10:什么是 RAG?一文讲清大模型的“外挂大脑”

RAG(检索增强生成)是大模型落地业务场景的核心架构,解决了模型知识静态、幻觉问题和微调成本高等痛点。它通过检索外部知识库增强生成过程,使回答有据可依、可验证且可更新。RAG流程包括文档准备、向量化、存储、检索和生成,显著提升企业知识库、智能客服等场景的可用性。虽然RAG不增强推理能力,但已成为大模型工程化的必经之路,是AI应用的默认架构选择。

RAG(Retrieval-Augmented Generation,检索增强生成)是当前大模型落地到真实业务场景的核心架构。

如果你遇到过以下问题:

- 大模型回答“看起来对”,但事实不可靠

- 无法让模型使用你自己的文档、数据库、知识库

- 数据一更新,就必须重新训练模型

那么,RAG 基本就是必选项,而不是可选项。

1. 为什么需要 RAG?

在没有 RAG 的情况下,大模型天然存在一些结构性限制。

1.1. 大模型的知识是“静态的”

大模型的知识来源于训练数据,而训练具有以下特点:

- 训练完成后,知识不会自动更新

- 无法直接访问企业内部数据

- 无法感知实时变化的数据

大模型并不是数据库,它无法“现查现用”。

1.2. 幻觉(Hallucination)问题不可避免

当模型缺乏足够信息时,它通常会:

- 基于概率生成“看起来合理”的答案

- 语言流畅,但事实错误

- 无法明确区分“不知道”和“猜测”

在金融、医疗、政务、企业知识库等场景中,这是致命问题。

1.3. 微调(Fine-tuning)并不是理想解法

很多人第一反应是:

“把数据拿去重新训练模型不就行了?”

但在工程实践中:

| 问题 | 说明 |

|---|---|

| 成本高 | 训练和推理成本极高 |

| 周期长 | 数据更新就要重新训练 |

| 灵活性差 | 不适合频繁变更的知识 |

| 风险大 | 可能破坏原有模型能力 |

👉 RAG 的出现,正是为了解决这些问题。

2. 什么是 RAG?

RAG = 检索(Retrieval) + 生成(Generation)

一句话概括:

在大模型生成回答之前,先从外部知识库中检索相关内容,再基于这些内容生成答案。

核心思想是:

- 不让模型“凭空作答”

- 让模型“有依据地回答”

3. RAG 的整体架构与流程

从系统工程角度看,一个标准 RAG 系统通常包含以下步骤。

Step 1:文档准备(Ingestion)

将原始数据整理为可处理的文本形式:

- PDF / Word / Markdown

- Wiki / 接口文档

- 数据库记录

- 日志、说明文档

并进行:

- 清洗

- 分段(Chunking)

- 元数据标注(来源、时间、权限等)

Step 2:向量化(Embedding)

使用 Embedding 模型将文本转为向量:

“PostgreSQL 是一个关系型数据库”

→ [-0.013, 0.082, 0.441, ...]

向量用于表示语义特征,而非关键词。

Step 3:向量存储(Vector Store)

将向量存入向量数据库,例如:

- PGVector(PostgreSQL)

- Qdrant

- Milvus

- Weaviate

- FAISS(本地)

并建立 ANN(近似最近邻)索引以支持高效相似度搜索。

Step 4:检索(Retrieval)

当用户提问时:

“Postgres 和 MySQL 有什么区别?”

系统会:

- 将问题向量化

- 在向量库中做相似度搜索

- 返回最相关的 Top-K 文档片段

Step 5:生成(Generation)

将检索结果作为上下文提供给大模型:【参考资料】 1. ... 2. ... 【问题】 Postgres 和 MySQL 有什么区别?

模型只基于给定内容进行回答,从而显著降低幻觉。

4. RAG 与直接使用大模型的对比

| 维度 | 直接 LLM | RAG |

|---|---|---|

| 数据来源 | 模型记忆 | 外部知识库 |

| 数据可更新 | ❌ | ✅ |

| 可控性 | ❌ | ✅ |

| 可追溯 | ❌ | ✅ |

| 幻觉概率 | 高 | 低 |

| 企业可用性 | 低 | 高 |

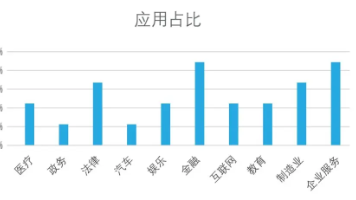

5. RAG 的典型应用场景

RAG 并非“高级玩法”,而是生产级必备能力。

✅ 企业知识库问答

- 内部制度

- 技术文档

- 运维手册

✅ 智能客服 / 工单系统

- 统一口径

- 避免编造答案

✅ AI 搜索系统

- 语义搜索

- 问答式搜索体验

✅ 私有数据 AI 化

- 本地部署

- 数据不出域

6. RAG 的边界与局限

RAG 不是万能解法:

- 检索质量决定回答上限

- 文档切分不合理会影响理解

- 不擅长强逻辑、复杂规划问题

- 无法替代事务型系统(OLTP)

RAG 增强的是“知识获取能力”,而不是推理能力本身。

7. 为什么说 RAG 是大模型工程化的必经之路?

可以这样理解:

- LLM 是大脑

- Embedding 是感知能力

- 向量数据库是记忆

- RAG 是连接神经系统

没有 RAG,大模型很难真正进入生产环境。

8. 总结

RAG 的核心价值不在于“让模型更聪明”,而在于:

- 让回答有来源

- 让结果可验证

- 让 AI 真正服务于业务

在可预见的未来:

RAG 将是 AI 应用的默认架构,而不是高级选项。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)