【收藏级】2026年大模型转行攻略|小白/程序员从零入门,轻松跻身AI热门领域

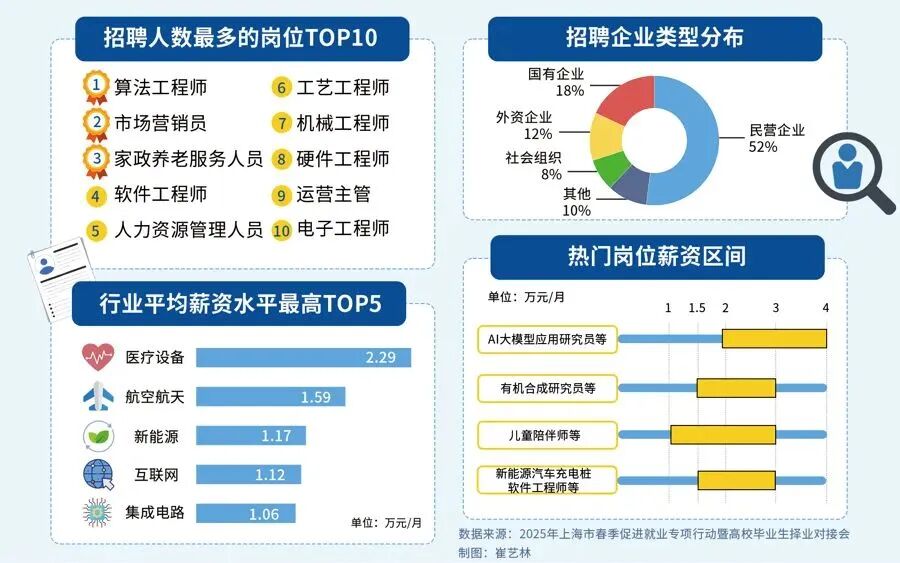

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

2026年,大模型技术持续爆发,已深度渗透互联网、金融、医疗等多个行业,相关人才缺口持续扩大,成为程序员转型、小白入行AI的最优赛道之一。本文为2026年全新修订版,结合当前大模型技术趋势和入门痛点,整理了一份从目标定位到职业落地的完整转型攻略,拆解每一步学习重点、实操方法和资源,帮助小白、程序员从零开始,高效切入大模型领域,少走弯路、快速上岸。

一、明确目标与方向(2026年适配版)

转行大模型,首要任务是找准定位——避免盲目跟风学习,结合自身基础(小白/程序员)和兴趣选择方向,才能提升学习效率、降低转型难度。2026年大模型领域核心方向已进一步细分,主要分为4类,适配不同基础人群:

1. 大模型开发(适配有编程基础的程序员)

核心是参与大模型的训练、微调和优化,侧重代码实操和模型调优能力。2026年更注重轻量化模型开发(适配中小企业落地),无需深耕超大规模模型训练,重点掌握预训练模型微调、参数优化等核心技能,入门门槛较往年有所降低,适合有Python、深度学习基础的程序员转型。

2. 大模型应用(适配小白+程序员,入门首选)

将大模型落地到具体业务场景,是2026年需求最旺盛、入门最容易的方向,无需深厚的数学和算法基础。核心涵盖自然语言处理(NLP)、计算机视觉(CV)、多模态交互等,比如开发AI聊天机器人、图片生成工具、文本润色系统等,小白可从工具调用、简单二次开发入手,程序员可结合自身业务经验快速转型。

3. 大模型研究(适配有数学/算法基础的程序员)

侧重大模型的理论研究,探索新的算法、架构和技术突破,比如优化Transformer架构、提升模型推理速度、解决多模态融合难点等。2026年重点关注高效训练、低资源适配等研究热点,适合对数学、算法有浓厚兴趣,愿意深耕技术底层的程序员,小白不建议优先选择。

4. 大模型工程(适配有运维/开发基础的程序员)

负责大模型的部署、运维、性能优化和工程化落地,是连接模型开发与实际应用的核心环节。2026年重点需求是云原生部署、边缘端模型适配、高并发场景优化,适合有服务器运维、项目工程化经验的程序员,小白可先从基础部署工具学习,逐步进阶。

补充建议:小白优先选择「大模型应用」方向,6-8个月可实现入门就业;程序员可根据自身基础,选择「开发」或「工程」方向,复用现有编程能力,缩短转型周期。

二、掌握基础知识(2026年入门必备,小白/程序员差异化指南)

无论小白还是程序员,基础知识都是入门大模型的基石。2026年入门要求更侧重「实用化」,无需死磕复杂理论,重点掌握能直接应用的知识和工具,以下是分模块拆解,适配不同基础人群:

(一)编程语言与工具(必学,优先级排序)

1. Python(核心中的核心,所有人必学)

大模型领域唯一主流编程语言,小白从基础语法入手,程序员可跳过基础,重点攻克大模型相关高频用法。

小白重点:熟练掌握语法、数据结构(列表、字典、集合)、控制流(if/for/while)、函数定义与调用,会使用基础模块(os、sys),无需深入高级特性,能看懂、写简单代码即可。

程序员重点:聚焦Python高级特性(装饰器、迭代器、生成器)、多线程/多进程(适配模型并行计算),熟练使用虚拟环境(conda、venv),规范代码编写(符合PEP8规范),为后续模型开发打基础。

2. 深度学习框架(优先PyTorch,2026年主流)

2026年,PyTorch凭借简洁的API、丰富的生态和研究领域的主导地位,成为大模型开发/应用的首选框架,TensorFlow可作为辅助学习(部分企业legacy项目仍在使用)。

核心学习重点:模型结构定义、数据集加载(Dataset、DataLoader)、优化器设置(Adam、SGD)、模型训练与评估的完整流程,无需深入框架底层源码,重点是能熟练调用,完成基础模型的搭建和训练。

补充:小白可借助PyTorch官方入门教程(2026年更新版),跟着实操案例学习,1-2周可掌握基础用法;程序员可快速上手,重点练习框架在大模型微调中的应用。

3. 数据处理与大模型工具(2026年新增重点)

这是小白与程序员拉开入门速度的关键,2026年无需从零搭建工具,重点掌握现成工具的使用,提升效率:

-

Pandas、NumPy:数据清洗、转换、统计的核心工具,小白需掌握基础的数据读取(read_csv)、缺失值处理、数据筛选,程序员可复用现有知识,重点练习大规模数据集的高效处理。

-

Hugging Face:2026年最核心的大模型工具库,提供海量预训练模型(BERT、GPT-4系列、Llama 3等)、一键微调工具、推理接口,小白可直接调用模型完成简单任务(如文本生成、分类),程序员可深入学习自定义微调、模型封装。

-

新增工具:LangChain(大模型应用开发框架,用于搭建聊天机器人、问答系统)、Gradio(快速构建模型演示界面),2026年企业高频需求,入门简单,建议优先学习。

(二)数学基础(按需学习,不盲目死磕)

数学是大模型的底层逻辑,但2026年入门无需精通所有知识点,按需取舍,重点掌握「能直接应用」的内容:

1. 线性代数(必备,最基础)

核心:矩阵运算(加法、乘法、转置)、向量的点积/叉积,理解“矩阵表示模型权重”的逻辑即可,无需深入复杂的特征值分解、矩阵求逆(小白可跳过推导,记住结论和用法)。

2. 概率论与统计(重点,影响模型调优)

核心:概率分布(正态分布、均匀分布)、贝叶斯定理、最大似然估计,理解“模型训练中的随机性”(如随机梯度下降)、“数据噪声的处理”,小白可结合实际案例理解,程序员可深入掌握其在模型调优中的应用。

3. 微积分(入门可简化)

核心:梯度、导数、链式法则,知道“梯度下降是模型优化的核心方法”,理解“导数表示参数变化对损失函数的影响”即可,小白无需推导复杂公式,程序员可重点掌握链式法则在反向传播中的应用。

(三)机器学习与深度学习基础(衔接大模型的关键)

1. 机器学习基础(小白必学,程序员可快速回顾)

无需学习所有算法,重点掌握3类核心算法,理解机器学习的基本思想:

-

线性回归:理解“输入与输出的线性关系”,掌握模型训练、损失计算的基本逻辑,是入门机器学习的基础。

-

决策树/随机森林:理解“分类与回归的核心思路”,无需深入源码,重点是掌握“特征选择”“模型评估”的基本方法。

-

SVM(支持向量机):了解其“寻找最优分类超平面”的核心思想,重点掌握其在小样本数据中的应用逻辑(适配大模型微调中的小样本场景)。

2. 深度学习基础(所有人必学)

核心掌握3个概念,衔接大模型学习:

-

神经网络:理解神经元、网络层、激活函数(ReLU、Sigmoid)的作用,知道“多层神经网络可拟合复杂数据”。

-

反向传播:理解其“计算梯度、更新模型参数”的核心流程,无需推导公式,重点是知道“反向传播是模型训练的核心步骤”。

-

损失函数:掌握常见损失函数(MSE、Cross-Entropy)的用途,知道“损失函数越小,模型性能越好”,以及如何根据任务选择合适的损失函数。

三、深入学习大模型技术(2026年核心重点,贴合行业需求)

基础知识掌握后,进入大模型核心技术学习,2026年重点聚焦「实用化技术」,摒弃过时内容,重点学习能直接应用、企业高频需求的知识点:

(一)Transformer架构(大模型的核心,必学)

Transformer是所有大模型(GPT、BERT、Llama等)的核心架构,2026年入门无需死磕论文推导,重点理解核心组件的作用和工作逻辑,能看懂架构图、说出核心原理即可。

核心学习重点:

-

自注意力机制(Self-Attention):理解其“捕捉序列数据长距离依赖”的优势,知道“如何计算每个token与其他token的关联度”,无需推导注意力分数的计算公式。

-

多头注意力机制(Multi-Head Attention):掌握其“拆分注意力、捕捉多维度特征”的逻辑,了解其在Transformer中的位置和作用。

(二)预训练与微调(2026年入门核心技能,必练)

2026年,大模型训练已进入“预训练+微调”的主流模式,无需从零训练大模型(成本高、难度大),重点掌握“利用预训练模型,通过微调适配具体任务”,这是企业入门岗位的核心要求。

1. 预训练(理解为主,无需实操)

核心:了解预训练模型的训练逻辑——在大规模无监督数据(文本、图像)上训练,学习通用特征(如语言语义、图像轮廓),掌握2026年主流预训练模型(GPT-4、Llama 3、BERT-base、CLIP)的特点和适用场景,知道“不同任务选择不同的预训练模型”(如文本分类选BERT,文本生成选GPT,多模态选CLIP)。

2. 微调(实操为主,必须练习)

核心:掌握在小规模任务数据上,微调预训练模型的完整流程,这是小白/程序员入门的关键实操技能,2026年重点练习“轻量化微调”(适配个人电脑,无需高端GPU)。

实操重点:使用Hugging Face Transformers库,完成文本分类、文本生成的微调任务,掌握“数据集准备、模型加载、参数设置、训练评估、模型保存与调用”的完整流程,小白可先使用Colab(免费GPU)实操,程序员可在本地搭建环境练习。

补充:2026年新增“LoRA微调”(低秩适配微调),轻量化、速度快,无需修改预训练模型全部参数,是企业高频使用的微调方法,建议重点学习。

(三)大模型优化(程序员重点,小白了解即可)

随着大模型落地场景增多,模型优化成为2026年企业核心需求,重点解决“模型体积大、推理慢、部署难”的问题,适合有编程/运维基础的程序员深入学习,小白可了解核心技术方向,无需深入实操。

1. 模型压缩(高频需求)

核心技术:知识蒸馏(将大模型知识迁移到小模型)、剪枝(去除无用参数)、量化(将高精度参数转为低精度,如FP32转FP16),重点理解每种技术的核心逻辑和适用场景,程序员可练习使用Hugging Face Accelerate库,实现简单的模型量化和剪枝。

2. 分布式训练(进阶内容)

核心:掌握多GPU、多节点的训练方法,解决“大模型训练显存不足、速度慢”的问题,重点学习PyTorch Distributed、Horovod等分布式框架的基础用法,了解“数据并行、模型并行”的区别,适合有工程化基础的程序员进阶学习。

(四)大模型应用(小白/程序员重点,贴合2026年业务场景)

2026年,大模型应用已全面落地,重点学习3个主流领域,掌握核心应用场景和实操方法,可直接对接企业入门岗位需求:

1. 自然语言处理(NLP)(入门首选,需求最旺)

核心场景:文本分类(情感分析、新闻分类)、文本生成(文案、摘要、代码生成)、问答系统(智能客服、知识库问答)、机器翻译,重点实操“文本分类”和“简单文本生成”,小白可使用LangChain+预训练模型,快速搭建简单的问答机器人,程序员可结合业务场景,开发定制化NLP工具。

2. 计算机视觉(CV)(进阶方向,适配有编程基础者)

核心场景:图像生成(扩散模型、GAN)、目标检测(YOLO系列)、图像分类,2026年重点学习“图像生成”(需求爆发),小白可使用Stable Diffusion、DALL-E API,快速生成图像,程序员可练习微调扩散模型,适配具体生成需求(如产品图、插画生成)。

3. 多模态模型(2026年热点,重点关注)

核心:融合文本、图像、音频等多种数据,实现跨模态交互(如图文生成、语音转文本+摘要),主流模型:CLIP(图文匹配)、DALL-E 3(图文生成)、GPT-4V(多模态理解),重点理解“多模态数据的处理逻辑”,小白可调用API实操,程序员可学习多模态模型的微调与部署,提升竞争力。

四、实践项目(2026年入门实操,小白/程序员可直接上手)

理论学习再多,不如实操一个项目——实践是掌握大模型技术的关键,也是求职时的核心竞争力。以下4个项目,从易到难,适配小白和程序员,可直接使用公开数据集和工具,无需从零搭建,重点练习“完整流程”(数据准备→模型选择→微调/调用→评估→部署演示):

1. 文本分类(小白入门首选,难度★★☆)

项目目标:使用BERT或Llama 3微调,实现电影评论情感分类(正面/负面),掌握大模型微调的完整流程。

实操细节:使用IMDB电影评论公开数据集(可从Hugging Face Datasets获取),用PyTorch+Transformers库,完成数据集加载、模型微调、训练评估,最后用Gradio搭建简单的演示界面,输入电影评论,输出情感标签。

补充:小白可使用Colab免费GPU,按照网上的分步教程实操,1周可完成;程序员可优化模型性能(如使用LoRA微调、调整参数),提升分类准确率。

2. 简单问答系统(小白/程序员适配,难度★★★)

项目目标:基于BERT或GPT-3.5-turbo,搭建一个简单的问答系统,输入问题,输出准确答案(如基于《西游记》知识库的问答)。

实操细节:使用SQuAD公开问答数据集,或自行整理简单的知识库(如Excel表格),用LangChain框架加载预训练模型,实现“问题解析→知识库匹配→答案生成”的完整流程,最后部署为简单的网页演示版(Gradio即可实现)。

3. 文本生成工具(程序员重点,难度★★★☆)

项目目标:使用GPT-2或Llama 3,微调实现“文案生成”(如产品文案、朋友圈文案),掌握文本生成类模型的微调与调用。

实操细节:自行整理文案数据集(如爬取电商产品文案),用Hugging Face Transformers库微调模型,优化生成效果(调整温度系数、最大生成长度),最后封装为Python脚本,可直接输入关键词,生成对应文案。

4. 图像生成演示工具(进阶项目,难度★★★☆)

项目目标:调用Stable Diffusion API,搭建一个图像生成工具,输入文本描述(如“一只可爱的猫咪,卡通风格,蓝色背景”),生成对应图像。

实操细节:使用Stable Diffusion WebUI,或用Python调用API,结合Gradio搭建演示界面,优化文本描述与图像生成的匹配度,程序员可尝试微调扩散模型,生成特定风格的图像(如企业LOGO、产品图)。

补充建议:每个项目完成后,将代码上传到GitHub,标注详细的操作步骤和注释,既是对学习的总结,也是求职时的重要背书(企业非常看重实操项目经验)。

五、参与开源社区(2026年快速提升,积累人脉与经验)

开源社区是大模型学习的“免费宝库”,尤其是对于小白和程序员,参与开源社区可以:接触最新技术、学习优秀代码、结识行业同行、积累项目经验,甚至获得企业内推机会,2026年重点关注以下4个开源社区/项目,适配入门人群:

1. Hugging Face(入门首选,必关注)

核心优势:2026年全球最大的大模型开源社区,提供海量预训练模型、工具库、数据集和实操教程,还有活跃的讨论区,小白可在这里找数据集、学微调教程,程序员可阅读源码、提交代码贡献(如修复简单BUG、优化文档),快速提升技术能力。

参与方式:注册账号,star热门模型仓库(如transformers、datasets),跟随社区教程实操,在讨论区提问、解答问题,尝试提交简单的PR(Pull Request)。

2. OpenAI(关注前沿,了解趋势)

核心优势:大模型领域的标杆,2026年持续发布GPT系列、多模态模型的最新进展和开源工具,关注其开源项目和技术博客,可及时了解行业前沿趋势(如模型优化、新应用场景),适合所有入门者。

参与方式:关注OpenAI GitHub仓库和官方博客,尝试使用其开源工具(如OpenAI API),参与社区讨论,了解最新模型的应用方法。

3. PyTorch Lightning(程序员重点,简化训练流程)

核心优势:基于PyTorch的开源框架,封装了训练流程,简化代码编写(无需重复写训练循环),2026年被广泛应用于大模型训练和微调,适合有编程基础的程序员学习,提升项目开发效率。

参与方式:学习官方文档,用PyTorch Lightning重构自己的实践项目,提交代码优化建议,参与社区讨论,解决项目中遇到的问题。

4. 国内开源社区(适配中文用户,小白友好)

补充:2026年国内大模型开源社区快速发展,如字节跳动即梦AI(字节跳动旗下AI创作平台,提供中文预训练模型和实操教程)、阿里云PAI、百度飞桨,中文文档、教程更适配国内入门者,小白可重点关注,获取中文学习资源和国内行业动态。

参与建议:无需盲目追求“提交核心代码”,小白可从“阅读源码、提问、整理教程”入手,程序员可结合自身基础,提交简单的代码贡献,重点是积累经验、拓宽视野。

六、学习资源推荐(2026年全新整理,小白/程序员适配)

整理了2026年最新、最实用的学习资源,涵盖在线课程、书籍、论文、博客,按需选择,避免盲目搜集资源,节省时间:

(一)在线课程(优先免费,入门友好)

1. Coursera:Andrew Ng《深度学习专项课程》(2026年修订版)

推荐理由:深度学习领域的经典课程,Andrew Ng授课,2026年更新了大模型相关内容,系统讲解深度学习基础、Transformer架构、预训练与微调,适合小白入门、程序员回顾基础,免费旁听,付费可获取证书。

2. 字节跳动即梦AI:《大模型入门实操课程》(免费,中文)

推荐理由:字节跳动旗下AI创作平台推出的入门课程,2026年全新上线,适配中文用户,重点讲解大模型应用、微调实操,搭配字节跳动开源的中文预训练模型,小白可直接跟着实操,无需担心语言和难度问题。

3. Fast.ai:《面向实践的大模型课程》(免费)

推荐理由:侧重实操,2026年更新了大模型应用和微调案例,适合有一定Python基础的小白和程序员,跟着课程可快速完成多个实践项目,提升动手能力。

(二)书籍(重点3本,无需多买)

1. 《深度学习》(Ian Goodfellow,2026年修订版)

推荐理由:深度学习经典教材,被称为“深度学习圣经”,2026年更新了大模型相关章节,全面讲解数学基础、深度学习算法、Transformer架构,适合程序员深入学习,小白可重点阅读前3-5章,掌握基础概念。

2. 《动手学深度学习》(李沐,2026年第3版)

推荐理由:最适合中文入门者的实践指南,2026年新增了大模型微调、LangChain应用、多模态模型等内容,搭配大量PyTorch实操代码,小白和程序员可跟着代码一步步学习,快速上手实操。

3. 《大模型应用开发实战》(2026年新书)

推荐理由:聚焦大模型实用化开发,讲解Hugging Face、LangChain、Gradio等工具的使用,以及文本生成、问答系统、图像生成等项目的完整开发流程,适合小白和程序员学习,可直接对接企业岗位需求。

(三)论文与博客(碎片化学习,了解前沿)

1. 论文:重点2篇(无需精读,理解核心)

- 《Attention is All You Need》:Transformer架构的核心论文,2026年入门无需精读公式,重点看架构图和核心逻辑,了解自注意力机制的作用。

- 《LoRA: Low-Rank Adaptation of Large Language Models》:2026年高频使用的微调方法论文,理解LoRA微调的核心逻辑,掌握其在大模型微调中的应用。

2. 博客:重点3个(碎片化学习,适配CSDN用户)

- CSDN大模型专栏:国内程序员最集中的学习平台,很多从业者分享实操教程、项目经验、求职技巧,小白可搜索“大模型入门”“BERT微调”,程序员可关注行业大佬的博客,了解企业实操经验。

- Medium:国外技术博客,有大量大模型相关的技术文章,2026年重点关注轻量化微调、多模态应用相关内容,可借助翻译工具阅读。

- 字节跳动即梦AI博客:中文博客,更新大模型技术动态、实操教程、国内行业趋势,适配中文用户,小白和程序员可重点关注。

七、职业发展建议(2026年适配,小白/程序员差异化指导)

学习大模型的最终目的是实现职业转型或晋升,结合2026年大模型行业趋势,给小白和程序员提供3点核心职业建议,帮助快速落地就业、提升竞争力:

(一)构建个人品牌(所有人必做,提升求职竞争力)

1. GitHub:打造个人技术名片

核心:将实践项目、学习笔记、代码封装上传到GitHub,规范代码注释,完善项目README(说明项目目标、实操步骤、依赖环境),小白可上传入门项目(如文本分类、问答系统),程序员可上传优化后的项目(如模型压缩、多模态应用),定期更新,吸引雇主关注。

2. 技术分享:提升知名度

核心:在CSDN、知乎、小红书等平台,分享大模型学习心得、实操教程、项目复盘,比如“小白从零微调BERT全过程”“2026年大模型入门工具推荐”,既能帮助其他学习者,也能提升自己的总结和表达能力,建立个人技术品牌,甚至获得企业内推机会。

3. 参加技术会议和比赛

核心:2026年有很多大模型相关的技术会议(如WAIC、CCF-GAIR)和比赛(如字节跳动即梦AI大赛、阿里云大模型应用大赛),小白可参加入门组比赛,积累经验;程序员可参加进阶组比赛,展示技术实力,获奖经历会成为求职时的加分项,还能结识行业专家和同行。

(二)寻找实习/全职机会(2026年岗位适配)

1. 小白:优先入门岗位,积累经验

核心岗位:大模型应用工程师助理、AI训练师、大模型运维助理,重点关注中小企业(门槛低、注重实操),无需追求大厂,先积累项目经验,掌握基础实操技能,1-2年后再跳槽提升。

2. 程序员:复用现有基础,快速转型

核心岗位:大模型开发工程师、大模型工程化工程师、多模态应用工程师,重点关注大厂(字节跳动、阿里、百度)和优质初创公司,大厂注重基础和技术深度,初创公司注重实操和业务落地,可根据自身需求选择。

补充:2026年,字节跳动即梦AI等国内平台持续扩招,重点招聘大模型应用、微调、部署相关人才,对小白和程序员都很友好,可重点关注其招聘信息。

(三)持续学习(大模型领域必备,避免被淘汰)

大模型技术更新速度极快,2026年的主流技术,可能2027年就会有新的优化和突破,保持持续学习的习惯,才能跟上行业步伐:

- 关注行业动态:定期看技术博客、开源社区、官方公告,了解最新模型、工具和应用场景。

- 深耕核心技能:不要盲目追求“学得多”,重点深耕1-2个方向(如大模型应用、模型微调),成为该方向的入门专家。

- 交流学习:加入大模型学习社群、开源社区,与同行交流经验,解决学习和工作中遇到的问题,拓宽视野。

八、常见问题解答(2026年小白/程序员高频疑问,精准解答)

1. 没有机器学习基础,小白能转行大模型吗?

可以,2026年大模型入门门槛已降低,小白可从「大模型应用」方向入手,无需先精通机器学习。建议先花1-2个月,掌握Python基础和简单的深度学习概念(如神经网络、损失函数),再学习大模型应用和微调实操,配合实践项目,6-8个月可实现入门就业。核心是有决心、多实操,不要害怕数学和代码。

2. 程序员转行大模型,需要多长时间?

视个人基础而定,通常3-6个月即可实现转型:

- 有Python、深度学习基础(如做过CV、NLP项目):3个月左右,重点学习Transformer架构、大模型微调、LoRA等核心技术,补充实践项目,即可投递入门岗位。

- 只有编程基础(无深度学习经验):4-6个月,先花1-2个月补深度学习基础,再学习大模型核心技术和实操,积累2-3个实践项目,即可转型。

3. 2026年大模型领域的职业前景如何?值得转行吗?

非常值得,2026年大模型领域职业前景广阔,核心优势有3点:

- 需求大:随着大模型在各行业落地,开发、应用、工程化等方向人才缺口持续扩大,岗位充足。

- 薪资高:入门岗位薪资普遍高于传统编程岗位(如Java、前端),有1-2年经验后,薪资涨幅明显。

- 发展稳:大模型是AI领域的长期主流方向,技术持续迭代,不会短期过时,且可横向拓展(如从应用转向开发、研究),职业发展空间大。

4. 小白/程序员学习大模型,最容易踩的坑是什么?如何避免?

最常见的3个坑,避开就能少走很多弯路:

-

坑1:盲目死磕数学和论文,忽略实操。建议:小白/程序员优先学实用知识和工具,数学和论文按需学习,重点放在实操和项目上。

-

坑2:追求“学得多”,不聚焦。建议:重点深耕1-2个方向(如小白聚焦应用,程序员聚焦开发/工程),不要同时学多个方向,避免贪多嚼不烂。

-

坑3:只学不练,没有实践项目。建议:每学习一个知识点,就搭配对应的实操,完成2-3个完整的实践项目,项目是求职的核心竞争力。

最后,2026年是大模型转型的黄金期,无论是小白还是程序员,只要找准方向、系统学习、多实操、多积累,都能成功跻身大模型领域。希望这份攻略能帮助你少走弯路,从零开始,实现职业升级,在AI浪潮中抓住机遇!

最后

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?

答案只有一个:人工智能(尤其是大模型方向)

当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应聘者,月基础工资也能稳定在4万元左右。

再看阿里、腾讯两大互联网大厂,非“人才计划”的AI相关岗位应聘者,月基础工资也约有3万元,远超其他行业同资历岗位的薪资水平,对于程序员、小白来说,无疑是绝佳的转型和提升赛道。

对于想入局大模型、抢占未来10年行业红利的程序员和小白来说,现在正是最好的学习时机:行业缺口大、大厂需求旺、薪资天花板高,只要找准学习方向,稳步提升技能,就能轻松摆脱“低薪困境”,抓住AI时代的职业机遇。

如果你还不知道从何开始,我自己整理一套全网最全最细的大模型零基础教程,我也是一路自学走过来的,很清楚小白前期学习的痛楚,你要是没有方向还没有好的资源,根本学不到东西!

下面是我整理的大模型学习资源,希望能帮到你。

👇👇扫码免费领取全部内容👇👇

最后

1、大模型学习路线

2、从0到进阶大模型学习视频教程

从入门到进阶这里都有,跟着老师学习事半功倍。

3、 入门必看大模型学习书籍&文档.pdf(书面上的技术书籍确实太多了,这些是我精选出来的,还有很多不在图里)

4、 AI大模型最新行业报告

2026最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

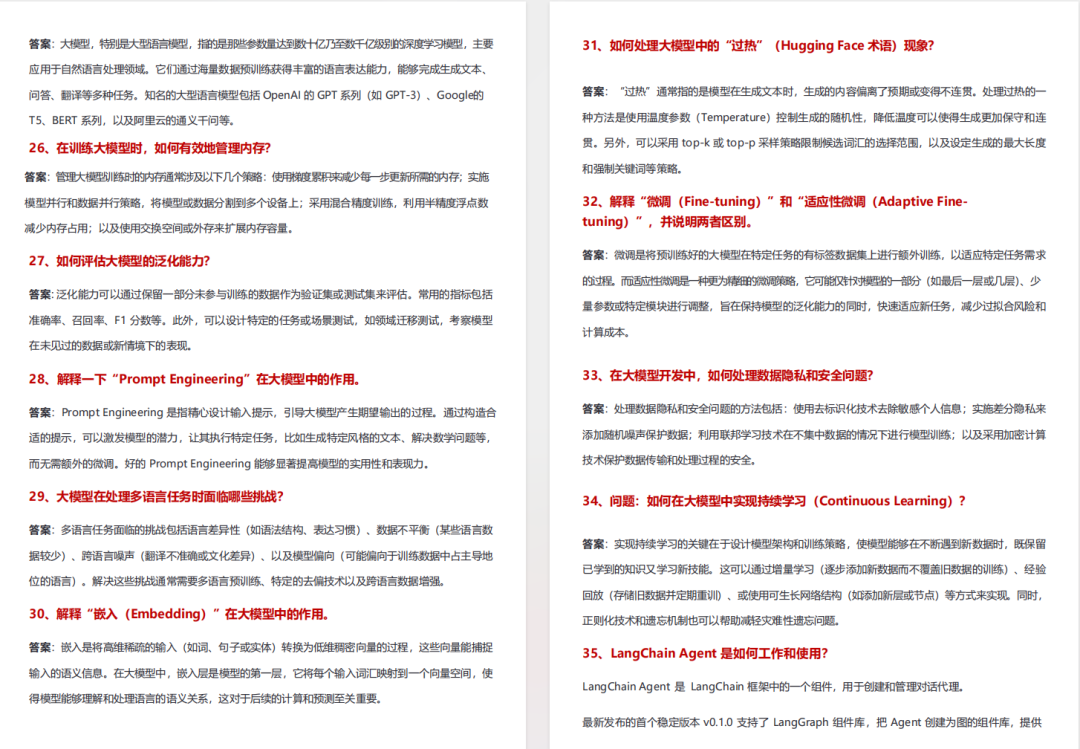

5、面试试题/经验

【大厂 AI 岗位面经分享(107 道)】

【AI 大模型面试真题(102 道)】

【LLMs 面试真题(97 道)】

6、大模型项目实战&配套源码

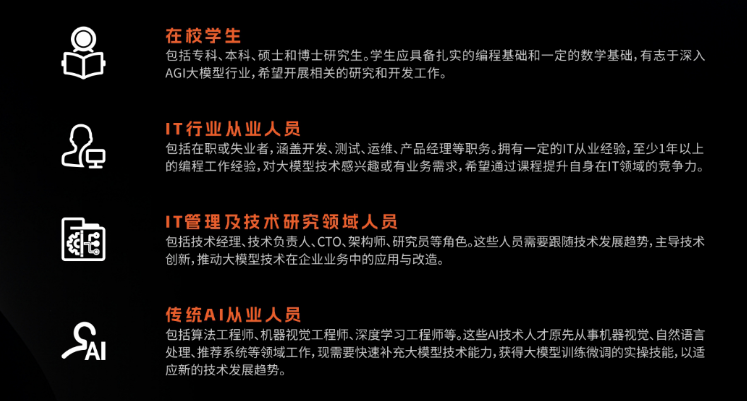

适用人群

四阶段学习规划(共90天,可落地执行)

第一阶段(10天):初阶应用

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

- 大模型 AI 能干什么?

- 大模型是怎样获得「智能」的?

- 用好 AI 的核心心法

- 大模型应用业务架构

- 大模型应用技术架构

- 代码示例:向 GPT-3.5 灌入新知识

- 提示工程的意义和核心思想

- Prompt 典型构成

- 指令调优方法论

- 思维链和思维树

- Prompt 攻击和防范

- …

第二阶段(30天):高阶应用

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

- 为什么要做 RAG

- 搭建一个简单的 ChatPDF

- 检索的基础概念

- 什么是向量表示(Embeddings)

- 向量数据库与向量检索

- 基于向量检索的 RAG

- 搭建 RAG 系统的扩展知识

- 混合检索与 RAG-Fusion 简介

- 向量模型本地部署

- …

第三阶段(30天):模型训练

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- 为什么要做 RAG

- 什么是模型

- 什么是模型训练

- 求解器 & 损失函数简介

- 小实验2:手写一个简单的神经网络并训练它

- 什么是训练/预训练/微调/轻量化微调

- Transformer结构简介

- 轻量化微调

- 实验数据集的构建

- …

第四阶段(20天):商业闭环

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

-

硬件选型

-

带你了解全球大模型

-

使用国产大模型服务

-

搭建 OpenAI 代理

-

热身:基于阿里云 PAI 部署 Stable Diffusion

-

在本地计算机运行大模型

-

大模型的私有化部署

-

基于 vLLM 部署大模型

-

案例:如何优雅地在阿里云私有部署开源大模型

-

部署一套开源 LLM 项目

-

内容安全

-

互联网信息服务算法备案

-

…

👇👇扫码免费领取全部内容👇👇

3、这些资料真的有用吗?

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献426条内容

已为社区贡献426条内容

所有评论(0)