差分隐私深度学习(DP-DL)简要理解

差分隐私深度学习是目前在敏感数据上训练实用AI模型时,提供严格隐私保证的黄金标准方法。它通过梯度裁剪和噪声注入,在模型效用与隐私保护强度之间进行根本性权衡。最新研究趋势提升效用:研究自适应的裁剪阈值、更优的噪声分布、与非凸优化理论结合以减小精度损失。与其他技术结合:与同态加密安全多方计算结合,构建多层防御的隐私计算体系;与联邦学习深度集成,实现端到端的隐私保护。自动化与工具化:研究自动调整隐私参数

·

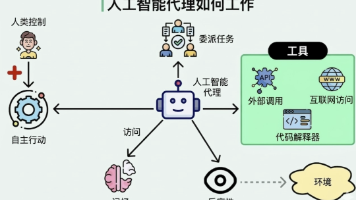

差分隐私深度学习(DP-DL)是一种在模型训练过程中严格量化并限制隐私泄露的技术。它通过系统性地在训练的关键步骤注入经过数学校准的噪声,确保从训练好的模型中难以反推任何单个训练样本的信息。

🛡️ 核心原理:从噪声中学习

其核心思想可概括为:在保护隐私的前提下,保证模型有用的前提是保证信息传递链路上泄漏的风险可控。它通过在两个关键环节注入噪声来实现:

- 算法层面差分隐私:这是最核心、最常用的实现层次。它将差分隐私的严格数学定义应用于随机梯度下降算法,确保每次模型参数更新都满足隐私约束。

- 目标层面差分隐私:在训练目标的损失函数中加入与隐私相关的正则化项(较少用)。

🧩 算法层面差分隐私的核心步骤

下图清晰地展示了 DP-SGD 算法的基本工作流程:

⚖️ 优缺点分析

差分隐私深度学习并非万能,其优缺点非常鲜明:

| 优点 | 缺点 |

|---|---|

| 1. 严格的数学隐私保障:提供可量化、可证明的隐私保证,隐私泄露有理论上界。 | 1. 效用损失:噪声必然降低模型准确性(如准确率可能下降1-5%或更多)。 |

| 2. 防御能力强:能防御包括成员推理攻击在内的多种隐私攻击,攻击者几乎无法确定特定数据是否在训练集中。 | 2. 训练效率降低:梯度裁剪、噪声添加和更小的批次使得训练收敛更慢,时间成本更高。 |

| 3. 兼容性强:可与深度学习框架(如PyTorch, TensorFlow)结合,无需改变模型基本架构。 | 3. 超参数调优复杂:隐私预算、噪声尺度、裁剪阈值等需精细权衡,调试难度大。 |

| 4. 隐私预算可管理:隐私消耗可累计计算与跟踪,方便管理整个项目的生命周期。 | 4. 对大批次数据友好:为降低噪声影响,需要更大批次,可能增加内存压力。 |

🔧 实现方法与工具

实现DP-DL主要依赖对标准训练流程的修改。现代深度学习框架提供了相应支持。

核心实现步骤:

- 替换优化器:使用差分隐私优化器(如 DP-SGD)替代标准的SGD或Adam。

- 设置隐私参数:

- 隐私预算:确定整个训练过程允许的总隐私损失(ε, δ)。例如 (ε=3, δ=1e-5)。

- 梯度裁剪:设定一个裁剪阈值

C,将每个样本的梯度范数限制在C以内,防止个别样本影响过大。 - 噪声尺度:根据隐私预算、数据集大小和训练轮数,计算需要添加的高斯噪声的标准差σ。

- 训练与审计:使用修改后的流程训练模型,并全程跟踪累积的隐私消耗。

主流工具库:

- TensorFlow Privacy / PyTorch Opacus:这两个官方支持的库封装了DP-SGD,只需几行代码即可改造现有训练脚本。

- TensorFlow Privacy代码示例:

import tensorflow_privacy

# 定义差分隐私优化器

optimizer = tensorflow_privacy.DPKerasSGDOptimizer(

l2_norm_clip=1.0, # 梯度裁剪阈值C

noise_multiplier=0.8, # 噪声乘数σ

num_microbatches=1,

learning_rate=0.01

)

# 然后像普通优化器一样编译和训练模型

model.compile(optimizer=optimizer, loss='categorical_crossentropy')

model.fit(train_data, train_labels, epochs=10)

🏥 应用场景

DP-DL特别适用于处理高度敏感数据的场景:

- 医疗健康:在多家医院联合训练疾病诊断模型时,保护病人病历隐私。

- 金融风控:银行间合作训练反欺诈模型,但不可泄露任何客户的交易细节。

- 移动设备(联邦学习):在手机端利用用户本地数据改进输入法或推荐模型,并将满足差分隐私的模型更新聚合至云端,防止从更新中反推原始数据。

- 政府与人口统计:在发布基于人口普查数据训练的预测模型或统计信息时,保护每个公民的个体信息。

- 企业内部敏感数据:公司利用包含用户隐私或商业机密的数据训练内部模型,避免模型记忆并泄露具体信息。

💎 总结与最新趋势

差分隐私深度学习是目前在敏感数据上训练实用AI模型时,提供严格隐私保证的黄金标准方法。它通过梯度裁剪和噪声注入,在模型效用与隐私保护强度之间进行根本性权衡。

最新研究趋势:

- 提升效用:研究自适应的裁剪阈值、更优的噪声分布、与非凸优化理论结合以减小精度损失。

- 与其他技术结合:与同态加密、安全多方计算结合,构建多层防御的隐私计算体系;与联邦学习深度集成,实现端到端的隐私保护。

- 自动化与工具化:研究自动调整隐私参数,降低工程师的使用门槛。

总而言之,当你需要在利用数据训练强大模型的同时,履行严格的隐私保护合规承诺(如GDPR),或防御针对模型的隐私窃取攻击时,差分隐私深度学习是实现这一目标的核心技术路径。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)