AI架构选择指南:RAG还是智能体?小白程序员别再瞎卷,用对工具才是硬道理!

文章详细解析了AI领域中RAG与智能体两种架构的技术原理、差异与应用场景。RAG作为知识增强器,专注于提供精准可靠的答案;智能体作为自主决策者,能执行复杂任务。文章通过"高级研究员vs智能工具库"的比喻,帮助读者理解两者的关系,并提供了基于场景的架构选择指南,包括两者融合的Agentic RAG架构,帮助开发者根据实际需求做出最合适的技术选择。

在探索人工智能技术落地的过程中,RAG与智能体是两类极具魅力的架构。大模型是基础能力提供者,RAG为LLM提供外部知识检索的知识增强器,而智能体是行动的自主决策者。RAG和智能体都构建在大模型的能力之上,这种层级关系是解释它们原理和应用边界的关键。

理解这一点至关重要,因为错误的技术选型,如同用精密的瑞士军刀去砍树,或用沉重的斧头去雕刻细节——不仅事倍功半,还可能完全无法达成目标。

本文将为你清晰揭示两者的核心差异,并通过一个贯穿始终的生动比喻,深入剖析它们如何从“各行其道”走向“珠联璧合”。我们最终将提供一个简洁有力的决策指南,帮助你无论面对何种场景,都能做出最精准、最经济的架构选择。

一、技术原理

1、大模型:通识的基石

大模型(如GPT系列)的本质是对人类知识的一种“模糊压缩”。它通过在海量文本数据上进行预训练,学会了语言的模式和浅层知识关联。其工作原理是根据上文预测下一个词的概率分布,从而生成连贯的文本。但它的知识局限于训练数据,可能过时或产生“幻觉”(即生成不准确的信息),且无法直接与外部世界互动。

2、RAG:精准的知识增强器

RAG的诞生就是为了弥补大模型的上述缺陷。其工作流程如同一位学者在撰写报告前先让助理去图书馆查阅资料:

(1)检索:将用户查询转化为向量,在向量数据库等外部知识库中快速查找最相关的信息片段。

(2)增强:将检索到的精准信息作为“参考资料”和原始问题一起提供给大模型。

(3)生成:大模型基于这些可靠依据生成最终答案,显著提升回答的事实准确性和可信度。

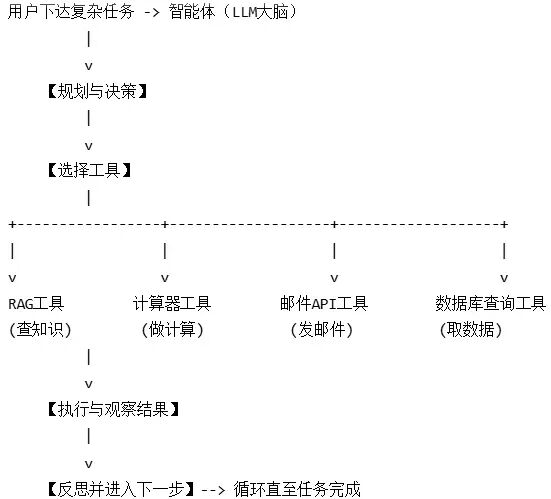

3、智能体:自主的项目执行官

智能体将大模型从“思考者”提升为“行动者”。它通常包含几个关键模块:

(1)规划:利用LLM的推理能力,将复杂目标拆解为具体步骤。

(2)工具调用:通过函数调用(Function Calling) 能力,调用外部API、数据库或软件,例如查询天气、发送邮件或执行计算。

(3)反思:评估行动结果,若失败则调整计划,形成“感知-决策-执行-反馈”的自主循环。

二、架构差异

1、RAG:精准的知识增强器。RAG的架构本质上是线性的,旨在通过引入外部知识来纠正大模型的“幻觉”问题。其工作流程如同撰写论文前先查阅资料:当用户提问时,RAG首先将问题转化为向量,在向量数据库等外部知识库中检索最相关的信息片段;然后将这些信息作为“参考资料”和原始问题一并提供给大模型;最后,大模型基于这些可靠依据生成最终答案。这种架构使其在智能客服、企业知识库问答、专业领域辅助等需要严格依据给定资料回答的场景中表现出色。然而,它的能力边界也很明显:通常只处理单轮问答,缺乏复杂的规划推理能力,知识更新依赖于后台对知识库的维护。

2、智能体:自主的行动执行官。智能体是一个更为复杂的系统,其目标是让AI从“思考者”变为“行动者”。它通常包含几个关键模块:规划(利用LLM的推理能力,将复杂目标拆解为具体步骤)、工具调用(通过函数调用能力,调用外部API、数据库或软件,如查询天气、发送邮件)、反思(评估行动结果,若失败则调整计划)。这就形成了一个自主的“感知-决策-执行-反馈”循环。因此,智能体非常适合自动化工作流、复杂游戏AI、需要动态交互的机器人控制等场景。其挑战在于系统复杂度和对LLM推理能力的依赖更高。

三、技术应用选择

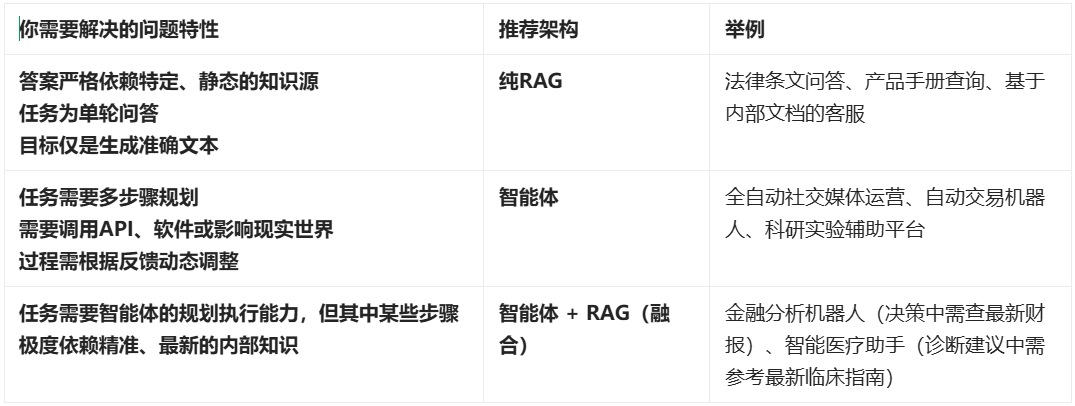

理解了技术原理,在实际应用中做出正确选择就水到渠成了。

1、追求答案精准可靠时,用RAG。当你需要模型严格依据内部文档、最新法规或专业数据库来回答问题,避免其“胡编乱造”时,RAG是首选。例如,搭建一个回答员工内部政策问题的系统,RAG能确保答案的准确性。

2、处理多步骤的开放任务时,用智能体。当任务涉及多个决策点、需要动态调用不同工具或与外部环境持续交互时,就需要智能体。例如,需要一个系统能自动监控库存、在库存不足时生成采购单并发送给供应商,这个完整流程就适合由智能体来完成。

3、从简单开始,按需增加复杂度。一个重要的原则是:不要盲目追求技术的复杂性。许多应用场景可能只需要精心设计的提示词(Prompt Engineering)或简单的RAG就能很好解决。应从最简单的可行方案入手,只有当业务确实需要更高的自主性时,才考虑引入智能体架构。

新手容易一上来就想做智能体,但很多问题其实RAG加提示词就够了。我得强调评估标准:需不需要多步骤规划?要不要调用多个工具?环境是不是动态的?用采购员例子对比就很直观——查价格用RAG,完整采购用智能体。

4、技术融合,Agentic RAG。RAG和智能体并非互斥,而是趋向于深度融合,形成更强大的解决方案,即“Agentic RAG”。在这种架构下,智能体作为决策核心,在规划任务步骤的过程中,可以主动调用RAG作为其一个工具来获取所需的知识。例如,一个科研智能体在规划实验步骤时,可以先通过RAG检索最新的相关文献,再决定下一步操作。这种融合架构结合了二者的优势,正成为下一代AI应用的重要方向。

四、技术融合架构

RAG本质是给LLM用的精准工具,而智能体是使用工具的执行者,下面用“高级研究员vs实习生”的例子具象化:研究员(智能体)和工具库(RAG),在写论文时,会主动决定何时查资料(调用RAG)、何时做实验(调用API)。这个例子能把“规划-执行-反思”的循环和RAG的被动增强区别开。

1、核心比喻:高级研究员 vs. 智能工具库

想象你是一家公司的高级研究员(智能体)。你有一个明确的项目目标,比如“完成一份关于新兴市场的季度分析报告”。

(1)你(智能体)的核心能力是:规划:拆解任务——“我需要先查行业数据,再看竞争对手动态,接着分析政策,最后撰写报告。”决策:决定每一步用什么方法、找谁、用什么工具。反思与调整:发现某个数据源不可靠,马上更换另一个。执行:最终完成并提交报告。

为了完成工作,你可以使用一个极其高效、精准的内部资料库(RAG系统)。

(2)这个资料库(RAG)的核心能力是:精准检索:你问“上个季度东南亚智能手机的出货量数据”,它能立刻从海量内部报告、市场数据中找出最相关的几段原文给你。提供依据:它给你的信息是有出处的、可靠的。被动响应:它不会主动干活。只有当你提问时,它才给出答案。

关键来了:在完成“分析报告”这个大任务的过程中,研究员(智能体)会多次、主动地去查询资料库(RAG)。比如,在“分析政策”这一步,你会主动去问:“请给我找一下越南本月最新发布的AI产业扶持政策原文。”这个过程,就是 “智能体驱动的RAG”或“Agentic RAG”——智能体是“大脑”和“执行者”,RAG是其手中一个强大、精准的“工具”。

2、融合架构

在技术架构上,RAG从一个独立的问答系统,降级为智能体工具箱中的一个标准工具。

(1)传统独立RAG应用架构:

用户提问 -> 检索 -> 增强提示词 -> LLM生成 -> 答案(一次性流程,终点是生成文本答案)

(2)融合后的智能体架构(包含RAG工具):

在这个架构里,RAG模块被封装成了一个标准的、可供调用的函数(Function),比如 search_knowledge_base(query: str) 。当智能体在规划路径中判断“此刻我需要一个精准、可靠的事实依据”时,它就会调用这个函数。

3、根据场景选择架构

场景一:公司内部知识助手

(1)任务:员工问:“我们公司今年的年假政策,对老员工有什么额外福利?”

(2)分析:这是一个单轮、事实性问题,答案严格依据一份静态文档(《员工手册》)。目标就是精准、不出错。

(3)正确选择:纯RAG架构。架构简单、成本低、效果直接。用户提问 -> 从向量化的《员工手册》中检索相关条款 -> 让LLM基于条款生成友好回答。

(4)新手误区:觉得这很“智能”,想用智能体。结果增加了不必要的复杂度和延迟。

场景二:自动化竞品分析周报

(1)任务:“请分析过去一周内,竞争对手A、B在产品发布和社交媒体上的动态,总结趋势并草拟一份邮件周报发给市场部。”

(2)分析:这是一个多步骤、开放式的复杂任务。涉及:1. 规划分析维度;2. 调用工具获取信息(爬取竞品官网、抓取社交媒体);3. 分析信息;4. 撰写总结;5. 调用邮件接口发送。任务是非标、动态的,且需要与多个外部系统交互。

(3)正确选择:智能体架构。智能体可以规划步骤,并按顺序调用不同的工具(网络搜索工具、情感分析API、邮件API等)。在整个过程中,如果需要依据某个内部分析框架(如《品牌声量评估模型V2.0》),它可以主动调用RAG工具来获取这个框架的细节。

(4)新手误区:试图用一个复杂的提示词让RAG完成所有事,结果LLM会因为无法执行实际动作(发邮件、获取实时信息)而失败。

场景三:智能游戏NPC

(1)任务:在一个开放世界游戏中,创建一个有背景故事、能自由与玩家对话并推动任务的NPC。

(2)分析:NPC需要:

- 长期记忆(记得和玩家的过往);

- 知识储备(了解游戏世界设定);

- 自主决策(决定现在去酒馆还是铁匠铺);

- 环境交互(执行“去酒馆”这个动作)。

(3)正确选择:以智能体为核心,深度融合RAG。

-

智能体模块:负责决策、规划日常行为、管理对话目标。

-

RAG作为记忆和知识库:

记忆RAG:将NPC与玩家每次的对话摘要存入向量库。每次对话前,先检索“记忆”,让NPC能说“你上次给我的剑好用吗?”

世界知识RAG:将游戏庞大的世界观设定文本向量化。当玩家问“这个王 国的历史是什么?”,NPC能通过检索给出符合设定的回答,避免胡编。

-

其他工具:导航系统、动作执行系统等。

(4)融合价值:实现了既有“灵魂”(自主性),又有“记忆”和“知识”(准确性) 的高阶NPC。

从精准回答的“知识库专家”(RAG),到自主行动的“全能执行官”(智能体),再到两者融合所诞生的“有记忆、有知识、能行动的超级助手”,我们看到了AI架构演进的清晰脉络。选择的核心,始终在于**深刻理解你所要解决问题的本质**:

若追求精准,请选择RAG。

若追求自主,请选择智能体。

当任务既需要自主决策的灵活性,又离不开精准知识的约束时,融合架构(Agentic RAG) 便是你的答案。

学AI大模型的正确顺序,千万不要搞错了

🤔2026年AI风口已来!各行各业的AI渗透肉眼可见,超多公司要么转型做AI相关产品,要么高薪挖AI技术人才,机遇直接摆在眼前!

有往AI方向发展,或者本身有后端编程基础的朋友,直接冲AI大模型应用开发转岗超合适!

就算暂时不打算转岗,了解大模型、RAG、Prompt、Agent这些热门概念,能上手做简单项目,也绝对是求职加分王🔋

📝给大家整理了超全最新的AI大模型应用开发学习清单和资料,手把手帮你快速入门!👇👇

学习路线:

✅大模型基础认知—大模型核心原理、发展历程、主流模型(GPT、文心一言等)特点解析

✅核心技术模块—RAG检索增强生成、Prompt工程实战、Agent智能体开发逻辑

✅开发基础能力—Python进阶、API接口调用、大模型开发框架(LangChain等)实操

✅应用场景开发—智能问答系统、企业知识库、AIGC内容生成工具、行业定制化大模型应用

✅项目落地流程—需求拆解、技术选型、模型调优、测试上线、运维迭代

✅面试求职冲刺—岗位JD解析、简历AI项目包装、高频面试题汇总、模拟面经

以上6大模块,看似清晰好上手,实则每个部分都有扎实的核心内容需要吃透!

我把大模型的学习全流程已经整理📚好了!抓住AI时代风口,轻松解锁职业新可能,希望大家都能把握机遇,实现薪资/职业跃迁~

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献617条内容

已为社区贡献617条内容

所有评论(0)