一文讲清:多模态检索的实现原理与路径

多模态RAG系统面临跨模态检索的关键挑战,主要采用直接表示法和间接表示法两种路径。间接法通过文本中介实现模态转换,而直接法则将不同模态数据映射到统一语义空间。技术实现涉及多模态融合(早期/中期/晚期)和对齐策略(显式/隐式),需专用Embedding模型支持。尽管多模态AI发展迅速,其优化方案仍存在较大探索空间,特别是在跨模态语义对齐和特征融合方面。

多模态RAG的实现路径可分为两类:直接表示法与间接表示法。

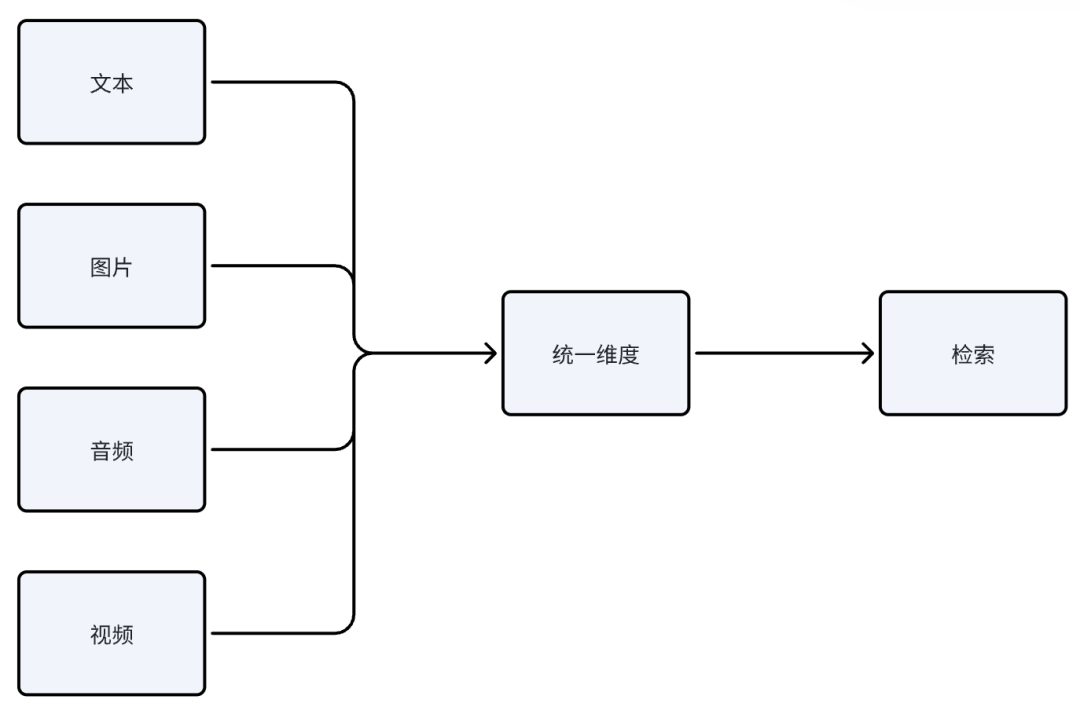

在RAG架构中,系统需依次完成检索召回与内容生成两个核心环节,这一结构在多模态RAG中同样成立;相较于文本RAG可依托语义相似度完成高效检索,多模态RAG因融合文本、图片、视频、音频等多种数据类型,故无法直接应用传统语义检索机制。

由此,如何有效实现跨模态数据的精准检索,成为亟待突破的关键瓶颈?当前多模态RAG正是围绕这一挑战展开应对方案的探索。

多模态检索

在多模态系统中,各类模态的数据形态迥异,无法直接进行比对或检索,因此亟需一种机制来消弭它们之间的隔阂,实现跨模态的比较与检索。

这就好比,你没法直接拿一只羊和一袋米比谁更“多”,但只要换成价格这个共同标尺,就能轻松衡量;同理,面对格式各异、维度不同的多模态数据,我们只需将它们映射到一个统一的表征空间中,这就是多模态检索的核心思路。

最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,其中算法、工程应用类人才需求最为紧迫!

学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。【点击蓝字获取】

【2026最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!

在实际应用中,达成这一目标主要依赖两种路径:间接表示法与直接表示法。

间接表示法的核心在于以文本模态为中介,对其他模态信息进行转译。由于文本具备极强的通用性,任何非文本数据——无论是图像、音频还是视频——均可被描述为自然语言内容。基于此,可先将异构模态数据转化为文本形式,继而借助文本相似度计算实现跨模态检索。

值得注意的是,多模态数据间的映射路径并非唯一。例如,视频可被视为时序图像序列,故可直接以图像为桥梁实现视频与图像的对齐;同理,语音信号亦可通过转录为文字,与文本内容建立语义关联。

相较之下,直接表示法则跳过中间转译环节,主张将各类模态数据直接编码至同一语义向量空间。在此空间中,语义相近的跨模态内容将彼此靠近,形成紧凑的嵌入分布。这一范式的典型代表是 OpenAI 的 CLIP 多模态模型。

其本质逻辑在于:面对模态间维度异构的挑战,通过统一映射消除表征差异,从而实现端到端的语义对齐。这也正是多模态 RAG 系统必须依赖专用 Embedding 模型的根本原因。

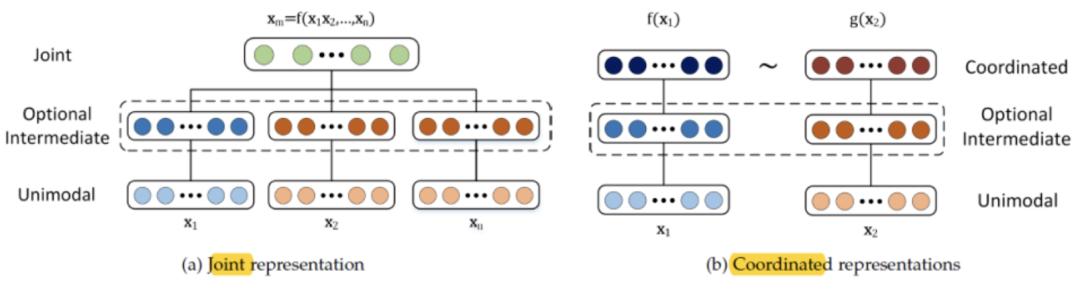

要构建此类统一向量空间,需综合运用多项关键技术,包括但不限于:多模态表示学习、多模态特征融合机制,以及跨模态语义对齐策略。

多模态融合主要包含三种实现路径:

早期融合:在输入阶段将原始数据直接拼接,再送入模型处理(例如RGB-D图像的像素级叠加)

中期融合:在特征提取完成后,通过模态间对齐机制进行信息交互(如基于Transformer的跨模态注意力机制)

晚期融合:对各模态独立输出的预测结果进行决策层面整合(如采用加权投票策略)

该融合机制的核心价值在于有效整合多源模态的互补信息,构建出更具鲁棒性的统一表征。

跨模态对齐旨在通过技术手段,使不同模态在特征空间、语义层次或表示维度上达成一致性映射,其方法体系可划分为两类:

显式对齐:显式建立模态间的对应映射关系,涵盖监督对齐与无监督对齐两种范式

隐式对齐:不依赖显式匹配,而是借助模型内在结构实现跨模态关联,典型方式包括注意力对齐与语义对齐

综上,尽管多模态已成为人工智能演进的核心趋势,其具体实现路径与优化策略仍存在广阔的研究空间。

最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,其中算法、工程应用类人才需求最为紧迫!

学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。【点击蓝字获取】

【2026最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!

更多推荐

已为社区贡献159条内容

已为社区贡献159条内容

所有评论(0)