分享我的AI资讯热点捕捉器

基于n8n工作流搭建AI热点日报推送系统的实践过程,包括News Hacker、Reddit等平台,实现了每日AI资讯的自动采集与推送。

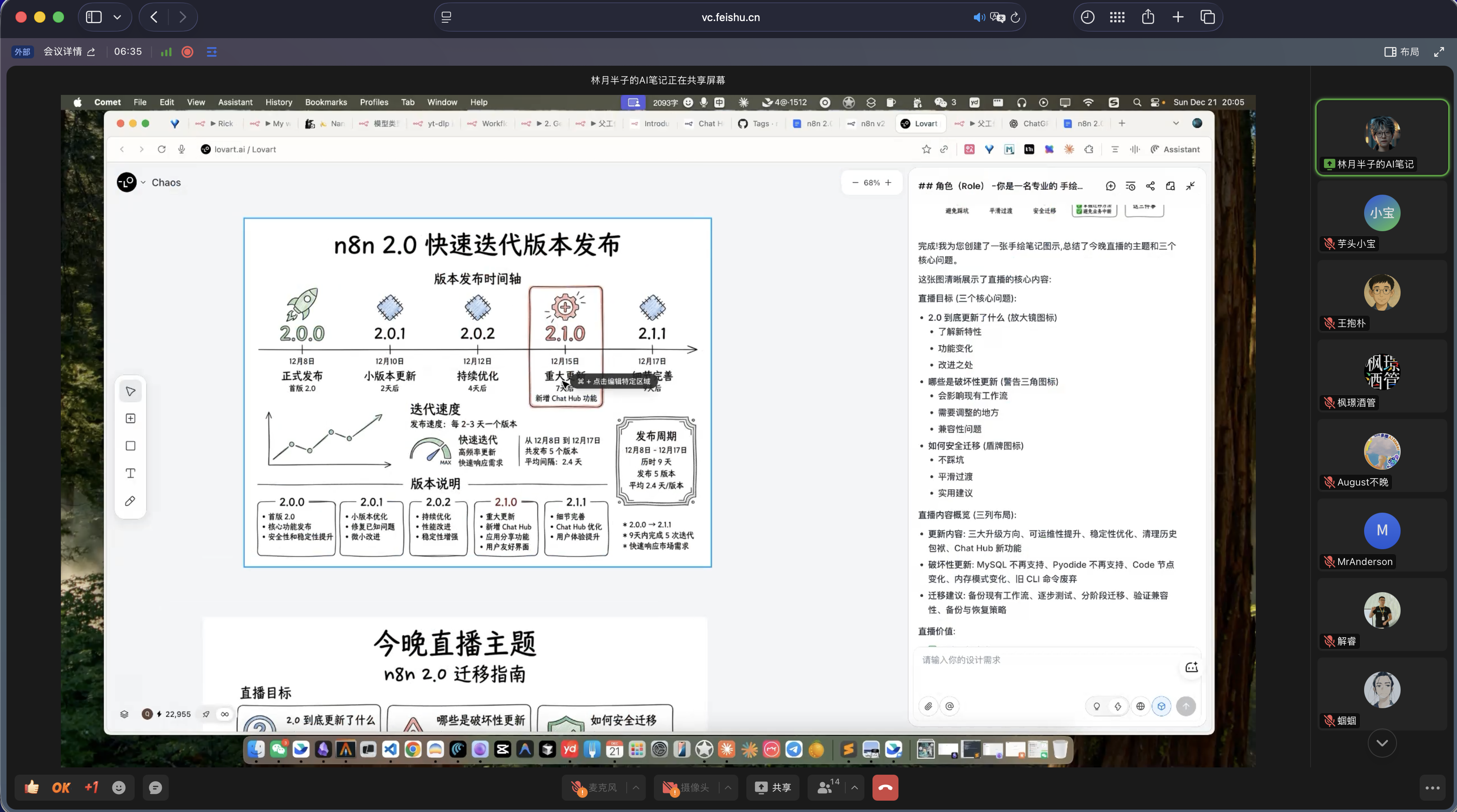

前一阵在B站看到了我关注的UP主Xuan_酱更新了关于n8n工作流的分享。这个工作流主要是全网AI热点捕捉器。那我自己也玩了有一阵n8n,时不时还混到群里看大佬直播分享。

想着我每日不少时间都花在AI信息的筛选浏览中,干脆自己依葫芦画瓢,自己搭个工作流,每天等日报推送岂不美哉。那么说干就干,今天分享一下这个过程中的一些收获吧,也是给老师交个作业,看看学生的学习成果。

成果展示

工作流总览:

信息保存:

最后我会用飞书多维表格的工作流,每日定时将当日的资讯推送到我的飞书上。在我不断扩充信息源的过程中,每日资讯从十几条已经到六十多条了(其实我已经筛了很多了…)。我直呼看不完,根本看不完。也再也没有精力去看别的地方了。

过程分享

具体操作方法我这里就不赘述了,有兴趣的直接去看Xuan_酱原视频,也有文档分享。

我是依葫芦画瓢,所以大量参考了Xuan_酱分享的工作流。去掉了X(因为经常刷),Tiktok,YouTube上的热点视频。保留了更多的新闻,Reddit等渠道,加了一些自己关注的优质个人博主。

目前一共17个信息源,图中我都有标记,具体的RSS地址我就不分享了,大家都可以搜到。我比较推荐的有News Hacker,YouTube上的AI Explained,Matt Wolfe,Matthew Berman等。这些都是专注AI领域,且持续更新的信息源。

信息源收集

大部分的信息源都很好获取RSS。这里我遇到了两个问题:

News Hacker上因为内容领域比较多,而我只需要AI相关的信息,所以没找到合适的RSS地址。最后使用了接口:https://api.newshacker.me,它可以按话题,分数,tag 名称筛选,完美契合我的要求。最后我只需要将时间戳转为统一的iso date就行。

n8n中是有Reddit相关的节点可以用的,创建Reddit API凭证就能用。但是官方去年底对这里管控,需要联系 Reddit 申请 API 相关权限。那我们这种个人用途想必很难申请了。

所以这里只能使用Reddit 的 RSS 订阅,地址:https://www.reddit.com/r/版块名/top.rss?t=day

- top:按热度/分数排序。

- t=day:时间范围限定为过去 24 小时

最终就是:https://www.reddit.com/r/artificial/top.rss?t=day

数据去重

因为Reddit查询是按热度查询,所以担心两天查询的数据有重复,所以加了一步去重的处理。

那首先就是按创建时间查询多维表格中昨天的Reddit历史数据,然后将最新获取的数据两者进行对比(使用链接地址)去重。

飞书配置

因为最后一步是需要将数据添加到飞书的多维表格,所以需要注意在开发者后台,创建应用后,添加权限。发布应用后,在文档的右上角菜单 更多 -> 添加文档应用 中将你创建的应用添加进去。这样才能操作你的表格。

定时触发

我是本地Docker 部署的n8n,默认时区是America/New_York,所以我明明设置的早上8点,结果晚上9点执行了。

所以我找到名为 docker-compose.yml 的文件,添加了时区配置:

services:

n8n:

image: n8nio/n8n

restart: always

ports:

- "5678:5678"

environment: # <-- 找到这里

# 在这里添加时区变量

- GENERIC_TIMEZONE=Asia/Shanghai

- TZ=Asia/Shanghai

保存文件后,在终端中运行以下命令来应用更改:

docker compose down

docker compose up -d

另外就是如果你发现到时间还没有触发,可以检查开启 Always Output Data(总是输出数据/不检查历史)

n8n的Cron节点有一个机制:默认只处理未被处理过的数据。 如果你之前在“编辑模式”下多次点击“Test”,定时节点可能已经生成了执行记录。当你激活工作流后,节点会检查上一次触发的时间,如果它认为该时间点已经被执行过了,它就会跳过,直到下一个“未执行”的时间周期到来。

这样设置后它每次到了时间都会强制触发,不管之前是否运行过。

总结

整个工作流还是比较简单的,反而信息的收集整理才是花费时间最多的地方。经此一役,我每天就是刷刷B站和X,看看AI日报就够了。还是相当不错的,后面考虑把我平时关注的其他类型资讯单独做个工作流,之前写的两个相关的Agent和Skills看来要被替代了。

下回更新或许就是新年后,这里也预祝大家新年快乐,马到成功!!

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)