A2UI协议,打破Agent交互壁垒,让智能系统自主“搭建”界面

A2UI协议:重塑AI Agent交互体验的新标准 摘要: A2UI(Agent-to-User Interface)是Google推出的开源协议,旨在解决AI Agent交互方式滞后的核心痛点。该协议采用声明式UI设计,通过结构化JSON数据描述界面需求,而非生成前端代码,实现了三大核心优势:1)安全可控,通过白名单组件机制规避安全风险;2)跨平台适配,一次描述即可多端渲染;3)模型解耦,支持各

在AI Agent飞速发展的今天,我们不难发现一个矛盾的现象:大语言模型(LLM)的能力不断突破,生态愈发完善,Agent早已摆脱了早期简单的问答逻辑,具备了规划、记忆、工具调用等复杂能力。无论是LangChain、LangGraph这类主流框架,还是AutoGen等协同式Agent工具,都能帮助开发者构建出足够“聪明”的智能体。但与此同时,Agent与用户之间的交互方式,却始终停留在最基础的聊天框模式,这一滞后的交互体验,正在成为Agent落地应用的重要瓶颈。

当我们需要用Agent处理多字段输入、配置选择、分步骤操作等场景时,原本智能的Agent会瞬间“退化”——它只能输出一大段冗长的说明文字,告诉用户需要填写什么信息、选择什么选项、按照什么顺序操作,然后等待用户手动完成所有步骤后再反馈结果。这种低效的交互方式,不仅让用户疲于应对,也浪费了Agent的智能算力,形成了Agent与用户之间一道天然的交互壁垒。

正是为了解决这一核心痛点,Google在去年年底提出并开源了A2UI(Agent-to-User Interface)协议。很多人初次接触A2UI时,会误以为它是一款新的前端框架,实则不然。A2UI的核心价值,是成为Agent与UI界面之间的“翻译官”,让Agent能够直接生成用户界面,而非仅仅输出文本内容,从而彻底打通Agent从思考决策到用户交互的最后一公里。

今天,我们就从本质、技术原理、快速上手、常见疑问等多个维度,全面拆解A2UI协议,看看它究竟如何重塑Agent的交互生态,以及开发者该如何快速掌握并应用这一工具。

一、读懂A2UI:它是协议,而非框架

要真正理解A2UI,首先要打破一个认知误区:A2UI不是React、Vue、Flutter这样的前端框架,也不依赖于特定的技术栈,它本质上是一套声明式的UI协议。这套协议定义了Agent与前端之间的通信标准,让Agent能够用统一的方式描述界面需求,前端则按照标准将其渲染为真实的UI组件。这种设计思路,决定了A2UI的四大核心特性。

1. 声明式UI:Agent只“描述”,不“编码”

传统的Agent交互中,若想实现界面展示,往往需要Agent生成HTML、JSX等前端代码,再由前端解析执行。这种方式不仅要求Agent具备前端编码能力,还会带来一系列兼容性和安全性问题。而A2UI采用了声明式UI的设计理念,Agent不再输出具体的前端代码,而是输出一套结构化的JSON数据,用于描述“需要什么界面组件”“组件有什么属性”“组件之间的层级关系”。

比如,Agent想要一个姓名输入框,只需要输出如下JSON:

{

"surfaceUpdate": {

"surfaceId": "main",

"components": [

{

"id": "name",

"component": {

"type": "TextField",

"props": { "label": "姓名" }

}

}

]

}

}

这段JSON清晰地告诉前端:需要在ID为“main”的界面上,添加一个ID为“name”、类型为文本输入框(TextField)、标签为“姓名”的组件。前端的核心工作,就是将这种结构化的描述映射成真实的本地UI组件,至于用React、Vue还是其他框架实现,完全由前端决定,Agent无需关心。

2. 安全可控:从“代码执行”到“数据渲染”

“为什么不让Agent直接写前端代码?”这是很多人接触A2UI时会提出的疑问。答案很简单:安全风险不可控。Agent生成的HTML/JS代码中,可能包含恶意脚本、未授权访问等安全隐患,一旦前端直接执行,很容易引发安全事故。

而A2UI的设计从根源上解决了这一问题。Agent输出的是结构化JSON数据,而非可执行代码,前端只需要渲染预先定义好的“白名单组件”——也就是说,前端会明确规定哪些组件(比如TextField、Button、Form等)是允许渲染的,以及每个组件支持哪些属性,Agent只能在这个范围内描述界面。这种方式让Agent的输出像数据一样安全,同时又能像代码一样精准表达界面需求,实现了安全性与灵活性的平衡。Google官方也明确表示,这种设计是A2UI的核心设计哲学之一。

3. 跨平台渲染:一次描述,多端适配

在移动互联网时代,跨平台开发是每个开发者都要面对的难题。不同平台(Web、iOS、Android、Flutter)有不同的前端技术栈和UI规范,传统方式下,Agent若想适配多端,需要生成不同平台的前端代码,工作量巨大且难以维护。

A2UI的组件设计是抽象的,它不与任何具体的平台技术绑定。Agent只需要描述“我要一个输入框+一个按钮”,无需关心这个输入框在Web端用React实现、在iOS端用SwiftUI实现、在Android端用Compose实现。前端会根据自身的技术栈,将A2UI的抽象组件映射为平台原生的UI组件,从而实现“一次生成,多端渲染”的效果。这种跨平台能力,极大地降低了Agent多端适配的开发成本。

具体来说,不同平台的渲染方式如下:

| 平台 | 渲染方式 |

|---|---|

| Web | React / Angular / Lit |

| iOS | SwiftUI |

| Android | Compose |

| Flutter | Widget |

4. 模型解耦:不绑定特定LLM,灵活适配

作为一套协议,A2UI并不与特定的大语言模型绑定。无论是Google自家的Gemini,还是OpenAI、Claude,亦或是其他模型或MaaS(模型即服务)提供商,只要能够稳定输出符合A2UI规范的结构化JSON数据,就可以接入A2UI生态。

这一特性让A2UI具备了极强的灵活性和可扩展性。开发者可以根据自身的业务需求、成本预算,自由选择合适的模型,而无需担心模型与交互层的兼容性问题。对于模型而言,也只需要专注于生成精准的结构化数据,无需关心前端的渲染逻辑,实现了模型层与交互层的解耦。

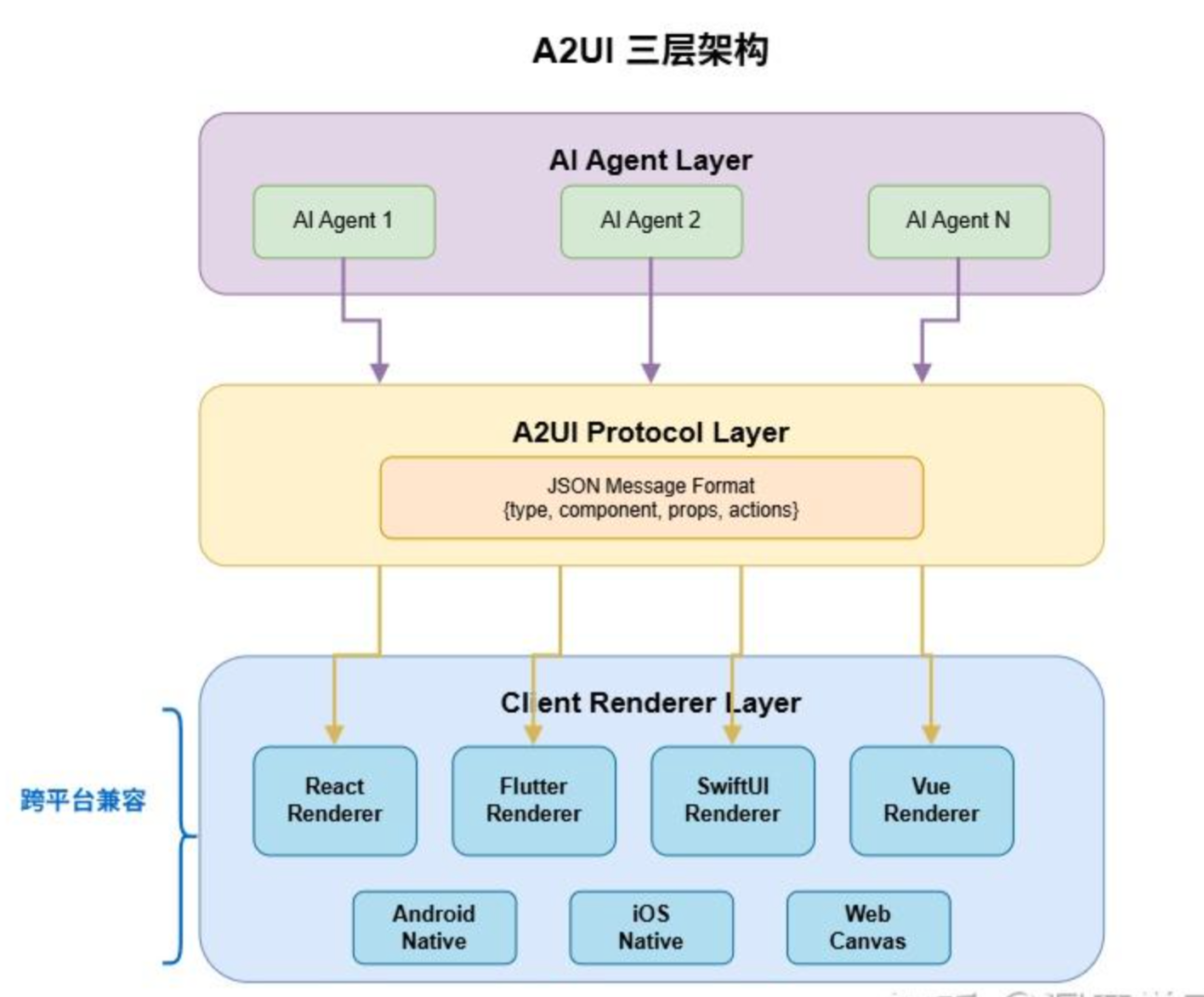

二、技术原理:A2UI的三层架构拆解

A2UI的核心架构分为三层——协议层、渲染层、数据层,每一层都有清晰的分工,三层协同工作,实现了Agent与前端之间的高效通信与交互。这三层架构层层递进,构成了A2UI的核心技术体系,我们逐一拆解其工作原理。

1. 协议层:Agent与UI的通信桥梁(Agent-to-UI Communication)

协议层是A2UI的核心,它定义了Agent与前端之间的通信格式和标准。Agent通过输出符合A2UI协议的JSON数据,向前端传递界面描述信息,这部分数据被称为“surfaceUpdate”(界面更新)。

一个典型的协议层JSON示例如下(以餐厅搜索界面为例):

{

"surfaceUpdate": {

"surfaceId": "restaurant-search",

"components": [

{

"id": "search-form",

"component": {

"type": "Form",

"children": [

{"type": "TextField", "props": {"placeholder": "搜索餐厅..."}},

{"type": "Button", "props": {"text": "搜索"}}

]

}

}

]

}

}

这段JSON包含三个核心字段:surfaceId用于标识当前界面的唯一ID,确保前端能够精准定位到需要更新的界面;components是组件数组,包含了当前界面需要渲染的所有组件;每个组件包含type(组件类型)、props(组件属性)、children(子组件)等字段,用于完整描述组件的形态和结构。

协议层的核心作用,就是让Agent和前端之间形成统一的“语言”,确保Agent的界面需求能够被前端精准理解,避免因通信格式不统一导致的交互异常。

2. 渲染层:框架无关的界面渲染(Framework-Agnostic Rendering)

渲染层的核心职责,是将协议层传递的结构化JSON数据,映射成前端能够识别并展示的本地UI组件。A2UI的渲染层是框架无关的,也就是说,无论前端使用哪种技术栈,都可以实现A2UI的渲染逻辑。

前端会预先定义好一套组件映射规则,当收到Agent发送的surfaceUpdate数据后,会根据组件的type字段,匹配对应的本地组件,并将props字段中的属性传递给本地组件,最终完成界面渲染。以下是一段简化的客户端渲染逻辑伪代码,清晰地展示了渲染层的工作原理:

class A2UIRenderer {

render(component, container) {

switch(component.type) {

case 'TextField':

return new TextInput(component.props); // 映射为文本输入框组件

case 'Button':

return new Button(component.props); // 映射为按钮组件

case 'Form':

return new Form(component.children); // 映射为表单组件,并渲染子组件

// 更多组件的映射规则...

}

}

}

从这段伪代码可以看出,渲染层的逻辑非常清晰:它本质上是一个“翻译器”,将A2UI协议定义的抽象组件,翻译成各个前端框架能够识别的具体组件。这种框架无关的设计,让A2UI能够适配各种前端技术栈,极大地提升了其通用性。

3. 数据层:Agent与UI的双向数据同步

在实际交互场景中,不仅Agent需要向前端传递界面信息,前端也需要向Agent反馈用户操作的数据(比如用户输入的文本、选择的选项等),同时Agent也可能需要向前端推送动态数据(比如搜索结果、加载状态等)。这就需要数据层来实现Agent与前端之间的双向数据同步。

A2UI的数据层通过“dataModelUpdate”(数据模型更新)字段来传递数据,支持多种数据类型(字符串、数字、数组、映射等)。以下是一个餐厅搜索结果的数据同步示例:

{

"dataModelUpdate": {

"surfaceId": "restaurant-search",

"contents": [

{

"key": "searchResults",

"valueArray": [

{

"valueMap": [

{"key": "name", "valueString": "川香阁"},

{"key": "rating", "valueNumber": 4.5},

{"key": "cuisine", "valueString": "川菜"}

]

}

]

}

]

}

}

这段JSON表示:向ID为“restaurant-search”的界面,同步key为“searchResults”的数组数据,数组中包含一条餐厅信息,包含名称(字符串类型)、评分(数字类型)、菜系(字符串类型)三个字段。前端收到这份数据后,可以将其展示在界面上;同样,当用户在前端输入搜索关键词并点击搜索按钮后,前端也会将用户输入的数据按照A2UI协议格式传递给Agent,Agent处理后再返回搜索结果数据,从而实现双向数据同步。

数据层的存在,让Agent与前端之间不仅能够实现界面交互,还能实现数据的实时同步,为复杂交互场景(比如表单提交、动态列表、状态更新等)提供了坚实的技术支撑。

三、快速开始:3步上手A2UI开发

了解了A2UI的本质和技术原理后,接下来我们进入实操环节。无论是从零开始搭建A2UI项目,还是将A2UI集成到现有项目中,都非常简单,只需完成环境准备、安装配置、启动项目三个核心步骤。

1. 环境准备:确认开发环境达标

在开始使用A2UI之前,首先需要确认开发环境满足以下要求:

-

Node.js版本:16.0.0及以上(A2UI的核心依赖需要Node.js 16+的支持)

-

npm版本:建议使用与Node.js匹配的最新版本(一般安装Node.js时会自动安装npm)

可以通过以下命令检查当前环境的版本:

# 检查Node.js版本

node --version

# 检查npm版本

npm --version

如果Node.js版本低于16.0.0,需要先升级Node.js。推荐使用nvm(Node Version Manager)来管理Node.js版本,方便快速切换不同版本的Node.js。

2. 安装步骤:两种方式任选

A2UI提供了两种安装方式:一种是使用官方快速开始模板,适合从零开始搭建项目;另一种是集成到现有项目中,适合在已有前端项目中引入A2UI能力。开发者可以根据自身需求选择合适的安装方式。

方式1:使用官方模板(从零开始)

官方提供了快速开始模板,包含了完整的项目结构和示例代码,能够帮助开发者快速上手。具体步骤如下:

# 克隆官方快速开始模板

git clone https://github.com/google/A2UI.git

# 进入快速开始示例目录

cd A2UI/examples/quick-start

# 安装项目依赖

npm install

# 启动开发服务器(默认端口为3000)

npm start

启动成功后,打开浏览器访问http://localhost:3000,即可看到A2UI的示例界面。官方模板中包含了基础的组件渲染、数据同步等功能,开发者可以在此基础上进行二次开发。

方式2:集成到现有项目

如果需要在已有的前端项目中引入A2UI,只需安装A2UI的核心库、对应框架的渲染器以及类型定义(TypeScript项目需要)即可。以React项目为例,具体步骤如下:

# 安装A2UI核心库(核心协议和工具类)

npm install @google/a2ui

# 安装React渲染器(用于将A2UI组件映射为React组件)

npm install @google/a2ui-react

# 安装类型定义(TypeScript项目必备,JavaScript项目可省略)

npm install -D @types/a2ui

如果是Vue、Angular、Flutter等其他框架,只需替换对应的渲染器即可。比如Vue项目可以安装@google/a2ui-vue,Angular项目可以安装@google/a2ui-angular,具体可参考A2UI官方文档。

3. 验证安装:确保环境正常运行

安装完成后,无论是使用官方模板还是集成到现有项目,都可以通过简单的代码验证A2UI是否正常工作。比如在项目中引入A2UI的核心组件,查看是否能够正常导入,无报错信息:

// 导入A2UI核心类(JavaScript项目)

import { A2UIAgent } from '@google/a2ui';

// 导入React渲染器(React项目)

import { A2UIRenderer } from '@google/a2ui-react';

如果导入过程中无报错,说明A2UI已经成功安装并可以正常使用。接下来,我们通过一个简单的“Hello World”示例,进一步熟悉A2UI的开发流程。

四、实战示例:搭建一个简单的A2UI应用

为了让大家更直观地理解A2UI的开发流程,我们将搭建一个简单的“Hello World”应用。这个应用的核心功能是:用户在输入框中输入内容,点击发送后,Agent生成一个包含问候信息和按钮的界面,点击按钮可以再次发送问候。整个应用分为Agent端和客户端(前端)两部分,我们逐一实现。

1. 创建Agent:定义界面描述和交互逻辑

Agent是A2UI应用的核心,负责处理用户输入、生成界面描述(surfaceUpdate)和数据同步(dataModelUpdate)。我们首先创建一个HelloAgent类,继承自A2UI提供的A2UIAgent基类,并重写handleMessage方法,用于处理用户输入并返回界面描述。

创建文件agent/hello-agent.js,代码如下:

// agent/hello-agent.js

import { A2UIAgent } from '@google/a2ui';

// 继承A2UIAgent基类,实现自定义Agent

class HelloAgent extends A2UIAgent {

// 处理用户输入的方法,参数为用户输入内容,返回界面更新信息

async handleMessage(userInput) {

return {

surfaceUpdate: {

surfaceId: "hello-world", // 界面唯一ID

components: [

{

id: "greeting-container", // 组件唯一ID

component: {

type: "Card", // 组件类型:卡片

props: {

title: "A2UI问候", // 卡片标题

variant: "elevated" // 卡片样式:带阴影

},

children: [

{

type: "Text", // 子组件类型:文本

props: {

content: `你好!您输入的是:${userInput}`, // 文本内容,包含用户输入

size: "large" // 文本大小:大

}

},

{

type: "Button", // 子组件类型:按钮

props: {

text: "再次问候", // 按钮文字

action: "greet_again" // 按钮点击触发的动作ID

}

}

]

}

}

]

}

};

}

}

// 导出Agent类,供前端调用

export default HelloAgent;

这段代码的逻辑非常清晰:当Agent收到用户输入(userInput)后,会返回一个包含卡片组件的界面更新信息。卡片中包含一段问候文本(展示用户输入内容)和一个“再次问候”按钮,按钮点击后会触发“greet_again”动作。

2. 创建客户端渲染器:渲染Agent生成的界面

客户端(前端)的核心工作,是创建渲染器,调用Agent处理用户输入,并将Agent返回的界面更新信息渲染为真实的UI。我们以React项目为例,创建客户端代码,文件路径为client/App.jsx:

// client/App.jsx

import React, { useState } from 'react';

import { A2UIRenderer } from '@google/a2ui-react'; // 导入React渲染器

import HelloAgent from './agent/hello-agent'; // 导入自定义Agent

function App() {

// 状态管理:存储Agent返回的界面信息

const [messages, setMessages] = useState([]);

// 状态管理:存储用户输入内容

const [userInput, setUserInput] = useState('');

// 实例化自定义Agent

const agent = new HelloAgent();

// 处理用户发送消息的方法

const handleSendMessage = async () => {

// 调用Agent的handleMessage方法,传入用户输入

const response = await agent.handleMessage(userInput);

// 将Agent返回的界面更新信息添加到messages数组中

setMessages(prev => [...prev, response]);

// 清空用户输入框

setUserInput('');

};

return (

{/* 界面容器样式(可根据需求自定义) */}

{/* 用户输入区域 */}

);

}

export default App;

这段React代码实现了三个核心功能:一是用户输入的状态管理,实时获取用户在输入框中的内容;二是调用Agent处理用户输入,将Agent返回的界面更新信息存储到messages数组中;三是使用A2UIRenderer组件,将messages数组中的界面更新信息渲染为真实的React组件,并处理组件触发的动作(比如按钮点击)。

3. 运行应用:查看最终效果

完成Agent和客户端的代码编写后,启动开发服务器:

npm start

打开浏览器访问http://localhost:3000,在输入框中输入任意内容(比如“Hello A2UI”),点击发送按钮,即可看到Agent生成的卡片界面:卡片标题为“A2UI问候”,内容为“你好!您输入的是:Hello A2UI”,下方有一个“再次问候”按钮。点击按钮后,会再次触发问候逻辑,界面内容会重新渲染(由于用户输入框已清空,此时内容会显示为“你好!您输入的是:”)。

这个简单的示例,完整展示了A2UI的核心工作流程:用户输入→Agent处理并生成界面描述→前端渲染界面→用户与界面交互→Agent响应交互并更新界面。通过这个示例,我们可以快速掌握A2UI的开发思路,为后续开发复杂应用奠定基础。

五、常见疑问:解开A2UI的使用困惑

在使用A2UI的过程中,很多开发者会遇到一些常见问题。这里整理了两个最具代表性的疑问,并结合官方文档和实操经验给出解答,帮助大家更顺畅地使用A2UI。

1. 前端必须引入A2UI官方npm包吗?

答案是:不一定。A2UI官方提供的npm包(比如@google/a2ui、@google/a2ui-react),本质上是对A2UI协议的封装,方便开发者快速接入。但这并不意味着前端必须引入这些官方包,开发者完全可以根据A2UI协议,自己实现渲染逻辑。

比如,在React项目中,我们可以自己编写一个简单的A2UIRenderer组件,根据Agent返回的JSON数据,渲染对应的React组件。核心逻辑如下:

// 自定义简单的A2UI渲染器

function CustomA2UIRenderer({ surface }) {

// 根据组件类型渲染对应的React组件

const renderComponent = (component) => {

switch (component.type) {

case 'Text':

return <p style={.size === 'large' ? '18px' : '14px' }}>{component.props.content};

case 'Button':

return <button onClick={ handleAction(component.props.action)}>{component.props.text};

case 'Card':

return (

<div style={', borderRadius: '8px', padding: '16px', margin: '8px 0' }}>

{component.props.title}

{component.children.map((child, index) => renderComponent(child, index))}

);

// 其他组件的渲染逻辑...

default:

return null;

}

};

// 处理组件动作

const handleAction = (action) => {

console.log('Triggered action:', action);

// 动作处理逻辑...

};

// 渲染所有组件

return (

{surface.components.map((item, index) => renderComponent(item.component, index))}

);

}

在实际业务中,更合理的做法是:大多数情况下,前端可以直接使用官方npm包,提高开发效率;如果有特殊需求(比如自定义组件、精简代码体积等),可以根据A2UI协议自行实现渲染逻辑。官方文档也明确表示,A2UI的核心是协议,而非具体的SDK封装。

2. LLM一定要输出特殊JSON吗?

答案是:是的,但并非所有回复都需要。A2UI的核心要求,是Agent(本质上是LLM)能够稳定输出符合A2UI协议的结构化JSON数据,这是Agent与前端实现界面交互的前提。但这并不意味着LLM的所有回复都必须是A2UI格式的JSON,在实际业务中,更合理的交互方式是“混合模式”。

具体来说,当需要用户进行交互操作(比如输入多字段、选择配置、查看动态列表等)时,LLM输出A2UI格式的JSON,前端渲染为界面;当只需要向用户反馈简单信息(比如回答一个简单问题、提示操作结果等)时,LLM可以直接输出文本,前端按照传统的聊天气泡方式展示。这种混合模式,既保证了复杂场景下的交互体验,又兼顾了简单场景下的效率。

比如,在一个智能客服Agent中,当用户询问“如何办理会员”时,Agent可以输出文本回复,告知用户办理流程;当用户表示“我要办理会员”时,Agent可以输出A2UI格式的JSON,渲染出会员办理表单(包含姓名、手机号、会员类型选择等组件),让用户快速填写提交。这种灵活的交互方式,能够极大地提升用户体验。

需要注意的是,LLM输出的A2UI JSON必须符合协议规范,否则前端无法正常渲染。为了确保LLM能够稳定输出合规的JSON,开发者可以通过提示词工程(比如在提示词中明确JSON格式要求、提供示例)、微调模型等方式,提升LLM输出的准确性。

六、总结:A2UI开启Agent交互新时代

回顾A2UI的核心价值,我们不难发现,它的意义远不止是提供了一种新的UI实现方案,更重要的是,它补齐了Agent从思考决策到用户交互的最后一环,打破了长期以来制约Agent落地应用的交互壁垒。在A2UI出现之前,Agent的智能更多体现在“思考”层面,而在交互层面始终存在短板;A2UI的出现,让Agent能够自主“搭建”界面,实现了从“能思考”到“会交互”的跨越。

对于Agent开发者而言,A2UI让他们无需再关注前端技术栈的细节,无需编写大量的界面代码,而是可以专注于Agent核心能力的设计(比如规划、记忆、工具调用等),极大地降低了Agent应用的开发成本。对于用户而言,A2UI让Agent的交互方式从冗长的文本说明,转变为直观的图形界面,操作更简单、体验更流畅,让智能系统真正走进日常工作和生活。

从技术层面来看,A2UI的声明式协议设计、安全可控的渲染机制、跨平台适配能力、模型解耦特性,让它具备了极强的通用性和可扩展性,能够适配各种前端技术栈、各种大语言模型、各种业务场景。无论是简单的问答交互,还是复杂的多步骤操作,A2UI都能提供高效、灵活的解决方案。

随着AI Agent生态的不断完善,交互体验将成为衡量Agent应用竞争力的核心指标之一。A2UI作为Google开源的核心交互协议,无疑将在Agent生态中扮演越来越重要的角色。对于开发者而言,尽早掌握A2UI的使用方法,不仅能够提升Agent应用的开发效率和用户体验,还能抢占Agent交互创新的先机。

最后,A2UI目前还处于快速发展阶段,Google不断在完善其协议规范和SDK封装,后续可能会推出更多新的组件类型、更强大的交互能力。建议开发者持续关注A2UI官方仓库和文档,及时跟进最新的功能更新,让自己的Agent应用始终保持领先的交互体验。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)