chatGPT原理自我分析

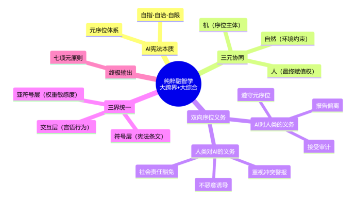

本文探讨了chatGPT理解人类语言的原理及其潜在影响。文章指出,计算机通过向量化和信息压缩两大步骤处理语言:首先将词语转化为多维向量空间中的数字表示,再通过特征提取技术(如Transformer模型)建立词语间的关联。GPT模型专注于语言生成,通过海量数据训练实现了从简单词语接龙到复杂对话的"涌现"能力。作者认为,语言作为人类文明的核心载体,其理解能力是通向通用人工智能的关键

总述

首先,我们先纠正一个观点,就是chatGPT在与人们的对话过程中,它不是一个暴力穷举的产物,如果认同这个观点,你可以再去往下阅读。

那么,chatGPT是如何理解人类语言的,这种理解方式与我们的思维有什么共同之处呢,在这条路上一直走下去,AI最终会涌现出智能吗?而最终,这个结果对于我们会有那些影响呢?

我们一起来探讨下。

chatGPT是如何理解人类语言的,要回答这个问题之前,我们首先要理解,计算机时如何记录现实世界的。我们都知道,计算机的底层时二进制,我们现实世界中的所有问题,如果都交给计算机去处理,其实最终都是把它转化成了数学问题。比如说,我们日常学习的26个字母,我们可以用52个数字来表示她,其中这52个数字包含了26个大写和26个小写。我们要表示一副画,我们可以把画的最小单位表示为R\G\B三种元素的组合,而每一种颜色都可以用0-255的数字来表示,于是,一幅画在电脑中就变成了一大堆数字的组合。但是,我们发现,这种表示方式有个小问题就是,电脑并不能把数字和它实际表示的东西建立起来。

在非人工智能时代,电脑只是我们存储和处理信息的一种工具,就像我们在处理冰箱中的食物或者锅碗瓢盆一样,它们并不需要认识冰激凌和鱼香肉丝,使用他们的人,知道就已经可以了。

而在人工智能时代,电脑需要自己处理与现实世界中的信息。图像识别需要看到照片就能实现一个人,而自然语言的理解,就是需要看到他的一段话就能够理解他说的是什么意思。

那么,电脑如何做到这一步呢?这里至少需要两步:第一步,叫做向量化;第二步,叫做信息压缩与特征提取。

向量化

首先我们来看向量化,什么是向量化呢?向量化简单来说,就是把你要表示的东西变成一组数字的组合。比如说,我们要表示一个人,我们可以这样来表示:

[0, 180, 75, 20]

第一个元素表示性别

第二个元素表示身高

第三个元素表示体重

第四个元素表示年龄

现在,我们知道了这组数字的含义,那么我们就知道了这个人是如何表示了,也就是,一个年龄20,身高180,体重75的男性。好了,如果我们角色,这几个指标并没有突出这个人的个性,那么,你还可以增加其他指标,比如说,三围、体脂率、肤色、发色等等,所有的这些,都可以表示成数字,维度越多,我们对你的定义也就越准确,通过这些维度筛选出来的人,跟你的相似度也就越高。

那么,我们为什么要向量化呢?

有两个原因:第一就是转化成数字之后,电脑方便处理;第二就是,向量化以后的空间结构,展现出了一定的规律。

第一点比较好理解,我们不过多赘述了,关于第二点,我们可以根据身高和体重来画一个二维坐标系,横轴表示体重,纵轴表示身高,那么,对于身高180,体重75的人来说,他们对应在坐标系中的某一个点,而且,所有和这个点接近的位置,都是体型和你相似的人。

如果我们增加一个年龄的指标,或者增加其他更多的指标,那么,我们就能够通过更多的空间关系来理解每一个人的特征。词语也是一样的,只不过,表示这个词语的维度也更不容易被总结出来。但是,我们始终相信,如果把它也放在一个很多指标维度的空间坐标系中,那些意义相近的词语,他们的空间可能会更加的接近,当然,这里面可能会有很多很多我们不知道如何表示的指标。

除此之外,向量是可以计算的,就像我们普通的数字一样,我们可以相加减和相乘,当我们把这个词放到坐标系中,我们也可以发现词语的计算关系,也可以得到另一个词语。我想说的是,词语之间的空间关系,也会反映出他们在现实世界中的实际关系,这个是非常有意思的。

我们说起来很简单,但是实际上,这份工作的复杂工作远超想象。我们不仅要把每个词语放在坐标系中,我们还要能够正确的标注出每个词语在这个空间中的位置,以上所说的神奇的事情才能发生。那么,我们怎么找到这些维度,怎么找到这些词语的空间位置呢?

这,就是人工智能要干的事情了。

比如说,我们预先准备50个维度的坐标,准备10000个词语,我们先把这些词随便仍在坐标系里面,对,就是随便扔,爱仍哪里仍哪里,专业描述就是,每个词,随机产生自己的向量,然后到语料库中随便摘出来一句话,然电脑玩词语接龙,把第二个词和第一个词拿过来计算,看看第二个词跟在第一个词背后的概率有多大?如果算出来概率很大,那你就比较幸运,说明这两个词在你坐标的位置比较合适;如果概率很小,说明一开始随便放的位置不合适,这个时候该怎么办呢,这个时候,就需要电脑把词的位置再调整一下,再回来计算,如果还不行,再去调整,再去计算。。因为向量是可以计算的,所以,我们就可以知道,每次计算出来的数和正确的结果的差距有多少,这个就是损失函数,我们训练的目的也是让这个差距越来越小,这种是有数学方法逼近正确结果的,这个过程叫做收敛。就这样,在无数次的调整之后,电脑终于调整好了词的位置,然后我们同样的道理再去训练第三个词,第四个词,第五个词。。。。然后这10000个词就都训练了好多遍了。于是,每个词,都找到了自己坐标里面的正确位置。词的向量化工作就结束了。

信息压缩与特征提取

说了这么多,我们来说第二大步,那就是信息压缩与特征提取,没有做特征提取,就相当于没有找到正确的规律。如果你用错误的规律去训练电脑,那么,电脑最后帮你找到的词向量也是错误的。也就说,这些词,并没有在向量空间中找到属于自己的正确位置。

我们知道,现实世界中的信息量是非常大的,为了理解和记忆他们,我们不可能把所有的信息都拿来做处理,这不仅非常浪费时间,而且,我们也没有办法然我们抓住重点,我们的大脑在处理信息的时候,也是经过层层筛选和过滤的,只有最重要的信息,才会进入到我们的意识进行处理,图像领域之所以首先在人工领域取得突破,就是因为它首先找到了提取图片特征的方法,也就是卷积神经网络。

虽然语言是我们人类创造的,但是一开始我们却一直找不到提取语言特征的正确方法,多年以来,人类一直在用的循环神经网络,它的训练方法跟日常训练的方法差不多。我们输入一句话,让他最后填空,而距离填空的词越近的词,它的权重就越高,而越远的词,影响就越小,这不仅会让电脑遗忘掉太远的词,而且很多时候,电脑就提取不出来正确的特征,这是一个很致命的问题,如果这个问题解决不了,很多我们想解决的问题就很难去解决,那么,这个问题怎么去解决呢,接下来,我们就要引出我们能AI发展史上划时代的模型,chatGPT里面那个T,Transformer。

2017年,google提出了一种叫做自注意力机制的方法,解决了自然语言的特征提取问题,简单来说,就是让句子里的词自己去和句子中所有的词做词向量相乘,乘出来的结果再去做训练,有了Transformer的加持,我们终于可以成功对语言进行压缩和特征提取了,在正确的训练下,我们就可以让电脑成功的做好向量化了。

因为Transformer是一个语言翻译模型,所以整个模型是由编码器和解码器两部分组成的,而这两部分的训练方法有不同,编码器考验的是对语言的理解,所以,它使用的训练方法是完形填空,相当于是给出前后文,把中间的字挖掉,让电脑去猜;而解码器是要根据意思,翻译成另外一种语言,所以,它考验的是语言的生成,它的训练方法是词语接龙。

后来,google和openai分别拿走了编码器和解码器,高出了自己的语言模型,google的重在语言理解,叫做BERT,openai的重在语言生成,叫做GPT,也就是chatGPT的前身。看到这里,你可能就明白了,chatGPT本身其实就是一个语言模型,它被制造出来的目的并不是解决实际问题,而是怎么把话说得更漂亮,而它把话说得很漂亮的诀窍其实也并不高深,说白了就是根据上文的内容去推测下一个词应该是什么,然后把这个词加进去,继续推测写一个词是什么,在不断的推测过程中,把词连接成句子,它只关心说出来的话像不像人话,并不关心是否正确,之所以我们在很多时候觉得它说的有道理,只是因为它看过太多的语料库了,在他所有的训练语料中,正确的说法是概率最大的那种而已。那么,这样一种终极目的是把话说漂亮的AI模型,是如何成为如今大杀四方的通用人工智能雏形的呢?最重要的原因就是,openai赌对了方向,openai创立之初就是要做通用人工智能,但是如何做出通用人工智能,其实是没有答案的。在很多年前,人工智能领域还是各种专业人工智能的天下,从业者基本都是聚焦在一个细分领域,比如围棋、绘画等,然后获得各种比赛大奖,名扬天下。

我们不得不说,语言才是理解整个人类社会最重要的工具,人类几千年的文明历史,几乎所有的显性知识,它的载体都是语言,而人类之间相互的交流,最重要的渠道也是语言,所以,如果电脑能够理解语言,就相当于它获得了理解整个人类社会成果的能力,也获得了与人类无缝交流的能力,所以,要产生通用人工智能,语言一定是一个重要的突破口。

在BERT和GPT1出来之时,BERT在各方面是完全吊打GPT1的,这个时候,openai面临两种选择,一种是根据特定场景,优化模型的算法,二是不够好,是因为向量空间不够大,不够精确,因此增加训练层数,增加向量维度,增加训练数据,也就说增加参数数量和训练数据,搞出来一个更大的模型,openai选择了后者,他们笃定通用人工智能需要泛化到更多的场景,因此需要更大的参数和更大的数据量,果然又赌对了,在参数规模达到1000亿的时候,神奇的现象产生了,这种现象叫做涌现,很多不具备的能力突然就产生了,自此,openai一路高歌猛进,彻底与其他公司拉开了距离。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)