MCP协议详解:AI时代大模型与工具交互的标准化解决方案

MCP是Anthropic推出的开放标准协议,旨在解决大模型与外部工具、数据源间的交互壁垒。它采用client-host-server架构,通过标准化通信实现大模型与数据库、文件系统、API等资源的连接。MCP提供Tools、Resources和Prompts三种功能,使AI应用能访问本地文件、数据库和外部API,增强功能并改善用户体验。开发者可借助MCP减少构建AI应用的复杂性,而用户则能获得功

MCP是Anthropic推出的开放标准协议,旨在解决大模型与外部工具、数据源间的交互壁垒。它采用client-host-server架构,通过标准化通信实现大模型与数据库、文件系统、API等资源的连接。MCP提供Tools、Resources和Prompts三种功能,使AI应用能访问本地文件、数据库和外部API,增强功能并改善用户体验。开发者可借助MCP减少构建AI应用的复杂性,而用户则能获得功能更强大的AI应用。

前排提示,文末有大模型AGI-CSDN独家资料包哦!

什么是MCP

MCP(Model Context Protocol,模型上下文协议)是 Anthropic 公司于 2024 年底推出的一种开放标准协议,旨在解决大型语言模型(LLM)与外部工具、数据源之间的交互壁垒。MCP其核心定位是成为 AI 领域的“通用接口”或“万能插座”,通过标准化通信实现大模型与多样化外部资源(如数据库、文件系统、API 等)的安全、高效连接。

官方的解释:

“The Model Context Protocol (MCP) follows a client-host-server architecture.”

MCP Server本质上就是一段Nodejs或者Python程序,大模型通过操作系统的STDIO,也就是标准输入输出通道,或者SSE协议调用某个MCP Server。

这里顺便提下Function Calling、MCP和AI Agent的区别和定位,如下

Function Calling:是AI模型调用函数的机制。

MCP:是一个标准协议,使大模型与API无缝交互。

AI Agent:是一个自主运行的智能系统,利用Function Calling和MCP来分析和执行任务,实现特定目标。

MCP是如何工作的

想要更深入知道里面的工作原理,看官方文档和源码

源码仓库:https://github.com/modelcontextprotocol[1]

官方文档:https://modelcontextprotocol.io/[2]

MCP提供了多种语言的sdk,大家可以根据自己的语言特长选择相应的sdk

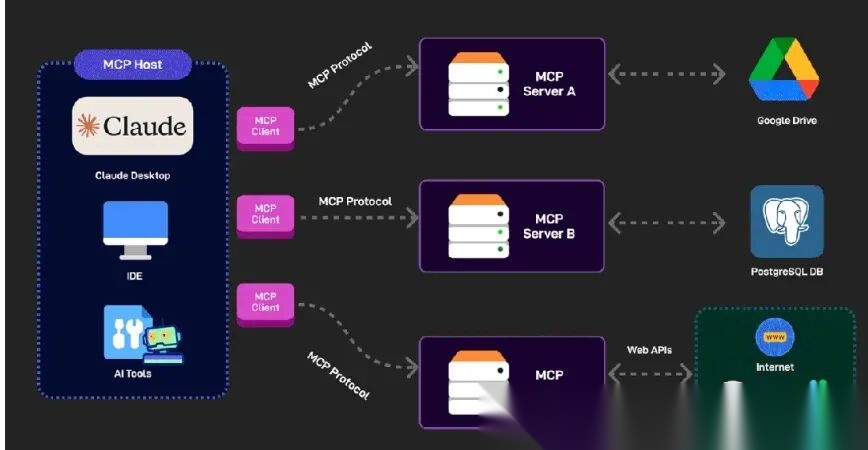

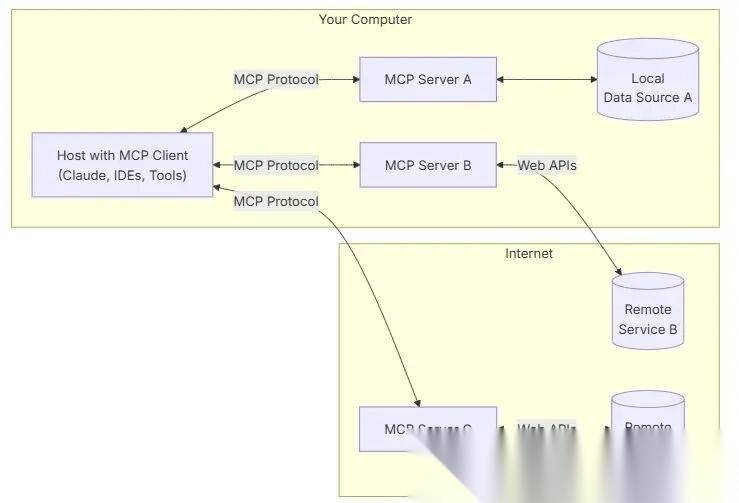

总体架构图

●

MCP Hosts: 如 Claude Desktop、IDE 或 AI 工具等希望通过 MCP 访问数据的程序。

●

MCP Clients:与服务器保持 1:1 连接的协议客户端。

●

MCP Servers: 通过标准化的模型上下文协议暴露特定功能的轻量级程序。

●

Local Data Sources: 你的计算机文件、数据库和服务,MCP 服务器可以安全访问。

●

Remote Services: 可通过互联网(例如通过 API)访问的外部系统,MCP 服务器可与之连接。

MCP和大模型的交互流程

MCP是核心是提供可插拔的多个工具支持LLM来调用,那么问题来了,LLM(模型)是在什么时候确定使用哪些工具的呢? Anthropic 为我们提供了详细的解释,当用户在mcp客户端发起一个问题时:

客户端(Claude Desktop / Cursor)将问题发送给 LLM。

LLM 分析可用的工具,并决定使用哪一个(或多个)。

客户端通过 MCP Server 执行所选的工具。

工具的执行结果被送回给 LLM。

LLM 结合执行结果,归纳总结后得到prompt并生成自然语言展示给用户!

通过MCP client端的示例代码我们也可以大概知道情况

Python

async def start(self):

# 初始化配置的 mcp server

for server in self.servers:

await server.initialize()

# 获取配置的每一个mcp server的 tools 命名为 all_tools

all_tools = []

for server in self.servers:

tools = await server.list_tools()

all_tools.extend(tools)

# 获取tool上的提示词并提供 给LLM 使用

tools_description = "\n".join(

[tool.format_for_llm() for tool in all_tools]

)

# 询问 LLM(Claude) 应该使用哪些工具。

system_message = (

"You are a helpful assistant with access to these tools:\n\n"

f"{tools_description}\n"

"Choose the appropriate tool based on the user's question. "

"If no tool is needed, reply directly.\n\n"

"IMPORTANT: When you need to use a tool, you must ONLY respond with "

"the exact JSON object format below, nothing else:\n"

"{\n"

' "tool": "tool-name",\n'

' "arguments": {\n'

' "argument-name": "value"\n'

" }\n"

"}\n\n"

"After receiving a tool's response:\n"

"1. Transform the raw data into a natural, conversational response\n"

"2. Keep responses concise but informative\n"

"3. Focus on the most relevant information\n"

"4. Use appropriate context from the user's question\n"

"5. Avoid simply repeating the raw data\n\n"

"Please use only the tools that are explicitly defined above."

)

messages = [{"role": "system", "content": system_message}]

while True:

#追加用户消息输入.

messages.append({"role": "user", "content": user_input})

# 将 system_message(针对mcp调用的提示词) 和用户消息输入一起发送给 LLM

llm_response = self.llm_client.get_response(messages)

... # 后面和确定使用哪些工具无关

class Tool:

"""Represents a tool with its properties and formatting."""

def __init__(

self, name: str, description: str, input_schema: dict[str, Any]

) -> None:

self.name: str = name

self.description: str = description

self.input_schema: dict[str, Any] = input_schema

# 把工具的名字 / 工具的用途(description)和工具所需要的参数(args_desc)转化为文本

def format_for_llm(self) -> str:

"""Format tool information for LLM.

Returns:

A formatted string describing the tool.

"""

args_desc = []

MCP的作用

借助 MCP,像 Claude 或 ChatGPT 这样的人工智能应用程序可以连接到数据源(例如本地文件、数据库)、工具(例如搜索引擎、计算器)和工作流程(例如特定提示),从而访问关键信息并执行任务。

开发者 :MCP 可以减少构建 AI 应用程序或代理或与之集成时的开发时间和复杂性。

AI 应用或代理 :MCP 提供对数据源、工具和应用程序生态系统的访问,这将增强功能并改善最终用户体验。

最终用户 :MCP 可产生功能更强大的 AI 应用程序或代理,这些应用程序或代理可以访问您的数据并在必要时代表您采取行动。

说人话:可以将 MCP 想象成人工智能应用程序的 USB-C 接口。正如 USB-C 提供了一种连接电子设备的标准化方式一样,MCP 也提供了一种将人工智能应用程序连接到外部系统的标准化方式。

如何使用MCP

如果我们自己手动创建一个MCP server应该能够很好的理解其实市面上已经有大量的MCP server了)

下面我们具体来搭建一个简单的加法运算的MCP,越简单越好:

创建文件main.py,内容如下:

# server.py

from mcp.server.fastmcp import FastMCP

# Create an MCP server

mcp = FastMCP("Demo")

# Add an addition tool

@mcp.tool()

def add(a: int, b: int) -> int:

"""Add two numbers"""

return a + b

# Add a dynamic greeting resource

@mcp.resource("greeting://{name}")

def get_greeting(name: str) -> str:

"""Get a personalized greeting"""

return f"Hello, {name}!"

if __name__ == "__main__":

mcp.run(transport='sse')

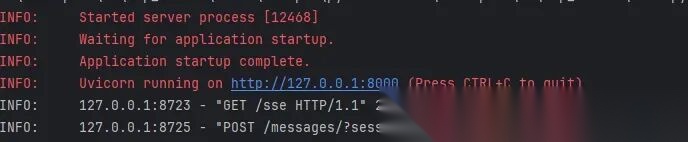

启动服务

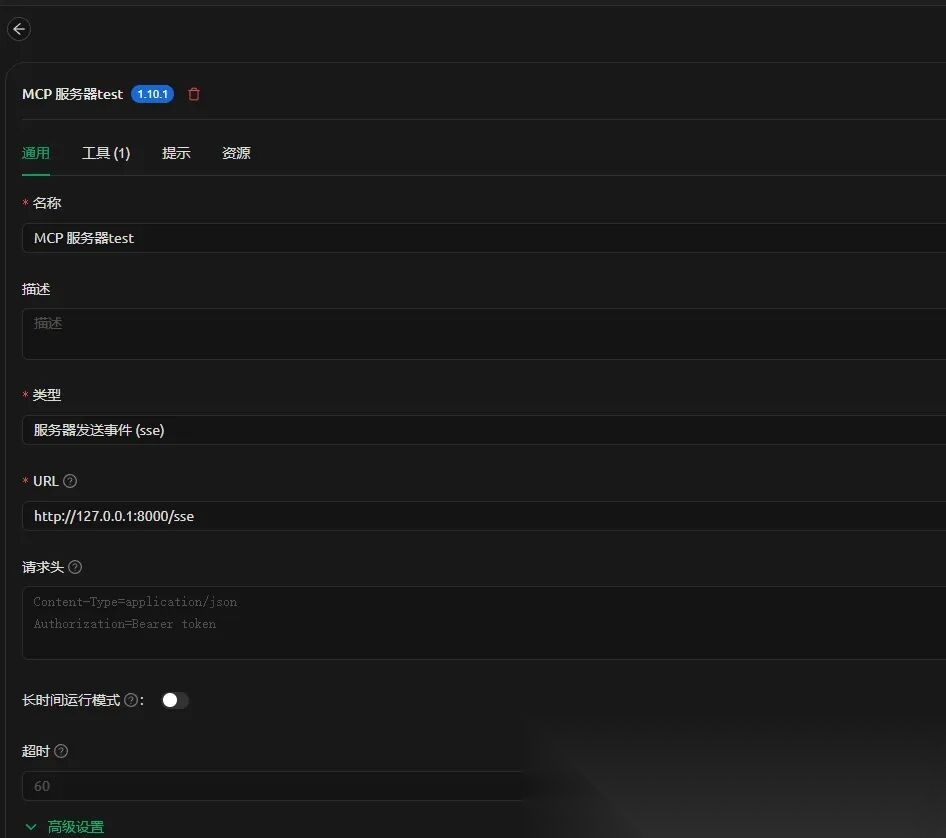

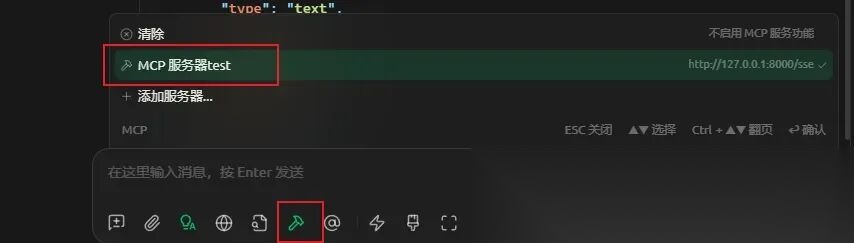

我们使用Cherry studio 作为客户端进行mcp调用

然后在聊天页面勾选相应的mcp服务

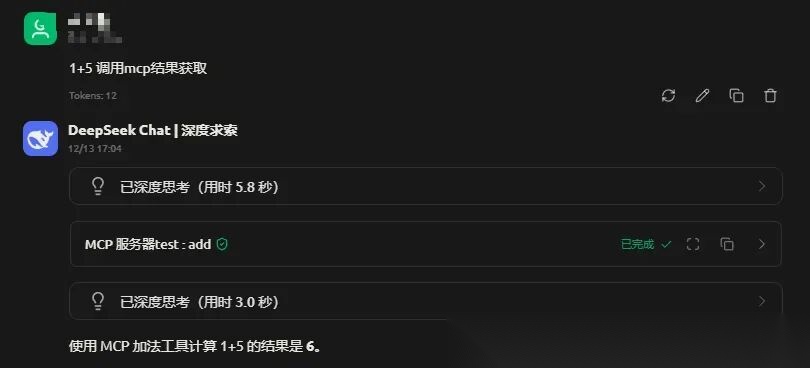

现在我们开始测试(我强制要求LLM调用mcp,因为这个问题实在太简单了,LLM默认情况下会使用最佳路径回答问题,当然也是为了帮我们节约token)

目前已经成功调用了本地的mcp服务,想要了解调用细节可以看看模型“思考的过程”,里面有一定的介绍。

我们回顾下MCP servers 可以提供三种主要类型的功能:

●

Tools(工具):可以被 LLM 调用的函数或外部服务接口,需要用户授权后执行。

●

Resources(资源):提供类似文件的结构化数据,供LLM读取和分析。如本地文件内容、远程api返回的json数据、数据库查询结果等。

●

Prompts(提示):预先编写的模板,帮助用户完成特定任务

其中Prompts(提示) 是对于LLM是非常重要的东西,设计得好可以让LLM很好的理解函数的作用并且准确的调用它。

如果本文对您有帮助,也请帮忙点个 赞👍 + 在看 哈!❤️

参考资料:

1.https://github.com/modelcontextprotocol[3]

2.https://modelcontextprotocol.io/[4]

如何学习AI大模型 ?

“最先掌握AI的人,将会晚掌握AI的人有竞争优势,晚掌握AI的人比完全不会AI的人竞争优势更大”。 在这个技术日新月异的时代,不会新技能或者说落后就要挨打。

老蓝我作为一名在一线互联网企业(保密不方便透露)工作十余年,指导过不少同行后辈。帮助很多人得到了学习和成长。

我是非常希望可以把知识和技术分享给大家,但苦于传播途径有限,很多互联网行业的朋友无法获得正确的籽料得到学习的提升,所以也是整理了一份AI大模型籽料包括:AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、落地项目实战等 免费分享出来。

- AI大模型学习路线图

- 100套AI大模型商业化落地方案

- 100集大模型视频教程

- 200本大模型PDF书籍

- LLM面试题合集

- AI产品经理资源合集

大模型学习路线

想要学习一门新技术,你最先应该开始看的就是学习路线图,而下方这张超详细的学习路线图,按照这个路线进行学习,学完成为一名大模型算法工程师,拿个20k、15薪那是轻轻松松!

视频教程

首先是建议零基础的小伙伴通过视频教程来学习,其中这里给大家分享一份与上面成长路线&学习计划相对应的视频教程。文末有整合包的领取方式

技术书籍籽料

当然,当你入门之后,仅仅是视频教程已经不能满足你的需求了,这里也分享一份我学习期间整理的大模型入门书籍籽料。文末有整合包的领取方式

大模型实际应用报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。文末有整合包的领取方式

大模型落地应用案例PPT

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。文末有整合包的领取方式

大模型面试题&答案

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。文末有整合包的领取方式

领取方式

这份完整版的 AI大模型学习籽料我已经上传CSDN,需要的同学可以微⭐扫描下方CSDN官方认证二维码免费领取!

更多推荐

已为社区贡献38条内容

已为社区贡献38条内容

所有评论(0)