机器学习与深度学习day6——思考如何更好的提取特征

无监督学习,一般指只有数据没有标签,核心特点是:训练数据没有人工标注的标签,模型需要自主从原始数据中挖掘潜在的结构、规律、特征或模式。可以把它理解成:让模型自己 “观察” 和 “总结” 数据的特点,而不是有人手把手教它 “什么是什么”。用一个生活化的例子就能快速区分:无监督学习的任务围绕 “发现数据规律”展开,主要分为三类:核心思想是让模型从未标注数据中通过生成或重建任务自动学习数据的内在结构与语

1.无监督学习

无监督学习,一般指只有数据没有标签,核心特点是:训练数据没有人工标注的标签,模型需要自主从原始数据中挖掘潜在的结构、规律、特征或模式。可以把它理解成:让模型自己 “观察” 和 “总结” 数据的特点,而不是有人手把手教它 “什么是什么”。

用一个生活化的例子就能快速区分:

| 学习范式 | 核心特点 | 生活化类比 | 常见任务 |

|---|---|---|---|

| 监督学习 | 数据带标签 | 老师教你:苹果是红色圆形的、香蕉是黄色长条形的 | 图像分类、房价预测 |

| 无监督学习 | 数据无标签 | 你自己整理书架:把大小相近、内容类似的书放在一起 | 客户分群、图像压缩 |

无监督学习的任务围绕 “发现数据规律”展开,主要分为三类:

-

聚类

- 目标:把相似的数据自动归为一类,不相似的分在不同类。

- 核心逻辑:模型计算数据之间的 “相似度”(比如距离),然后划分族群。

- 常见算法:K-Means、DBSCAN、层次聚类。

- 应用场景:电商用户分群(高消费群、低频群)、图像分割(把同一物体的像素聚在一起)。

-

降维

- 目标:在保留数据核心信息的前提下,降低数据的维度,简化计算。

- 核心逻辑:把高维数据(比如 100 维特征)映射到低维空间(比如 2 维),方便可视化或后续处理。

- 常见算法:PCA(主成分分析)、t-SNE、Umap。

- 应用场景:把高维的图像特征降到 2 维,用散点图直观展示不同类别的分布。

-

生成模型

- 目标:学习数据的分布规律,然后生成和原始数据相似的新数据。

- 核心逻辑:模型 “记住” 数据的特征(比如人脸的五官分布、文本的语法规律),然后 “创造” 新样本。

- 常见算法 / 模型:自编码器(AutoEncoder)、生成对抗网络(GAN)、变分自编码器(VAE)。

- 应用场景:生成逼真的人脸图像、文本续写、图像去噪。

2.生成式自监督

核心思想是让模型从未标注数据中通过生成或重建任务自动学习数据的内在结构与语义表示,无需人工标注标签。它就像让 AI 玩 “填空游戏” 或 “拼图游戏”,通过解决这些自我生成的任务来掌握数据规律,进而为下游任务(如分类、检测、生成等)提供高质量特征表示。

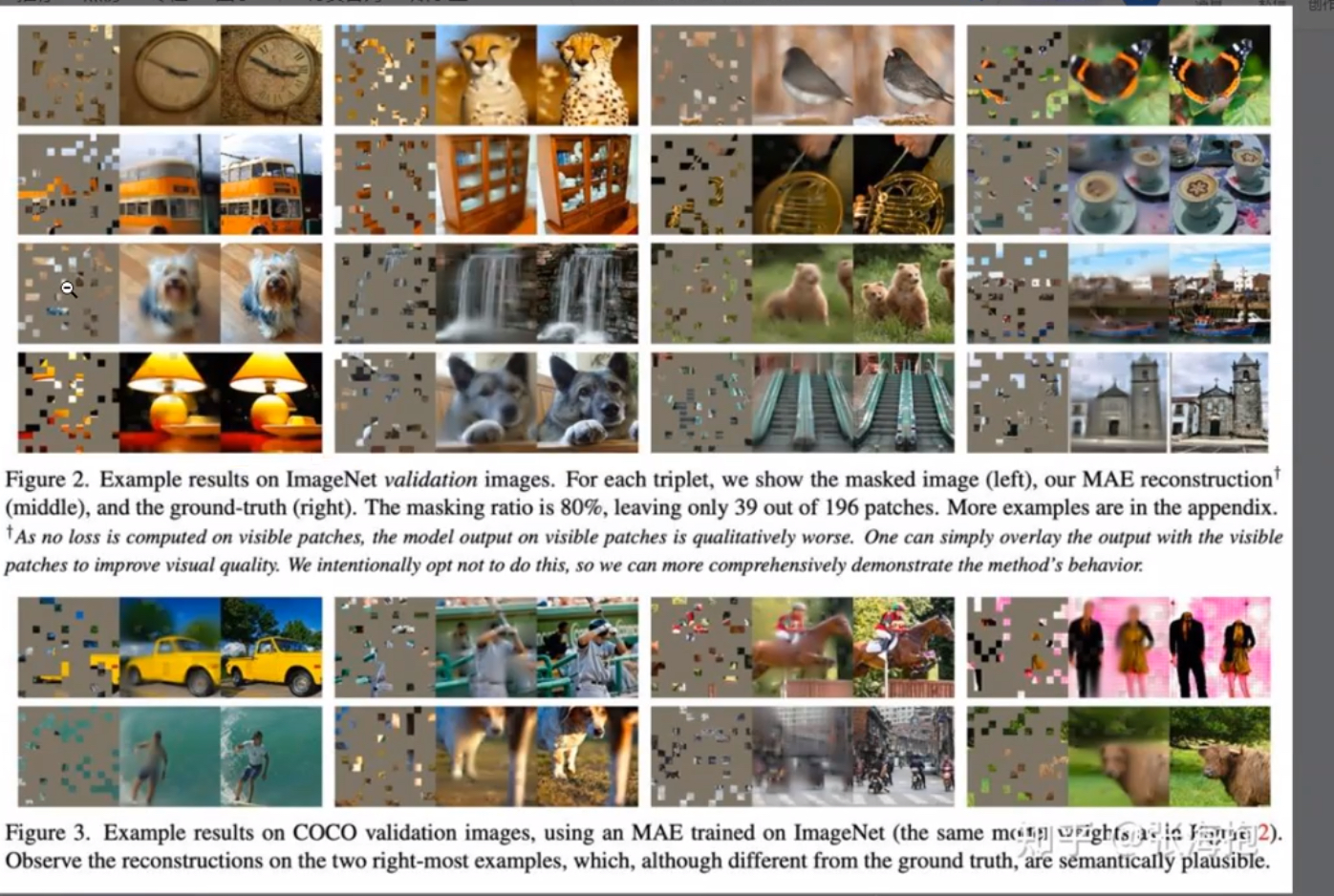

通过输入一张灰度图像——让模型去预测彩色图像

通过输入一些图像碎片——让模型去预测完整图像

3.encoder编码器

编码器 = 数据的「压缩提炼大师」

你可以把编码器想象成一个超级提炼机,它的工作就两件事:

- 输入:一堆「又大又杂」的原始数据(比如一张 224×224 的图片,有几十万个像素点;一句话的文字,有一堆零散的字)

- 输出:一个「又小又精」的核心摘要(叫隐向量)—— 这个摘要扔掉了没用的细节(比如图片的噪点、文字的口水话),只保留最关键的信息(比如图片是猫还是狗、文字是夸人还是骂人)

举 2 个最直观的例子

1. 处理图像时的编码器

- 原始输入:一张猫咪的照片,有

3×224×224 = 150528个像素点(相当于一本厚厚的、全是细节的画册) - 编码器操作:把画册快速翻完,提炼出一句核心话 ——「这是一只黄白相间的短毛猫,正趴在沙发上」

- 输出结果:一个几百维的隐向量(就像刚才那句核心话,短小精悍,信息量足)

2. 处理文本时的编码器

- 原始输入:一句话「我今天早上吃了一个香喷喷的牛肉包子,味道超赞」

- 编码器操作:去掉「今天早上」「香喷喷的」这些修饰,提炼核心 ——「我吃牛肉包,觉得好吃」

- 输出结果:一个几百维的隐向量(浓缩了这句话的核心语义)

编码器和解码器之间的关系

- 编码器负责学本事:拼命提炼数据的核心信息

- 解码器负责考它:拿着编码器的「核心摘要」,尝试还原出原始数据

- 训练完之后:解码器就可以扔了!我们真正要的是学好本事的编码器,用它去做分类、检测这些下游任务(比如用提炼图像的编码器,去判断一张新图是不是猫)

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)