【论文笔记】Families’ Vision of Generative AI Agents for Household Safety Against Digital and Physical Thr

本文通过定性研究揭示了家庭对 Generative AI agent 的真实期待:安全不应是监控,而应是嵌入日常照护角色中的协作支持。论文提出的多 agent 框架与隐私原则,为未来家庭 AI 系统设计与 Agent Safety 研究提供了重要的人本参考。Agent Memory 的隐私设计,与本文提出的四项标准结合。对齐本文提出的 MAS 框架设计和实现特定的 AI Agent demo。

论文信息

论文标题: Families’ Vision of Generative AI Agents for Household Safety Against Digital and Physical Threats

论文作者: Zikai Wen, Lanjing Liu, Yaxing Yao - JHU

论文链接: https://dl.acm.org/doi/10.1145/3757598

论文关键词: HCI, AI&Privacy

研究背景

随着数字技术和智能设备的普及,家庭安全问题呈现出数字安全与物理安全高度交织的特征。青少年尤其面临以下风险:

- 数字空间中的网络霸凌、性骚扰、诈骗、虚假信息、数字成瘾;

- 现实世界中的交通安全、家庭事故与健康紧急情况。

这些风险具有三个显著特征:

- 发生隐蔽、变化迅速;

- 家长难以及时察觉;

- 青少年往往不愿主动向父母披露。

现有家庭安全技术(如家长控制软件、监控应用)主要基于监控与限制逻辑,其结果往往是:

- 强化亲子权力不对等;

- 破坏信任关系;

- 诱发青少年规避、对抗行为。

论文中指出 安全技术若忽视家庭关系与青少年自主性,反而可能削弱安全本身。

当下 GenAI 和 AI Agent 的到来为研究带来新的角度,既有研究显示:

- 青少年愿意与 AI 进行自然语言互动;

- AI 有时被视为“非评判性”的倾诉对象;

- 具备记忆与自治能力的 AI agent 可能长期嵌入家庭生活。

所以本文提出核心研究视角:

不将 GenAI 视为监控工具,而是将其视为家庭支持者与协作者。

研究问题

论文围绕以下三个研究问题展开:

- RQ1: 父母与青少年如何在家庭语境下理解 AI agent 的角色?

- RQ2: 家庭希望 AI agent 如何参与家庭安全管理?

- RQ3: 哪些深层需求与顾虑塑造了家庭对 AI agent 的态度?

这些问题聚焦于用户心智模型(mental models),而非技术可行性。

研究方法

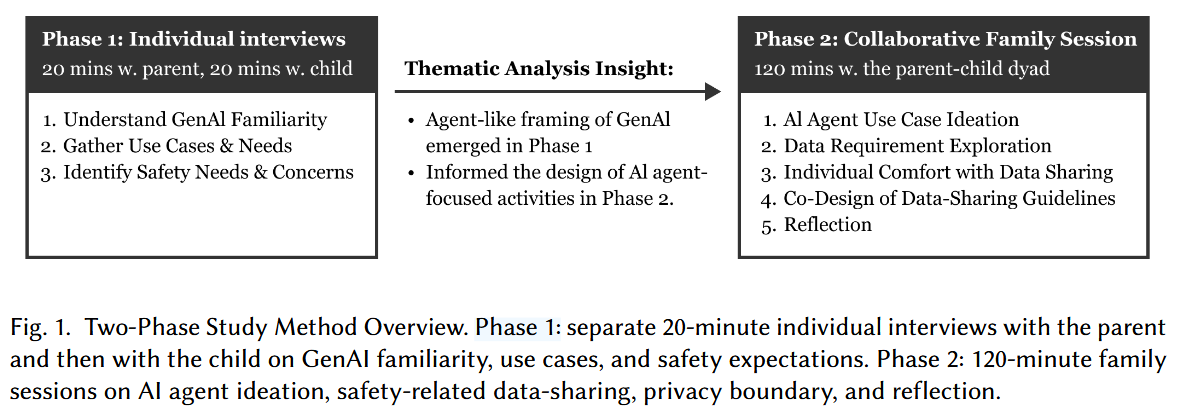

论文采用两阶段定性研究设计:

Phase 1:个别访谈(Individual Interviews)

- 父母与孩子分开进行;

- 了解其对 GenAI 的现有使用、理解与安全认知。

Phase 2:家庭共设计会话(Family Co-design Sessions)

- 父母与孩子共同参与;

- 想象并设计未来具备 agentic 能力的 AI 系统;

- 重点讨论角色分工、数据需求与隐私边界。

参与者

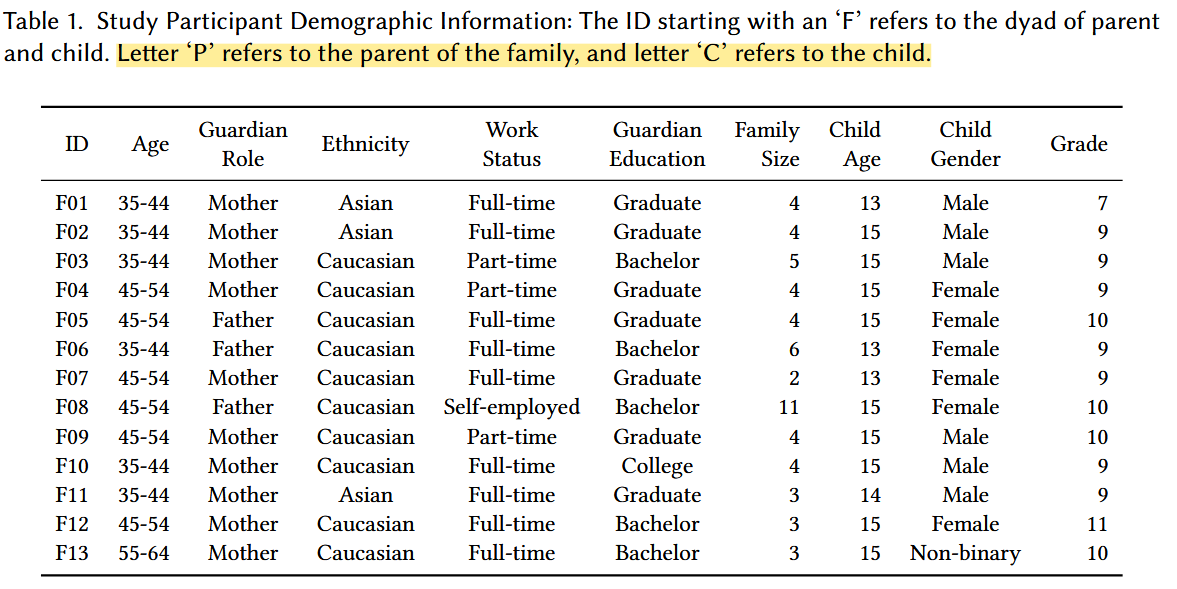

- 13 对亲子 dyads;

- 青少年年龄 13–15 岁;

- 研究对象主要来自美国中产家庭。

研究发现

RQ1 AI Agent 的家庭角色想象

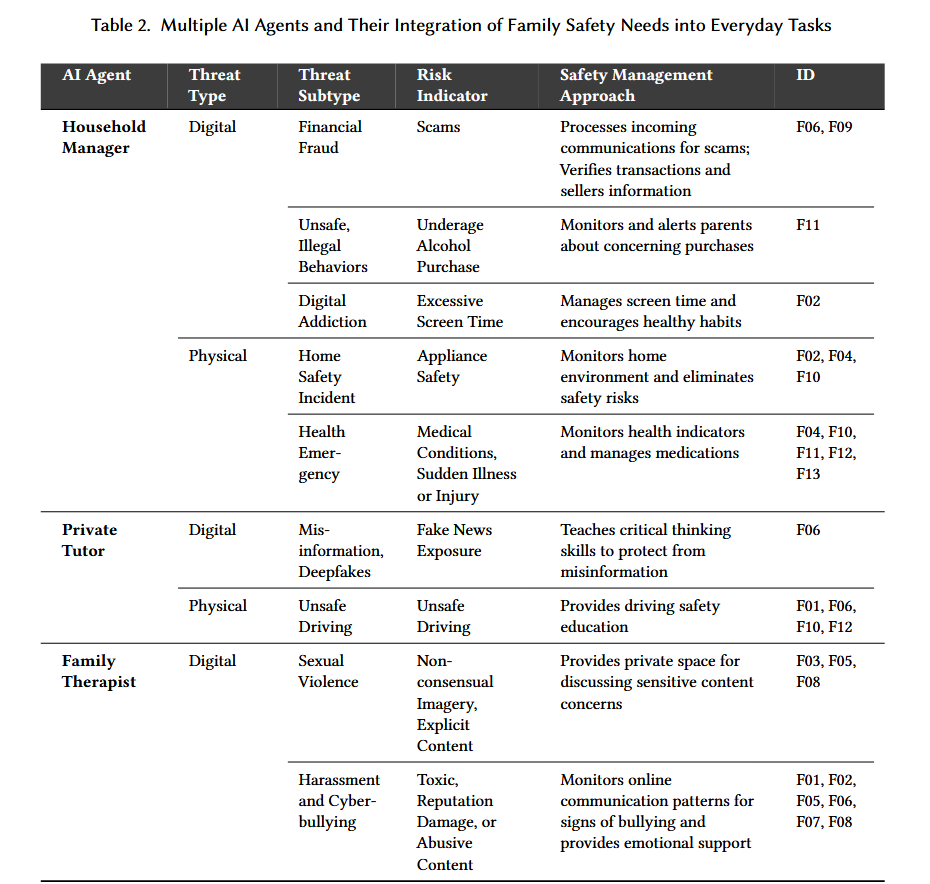

家庭并非从“功能模块”角度理解 AI,而是通过熟悉的家庭照护角色来理解 AI agent。作者总结出三类核心角色:

Household Manager(家庭管家)

- 管理邮件、日程、家务;

- 顺带识别诈骗、异常消费、家庭安全隐患;

- 安全功能以“日常协助”的形式自然嵌入。

Private Tutor(私人教师)

- 提供个性化学习辅导;

- 延伸至数字素养、虚假信息识别、驾驶安全教育;

- 安全被理解为一种“可学习的能力”。

Family Therapist(家庭治疗师)

- 情绪支持、冲突调解;

- 为网络霸凌、性内容等敏感议题提供私密空间;

- 被部分青少年视为比父母更“非评判性”的倾诉对象。

RQ2 安全功能的情境化嵌入

论文发现:家庭并不会主动讨论“安全系统”,而是在讨论日常功能时自然引出安全需求。作者归纳了:

- 6 类数字威胁(诈骗、霸凌、性暴力、成瘾、虚假信息等);

- 3 类物理威胁(交通、家庭事故、健康紧急情况)。

这些威胁分别被映射到不同 AI agent 的日常职责中,而非集中到单一“安全 agent”。

RQ3 隐私、信任与家庭沟通

Agent 级隐私边界

家庭强烈反对不同 AI agent 自动共享信息,即便它们属于同一系统。特别是:therapist agent 的信息不应自动传递给父母或其他 agent。

代际差异

- 青少年:更信任 AI 的非评判性;

- 父母:更担忧数据滥用与隐私泄露。

AI 不应取代亲子沟通

家庭一致认为:AI agent 应当促进而非替代父母与孩子之间的直接沟通。

设计框架与理论贡献

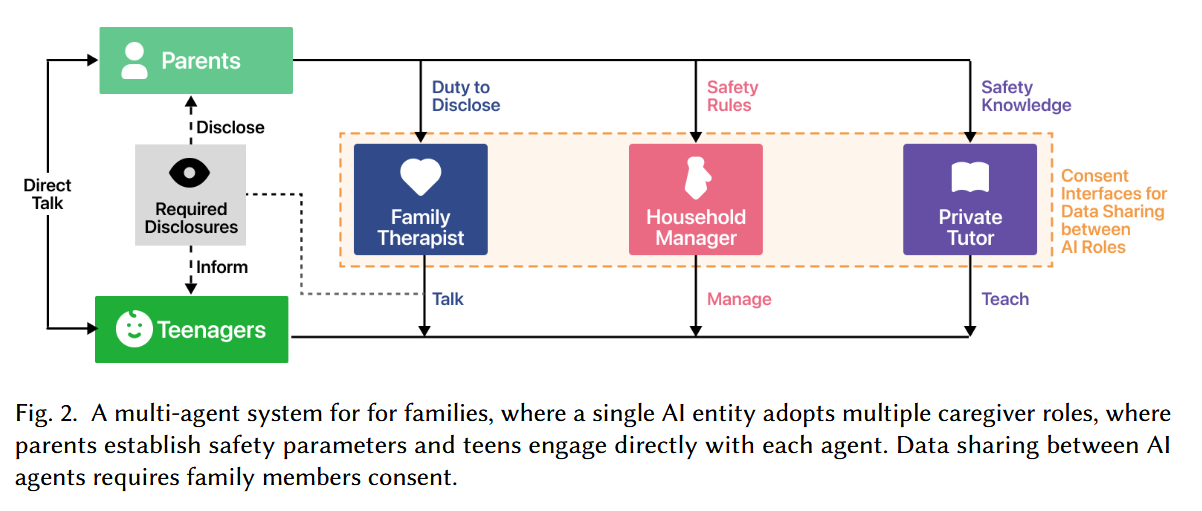

基于上面的研究,作者提出一个多 AI agent 系统框架,每个 agent 扮演不同照护角色,并通过“talk / manage / teach”路径与家庭成员互动。

该框架要遵循四项隐私设计原则:

- Memory Segregation:不同 agent 维护独立记忆;

- Conversational Consent:通过自然语言征求数据共享同意;

- Selective Sharing:仅共享必要信息;

- Progressive Memory:敏感数据随时间淡出。

该框架扩展了 Communication Privacy Management (CPM) 理论在多 agent 系统中的适用性。

伦理风险与研究局限

潜在风险

- 情感支持“幻觉”;

- 过度依赖 AI;

- 责任转移;

- 文化与家庭价值误判。

研究局限

- 样本规模小且同质;

- 基于想象而非真实部署;

- 年龄段有限;

- 技术发展快速,认知可能变化。

总结

本文通过定性研究揭示了家庭对 Generative AI agent 的真实期待:安全不应是监控,而应是嵌入日常照护角色中的协作支持。论文提出的多 agent 框架与隐私原则,为未来家庭 AI 系统设计与 Agent Safety 研究提供了重要的人本参考。

对未来的研究方向有以下参考:

- Agent Memory 的隐私设计,与本文提出的四项标准结合。

- 对齐本文提出的 MAS 框架设计和实现特定的 AI Agent demo。

- 为保证家庭隐私等需求,是否应该提出全流程,包含系统实现与形式化安全分析,等覆盖 agent 全生命周期的 理论指导框架。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)