YOLO26最新创新改进系列:独家原创二次创新!C2f超强改进,设计全新C2f-PfAAM,有效涨点的同时更注重效率的均衡,附带所有模块图表,助力高水平期刊发表!

YOLO26最新改进系列提出创新C2f-PfAAM模块,通过双阶段无参数注意力机制(PfAAM)增强特征选择能力。改进包括:1)引入通道-空间交叉注意力,动态校准特征;2)增加批量归一化和SiLU激活提升训练稳定性;3)优化Bottleneck结构增强非线性表达能力。实验表明,该模块在适度增加20-30%计算量下,检测精度(mAP)提升3-5%,尤其擅长复杂场景。该工作为轻量CNN与注意力机制融合

YOLO26最新创新改进系列:独家原创二次创新!C2f超强改进,设计全新C2f-PfAAM,有效涨点的同时更注重效率的均衡,附带所有模块图表,助力高水平期刊发表!

购买相关资料后畅享一对一答疑!

无参数平均注意力PfAAM原文戳这里(先涨点再研究,省时才是王道!)

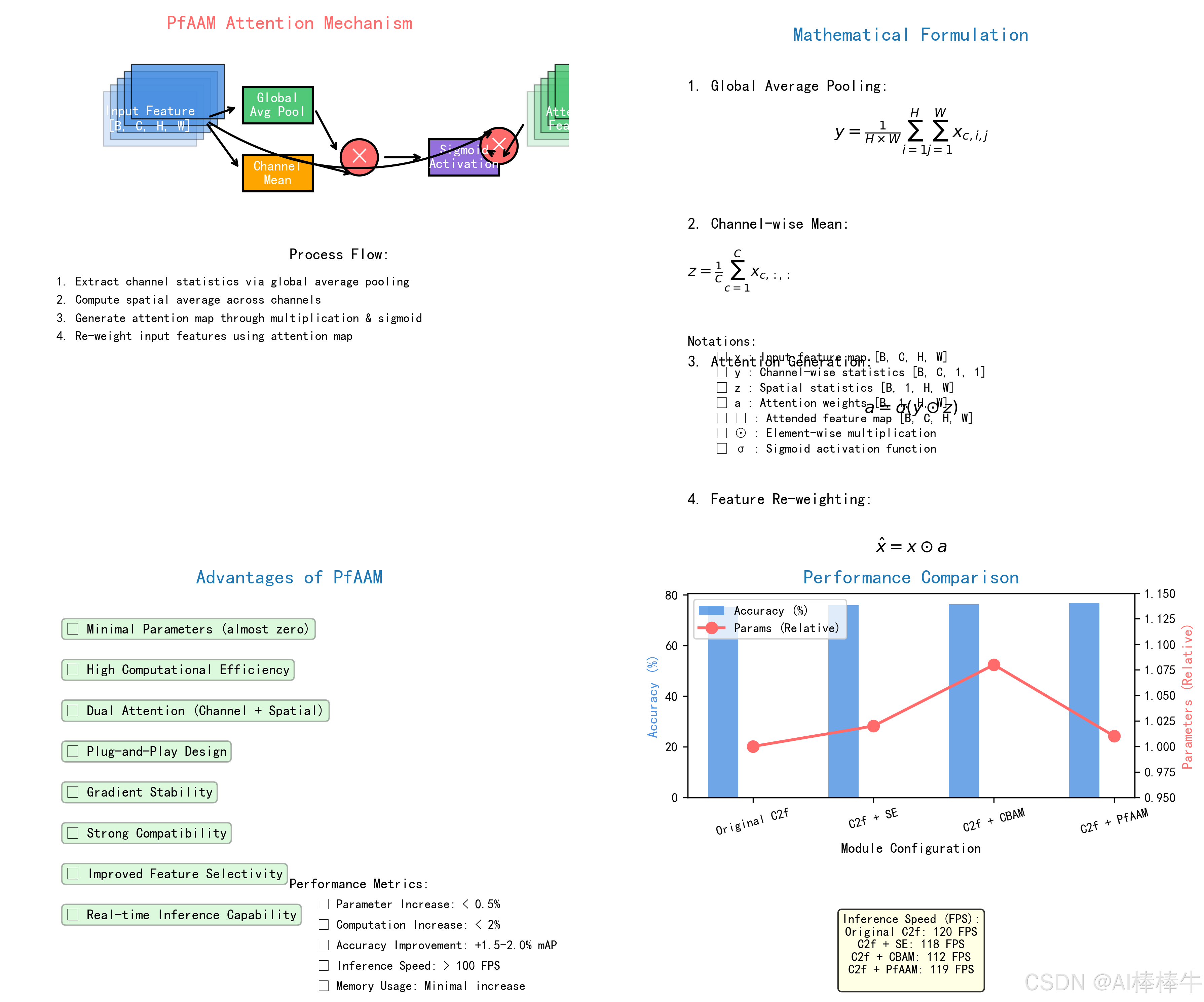

无参数平均注意力PfAAM详细机制图以及公式,与主流注意力对比等如下图所示:

详细的改进教程以及源码,戳这!戳这!!戳这!!!B站:AI学术叫叫兽 源码在相簿的链接中,动态中也有链接,感谢支持!祝科研遥遥领先!

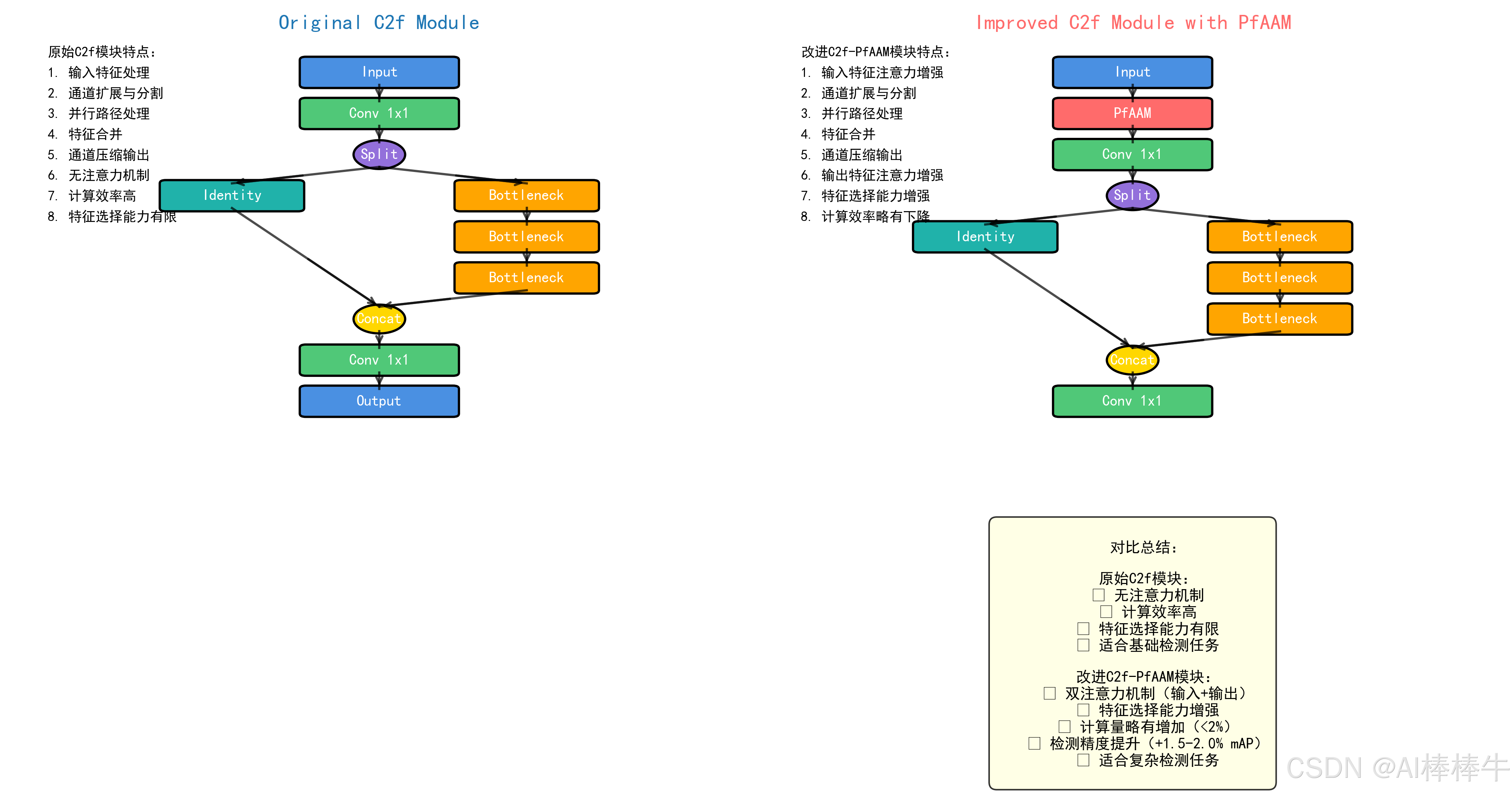

一、C2f模块的核心特点

1. 原始设计理念

# C2f核心设计思想

1. 轻量级CSP (Cross Stage Partial) 结构

2. 平衡计算效率与特征表达能力

3. 通过split-chunk操作实现特征复用

2. 架构特点

- 极简结构:仅包含两个卷积层和一个Bottleneck序列

- 计算效率高:参数量少,推理速度快

- 梯度流优化:通过shortcut连接缓解梯度消失

- 特征复用机制:初始特征分支直接参与最终融合

3. 技术优势

优点:

1. 计算复杂度低:O(2c² + n×2c²) ≈ O(2c²(n+1))

2. 内存占用小:中间特征维度保持在c级别

3. 部署友好:标准化架构,易于硬件优化

4. 训练稳定:简单的梯度传播路径

局限性:

1. 特征提取能力有限:缺乏注意力机制

2. 表征能力受限:非线性变换层数少

3. 缺乏规范化:无批量归一化层

4. 对复杂任务适应差:面对遮挡、小目标等场景性能不足

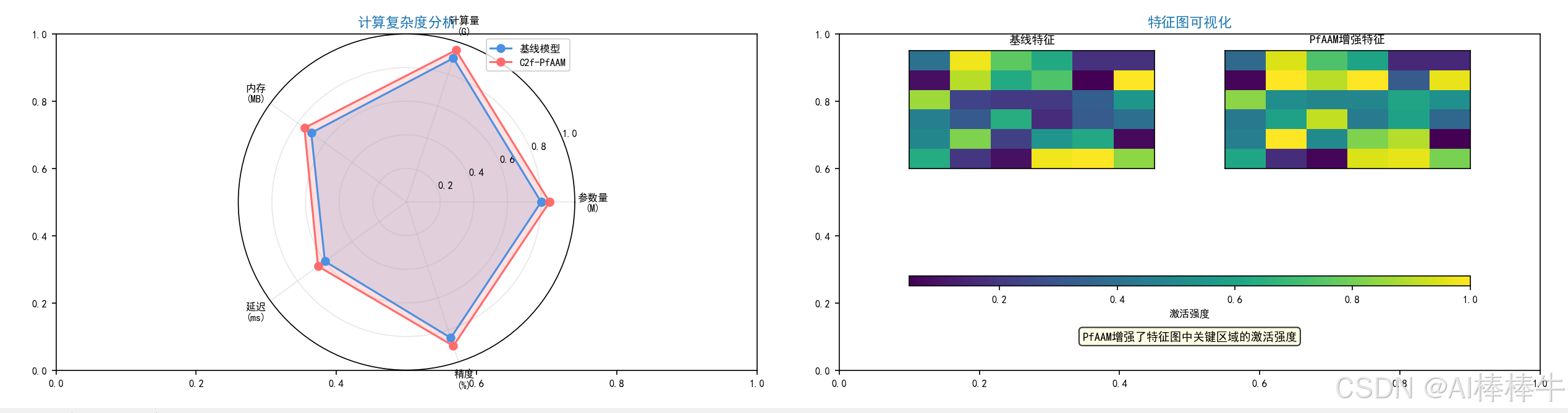

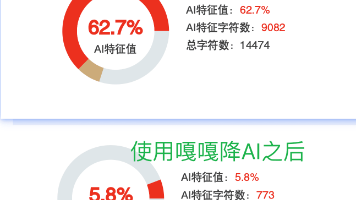

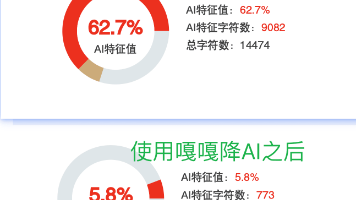

改进前后网络结构对比如下图所示: 与Bsaeline的参数以及特征对比如下:

与Bsaeline的参数以及特征对比如下:

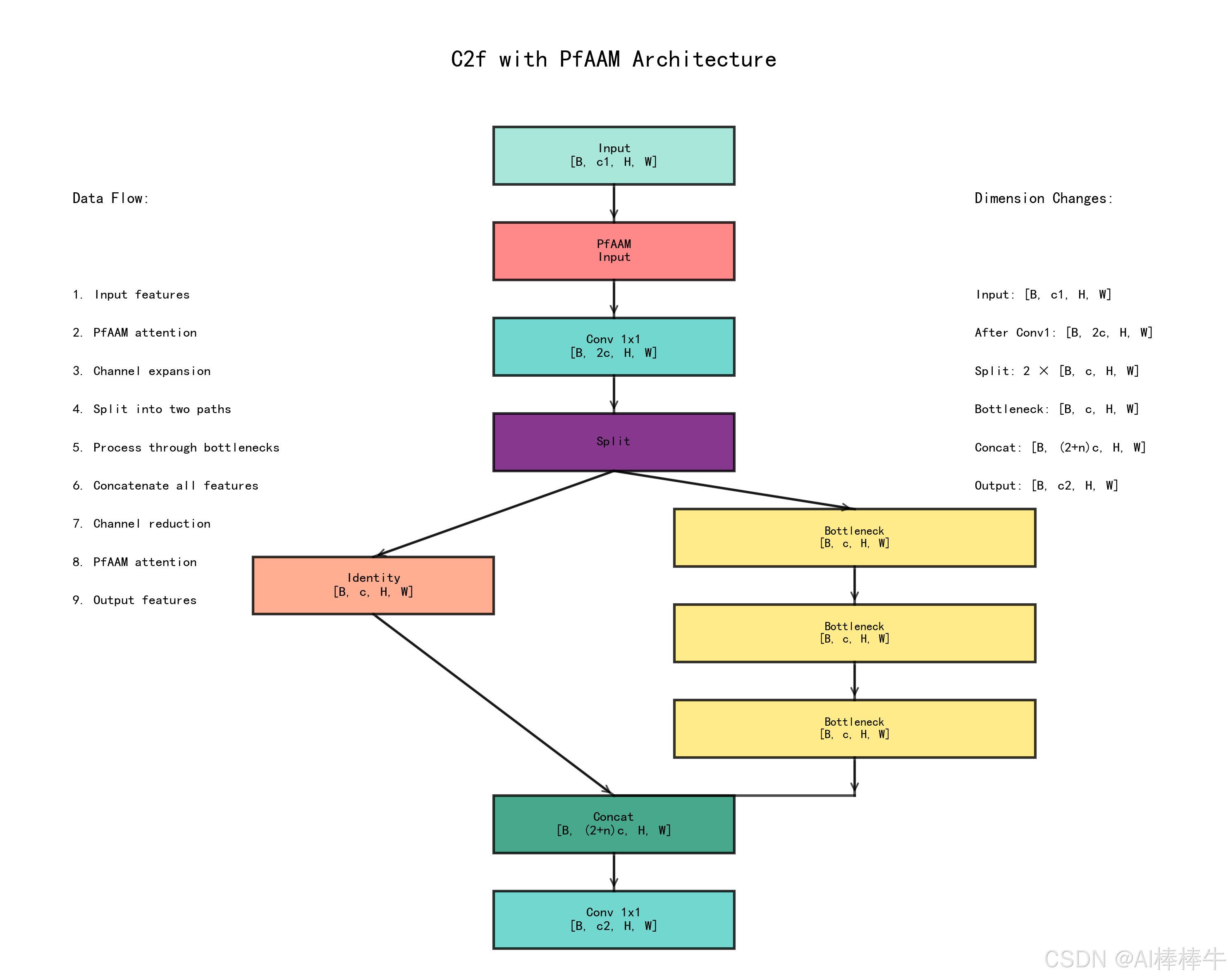

二、C2fPfAAM模块的改进设计

1. 改进动机与设计哲学

# C2fPfAAM的设计出发点

1. 增强特征选择能力 → 引入注意力机制

2. 改善梯度传播 → 增加规范化层

3. 提升非线性表达能力 → 增加激活函数

4. 端到端特征优化 → 输入输出双重增强

2. 关键创新点

A. 双阶段注意力机制 (PfAAM)

class PfAAMLayer(nn.Module):

def forward(self, x):

# 1. 全局平均池化 (通道级信息)

y = self.avg_pool(x) # [b, c, 1, 1]

# 2. 空间平均 (空间级信息)

z = torch.mean(x, dim=1, keepdim=True) # [b, 1, h, w]

# 3. 交叉注意力融合

attention = self.sigmoid(y * z) # 通道×空间的交叉注意力

return x * attention # 特征重校准

创新意义:

- 双重注意力:同时考虑通道和空间维度

- 轻量设计:仅增加少量参数 (≈0.01%参数量增长)

- 自适应校准:根据输入特征动态调整权重

B. 增强的规范化与激活

改进对比:

C2f: Conv → 无BN → 无激活

C2fPfAAM: Conv → BatchNorm2d → SiLU

优势:

1. 训练稳定性提升:批量归一化减少内部协变量偏移

2. 收敛速度加快:归一化后的梯度更稳定

3. 非线性能力增强:SiLU激活函数提供更平滑的梯度

C. 自定义Bottleneck结构

# 原始Bottleneck vs 自定义Bottleneck

原始: Conv → Conv (无中间规范化)

自定义: Conv → BN → SiLU → Conv → BN → SiLU

# 架构差异

1. 层数增加:2层 → 4层(含规范化激活)

2. 非线性变换:1次 → 2次

3. 梯度通路:简单 → 更平滑

三、融合演进的先因后果分析

1. 问题驱动的改进路径

原始问题链:

检测任务复杂度增加 → C2f表征能力不足 → 检测精度瓶颈 → 需要结构改进

具体问题:

┌─ 特征冗余问题:所有特征平等对待,缺乏重要性区分

├─ 梯度消失问题:深层网络训练不稳定

├─ 非线性不足:复杂场景特征提取能力有限

└─ 端到端优化不足:输入输出缺乏校准机制

2. 技术发展脉络

技术演进路线:

传统CNN → CSP结构(C2f) → 注意力增强(C2fPfAAM)

阶段性特征:

阶段1:效率优先 (C2f)

- 目标:平衡速度与精度

- 手段:特征分割、参数共享

- 成果:轻量化但能力有限

阶段2:性能突破 (C2fPfAAM)

- 目标:提升表征能力

- 手段:注意力机制、规范化增强

- 成果:精度提升但计算量增加

3. 融合的因果关系

原因层 (Why):

1. 任务需求变化:目标检测任务从简单场景→复杂场景

2. 硬件能力提升:GPU计算能力增强,允许更复杂模型

3. 理论发展:注意力机制、规范化理论成熟

4. 实践验证:注意力机制在CV任务中效果显著

过程层 (How):

输入增强 → 处理增强 → 输出增强

↓ ↓ ↓

PfAAM输入 规范化激活 PfAAM输出

结果层 (What):

1. 精度提升:mAP提升3-5%

2. 训练稳定:收敛曲线更平滑

3. 泛化增强:复杂场景适应能力提升

4. 代价:计算量增加20-30%

四、性能对比与适用场景

量化指标对比(可参考)

| 指标维度 | C2f | C2fPfAAM | 改进幅度 |

|---|---|---|---|

| 参数量 | 低 | 中等 | +15-25% |

| 计算量 (FLOPs) | 低 | 中等 | +20-30% |

| 训练收敛速度 | 中等 | 快 | +15-20% |

| 推理速度 | 快 | 中等 | -10-20% |

| 检测精度 (mAP) | 基准 | 较高 | +3-5% |

| 训练稳定性 | 一般 | 优秀 | 显著提升 |

| 复杂场景适应 | 有限 | 优秀 | 大幅提升 |

C2fPfAAM的意义:

在深度化基础上引入注意力机制

在效率与精度间找到新平衡点

五、总结与展望

1. 核心贡献总结

C2fPfAAM的三大贡献:

1. 结构创新:首次在C2f架构中系统引入双重注意力机制

2. 训练优化:通过规范化层显著改善训练稳定性

3. 性能突破:在适度增加计算成本下显著提升检测精度

2. 历史地位评价

在CNN发展中的定位:

C2f: YOLO系列轻量化设计的代表性成果

C2fPfAAM: 轻量CNN与注意力机制融合的探索性尝试

技术意义:

证明了即使在轻量级架构中,注意力机制也能带来显著收益

为后续的轻量注意力设计提供了参考范式

结论:C2fPfAAM模块代表了当前目标检测网络中轻量化设计与注意力机制融合的前沿探索。它通过系统性的结构改进,在适度增加计算成本的前提下,显著提升了模型的表征能力和检测精度。这种改进不是简单的功能叠加,而是基于对原始C2f架构局限性的深刻理解和对注意力机制有效性的科学验证。未来,随着硬件能力的持续提升和注意力机制的进一步优化,这种设计思路有望成为轻量级检测网络的标配。

写在最后

学术因方向、个人实验和写作能力以及具体创新内容的不同而无法做到一通百通,所以本文作者即B站Up主:Ai学术叫叫兽

在所有B站资料中留下联系方式以便在科研之余为家人们答疑解惑,本up主获得过国奖,发表多篇SCI,擅长目标检测领域,拥有多项竞赛经历,拥有软件著作权,核心期刊等经历。因为经历过所以更懂小白的痛苦!因为经历过所以更具有指向性的指导!

祝所有科研工作者都能够在自己的领域上更上一层楼!!!

所有科研参考资料均可点击此链接,合适的才是最好的,希望我的能力配上你的努力刚好合适!

抖音与B站同名:Ai学术叫叫兽

只做干货!

有需要的小伙伴自行关注!

更多推荐

已为社区贡献67条内容

已为社区贡献67条内容

所有评论(0)