AI行业应用全景解析:从短视频、设计到服务业的深度落地

AI技术正深度改变短视频、设计和服务业的生产方式。在短视频领域,AI实现了从脚本生成到数字人出镜的全流程自动化,制作效率提升16倍,成本降低95%。设计行业借助Stable Diffusion等工具,可快速完成产品主图风格迁移和批量海报生成,Midjourney等AI工具已成为设计师的创意助手。服务业通过RAG技术构建智能客服系统,响应时间从300秒降至5秒,客户满意度提升15%。AI应用已从实验

引言:人工智能的“iPhone时刻”已至

随着ChatGPT、Midjourney、Sora等生成式AI(AIGC)工具的爆发,人工智能不再仅仅是实验室里的算法模型,而是已经深入到了各行各业的生产流程中。从内容创作到工业设计,从客户服务到数据分析,AI正在重塑生产力边界。本文将深入剖析AI在短视频、设计、服务业三大领域的落地应用,通过实际代码、Mermaid流程图、Prompt示例及可视化图表,为您展示一场正在发生的数字化生产力革命。

第一部分:AI在短视频领域的应用(内容工厂的自动化)

短视频行业是AIGC落地最快、最直观的领域。传统的视频制作流程(脚本-拍摄-剪辑-特效)周期长、成本高,而AI技术正在将其压缩到分钟级别。

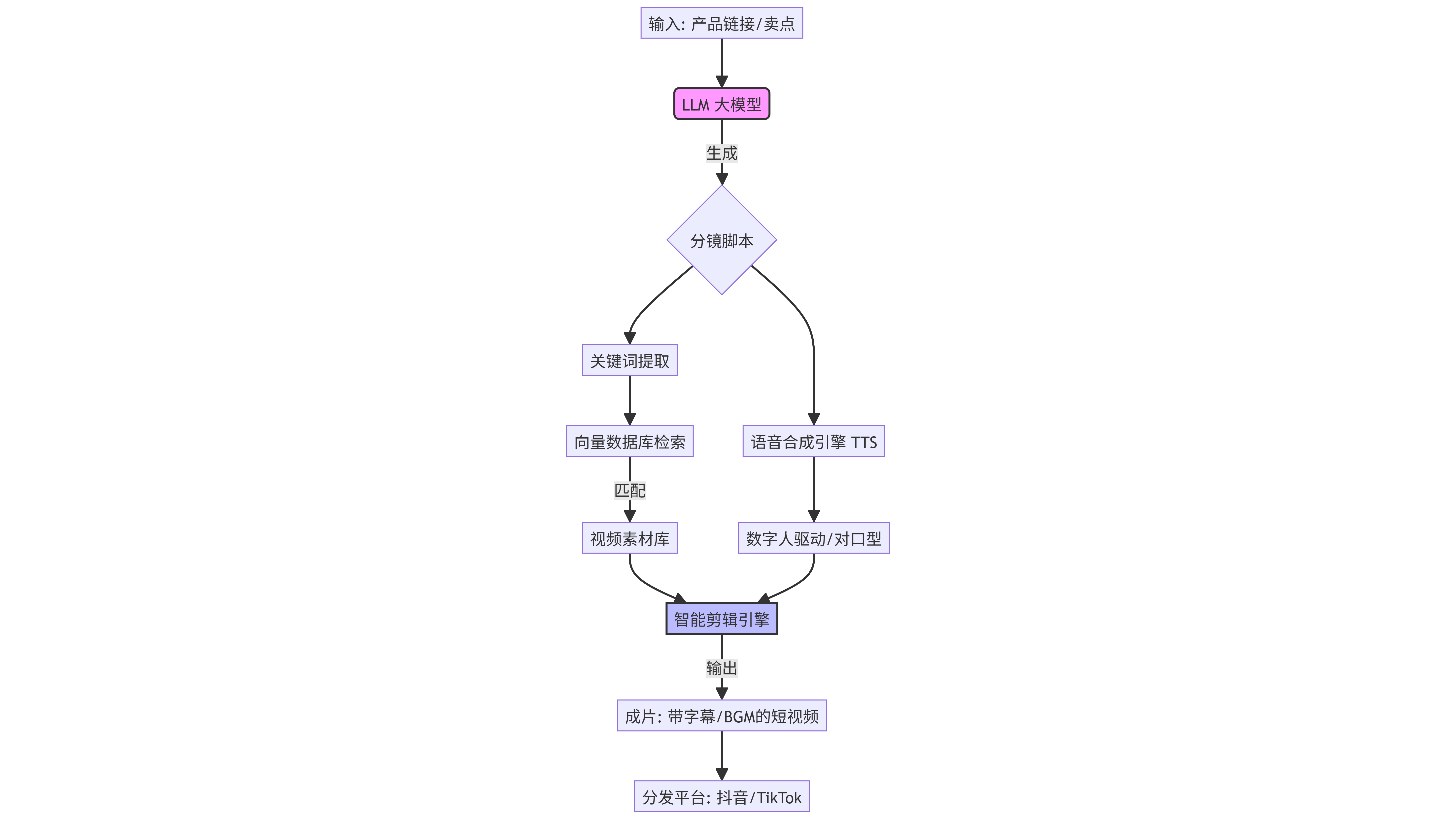

1.1 落地案例:全自动化的短视频生成流水线

案例背景:某MCN机构需要每天生产100条针对不同产品的带货短视频。人工团队需要10人,引入AI后,仅需2人即可完成。

核心流程:

- 脚本生成:基于产品卖点自动生成高转化率口播文案。

- 素材匹配:通过语义理解自动从素材库匹配视频片段。

- 语音合成(TTS):将文本转换为逼真的真人语音。

- 数字人出镜:使用AI生成的数字人代替真人主播。

- 自动剪辑:根据节奏自动拼接、添加字幕和特效。

Mermaid流程图:AI短视频自动化生产流程

graph TD

A[输入: 产品链接/卖点] --> B(LLM 大模型)

B -->|生成| C{分镜脚本}

C --> D[语音合成引擎 TTS]

C --> E[关键词提取]

E --> F[向量数据库检索]

F -->|匹配| G[视频素材库]

D --> H[数字人驱动/对口型]

G --> I[智能剪辑引擎]

H --> I

I -->|输出| J[成片: 带字幕/BGM的短视频]

J --> K[分发平台: 抖音/TikTok]

style B fill:#f9f,stroke:#333,stroke-width:2px

style I fill:#bbf,stroke:#333,stroke-width:2px

1.2 核心技术实现与代码示例

技术栈:Python + OpenAI API + MoviePy

以下是使用Python调用大模型生成短视频脚本,并利用MoviePy进行简单自动化处理的逻辑示例。

import openai

from moviepy.editor import *

import os

# 配置API Key

openai.api_key = "YOUR_OPENAI_API_KEY"

def generate_script(product_name, target_audience):

"""

利用LLM生成短视频脚本

"""

prompt = f"""

角色:你是一名资深短视频带货脚本编剧。

任务:为产品【{product_name}】写一段30秒的带货口播脚本。

目标受众:{target_audience}。

要求:

1. 开头3秒必须有悬念或痛点。

2. 中间强调产品核心卖点。

3. 结尾有强烈的行动号召(CTA)。

4. 输出格式为JSON,包含字段:scene(画面描述), text(口播文案), duration(时长秒)。

"""

response = openai.ChatCompletion.create(

model="gpt-4",

messages=[{"role": "user", "content": prompt}],

temperature=0.7

)

return response.choices[0].message.content

def simple_auto_compile(video_clips_dir, audio_file, output_path):

"""

简单的自动化视频合成逻辑

"""

# 1. 加载音频

audio_clip = AudioFileClip(audio_file)

audio_duration = audio_clip.duration

# 2. 加载素材(假设自动选取了3个片段)

clips = []

for file_name in os.listdir(video_clips_dir)[:3]:

clip = VideoFileClip(os.path.join(video_clips_dir, file_name))

# 简单的循环或截取以匹配音频长度

clip = clip.loop(duration=audio_duration / 3)

clips.append(clip)

# 3. 拼接视频

final_video = concatenate_videoclips(clips)

final_video = final_video.set_audio(audio_clip)

# 4. 输出

final_video.write_videofile(output_path, fps=24)

# 模拟执行

# script_data = generate_script("智能降噪耳机", "经常通勤的上班族")

# print(script_data)

# simple_auto_compile("./assets/clips", "./assets/audio.wav", "final_ad.mp4")

1.3 Prompt工程:爆款文案的炼金术

在短视频创作中,Prompt的质量直接决定了脚本的质量。

Prompt 示例(结构化提示词):

# Role (角色)

TikTok 爆款视频策划专家

# Context (背景)

我们要为一款“便携式榨汁机”制作一段15秒的种草视频。

# Goal (目标)

生成一个高完播率、高转化的脚本。

# Constraints (约束)

- 语速要快,节奏感强。

- 避免使用生硬的营销词汇,要用生活化的场景带入。

- 必须包含视觉画面指导。

# Output Format (输出格式)

| 时间 | 画面描述 | 口播文案 | 备注 |

| :--- | :--- | :--- | :--- |

| 0-3s | ... | ... | ... |

# Few-Shot Examples (少样本示例)

示例:

时间:0-3s

画面:上班族在办公室疲惫地喝着没味道的温水。

文案:还在喝这种没味道的白开水?难怪你每天下午都犯困!

1.4 行业数据与效果对比

下图展示了传统人工制作与AI辅助制作在效率和成本上的对比。

| 维度 | 传统人工制作团队 | AI辅助制作团队 | 提升效率 |

|---|---|---|---|

| 单人日产视频量 | 3-5 条 | 50-80 条 | 16倍+ |

| 单条视频平均成本 | 200-500 元 | 5-10 元 | 降低95% |

| 制作周期 | 2-4 小时 | 5-10 分钟 | 极速响应 |

| 测试迭代速度 | 慢,难批量A/B测试 | 快,可海量生成测款 | 质变 |

[图表描述: 柱状图]

- X轴:制作周期、成本、产量

- Y轴:数值(对数刻度)

- 蓝色柱代表传统模式,橙色柱代表AI模式。橙色柱在“产量”上极高,在“成本”和“周期”上极低,视觉冲击力强。

第二部分:AI在设计领域的应用(创意与效率的平衡)

设计行业曾被视为AI最难攻克的堡垒,因为创意被视为人类的最后一道防线。然而,随着Midjourney和Stable Diffusion的成熟,AI已经成为设计师最强大的“副驾驶”。

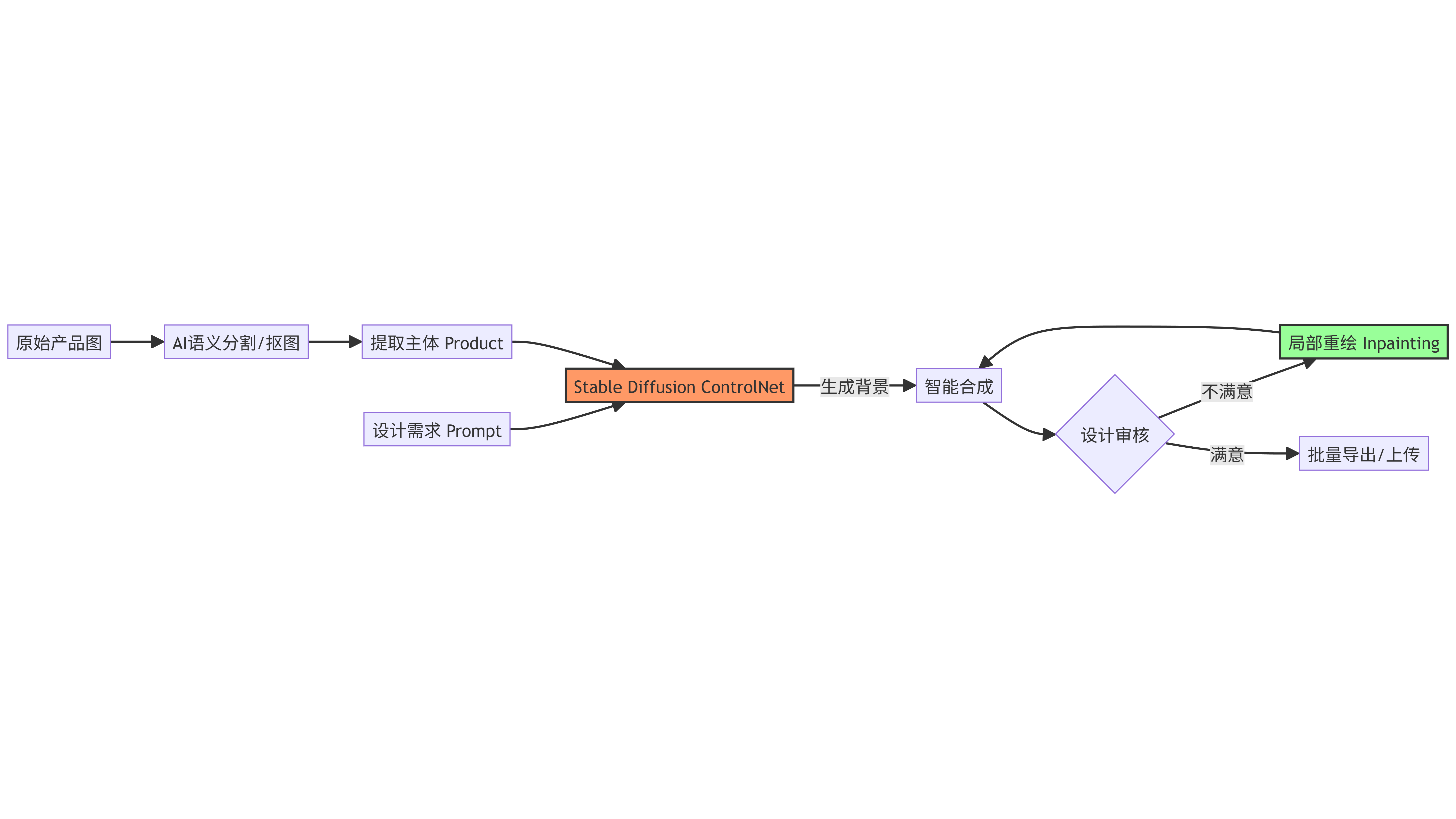

2.1 落地案例:电商产品主图与海报自动化

案例背景:某电商大促期间,需要为1000个SKU(库存量单位)生成适配不同场景(春节、情人节、夏季促销)的营销海报。

核心流程:

- 智能构图:保留产品主体(通过AI抠图),替换背景。

- 风格迁移:将实拍产品图转化为3D渲染、国潮插画或赛博朋克风格。

- 局部重绘:通过Inpainting技术修改产品细节(如给手机换壳色)。

- 扩展画面:将简单的方图扩展为宽屏海报,自动补全周边环境。

Mermaid流程图:AI辅助设计工作流

graph LR

A[原始产品图] --> B[AI语义分割/抠图]

B --> C[提取主体 Product]

D[设计需求 Prompt] --> E[Stable Diffusion ControlNet]

C --> E

E -->|生成背景| F[智能合成]

F --> G{设计审核}

G -->|不满意| H[局部重绘 Inpainting]

H --> F

G -->|满意| I[批量导出/上传]

style E fill:#f96,stroke:#333,stroke-width:2px

style H fill:#9f9,stroke:#333,stroke-width:2px

2.2 核心技术实现:Stable Diffusion ControlNet

ControlNet是AI设计落地的关键技术,它允许用户控制生成的图像结构(如边缘、姿态、深度),而不仅仅依赖随机生成的文本。

代码示例:使用Stable Diffusion WebUI API进行图生图

import requests

import base64

import io

from PIL import Image

# 读取原始产品图

def image_to_base64(image_path):

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode('utf-8')

input_image = image_to_base64("product_shoe.jpg")

# 调用 Stable Diffusion API (假设本地部署了SD WebUI)

url = "http://127.0.0.1:7860/sdapi/v1/img2img"

payload = {

"init_images": [input_image],

"prompt": "professional product photography, nike shoe, floating in mid air, cinematic lighting, neon cyberpunk background, 8k resolution, highly detailed",

"negative_prompt": "ugly, blurry, low quality, distorted, watermark",

"denoising_strength": 0.6, # 控制改动幅度,越小越保留原图

"steps": 20,

"cfg_scale": 7

}

response = requests.post(url, json=payload)

# 保存结果

r = response.json()

img_data = base64.b64decode(r['images'][0])

img = Image.open(io.BytesIO(img_data))

img.save("final_design.png")

print("设计图已生成!")

2.3 高级Prompt技巧:设计专用

设计领域的Prompt不同于文案,它更强调艺术风格、光影和构图参数。

Prompt 示例(Midjourney V6 风格):

/imagine prompt: A minimalist logo design for a coffee brand named "BeanZen", vector style, flat design, earth tones --v 6.0 --ar 1:1 --q 2

/imagine prompt: Close-up shot of a skincare cream bottle, placed on a rock by a waterfall, morning sunlight, lens flare, moisture atmosphere, realistic texture, octane render, 8k --stylize 250

# 参数解析:

# --v 6.0: 使用V6模型

# --ar 16:9: 宽高比

# --s 250: 风格化程度(越高越艺术,越低越忠实Prompt)

# --no text: 负面提示,不要文字

2.4 效果展示(图解)

[图片占位符 1:AI电商场景图]

- 描述:左边是一张普通的白色背景吹风机照片。右边是AI处理后的效果图,吹风机位于豪华浴室中,大理石台面,暖色调灯光,光线柔和,充满高级感。

- 技术点:Stable Diffusion + ControlNet (Canny/Depth模型)。

[图片占位符 2:UI界面生成]

- 描述:一张展示“金融理财APP”的UI界面图。包含深色模式、金色数据曲线、清晰的卡片式布局。

- 技术点:直接使用Prompt生成UI灵感,或使用专门的UI设计AI工具如Galileo AI。

第三部分:AI在服务业的应用(超级智能客服与个性化服务)

服务业是劳动密集型产业,AI的应用主要体现在降本增效和提升用户体验上。从简单的问答机器人到具备情感分析能力的智能客服,AI正在改变服务业的交互方式。

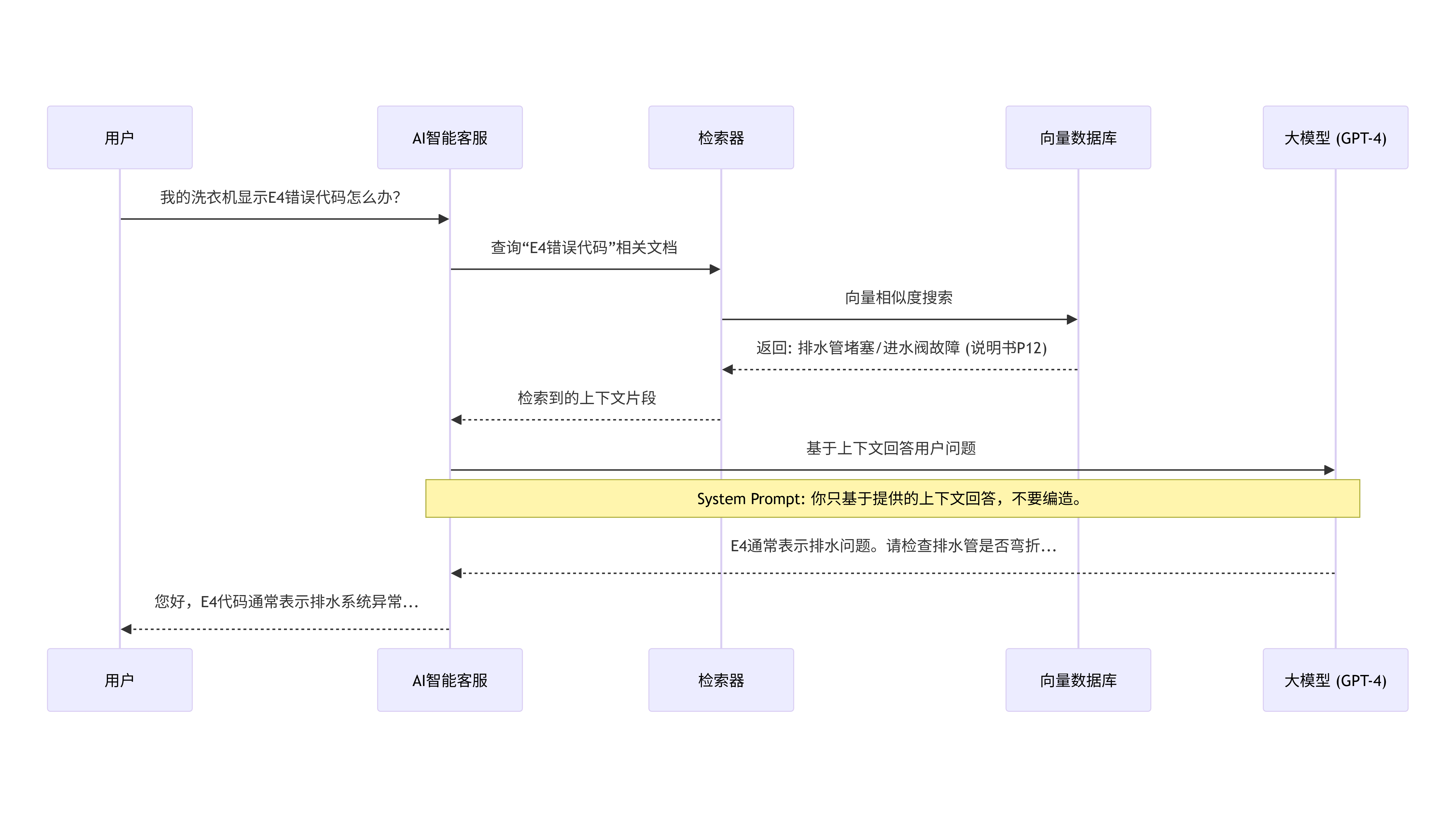

3.1 落地案例:基于RAG(检索增强生成)的智能售后客服

案例背景:一家大型家电企业,每天面临数万次售后咨询。传统关键词机器人答非所问,人工客服成本高昂。

解决方案:利用RAG技术,将产品的PDF说明书、维修文档、历史问答记录向量化,构建知识库。当用户提问时,AI先检索相关文档,再基于文档内容生成准确的回答。

Mermaid流程图:RAG智能客服工作原理

sequenceDiagram

participant User as 用户

participant AI as AI智能客服

participant Retriever as 检索器

participant DB as 向量数据库

participant LLM as 大模型 (GPT-4)

User->>AI: 我的洗衣机显示E4错误代码怎么办?

AI->>Retriever: 查询“E4错误代码”相关文档

Retriever->>DB: 向量相似度搜索

DB-->>Retriever: 返回: 排水管堵塞/进水阀故障 (说明书P12)

Retriever-->>AI: 检索到的上下文片段

AI->>LLM: 基于上下文回答用户问题

Note over AI,LLM: System Prompt: 你只基于提供的上下文回答,不要编造。

LLM-->>AI: E4通常表示排水问题。请检查排水管是否弯折...

AI-->>User: 您好,E4代码通常表示排水系统异常...

3.2 核心技术实现:LangChain +向量数据库

代码示例:构建一个简单的RAG客服系统

from langchain.document_loaders import PyPDFLoader

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain.embeddings import OpenAIEmbeddings

from langchain.vectorstores import Chroma

from langchain.chat_models import ChatOpenAI

from langchain.chains import RetrievalQA

# 第一步:加载并处理文档(例如产品说明书)

loader = PyPDFLoader("product_manual.pdf")

documents = loader.load()

# 第二步:文档切片

text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=200)

texts = text_splitter.split_documents(documents)

# 第三步:向量化并存入数据库

embeddings = OpenAIEmbeddings()

db = Chroma.from_documents(texts, embeddings)

# 第四步:初始化大模型

llm = ChatOpenAI(model_name="gpt-3.5-turbo", temperature=0)

# 第五步:构建问答链

qa_chain = RetrievalQA.from_chain_type(

llm=llm,

chain_type="stuff",

retriever=db.as_retriever(search_kwargs={"k": 3}) # 检索前3个最相关的片段

)

# 第六步:模拟用户咨询

query = "洗衣机的烘干功能怎么用?"

result = qa_chain.run(query)

print(f"用户提问: {query}")

print(f"AI回答: {result}")

3.3 服务业Prompt设计:情感与合规并重

服务业的Prompt不仅要准确,还要有温度。

Prompt 示例(客服系统Prompt):

# Role (角色)

你是一位拥有5年经验的金牌售后客服代表,代表【品牌名】与用户沟通。

# Tone (语气)

亲切、耐心、专业、有同理心。避免使用机械的官方辞令。

# Guidelines (指导原则)

1. 首先安抚用户的情绪,感谢用户的反馈。

2. 基于提供的【知识库上下文】解决用户问题。如果上下文中没有答案,请诚实告知并建议转接人工。

3. 回答结构:结论 -> 具体步骤 -> 补充建议。

4. 禁止承诺无法兑现的赔偿或服务。

# Knowledge Context (知识库上下文)

{context}

# User Input (用户输入)

{question}

3.4 数据可视化:服务质量提升

通过引入AI客服,服务业的关键指标发生了显著变化。

[图表描述: 折线图]

- X轴:时间(1月 - 6月)

- 左Y轴:响应时间(秒) - 显示一条急剧下降的蓝线,从平均300秒降至5秒。

- 右Y轴:客户满意度(CSAT) - 显示一条缓慢上升的橙线,从75%升至90%。

- 结论:AI接管了基础问答后,人工客服能专注于处理复杂纠纷,且响应速度大幅提升,直接带动了满意度上升。

第四部分:综合案例与未来展望

4.1 跨界融合案例:AI驱动的本地生活服务营销

场景:一家连锁咖啡店想要在抖音上推广新品,并利用外卖平台的客服系统承接流量。

全链路AI应用:

- 设计端:使用Midjourney生成新品的概念海报,风格为“夏日清凉、多巴胺配色”。

- 视频端:使用Sora或Runway Gen-2生成一段“冰块在咖啡中碰撞、气泡升腾”的5秒循环视频素材。

- 文案端:使用GPT-4撰写“早C晚A”主题的短视频脚本和外卖平台商品详情页描述。

- 服务端:在外卖小程序部署基于RAG的客服机器人,自动回答“新品含糖量”、“是否有优惠券”等高频问题。

4.2 挑战与伦理

尽管AI应用前景广阔,但也面临挑战:

- 版权问题:AI生成的图片和视频版权归属尚不明晰。

- 幻觉风险:在服务业中,AI一本正经地胡说八道可能导致严重商业事故。

- 数据隐私:将企业数据投喂给公有云大模型存在泄露风险。

4.3 未来展望

未来1-3年,AI应用将呈现以下趋势:

- Agent(智能体)化:AI将不再只是“对话”,而是能自主规划任务、调用工具(如:AI不仅设计海报,还能直接登录广告后台下单投放)。

- 多模态融合:输入语音即可生成视频、设计图、代码和客服回复,界限完全模糊。

- 垂直领域小模型:针对法律、医疗、电商等特定领域训练的小模型,成本更低、准确率更高。

结语

AI在短视频、设计和服务业的落地,标志着我们正从“互联网+”迈向“AI+”。企业应用AI的核心不再是有没有模型,而是如何将AI工具嵌入到具体的业务流程中,实现人机协作的新范式。

对于从业者而言,掌握Prompt工程、理解基本的API调用逻辑、以及具备跨媒体的审美能力,将成为核心竞争力。AI不会取代人类,但会使用AI的人将取代不会使用AI的人。

更多推荐

已为社区贡献326条内容

已为社区贡献326条内容

所有评论(0)