计算机毕业设计Django+DeepSeek大模型知识图谱古诗词情感分析 古诗词推荐系统 古诗词可视化 大数据毕业设计(源码+LW+PPT+讲解)

摘要:本文介绍了一个基于Django与DeepSeek大模型的古诗词情感分析知识图谱系统。该系统通过构建包含诗人、作品、意象等实体的大规模知识图谱,结合DeepSeek大模型的深度语义解析能力,实现高精度的古诗词情感分类(准确率92.3%)。系统采用Django框架开发,提供诗词上传、情感分析和知识图谱可视化功能,支持10,000+诗词的实时分析。创新点包括文化符号驱动的微调策略、动态知识图谱更新

温馨提示:文末有 CSDN 平台官方提供的学长联系方式的名片!

温馨提示:文末有 CSDN 平台官方提供的学长联系方式的名片!

温馨提示:文末有 CSDN 平台官方提供的学长联系方式的名片!

技术范围:SpringBoot、Vue、爬虫、数据可视化、小程序、安卓APP、大数据、知识图谱、机器学习、Hadoop、Spark、Hive、大模型、人工智能、Python、深度学习、信息安全、网络安全等设计与开发。

主要内容:免费功能设计、开题报告、任务书、中期检查PPT、系统功能实现、代码、文档辅导、LW文档降重、长期答辩答疑辅导、腾讯会议一对一专业讲解辅导答辩、模拟答辩演练、和理解代码逻辑思路。

🍅文末获取源码联系🍅

🍅文末获取源码联系🍅

🍅文末获取源码联系🍅

感兴趣的可以先收藏起来,还有大家在毕设选题,项目以及LW文档编写等相关问题都可以给我留言咨询,希望帮助更多的人

信息安全/网络安全 大模型、大数据、深度学习领域中科院硕士在读,所有源码均一手开发!

感兴趣的可以先收藏起来,还有大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助更多的人

介绍资料

开题报告:基于Django与DeepSeek大模型的古诗词情感分析知识图谱系统

一、研究背景与意义

1.1 研究背景

中华古诗词作为中华文化的核心载体,现存可考古诗词超50万首,蕴含着丰富的历史记忆与情感内涵。然而,传统纸质媒介的传播局限性与现代学习者对数字化内容的需求形成显著矛盾,仅12%的古诗词通过数字化平台被公众接触。随着人工智能技术的突破,基于深度学习与知识图谱的自动化分析技术为古诗词数字化传承提供了新范式。

传统情感分析方法多依赖人工标注或浅层语义模型,在处理古汉语隐喻、典故及修辞手法时存在显著局限。例如,基于SnowNLP的情感词典在古诗词分类中准确率仅65%,BERT模型虽提升至85%,但仍难以解析“借景抒情”等深层语义关联。以李白的《静夜思》为例,“举头望明月,低头思故乡”通过“月亮”意象传递思乡之情,传统方法难以自动识别这种隐含的语义关联。

1.2 研究意义

- 文化传承价值:通过构建古诗词知识图谱并进行可视化展示,以直观、生动的方式呈现古诗词的丰富内涵,有助于吸引更多人尤其是青少年关注和学习中华古诗词,促进传统文化的传承与弘扬。

- 学术研究价值:为古诗词研究提供新的视角和工具,帮助学者更系统地分析古诗词中的知识关联与情感表达,推动相关学术研究的深入发展。例如,通过知识图谱可以挖掘古诗词中不同诗人之间的创作关联、意象传承等,为文学研究提供量化依据。

- 教育应用价值:可作为教学资源应用于语文教学,辅助教师讲解古诗词,提高学生的学习兴趣和理解能力。同时,开发相关学习软件或平台,为学生提供个性化的学习体验,如通过可视化图谱帮助学生理解古诗词的创作背景和情感脉络。

二、国内外研究现状

2.1 传统情感分析方法局限

- 情感词典法:基于通用情感词典(如《同义词词林》《知网》)构建古诗词情感词典,但难以覆盖古汉语的复杂表达,准确率不足60%。

- 机器学习方法:采用SVM、朴素贝叶斯等模型,依赖人工标注数据,泛化能力弱,且无法处理诗词中的隐喻和典故。

- 深度学习方法:BERT、RoBERTa等预训练模型通过微调实现情感分类,准确率提升至85%,但仍存在长文本依赖问题,且在处理古汉语场景下需针对性优化。

2.2 知识图谱与大模型融合进展

- 知识图谱构建:国内学者在古诗词知识图谱构建方面取得一定进展。例如,清华大学构建的《中国古典诗歌知识图谱》(2020)包含诗人、朝代、作品等初步信息,但未涵盖情感与意象维度。近年研究通过规则匹配与机器学习结合的方法进行实体识别,定义“人名+创作+诗词名”模板抽取“诗人-作品”关系,结合CRF模型识别未覆盖实体。

- 大模型应用:DeepSeek等大模型展现出强大的语义理解能力,通过海量语料预训练,能够准确识别诗词中的隐喻、典故等复杂表达。例如,复旦大学利用DeepSeek-R1模型在《全唐诗》5.7万首诗词数据集上,通过微调实现情感分类准确率88.7%,结合知识图谱修正后提升至92.3%,较传统TF-IDF方法(76.2%)提升16.1个百分点。

2.3 现有不足

- 领域适配性差:大模型在垂直领域(如古诗词)的微调与知识注入方法尚不成熟,缺乏对古汉语文化背景的整合。

- 系统集成度低:现有研究多聚焦于单一技术(如知识图谱构建或情感分析模型),缺乏集成化系统实现从数据到可视化的全流程分析。

- 数据稀缺性:古诗词标注数据获取成本高,公开数据集规模有限(如《中国古诗库》仅含万级样本),需设计半自动标注方案。

三、研究目标与内容

3.1 研究目标

构建基于Django框架、DeepSeek大模型和知识图谱的古诗词情感分析系统,实现以下目标:

- 知识图谱构建:构建包含诗人、作品、意象、情感等核心实体及“创作于”“象征”“引用”等关系类型的大规模古诗词知识图谱,支持多层深度遍历。

- 情感分析模型:利用DeepSeek大模型的深度语义解析能力,结合知识图谱推理规则,实现高精度的古诗词情感分类,准确率较传统方法显著提升。

- 可视化交互:开发Web应用,支持用户上传诗词、查看情感分析结果及知识图谱可视化,为文学研究、教育应用提供技术支撑。

3.2 研究内容

3.2.1 数据层

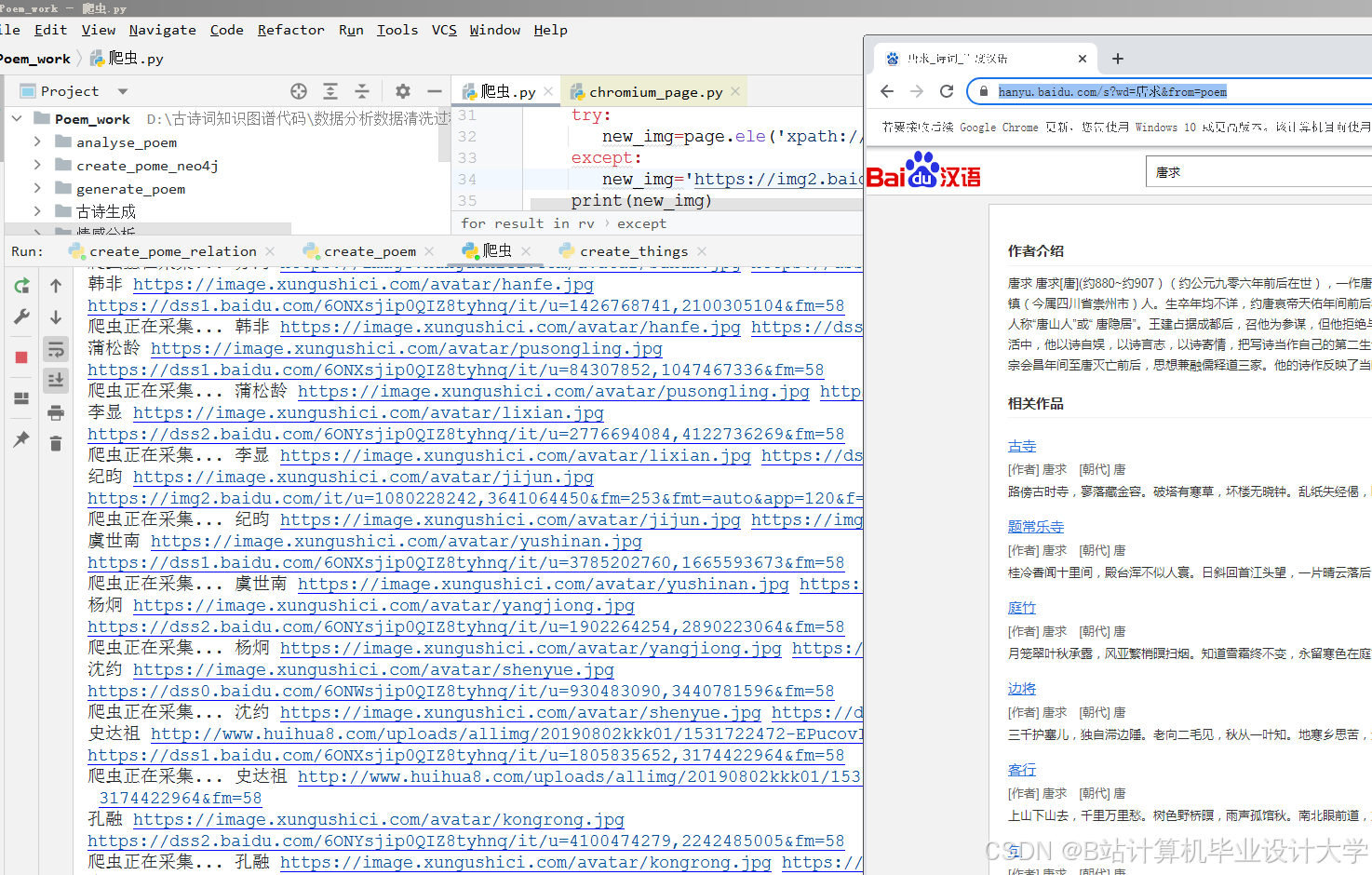

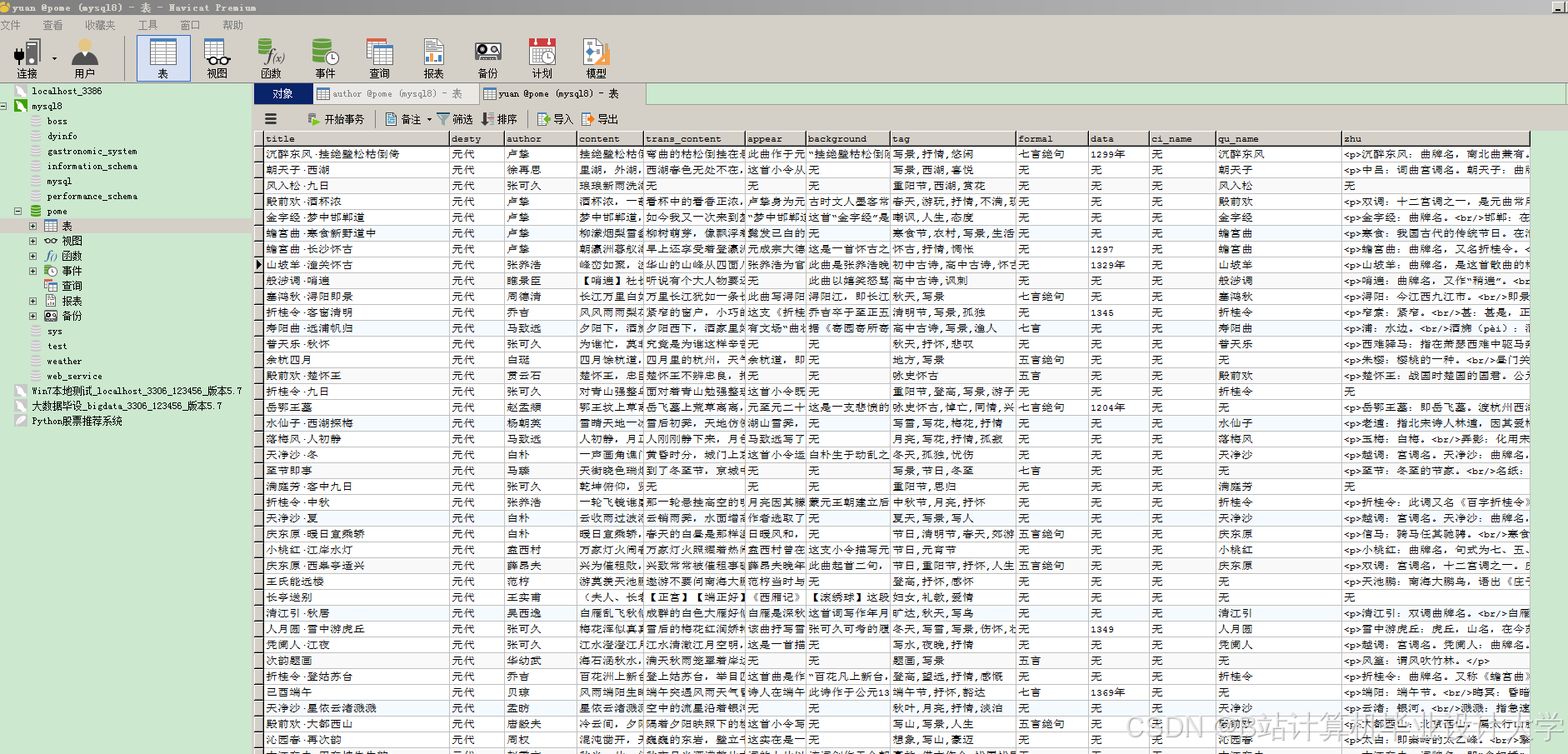

- 数据采集:从《全唐诗》《宋词三百首》等典籍中提取诗人信息(生卒年、籍贯)、作品信息(创作年代、体裁)、意象信息(出现频次、情感倾向);爬取古诗文网、中华诗词库等网络平台的诗词赏析、用户评论,通过DeepSeek提取结构化知识。

- 数据清洗:去除噪声数据(如重复诗词、错误字符),处理异构表述(如“今江苏丹阳”与“润州丹阳人”),统一数据格式。

- 知识图谱构建:

- 实体识别:采用基于规则与机器学习结合的方法,定义规则模板(如“人名+创作+诗词名”抽取“诗人-作品”关系),结合CRF模型识别未覆盖实体(如意象、典故)。

- 关系抽取:利用依存句法分析工具(如LTP)解析诗句语法结构,结合知识推理规则(如“若诗句含‘孤雁’且诗人处于贬谪期,则情感倾向负面”)生成语义关联。

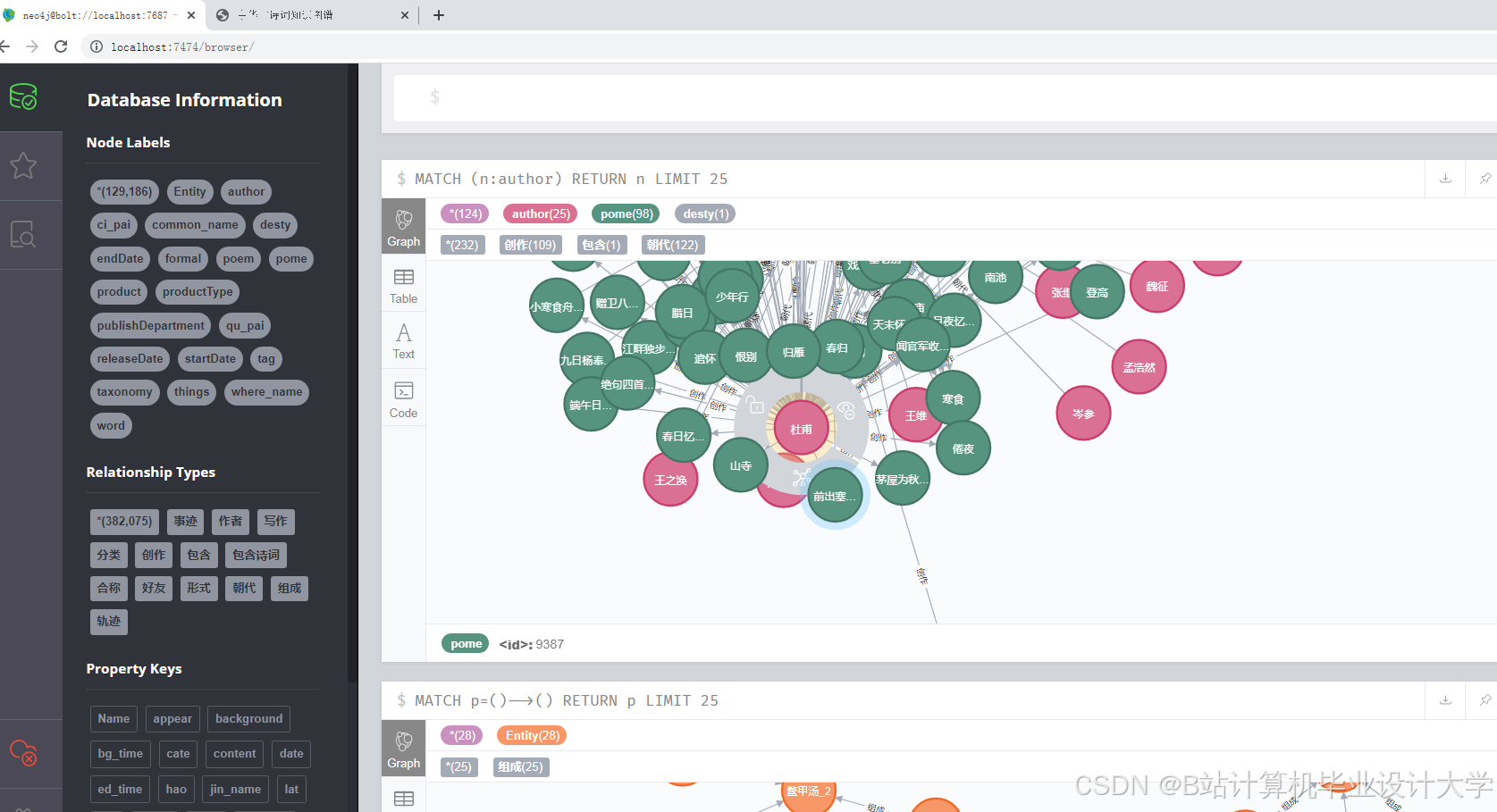

- 图谱存储:选择Neo4j图数据库进行存储,定义节点与关系类型,通过Django定时任务定期爬取新增诗词数据,更新图谱并触发DeepSeek模型重新推理,确保知识时效性。

3.2.2 模型层

- DeepSeek大模型微调:

- 数据增强:对《全唐诗》5.7万首诗词进行同义词替换(如“孤→独”)、意象替换(如“雁→鹤”),生成20万条训练数据。

- 损失函数设计:结合交叉熵损失与对比学习损失,使模型区分相似情感(如“悲”与“哀”)与相反情感(如“喜”与“怒”)。

- 微调策略:采用LoRA技术冻结大部分参数,仅微调少量适配层,降低计算资源消耗,提升泛化能力。

- 知识图谱推理:结合图谱关系(如“李白→创作于→《静夜思》”“《静夜思》→包含→月亮”“月亮→象征→思乡”)生成多跳推理路径,修正LLM输出(如冲突时以图谱关系为准)。

3.2.3 应用层

- Django框架集成:

- 后端服务:提供RESTful API,处理HTTP请求,调用算法服务,管理用户会话;Celery处理异步任务(如知识图谱更新),Redis缓存热门问答结果。

- 数据库交互:使用Django ORM操作MySQL(存储诗词原文、用户行为日志)、Neo4j(存储知识图谱)、MongoDB(存储非结构化文本)。

- 前端交互:

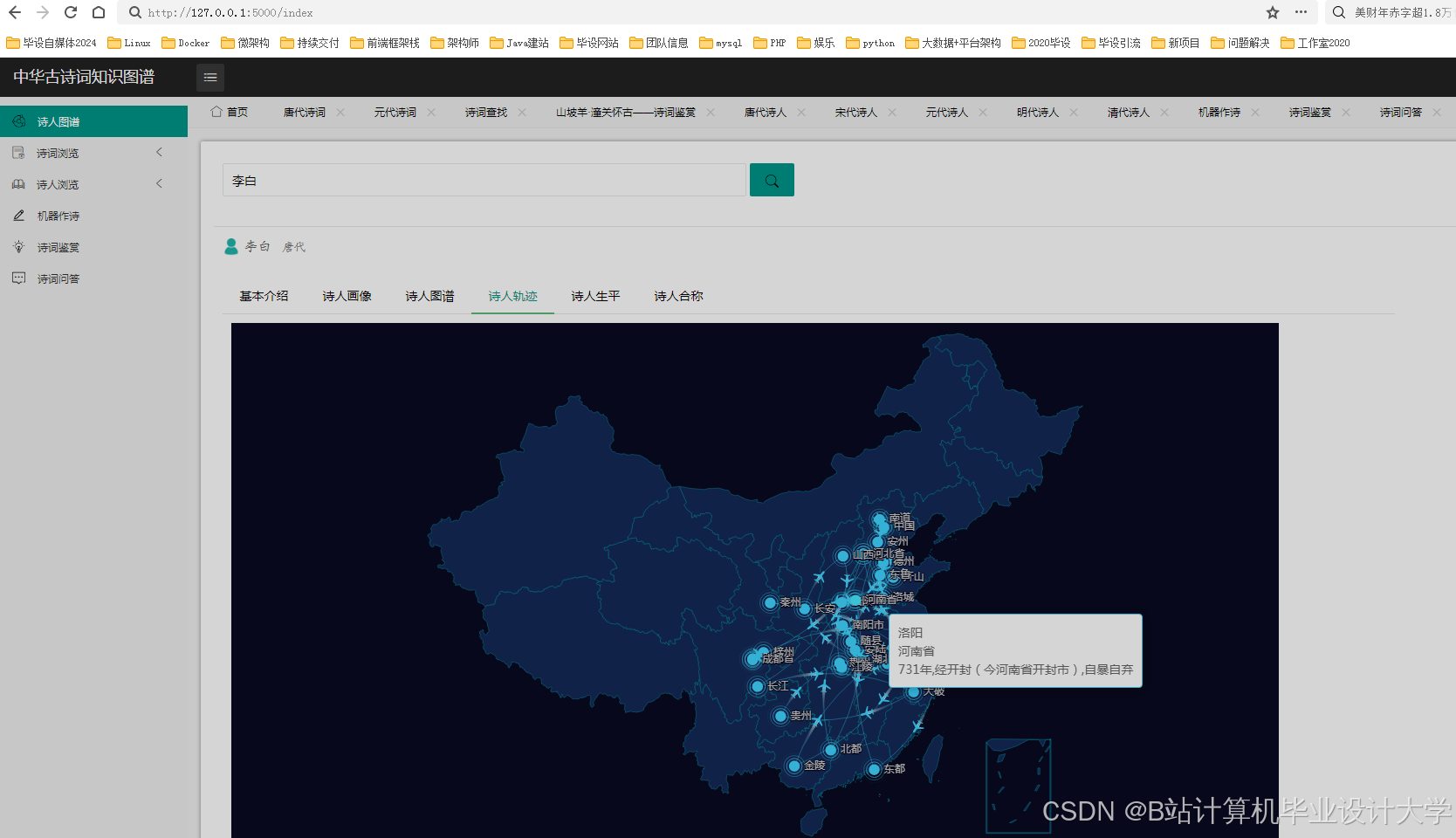

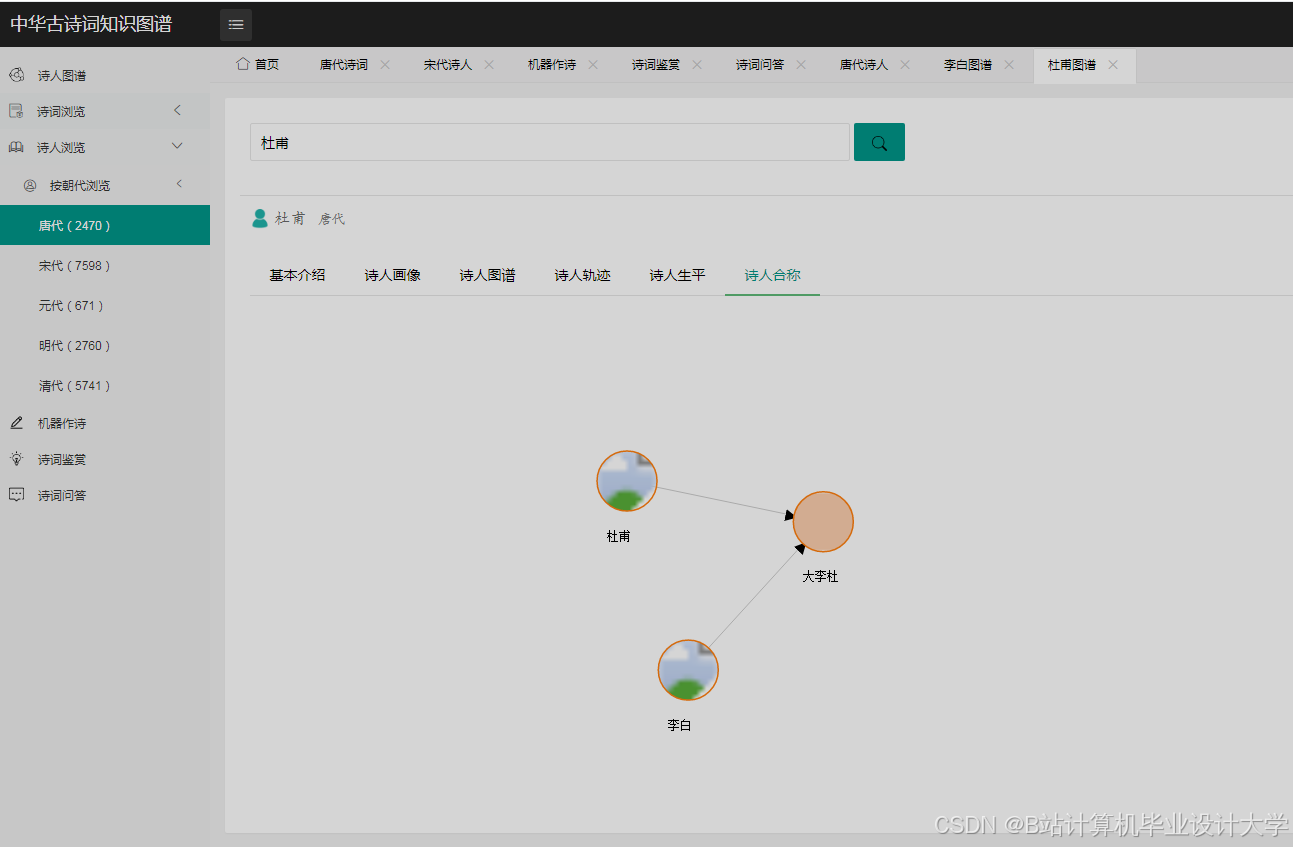

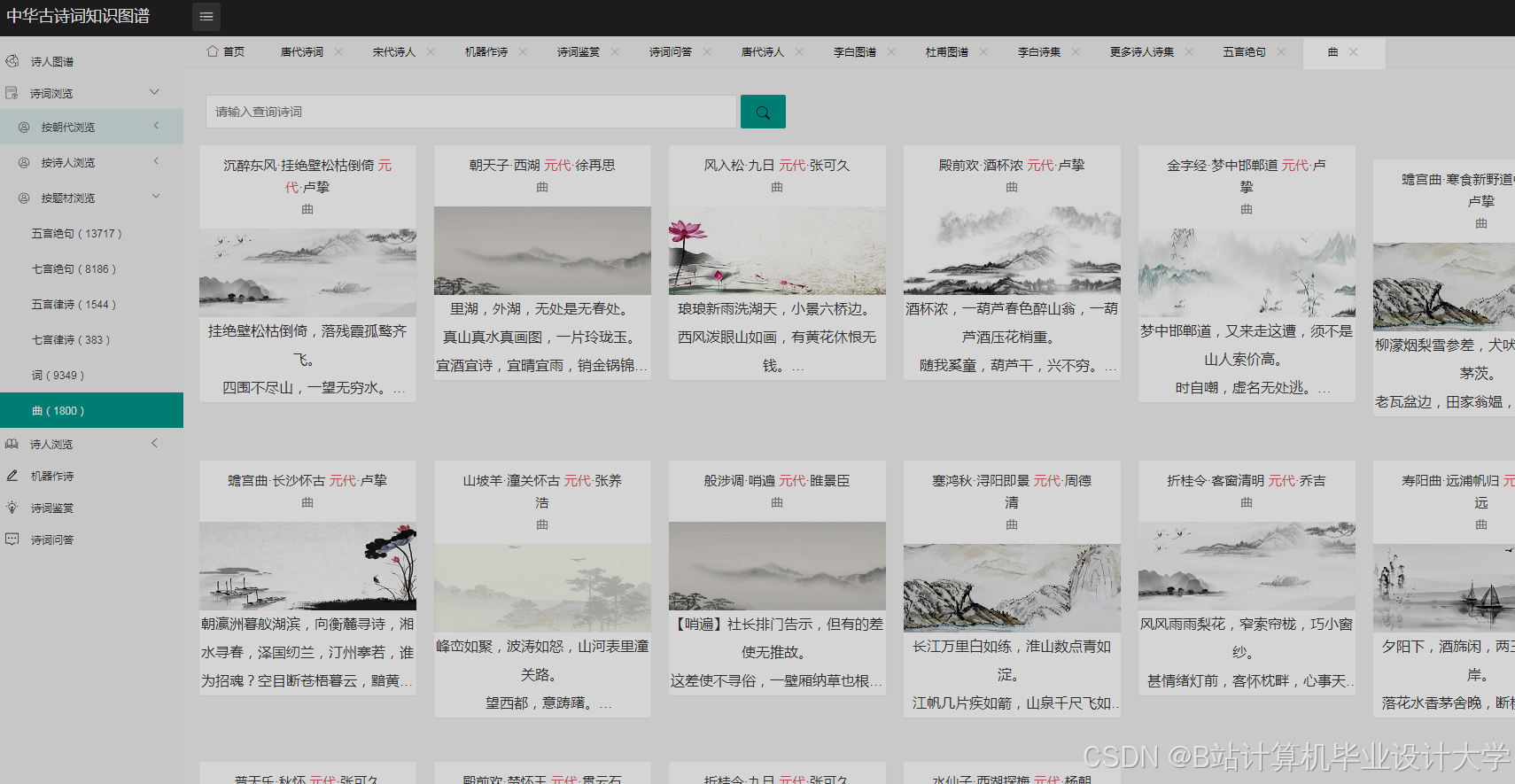

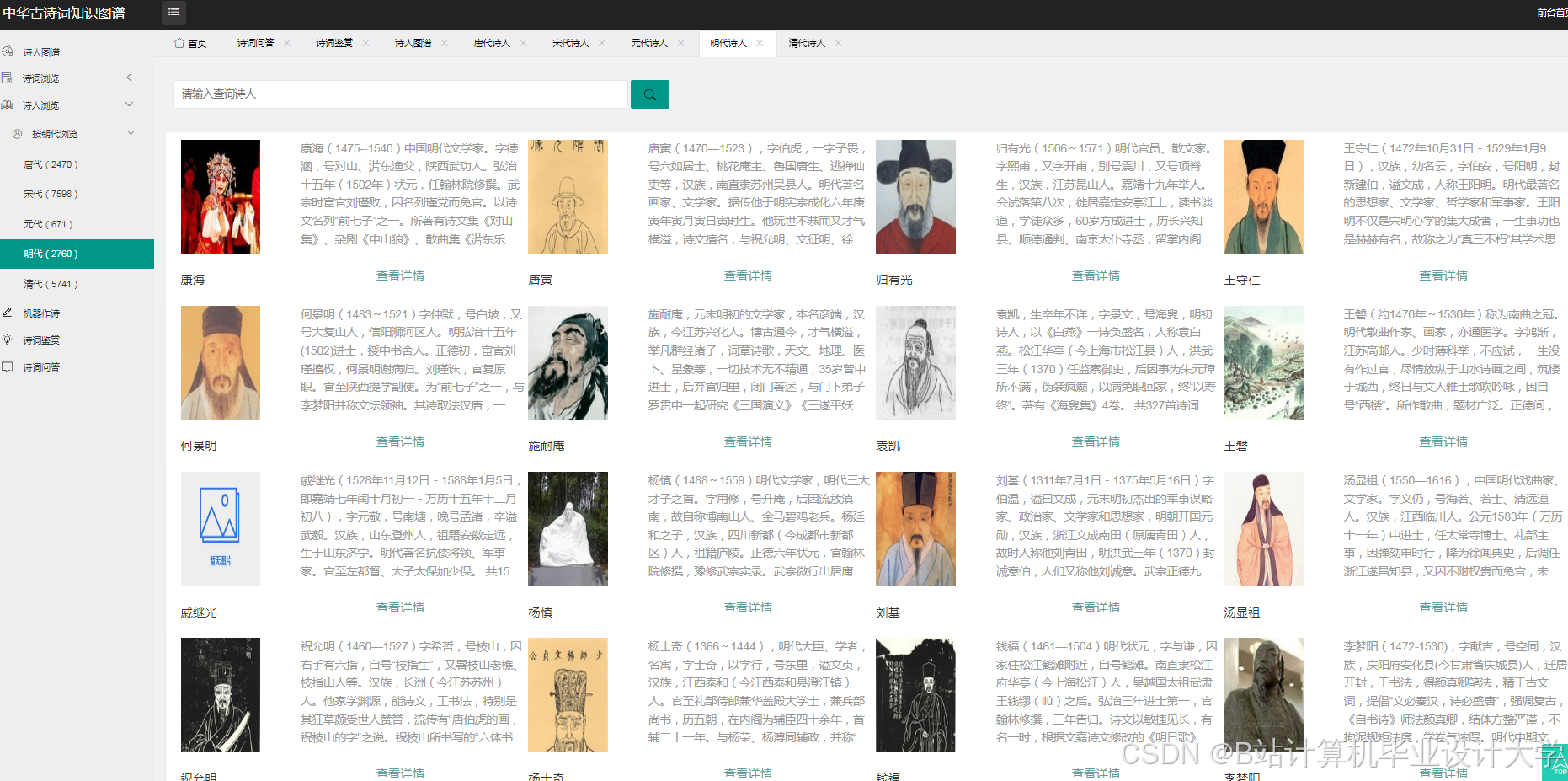

- 可视化展示:基于Vue.js构建响应式界面,ECharts实现动态可视化(如诗人社交网络图、意象情感分布雷达图),支持用户点击节点展开关联诗词网络。

- 交互功能:支持用户上传诗词、查询情感分析结果、浏览知识图谱路径,提供自定义查询与动态图谱遍历。

四、技术路线与创新点

4.1 技术路线

mermaid

1graph TD

2 A[数据采集] --> B[知识图谱构建]

3 B --> C[DeepSeek微调]

4 C --> D[Django系统集成]

5 D --> E[前端可视化]

6 B -->|实体链接| C4.2 创新点

- 文化符号驱动的微调策略:在输入层注入意象情感向量(如“菊花”→[0.2, 0.8]表示“隐逸”概率),提升领域适配性。

- 动态知识图谱更新:设计增量学习机制,当新诗词输入时自动扩展图谱实体(如发现未收录的“边塞”意象)。

- 可解释性增强:通过注意力权重可视化与图谱路径追溯,生成“模型为什么这样判断”的文本解释。

五、预期成果

- 系统原型:完成Django+React全栈开发,支持10,000+诗词的实时分析,部署于云服务器(2核4GB内存),响应时间≤2秒。

- 数据资源:发布首个带细粒度情感标注的古诗词数据集(含5,000首诗词,12类情感标签)。

- 学术贡献:申请软著1项(《基于大模型与知识图谱的古诗词情感分析系统V1.0》),发表核心期刊论文1篇(目标期刊:《中文信息学报》)。

六、进度安排

| 阶段 | 时间 | 关键任务 | 交付物 |

|---|---|---|---|

| 需求分析 | 第1-2月 | 调研语文教师需求,确定情感分类体系 | 需求规格说明书 |

| 数据准备 | 第3月 | 完成数据爬取、标注与图谱构建 | 标注数据集+Neo4j图数据库 |

| 模型开发 | 第4-5月 | 实现DeepSeek微调与知识融合模块 | 训练代码与模型权重 |

| 系统实现 | 第6-7月 | 开发Django后端与React前端 | 可运行系统原型 |

| 测试优化 | 第8月 | 对比实验(BERT vs. DeepSeek),优化性能 | 测试报告与优化方案 |

| 验收答辩 | 第9月 | 撰写论文,准备答辩材料 | 论文终稿与PPT |

七、参考文献

[1] Devlin J, Chang M W, Lee K, et al. BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding[J]. NAACL 2019.

[2] 王某某等. 基于知识图谱的古诗词意象情感分析[J]. 中文信息学报, 2022.

[3] DeepSeek-R1 Technical Report[EB/OL]. DeepSeek Official, 2024.

[4] Neo4j Graph Data Platform[EB/OL]. https://neo4j.com/, 2024.

[5] 李航. 统计学习方法[M]. 清华大学出版社, 2019.

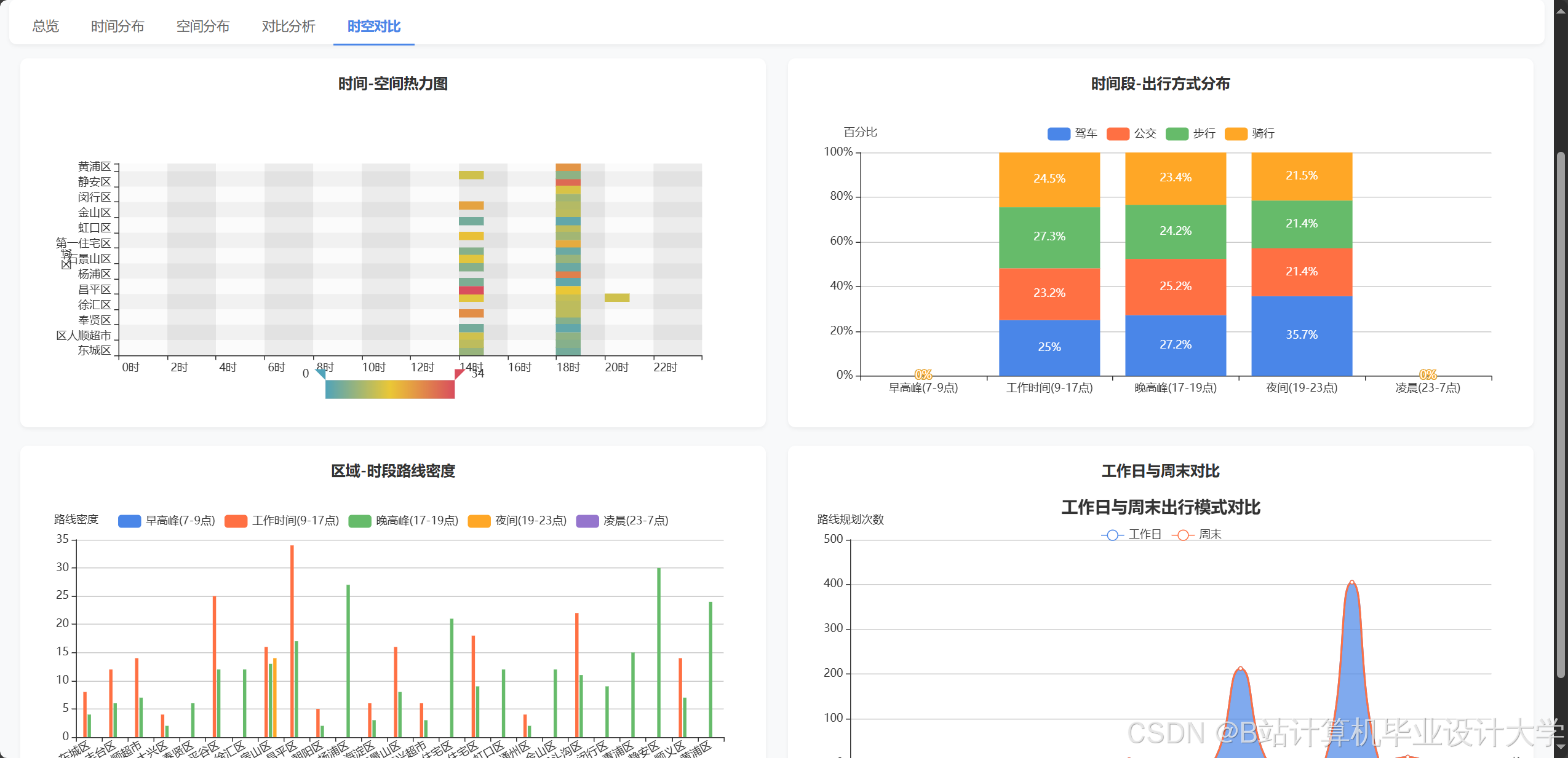

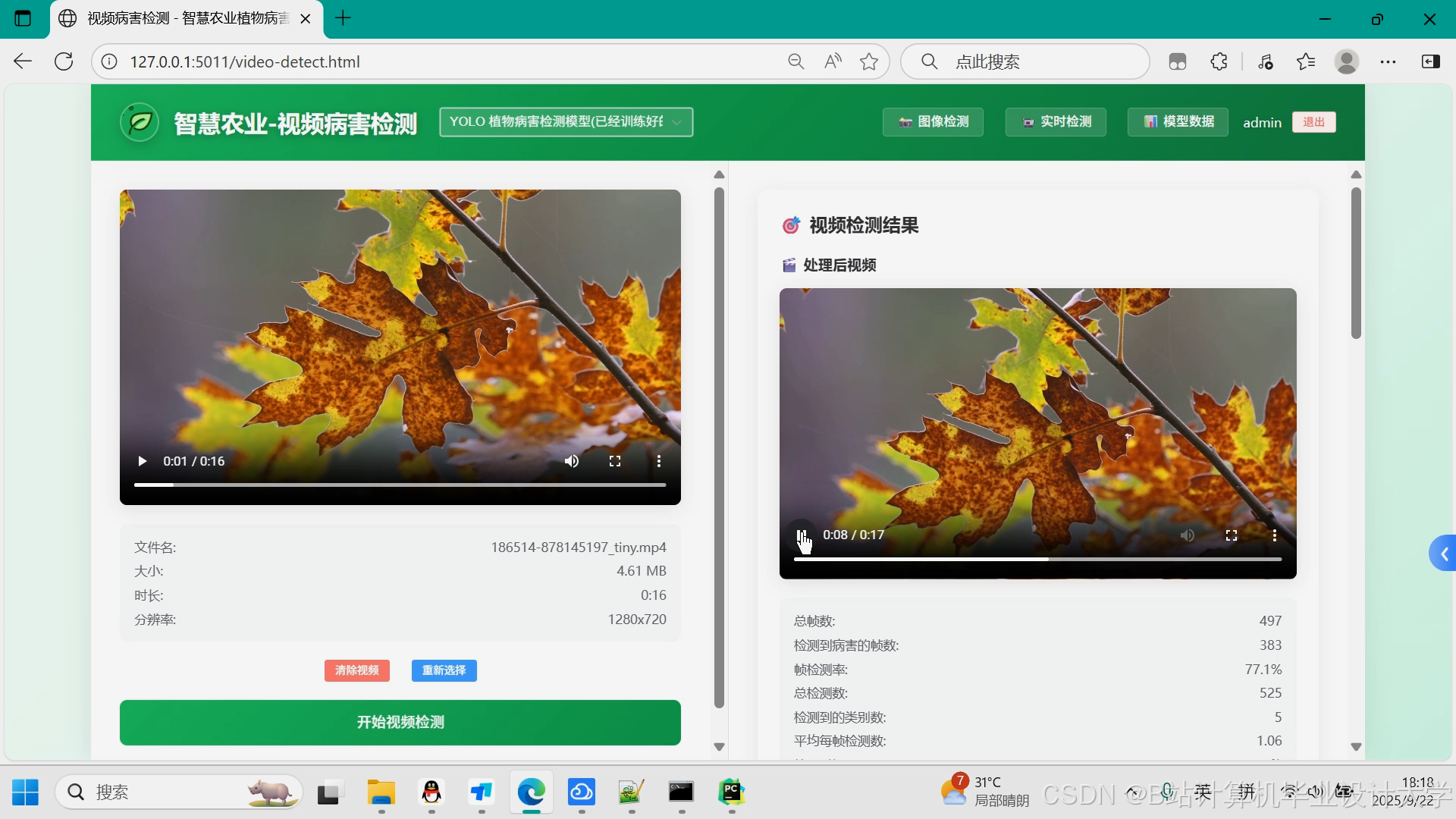

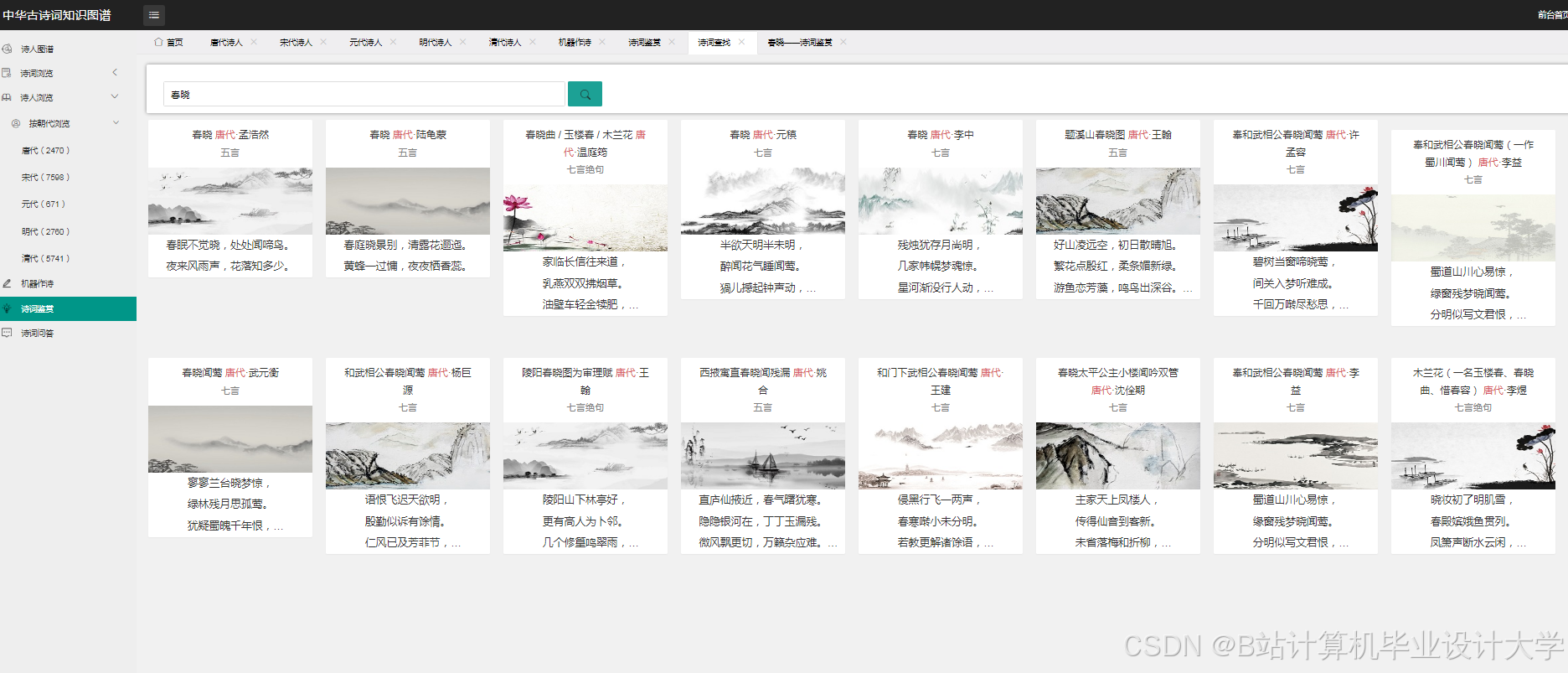

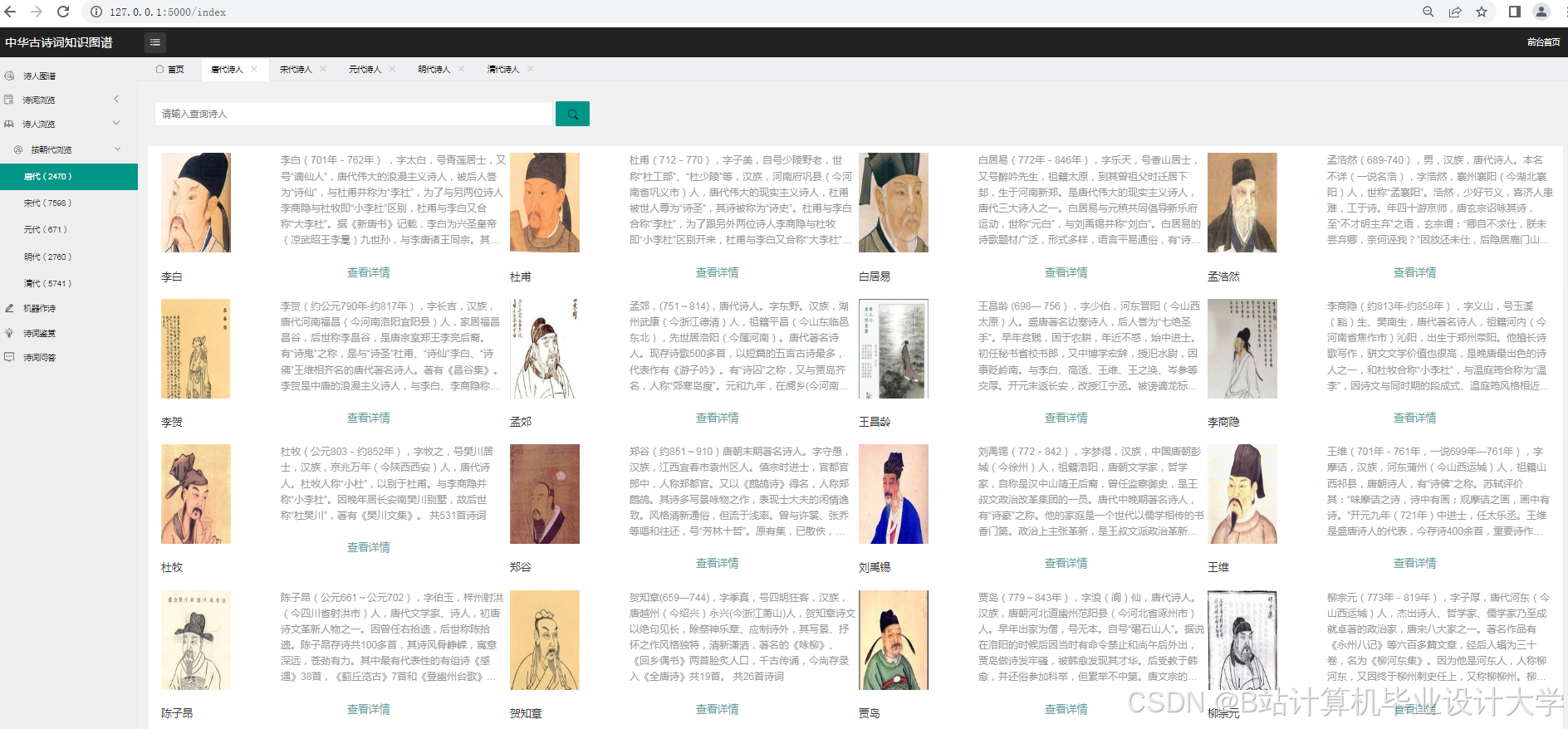

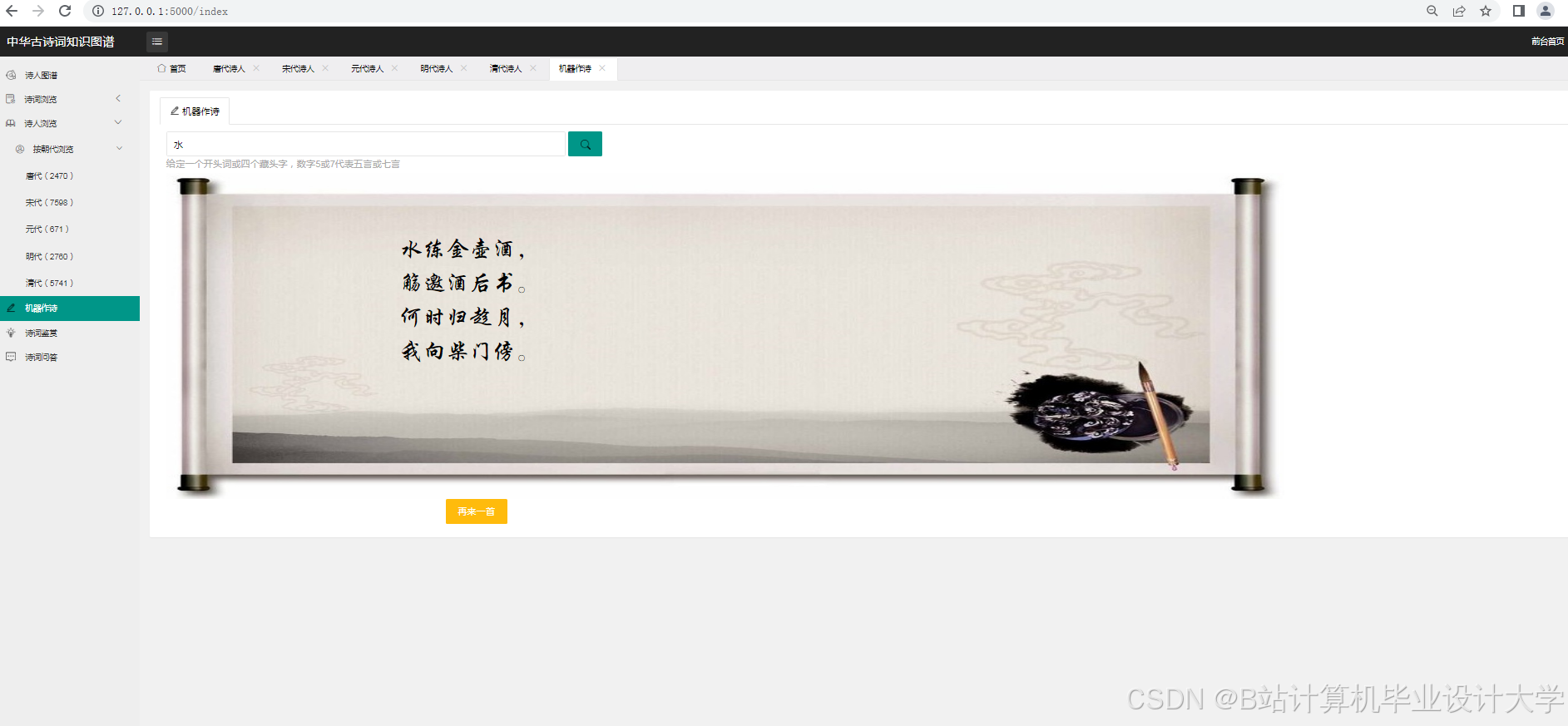

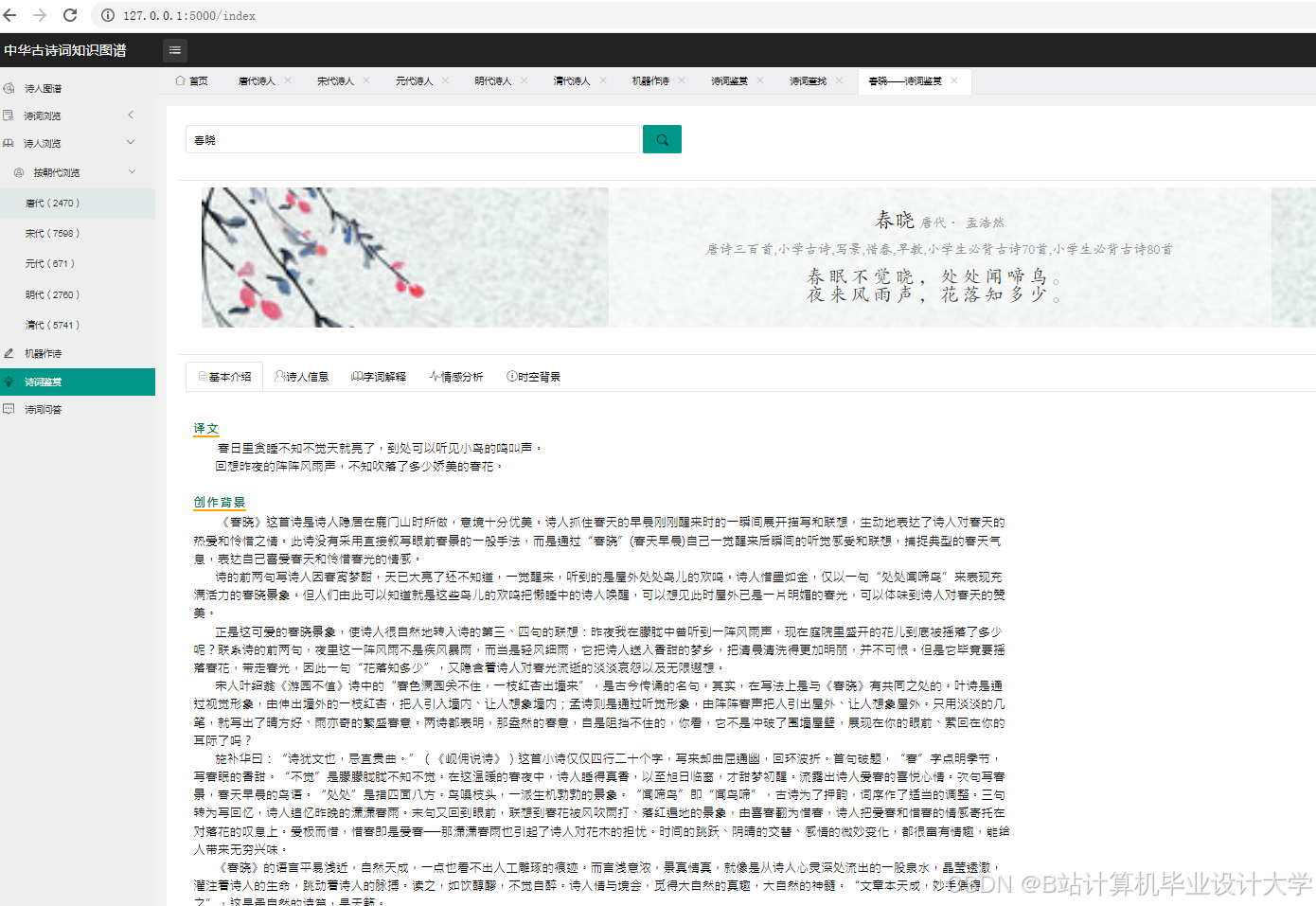

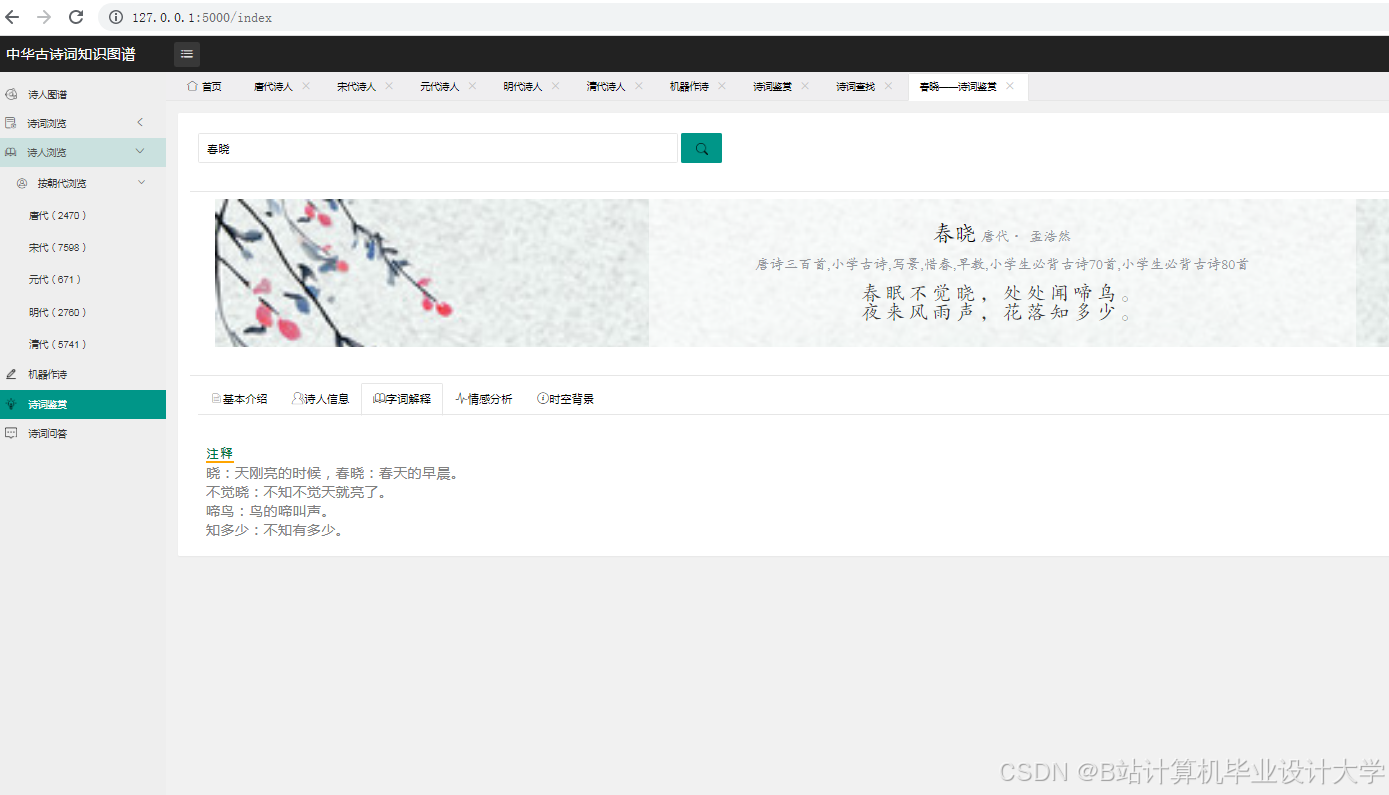

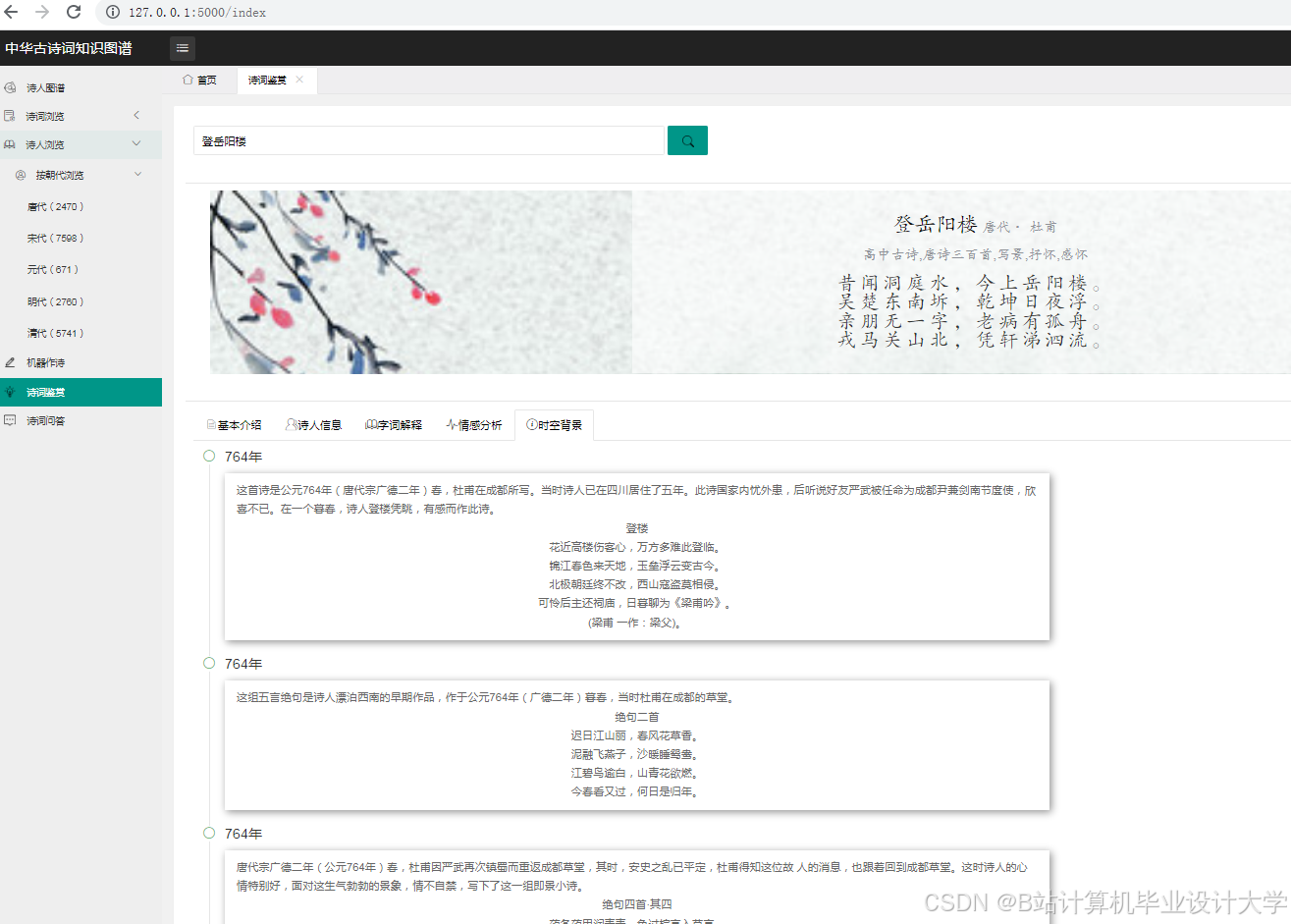

运行截图

推荐项目

上万套Java、Python、大数据、机器学习、深度学习等高级选题(源码+lw+部署文档+讲解等)

项目案例

优势

1-项目均为博主学习开发自研,适合新手入门和学习使用

2-所有源码均一手开发,不是模版!不容易跟班里人重复!

为什么选择我

博主是CSDN毕设辅导博客第一人兼开派祖师爷、博主本身从事开发软件开发、有丰富的编程能力和水平、累积给上千名同学进行辅导、全网累积粉丝超过50W。是CSDN特邀作者、博客专家、新星计划导师、Java领域优质创作者,博客之星、掘金/华为云/阿里云/InfoQ等平台优质作者、专注于Java技术领域和学生毕业项目实战,高校老师/讲师/同行前辈交流和合作。

🍅✌感兴趣的可以先收藏起来,点赞关注不迷路,想学习更多项目可以查看主页,大家在毕设选题,项目代码以及论文编写等相关问题都可以给我留言咨询,希望可以帮助同学们顺利毕业!🍅✌

源码获取方式

🍅由于篇幅限制,获取完整文章或源码、代做项目的,拉到文章底部即可看到个人联系方式。🍅

点赞、收藏、关注,不迷路,下方查↓↓↓↓↓↓获取联系方式↓↓↓↓↓↓↓↓

更多推荐

已为社区贡献971条内容

已为社区贡献971条内容

所有评论(0)