【AI大模型前沿】Z-Image:阿里通义的图像生成魔法棒,低资源设备也能玩转高清图像

Z-Image是一个具有60亿参数的高效图像生成基础模型,通过系统优化,在照片级真实感图像生成和中英双语文本渲染方面表现出色,其性能可与顶级商业模型相媲美。它包含三个主要变体:Z-Image-Turbo、Z-Image-Base和Z-Image-Edit,分别专注于快速推理、基础开发和图像编辑。

系列篇章💥

目录

前言

在AI图像生成领域,随着技术的不断进步,人们对生成图像的质量、速度以及模型的灵活性提出了更高的要求。Z-Image作为阿里通义推出的高效图像生成模型,凭借其创新的技术架构和强大的功能,正在改变人们对AI图像生成的认知。

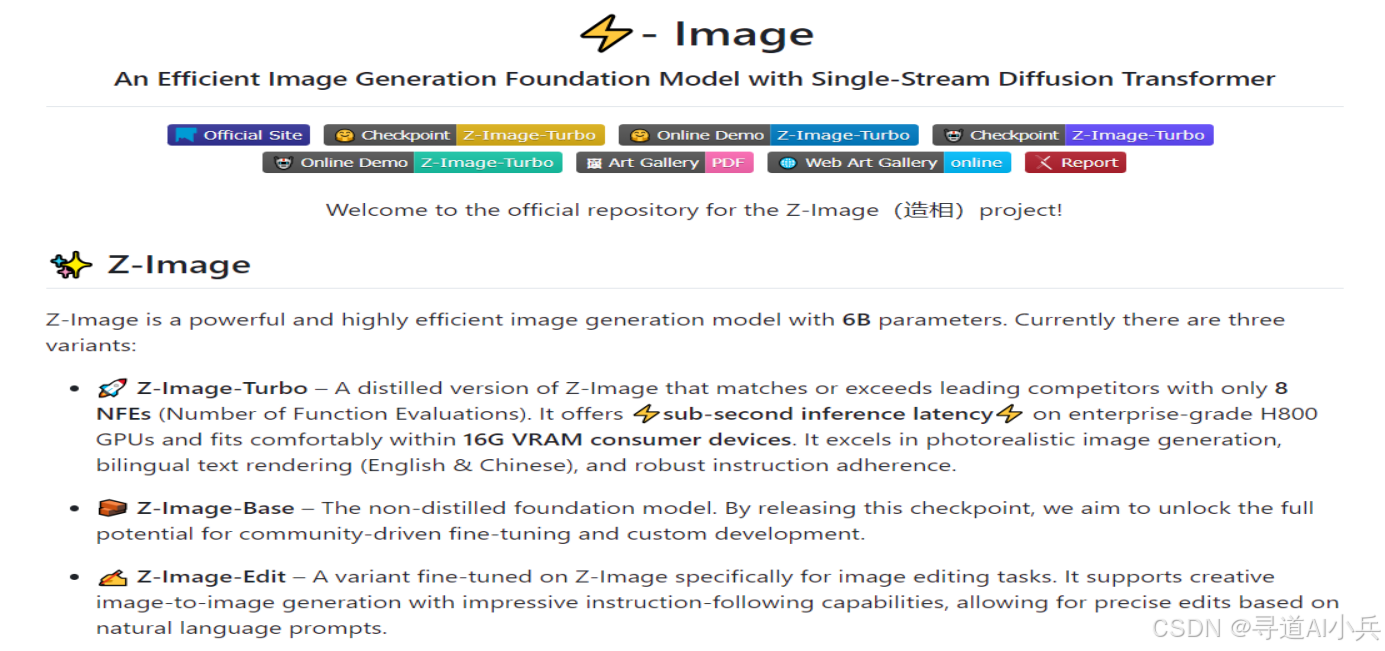

一、项目概述

Z-Image是一个具有60亿参数的高效图像生成基础模型,通过系统优化,在照片级真实感图像生成和中英双语文本渲染方面表现出色,其性能可与顶级商业模型相媲美。它包含三个主要变体:Z-Image-Turbo、Z-Image-Base和Z-Image-Edit,分别专注于快速推理、基础开发和图像编辑。

二、核心功能

(一)高效图像生成

Z-Image能够快速生成高质量的逼真图像,适合创意设计、艺术创作和虚拟内容生成等多种场景。其Z-Image-Turbo版本仅需8步推理即可生成与大型模型媲美的图像,推理速度极快,能在消费级GPU上流畅运行。

(二)双语文本渲染

支持中英文文本渲染,能够准确生成包含复杂文字内容的图像,适用于多语言环境下的图像生成任务。Z-Image-Turbo在小字号等高难度场景下也能高质量渲染文字,效果媲美顶尖闭源模型。

(三)创意图像编辑

通过Z-Image-Edit变体,用户可以根据自然语言指令对图像进行精确编辑,实现创意变换和风格调整。它支持从局部修改到全局风格变换的多种任务,保持高度编辑一致性。

(四)低资源适配

Z-Image-Turbo版本优化了推理效率,可在低资源设备(如16GB显存的消费级GPU)上快速运行,降低了AI图像生成的硬件门槛,适合企业级和消费级应用场景。

(五)社区驱动开发

提供基础模型(Z-Image-Base),便于开发者进行微调和自定义开发,满足多样化需求。这种开放性设计有助于推动社区创新和模型的广泛应用。

三、技术揭秘

(一)单流扩散变换器架构(S3-DiT)

Z-Image采用单流扩散变换器架构(S3-DiT),将文本、视觉语义标记和图像VAE标记在序列级别连接,形成统一输入流。相比双流方法,这种架构显著提高了参数效率,降低了计算成本,使模型在图像生成任务中更加高效。

(二)解耦DMD(分布匹配蒸馏)

解耦DMD技术将CFG增强(CA)和分布匹配(DM)机制分离并优化。CA作为主要驱动力,DM作为稳定器,两者协同提升少数步骤生成的性能。通过这种优化,Z-Image在极短时间内即可生成高质量图像。

(三)DMDR(DMD + 强化学习)

DMDR结合强化学习(RL)和分布匹配蒸馏(DMD),进一步提升语义对齐、美学质量和结构连贯性。这种融合技术使Z-Image生成的图像不仅质量更高,还具备更强的语义理解和逻辑推理能力。

(四)优化推理性能

Z-Image支持Flash Attention和模型编译等技术,进一步加速推理过程。通过这些优化,模型在低资源设备上也能快速运行,显著降低了延迟,提高了实际应用中的效率。

(五)多语言理解与生成

通过多模态预训练和微调,Z-Image能够理解并生成包含中英文的图像内容。这种多语言能力使其在跨语言图像生成任务中表现出色,支持全球范围内的多样化应用。

四、应用场景

(一)艺术画廊

艺术家利用Z-Image能够快速生成独特的艺术作品,探索不同风格和主题。无论是超现实主义的梦幻场景还是写实主义的精细作品,Z-Image都能精准呈现,为艺术创作提供无限灵感,帮助艺术家突破传统创作的局限,高效实现创意。

(二)广告素材生成

在广告领域,Z-Image可快速生成高质量的广告图片,用于社交媒体、海报、横幅等。它能根据品牌需求和文案描述生成精准匹配的视觉内容,支持多语言文本渲染,满足全球市场广告素材的多样化需求,大幅缩短广告制作周期。

(三)影视特效

影视制作中,Z-Image能够生成虚拟场景、角色或特效元素,辅助影视特效制作。它可以快速生成逼真的外星生物、未来城市景观或奇幻魔法效果,为影视创作者提供强大的视觉支持,降低特效制作成本,缩短制作周期。

(四)游戏开发

对于游戏开发,Z-Image可以快速生成游戏中的角色、场景和道具,加速游戏开发流程。它支持创意编辑和风格变换,能够根据游戏设定生成风格一致的视觉元素,帮助开发者快速构建游戏世界,提升开发效率。

(五)教学素材

在教育领域,Z-Image可生成与教学内容相关的图像,如历史场景、科学现象等,增强教学效果。它能根据教学需求生成精准的视觉素材,帮助学生更直观地理解抽象概念,为教学提供生动的辅助工具。

五、快速使用

(一)基础图像生成

以下是使用Z-Image-Turbo进行基础图像生成的代码示例:

import torch

from diffusers import ZImagePipeline

# 1. 加载模型

pipe = ZImagePipeline.from_pretrained(

"Tongyi-MAI/Z-Image-Turbo",

torch_dtype=torch.bfloat16,

low_cpu_mem_usage=False,

)

pipe.to("cuda")

# 2. 设置提示词

prompt = "Young Chinese woman in red Hanfu, intricate embroidery. Impeccable makeup, red floral forehead pattern. Elaborate high bun, golden phoenix headdress, red flowers, beads. Holds round folding fan with lady, trees, bird. Neon lightning-bolt lamp (⚡️), bright yellow glow, above extended left palm. Soft-lit outdoor night background, silhouetted tiered pagoda (西安大雁塔), blurred colorful distant lights."

# 3. 生成图像

image = pipe(

prompt=prompt,

height=1024,

width=1024,

num_inference_steps=9,

guidance_scale=0.0,

generator=torch.Generator("cuda").manual_seed(42),

).images[0]

# 4. 保存结果

image.save("z_image_example.png")

(二)启用Flash Attention

如果你的GPU支持Flash Attention,可以启用以获得更好的效率:

pipe.transformer.set_attention_backend("flash") # 启用Flash Attention 2

# 或者启用Flash Attention 3(如果支持)

# pipe.transformer.set_attention_backend("_flash_3")

(三)模型编译加速

使用PyTorch编译可以进一步加速推理:

pipe.transformer.compile()

(四)CPU卸载(低显存设备)

如果你的显存有限,可以启用CPU卸载:

pipe.enable_model_cpu_offload()

六、结语

Z-Image以其高效、低资源消耗和强大的图像生成能力,为AI图像生成领域带来了新的可能性。它不仅在技术上取得了突破,更通过开源和社区驱动的方式,为开发者提供了广阔的创新空间。我们期待Z-Image能够在更多领域发挥其价值,推动AI图像生成技术的发展。

七、项目地址

- 项目官网:https://tongyi-mai.github.io/Z-Image-blog/

- GitHub仓库:https://github.com/Tongyi-MAI/Z-Image

- Hugging Face模型库:https://huggingface.co/Tongyi-MAI/Z-Image-Turbo

🎯🔖更多专栏系列文章:AI大模型提示工程完全指南、AI大模型探索之路(零基础入门)、AI大模型预训练微调进阶、AI大模型开源精选实践、AI大模型RAG应用探索实践🔥🔥🔥 其他专栏可以查看博客主页📑

😎 作者介绍:资深程序老猿,从业10年+、互联网系统架构师,目前专注于AIGC的探索(CSDN博客之星|AIGC领域优质创作者)

📖专属社群:欢迎关注【小兵的AI视界】公众号或扫描下方👇二维码,回复‘入群’ 即刻上车,获取邀请链接。

💘领取三大专属福利:1️⃣免费赠送AI+编程📚500本,2️⃣AI技术教程副业资料1套,3️⃣DeepSeek资料教程1套🔥(限前500人)

如果文章内容对您有所触动,别忘了点赞、⭐关注,收藏!加入我们,一起携手同行AI的探索之旅,开启智能时代的大门!

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)