【值得收藏】ToPG:基于命题图谱导航的RAG方法,实现粒度与结构的完美平衡

ToPG提出了一种创新的命题级RAG解决方案,通过构建"实体-命题-段落"异构图实现了三种智能搜索模式:Naive(单跳事实)、Local(多跳推理)和Global(抽象/综述)。该方法采用查询感知游走技术,解决了传统RAG在粒度与结构上的权衡难题。实验表明,ToPG在复杂场景下F1值提升11%以上,相比GraphRAG节省30%以上的token消耗,同时在单跳、多跳和抽象问答

ToPG提出命题级RAG解决方案,构建"实体-命题-段落"异构图,实现三种搜索模式:Naive(单跳事实)、Local(多跳推理)和Global(抽象/综述)。该方法通过查询感知游走,解决了传统RAG粒度与结构不可兼得的痛点。实验证明,在复杂场景下F1提升11+,比GraphRAG节省30%+ token消耗,实现了单跳、多跳和抽象问答三方面的SOTA级表现。

https://github.com/idiap/ToPGhttps://arxiv.org/pdf/2601.04859A Navigational Approach for Comprehensive RAG via Traversal over Proposition Graphs

一、RAG 的三座“大山”

| 传统 RAG 方案 | 擅长 | 不擅长 |

|---|---|---|

| Chunk-RAG (整块召回) | 简单事实问答 | 多跳、跨段落推理 |

| Iterative-RAG (链式思考) | 局部多跳 | 缺乏全局视野,易走偏 |

| KG-RAG (三元组图谱) | 复杂推理 | 单跳事实精度低,三元组信息压缩严重 |

一句话痛点:粒度 vs. 结构不可兼得——要么信息太粗,要么结构太硬。

二、ToPG 把“粒度”和“结构”同时做软

2.1 核心思想

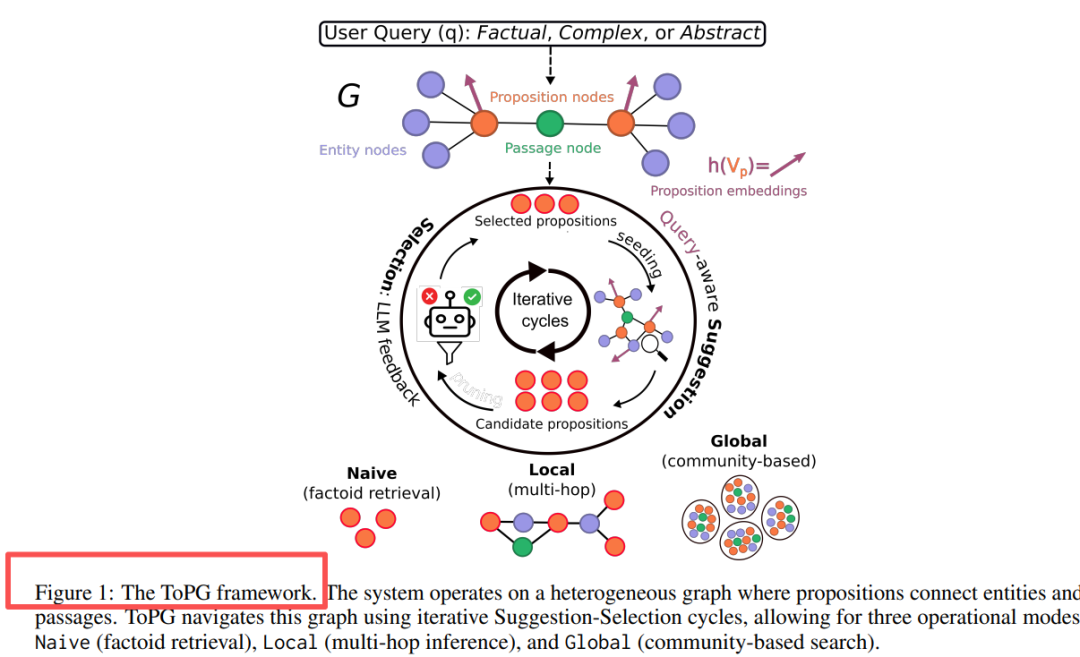

图 1 一张图看懂 ToPG 框架

异构图:命题节点(蓝色)既连实体(橙色)也连段落(绿色),实现“细粒度+高连通”

用命题(proposition)作为最小知识单元,把“实体-命题-段落”拼成一张异构图,再让 LLM 以“建议-选择(Suggestion-Selection)”的方式边导航边反馈,实现三种搜索模式:

| 模式 | 场景 | 导航策略 |

|---|---|---|

| Naive | 单跳事实 | 纯向量召回命题,不用图 |

| Local | 多跳推理 | 迭代 Suggestion-Selection,LLM 每轮筛掉噪音 |

| Global | 抽象/综述 | 多起点并行游走 → 社区检测 → 分面生成答案 |

2.2 关键技术细节

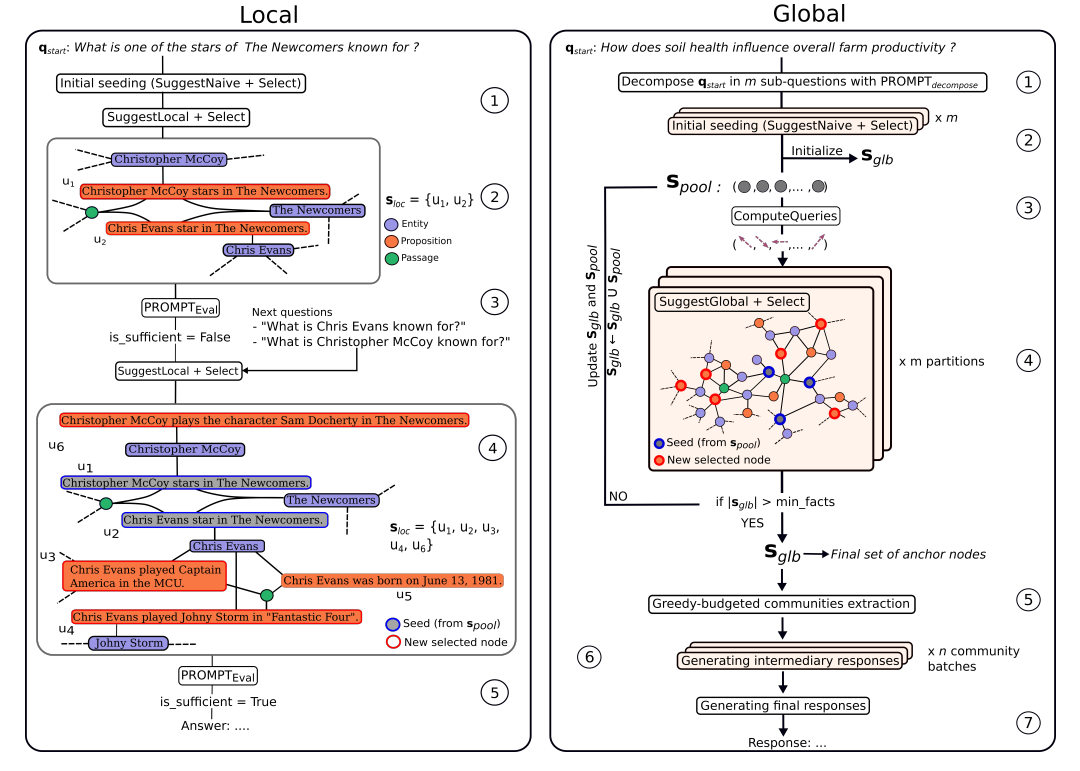

图 2 分步骤示例:Local 模式如何 2 跳找到“Gloria in D 大调作曲家出生地的著名桥梁”

Global 模式:多起点并行游走 → 社区检测 → 综述答案

| 模块 | 做法 | 公式/参数 |

|---|---|---|

| 图谱构建 | LLM few-shot 抽取实体→命题;同义词用 embedding 合并 | cosine ≥ 0.4 |

| Query-Aware PPR | 转移矩阵 M = λ·结构 + (1-λ)·语义相似度 | λ = 0.5(实验最佳) |

| Local 迭代 | 每轮 LLM 判断“信息够了吗?”不够就自动生成子问题继续走 | max-iter = 3 |

| Global 社区 | 收集 600 个锚点 → Leiden 算法分社区 → 每社区生成中间答案 → 排序合并 | budget = 8 k 节点 |

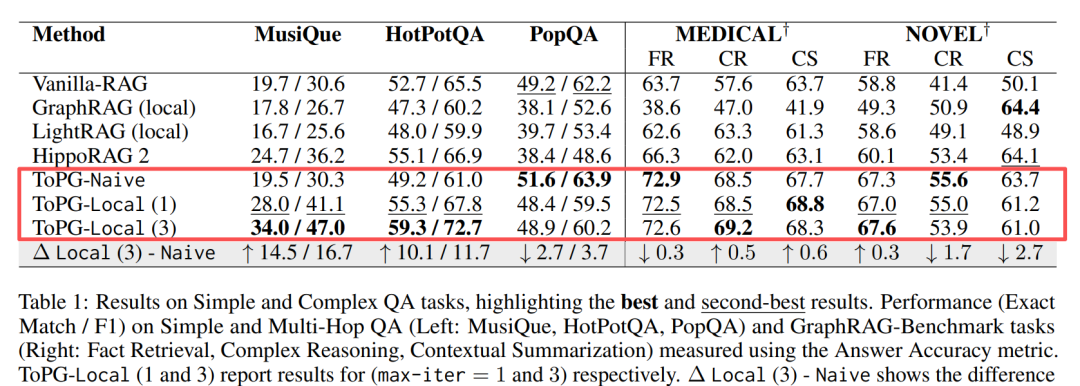

三、结论:一张表看懂涨点

单跳场景 Naive 模式已足够,Local 反而增加 token 成本;但在复杂场景,3 轮迭代即可把 F1 拉涨 11+

抽象问答(LLM-as-a-Judge)

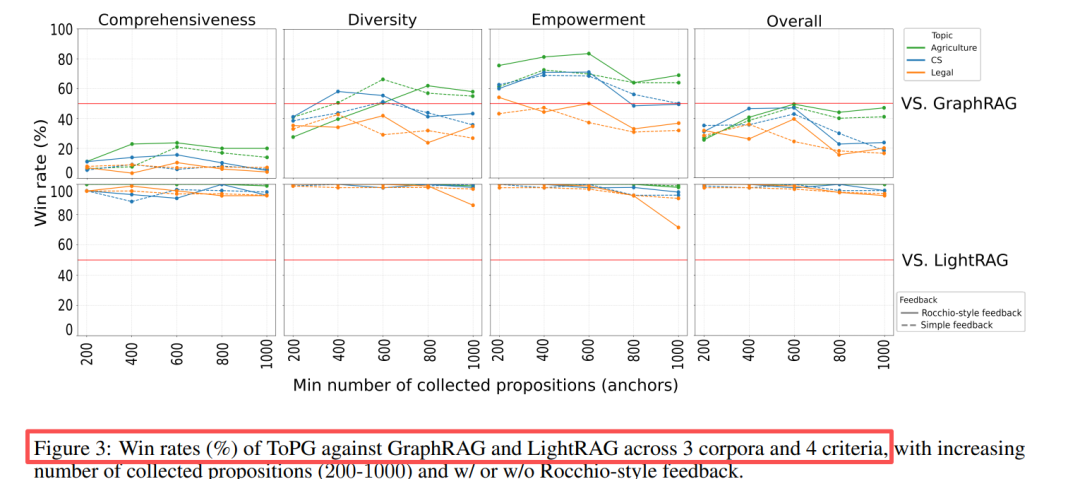

图 3 胜率热力图:600 个锚点后收益饱和

| 维度 | Agriculture | CS | Legal |

|---|---|---|---|

| Comprehensiveness | 与 GraphRAG 持平 | 持平 | 略负 |

| Diversity & Empowerment | 显著优于 GraphRAG & LightRAG | 同上 | 同上 |

成本视角

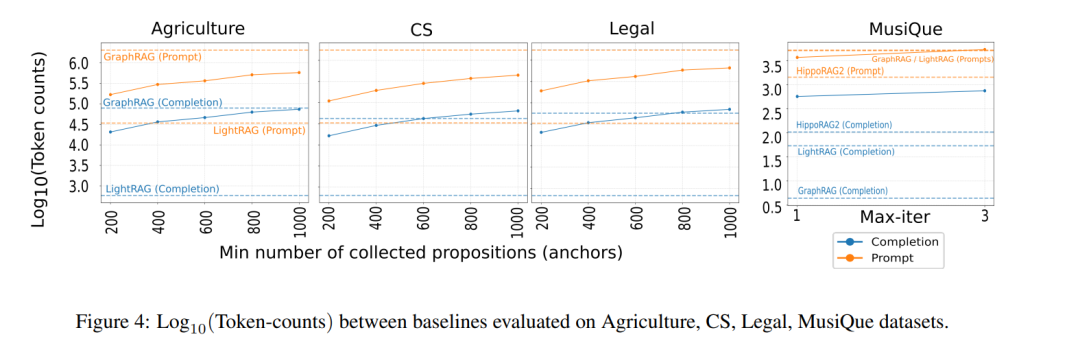

图 4 Token 成本对比

| 方法 | 每抽象查询 token 消耗 | 备注 |

|---|---|---|

| LightRAG | 最低 | 关键词扩展,答案深度不足 |

| ToPG-Global | 中等(<600 锚点) | 比 GraphRAG 省 30%+ 生成 token |

| GraphRAG | 最高 | 预生成社区摘要,输入膨胀 |

四、一句话总结

ToPG 用“命题级粒度+查询感知游走”证明:把图谱做软、把导航做活,就能在单跳、多跳、抽象问答三条赛道都拿到 SOTA 级成绩。

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习和面试资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献733条内容

已为社区贡献733条内容

所有评论(0)