BDD100K数据集介绍

BAIR的计算机视觉研究者有兴趣探索自动驾驶感知算法的前沿,以使其更加安全,为了设计和测试潜在的算法,研究者想利用真实驾驶平台收集数据中的所有信息。因此,在Nexar的帮助下,BAIR将发布BDD100K的数据库,这是目前用于计算机视觉研究的最大、最多样化的开放驾驶视频数据集。数据集涵盖了不同的天气条件,包括晴天、阴天和雨天,以及白天和晚上的不同时间。数据集中的GT框标签共有10个类别,分别为:B

背景:

BAIR的计算机视觉研究者有兴趣探索自动驾驶感知算法的前沿,以使其更加安全,为了设计和测试潜在的算法,研究者想利用真实驾驶平台收集数据中的所有信息。这种信息有四个主要特点:大规模、多样化、在街上采集、具有时间信息。数据多样性对于测试感知算法的鲁棒性尤为重要。但是,当前的开放数据集只能覆盖上述属性的一部分。因此,在Nexar的帮助下,BAIR将发布BDD100K的数据库,这是目前用于计算机视觉研究的最大、最多样化的开放驾驶视频数据集。该项目由伯克利DeepDrive产业联盟组织和赞助,该联盟研究计算机视觉和机器学习在汽车应用上的最新技术。

下载地址:

官网:http://bair.berkeley.edu/blog/2018/05/30/bdd/

数据集下载地址:http://bdd-data.berkeley.edu.

论文下载地址:https://arxiv.org/abs/1805.04687

数据集组成:

基本情况:

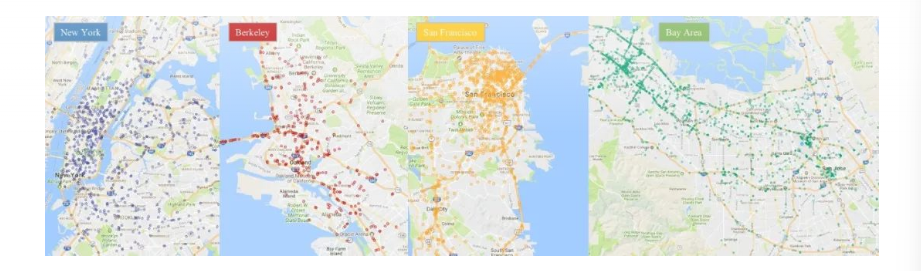

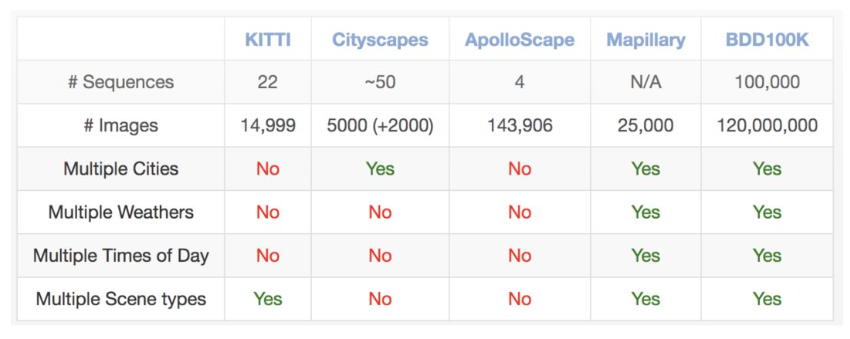

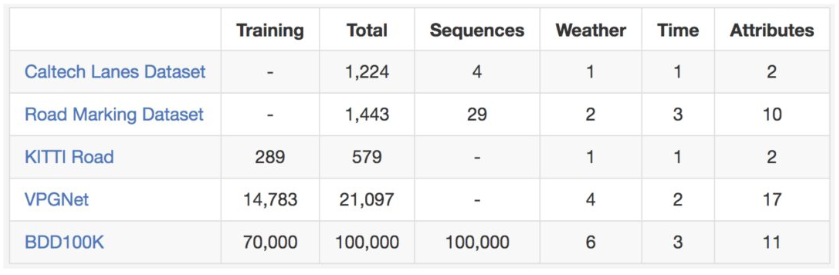

该数据集包含共10万个视频。每个视频大约40秒长、720p、30fps,还附有手机记录的GPS/IMU信息,以显示大概的驾驶轨迹。这些视频是从美国各地收集的,如上图所示。数据集涵盖了不同的天气条件,包括晴天、阴天和雨天,以及白天和晚上的不同时间。下表总结了与以前数据集的对比结果,表名BAIR的数据集更大,更多样化。

注释:

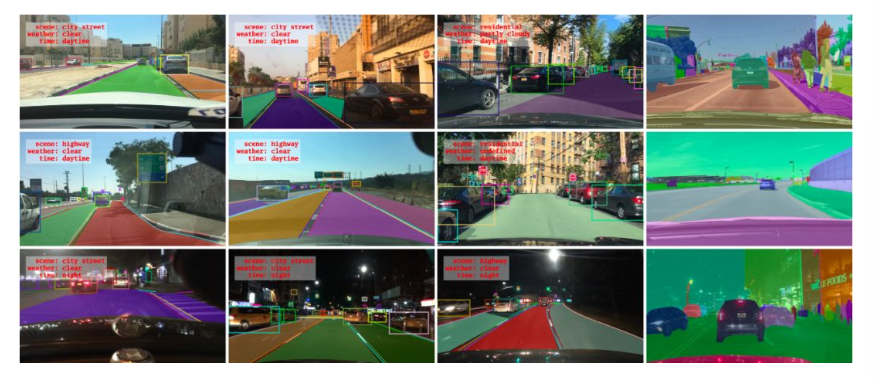

BAIR研究者在每个视频的第10秒采样关键帧,并为这些关键帧提供注释。它们被标记为几个类别:图像标记、道路对象边界框、可驾驶区域、车道标记线和全帧实例分割。这些注释有助于理解不同场景中数据和对象统计的多样性。

Annotation包含了被标记对象的源图像的URL、类别标签、大小(起始坐标、结束坐标、宽度和高度)、截断、遮挡和交通灯颜色等信息。

道路目标边界框:10万张图片(其中训练集7万,测试集2万,验证集1万)

可行驶区域:10万张图片

车道线标记:10万张图片

全帧实例分割:1万张图片

针对不同目标:

道路目标检测:

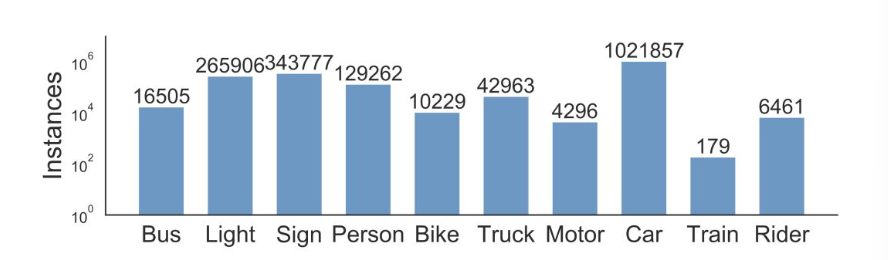

为了解对象的分布及其位置,BAIR研究者为所有10万个关键帧中常出现在道路上的对象标记了对象边界框。下面的条形图显示对象计数。在主时钟还有其他处理统计数据的方法。例如,我们可以比较不同天气条件下或不同场景中的对象数量。此图还显示了数据集中出现的各种对象集,以及数据集的规模(超过100万辆汽车)。这些是具有不同外观和语境的不同对象(多类别)。

标签类别:

数据集中的GT框标签共有10个类别,分别为:Bus、Light、Sign、Person、Bike、Truck、Motor、Car、Train、Rider。总共约有184万个标定框,不同类型目标的数目统计如图1所示。

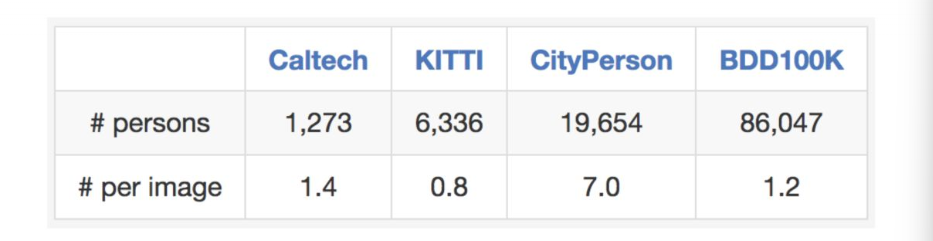

其中小车(Car一类)就超过了100万个样本。平均而言,每张图片约9.7辆车,1.2个人。尤其是,行人的数量多于之前的数据集,具体数目如图2所示(统计是基于各数据集中的训练集的)。

该数据集也适用于研究某些特定的领域。例如,若对检测和避开街道上的行人感兴趣,可以考虑研究该数据集,因为它包含的行人实例比以前的转嗯数据集还要多,如下表所示:

天气、场景和时间:

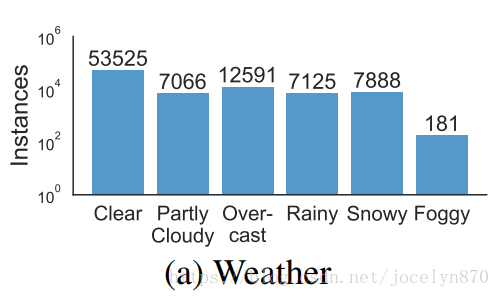

天气:晴天、多云、阴天、下雨、下雪、雾天6种天气,以晴天为主。

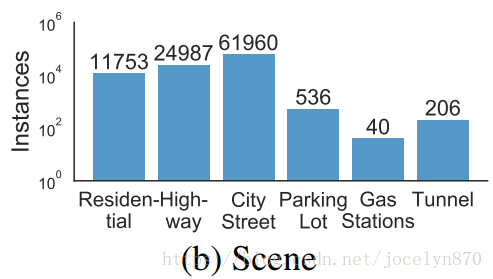

场景:住宅区、公路、城市街道、停车场、加油站、隧道6种场景,以城市街道为主。

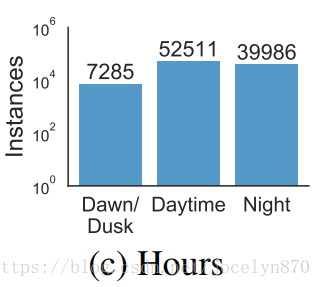

时间:黎明/黄昏、白天、夜晚3个阶段,其中白天、夜晚居多。

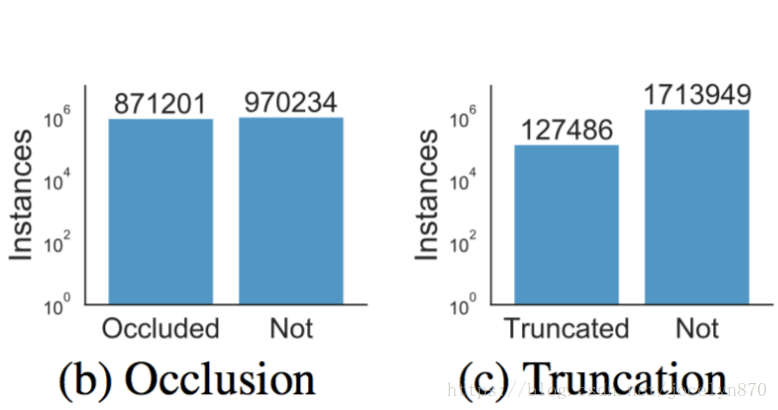

Occluded、Truncated

目标的是否遮挡、截断情况标注。

车道线:

车道线对于人类司机而言是重要的道路指示。它们也是驾驶方向的重要线索,以及在GPS或地图没有准确覆盖全球时,帮助自动驾驶系统准确定位。

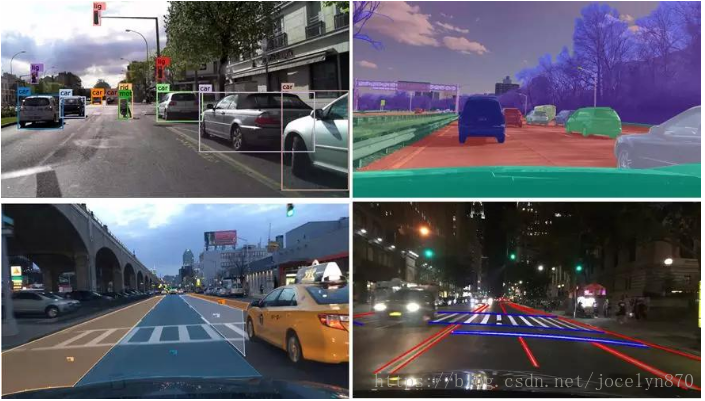

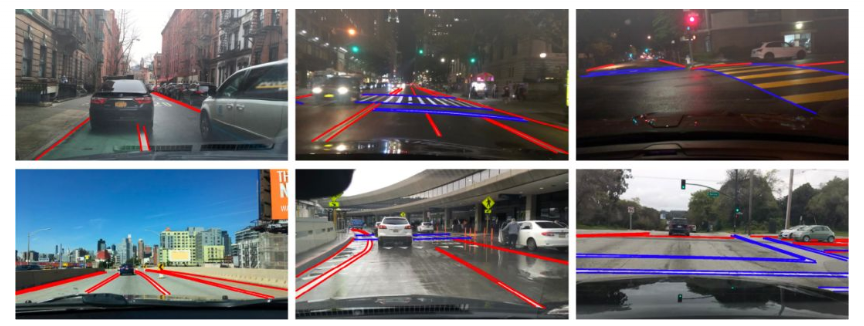

BAIR研究者根据车道线对车辆的指示作用将车道线分成两种类型:垂直车道线(下图中红色标记)表示车辆驾驶方向;平行车道线(下图蓝色标记)表示车辆在此车道要停下。

BAIR研究者还为车道线提供属性,如实线vs虚线、双线vs单线。

车道线数据集对比:

可驾驶区域:

我们能否在某条路上驾驶取决于车道线、交通设备,以及与道路上其他对象的复杂互动。总之,理解哪块区域适合驾驶非常重要。为研究该问题,BAIR提供可驾驶区域的分割注释,如下图所示。

![]()

BAIR根据ego vehicle将可驾驶区域分割成两个类别:直接可驾驶(标记为红色)即ego vehicle具备道路优先权,可以在该区域驾驶;代替可驾驶(标记为蓝色)即ego vehicle可在该区域驾驶,但是必须小心,因为这段路的优先权属于其他车辆。

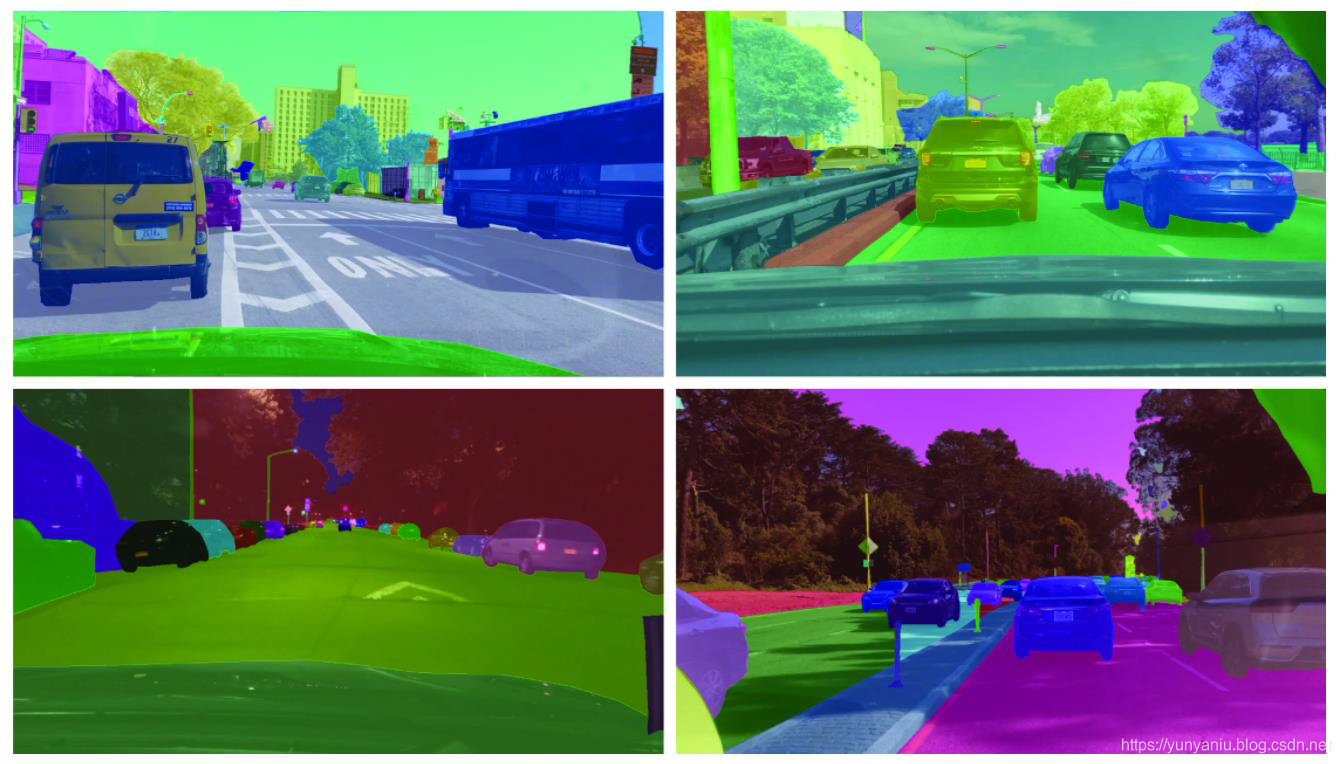

全帧分割:

研究者已经证明在Cityscapes数据集上,全帧实例分割可以大大促进密集预测和目标检测方面的研究,而这两者是计算机视觉应用中的重要部分。由于BAIR的视频是不同的领域,因此BAIR也提供实例分割注释,以对比不同数据集上的域变换(domain shift)。获取全像素级别的分割结果成本高,且耗费大量劳动。幸运的是,使用BAIR的标注工具后,标注成本可以减少50%。最后,BAIR给包含一万张图像的数据自己进行了全帧实例分割。标注集与Cityscapes数据集中的训练注释是兼容的,这样便于研究两个数据集之间的域变换。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)