【AI入门】告别写不完的 if-else!带你 10 分钟看懂机器学习(人话版)

兄弟们,机器学习真没那么玄乎。它不是魔法,它只是一个不知疲倦的、会根据错误自我修正的数学函数。Machine Learning = Model + Loss + Optimizer (模型 + 误差 + 优化器)。下一篇,飞哥带大家玩点更直观的——把这个 Loss 下降的过程画出来!👇。

大家好,我是飞哥。👋

最近有位做前端和移动端的兄弟问我:“飞哥,我看 AI 教程全是数学公式,什么梯度下降、反向传播,看得我脑壳疼。这玩意儿到底跟咱们平时写 Java/Kotlin/JS 有啥区别啊?”

这个问题问得太好了。

作为一名在全栈领域摸爬滚打 10 年,写惯了业务逻辑的“if-else 工程师”,我刚接触 AI 时也是一脸懵逼。但当你捅破那层窗户纸,你会发现:机器学习的本质,其实就是“投篮”!

今天飞哥不讲数学,只讲人话,带你用程序员的思维秒懂机器学习。

1. 为什么:规则是写不完的 🤯

1.1 传统的“逻辑思维”

在传统的 App 或 Web 开发中,我们习惯了上帝视角。所有规则都是我们定好的:

// 无论是 Android 的 onClick 还是 Vue 的 @click

// 只有点击且登录了,才能跳转

if (button.isClicked && user.isLoggedIn) {

jumpToPage2()

} else {

showToast("请先登录")

}

这种 Rule-based (基于规则) 的编程方式,逻辑严密,非常适合写业务。

1.2 现实世界的“失控”

但是,如果你要写一个程序来 “识别照片里有没有猫”,你怎么写?

if (有两只尖耳朵)-> 可能是狗,也可能是狐狸。if (有胡须)-> 可能是老鼠。if (圆脸)-> 可能是猫头鹰。if (毛茸茸)-> 可能是地毯…

你会发现,规则是写不完的。现实世界太复杂,充满了不确定性,传统的 if-else 彻底失效了。

于是,大神们换了个思路:与其我们手写规则,不如让电脑自己去“猜”规则! —— 这就是机器学习。

2. 是什么:三步拆解机器学习 🧠

第一步:锚定已知 ⚓️

还记得初中代数吗?

y=ax+b y = ax + b y=ax+b

- x 是输入(比如房屋面积)。

- y 是输出(比如房价)。

- a 和 b 是参数(斜率和截距)。

机器学习的本质,就是让电脑自己求出 a 和 b 的过程。

一旦求出了最佳的 a 和 b,给你一个新的 x,它就能算出 y。

第二步:生动类比 (投篮训练) 🏀

这听起来还是很抽象?来,闭上眼想象你在练投篮:

- 前向传播 (Forward):你闭眼扔出一个球(输入 x),球偏离了篮筐(输出 y_pred)。

- 计算损失 (Loss):睁眼一看,球偏左了 10 厘米(Loss = 10)。Loss 就是你的“烂”度指标。

- 优化器 (Optimizer):你的大脑迅速调整手臂肌肉的力度和角度(更新参数 Weights)。

- 迭代 (Epoch):再投一次!这次只偏了 5 厘米…

- 收敛:重复投了 1000 次后,你成了百发百中的神射手(Loss 接近 0)。

机器也是这样学习的!它就是个不知疲倦的投篮手,通过无数次试错,把自己练成了专家。

第三步:三大门派 ⚔️

并不是所有的学习都有“标准答案”。根据有没有老师教,机器学习分为三类:

- 监督学习 (Supervised):上课。

- 老师出题(输入),给答案(标签)。你做错了,老师打分。

- 例子:房价预测、猫狗识别。

- 无监督学习 (Unsupervised):自习。

- 没老师,没答案。对着一堆书自己找规律。

- 例子:把用户分成“土豪”和“羊毛党”(聚类)。

- 强化学习 (Reinforcement):训狗。

- 做对了给骨头(奖励),做错了打屁股(惩罚)。

- 例子:AlphaGo 下围棋、训练游戏 AI。

3. 黑话指南 (术语表) 📖

看 AI 论文或文档时,这些词会把你看晕。飞哥给你翻译成人话:

| 术语 | 英文 | 解读 (人话版) |

|---|---|---|

| 训练集 | Training Set | 课本。平时上课用来学习的例题。 |

| 测试集 | Test Set | 期末考试。用来检测你是不是真学会了,还是死记硬背。 |

| 过拟合 | Overfitting | 书呆子。平时作业全对(训练集 Loss 低),一考试就挂(测试集 Loss 高)。 |

| 欠拟合 | Underfitting | 学渣。平时作业和考试都不及格。 |

| 特征工程 | Feature Engineering | 备菜。数据是食材,模型是厨师。如果食材是烂的 (Garbage In),厨师再牛也做不出好菜 (Garbage Out)。 |

4. 怎么用:Scikit-learn 初体验 💻

光说不练假把式。Python 里最经典的机器学习库是 scikit-learn (sklearn)。

4.1 安装 (注意坑!🚧)

很多兄弟在这里栽了跟头!

- ❌

pip install sklearn(错!这是旧包,已废弃) - ✅

pip install scikit-learn(对!要装这个)

在终端执行:

pip install scikit-learn

4.2 极简代码:预测房价

下面这段代码,麻雀虽小,五脏俱全。

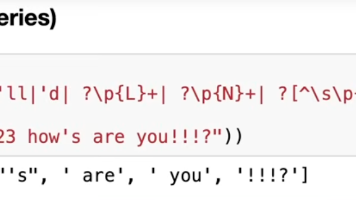

# 飞哥提示:导入时要用 sklearn,不是 scikit-learn,别晕!

from sklearn.linear_model import LinearRegression

import numpy as np

# 1. 准备数据 (Training Set)

# 飞哥解读:sklearn 要求输入必须是二维矩阵 [[x1], [x2]],因为可能有多个特征

X = np.array([[50], [80], [100], [120]]) # 房屋面积

y = np.array([150, 240, 300, 360]) # 房价 (万)

# 2. 选择模型 (Model)

# 飞哥解读:这就相当于雇了个“线性回归”专家的对象

model = LinearRegression()

# 3. 训练 (Fit) -> 关键时刻!

# 飞哥解读:这就是“投篮训练”。给它数据,让它自己找规律 (求出 y=ax+b 中的 a 和 b)

model.fit(X, y)

# 4. 预测 (Predict)

# 飞哥解读:模型练好了,来考考它:150平米的房子多少钱?

new_house = np.array([[150]])

prediction = model.predict(new_house)

print(f"预测房价: {prediction[0]} 万元")

# 输出结果应该是 450.0,因为它学到了 y = 3x 的规律

总结

兄弟们,机器学习真没那么玄乎。

它不是魔法,它只是一个不知疲倦的、会根据错误自我修正的数学函数。

只要记住这句话:Machine Learning = Model + Loss + Optimizer (模型 + 误差 + 优化器)。

下一篇,飞哥带大家玩点更直观的——把这个 Loss 下降的过程画出来!

如果你觉得这篇帮你看懂了机器学习,点个赞支持一下飞哥!👇

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)