AI原生应用领域多租户的安全防护机制探讨

本文聚焦“AI原生应用的多租户安全”,覆盖从基础概念到实战防护的全链路知识。适合想了解多租户安全设计的开发者、架构师,或对AI应用安全感兴趣的技术爱好者。本文从“生活场景→核心概念→技术原理→实战案例→未来趋势”展开,通过“合租公寓”“快递分拣”等通俗类比,让复杂的安全机制变得可感知。AI原生应用:以AI为核心引擎的应用,依赖模型推理、训练等能力;多租户架构:共享资源但逻辑隔离的服务模式,降低成本

AI原生应用领域多租户的安全防护机制探讨

关键词:AI原生应用、多租户架构、安全防护、数据隔离、模型安全、访问控制、隐私计算

摘要:随着AI技术与云服务的深度融合,AI原生应用(以AI为核心设计的应用)正以“多租户”模式快速普及——一个系统同时服务多个企业/用户(租户)。但多租户场景下,“数据混存、模型共享、资源共用”的特性带来了前所未有的安全挑战:租户A的隐私数据可能被租户B“偷看”,恶意租户可能“污染”共享模型,甚至攻击者能通过漏洞跨租户窃取资源。本文将从生活场景类比出发,逐步拆解AI原生应用多租户的安全风险,深入讲解数据隔离、模型防护、访问控制等核心防护机制,并通过代码示例和实战案例,帮你理解如何为多租户AI应用构建“安全护城河”。

背景介绍

目的和范围

本文聚焦“AI原生应用的多租户安全”,覆盖从基础概念到实战防护的全链路知识。适合想了解多租户安全设计的开发者、架构师,或对AI应用安全感兴趣的技术爱好者。

预期读者

- 初级:对AI、云服务有基础了解,想入门多租户安全的开发者

- 中级:负责AI应用开发/运维,需解决多租户安全问题的技术负责人

- 高级:关注AI安全前沿技术(如隐私计算)的架构师

文档结构概述

本文从“生活场景→核心概念→技术原理→实战案例→未来趋势”展开,通过“合租公寓”“快递分拣”等通俗类比,让复杂的安全机制变得可感知。

术语表

| 术语 | 解释 |

|---|---|

| AI原生应用 | 从设计之初就以AI为核心能力的应用(如智能客服、个性化推荐系统) |

| 多租户(Multi-Tenant) | 一个系统实例同时服务多个独立租户(如钉钉为不同企业提供专属工作空间) |

| 数据隔离 | 确保不同租户的数据彼此不可见、不可篡改 |

| 模型中毒攻击 | 恶意租户通过输入“污染数据”,破坏共享模型的预测准确性 |

核心概念与联系

故事引入:合租公寓的“安全烦恼”

想象一个“智能合租公寓”:公寓里有10间房(租户),共用厨房(计算资源)、快递柜(数据存储)和公共AI管家(共享模型)。

- 租户A的快递(用户隐私数据)被租户B误拿(数据泄露);

- 租户C往厨房调料罐(模型训练数据)里撒糖(污染数据),导致AI管家做的菜(模型预测)全变甜(模型中毒);

- 租户D破解了门禁(系统漏洞),进入其他房间翻找(越权访问)。

AI原生应用的多租户场景,就像这个“智能合租公寓”:资源共享带来高效,但也埋下安全隐患。如何让租户“同住屋檐下,隐私不泄露”?这就是多租户安全防护的核心目标。

核心概念解释(像给小学生讲故事一样)

核心概念一:AI原生应用

AI原生应用不是“传统应用+AI功能”,而是“以AI为核心引擎”设计的系统。比如,一个智能客服系统,从用户咨询文本的理解(自然语言处理)、答案生成(大模型推理)到问题分类(机器学习模型),每一步都依赖AI能力。它像一个“AI大脑驱动的机器人”,而传统应用更像“人类操作的工具”。

核心概念二:多租户架构

多租户架构就像“共享办公室”:一栋大楼里有多个公司(租户),共用前台(入口)、电梯(网络)、空调(计算资源),但每个公司有独立的办公区(数据空间)和门禁(权限控制)。系统通过“逻辑隔离”让租户感觉自己“独占”资源,同时降低成本(一栋楼比10栋楼便宜)。

核心概念三:多租户安全防护机制

安全防护机制是多租户系统的“保安团队”,包含三个“保安”:

- 数据隔离保安:确保A租户的合同(敏感数据)不会出现在B租户的文件柜里;

- 模型防护保安:防止有人往“AI管家”的“学习教材”(训练数据)里塞错误内容;

- 访问控制保安:只有A租户的员工(合法用户)能刷门禁(凭证)进入A的办公区。

核心概念之间的关系(用小学生能理解的比喻)

AI原生应用(智能公寓)采用多租户架构(共享大楼)时,必须依赖安全防护机制(保安团队)解决三大矛盾:

- 数据混存 vs 隐私保护:共享快递柜(存储)里,数据隔离保安给每个租户的快递贴“专属封条”(加密+权限);

- 模型共享 vs 恶意篡改:共用AI管家(模型)时,模型防护保安给“学习教材”加“防伪水印”(数据校验),防止被污染;

- 资源共用 vs 越权访问:共享电梯(计算资源)里,访问控制保安检查“电梯卡”(身份凭证),只让租户去自己的楼层(权限范围)。

核心概念原理和架构的文本示意图

AI原生应用(智能公寓)

├─ 多租户架构(共享大楼)

│ ├─ 租户1(公司A):独立数据空间+专属权限

│ ├─ 租户2(公司B):独立数据空间+专属权限

│ └─ ...(更多租户)

└─ 安全防护机制(保安团队)

├─ 数据隔离:加密存储+租户标识绑定

├─ 模型防护:数据校验+联邦学习

└─ 访问控制:RBAC+动态权限校验

Mermaid 流程图(多租户安全防护流程)

核心算法原理 & 具体操作步骤

多租户安全的核心是“隔离”与“校验”,以下是三大核心机制的技术原理与实现方法:

一、数据隔离:让租户数据“各回各家”

原理

数据隔离的本质是“给每条数据打‘租户标签’,并在读写时强制校验标签”。就像快递柜的每个格子都标有“租户A-1号”,只有租户A的取件码能打开。

实现步骤(以数据库存储为例)

- 数据入库时:为每条数据添加

tenant_id字段(租户唯一标识,如“T001”)。 - 数据查询时:SQL语句自动追加

WHERE tenant_id = 'T001',确保只能查自己租户的数据。 - 物理隔离(可选):敏感租户(如金融机构)可单独分配数据库实例(类似“独立快递柜”)。

Python代码示例(Flask+SQLAlchemy)

from flask import request

from flask_sqlalchemy import SQLAlchemy

db = SQLAlchemy()

class UserData(db.Model):

id = db.Column(db.Integer, primary_key=True)

data = db.Column(db.String(255))

tenant_id = db.Column(db.String(50)) # 租户标识字段

def get_user_data():

# 从请求中获取租户ID(实际需通过JWT等鉴权获取)

current_tenant = request.headers.get('X-Tenant-ID')

# 查询时自动过滤租户

data = UserData.query.filter_by(tenant_id=current_tenant).all()

return data

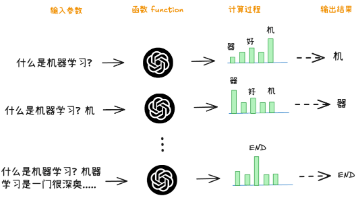

二、模型防护:防止“AI管家”被带偏

原理

共享模型(如推荐模型、客服模型)可能被恶意租户“投喂”错误数据(如伪造的用户点击记录),导致模型预测偏差(模型中毒攻击)。防护的关键是“识别异常数据”和“隔离训练过程”。

实现方法

- 数据校验:通过统计方法(如检查数据分布是否异常)或AI检测模型(如用异常检测算法)过滤“可疑数据”。

- 联邦学习(FL):让模型在租户本地训练(不传输原始数据),只上传“模型参数更新”,避免数据泄露(类似“老师让学生自己做题,只交答案,不交试卷”)。

数学模型(以联邦学习为例)

联邦学习的核心是“全局模型聚合”,公式如下:

Wglobalt+1=∑i=1nNiNWit W_{global}^{t+1} = \sum_{i=1}^n \frac{N_i}{N} W_i^t Wglobalt+1=i=1∑nNNiWit

其中:

- Wglobalt+1W_{global}^{t+1}Wglobalt+1:第t+1轮的全局模型参数

- NiN_iNi:租户i的样本量,NNN:总样本量(确保大租户不“主导”模型)

- WitW_i^tWit:租户i第t轮的本地模型参数

Python代码示例(简化版联邦学习聚合)

def federated_aggregate(local_models, sample_sizes):

total_samples = sum(sample_sizes)

global_model = {}

# 初始化全局模型参数(假设参数是字典形式)

for key in local_models[0].keys():

global_model[key] = 0.0

# 按样本量加权平均

for i, model in enumerate(local_models):

weight = sample_sizes[i] / total_samples

for key in model:

global_model[key] += model[key] * weight

return global_model

三、访问控制:给每个操作“贴权限标签”

原理

访问控制(如RBAC,基于角色的访问控制)通过“角色→权限→操作”的映射,确保用户只能执行被允许的操作。例如:租户A的“普通员工”角色只能查看数据,“管理员”角色才能删除数据。

实现步骤

- 定义角色:如“普通用户”“分析师”“管理员”。

- 绑定权限:为每个角色分配权限(如“查看数据”“修改模型”)。

- 动态校验:用户请求时,检查其角色是否有权限执行操作。

Python代码示例(Django RBAC实现)

from django.contrib.auth.models import Group, Permission

from django.core.exceptions import PermissionDenied

# 1. 定义角色(组)

analyst_group, created = Group.objects.get_or_create(name='分析师')

admin_group, created = Group.objects.get_or_create(name='管理员')

# 2. 绑定权限(假设模型有view_data和delete_data权限)

view_perm = Permission.objects.get(codename='view_data')

delete_perm = Permission.objects.get(codename='delete_data')

analyst_group.permissions.add(view_perm)

admin_group.permissions.add(view_perm, delete_perm)

# 3. 动态校验权限

def delete_data(request, data_id):

if not request.user.has_perm('app.delete_data'):

raise PermissionDenied("无删除权限")

# 后续删除操作...

数学模型和公式 & 详细讲解 & 举例说明

同态加密:让数据“加密状态下也能计算”

多租户场景中,若需跨租户联合计算(如统计行业平均数据),直接共享原始数据会泄露隐私。同态加密(HE)允许在加密数据上进行计算,结果解密后与明文计算一致。

公式示例(加法同态):

设明文数据为m1,m2m_1, m_2m1,m2,加密函数为EEE,则:

E(m1)+E(m2)=E(m1+m2) E(m_1) + E(m_2) = E(m_1 + m_2) E(m1)+E(m2)=E(m1+m2)

举例:租户A有加密的用户年龄E(25)E(25)E(25),租户B有E(30)E(30)E(30),系统计算E(25)+E(30)=E(55)E(25)+E(30)=E(55)E(25)+E(30)=E(55),解密后得到55(真实年龄和),但计算过程中看不到25和30的具体值。

项目实战:多租户AI推荐系统的安全设计

开发环境搭建

- 技术栈:Python 3.9+、Flask 2.0+(Web框架)、SQLAlchemy 1.4+(ORM)、Scikit-learn(推荐模型)

- 硬件:云服务器(2核4G,用于部署)、Redis(缓存租户会话)

源代码详细实现和代码解读

我们将实现一个简化的“多租户商品推荐系统”,重点展示数据隔离、模型防护和访问控制的代码逻辑。

1. 数据隔离:租户标识绑定

# models.py(数据库模型)

from app import db

class UserBehavior(db.Model):

__tablename__ = 'user_behavior'

id = db.Column(db.Integer, primary_key=True)

user_id = db.Column(db.Integer)

item_id = db.Column(db.Integer)

click = db.Column(db.Boolean)

tenant_id = db.Column(db.String(50), nullable=False) # 关键:租户标识字段

@staticmethod

def get_for_tenant(tenant_id):

# 查询时强制过滤租户

return UserBehavior.query.filter_by(tenant_id=tenant_id)

2. 模型防护:联邦学习训练

# training.py(模型训练逻辑)

from sklearn.linear_model import SGDClassifier

import numpy as np

def local_train(tenant_data):

# 租户本地训练模型(仅使用自己的数据)

X = tenant_data[['user_feature', 'item_feature']].values

y = tenant_data['click'].values

model = SGDClassifier(loss='log_loss') # 逻辑回归模型

model.fit(X, y)

return model.coef_, model.intercept_ # 返回参数,不上传原始数据

def global_aggregate(local_params, sample_sizes):

# 全局模型聚合(按样本量加权)

total = sum(sample_sizes)

global_coef = np.zeros_like(local_params[0][0])

global_intercept = 0.0

for (coef, intercept), size in zip(local_params, sample_sizes):

weight = size / total

global_coef += coef * weight

global_intercept += intercept * weight

return global_coef, global_intercept

3. 访问控制:基于角色的权限校验

# auth.py(权限校验中间件)

from flask import request, jsonify

from functools import wraps

# 模拟角色-权限映射(实际应从数据库读取)

ROLE_PERMISSIONS = {

'普通用户': ['view_recommendation'],

'分析师': ['view_recommendation', 'view_analytics'],

'管理员': ['view_recommendation', 'view_analytics', 'manage_model']

}

def required_permission(permission):

def decorator(f):

@wraps(f)

def wrapped(*args, **kwargs):

user_role = request.headers.get('X-User-Role')

if not user_role or permission not in ROLE_PERMISSIONS.get(user_role, []):

return jsonify(error="无权限"), 403

return f(*args, **kwargs)

return wrapped

return decorator

# 使用示例:接口需要'manage_model'权限

@app.route('/update_model', methods=['POST'])

@required_permission('manage_model')

def update_model():

# 更新模型逻辑...

return jsonify(success=True)

代码解读与分析

- 数据隔离:通过

tenant_id字段强制绑定数据归属,查询时自动过滤,避免“越界查数据”; - 模型防护:采用联邦学习,租户仅上传模型参数(非原始数据),防止数据泄露,同时通过加权聚合平衡各租户贡献;

- 访问控制:通过中间件校验用户角色对应的权限,确保“普通用户看不到管理员功能”。

实际应用场景

1. 云厂商AI中台(如阿里云PAI)

云厂商为多个企业提供AI训练/推理服务,需确保:

- 企业A的训练数据不被企业B查看;

- 企业B无法修改企业A的模型参数;

- 企业管理员能管理本企业用户权限,普通员工只能调用接口。

2. SaaS智能客服系统(如智齿科技)

不同企业(租户)共用一套客服系统,但:

- 企业A的用户聊天记录(含隐私信息)需隔离存储;

- 企业B的客服机器人(模型)不能学习到企业A的数据;

- 企业管理员可配置客服人员的对话查看权限(如仅查看自己接待的客户)。

3. 金融AI风控平台

银行、保险等金融机构共用风控模型,但:

- 某银行的交易数据(如用户消费记录)需严格隔离;

- 模型更新时,需防止“恶意银行”上传“污染参数”破坏全局模型;

- 监管机构需能审计各租户的模型调用日志,确保合规。

工具和资源推荐

| 类别 | 工具/资源 | 说明 |

|---|---|---|

| 访问控制 | Keycloak | 开源身份与访问管理(IAM)系统,支持多租户权限管理 |

| 数据加密 | AWS KMS(密钥管理服务) | 云厂商提供的密钥管理工具,支持租户级密钥隔离 |

| 联邦学习框架 | TensorFlow Federated(TFF) | Google开源的联邦学习框架,支持多租户模型训练 |

| 安全审计 | Elastic Stack(Elasticsearch+Kibana) | 日志收集与分析工具,可监控多租户的异常操作(如高频数据查询) |

| 隐私计算 | 蚂蚁链隐语(SecretFlow) | 支持多租户联合计算的隐私计算框架,集成同态加密、安全多方计算等技术 |

未来发展趋势与挑战

趋势1:隐私计算深度融入多租户设计

随着《个人信息保护法》等法规的完善,“数据可用不可见”将成为强制要求。未来多租户AI应用将更多集成隐私计算技术(如同态加密、安全多方计算),在不共享原始数据的前提下完成联合建模。

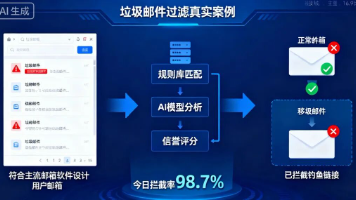

趋势2:AI驱动的自动化安全防护

传统规则式防护(如“禁止跨租户查询”)难以应对复杂攻击(如新型模型中毒)。未来将用AI算法(如异常检测模型)自动识别“可疑操作”,并触发隔离或报警(类似“AI保安”)。

挑战1:性能与安全的平衡

隐私计算(如同态加密)会增加计算开销(可能慢100倍),如何在“安全”与“效率”间找到平衡?需要硬件加速(如专用加密芯片)和算法优化(如轻量级同态加密)。

挑战2:跨租户攻击检测难度大

攻击者可能通过“正常操作”掩盖恶意行为(如多次小批量上传污染数据),传统日志分析难以识别。需要更智能的“行为画像”技术(如基于图神经网络的租户行为建模)。

总结:学到了什么?

核心概念回顾

- AI原生应用:以AI为核心引擎的应用,依赖模型推理、训练等能力;

- 多租户架构:共享资源但逻辑隔离的服务模式,降低成本;

- 安全防护机制:包含数据隔离(租户标签+校验)、模型防护(联邦学习+数据校验)、访问控制(RBAC+动态鉴权)。

概念关系回顾

多租户架构是AI原生应用的“高效底座”,但必须依赖安全防护机制解决“数据混存、模型共享、资源共用”带来的风险。三者关系如同“大楼(架构)→住户(应用)→保安(防护)”,缺一不可。

思考题:动动小脑筋

-

假设你要设计一个多租户的AI教育平台(如在线批改作文),如何防止教师A看到教师B的学生作文数据?可以考虑哪些数据隔离方案?

-

如果一个恶意租户持续向共享的作文批改模型“投喂”语法错误但被标记为“正确”的数据,可能导致模型误判。你会如何检测和防御这种“模型中毒攻击”?

-

访问控制中,“租户管理员”可能越权操作(如删除其他租户数据)。如何设计“管理员权限限制”机制,确保“我的权限不越界”?

附录:常见问题与解答

Q:多租户数据隔离是“逻辑隔离”还是“物理隔离”更好?

A:视需求而定。逻辑隔离(共享数据库+tenant_id)成本低,适合大多数场景;物理隔离(独立数据库实例)安全性更高,适合金融、医疗等敏感行业。

Q:联邦学习能完全防止数据泄露吗?

A:不能。虽然联邦学习不上传原始数据,但攻击者可能通过“模型反演攻击”(根据模型参数推测原始数据特征)获取部分信息。需结合差分隐私(给参数加“随机噪声”)进一步防护。

Q:多租户访问控制需要注意什么?

A:避免“权限继承漏洞”(如租户管理员的权限被错误继承到其他租户),建议采用“最小权限原则”(用户仅拥有完成任务所需的最低权限)。

扩展阅读 & 参考资料

- 《AI安全技术白皮书》——中国信息通信研究院

- 《联邦学习:算法与应用》——杨强、刘洋(著)

- NIST SP 800-162《多租户云系统安全指南》

- AWS文档《Multi-Tenant Application Security Best Practices》

更多推荐

已为社区贡献209条内容

已为社区贡献209条内容

所有评论(0)