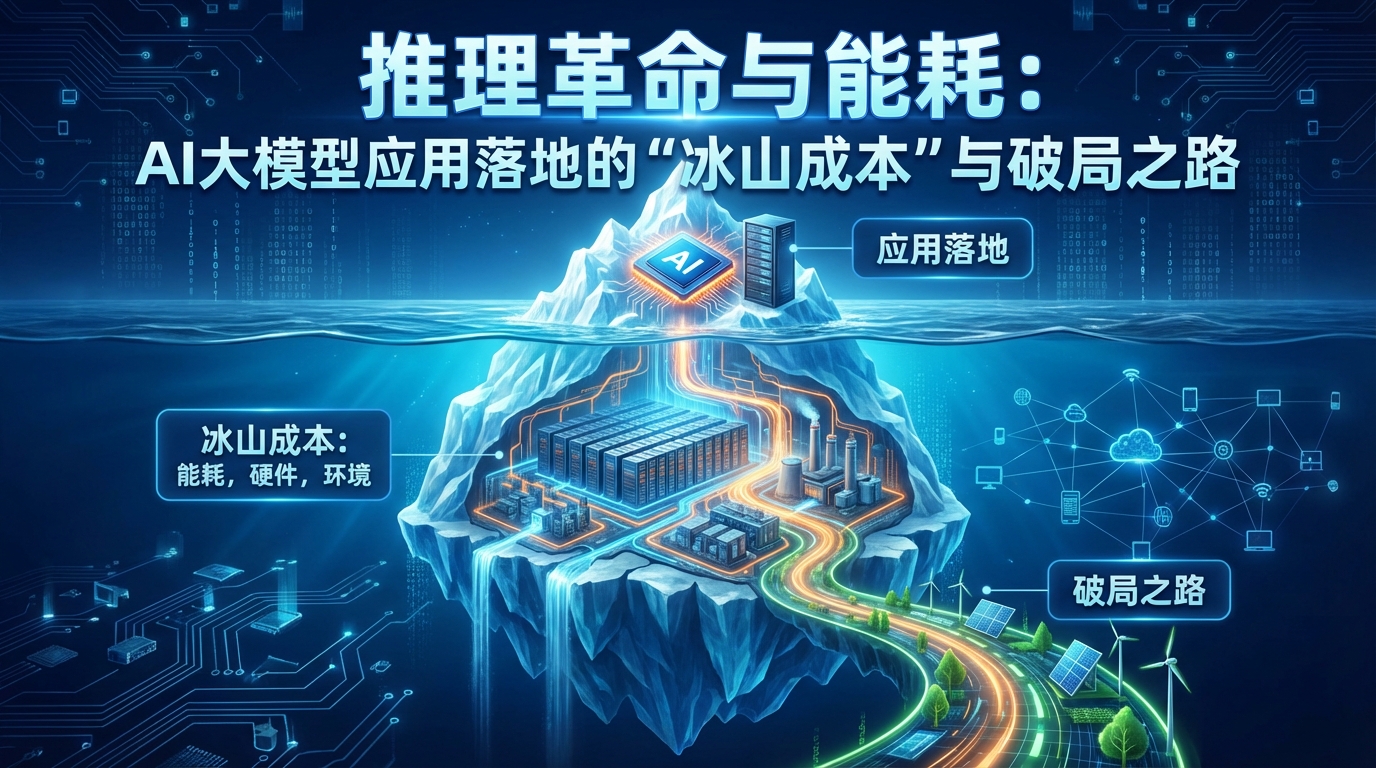

推理革命与能耗:AI大模型应用落地的“冰山成本”与破局之路

当西部地区的风能与太阳能通过“东数西算”工程,为东部的AI推理提供绿色动力,一幅高效、低碳的智能社会图景正徐徐展开。训练是一次性的、集中式的“锻造”过程,而推理是持续性的、分布式的“服务”过程。小米发布的轻量化大模型,参数规模仅为主流模型的十分之一,但在多项基准测试中性能相当,推理速度提升5倍,能耗降低70%。模型压缩与量化技术日趋成熟,将FP32精度模型转换为INT8甚至INT4,能在几乎不损失

一只名叫“ChatGPT”的数字巨兽,每天仅响应全球用户的请求,消耗的电力就超过50万度,这背后并非训练的短暂爆发,而是永不间断的推理洪流。

当全球科技巨头将AI大模型推上神坛时,喧嚣背后正涌动着另一场静默但更为根本的革命——推理革命。模型训练虽如昙花一现般引人注目,而真正无时无刻不在发生、规模呈指数级增长的模型推理,正成为决定AI能否真正普及的能源命脉。

01 推理洪流:从训练场到应用海

大模型竞赛的第一阶段看似结束,ChatGPT、文心一言、通义千问等模型相继登场。真正的竞赛第二阶段才刚刚拉开帷幕:从“模型可用”到“应用好用”的推理落地战。

一家中型互联网公司每天处理数亿次的AI请求(搜索推荐、图像生成、智能客服),其推理消耗的算力已是训练时的数十倍乃至上百倍。

推理与训练的本质差异决定了这场革命的特殊性。训练是一次性的、集中式的“锻造”过程,而推理是持续性的、分布式的“服务”过程。每一次用户提问、每一次图片生成、每一次视频渲染,都在调用庞大的模型参数,消耗着惊人的计算资源与电力。

随着AI应用深入各行各业,推理需求的爆炸性增长已不是线性,而是指数级曲线。

02 能耗冰山:水面下的成本结构

AI能耗的“冰山效应”正在显现。水面之上是训练成本,虽然高昂但可预测、可控制;水面之下则是推理成本,随着用户量的增长而持续膨胀,深不可测。

根据半导体研究机构SemiAnalysis的数据,ChatGPT每日的推理成本高达70万美元,其中大部分为电力与算力基础设施支出。这仅是一款应用,当数千款AI应用同时运行时,全球电力系统将面临前所未有的压力。

更令人担忧的是,当前大多数AI推理的效率极低。斯坦福大学AI指数报告指出,大型Transformer模型在推理时,计算资源的利用率往往不足30%,大量能耗浪费在数据搬运、内存等待等非计算任务上。

不同规模AI请求的能耗对比鲜明:一次简单的文本生成消耗相当于点亮一个灯泡数分钟;而生成一张高清图片的能耗,相当于这台灯泡亮上数小时。

03 推理经济学:成本下降与能效竞赛

面对能耗困境,产业界正从两个维度寻求突破:降低单次推理成本和提升单位能耗性能。这场能效竞赛正在重塑AI芯片与软件栈的竞争格局。

推理成本正在以前所未有的速度下降。行业数据显示,过去18个月内,大模型推理的单次调用成本已下降超过80%。这一趋势由多重因素驱动:

模型压缩与量化技术日趋成熟,将FP32精度模型转换为INT8甚至INT4,能在几乎不损失精度的情况下减少75%以上的计算量与能耗。

动态批处理与连续批处理技术让GPU等硬件保持高利用率,避免空闲耗电。业界领先的推理引擎已能将芯片利用率提升至60%以上。

专用推理芯片的崛起改变了游戏规则。相比通用GPU,如华为昇腾、谷歌TPU等专用AI芯片,在能效比上普遍有3-5倍的优势。

04 技术破局:从芯片到系统的全方位优化

应对推理能耗挑战需要全栈式的技术创新,从底层芯片到上层软件,每个环节的优化都能产生乘数效应。

芯片架构革新是基础。下一代AI芯片正从“以计算为中心”转向“以数据为中心”,通过近内存计算、存算一体等技术,减少数据搬运这一主要能耗来源。Graphcore的IPU芯片采用大规模并行处理架构,相比传统GPU在推荐系统推理任务上能效提升达40%。

模型架构轻量化是关键。小米发布的轻量化大模型,参数规模仅为主流模型的十分之一,但在多项基准测试中性能相当,推理速度提升5倍,能耗降低70%。这类“小而精”的模型更适合边缘设备与实时应用。

推理系统智能化是保障。智能调度系统能根据请求的紧急程度、模型复杂度和当前能源价格(如电网负荷高峰时电价更高),动态分配计算资源,实现成本与体验的最优平衡。

05 清洁能源:AI竞争的下一个“操作系统”

当推理成本持续下降,电力成本在总成本中的占比将愈发凸显。未来,拥有稳定、廉价清洁能源的地区将在AI竞争中占据结构性优势。

科技巨头们早已洞察这一趋势。谷歌承诺到2030年实现全天候无碳能源运营;微软不仅购买大量可再生能源,更直接投资下一代核能技术;亚马逊则成为全球最大的可再生能源企业采购商。

国内科技企业也在积极布局。百度在山西阳泉的数据中心采用太阳能与水力发电,年均PUE(能源利用效率)低至1.1;华为云在贵州的数据中心充分利用当地凉爽气候与水电资源,大幅降低冷却与电力成本。

这种能源优势正在转化为区域竞争力。挪威凭借丰富的水电资源,正成为欧洲AI公司的数据中心首选地;美国怀俄明州则利用廉价风电吸引科技巨头建设AI基础设施。

06 未来展望:绿色AI与可持续智能

推理革命正在推动AI行业向更高效、更绿色的方向发展。这场变革不仅是技术挑战,更是可持续发展的重要实践。

边缘计算与混合架构将成为主流。将简单推理任务下放到边缘设备,仅将复杂请求发送到云端,能大幅减少数据传输与集中式数据中心的能耗。据IDC预测,到2027年,超过50%的AI推理将在边缘端完成。

AI for Energy(AI赋能能源管理)正形成良性循环。AI技术本身被用于优化电网调度、预测可再生能源产出、管理数据中心能耗。谷歌利用DeepMind的AI技术优化数据中心冷却系统,实现了40%的能效提升。

政策与标准的引导作用日益凸显。欧盟的“能效先行”设计规范要求数据中心能效持续改进;中国也在制定AI计算能效标准,引导行业绿色发展方向。

推理革命的终局,不是一场零和博弈,而是AI技术与能源系统的协同进化。

国内在这场竞赛中拥有独特优势:强大的芯片自研能力、全球领先的可再生能源装机规模,以及集中力量办大事的制度优势。当西部地区的风能与太阳能通过“东数西算”工程,为东部的AI推理提供绿色动力,一幅高效、低碳的智能社会图景正徐徐展开。

推理能耗的挑战不是AI发展的终点,而是其真正成熟、走向普及的成人礼。

更多推荐

已为社区贡献28条内容

已为社区贡献28条内容

所有评论(0)