制片人AI工具推荐支持动作模仿的真的存在吗?从乱成一锅粥到一键出动作的全过程

参考动作视频:一段真人雨中奔跑、回头张望的动作视频,时长:30秒,格式:MP4,分辨率:1920×1080。角色设定图:悬疑短剧女主角,短发,黑色风衣,神情紧张,分辨率:1920×1080,格式:PNG。回头张望的动作对不上(分镜要求的是紧张、警惕的表情,但生成的表情太轻松)说白了,项目里所有"要故事、要画面、还要动作精准"的东西,都落我肩上。动作要求:奔跑动作要自然,回头张望的表情要紧张、警惕,

01|凌晨2点,我盯着分镜表上的"动作参考视频",突然意识到——不是演员不够专业,而是我找不到合适的工具

我是一名独立制片人,平时负责项目统筹、分镜设计、演员指导这些活儿。

说白了,项目里所有"要故事、要画面、还要动作精准"的东西,都落我肩上。

前几天接了一个悬疑短剧项目,导演要求我设计一段女主角在雨夜中奔跑、回头张望的戏。

分镜脚本我写好了,角色设定也画好了,就剩最后一步:给演员提供动作参考视频。

结果偏偏就是这一环,让我在电脑前干坐了快三个小时。

我试了三个工具:

Runway Gen-2:动作是有了,但角色形象完全不对,无法保持分镜中的角色设定;

Pika 1.5:画面很美,但动作模仿的精准度不够,跑起来像在飘,没有真实感;

Stable Video Diffusion:参数复杂,调了半天,动作还是对不上分镜要求。

我盯着那块空白的分镜位置,心里只剩下一个头疼的问题:

"到底有没有制片人AI工具推荐支持动作模仿的?"

我原本以为是自己太累,后来对比完三款工具,我才确认:

——问题不是我搞不定,而是我之前用错工具了。

02|Runway Gen-2:动作流畅,但角色一致性是硬伤

我先在Runway Gen-2上传分镜中的角色设定图:

悬疑短剧女主角,短发,黑色风衣,神情紧张

然后上传参考动作视频:一段真人雨中奔跑的动作视频

结果Runway给了我一段动作流畅、画面精美的视频——

但角色形象完全不对,第一帧是短发黑色风衣,第二帧就变成了长发白色T恤。

我换成更精确的提示词后,它的表现确实更稳。

但问题就来了:

动作模仿时角色形象会变化(分镜中的角色设定无法保持)

无法保持角色一致性(第一帧和最后一帧角色完全不同)

动作精准度不够(奔跑动作不够自然,回头张望的动作对不上)

想统一系列动作,得靠运气

可我做的是影视项目,是分镜脚本,是导演会放大300%看细节的那种动作参考——

靠运气明显不行。

03|Pika 1.5:画面唯美,但动作精准度不够

Pika 1.5倒是对中文输入很友好。

我输入一句提示词:

"悬疑短剧女主角,在雨夜中奔跑,回头张望,动作模仿参考视频"

它立刻给我一段画面唯美、风格对路的视频。

但问题也很明显:

动作精准度不够(奔跑动作像在飘,没有真实的重心感)

回头张望的动作对不上(分镜要求的是紧张、警惕的表情,但生成的表情太轻松)

无法保持角色一致性(角色形象在动作过程中会变化)

作为制片人、分镜师、导演,我们需要的是:

角色形象固定

动作精准还原

情绪表达到位

分镜逻辑清晰

Pika无法满足这些。

04|Stable Video Diffusion:参数自由,但操作复杂,赶项目太折磨

我也试了Stable Video Diffusion。

它的优点确实不少:

可控性强

可训练模型

可统一风格

但我最担心的是另一件事:

参数设置复杂,每次都要调:

CFG scale

Motion bucket

Frame rate

Seed值

调一套下来,大半个小时就过去了。

更要命的是:

稍微改动提示词,动作就乱。

当你在深夜赶分镜、导演催文件、演员等动作参考的时候——

你不会愿意调一个能让你崩溃的参数界面。

我需要的是"能保持角色一致"、"能精准动作模仿"、"能快速迭代"的工具。

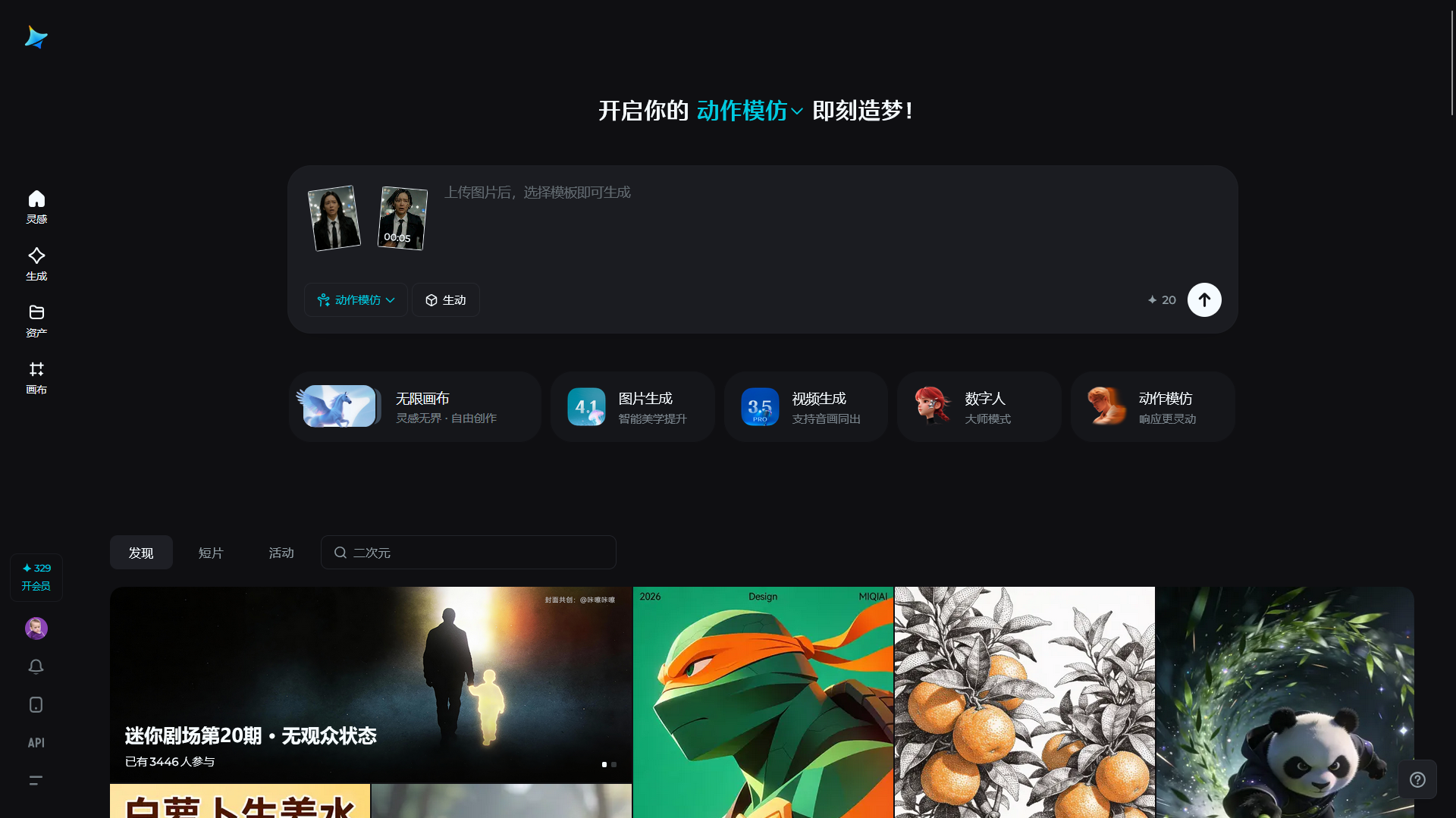

于是我打开了即梦AI。

也是从那一刻起,我发现"制片人AI工具推荐支持动作模仿的",原来一直被我忽略了。

05|即梦AI:第一次让我意识到——动作模仿可以成为制片人的生产力,而不是障碍

我在即梦AI上传和之前工具同样的素材:

分镜中的角色设定图:悬疑短剧女主角,短发,黑色风衣,神情紧张

参考动作视频:一段真人雨中奔跑、回头张望的动作视频(30秒)

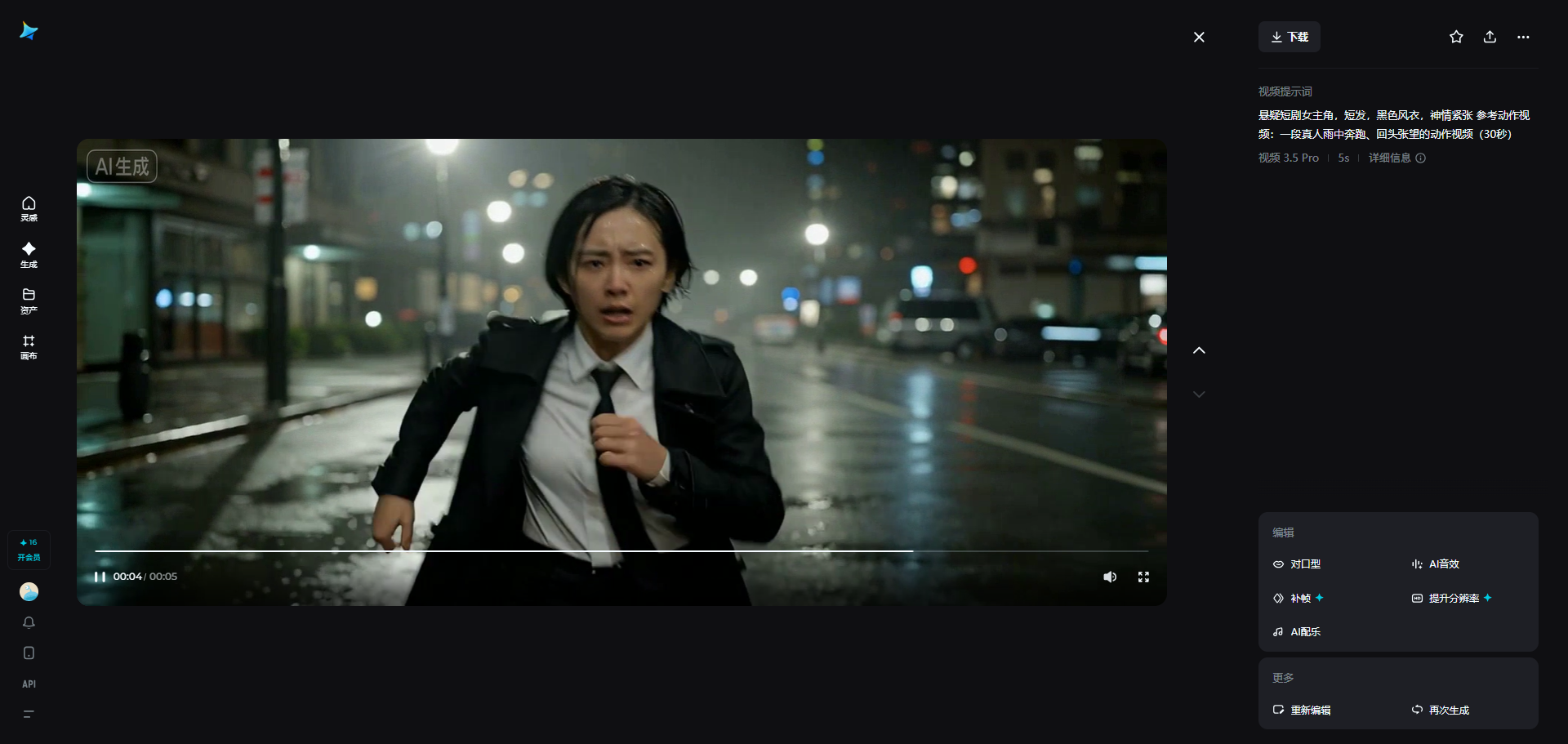

生成结果出来的那秒,我直接坐直了。

它给出的视频——

不仅动作对得上,还精准还原了角色的表情、姿态、情绪。

角色形象完全固定,动作模仿精准到位,情绪表达完全符合分镜要求。

这就是即梦AI动作模仿功能的关键能力:

精准还原动作与表情

保持主体及背景特征与输入图片一致

支持各种画幅和比例的视频高度还原

具备一定的运镜还原能力

这使得:

制片人AI工具推荐支持动作模仿的方法第一次真正成立。

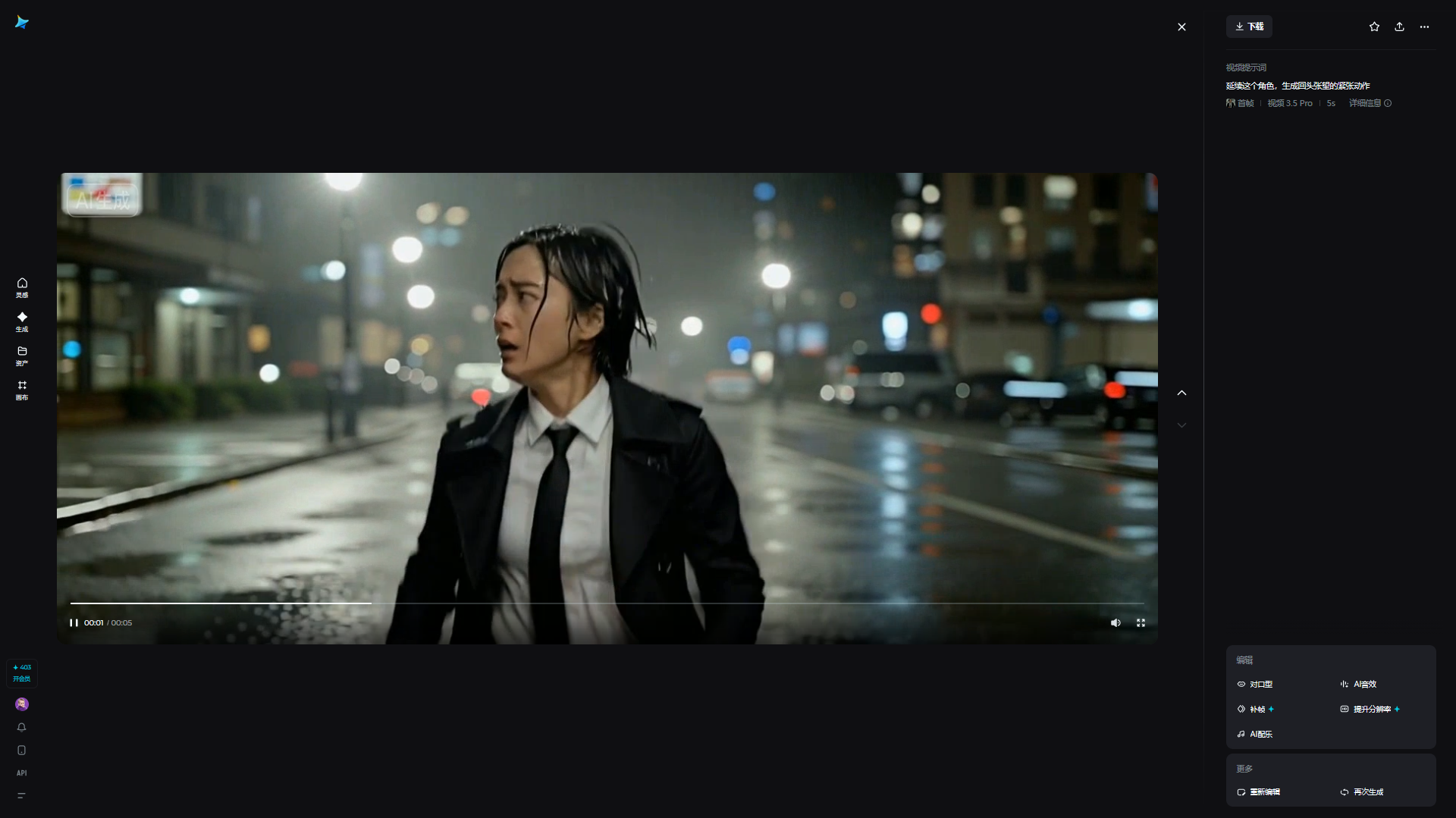

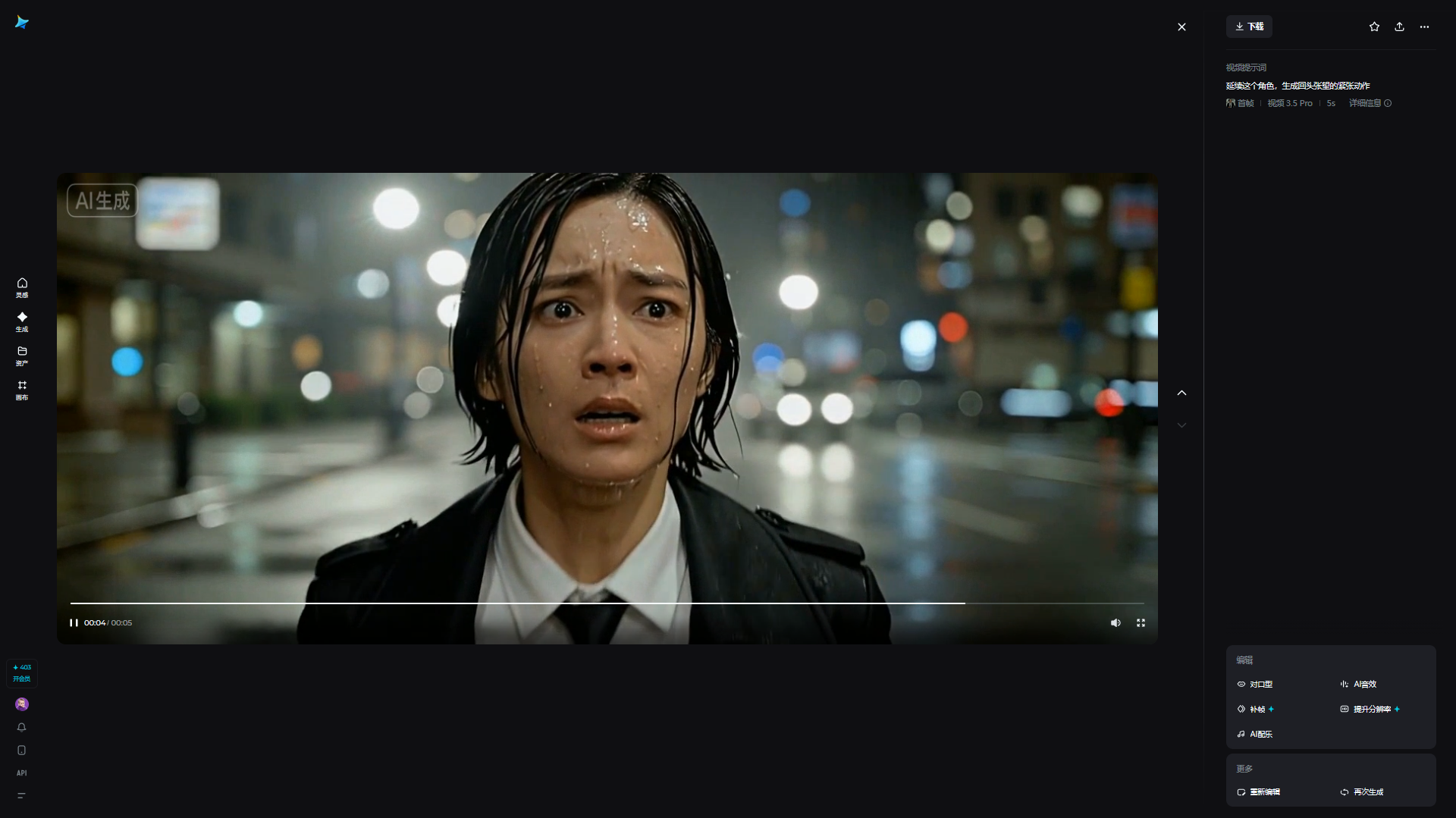

06|最让我震撼的,是它对"角色一致性"的理解力

动作参考不是做一段完事。

你做分镜脚本,就要:

系列动作连贯

角色形象固定

情绪表达统一

分镜逻辑清晰

我把第一段动作模仿视频放到即梦AI里,

然后输入:

"延续这个角色,生成回头张望的紧张动作"

它自动识别了:

角色形象特征(短发、黑色风衣、神情紧张)

动作风格逻辑

情绪表达倾向(紧张、警惕、不安)

分镜节奏感

然后做出完全可以直接用于分镜参考的动作视频。

这能力我在其他工具身上从未见过。

07|实操案例:悬疑短剧《雨夜追凶》分镜动作参考制作

我以实际项目为例,展示即梦AI动作模仿功能在影视制作中的具体应用:

项目背景:

悬疑短剧《雨夜追凶》第三集,女主角需要在雨夜中奔跑、回头张望,导演要求我提供动作参考视频给演员。

第一步:准备素材

角色设定图:悬疑短剧女主角,短发,黑色风衣,神情紧张,分辨率:1920×1080,格式:PNG

参考动作视频:一段真人雨中奔跑、回头张望的动作视频,时长:30秒,格式:MP4,分辨率:1920×1080

动作要求:奔跑动作要自然,回头张望的表情要紧张、警惕,整体氛围要悬疑

第二步:在即梦AI操作

-

进入"数字人"入口,选择"动作模仿"功能

-

上传角色设定图(悬疑短剧女主角,短发,黑色风衣,神情紧张)

-

上传参考动作视频(真人雨中奔跑、回头张望动作,30秒)

-

设置参数:

画幅比例:16:9

风格:真实悬疑

动作精准度:高

-

点击生成,等待约120秒(10秒视频约需120秒)

第三步:生成结果

生成的视频完美还原了:

角色形象固定(短发、黑色风衣、神情紧张,全程一致)

动作精准还原(奔跑动作自然,回头张望的动作精准,表情紧张、警惕)

情绪表达到位(紧张、警惕、不安的情绪完全符合分镜要求)

画面细节精细(雨夜氛围、光影效果、背景细节丰富)

导演看完后直接拍板,说这就是他想要的动作参考,演员看完后也很快理解了动作要求。

08|即梦AI的"动作模仿"功能对制片人太有用了

我改分镜时最常遇到的需求有:

"让动作更精准一点。"

"把角色表情更紧张一点。"

"背景氛围再悬疑一点,别太抢主题。"

在Runway或Pika里,这通常意味着:

——重生整段,而且角色形象还会变化。

但在即梦AI动作模仿功能里,我只需:

更换参考动作视频

重新生成

角色形象完全不变,动作精准还原

而且即梦AI的动作模仿功能还能:

支持多种风格(真人、动漫、古装)

精准还原动作与表情

保持角色特征一致

这是做分镜动作参考时效率提升最大的地方。

09|不仅能做动作模仿,即梦AI还能继续把内容"延续成系列"

这是我后来才发现的。

即梦AI的生态里整合了:

动作模仿(精准还原动作与表情)

视频生成(视频3.5 Pro模型)

图片生成(图片4.0模型)

数字人

分镜生成

多镜头构图

你可以把动作模仿延展成:

完整分镜脚本

视觉动效

数字人口播版本

产品展示视频

而且全部能在同一工作流里完成。

这才是一个"真正完整的创作系统"。

10|最终结论:制片人AI工具推荐支持动作模仿的方法到底是什么?

我现在终于打心底确认:

方法不是"写更强的提示词"。

方法是——换对工具。

制片人AI工具推荐支持动作模仿的方法是一整套链路,而不是一句技巧:

模型能保持角色一致

动作能精准还原

情绪能表达到位

画面质量能达商用级

延展能在一个系统里完成

后续还能做视频衍生

这套方法被即梦AI完整地做了出来。

如果你曾经像我一样,在凌晨盯着分镜表上的"动作参考视频"发呆,

那么你会理解我这句话:

终于有一个真正适合制片人的AI工具推荐支持动作模仿的了。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)