别再手写 LangChain 代码了!我用 Langflow,开发 AI Agent 就像画流程图。

摘要:LangChain框架虽强大但调试复杂,可视化工具Langflow(16.1k GitHub星)通过拖拽式界面简化AI应用构建。相比传统本地部署的繁琐步骤,Sealos云平台提供3分钟快速部署方案,支持公网访问。用户可轻松创建问答机器人等AI应用,实现"所见即所得"的开发体验,无需关注环境配置,专注AI逻辑创新。这种云端开发模式显著提升了开发效率。(149字)

我最近一直在研究 LangChain,这个强大的框架能将大语言模型(LLM)与外部工具和数据连接起来,创造出各种神奇的 AI 应用。但我很快发现,用代码构建复杂的 Agent 链,调试起来非常痛苦,整个逻辑流也不够清晰。

就在我快要被 Python 样板代码淹没时,我发现了 Langflow,一个在 GitHub 上爆火(16.1k Star)的可视化 AI 构建工具。

Langflow 是什么?

Langflow 是一个为 LangChain 量身打造的图形化界面(GUI)。它提供了一个类似流程图的画布,让你通过拖拽和连接的方式,来构建和实验你的 AI 应用。

它把复杂的代码变成了直观的模块:

-

可视化构建:将 LLM、提示词模板、输出解析器、工具等所有 LangChain 组件都变成了可以拖拽的节点。

-

实时调试:在画布上就能看到每个节点的数据流和输出结果,调试过程前所未有的直观。

-

快速实验:可以轻松替换不同的模型、调整不同的提示词,快速迭代你的想法。

-

一键导出:设计完成后,可以将整个流程图导出为可运行的 Python 代码或 JSON 文件。

传统部署方式

想要在本地运行 Langflow,你需要一个标准的 Python 开发环境:

-

管理虚拟环境:为了避免依赖冲突,你最好创建一个虚拟环境(如 venv 或 Conda)。

-

安装依赖:通过

pip install langflow命令安装,但往往还需要根据你的需要安装openai、huggingface_hub等额外的库。 -

命令行启动:在终端运行

langflow命令来启动 Web 服务。 -

无公网访问:默认只在本地运行,如果想分享给别人或在公网上访问,就需要做复杂的内网穿透或反向代理配置。

在 Sealos 上体验“云端”AI 画布

通过 Sealos,你可以跳过所有本地环境的折腾,在 3 分钟内拥有一个可以在任何地方访问的 Langflow 画布。

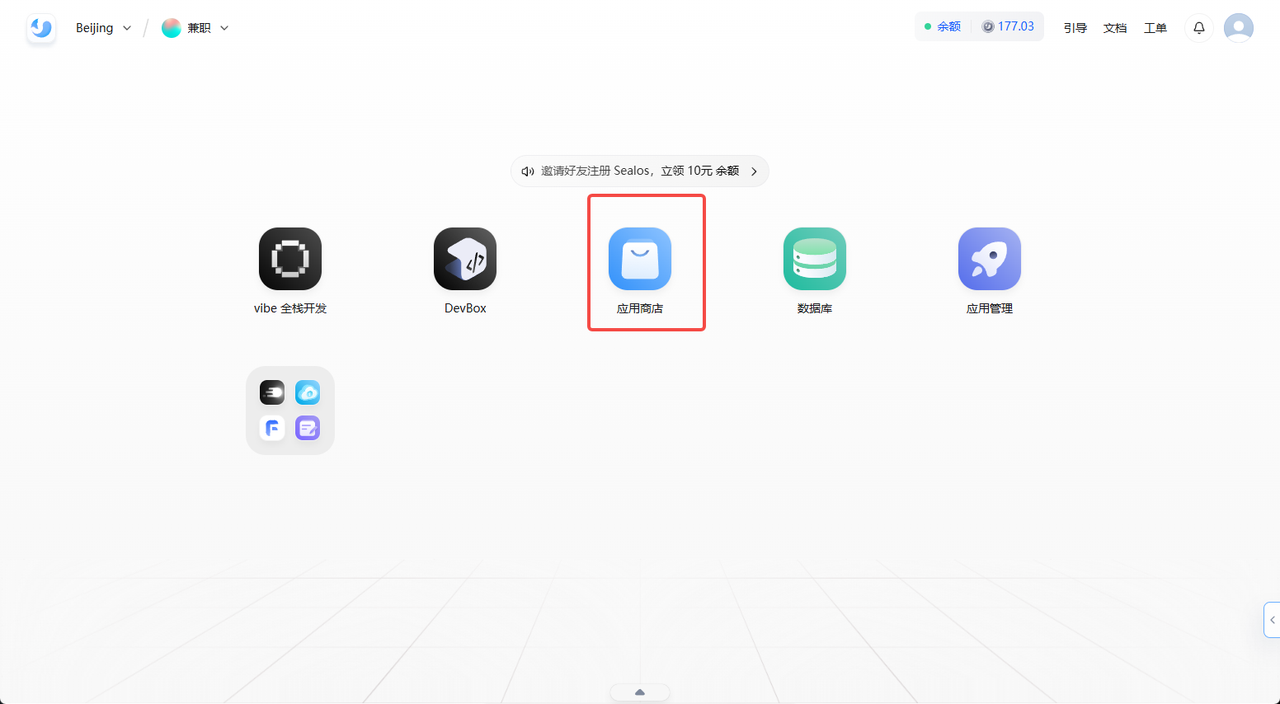

第一步:进入 Sealos 应用商店

登录你的 Sealos 桌面,点击“应用商店”。

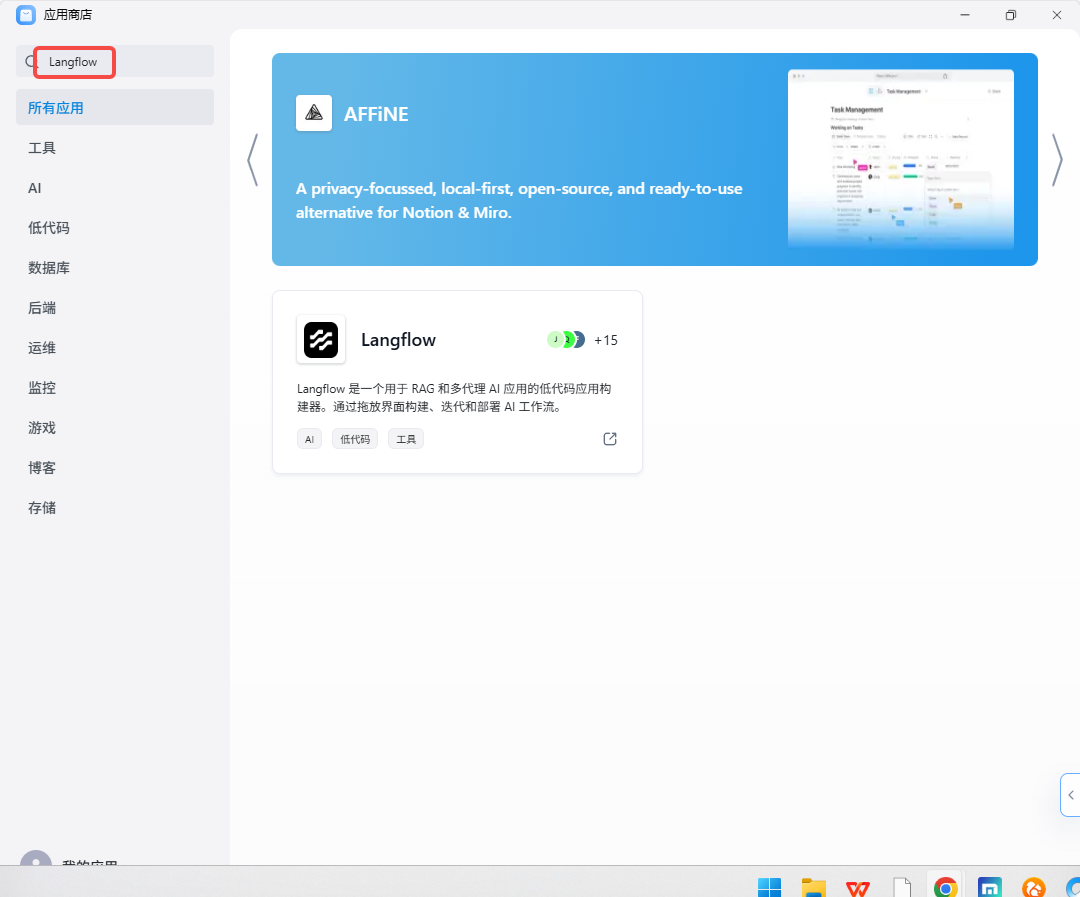

第二步:搜索 Langflow

在搜索框中输入 Langflow,点击卡片进入应用详情页。

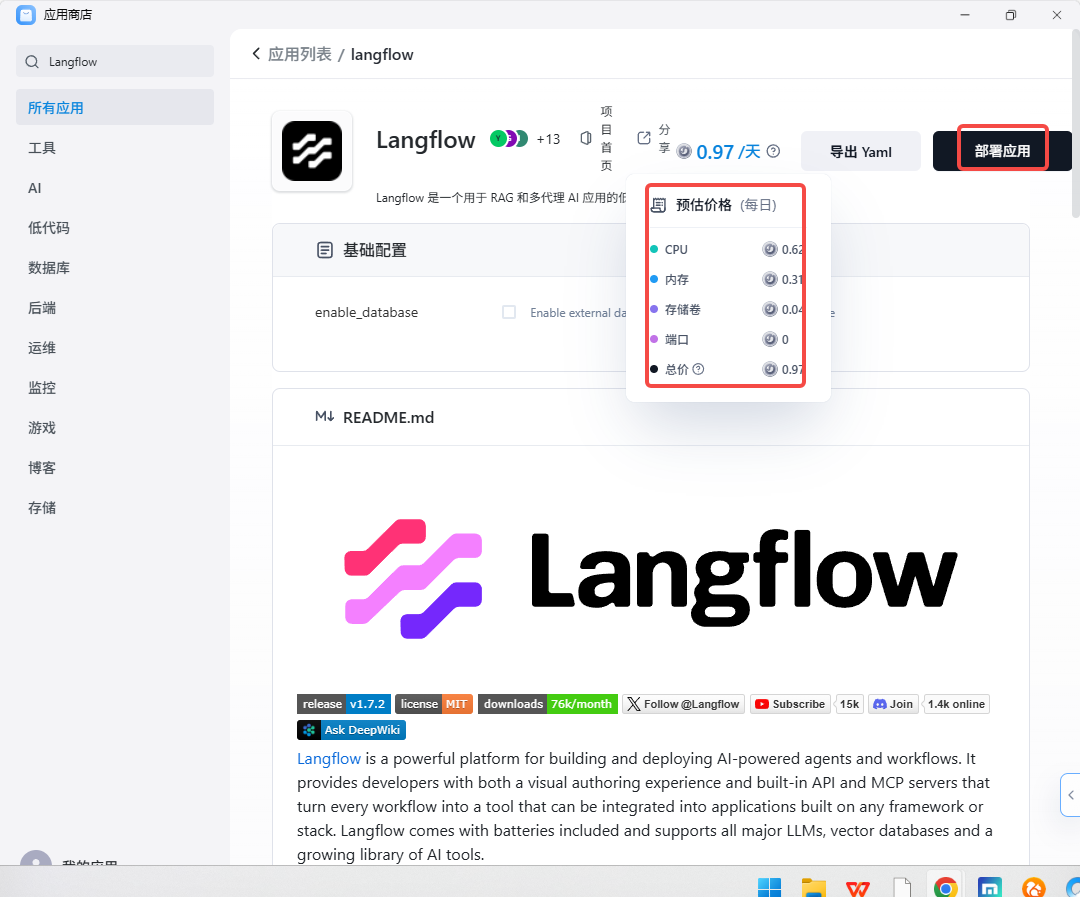

第三步:一键部署

Langflow 在 Sealos 上的部署非常简单,没有任何需要预填的配置。查看一下预估的日费用,然后直接点击右上角的“部署应用”。

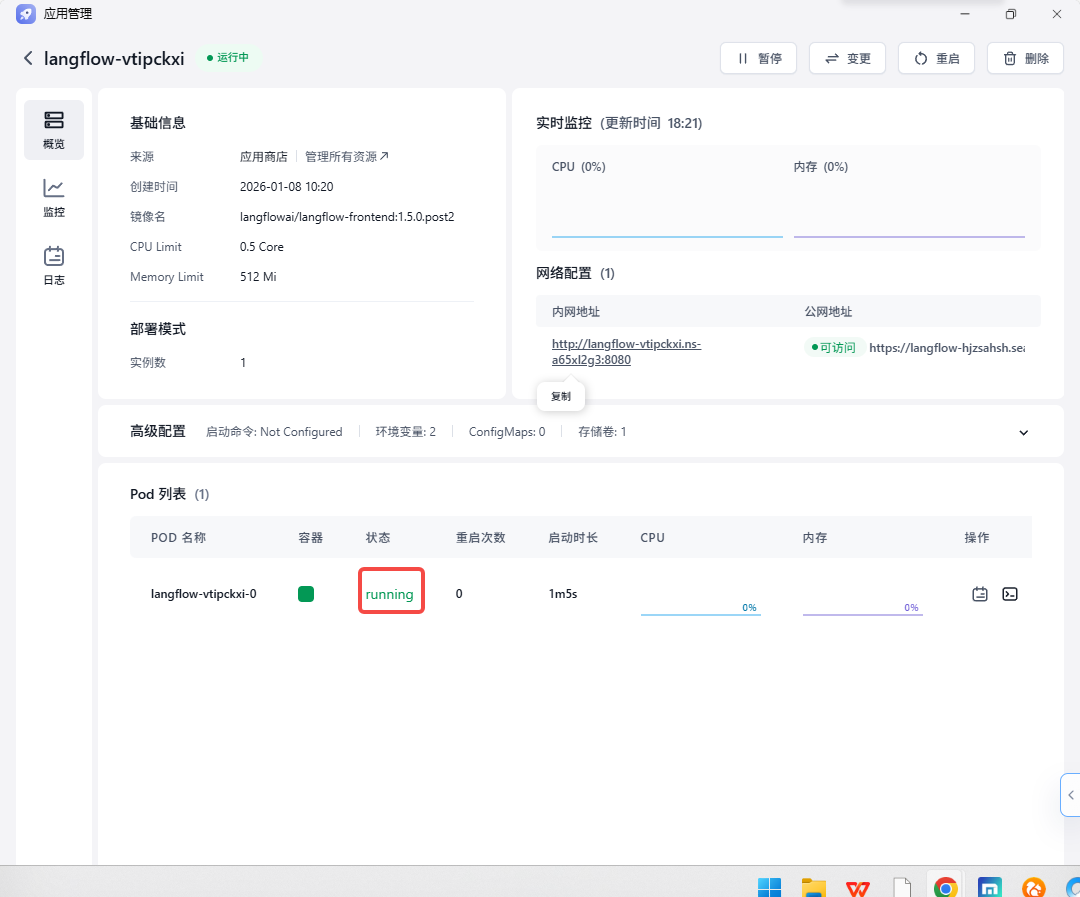

第四步:等待画布生成

Sealos 的自动化系统会处理好所有事情。大约 1-2 分钟后,应用状态会变为绿色的 Running。这意味着你的云端 AI 实验平台已经搭建完毕。

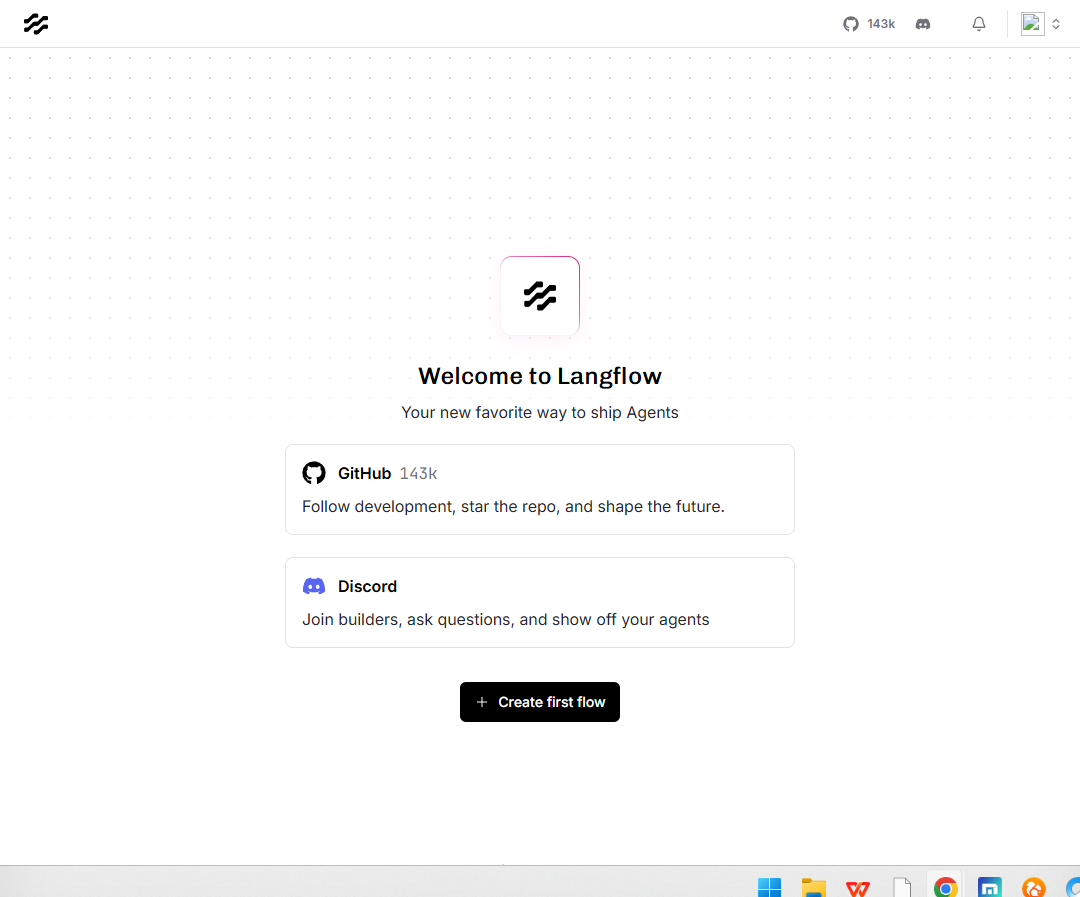

快速上手:构建你的第一个 AI 应用

部署成功后,我们来快速构建一个简单的问答机器人。

-

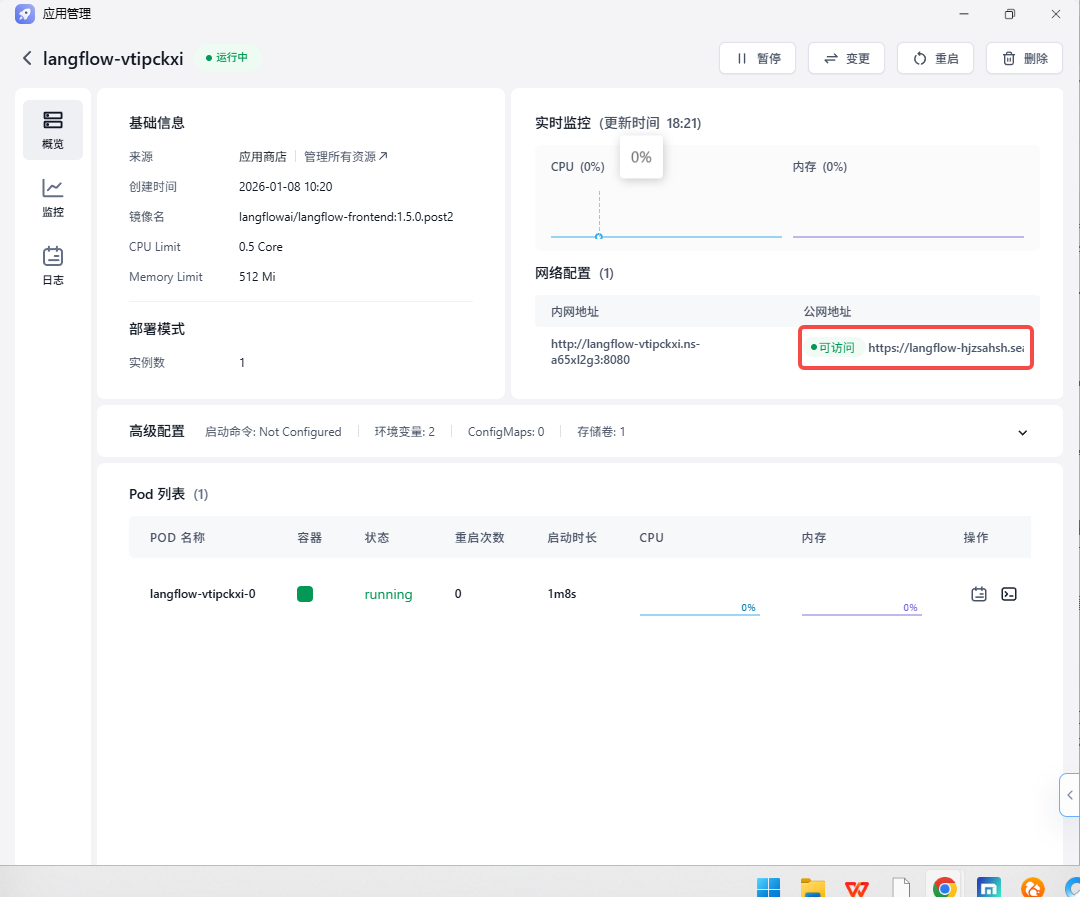

访问 Langflow:在 Sealos 的应用详情页,找到“网络配置”,点击公网域名,进入 Langflow 的画布界面。

-

拖拽组件:

-

从左侧的组件栏里,找到

Prompts->PromptTemplate,把它拖到画布上。

-

再找到

LLMs->OpenAI,也把它拖到画布上。

-

-

配置组件:

-

点击

PromptTemplate节点,在右侧的配置栏里,Template字段输入:“{input}的首都是哪里?” -

点击

OpenAI节点,在右侧的配置栏里,找到OpenAI API Key字段,填入你自己的 OpenAI API 密钥。

-

-

连接并运行:将

PromptTemplate节点的输出圆点拖拽连接到OpenAI节点的输入圆点上。然后点击画布右下角的闪电图标,在弹出的聊天框中输入“中国”,回车。

片刻之后,你就能看到 AI 的回答了。恭喜,你已经用拖拽的方式构建并运行了你的第一个 LLM 应用!

总结

Langflow 真正实现了“所见即所得”的 AI 开发体验,它将我的许多想法从复杂的代码草稿变成了可以快速验证和分享的可视化流程。

Sealos 应用商店则让我可以随时随地打开浏览器就开始创作,而无需关心任何本地环境配置的烦恼。这种“云端开发”的模式,让我能更专注于 AI 逻辑本身。如果你也对构建 LLM 应用感兴趣,但又被繁琐的代码所困扰,那么 “Sealos + Langflow” 这对组合绝对值得一试。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)