旺知识:2025年搜推广多模态大模型表征和创意生成技术业界进展与趋势-Google、Meta、阿里、字节

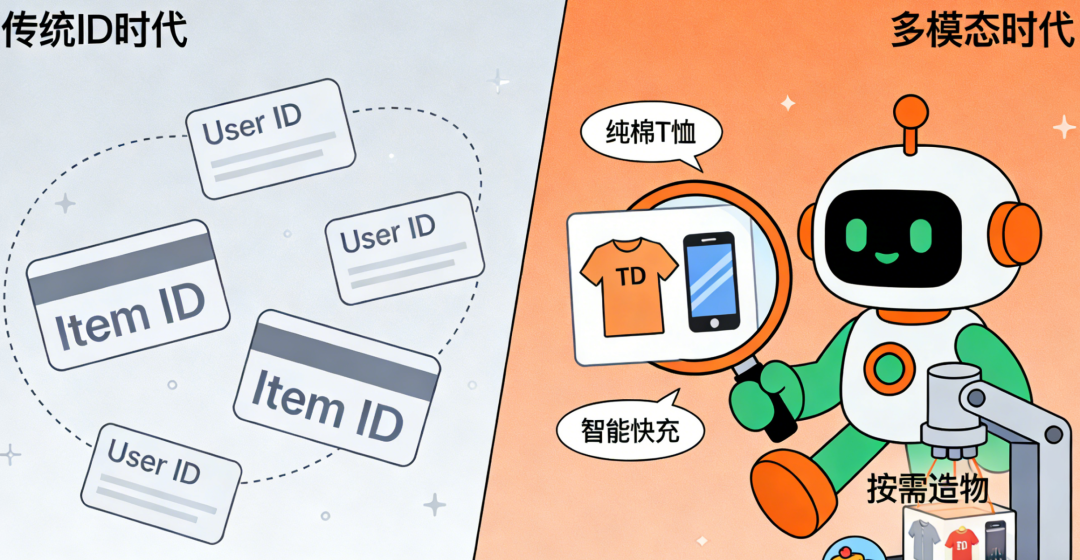

在当前以大模型为核心驱动力的 AI 时代,搜索、广告与推荐(统称为“搜推广”)领域正经历着从“以 ID 标签特征为中心”向“以内容语义为中心”的范式跃迁。传统的推荐系统长期依赖于稀疏的 ID 特征(如 User ID、Item ID),这种模式虽然在处理大规模点击率预测任务中具有极高的计算效率,但随着业务深入,其在冷启动、长尾内容分发以及跨领域迁移方面的局限性日益凸显。

在当前以大模型为核心驱动力的 AI 时代,搜索、广告与推荐(统称为“搜推广”)领域正经历着从“以 ID 标签特征为中心”向“以内容语义为中心”的范式跃迁。传统的推荐系统长期依赖于稀疏的 ID 特征(如 User ID、Item ID),这种模式虽然在处理大规模点击率预测任务中具有极高的计算效率,但随着业务深入,其在冷启动、长尾内容分发以及跨领域迁移方面的局限性日益凸显。

多模态表征技术通过对图像、文本、音频等非结构化数据的深度挖掘,为理解用户真实意图和内容深度语义提供了关键技术路径,突破了受限于原有ID标签类特征的搜推广系统效果天花板,促成了创意生成技术的成熟落地,驱动互联网服务场景用户体验和商业价值显著提升。

Google Ads: “In the past year alone, Demand Gen has seen a 26% increase in conversions per dollar driven by 60+ AI-powered improvements to ramp time, bidding and other updates you may not have heard about.[2] (仅在过去一年,60多项人工智能技术增强的Demand Gen的每美元转化率提高了26%。)”

本文将介绍和洞察Meta、阿里、字节、Google的最新相关技术进展:

多模态表征和创意生成技术正在重新定义搜推广领域的“游戏规则”:他们不仅是解决数据稀疏性的手段,也是内容理解跨越到“深层语义”关键,更是将搜推广从单纯的“意图匹配”推向了“意图创造”的新阶段。

Google Ads: “Demand Gen helps you create and convert demand on YouTube and Google’s most visual, immersive surfaces when consumers aren’t searching for you [3]. (Demand Gen可帮助您在消费者未搜索您时,在YouTube和谷歌最具视觉效果、沉浸感最强的平台上创造并转化需求。)”

很高兴看到我们2年前对于大模型+搜推广技术发展预测的观点,包括一些在当时看来相当大胆的预测“预训练推荐模型成为新的推荐技术演进趋势”、“一个大模型端到端完成广告推荐任务,打开更高推荐效果优化空间,原有经典多环节推荐系统不再是唯一的选择”、“实现真正强个性化内容,展现的广告和内容根据用户画像和行为实时生成”等到2026年这个时间节点,终于逐渐变成行业共识并在Google、Meta等领先厂商落地创造显著用户体验和商业价值。

因为文章里面还有一些更大胆的预测,现在还不是行业共识,但我们认为未来还是有很大可能会成为行业共识并极大化推进大模型+搜推广技术和产品进步。比《Google | Gemini 3与广告创意的生成式革命》章节的Google工作也是仅仅实现了如我们下面的预测的前序步骤“利用多模态信号捕捉潜客意图”,未来还有非常大的技术和产品突破空间可以继续演进和探索:

旺知识@2023:“这种未来形态的全生成广告推荐系统,如果能够实现强个性化内容+新需求和趋势发现将能够对于未来广告和推荐的产品形态也带来革命性的影响:广告推荐系统将不仅仅能够用于推销已有商品,同时还能够引导新商品的定制和研发[4]。”

旺知识@2023:“我们这里畅想一个例子。比如,推荐系统发现小明对于T恤、王者荣耀游戏都感兴趣;那么系统可以大胆生成一系列的-“王者荣耀英雄T恤”,并把这些新商品推荐给用户;如果用户点击购买个某个新商品,订单将直接下发后台工厂进行定制加工和出货。如果有大量用户都对于这个新商品感兴趣,那这个商品可以变成一个标品,让工厂大批量生产和发货。[4]。”

现在,站在这个多模态大模型技术推动搜推广技术和产品突破的关键时间节点,我们对2025年Google、Meta、阿里、字节的多模态表征和创意生成技术最新代表性进展和发展趋势进行洞察分析,希望对大模型+搜推广领域的研发和决策带来有用的信息参考。

1. 研究背景:ID、见图知意、按需造物

搜推广领域的技术演进始终围绕着如何更精准地建模“用户-环境-内容”之间的复杂交互。在传统的 CTR(点击率)预测模型中,稀疏 ID 特征(Sparse Features)占据主导地位。通过 Embedding 技术,海量的离散 ID 被映射到低维稠密向量空间,模型学习这些向量之间的共现关系来捕捉用户的偏好 。

然而,随着互联网内容形式从纯文字向短视频、直播、沉浸式电商的转变,单纯依靠 ID 特征已经难以满足业务需求。 首先, ID 特征天然存在稀疏性问题。对于一个新上架的商品或新发布的视频,由于缺乏历史点击反馈,模型无法生成高质量的 ID Embedding,导致所谓的“冷启动”难题 。其次, ID 特征无法捕捉内容的“原生语义”。这种语义的缺失限制了推荐的泛化能力和解释性 。

在此背景下,多模态表征学习(Multimodal Representation Learning)成为突破瓶颈的关键。通过将图像、视频帧、标题、语音等多种模态映射到统一的语义空间,模型可以实现“见图知意”,即便在没有 ID 反馈的情况下,也能根据内容的视觉和语义相似性进行精准分发 。 此外, GPU 计算能力的指数级增长和多模态大语言模型(MLLM)的成熟,使得在工业界大规模部署稠密多模态表征成为可能 。

在此背景下,多模态表征学习成为突破瓶颈的关键。这种技术不仅用于“召回”和“排序”,更延伸到了“生成”端。例如,Google Gemini 提供的生成式底座,能够基于对物理世界逻辑的深度建模,全自动生成符合品牌审美且逻辑自洽的视觉素材。这意味着模型不仅要“见图知意”,更要“按需造物”。 GPU 算力的增长与 Gemini 等原生多模态大模型的成熟,使得这种“生成式表征”+“生成式创意”从实验室走向了工业界的大规模应用。

2. 业界进展:Meta、阿里、字节、Google

2.1 Meta:从生成式广告模型到思维增强表征

Meta 在多模态表征领域的探索体现了其在生成式 AI 与广告系统深度融合方面的野心。其研究不仅关注表征的精确性,更强调如何通过“生成式能力”来反哺“表征质量”。

Meta 生成式广告模型(GEM)的中央大脑架构

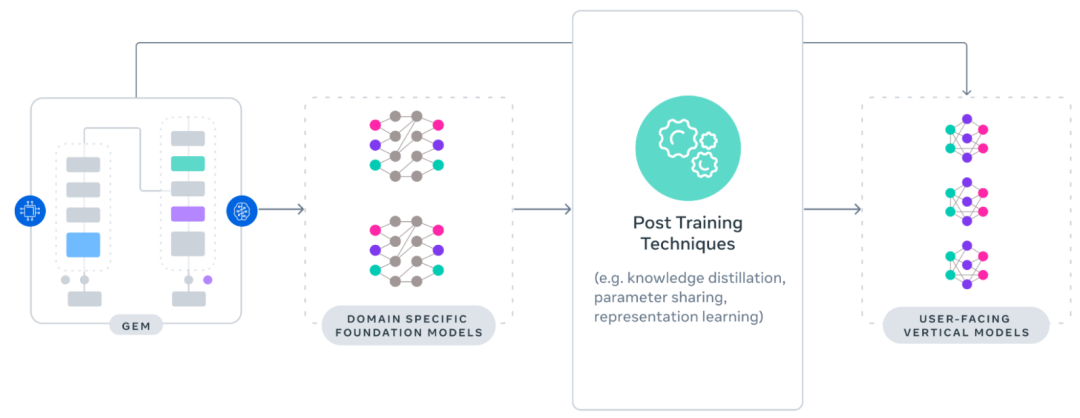

Meta 在其工程实践中推出了生成式广告模型(GEM),将其定义为加速广告推荐 AI 创新的“中央大脑” 。

研究背景:

Meta 的广告系统需要处理分布在全球的数亿个创意素材。传统的做法是为创意生成、受众匹配、出价优化分别训练小模型,导致技术栈割裂,难以共享底层语义理解。 GEM 的出现是为了建立一个统一的生成式底座。

技术创新:

GEM 的核心创新在于其将生成式 AI 与传统的推荐判别式任务进行了深度对齐。它不仅仅是一个生成文案或图片的工具,而是一个能够感知多模态语境的决策引擎。通过在中央大脑中预集成多模态语义信息, GEM 可以为下游的所有推荐任务提供一致的、高阶的语义表征。

实验效果:

GEM 显著加速了 Meta 内部 AI 功能的迭代效率。在 Instagram 和 Facebook 的初步部署中, GEM 已带来 3% 到 5% 的广告转化率提升。 Meta 宣称 GEM 驱动广告性能增益的效率比其原始排名模型高出约 4 倍 [5]。

Meta: “Since launching GEM earlier this year, GEM’s launch across Facebook and Instagram has delivered a 5% increase in ad conversions on Instagram and a 3% increase in ad conversions on Facebook Feed in Q2 [5]. (GEM在Facebook和Instagram上的投放使第二季度Instagram的广告转化率提高了5%,Facebook Feed的广告转化率提高了3%。)”

Meta:“GEM overcomes these challenges through: A scalable model architecture that is now 4x more efficient at driving ad performance gains for a given amount of data and compute than our original ads recommendation ranking models [5]. (GEM其可扩展的模型架构在给定数据量和计算量的情况下,在推动广告效果提升方面比我们最初的广告推荐排名模型效率提高了4倍。)”

洞察思考:GEM显著加速了Meta内部AI功能的迭代效率。通过这种“中央大脑”模式,Meta能够将最先进的多模态理解能力快速同步到全球的广告投放链路中 。从行业视角看,GEM代表了广告系统架构的未来趋势:不再将AI视作单一的特征提取器,而是将其作为系统的智能内核,统领从内容创作到精准投放的全过程。

Think Then Embed:生成式推理增强表征

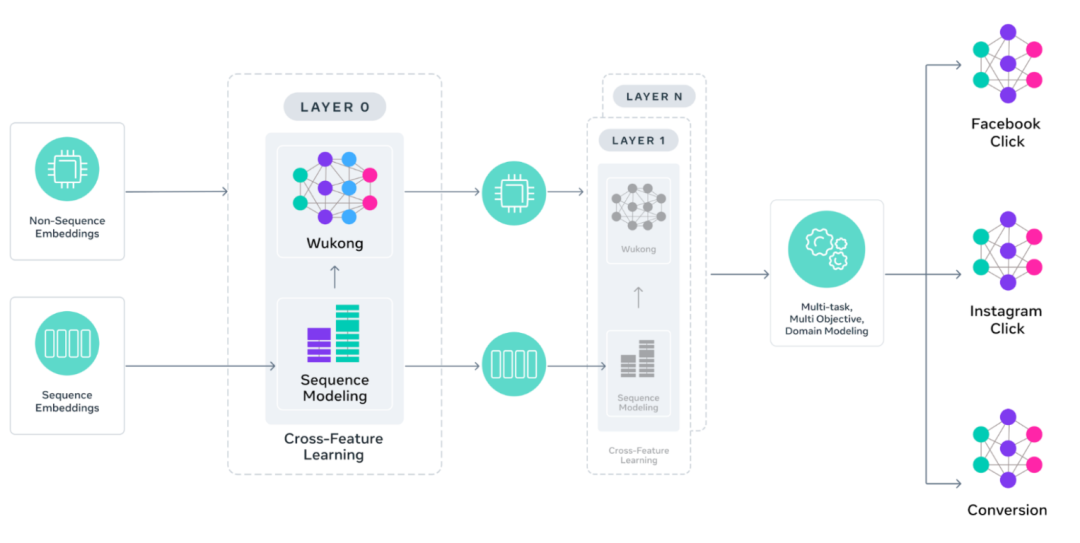

针对多模态表征在处理复杂指令时的乏力表现, Meta 提出了“先思考,后表征”(Think Then Embed, TTE)框架 。

研究背景:现有的通用多模态表征模型(UME)多将MLLM视作静态的特征提取器,忽视了其强大的生成推理能力。当遇到需要组合推理的复杂指令(如“检索那张左侧有红色建筑、右侧有蓝色水池的图片”)时,传统的直接编码方式往往无法捕捉细粒度的空间关系 。

技术创新:

TTE 引入了一个范式转变:它在生成表征向量之前,先让模型进行显式的“思维链(CoT)”推理 。

- • 推理阶段(Thinking Phase): 引入一个推理器(Reasoner MLLM),针对输入的指令和多模态内容生成详细的中间推理轨迹(Embedding-Centric Reasoning, ECR) 。

- • 表征阶段(Embedding Phase): 编码器(Embedder)在原始查询和 ECR 的基础上生成最终表征 。

- • 单次推理优化: 为了解决效率问题,通过在推理器之上训练一个可插拔的表征头,实现了单次前向传播中同时完成推理和表征生成 。

实验效果:

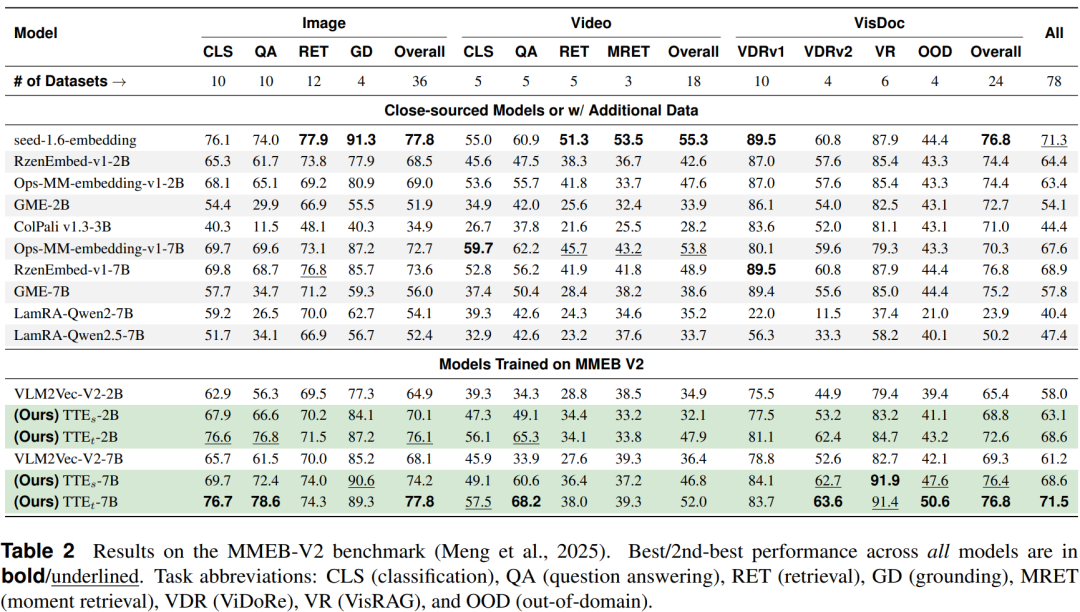

在多模态表征领域的权威基准测试 MMEB-V2 上,基于 TTE 框架的模型取得了显著突破。TTE_t-7B 模型以 71.5% 的综合得分创下新纪录,超越了诸多在海量私有数据上训练的闭源模型(如 seed-1.6-embedding 的 71.3%) 。实验证明,ECR不仅提升了复杂指令下的检索精度,即便推理过程存在噪声,模型依然能从中提取出关键的语义特征,带来 1% 到 2% 的额外性能提升 [6]。

洞察思考:TTE的成功证明了“生成即表征”的可能性。在大模型时代,向量空间不应再被视为一个被动投影的产物,而应该是模型主动思考后的浓缩,智能体表征(Agentic Embedding)、推理增强表征为多模态表征提供了新的技术演进方向和效果优化空间。 这种将自然语言推理与稠密向量检索相结合的路径,为解决搜推广中的“语义鸿沟”提供了极具价值的参考方案 。

2.2 阿里巴巴:电商场景下的超大规模多模态实践

阿里巴巴(阿里妈妈及淘宝技术团队)在电商领域的应用不仅强调表征的广度,更注重在超长行为序列和百亿级商品池下的工程落地与效果转化。

MOON:电商多模态表征感知与认知的范式跃迁

阿里妈妈团队开发的面向电商领域商品理解的通用多模态表征模型MOON(Multimodal Representation Learning for E-commerce Product Understanding) ,标志着电商产品理解从传统的图文匹配转向了基于 MLLM 的深度感知。

研究背景:在淘宝搜索广告场景中,团队发现传统的 CTR 模型由于过度依赖 ID 特征,在面对海量冷启动商品和多变的用户审美偏好时,表现出明显的增长瓶颈。用户点击行为在很大程度上是由“视觉所见”驱动的,因此需要一种能真正理解商品视觉属性(如面料感、剪裁风格、排版逻辑)的原生多模态模型 。

技术创新:

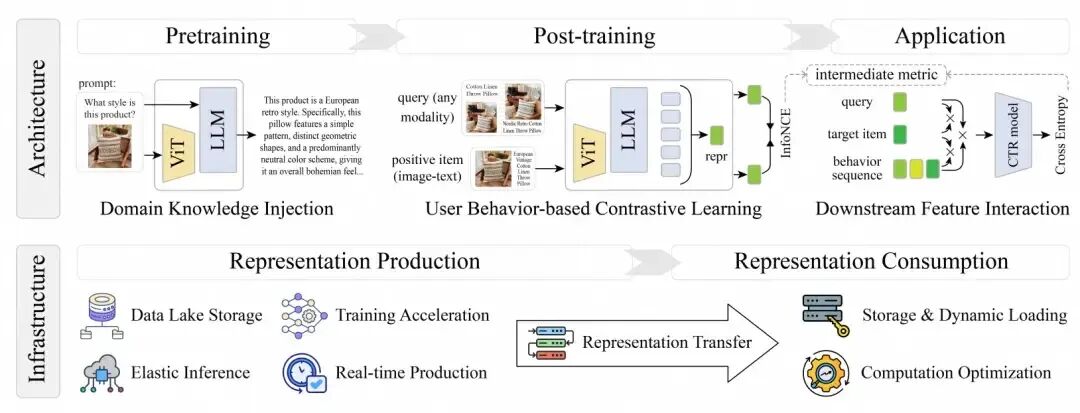

- • 三阶段范式(PreTrain-PostTrain-Application): MOON 并不追求端到端的训练,而是通过解耦表征学习与下游任务,实现了模型规模的有效扩展 [1]。

- • 后训练(PostTrain)与对齐指标: 这是 MOON 的核心贡献。团队发现传统的对比学习并不能完全反映用户的点击意图,因此引入了“图搜召回率”作为关键的中间评价指标,并设计了专门的 PostTrain 阶段将商品内容空间与用户点击兴趣空间进行对齐 [1]。

- • 模型架构优化: 采用引导式专家混合模块(Guided MoE)来处理不同模态和不同方面的商品内容,并通过视觉定位(Visual Grounding)技术减弱背景噪声对产品表征的干扰 [7]。

实验效果:自2023 年全量上线以来,MOON多模态表征已完成五次重大迭代,累计带来大盘CTR+20%的显著提升,是搜索广告近3年最大可持续优化的提效方向 [1]。 目前,该表征模型已成为整个搜索广告链路的“基础设施”,在召回、相关性计算、排序和创意自动生成等环节得到全面应用 [1]。MOON 的参数规模已扩展至 40 亿量级,并在 2.4 万亿 Token 的海量数据上完成了预训练,验证了在搜推广领域同样存在“Scaling Law” [1]。

阿里妈妈: “MOON…电商领域商品理解的通用多模态表征…目前已全面应用到手淘搜索广告场景全链路的各个阶段…自 23 年以来共全量 5 期,累计带来大盘CTR+20%的显著提升,是搜索广告近3年最大可持续优化的提效方向 [1]。”

洞察思考:MOON 的成功揭示了稠密多模态表征与稀疏 ID 模型并非竞争关系,而是互补关系。通过多阶段解耦,稠密模型可以学习通用的语义知识,而稀疏模型负责捕捉高频的统计信号,两者协同作用可释放出巨大的商业价值 。

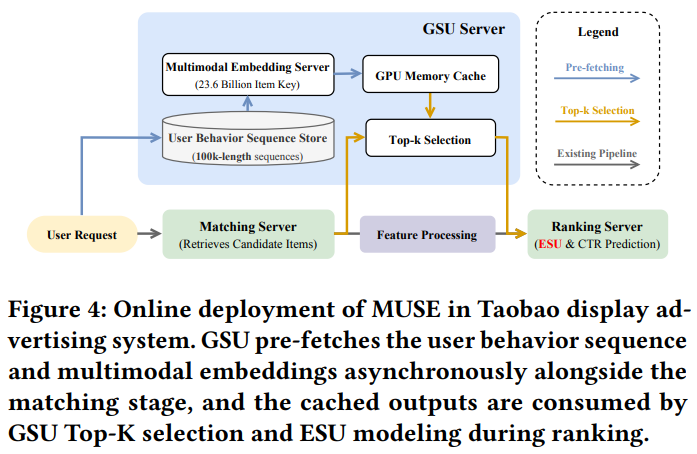

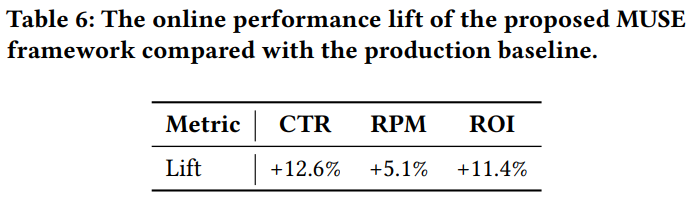

MUSE:用多模态解决十万级超长行为序列建模

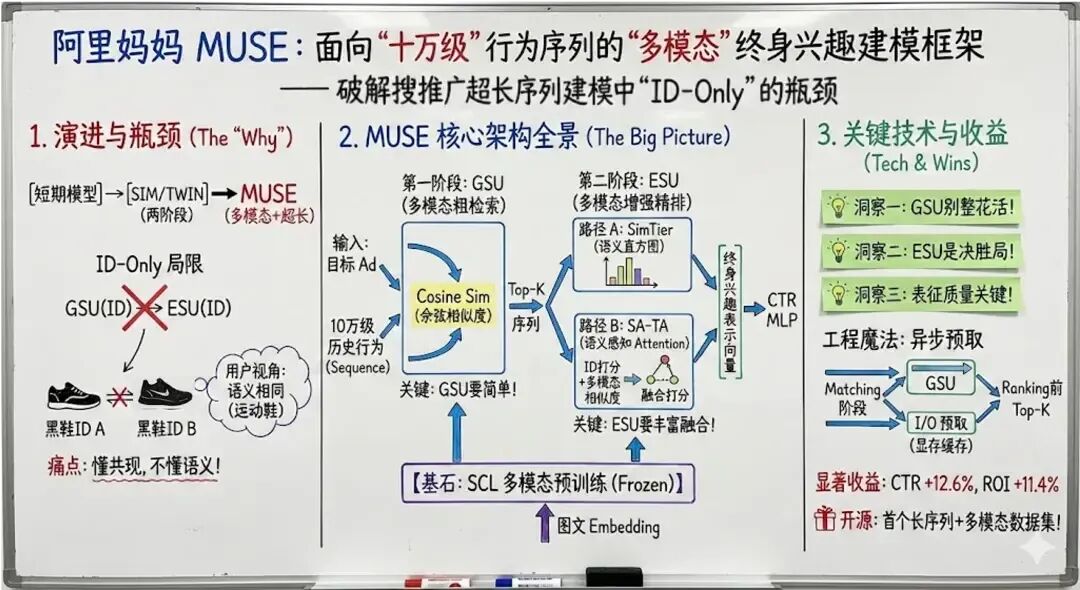

为了捕捉用户的终身兴趣,阿里巴巴推出了 MUSE 框架,旨在解决长序列建模中的信息损失和计算瓶颈。

研究背景:推荐系统常受困于“短期健忘”。虽然现有框架(如 SIM)尝试引入万级历史序列,但受限于计算资源,往往只能处理简化的 ID 特征。一旦序列长度扩展到十万甚至百万级,ID 过于稀疏的问题会导致建模效果严重下降,且海量数据的读取会造成巨大的 I/O 延迟 。

技术创新:

-

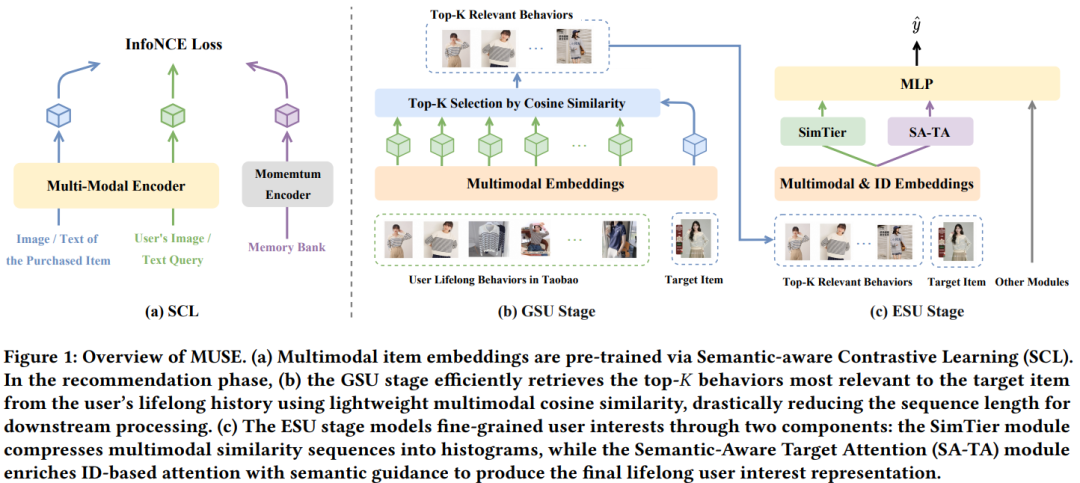

• 轻量化通用搜索单元(GSU): MUSE 提出了“大道至简”的观点。在第一阶段(GSU)中,不再使用复杂的检索模型,而是直接利用高性能的多模态 SCL 表征进行简单的余弦相似度计算 [8]。

-

• 语义感知对比学习(Semantic-aware Contrastive Learning, SCL): 开发了一种利用“搜索-购买”全路径行为进行预训练的方法,基于 “搜索 - 购买” 行为构造正样本,使生成的图像表征向量天然具备语义相关性和行为相关性 [8] 。

-

-

• 多模态增强精确搜索单元(ESU):

- • SimTier模块: 将历史行为的多模态相似度序列转化为紧凑的直方图,捕捉用户兴趣的多层次语义分布 [8]。

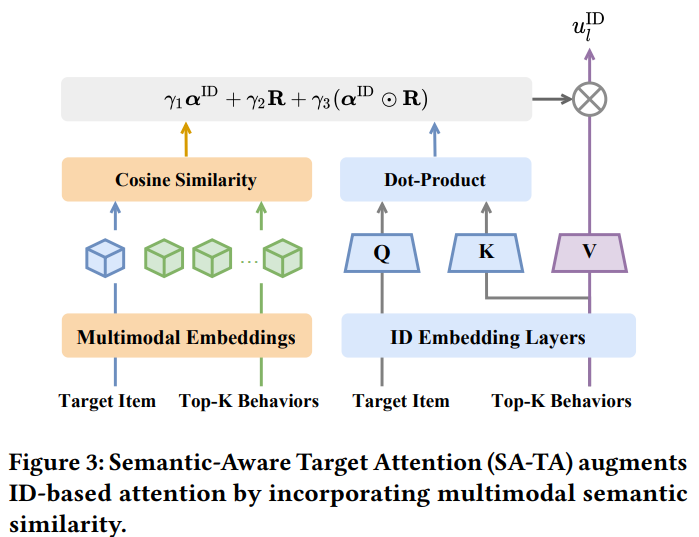

- • 语义感知目标注意力 (Semantic-Aware Target Attention, SA-TA): 将多模态余弦相似度直接注入 ID 基础的 Attention 机制中,使得模型能识别出那些 ID 虽然冷门但语义与目标商品高度相关的历史行为 [8]。

- • 高效异步预取(Asynchronous Pre-fetching): 通过将多模态表征向量的读取与打分阶段并行化,实现了在处理 10 万长度序列时 GSU 对端到端延迟几乎是 “隐身” 的 。

实验效果:MUSE 在淘宝展示广告排序模型中实现了全面部署。在线 A/B 测试显示,CTR 提升了 12.6%,RPM(千次展现收入)提升了 5.1%,ROI(投资回报率)提升了 11.4% [8]。 实验进一步证实,随着历史序列长度从 1 万增加到 10 万,MUSE 相较于纯 ID 模型的优势越来越显著 。同时,阿里开源的 Taobao-MM 数据集包含了 1 亿个样本,900 万用户,3500万商品的128维高质量多模态表征,填补了学界缺乏大规模多模态长序列数据的空白 [8]。

洞察思考:MUSE 的核心洞察在于,在长序列建模中,“语义相关性”是比“ID 共现”更稳定的锚点。当用户的历史足迹跨越数年时,ID 可能会失效,但用户对“极简风”或“户外运动”的视觉偏好是具有持久性的。多模态表征正是捕捉这种跨时空兴趣的最佳媒介 。

2.3 字节跳动:全模态表征基础模型的领先实践

作为全球顶尖的内容分发平台,字节跳动(抖音SAIL团队)在处理短视频这种高度复杂的数据流时,展现了极强的多模态融合能力。

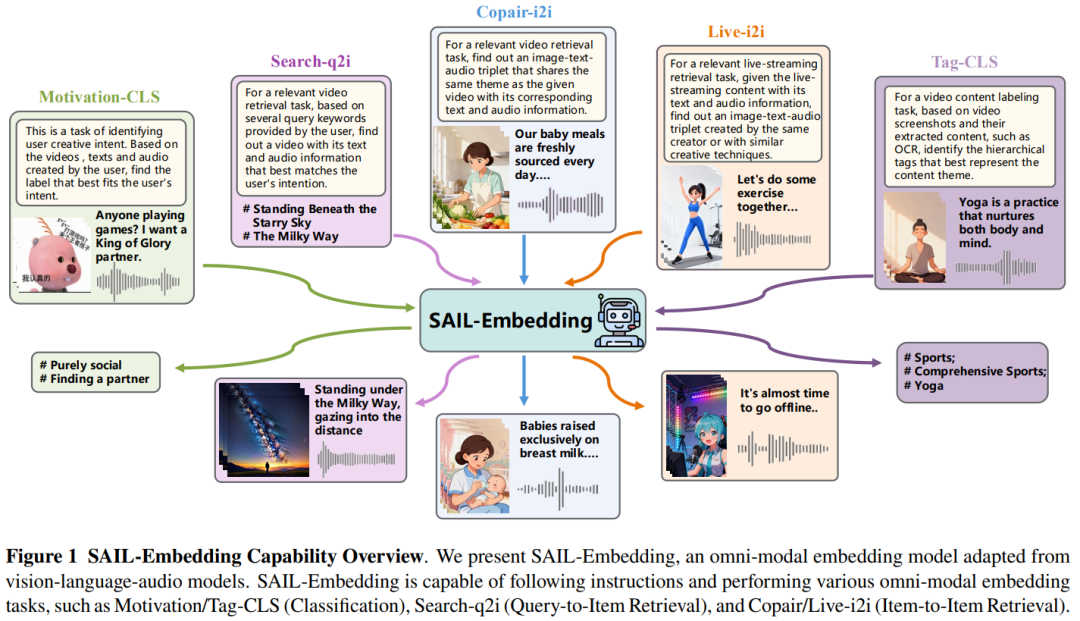

SAIL-Embedding:打通“视、文、音”的全模态表征

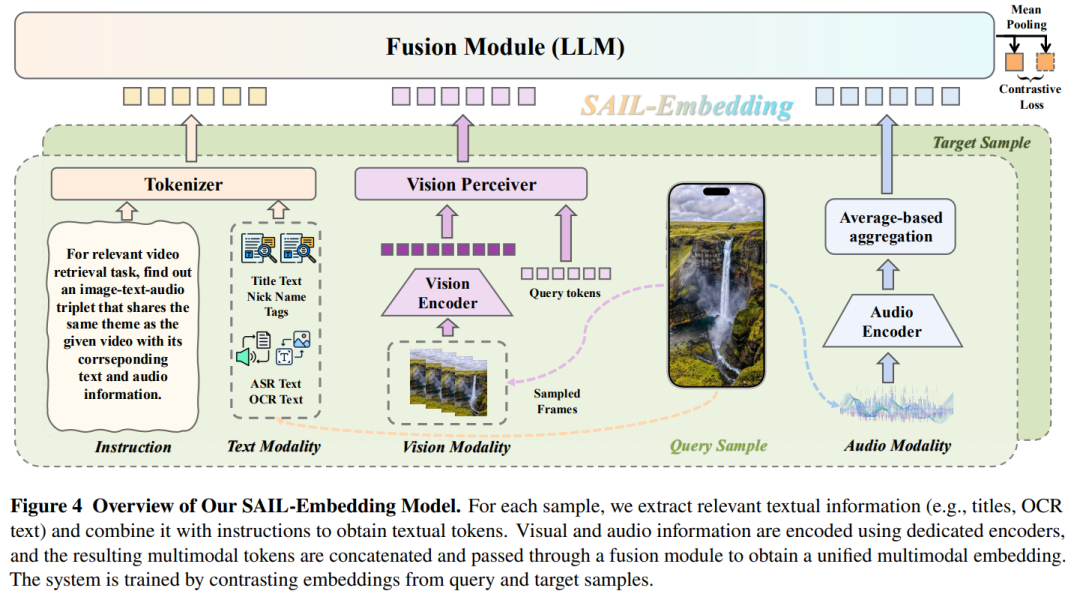

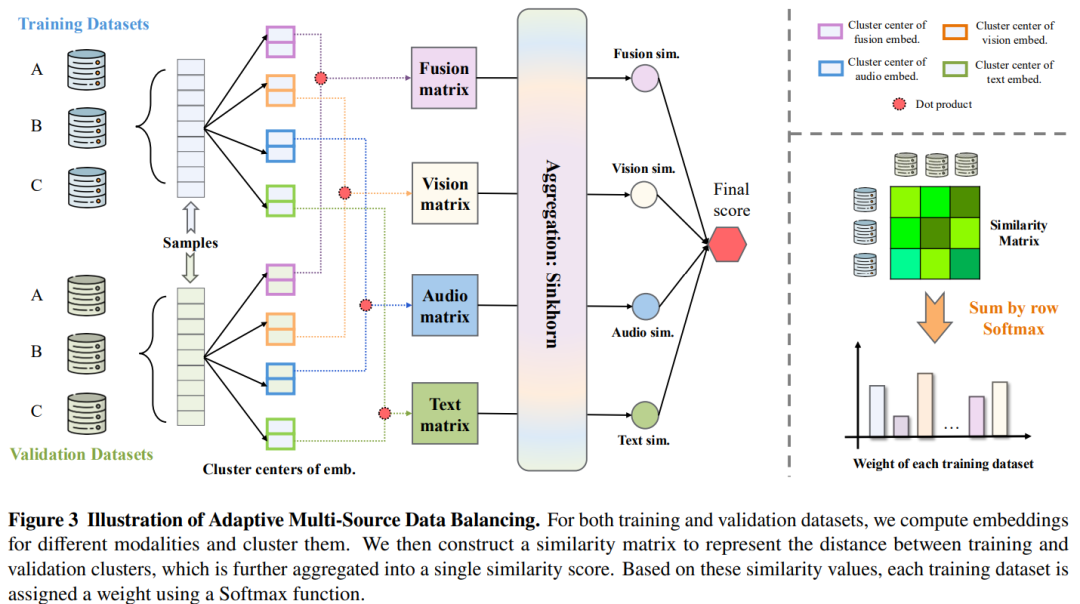

字节跳动与香港中文大学 MMLab 联合发布的SAIL-Embedding,是业内领先真正实现“全模态”融合的表征基础模型。

研究背景:短视频的内容理解极具挑战性。除了图像和标题,视频中的 OCR(帧内文字)、ASR(语音转文字)、背景音乐(BGM)甚至创作者的昵称都包含关键信息。现有的 CLIP 类模型多局限于图文二元关系,难以处理短视频这种多模态信号高度互补的场景。此外,大规模工业级训练面临着数据质量不均和训练不稳定的难题。

技术创新:

- • 全模态输入架构:该模型以 LLM 作为中央推理骨干,能够接收视觉(帧/封面)、文本(标题/OCR/ASR/标签)和音频(BGM/人声信号)的任意组合 [10]。

- • 鲁棒性训练策略:

- • 动态难负采样: 在对比学习中,表征学习的有效性在很大程度上取决于正样本和负样本的质量。虽然随机负样本通常数量众多,但它们在语义上往往与查询不相似,这使得区分任务变得简单,并限制了模型捕捉细微差异的能力。难负样本——即由于与正样本具有高度语义相似性而难以区分的样本——在提高模型鲁棒性和检索性能方面发挥着至关重要的作用。然而,“难”的概念取决于数据集和任务,而应用固定的全局相似性阈值往往会导致次优结果。为了解决这一问题,SAIL提出了一种动态硬负样本挖掘策略,该策略能够为每个数据集利用F1分数自适应调整相似度阈值,强制模型区分那些语义极度相近的负样本。[11]

- • 多源数据自动平衡: 传统的多源训练流程通常依赖于人工分配的数据集混合比例,这些比例由主观专业知识和任务直觉决定。这种启发式配置难以通过实证方法进行验证,并可能导致泛化性能不佳。SAIL引入了一种自适应加权框架,该框架直接从数据分布中学习特定于数据集的采样权重,而非基于人为设计的启发式方法。其核心思想是衡量高质量基准验证集与预训练数据集之间的语义相似性,并将这种相似性转化为灵活的采样权重,用于多源训练。与基于单一实例相似性得分移除全部样本的硬过滤方法相比,SAIL的方法在数据集层面进行软选择,在保持整体数据质量的同时保留分布多样性。这可以防止对基准领域的过拟合,避免分布崩溃,从而提高对未见任务的泛化能力。[11]

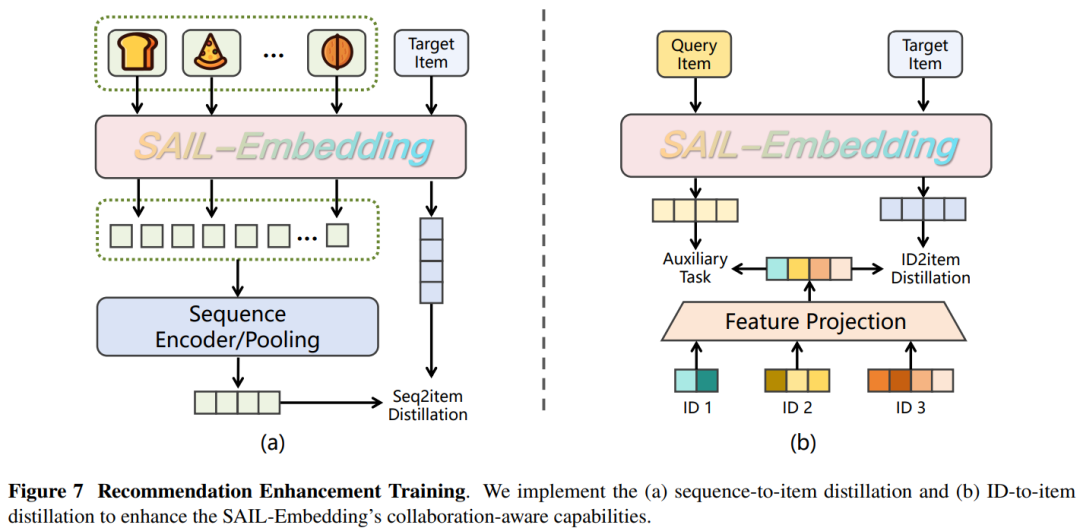

- • 协同感知的推荐增强(Collaboration-aware Recommendation Enhancement Training, CRET):这是 SAIL-Embedding 最具工业特色的创新。它通过知识蒸馏,将纯多模态语义与反映用户真实行为的 ID 向量进行对齐。具体来说,模型会学习“序列到物品(Sequence-to-item)”和“ID到物品(ID-to-item)”的映射,从而在表征中注入了点击、收藏、关注等协同过滤信号。

实验效果:

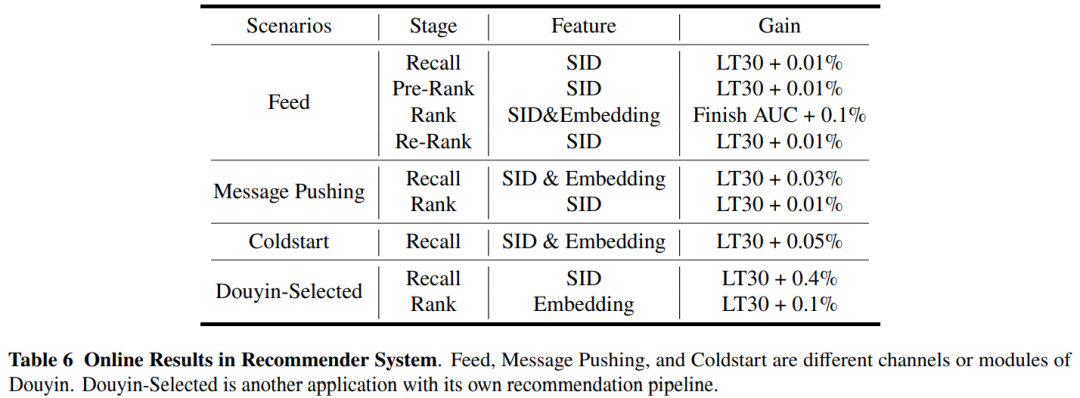

SAIL-Embedding 在抖音的多个核心场景中取得了显著收益 [11]:

- • 抖音精选:在极其注重内容质量的精选场景,该模型实现了 0.4+% 的 30 天长期价值(LT)增益。

- • 主 Feed 流:融入 SAIL 提取的特征后,推荐模型的 AUC 提升了 0.1%。

- • 冷启动场景:在冷启动阶段实现了 0.05% 的 30 天长期价值(LT)增益。

- • 一致性与关联性:引入 CRE 策略后,表征的归一化互信息(NMI)提升了 5%,排序一致性(肯德尔相关系数)提升了 3.8%。

洞察思考:工业场景下,纯粹的语义对齐(如 CLIP)是不够的,真正的“语义基础模型”必须学会与“用户反馈”共舞。通过将多模态理解与协同过滤信号进行 CRE 式的蒸馏,字节跳动打破了“内容相关性”与“商业转化率”之间的隔阂。

2.4 Google:Gemini时代的多模态搜索与广告创意生成新范式

2025年谷歌(Google)正经历自其成立以来最为深刻的技术架构与商业逻辑重塑。随着 Gemini 3 系列原生多模态大模型的全面实装,搜索不再仅仅是信息的索引与呈现,而是进化为一种具备深层推理能力的生成式智慧中枢。这一转型不仅改写了用户获取信息的方式,更在广告创意生产、竞价算法以及流量流转机制等多个维度,引发了前所未有的范式变革 。

Gemini 3与广告创意的生成式革命

研究背景:谷歌在 2025 年将其图像生成技术路径从追求速度的 Gemini 2.5 Flash 转向了追求深度推理与专业产出的 Gemini 3 架构。这一转变的核心标志便是 Nano Banana Pro 模型的推出 。该模型不仅是一个创意生成工具,更被定义为广告主和企业级设计场景中的“超级智能艺术家” 。

技术创新:

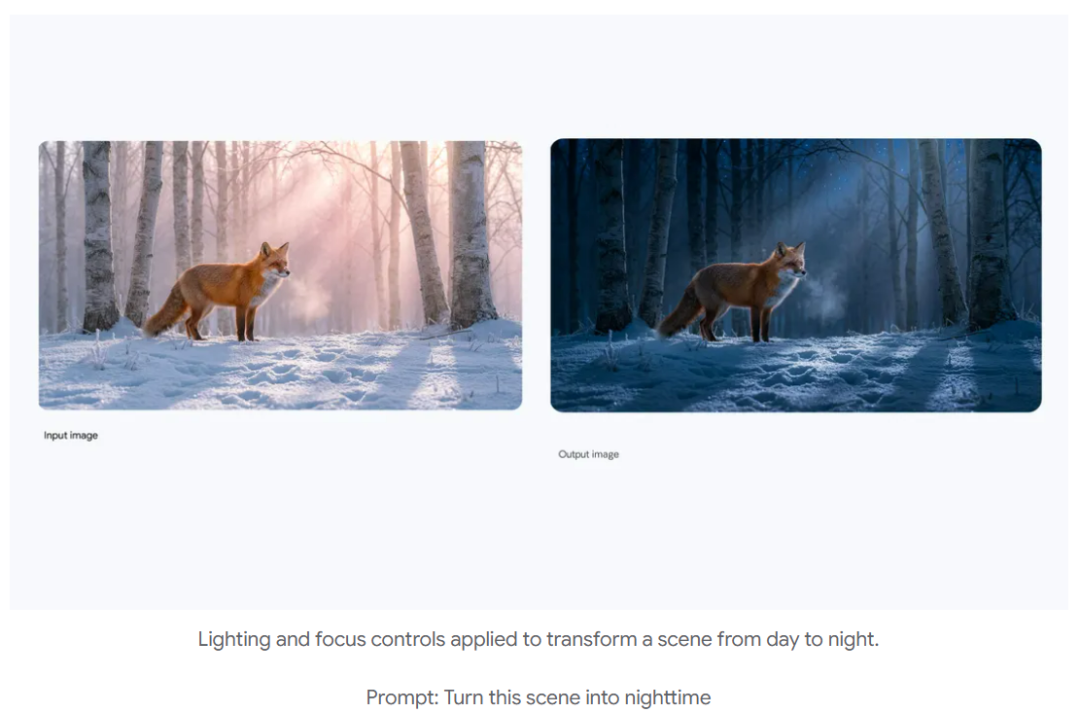

- • 物理世界的深度理解:Nano Banana Pro 的诞生,标志着谷歌在处理多模态数据时,已经从简单的特征提取进化到深层的语义理解与物理常识建模。这种能力的提升,首先体现在对物理世界逻辑的深度依从性上 。在 Gemini 3 之前,生成式 AI 往往在光影追踪、重力表现或复杂机械结构上出现“逻辑幻觉”,而 Nano Banana Pro 能够通过推理过程确保生成的图像符合物理规律,例如在 4K 渲染中精确平衡光源对不同纹理表面的漫反射与折射效果 。[12]

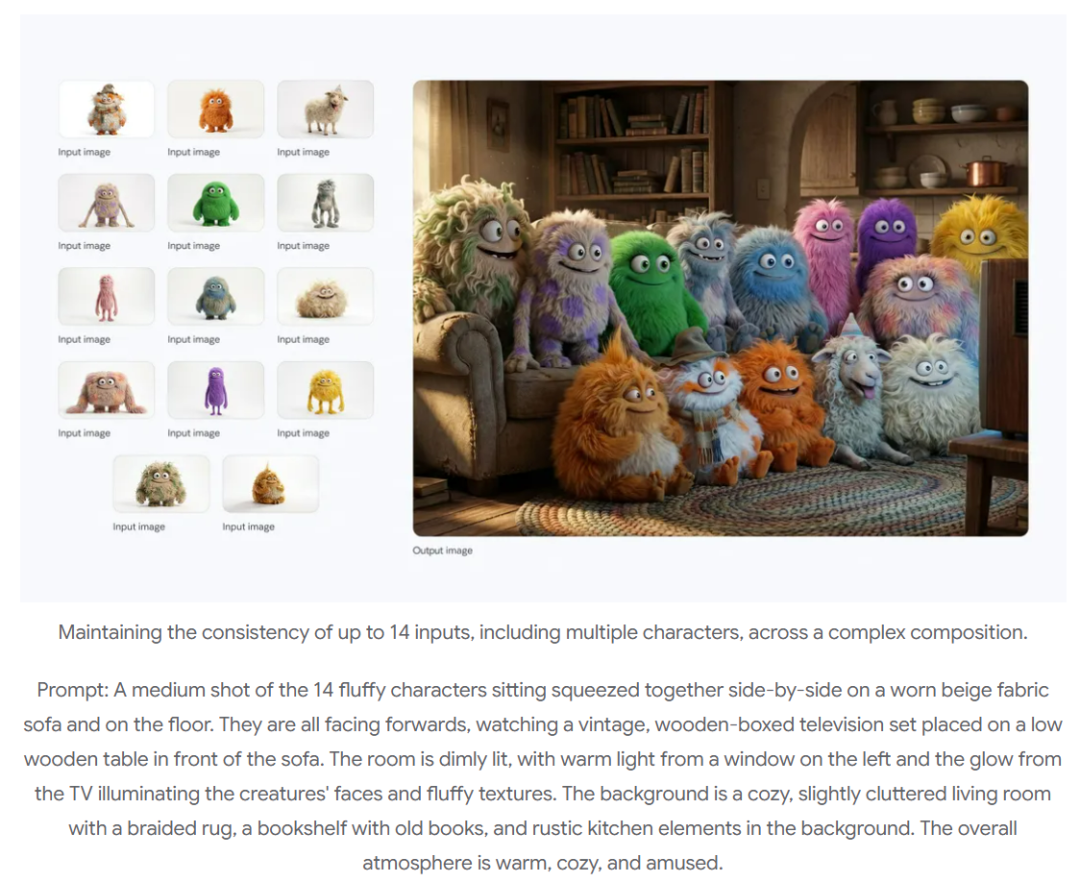

- • 商业化等级角色一致性保持:在商业叙事和系列广告素材的制作中,保持同一角色的视觉连续性一直是一个重大的技术挑战。以往的工具经常出现“人脸漂移”,即在不同场景下同一人物的面部特征发生细微改变,导致品牌信任度受损。Nano Banana Pro 通过其创新的参考图像注入技术,允许用户上传多个参考点(Asset IDs),包括正面视图、侧面特征以及特定的配饰细节 。[12]

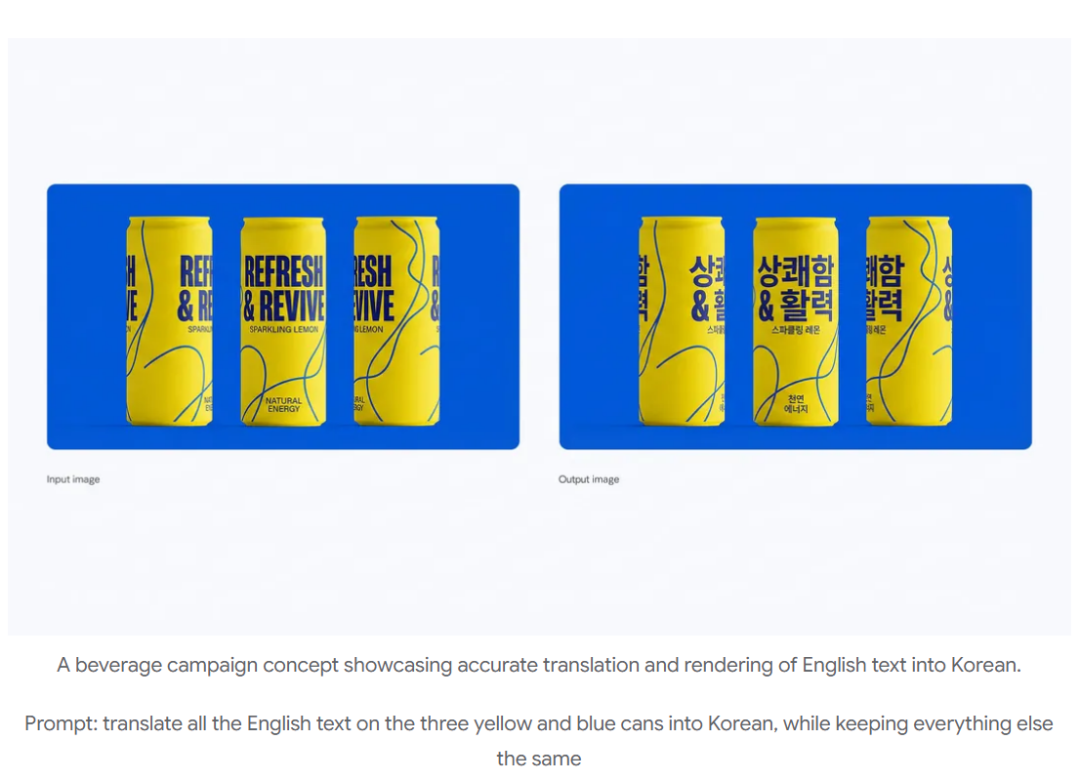

- • 文本渲染与局部精确编辑:针对图像中文字渲染难以辨认的行业通病,Nano Banana Pro 引入了先进的字体渲染引擎。它不仅能生成清晰的品牌 Logo,还支持在复杂的 3D 环境中无缝表征多行、多语种的文案 。这种能力在 2025 年被广泛应用于动态海报和国际化营销物料的自动化生产中。[12]

实验效果:

在 2025 年的广告实操中,谷歌不仅提供了更强大的创意模型,还通过改进 Bidding(竞价)和 Matching(匹配)算法,直接优化了广告主的投入产出比(ROI)。数据表明,AI 驱动的深度优化正在抵消日益上涨的流量成本:

- • Demand Gen 视觉驱动的购买力挖掘:作为谷歌旗下的核心视觉广告产品,Demand Gen 在 2025 年集成了超过 60 项 AI 驱动的改进(包括利用 Nano Banana 系列模型生成的自动化视频素材和更精准的竞价算法),实现单位美元驱动的转化率提升了 26% [2]。 这种增长的深层逻辑在于,Demand Gen 能够更好地利用多模态信号捕捉处于“发现阶段”的潜客意图。研究发现,约 68% 的 Demand Gen 转化来自于过去 30 天内未在谷歌搜索中出现过的全新品牌用户 [13]。这意味着 AI 不仅仅是在转化已有的意图,更是在通过沉浸式的视觉内容创造新的需求 [2]。 此外,随着 Connected TV(CTV)和 Shorts 购物功能的整合,Demand Gen 已经成为连接品牌声量与直接效果的短路径闭环。

Google Ads: “In the past year alone, Demand Gen has seen a 26% increase in conversions per dollar driven by 60+ AI-powered improvements to ramp time, bidding and other updates you may not have heard about.[2] (仅在过去一年,60多项人工智能技术增强的Demand Gen的每美元转化率提高了26%。)”

Google Ads: “Demand Gen helps you create and convert demand on YouTube and Google’s most visual, immersive surfaces when consumers aren’t searching for you [3]. (Demand Gen可帮助您在消费者未搜索您时,在YouTube和谷歌最具视觉效果、沉浸感最强的平台上创造并转化需求。)”

- • 智能出价与广泛匹配的协同效应:2025年,谷歌广告最显著的策略变动之一是极力推动“智能出价(Smart Bidding)+ 广泛匹配(Broad Match)”的黄金组合。 传统的搜索广告依赖于关键词的精确匹配,这在长尾词爆炸的今天显得力不从心。根据 2025 年的最新实测数据,使用这种基于语义而非文本匹配模式的广告主,在保持转化成本(CPA)稳定的前提下,获得了 25% 的转化增益 [14]。 这种增益源于 Smart Bidding 算法在毫秒内处理的海量维度信息。据估算,算法每天会做出超过 50,000 次微调决策,分析包括用户地理位置、历史行为、搜索时间点甚至当地天气等 3,840 多个辅助变量 [15]。对于企业而言,这意味着广告不仅能出现在“对的词”下,更能出现在“对的人”面前。

Google Ads: “On average, advertisers that change their phrase keywords to broad match can see 25% more conversions (in target CPA campaigns) and 12% more conversion value (in target ROAS campaigns) while meeting targets. (平均而言,将短语关键词更改为广泛匹配的广告主在达到目标的同时,转化次数可增加约25%(CPA广告),转化价值可增加约12%(ROAS广告)。)”

洞察思考:

AI正将搜索广告从“文字对齐”进化为“意图捕捉”。搜索算法不再死板地匹配关键词,而是通过多个多模态实时信号(如地理位置、历史行为等)深度理解用户背后的真实动机 。这种范式转变让广告从“广撒网”变成了“精喂鱼”,搜索结果也变得更加“意图优先”而非“词组优先” 。

搜索行为转型:AI Mode与AI Overviews的双重冲击

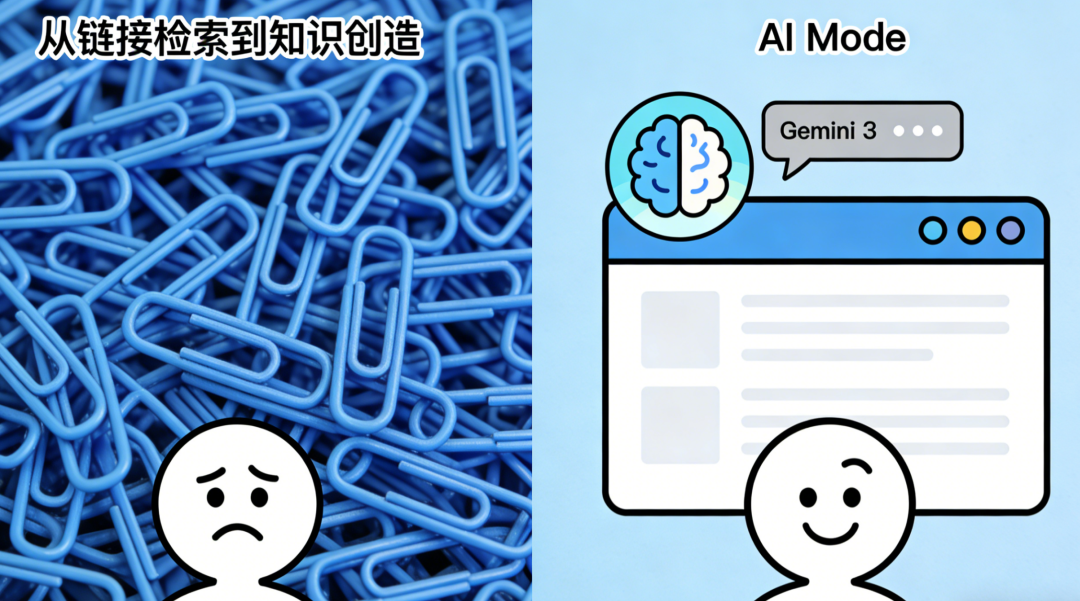

Google正在将搜索从传统的“链接列表”转型为以Gemini为核心的“AI模式”。这种多模态表征的应用不仅改变了内容如何被找到,也改变了流量如何流转。

研究背景:谷歌搜索在 2025 年正式完成了从“搜索引擎”向“生成式智慧助手”的身份转变。这种转变体现在产品前端的两个核心功能上,作为摘要呈现的 AI Overviews 以及作为深度研究界面的 AI Mode 。

- • AI Mode 超越链接的沉浸式研究体验:谷歌在 2025 年 3 月推出的 AI Mode,被视为“对搜索的重新构思” 。在 AI Mode 界面下,用户的查询不再返回一系列蓝色的网页链接,而是一个由 Gemini 3 Pro 驱动的、全屏化的、具备深度推理能力的综合响应界面 。AI Mode 引入了名为“Deep Search”的阶跃功能。当用户提出如“如何为一家位于东南亚的科技初创企业建立符合当地法律的合规体系?”这类多维度复杂问题时,系统不再仅仅提取片面信息,而是会同时访问数百个权威站点,进行跨语种、跨领域的逻辑推理,最终在几分钟内生成一份具备完整引用出处的专家级报告 。这种“查询分发(Query Fan-out)”机制极大地提高了用户处理复杂任务的效率,使搜索从简单的信息检索上升为知识创造 。 [16]

Google Search: “AI Mode uses Gemini 3’s next-generation intelligence, with advanced reasoning, thinking, and multimodal understanding to help with even your toughest questions. (AI模式采用Gemini 3的下一代智能技术,具备先进的推理、思考和多模态理解能力,可助你解答最棘手的问题。)”

- • AI Overviews流量流转的新平衡:AI Overviews 的普及彻底改变了谷歌页面的流量分配逻辑。对于信息类查询,AI 摘要能够直接在搜索结果首页解答用户疑问,形成了显著的“零点击搜索”趋势。 这一趋势在 2025 年 9 月的实测数据中得到了印证:对于触发了 AI 摘要的查询,自然搜索(Organic)的点击率下降了 61%,而传统位置的付费点击率下降了 68% [17]。然而,这种下降背后隐藏着高质量流量的定向迁移。尽管总点击量减少,但那些在 AI 摘要中被引用(Cited)的品牌,其获得的转化效率反而更高。数据显示,被引用的品牌在相同查询下的自然 CTR 比未引用品牌高出 35%,付费 CTR 更是高出 91% [17]。这意味着未来的流量红利将不再属于“排位第一”的网站,而属于“被 AI 信任并引用”的权威来源。

2025搜索广告表现对比表

| 指标 | 2024年数据 | 2025年预测/实测数据 | 趋势分析 |

|---|---|---|---|

| 平均点击率(CTR) | 6.42% [18] | 6.66% [19] | 受AI驱动的精准匹配影响上升 |

| 平均转化率(CVR) | 6.96% [18] | 7.52% [19] | 65%的行业见证了CVR的显著提升 |

| 平均单次点击成本(CPC) | $4.66 [18] | $5.26 [19] | 87%的行业面临成本上涨,竞争日益激烈 [19] |

| AI Overview影响(自然CTR) | - | 下降61% [17] | AI摘要直接解答了问题,用户无需点击 |

| AI Overview影响(付费CTR) | - | 下降68% [17] | 传统广告位受挤压,但“被引用”品牌红利巨大 |

洞察思考:

Google的数据展示了一个矛盾的现状,虽然由于AI直接提供答案(零点击搜索),总体的CTR承受了下行压力,但由于多模态表征模型更精准地识别了高意图流量,最终的转化效率(CVR)反而创下新高。这意味着未来的竞争重心将从“争夺点击量”转向“争夺AI的引用权和信任度”。

- 发展趋势:生成推理引领架构变革

==================

我们洞察总结搜推广领域的多模态大模型表征和创意生成技术正呈现出以下四大发展趋势:

3.1 从“判别式编码”向“智能体生成式推理”的范式融合

未来的表征模型将不再仅仅是将图片投影成一个固定长度的向量,而是会先进行“思考”。Meta 的 TTE 框架与 Google Gemini 的物理常识推理均预示了这种趋势:即利用大模型的自然语言理解能力,先对多模态输入进行显式的语义拆解。这种“生成即表征”的模式,能让广告系统在生成创意的同时,同步产生精准的投放表征。在大模型时代,向量空间不应再被视为一个被动投影的产物,而应该是模型主动思考后的浓缩,智能体表征(Agentic Embedding)、推理增强表征为多模态表征提供了新的技术演进方向和效果优化空间。

3.2 大模型语义“深度扩展”逐渐取代传统语义“宽度扩展”

阿里妈妈的MOON实践证明,将多模态模型扩展到十亿参数级别,并配合数万亿Token的训练,能持续带来业务增益。这种“深度扩展”正在取代传统的“宽度扩展”(即单纯堆砌成千上万个稀疏ID特征)。未来,搜推广系统将形成“统一的多模态语义底座 + 任务特定插件”的架构模式。Gemini 3 & Nano Banana Pro 的全量实装证明,将模型扩展到百亿甚至千亿参数,能显著增强模型对复杂商业场景创意生成(如角色一致性、文本精确渲染)的控制力。

3.3 用户行为信号与内容语义深度融合

纯内容语义不代表用户兴趣(例如,用户喜欢看某类视频不代表他会购买其中商品)。因此,字节跳动的CRE策略和阿里的SA-TA机制代表了未来的融合路径:以多模态内容语义为基石解决冷启动和通用性,以行为信号为修正解决商业转化和个性化,两者之间的“蒸馏”与“融合”是工业界关键的竞争力。

3.4 信息检索工程基础设施的异步化流式架构

面对十万级超长序列建模(如阿里MUSE)和复杂的实时生成式编辑(如Google Nano Banana Pro),底层的I/O延迟和算力消耗成为核心挑战。未来的搜推广系统将从“同步计算链”转向“异步预取、KV缓存、边缘计算”相结合的流式架构,确保大模型带来的智能增益不会被在线响应的延迟所抵消。

4. 洞察结论:语义深度理解生成重塑搜推广格局

多模态大模型表征和创意生成技术正在重新定义搜推广领域的“游戏规则”。它不仅是解决数据稀疏性的手段,更是内容理解跨越到“深层语义”的关键。Google 通过 Gemini 3 架构,更是将广告从单纯的“意图匹配”推向了“意图创造”,通过 Nano Banana Pro 等工具实现了创意生产的工业化革命。

那么,如何系统的去学习大模型LLM?

作为一名深耕行业的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

更多推荐

已为社区贡献516条内容

已为社区贡献516条内容

所有评论(0)