联想陈太锋:AI监管常态化下的合规挑战与工程化治理

唯有通过组织重塑、流程前置与治理工程化,构建起一套“碳硅共融”的高效治理体系,才能在AIGC的浪潮中保持定力,实现“AI向善”的可持续发展目标。他结合联想在AI PC、AI平板、企业级方案等200多款AI应用中的实战经验,深度解析了AI监管时代的范式转变,并分享了联想如何通过“预防内置、动态合规”的策略。我们设立了严格的合规审查流程,所有产品上线前根据不同的场景,须完成包括PSRB(联想全球安全实

在AI技术日新月异的今天,企业如何平衡业务创新与合规治理?面对AIGC带来的几何级内容增长与复杂的监管环境,传统的治理模式是否依然有效?

在数美2025 AI风控大会上,联想中国AI产品内容安全负责人陈太锋带来了主题为《AIGC 治理新范式:从合规到高效治理》的精彩分享。他结合联想在AI PC、AI平板、企业级方案等200多款AI应用中的实战经验,深度解析了AI监管时代的范式转变,并分享了联想如何通过“预防内置、动态合规”的策略。

本文主体内容基于大会的演讲实录,同时融合了他最新的年终总结《2025年AIGC内容合规年度总结:从“被动响应”走向“工程化治理”》中的部分内容,带来兼具实践参考与前瞻性洞察的分享。

我们正处在一个智能涌现的纪元,生成式人工智能(AIGC)已经不再是遥远的技术概念,而是深度嵌入社会生产力的底层逻辑,成为重塑各行业的基础引擎。AI的渗透力已超越单纯的技术创新,正在更深层次推动经济结构的系统性变革。

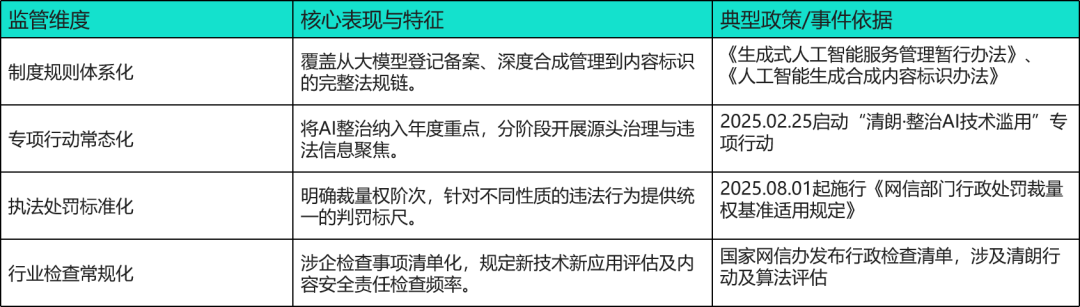

然而,这种基础性生产力的爆发也带来了前所未有的治理困境。AIGC生成的即时性、高仿真性与责任边界的模糊性,使得传统的互联网治理模式面临严峻挑战。特别是去年以来,AI监管已进入“深水区”,逐渐形成了“制度规则体系化、专项行动常态化、执法处罚标准化、行业检查常规化”的治理新格局。

特别是在2025年初,中央网信办将“整治AI技术滥用乱象”列为“清朗”系列专项行动的重点,明确指向恶意挑动负面情绪、夸大炒作不实信息、宣扬恐慌焦虑以及借血腥暴力画面挑起网络戾气等深层社会问题。这一转变标志着治理逻辑从单纯的“技术防范”上升到了“生态治理”的高度。

一、范式转变:AI监管时代的体系化与常态化

我从事合规工作近20年,经历了从PC互联网到UGC(用户生成内容),再到如今AIGC(人工智能生成内容)的演变。我也曾是数美的一员,负责过AIGC方面的解决方案。回看过去,Web 1.0和UGC时代的治理挑战,相比于今天的AI治理,其实仅仅是冰山一角。

1. 制度规则体系化

这两年,针对AIGC出台了许多法律法规,如内容标识的相关规定。特别值得关注的是,《网络安全法》的修订将人工智能治理纳入其中,并补充了个人信息保护的内容。此外,2025年6月30日国家网信办发布的涉企行政检查事项清单,以及公安部相关文件的修订,都标志着AI监管已经形成了制度规则的体系化。

2. 监管执法常态化

目前的治理格局呈现出专项行动常态化、执法处罚标准化、行业检查常规化的特点。例如网信部门出台了行政裁量权的基准适用规定。这意味着,企业治理不再是仅仅应对突发舆情,而是要时刻准备应对各种法规落地的检查。

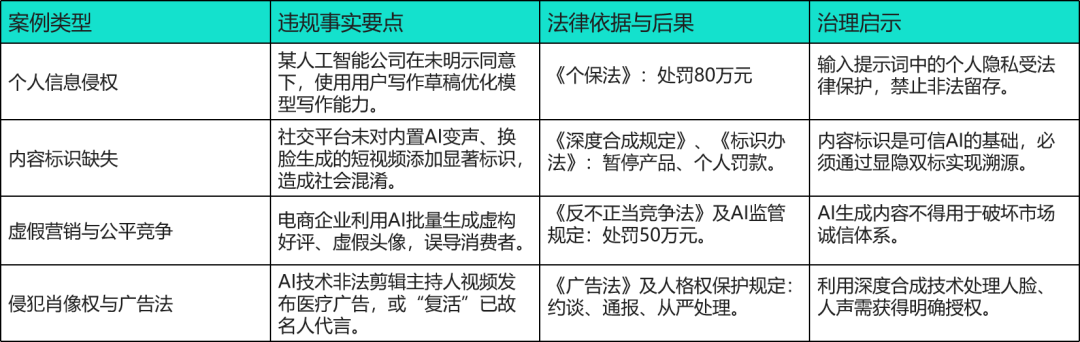

3. 多方协同治理

我们整理了近期的AI治理案例,发现核心聚焦于数据安全、内容标识和内容安全。监管模式也从单一部门牵头,转向网信、公安、市场监管等多部门协同治理。在AIGC行业发展过程中,监管部门目前保持“包容审慎”的态度,“以案释法”成为了重要的监管手段。

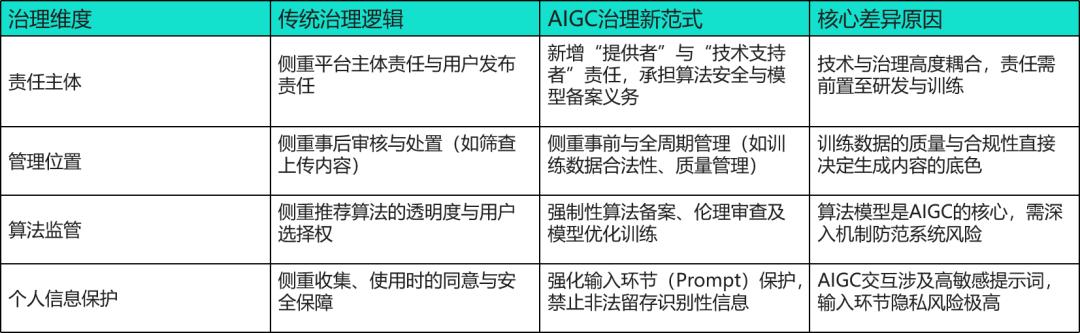

二、核心挑战:技术发展的“剪刀差”效应

传统的互联网内容治理通常基于“事后监督”和“边界清晰”的原则。然而,AIGC技术的特质使得这种模式难以为继。AIGC内容的生成具有瞬时性和规模化特征,这与治理能力的提升速度之间形成了显著的“剪刀差”。在传统的逻辑下,平台对用户发布的内容承担巡查和应急处置责任,但在AIGC环境下,责任主体延伸到了“提供者”和“技术支持者”,且内容生成机制非完全透明,责任往往需要前置到研发阶段。

不仅是基础的内容安全,AI还带来了底层漏洞、隐私泄露、大模型幻觉等新风险。这种发展的不匹配,促使我们必须思考新的治理模式。

三、应对策略:预防内置,动态合规

针对上述挑战,联想制定了“预防内置,动态合规”的治理新模式。

1. 强调前置治理

AIGC内容一旦生成,无法像UGC那样简单地撤回。因此,治理必须前置,要在内容生成之前或生成的瞬间(如思考链环节)进行拦截和回测,这对前置能力的要求极高。

2. 动态合规事项调整

UGC时代的治理主要围绕《网络信息内容生态治理规定》等核心法规。但在AIGC时代,除了基础合规,还会延伸出科技伦理、深度伪造(如人脸诈骗)等新风险。我们需要根据不同场景动态优化治理内容。

3. 全生命周期治理

治理需覆盖模型训练(语料安全、贸易合规、知识产权)、上线备案、以及事后监管的全过程。例如在训练阶段涉及显卡算力,就可能触发贸易合规审查;使用开源内容,则涉及知识产权审查。

4. 责任主体的延伸与界定

当我们调用第三方模型(如豆包、文心一言)通过API提供服务时,作为服务提供者我们承担主体责任,但技术提供者也有相应责任。如何在复杂的生态中划分责任边界,是一个重要课题。

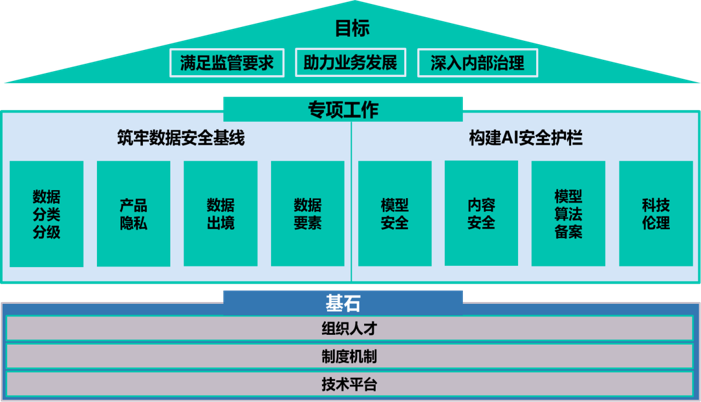

四、联想实践:构建高效的AI治理体系

目前,我们部门管理着联想内部约200多款AI应用,涵盖C端的AI PC、AI平板、AI手机,以及内部应用和B端解决方案。 为了实现高效治理,我们构建了一套完整的体系:

1. 顶层设计:AI治理“屋顶图”

联想发展AI有三个关键词:绿色、普惠、负责任。我们制定了《人工智能政策》,并通过红头文件落地。我们的“屋顶图”目标明确:满足监管要求、助力业务发展、深入内部治理。工作拆解为数据安全(分类分级、隐私、出境)和AI安全(模型安全、内容安全、备案、伦理)两大专项。

2. 组织架构:AI合规委员会

我们成立了AI合规委员会,下设合规管理、内容安全、科技伦理等工作组,拉通了100多位跨部门成员。同时,设立实体组织“内容安全运营部”负责日常运营。AI合规涉及面广,只有业务侧强力推动,合规才能真正落地。

3. 流程机制:瀑布式与持续性审查

我们设立了严格的合规审查流程,所有产品上线前根据不同的场景,须完成包括PSRB(联想全球安全实验室)、BIA、开源、数据隐私以及价值观审查(是否符合科技伦理)在内的全套流程。

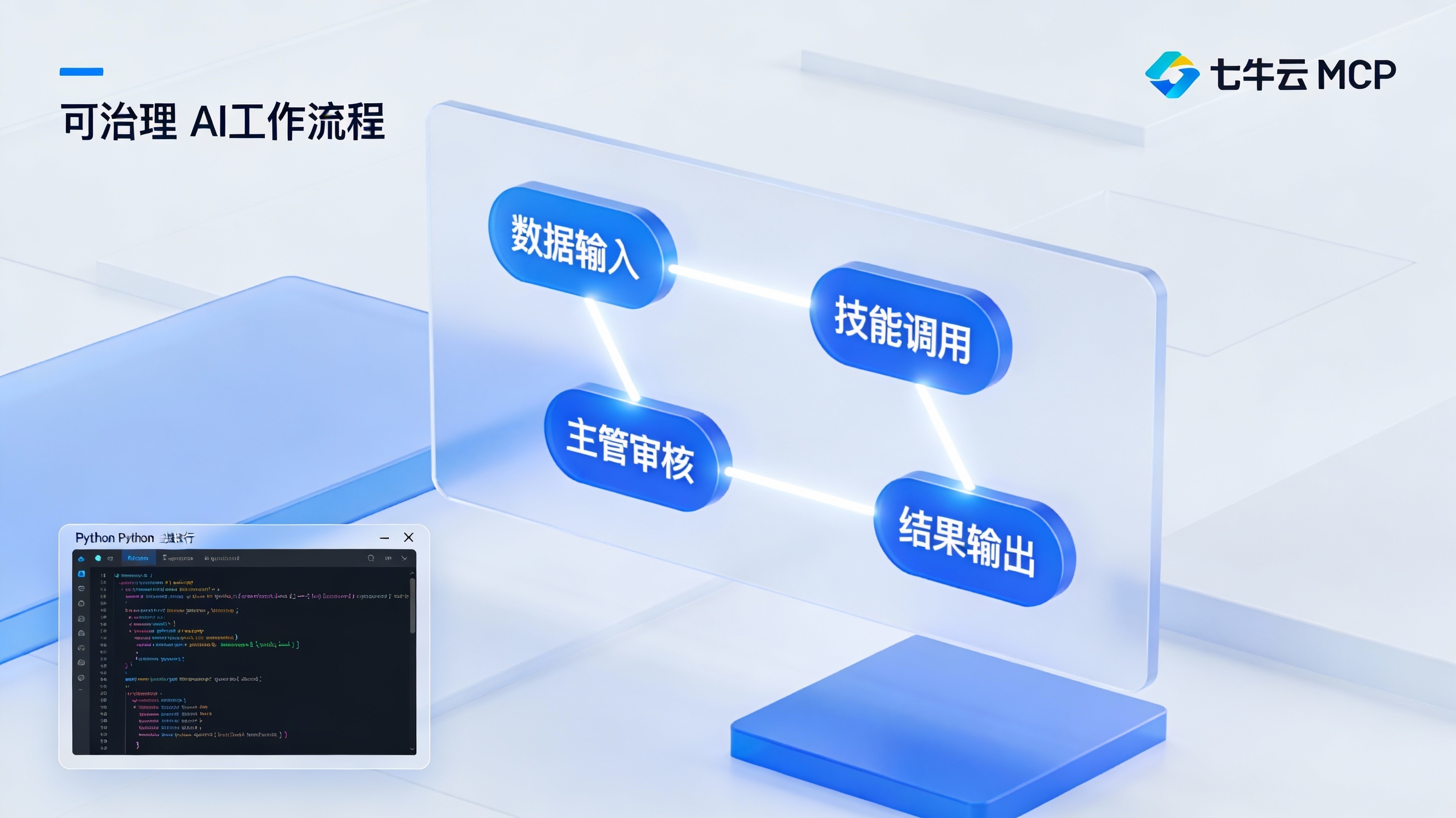

4. 工程化落地:AI合规中台

我们将治理需求转化为工程化能力,构建了AI合规中台。中台集成了自研引擎以及数美等合作伙伴的公有云、私有云及端侧能力,统一为三大业务场景提供服务。例如在AI PC端,我们内置了端侧模型进行实时防护。

5. 提效手段:AI治理AI

我们利用AI技术开发了大量Agent来辅助工作,如合规审查Agent、日志处置Agent等。目前,部门30%的工作已通过AI自动化解决。

在检测巡检方面,我们引入了大模型进行动态质检,并结合分类模型对日志进行预处理(如过滤低风险的生活类日志),极大提升了效率。

五、总结与前瞻:通向可信AI的必由之路

生成式人工智能的治理不仅是一场关于“安全”的较量,更是一场关于“信任”的竞争。这一年的成功实践证明,高效治理并非业务发展的绊脚石,而是助力业务稳健发展、进入高壁垒场景的核心竞争力。

展望未来,AI治理将呈现出以下趋势:

端侧治理的崛起:随着具身智能和端侧大模型的普及,治理算力将从云端向端侧下沉。

治理工具的平台化:未来,统一的AI合规治理中台将成为企业的标配。这种中台将具备多模态扫描、风险自动聚类、模型安全评测及舆情质检等全方位能力。

合规文化的价值观内化:从传统的“外部驱动合规”转向“内部价值观驱动”。企业应将科技伦理、透明度与问责机制内化为组织基因,通过透明度报告和可信模型建设,建立起真实的人机交互信任。

在这个超级大周期下,企业必须与过去的被动思维告别。唯有通过组织重塑、流程前置与治理工程化,构建起一套“碳硅共融”的高效治理体系,才能在AIGC的浪潮中保持定力,实现“AI向善”的可持续发展目标。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)