英伟达Rubin平台全面解析:5倍于Blackwell的AI算力,开启物理AI时代

北京时间1月6日凌晨,在拉斯维加斯 CES 2026 展会现场,英伟达创始人黄仁勋身穿经典皮衣现身,并正式发布了全新一代Vera Rubin计算架构。这一架构涵盖CPU、GPU、互连、网络、存储与系统级设计,被英伟达定义为面向“下一阶段AI前沿”的基础设施平台。在这场演讲中,黄仁勋并未将重点放在某一具体应用或模型能力上,而是在演讲中明确指出,AI发展的下一步是让模型能够。

摘要:北京时间1月6日凌晨,在拉斯维加斯 CES 2026 展会现场,英伟达创始人黄仁勋身穿经典皮衣现身,并正式发布了全新一代Vera Rubin计算架构。这一架构涵盖CPU、GPU、互连、网络、存储与系统级设计,被英伟达定义为面向“下一阶段AI前沿”的基础设施平台。在这场演讲中,黄仁勋并未将重点放在某一具体应用或模型能力上,而是在演讲中明确指出,AI发展的下一步是让模型能够 “多想一会儿” ,而这需要全新的计算范式。事实上随着AI模型参数规模不断扩大,特别是混合专家模型的兴起,传统的计算架构已难以满足需求。代理式AI的核心特点-多步骤问题求解和长上下文工作流正将计算推向前所未有的极限。

一、Rubin 平台问世 —— 六芯系统的AI超级计算机

NVIDIA Rubin 平台,刚刚推出的六款全新芯片,目标是构建一台在成本、性能与安全性上全面领先的 AI 超级计算机,加速 AI 在主流场景中的落地。

这六款芯片包括:NVIDIA Vera CPU、NVIDIA Rubin GPU、NVIDIA NVLink 6 Switch、NVIDIA ConnectX-9 SuperNIC、NVIDIA BlueField-4 DPU 和 NVIDIA Spectrum-6 Ethernet Switch,极致的协同设计,将大幅缩短训练时间,降低推理 Token 成本。这种全面协同的设计标志着英伟达从单一的GPU供应商向完整的AI基础设施提供商的转变。这种系统级方法的核心是将整个数据中心视为计算单元,而不仅仅是单个芯片的性能提升。Vera CPU作为平台的关键组成部分,采用88个定制Olympus核心,完全兼容Armv9.2架构。这款CPU专为代理式推理设计,被英伟达称为大规模AI工厂中能效最高的CPU。

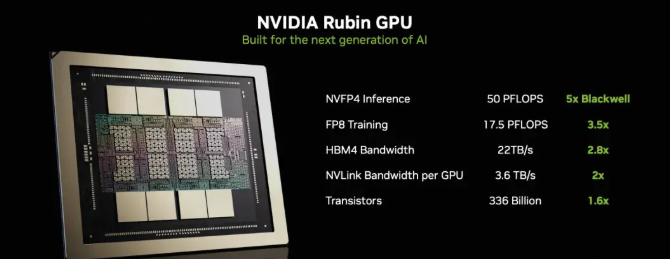

二、性能飞跃:五大技术突破

Rubin平台带来了五大关键技术创新,包括最新一代 NVIDIA NVLink 互连技术、Transformer 引擎、机密计算和 RAS 引擎,以及 NVIDIA Vera CPU,使其性能远超上一代Blackwell平台。制程工艺采用台积电3nm(N3P)工艺,CoWoS-L封装,集成度与能效大幅提升,内存配置基础班为8层HBM4(288GB,13TB/s),Ultra版12层HBM4e,容量与带宽提升。同时,第六代NVLink实现了GPU间通信的重大飞跃,为每个GPU提供每秒3.6TB的带宽,而Vera Rubin NVL72机架的总带宽则高达每秒260TB,超过了整个互联网的带宽。

具体对比如下:

| 性能指标 | NVIDIA Rubin | NVIDIA Blackwell | 提升幅度 |

|---|---|---|---|

| 推理性能(NVFP4) | 50 PFLOPS | 10 PFLOPS | 5倍 |

| 训练性能 | 35 PFLOPS | 10 PFLOPS | 3.5倍 |

| HBM4内存带宽 | 22TB/s | 7.8TB/s | 2.8倍 |

| 单GPU NVLink带宽 | 3.6TB/s | 1.8TB/s | 2倍 |

| 晶体管数量 | 3360亿个 | 2080亿个 | 1.6倍 |

| 推理成本 | 降低至十分之一 | 基准 | 显著降低 |

基于公开数据的Rubin与Blackwell平台关键性能对比

在系统层面,Rubin GPU搭载了第三代Transformer引擎,采用硬件加速的自适应压缩技术,使NVFP4推理性能达到50 PFLOPS,是Blackwell平台的5倍。同时新的存储解决方案——推理上下文内存存储平台,由BlueField-4 DPU驱动,旨在解决长上下文推理中的存储瓶颈问题。这对于处理复杂文档理解和多步骤代理推理至关重要,根据英伟达公布的数据,Rubin平台能将推理成本降至Blackwell平台的十分之一,并将训练混合专家模型所需的GPU数量减少至四分之一。

三、国产GPU发展之路漫漫其修远兮

国产GPU的追赶,不是一场“弯道超车”的短跑,而是一场围绕算力王座的“马拉松”已然开跑。英伟达的Rubin,定义了下一个赛段的终点线;而国内GPU公司的密集上市,则为追赶者注入了第一剂强心针。 最近的IPO浪潮,解决的是“资本”和“市场信心”的问题,让国产GPU获得了持续研发和商业落地的宝贵弹药。但这笔钱,要用来填补的,是CUDA生态的鸿沟、是系统级定义的差距、是顶尖人才的储备。 上市不是终点,而是更残酷竞赛的起点。这条路没有捷径,唯有脚踏实地,用每一代产品的进步,去回答时间的问题。

这条路注定艰难。它需要的不仅是技术的突破,更是产业链的协同、开发者的信任和时间的沉淀。这就像一场围棋,英伟达已在全局布下厚势,而我们则需要在看似局部的领域中扎实做活,积蓄力量,等待“胜负手”时机。

祝福国产GPU,这场技术长征,才刚刚开始。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)