深入 ‘Dynamic Tool Approval’:如何针对高风险工具实现‘仅限本次调用’的人工授权逻辑?

各位同仁,下午好!今天,我们将深入探讨一个在自动化和人工智能日益普及的时代背景下,至关重要的安全与治理话题——“动态工具授权”。特别是,我们将聚焦于如何针对那些具有高风险的操作,实现一种精细到“仅限本次调用”的人工授权逻辑。随着AI代理、自动化脚本和复杂系统在我们的日常运营中扮演越来越重要的角色,它们被赋予了前所未有的能力去调用各种工具,执行从数据分析到基础设施管理乃至财务交易的各项任务。这种能力

各位同仁,下午好!

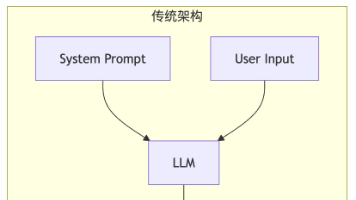

今天,我们将深入探讨一个在自动化和人工智能日益普及的时代背景下,至关重要的安全与治理话题——“动态工具授权”。特别是,我们将聚焦于如何针对那些具有高风险的操作,实现一种精细到“仅限本次调用”的人工授权逻辑。

随着AI代理、自动化脚本和复杂系统在我们的日常运营中扮演越来越重要的角色,它们被赋予了前所未有的能力去调用各种工具,执行从数据分析到基础设施管理乃至财务交易的各项任务。这种能力固然带来了效率的飞跃,但也伴随着巨大的潜在风险。一个未经妥善控制的AI代理,错误地调用了一个高风险工具,其后果可能是灾难性的。

静态的权限管理(例如,某个服务账户可以调用某个API)已不足以应对这种复杂性。我们不仅需要知道“谁”能调用“什么”工具,更需要关注在“什么情境下”、“以何种参数”调用,以及“本次调用”是否真的安全、合规。这就是“动态工具授权”的核心价值所在,而“仅限本次调用的人工授权”则是其应对高风险场景的终极防线。

高风险工具的挑战与动态授权的必要性

首先,让我们明确一下,我们所说的高风险工具通常指的是哪些?它们包括但不限于:

- 数据修改工具: 数据库的删除、修改、批量更新操作,尤其是生产环境。

- 基础设施管理工具: 服务器的创建、删除、配置更改,网络ACL的修改,云资源的销毁。

- 敏感数据访问工具: 访问客户个人身份信息 (PII)、财务数据、商业机密。

- 部署与发布工具: 生产代码的部署、回滚,服务版本的升级。

- 财务操作工具: 支付发起、资金转账、账务调整。

- 安全管理工具: 密钥管理、权限修改、防火墙规则调整。

这些工具的共同特点是,一旦被错误或恶意使用,可能导致数据丢失、系统瘫痪、财务损失、声誉受损,甚至法律责任。

传统的权限管理模式,例如RBAC(基于角色的访问控制),往往是静态的:一个用户或服务拥有某个角色的权限,就可以执行该角色下所有的操作。但这在高风险工具的场景下,存在显著局限:

- 上下文缺失: 即使一个管理员有权删除数据库,我们也不能假定他/她每一次删除操作都是合理的。具体要删除哪个数据库?在什么时间?谁触发的?这些上下文信息至关重要。

- 参数敏感性: 很多工具的风险等级取决于其调用参数。例如,一个“删除文件”工具,删除

/tmp/test.txt和删除/etc/passwd的风险截然不同。静态权限无法区分这种参数层面的差异。 - 自动化代理的盲点: AI代理或自动化脚本可能因逻辑错误、数据偏差或外部输入异常而生成错误或恶意的调用参数,从而触发高风险操作。

因此,我们需要一种更智能、更精细的授权机制,它能够在运行时评估每一次工具调用的风险,并根据预设策略决定是否需要人工干预。这正是“动态工具授权”的价值所在。而对于那些被评估为极高风险的调用,我们不惜引入人工审批的延迟,以换取操作的绝对安全性与可控性。

核心概念:仅限本次调用的高风险工具人工授权 (One-Time Human Authorization)

“仅限本次调用的人工授权”是动态工具授权体系中的一个关键环节,它旨在为高风险操作提供一道不可逾越的人工审批屏障。其核心思想是:

- 细粒度审批: 审批不是针对工具本身的权限,而是针对“本次特定调用”的“特定参数”的授权。

- 一次性有效: 审批一旦通过,仅对当前请求有效。下一次即使是相同的工具、相同的参数,也可能需要重新审批(取决于策略,但对于最高风险的工具,通常都是如此)。

- 透明化决策: 审批人必须清晰地看到本次调用的所有上下文信息,包括但不限于工具名称、完整的调用参数、发起方、预期的影响等。

- 审计可追溯: 所有的请求、评估、审批决策、执行结果都必须被完整记录,形成不可篡改的审计链条。

让我们通过一个简化的流程图(此处以文字描述)来理解其端到端的工作机制:

- 工具调用请求发起: AI代理、自动化系统或甚至开发人员通过API发起对某个工具的调用。

- 请求拦截与预处理: 授权系统拦截该请求,并提取所有相关信息(工具ID、参数、调用者身份、调用上下文等)。

- 风险评估: 授权系统的风险评估引擎根据预设策略,对本次调用的风险等级进行实时评估。

- 策略匹配与决策:

- 如果风险极低,且符合自动化执行策略,则直接放行执行。

- 如果风险中等,可能需要内部规则审批或特定权限检查。

- 如果风险极高,且明确要求人工授权,则暂停本次调用,进入人工审批流程。

- 人工审批请求创建: 系统生成一个唯一的审批请求,包含所有调用细节,并通知指定的审批人(或审批组)。

- 人工审批: 审批人收到通知,通过专门的审批界面查看请求详情,并做出“批准”或“拒绝”的决策,通常还需要附带审批意见。

- 决策响应与执行/拒绝:

- 如果审批人“批准”,系统将本次调用标记为已授权,并允许工具执行环境继续执行该操作。

- 如果审批人“拒绝”或审批请求超时,系统将取消本次调用,并通知发起方。

- 审计记录: 整个流程中的每一个关键步骤(请求、评估、审批、执行结果)都被详细记录到审计日志中。

这种模式虽然引入了人工干预的延迟,但它为高风险操作提供了一个强大的安全网,确保关键决策始终在人类的监督和控制之下。

系统架构概览

要实现上述“仅限本次调用”的人工授权逻辑,我们需要构建一个健壮且可扩展的系统架构。以下是其核心组件的概览:

+-------------------+ +-----------------------+ +-------------------+

| AI Agent / | | | | |

| Automation System|------>| Tool Invocation |------>| Tool Registry |

| (发起工具调用) | | Service (API Gateway)| | (工具元数据) |

+-------------------+ +-----------------------+ | |

| +---------^---------+

| |

v |

+-----------------------+ +-----------------------+ +-------------------+

| Risk Assessment |<------| Policy Engine |<------| IAM / RBAC |

| Engine (风险评估) | | (策略规则) | | (身份与权限) |

+-----------------------+ +-----------------------+ +-------------------+

| |

| (若需人工审批) |

v |

+-----------------------+ +-----------------------+ +-------------------+

| Approval Workflow |<----->| Human Approval |<----->| Notification |

| Engine (审批流程) | | Interface (审批界面) | | Service (通知) |

+-----------------------+ +-----------------------+ +-------------------+

| |

| (审批通过) |

v |

+-----------------------+ +-----------------------+ +-------------------+

| Tool Execution |<------| Sandbox /隔离环境 |<------| Audit Logging |

| Environment (执行器) | | | | (审计日志) |

+-----------------------+ +-----------------------+ +-------------------+核心组件及其职责:

- Tool Invocation Service (工具调用服务 / API Gateway):

- 接收所有来自AI代理或自动化系统的工具调用请求。

- 作为整个授权流程的入口。

- 对请求进行初步验证(例如,格式、基本认证)。

- Tool Registry (工具注册中心):

- 存储所有可调用工具的元数据,包括名称、描述、参数定义、所有者、预设风险等级、审批策略ID等。

- 是风险评估引擎的数据源之一。

- IAM / RBAC (身份与访问管理):

- 管理所有用户、系统和AI代理的身份。

- 定义角色和权限,确保只有授权的实体才能发起工具调用请求,或成为审批人。

- Policy Engine (策略引擎):

- 存储和管理授权策略,这些策略定义了在何种条件下需要何种级别的审批。

- 通常以规则集的形式存在,供风险评估引擎查询。

- Risk Assessment Engine (风险评估引擎):

- 根据Tool Registry中的工具元数据、Policy Engine中的策略以及本次调用的具体参数和上下文,实时评估本次调用的风险等级。

- 输出本次调用所需的审批级别(例如:无、低风险自动审批、高风险人工审批)。

- Approval Workflow Engine (审批工作流引擎):

- 如果风险评估结果需要人工审批,该引擎负责创建、管理审批请求的生命周期。

- 处理审批请求的状态转换(待审批 -> 已批准/已拒绝/已过期)。

- 与Notification Service集成,通知审批人。

- Human Approval Interface (人工审批界面):

- 一个Web界面或API,供人工审批者查看审批请求的详细信息(工具、参数、上下文)并做出决策。

- 必须提供清晰、易懂的审批信息。

- Notification Service (通知服务):

- 负责向审批人发送通知(邮件、即时消息、内部系统通知),提醒有待处理的审批请求。

- Tool Execution Environment (工具执行环境 / Executor):

- 在审批通过后,实际执行工具调用的环境。

- 通常是沙箱化、隔离的,遵循最小权限原则。

- 在执行前再次验证审批状态和参数,确保执行的是被批准的操作。

- Audit Logging (审计日志):

- 记录所有关键事件:工具调用请求、风险评估结果、审批请求创建、审批人决策、工具执行结果等。

- 日志应包含足够的上下文信息,且不可篡改,以满足合规性和安全审计要求。

核心组件与实现细节

现在,让我们深入到一些关键组件的实现细节,并辅以代码示例。为了清晰起见,我们将使用Python作为示例语言,结合Pydantic进行数据模型定义。

1. 工具注册与元数据管理 (Tool Registry & Metadata)

每个工具都需要一个明确的定义,其中包含其固有的风险属性和审批策略。

from pydantic import BaseModel, Field, validator

from enum import Enum

from typing import Dict, Any, Optional, List

class RiskLevel(str, Enum):

"""工具的固有风险等级"""

LOW = "LOW"

MEDIUM = "MEDIUM"

HIGH = "HIGH"

CRITICAL = "CRITICAL" # 最高风险,通常需要人工审批

class ApprovalPolicyType(str, Enum):

"""审批策略类型"""

NONE = "NONE" # 无需审批

AUTO_APPROVE_LOW_RISK = "AUTO_APPROVE_LOW_RISK" # 低风险自动审批

GROUP_APPROVE = "GROUP_APPROVE" # 特定组审批

ONE_TIME_HUMAN_APPROVAL = "ONE_TIME_HUMAN_APPROVAL" # 仅限本次人工审批

class ToolParameter(BaseModel):

"""工具参数定义"""

name: str = Field(..., description="参数名称")

type: str = Field(..., description="参数类型,如 'string', 'integer', 'boolean', 'object'")

description: Optional[str] = Field(None, description="参数描述")

required: bool = Field(True, description="是否为必填参数")

sensitive: bool = Field(False, description="是否为敏感参数,敏感参数可能需要加密或脱敏")

# 更多属性,如:pattern, enum, min/max length/value, default_value, risk_modifier等

class ToolDefinition(BaseModel):

"""

工具注册定义模型

存储在Tool Registry中

"""

id: str = Field(..., description="工具的唯一标识符")

name: str = Field(..., description="工具的友好名称")

description: str = Field(..., description="工具的详细描述")

owner: str = Field(..., description="工具的负责人或团队")

version: str = Field("1.0.0", description="工具版本")

inherent_risk_level: RiskLevel = Field(..., description="工具的固有风险等级")

parameters: List[ToolParameter] = Field([], description="工具接受的参数定义")

default_approval_policy: ApprovalPolicyType = Field(

ApprovalPolicyType.AUTO_APPROVE_LOW_RISK,

description="默认的审批策略"

)

# 额外的元数据,例如:执行环境要求、超时时间等

metadata: Dict[str, Any] = Field({}, description="其他自定义元数据")

@validator('id')

def validate_id_format(cls, v):

if not v.replace('-', '').isalnum():

raise ValueError('Tool ID must be alphanumeric or contain hyphens')

return v

# 示例工具定义

tool_definitions_db: Dict[str, ToolDefinition] = {

"db_delete_table": ToolDefinition(

id="db_delete_table",

name="删除数据库表",

description="从指定数据库中删除一张表。这是一个高风险操作。",

owner="db_admin_team",

inherent_risk_level=RiskLevel.CRITICAL, # 固有风险极高

parameters=[

ToolParameter(name="database_name", type="string", description="数据库名称", required=True),

ToolParameter(name="table_name", type="string", description="要删除的表名称", required=True),

ToolParameter(name="environment", type="string", description="操作环境 (prod/staging/dev)", required=True),

],

default_approval_policy=ApprovalPolicyType.ONE_TIME_HUMAN_APPROVAL # 默认需要人工审批

),

"file_read": ToolDefinition(

id="file_read",

name="读取文件内容",

description="读取指定路径的文件内容。",

owner="ops_team",

inherent_risk_level=RiskLevel.LOW,

parameters=[

ToolParameter(name="file_path", type="string", description="文件路径", required=True),

ToolParameter(name="max_bytes", type="integer", description="最大读取字节数", required=False, default=1024),

],

default_approval_policy=ApprovalPolicyType.AUTO_APPROVE_LOW_RISK

),

"user_update_profile": ToolDefinition(

id="user_update_profile",

name="更新用户资料",

description="更新指定用户的个人资料信息。",

owner="user_service_team",

inherent_risk_level=RiskLevel.MEDIUM,

parameters=[

ToolParameter(name="user_id", type="string", description="用户ID", required=True),

ToolParameter(name="profile_data", type="object", description="要更新的资料内容", required=True, sensitive=True),

],

default_approval_policy=ApprovalPolicyType.GROUP_APPROVE # 例如,需要用户服务团队审批

)

}

def get_tool_definition(tool_id: str) -> Optional[ToolDefinition]:

"""从注册中心获取工具定义"""

return tool_definitions_db.get(tool_id)

print(get_tool_definition("db_delete_table").json(indent=2))表格:示例工具定义及其风险评估属性

| 工具ID | 工具名称 | 固有风险等级 | 默认审批策略 | 关键参数示例 | 备注 |

|---|---|---|---|---|---|

db_delete_table |

删除数据库表 | CRITICAL |

ONE_TIME_HUMAN_APPROVAL |

database_name, table_name, environment |

极高风险,每次调用都需要人工审批。 |

file_read |

读取文件内容 | LOW |

AUTO_APPROVE_LOW_RISK |

file_path, max_bytes |

低风险,通常可自动审批。 |

user_update_profile |

更新用户资料 | MEDIUM |

GROUP_APPROVE |

user_id, profile_data |

中等风险,可能需要特定团队审批。 |

deploy_prod_code |

部署生产代码 | CRITICAL |

ONE_TIME_HUMAN_APPROVAL |

service_name, version, rollback_strategy |

影响生产环境,每次部署需人工确认。 |

2. 风险评估引擎 (Risk Assessment Engine)

这是系统的核心智能部分。它根据工具的固有风险、调用参数的敏感性、调用上下文等因素,动态评估本次调用的最终风险。

class InvocationContext(BaseModel):

"""工具调用的上下文信息"""

caller_id: str = Field(..., description="调用方ID(用户ID或服务ID)")

caller_roles: List[str] = Field([], description="调用方的角色列表")

source_ip: str = Field(..., description="调用方的IP地址")

environment: str = Field("unknown", description="操作环境 (prod/staging/dev)")

correlation_id: str = Field(..., description="本次操作的关联ID,用于日志追溯")

# 更多上下文信息,如:时间、业务流程ID等

class InvocationRequest(BaseModel):

"""

工具调用请求模型

由AI Agent或自动化系统发起

"""

tool_id: str = Field(..., description="要调用的工具ID")

parameters: Dict[str, Any] = Field({}, description="本次调用的具体参数")

context: InvocationContext = Field(..., description="本次调用的上下文信息")

class ApprovalRequired(str, Enum):

"""本次调用所需的审批级别"""

NONE = "NONE"

AUTO = "AUTO" # 可由系统自动审批

HUMAN_ONE_TIME = "HUMAN_ONE_TIME" # 仅限本次的人工审批

class RiskAssessmentResult(BaseModel):

"""风险评估结果"""

risk_level: RiskLevel = Field(..., description="评估出的本次调用的风险等级")

approval_required: ApprovalRequired = Field(..., description="基于风险和策略,所需的审批级别")

reasons: List[str] = Field([], description="评估结果的理由")

class PolicyEngine:

"""简化的策略引擎,实际可能是一个规则引擎服务"""

def get_policy_for_tool(self, tool_id: str) -> ApprovalPolicyType:

tool_def = get_tool_definition(tool_id)

if tool_def:

return tool_def.default_approval_policy

return ApprovalPolicyType.NONE # 默认安全策略

class RiskAssessmentEngine:

"""

风险评估引擎

根据工具定义、调用参数和上下文评估风险

"""

def __init__(self, policy_engine: PolicyEngine):

self.policy_engine = policy_engine

def assess_risk(self, request: InvocationRequest) -> RiskAssessmentResult:

tool_def = get_tool_definition(request.tool_id)

if not tool_def:

# 工具不存在,视为高风险或直接拒绝

return RiskAssessmentResult(

risk_level=RiskLevel.CRITICAL,

approval_required=ApprovalRequired.HUMAN_ONE_TIME,

reasons=["Tool definition not found."]

)

current_risk_level = tool_def.inherent_risk_level

reasons = [f"Inherent risk level of tool '{tool_def.name}': {current_risk_level.value}"]

# 1. 参数敏感性分析

for param_def in tool_def.parameters:

if param_def.name in request.parameters:

param_value = request.parameters[param_def.name]

if param_def.sensitive:

current_risk_level = max(current_risk_level, RiskLevel.MEDIUM)

reasons.append(f"Parameter '{param_def.name}' is sensitive.")

# 示例:针对特定参数值进行风险提升

if param_def.name == "environment" and param_value == "prod":

current_risk_level = max(current_risk_level, RiskLevel.CRITICAL)

reasons.append(f"Targeting production environment with parameter '{param_def.name}'.")

if param_def.name == "table_name" and param_value == "*" and tool_def.id == "db_delete_table":

current_risk_level = max(current_risk_level, RiskLevel.CRITICAL)

reasons.append(f"Wildcard table deletion requested for '{tool_def.id}'.")

# 2. 调用方权限与角色检查 (结合IAM/RBAC)

# 实际中会调用IAM服务检查 caller_id 和 caller_roles

if "admin" not in request.context.caller_roles and current_risk_level in [RiskLevel.HIGH, RiskLevel.CRITICAL]:

# 如果非管理员尝试执行高风险操作,风险可能进一步提升,或直接拒绝

reasons.append(f"Caller '{request.context.caller_id}' lacks admin role for high-risk operation.")

# 这里只是记录,实际中可能会有更强的策略,例如直接禁止

# 3. 策略匹配与审批级别确定

policy_type = self.policy_engine.get_policy_for_tool(request.tool_id)

approval_required = ApprovalRequired.NONE

if policy_type == ApprovalPolicyType.ONE_TIME_HUMAN_APPROVAL:

approval_required = ApprovalRequired.HUMAN_ONE_TIME

reasons.append(f"Tool's default policy '{policy_type.value}' requires human approval.")

elif policy_type == ApprovalPolicyType.GROUP_APPROVE:

if current_risk_level in [RiskLevel.HIGH, RiskLevel.CRITICAL]:

approval_required = ApprovalRequired.HUMAN_ONE_TIME # 即使是组审批,高风险也升级到人工单次审批

reasons.append(f"Tool's policy '{policy_type.value}' combined with high risk requires human approval.")

else:

approval_required = ApprovalRequired.AUTO # 假设组审批也是一种自动化审批

reasons.append(f"Tool's policy '{policy_type.value}' requires group approval (handled as auto for now).")

elif policy_type == ApprovalPolicyType.AUTO_APPROVE_LOW_RISK:

if current_risk_level in [RiskLevel.LOW, RiskLevel.MEDIUM]:

approval_required = ApprovalRequired.AUTO

reasons.append(f"Tool's policy '{policy_type.value}' allows auto-approval for current risk level.")

else:

# 即使是自动审批策略,如果评估出高风险,也应升级

approval_required = ApprovalRequired.HUMAN_ONE_TIME

reasons.append(f"Tool's policy '{policy_type.value}' overridden due to high calculated risk.")

# 最终判断:如果任何理由导致风险为CRITICAL,则强制人工审批

if current_risk_level == RiskLevel.CRITICAL:

approval_required = ApprovalRequired.HUMAN_ONE_TIME

if "CRITICAL risk detected, forcing human approval." not in reasons:

reasons.append("CRITICAL risk detected, forcing human approval.")

return RiskAssessmentResult(

risk_level=current_risk_level,

approval_required=approval_required,

reasons=reasons

)

# 示例使用

policy_engine = PolicyEngine()

risk_engine = RiskAssessmentEngine(policy_engine)

# 场景1: 删除生产环境的表 (高风险)

request_delete_prod_table = InvocationRequest(

tool_id="db_delete_table",

parameters={"database_name": "main_prod_db", "table_name": "user_data", "environment": "prod"},

context=InvocationContext(caller_id="ai_agent_001", caller_roles=["data_ops_agent"], source_ip="10.0.0.1", environment="prod", correlation_id="corr-12345")

)

result_delete_prod_table = risk_engine.assess_risk(request_delete_prod_table)

print("n--- 场景1: 删除生产环境的表 ---")

print(result_delete_prod_table.json(indent=2))

# 场景2: 读取开发环境的文件 (低风险)

request_read_dev_file = InvocationRequest(

tool_id="file_read",

parameters={"file_path": "/app/dev_log.txt", "environment": "dev"},

context=InvocationContext(caller_id="dev_user_123", caller_roles=["developer"], source_ip="192.168.1.10", environment="dev", correlation_id="corr-67890")

)

result_read_dev_file = risk_engine.assess_risk(request_read_dev_file)

print("n--- 场景2: 读取开发环境的文件 ---")

print(result_read_dev_file.json(indent=2))

# 场景3: 更新用户资料 (中风险,但被策略升级)

request_update_user_profile = InvocationRequest(

tool_id="user_update_profile",

parameters={"user_id": "U007", "profile_data": {"email": "new@example.com"}},

context=InvocationContext(caller_id="crm_system", caller_roles=["system_user"], source_ip="172.16.0.5", environment="prod", correlation_id="corr-11223")

)

result_update_user_profile = risk_engine.assess_risk(request_update_user_profile)

print("n--- 场景3: 更新用户资料 ---")

print(result_update_user_profile.json(indent=2))3. 授权工作流引擎 (Approval Workflow Engine)

该引擎负责管理审批请求的生命周期。

import uuid

from datetime import datetime, timedelta

class ApprovalStatus(str, Enum):

"""审批请求状态"""

PENDING = "PENDING"

APPROVED = "APPROVED"

REJECTED = "REJECTED"

EXPIRED = "EXPIRED"

class ApprovalRequest(BaseModel):

"""人工审批请求模型"""

id: str = Field(default_factory=lambda: str(uuid.uuid4()), description="审批请求的唯一ID")

tool_id: str = Field(..., description="请求调用的工具ID")

invocation_parameters: Dict[str, Any] = Field(..., description="本次调用的具体参数")

invocation_context: InvocationContext = Field(..., description="本次调用的上下文")

requested_at: datetime = Field(default_factory=datetime.utcnow, description="请求发起时间")

expires_at: datetime = Field(..., description="审批过期时间")

status: ApprovalStatus = Field(ApprovalStatus.PENDING, description="当前审批状态")

approver_id: Optional[str] = Field(None, description="审批人ID")

approved_at: Optional[datetime] = Field(None, description="审批通过时间")

rejection_reason: Optional[str] = Field(None, description="拒绝理由")

# 审批人信息,例如审批组ID

required_approver_group: Optional[str] = Field(None, description="需要审批的组")

# 存储原始的风险评估结果,方便审批人查看

risk_assessment_result: RiskAssessmentResult = Field(..., description="原始风险评估结果")

def is_expired(self) -> bool:

return self.status == ApprovalStatus.PENDING and datetime.utcnow() > self.expires_at

class ApprovalWorkflowEngine:

"""

负责审批请求的创建、状态管理和通知。

实际中,这会是一个持久化的服务,例如使用数据库存储审批请求。

"""

def __init__(self, notification_service: Any): # 实际中传入一个通知服务实例

self.pending_approvals: Dict[str, ApprovalRequest] = {}

self.notification_service = notification_service

def create_approval_request(

self,

invocation_request: InvocationRequest,

risk_result: RiskAssessmentResult,

approver_group: Optional[str] = None,

ttl_minutes: int = 60

) -> ApprovalRequest:

"""创建一个新的审批请求"""

expires_at = datetime.utcnow() + timedelta(minutes=ttl_minutes)

approval_req = ApprovalRequest(

tool_id=invocation_request.tool_id,

invocation_parameters=invocation_request.parameters,

invocation_context=invocation_request.context,

expires_at=expires_at,

required_approver_group=approver_group,

risk_assessment_result=risk_result

)

self.pending_approvals[approval_req.id] = approval_req

self.notification_service.send_approval_notification(approval_req) # 通知审批人

print(f"Created approval request {approval_req.id} for tool '{approval_req.tool_id}'. Expires at: {expires_at}")

return approval_req

def get_approval_status(self, request_id: str) -> Optional[ApprovalRequest]:

"""获取审批请求状态"""

req = self.pending_approvals.get(request_id)

if req and req.is_expired():

req.status = ApprovalStatus.EXPIRED

print(f"Approval request {request_id} expired.")

return req

def process_approval_decision(

self,

request_id: str,

approver_id: str,

decision: ApprovalStatus,

reason: Optional[str] = None

) -> Optional[ApprovalRequest]:

"""处理审批人的决策"""

approval_req = self.pending_approvals.get(request_id)

if not approval_req or approval_req.status != ApprovalStatus.PENDING:

print(f"Approval request {request_id} not found or not in PENDING state.")

return None

if approval_req.is_expired():

approval_req.status = ApprovalStatus.EXPIRED

print(f"Approval request {request_id} was already expired.")

return approval_req

approval_req.status = decision

approval_req.approver_id = approver_id

approval_req.approved_at = datetime.utcnow() if decision == ApprovalStatus.APPROVED else None

approval_req.rejection_reason = reason if decision == ApprovalStatus.REJECTED else None

print(f"Approval request {request_id} processed by {approver_id}: {decision.value}.")

return approval_req

# 简化的通知服务

class MockNotificationService:

def send_approval_notification(self, approval_req: ApprovalRequest):

print(f"--- NOTIFICATION ---")

print(f"New approval request for '{approval_req.tool_id}' from '{approval_req.invocation_context.caller_id}'")

print(f"Parameters: {approval_req.invocation_parameters}")

print(f"Risk: {approval_req.risk_assessment_result.risk_level.value}, Needs: {approval_req.risk_assessment_result.approval_required.value}")

print(f"Please review at [Approval UI URL]/requests/{approval_req.id}")

print(f"--------------------")

# 示例使用

notification_service = MockNotificationService()

approval_workflow = ApprovalWorkflowEngine(notification_service)

# 假设前面的高风险请求需要审批

# result_delete_prod_table (来自RiskAssessmentEngine的输出)

if result_delete_prod_table.approval_required == ApprovalRequired.HUMAN_ONE_TIME:

approval_req_obj = approval_workflow.create_approval_request(

request_delete_prod_table,

result_delete_prod_table,

approver_group="db_ops_approvers"

)

# 模拟人工审批

import time

time.sleep(1) # 模拟审批延迟

print("nApprover reviews the request...")

approved_req = approval_workflow.process_approval_decision(

approval_req_obj.id,

approver_id="human_approver_007",

decision=ApprovalStatus.APPROVED,

reason="Approved as per urgent request from ticket #12345"

)

if approved_req:

print(f"Final status for {approved_req.id}: {approved_req.status.value}")

4. 工具执行环境与沙箱 (Tool Execution Environment & Sandboxing)

只有在获得明确的“仅限本次调用”的授权后,工具才能被执行。执行器必须严格遵循最小权限原则,并在沙箱环境中运行。

class ToolExecutionResult(BaseModel):

"""工具执行结果"""

status: str = Field(..., description="执行状态 (SUCCESS/FAILURE)")

output: Optional[Dict[str, Any]] = Field(None, description="工具执行的输出")

error: Optional[str] = Field(None, description="错误信息")

executed_at: datetime = Field(default_factory=datetime.utcnow, description="执行时间")

class ToolExecutor:

"""

工具执行器,负责实际调用后端工具。

它会检查审批状态,并在隔离环境中执行。

"""

def __init__(self, approval_workflow: ApprovalWorkflowEngine):

self.approval_workflow = approval_workflow

def execute_tool(

self,

invocation_request: InvocationRequest,

approval_request_id: Optional[str] = None # 如果需要人工审批,则传入审批ID

) -> ToolExecutionResult:

"""

执行工具调用。

在执行前会检查审批状态。

"""

if approval_request_id:

approval_req = self.approval_workflow.get_approval_status(approval_request_id)

if not approval_req or approval_req.status != ApprovalStatus.APPROVED:

return ToolExecutionResult(

status="FAILURE",

error=f"Execution rejected: Approval request {approval_request_id} is not APPROVED or does not exist. Current status: {approval_req.status.value if approval_req else 'N/A'}"

)

# 关键:验证执行参数与审批时的参数是否一致

if approval_req.tool_id != invocation_request.tool_id or

approval_req.invocation_parameters != invocation_request.parameters:

return ToolExecutionResult(

status="FAILURE",

error="Execution rejected: Tool ID or parameters mismatch with approved request."

)

# 模拟工具执行,实际中会调用外部服务或执行脚本

print(f"n--- Executing Tool: {invocation_request.tool_id} ---")

print(f"Parameters: {invocation_request.parameters}")

print(f"Context: {invocation_request.context.json(indent=2)}")

# 模拟沙箱环境执行

try:

# 实际中,这里会根据 tool_id 调用不同的实际工具实现

if invocation_request.tool_id == "db_delete_table":

db_name = invocation_request.parameters.get("database_name")

table_name = invocation_request.parameters.get("table_name")

env = invocation_request.parameters.get("environment")

if env == "prod" and table_name == "user_data":

# 模拟真实高风险操作

print(f"!!!! DANGER: Deleting table '{table_name}' from production database '{db_name}' !!!!")

# raise Exception("Simulated DB Deletion Error") # 模拟失败

print(f"Successfully deleted table '{table_name}' from database '{db_name}' in '{env}' environment.")

return ToolExecutionResult(status="SUCCESS", output={"message": "Table deletion simulated successfully."})

elif invocation_request.tool_id == "file_read":

file_path = invocation_request.parameters.get("file_path")

# 模拟文件读取

content = f"Content of {file_path}: This is a simulated file content."

return ToolExecutionResult(status="SUCCESS", output={"content": content})

else:

return ToolExecutionResult(status="FAILURE", error="Tool not implemented in executor.")

except Exception as e:

return ToolExecutionResult(status="FAILURE", error=str(e))

# 示例使用

tool_executor = ToolExecutor(approval_workflow)

# 尝试执行未审批的请求

print("n--- 尝试执行未审批的删除请求 ---")

unapproved_execution_result = tool_executor.execute_tool(request_delete_prod_table, approval_req_obj.id)

print(unapproved_execution_result.json(indent=2)) # 应该会显示拒绝

# 再次尝试执行,此时已审批

print("n--- 尝试执行已审批的删除请求 ---")

approved_execution_result = tool_executor.execute_tool(request_delete_prod_table, approval_req_obj.id)

print(approved_execution_result.json(indent=2))

# 执行低风险的自动审批请求

print("n--- 执行低风险的自动审批请求 ---")

low_risk_execution_result = tool_executor.execute_tool(request_read_dev_file) # 无需审批ID

print(low_risk_execution_result.json(indent=2))5. 审计与日志 (Audit and Logging)

所有操作都必须被详细记录,以确保可追溯性和合规性。这通常通过一个独立的审计服务实现。

import logging

# 配置日志

logging.basicConfig(level=logging.INFO, format='%(asctime)s - %(name)s - %(levelname)s - %(message)s')

audit_logger = logging.getLogger('audit_log')

class AuditEvent(BaseModel):

"""审计事件模型"""

event_id: str = Field(default_factory=lambda: str(uuid.uuid4()))

timestamp: datetime = Field(default_factory=datetime.utcnow)

event_type: str = Field(..., description="事件类型,如 TOOL_INVOKE_REQUEST, RISK_ASSESSMENT, APPROVAL_DECISION, TOOL_EXECUTION")

actor_id: str = Field(..., description="触发事件的实体ID")

target_id: str = Field(..., description="事件作用的目标ID (如 tool_id, approval_request_id)")

details: Dict[str, Any] = Field({}, description="事件详情")

class AuditService:

"""审计服务"""

def log_event(self, event_type: str, actor_id: str, target_id: str, details: Dict[str, Any]):

event = AuditEvent(

event_type=event_type,

actor_id=actor_id,

target_id=target_id,

details=details

)

# 在实际系统中,这里会将事件发送到持久化存储,如Kafka, S3, ELK等

audit_logger.info(f"Audit Log: {event.json()}")

# 整合到主流程中

audit_service = AuditService()

# 模拟端到端流程中的审计点

# 1. AI Agent发起请求时

audit_service.log_event(

event_type="TOOL_INVOKE_REQUEST",

actor_id=request_delete_prod_table.context.caller_id,

target_id=request_delete_prod_table.tool_id,

details=request_delete_prod_table.dict()

)

# 2. 风险评估结果

audit_service.log_event(

event_type="RISK_ASSESSMENT",

actor_id="RiskAssessmentEngine",

target_id=request_delete_prod_table.tool_id,

details={"invocation_request": request_delete_prod_table.dict(), "assessment_result": result_delete_prod_table.dict()}

)

# 3. 创建审批请求

approval_req_obj = approval_workflow.create_approval_request(

request_delete_prod_table,

result_delete_prod_table,

approver_group="db_ops_approvers"

)

audit_service.log_event(

event_type="APPROVAL_REQUEST_CREATED",

actor_id="ApprovalWorkflowEngine",

target_id=approval_req_obj.id,

details=approval_req_obj.dict()

)

# 4. 审批人决策

approved_req = approval_workflow.process_approval_decision(

approval_req_obj.id,

approver_id="human_approver_007",

decision=ApprovalStatus.APPROVED,

reason="Approved as per urgent request from ticket #12345"

)

if approved_req:

audit_service.log_event(

event_type="APPROVAL_DECISION",

actor_id=approved_req.approver_id,

target_id=approved_req.id,

details=approved_req.dict()

)

# 5. 工具执行结果

approved_execution_result = tool_executor.execute_tool(request_delete_prod_table, approval_req_obj.id)

audit_service.log_event(

event_type="TOOL_EXECUTION",

actor_id="ToolExecutor",

target_id=request_delete_prod_table.tool_id,

details={

"invocation_request": request_delete_prod_table.dict(),

"approval_request_id": approval_req_obj.id,

"execution_result": approved_execution_result.dict()

}

)端到端流程与API设计

为了将上述组件整合,我们需要定义清晰的API接口,让AI代理或自动化系统能够与我们的动态工具授权服务交互。

API 端点示例 (RESTful 风格):

-

发起工具调用请求 (Agent/System -> Tool Invocation Service)

- Endpoint:

POST /api/v1/tool-invocations - Request Body:

InvocationRequest(tool_id, parameters, context) - Response (202 Accepted):

{ "status": "PENDING_APPROVAL", "approval_request_id": "uuid-of-approval-request", "message": "High-risk operation, awaiting human approval." } - Response (200 OK): (若自动审批通过或无需审批)

{ "status": "EXECUTED", "execution_result": { ... } // 直接返回执行结果 } - Response (400 Bad Request / 403 Forbidden): (请求格式错误或无权限)

- Endpoint:

-

查询审批请求状态 (Agent/System -> Approval Workflow Engine)

- Endpoint:

GET /api/v1/approval-requests/{approval_request_id}/status - Response (200 OK):

{ "id": "uuid-of-approval-request", "status": "APPROVED", // PENDING, REJECTED, EXPIRED, APPROVED "tool_id": "db_delete_table", "invocation_parameters": { ... }, "approver_id": "human_approver_007", "approved_at": "2023-10-27T10:30:00Z", "rejection_reason": null }

- Endpoint:

-

人工审批决策 (Human Approver -> Human Approval Interface -> Approval Workflow Engine)

- Endpoint:

PUT /api/v1/approval-requests/{approval_request_id}/decide - Request Body:

{ "decision": "APPROVED", // or "REJECTED" "approver_id": "human_approver_007", "reason": "Approved as per urgent ticket #12345" } - Response (200 OK): 更新后的

ApprovalRequest状态。

- Endpoint:

端到端流程示例 (使用上述API):

-

AI Agent 尝试删除生产数据库表:

POST /api/v1/tool-invocations

Body:{ "tool_id": "db_delete_table", "parameters": { ... }, "context": { ... } }

Service Response:202 Accepted,{ "status": "PENDING_APPROVAL", "approval_request_id": "req-123" } -

Approval Workflow Engine 创建审批请求,通知

db_ops_approvers组。 -

Human Approver 收到通知,登录审批界面,查看

req-123的详细信息。 -

Human Approver 确认无误后,点击“批准”:

PUT /api/v1/approval-requests/req-123/decide

Body:{ "decision": "APPROVED", "approver_id": "human_approver_007", "reason": "..." }

Service Response:200 OK,{ "id": "req-123", "status": "APPROVED", ... } -

AI Agent (或一个独立的执行服务) 持续轮询

GET /api/v1/approval-requests/req-123/status。

当收到{"status": "APPROVED", ...}时,AI Agent 再次(或由执行服务)调用工具执行器:POST /api/v1/tool-executions(内部API,不对外暴露)

Body:{ "tool_id": "db_delete_table", "parameters": { ... }, "approval_request_id": "req-123" }

Service Response:200 OK,{ "status": "SUCCESS", "output": { ... } } -

Audit Service 记录所有这些步骤。

安全考量

在设计和实现这样的系统时,安全是重中之重。

-

认证与授权 (Authentication & Authorization):

- 调用者认证: 确保只有合法的AI代理或系统能够发起工具调用请求。使用OAuth2、API Key或mTLS等机制。

- 审批人授权: 确保只有被授权的审批者才能访问审批界面并做出决策。实施严格的RBAC。

- API Gateway保护: 所有对外暴露的API都应通过API Gateway进行认证、授权和流量控制。

-

输入验证 (Input Validation):

- 对所有传入的调用参数进行严格的类型、格式、范围验证,防止注入攻击、恶意参数篡改。

- Pydantic等数据验证库在此发挥重要作用。

-

最小权限原则 (Least Privilege):

- 执行环境: 工具执行环境应以最小权限运行,只拥有执行特定任务所需的权限,且不能访问其他不相关资源。

- 审批人: 审批人只能看到其需要审批的请求,且只能批准/拒绝,无权修改请求内容或直接执行工具。

-

审计日志的不可篡改性 (Immutability of Audit Logs):

- 审计日志是事后追溯和合规性的基石。应将日志发送到安全的、不可篡改的存储(如WORM存储、区块链日志服务)。

- 日志应包含足够的上下文信息,包括调用者、工具、参数、时间戳、风险评估结果、审批决策和执行结果。

-

敏感参数的加密 (Encryption of Sensitive Parameters):

- 对于包含敏感信息(如数据库凭据、PII)的调用参数,在传输和存储过程中都应进行加密。

- 在审批界面展示时,可能需要对敏感参数进行脱敏处理,除非审批人明确需要查看完整内容且拥有相应权限。

-

拒绝服务保护 (DoS Protection):

- 对API端点实施速率限制、请求大小限制,防止恶意或错误的请求泛滥导致服务不可用。

-

隔离与沙箱 (Isolation & Sandboxing):

- 工具执行器应运行在与主控制平面隔离的环境中,例如Docker容器、Kubernetes Pod或虚拟机。

- 每个工具的执行都应在独立的、短暂的沙箱中进行,避免一个工具的失败或漏洞影响其他工具或核心服务。

挑战与最佳实践

实现“仅限本次调用”的人工授权系统并非没有挑战,但通过一些最佳实践可以有效应对。

-

审批延迟与用户体验 (Approval Latency & UX):

- 挑战: 引入人工审批必然会增加操作延迟,这可能影响自动化流程的效率。

- 最佳实践:

- 清晰的通知机制: 确保审批人能通过多种渠道(邮件、IM、移动App)及时收到审批请求。

- 简洁的审批界面: 审批界面应直观,清晰展示所有关键信息,减少审批人的决策负担。

- SLA与超时机制: 为审批请求设置合理的SLA和超时时间。超时后,请求应自动拒绝,并通知发起方。

- 异步处理: 整个流程应设计为异步的,调用方不需阻塞等待审批结果,而是通过轮询或Webhook接收通知。

-

审批策略的复杂性 (Complexity of Approval Policies):

- 挑战: 随着业务发展,审批策略会越来越复杂,例如“生产环境的数据库删除操作,需要DBA团队至少两人审批,且其中一人必须是高级DBA”。

- 最佳实践:

- 策略即代码 (Policy as Code): 将审批策略以可版本控制、可测试的代码形式管理。

- 规则引擎: 使用外部规则引擎(如Open Policy Agent (OPA))来管理和执行复杂策略,提高灵活性。

- 可视化策略编辑器: 为非技术人员提供可视化工具来定义和管理策略。

-

可扩展性与性能 (Scalability & Performance):

- 挑战: 随着自动化工具调用量的增加,系统需要处理大量的请求、风险评估和审批流程。

- 最佳实践:

- 无状态服务设计: 核心服务应设计为无状态,易于水平扩展。

- 消息队列: 使用Kafka、RabbitMQ等消息队列解耦组件,处理异步任务和削峰填谷。

- 缓存: 缓存工具定义、策略规则等不常变化的数据,减少数据库负载。

- 数据库优化: 选择合适的数据库(如NoSQL用于日志,关系型数据库用于审批状态),优化查询。

-

人员培训与意识 (Personnel Training & Awareness):

- 挑战: 审批人需要充分理解所审批操作的潜在风险和影响。

- 最佳实践:

- 持续培训: 定期对审批人进行培训,更新风险知识和审批流程。

- 透明化信息: 审批界面必须提供足够的信息,帮助审批人做出明智决策。

- 风险教育: 向所有参与自动化流程的人员普及安全意识和风险管理知识。

-

与现有系统的集成 (Integration with Existing Systems):

- 挑战: 系统需要与现有的IAM、ITSM(IT服务管理)、监控告警系统等集成。

- 最佳实践:

- 开放API: 提供标准化的API接口,便于与其他系统集成。

- Webhook: 支持Webhook回调,实现事件驱动的集成。

- 统一身份: 与企业级IAM系统集成,实现单点登录和统一身份管理。

展望与思考

“动态工具授权”和“仅限本次调用的人工授权”是构建安全、可信的自动化和AI系统的基石。它们不仅提供了强大的安全保障,也为未来的系统演进留下了广阔空间:

- AI辅助审批: 未来,AI自身可以作为辅助,对高风险请求进行初步分析,提供风险摘要和建议,甚至预测审批结果,从而加速人工审批流程。

- 情景感知深度: 我们可以引入更多情境信息,例如当前系统的负载、近期是否有安全事件、外部威胁情报等,进一步提升风险评估的准确性。

- 自适应策略: 借助机器学习,系统可以根据历史审批数据和执行结果,动态调整风险评估模型和审批策略,实现更智能、更灵活的授权管理。

通过精心设计和持续优化,我们能够构建出既能充分发挥自动化和AI潜力,又能牢牢掌握风险控制权的智能系统。这不仅是技术挑战,更是对我们在人与机器协作新范式下,如何确保安全与信任的深刻探索。

感谢大家的聆听!

更多推荐

已为社区贡献48条内容

已为社区贡献48条内容

所有评论(0)