显卡 6G 也能跑,阿里开源新模型,凭什么说吊打 Flux 让设计师疯狂?

阿里云开源Z-Image-Turbo-Fun-Controlnet-Union(简称Z-Controlnet),一款轻量级AI绘图工具,仅60亿参数却支持多条件精准控制。该工具可在RTX4080上9秒生成1024x1024高清图,支持姿势、边缘、深度等联合控制,显存需求仅6GB,老显卡和Mac均可流畅运行。其多条件输入能力解决了传统AI绘图不可控的问题,为电商、游戏开发等领域提供高效解决方案,大幅

你还在用AI画图时被“乱七八糟的姿势”气到砸键盘吗?阿里云这个新开源神器,直接让你随心所欲控制一切!

现在,想象一下,如果你能像导演一样,给AI发号施令:“这个人要这样摆姿势,这个建筑要严格按照我的线稿来,深度感要这么处理”——AI乖乖听话,几秒钟就吐出一张完美无缺的专业级大片。这不是科幻电影,这是2025年底阿里云实验室刚刚开源的超级武器:

Z-Image-Turbo-Fun-Controlnet-Union。

这个名字听起来超级长对吧?我们就亲切地叫它“Z-Controlnet神器”。它只有60亿参数,却干翻了那些动辄上百亿参数的大模型,甚至在很多场景下性能超过了大名鼎鼎的Flux。关键是,它完全开源、免费商用,还特别轻量——用家用显卡就能飞起。

首先,我们得聊聊它的“爸爸”——Z-Image-Turbo。 在 AI 绘画界,Flux 就像是一个肌肉发达的巨人,画质无敌,但对硬件要求极高,吃显存像吃零食一样。而 Z-Image-Turbo 走的是另一条路子:“精兵简政”。 它基于一种叫“单流扩散架构”的技术。听不懂?没关系。想象一下,以前的模型画图像是一个优柔寡断的画家,每一笔都要犹豫很久(推理步骤多);

而 Z-Image-Turbo 就像是一个受过特种兵训练的速写大师,它只需要 8 步,就能画出一张 1024x1024 的高清大图。 在 RTX 4080 这种显卡上,它只需要 9 秒。这是什么概念?你喝口水的功夫,图已经生成好了。而且,它只有 60 亿(6B)参数。在 AI 领域,这属于“轻量级”选手,但它打出的拳重(画质),却有着照片级的真实感,皮肤纹理、头发丝、光影,一个都不少。

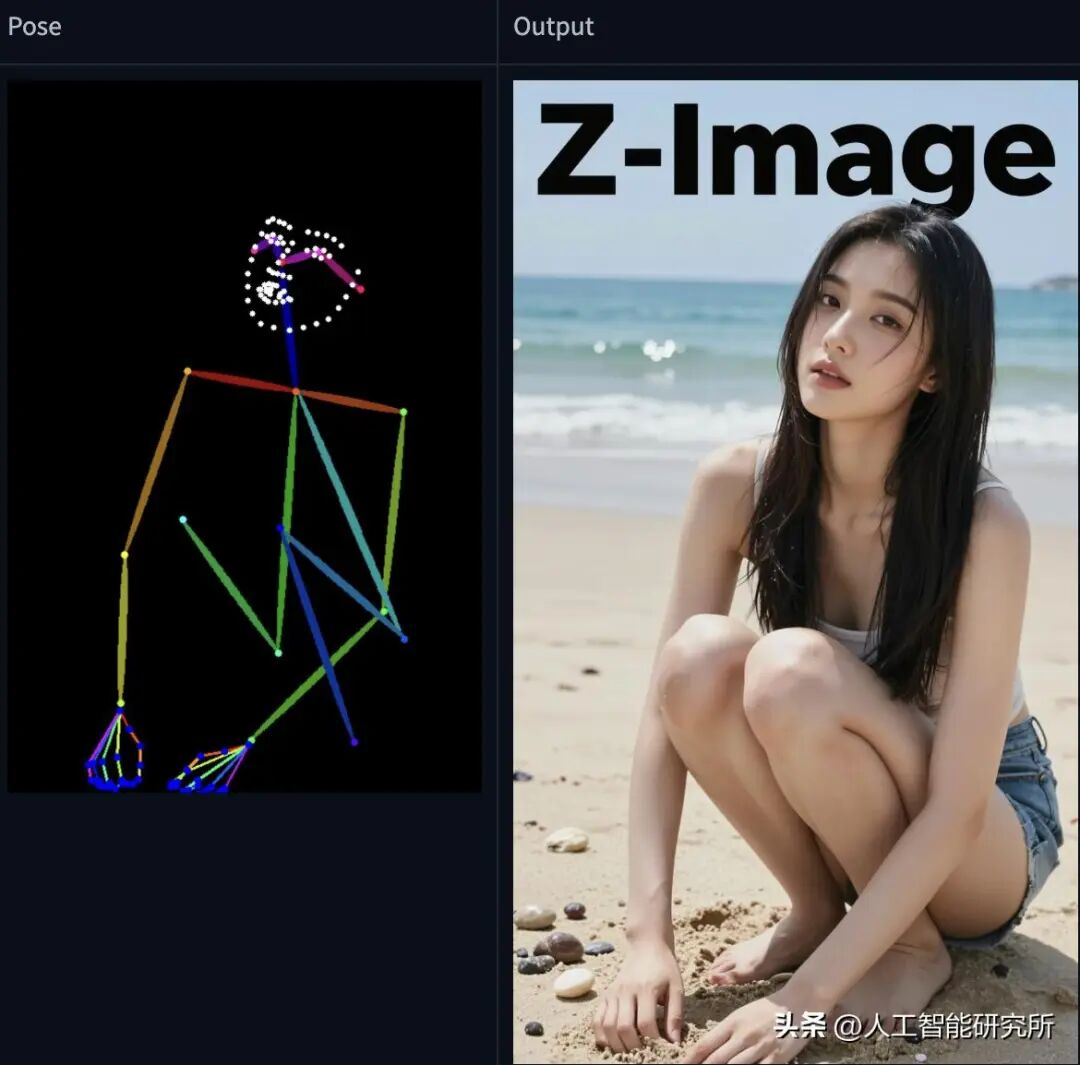

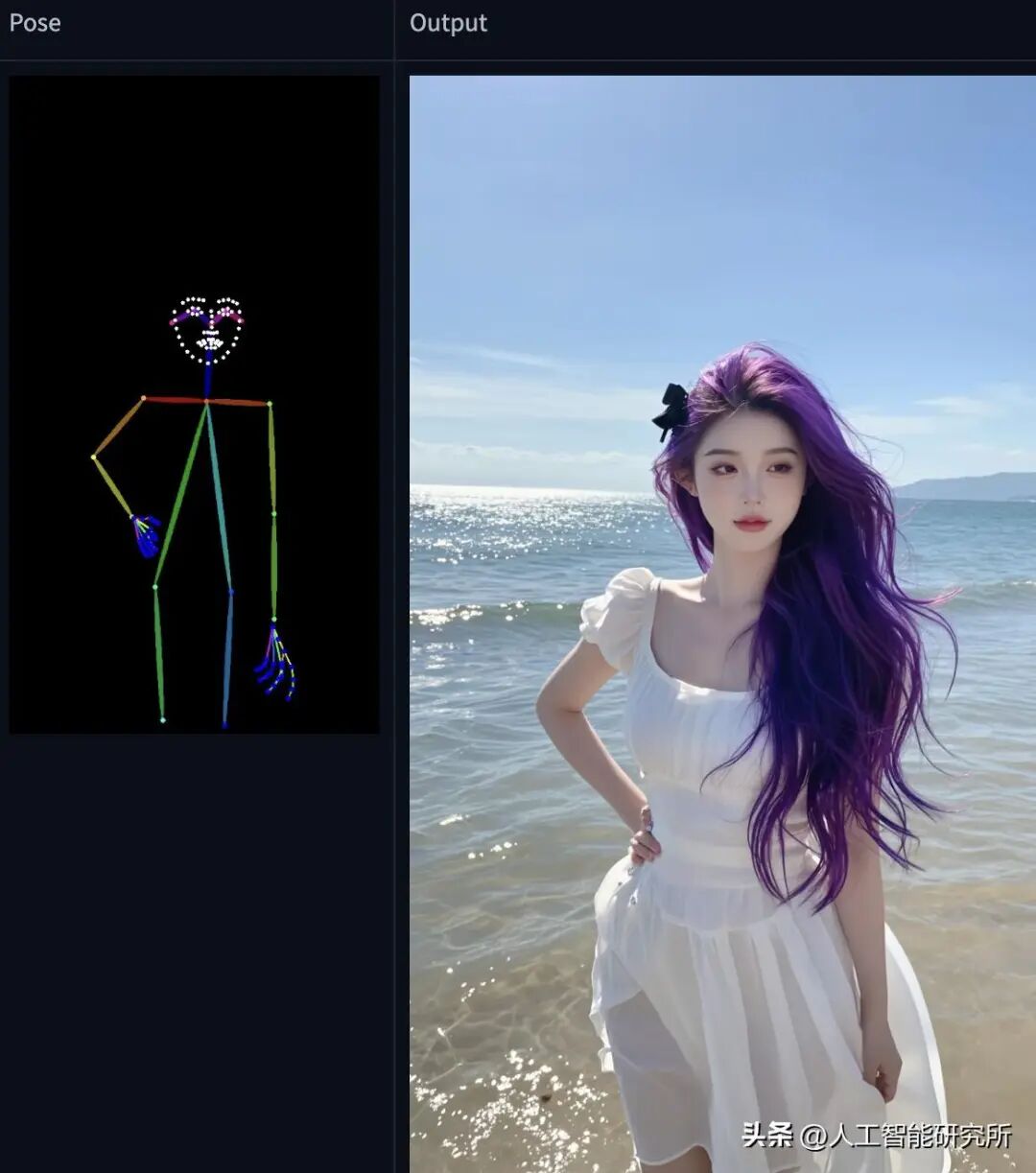

让我们从一个日常小故事说起。你是个电商卖家,想快速出几张模特穿新款衣服的宣传图。以前你得请摄影师、租场地、找模特,折腾半天。现在呢?你随便找张模特的姿势骨骼图(就像火柴人一样简单),再输入“穿红色连衣裙站在海边夕阳下”,Z-Controlnet神器就能精准还原那个姿势,衣服贴合身体,头发随风飘,皮肤纹理细腻到能看到毛孔,光影美得像专业摄影师拍的。

这就是ControlNet的魔力——它像给AI戴了个“紧箍咒”,不再让AI自由发挥乱来,而是严格按照你给的“控制条件”生成图像。

Z-Image系列从11月底一发布就火爆全网,首日下载50万次,霸榜Hugging Face热搜。它的基础版Z-Image-Turbo已经很猛了:只需要8个步骤(传统模型要几十步),在RTX 4080上9秒就能出1024x1024的高清图,还完美支持中英文混搭描述,比如“一个中国女孩 wearing red dress in ancient temple”。

但很多人说:“快是快了,就是有时候姿势不对、边缘模糊,不够听话啊!”

阿里云的工程师们听到了,于是直接放大招——推出

Z-Image-Turbo-Fun-Controlnet-Union。

什么是“Fun-Controlnet-Union”?

给 AI 装上“方向盘” 好,底子好只是第一步。这次发布的

Z-Image-Turbo-Fun-Controlnet-Union,真正的杀手锏在于后面这一长串后缀。 很多朋友玩 AI 最头疼的就是“不可控”。你让 AI 画个“正在喝咖啡的少女”,它可能画成“正在被咖啡喝的少女”,或者姿势完全不对。 这时候,就需要 ControlNet 出场了。

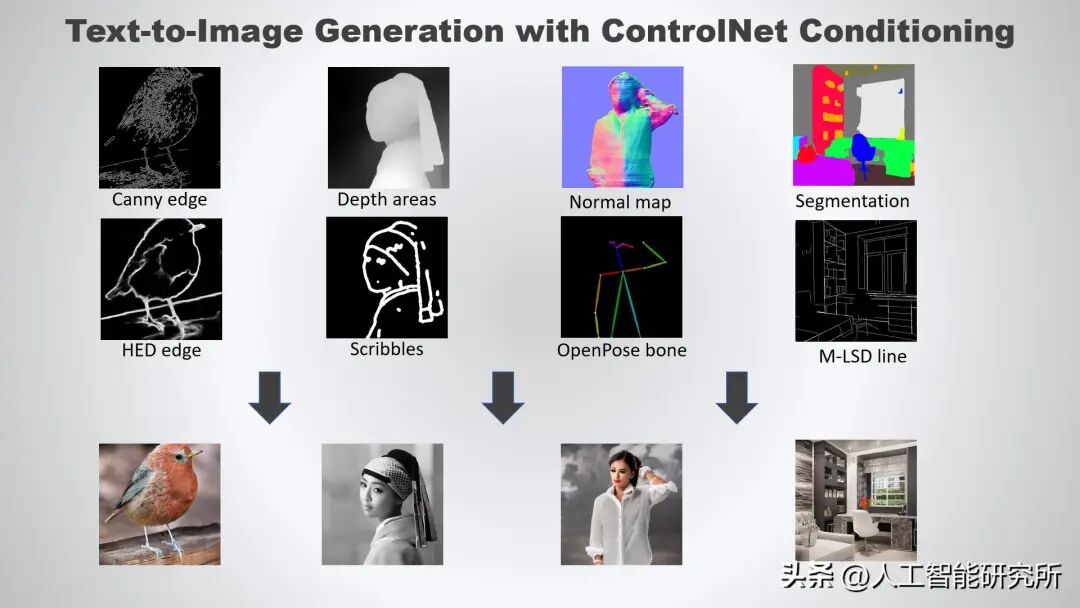

如果把生成图片比作盖房子,以前我们只能告诉 AI:“给我盖个漂亮的别墅”。至于别墅是圆的还是方的,全看运气。 而有了 ControlNet,就等于你直接把设计图纸(线稿、骨架图、深度图)拍在 AI 面前:“照着这个结构盖,砖头颜色你可以自己定,但柱子必须立在这儿!” 那么,这个“Union”又厉害在哪里呢?

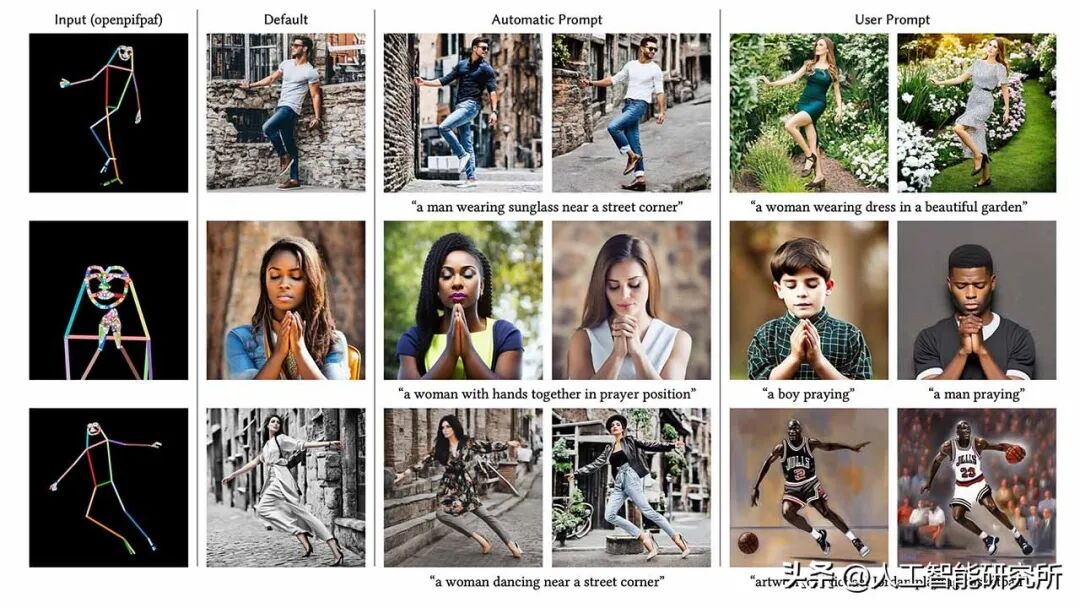

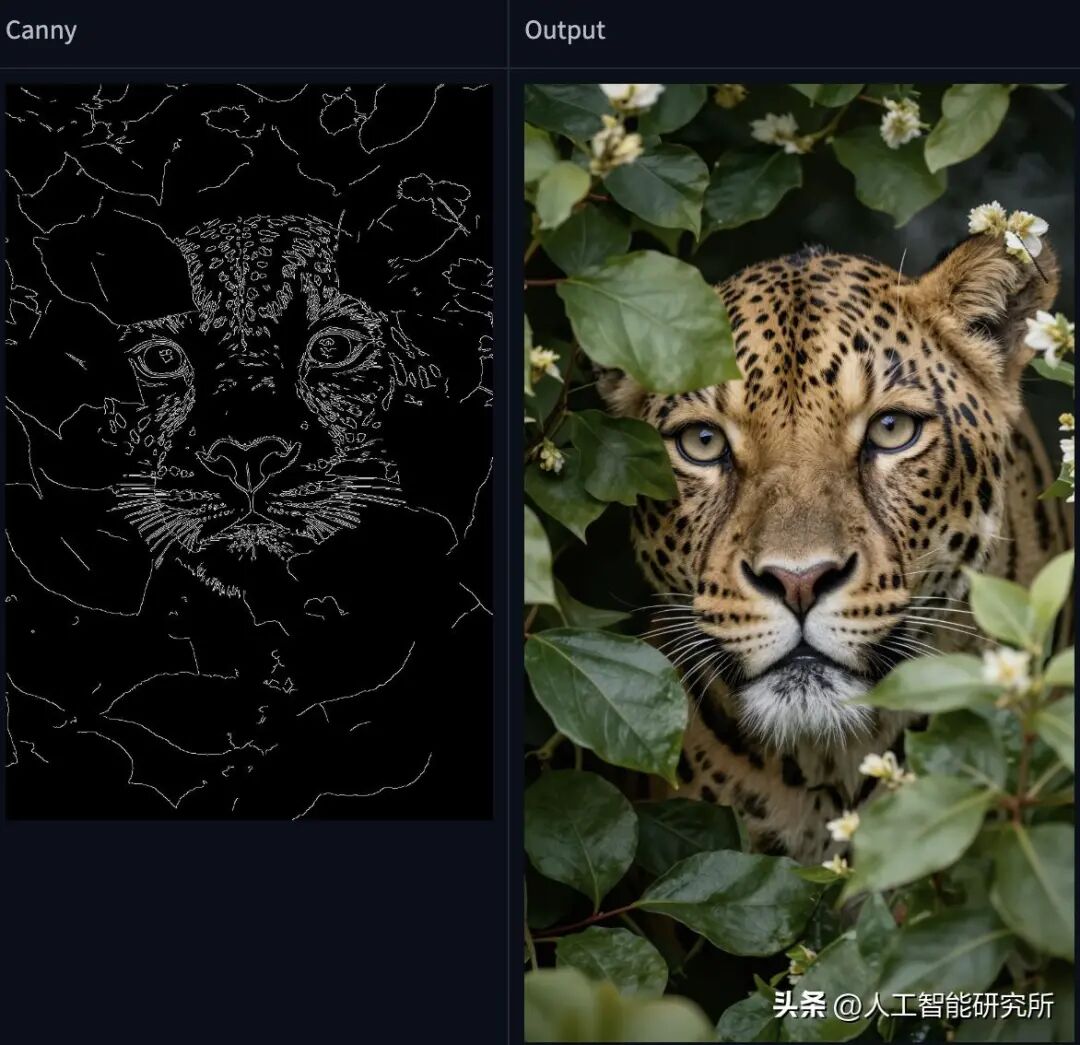

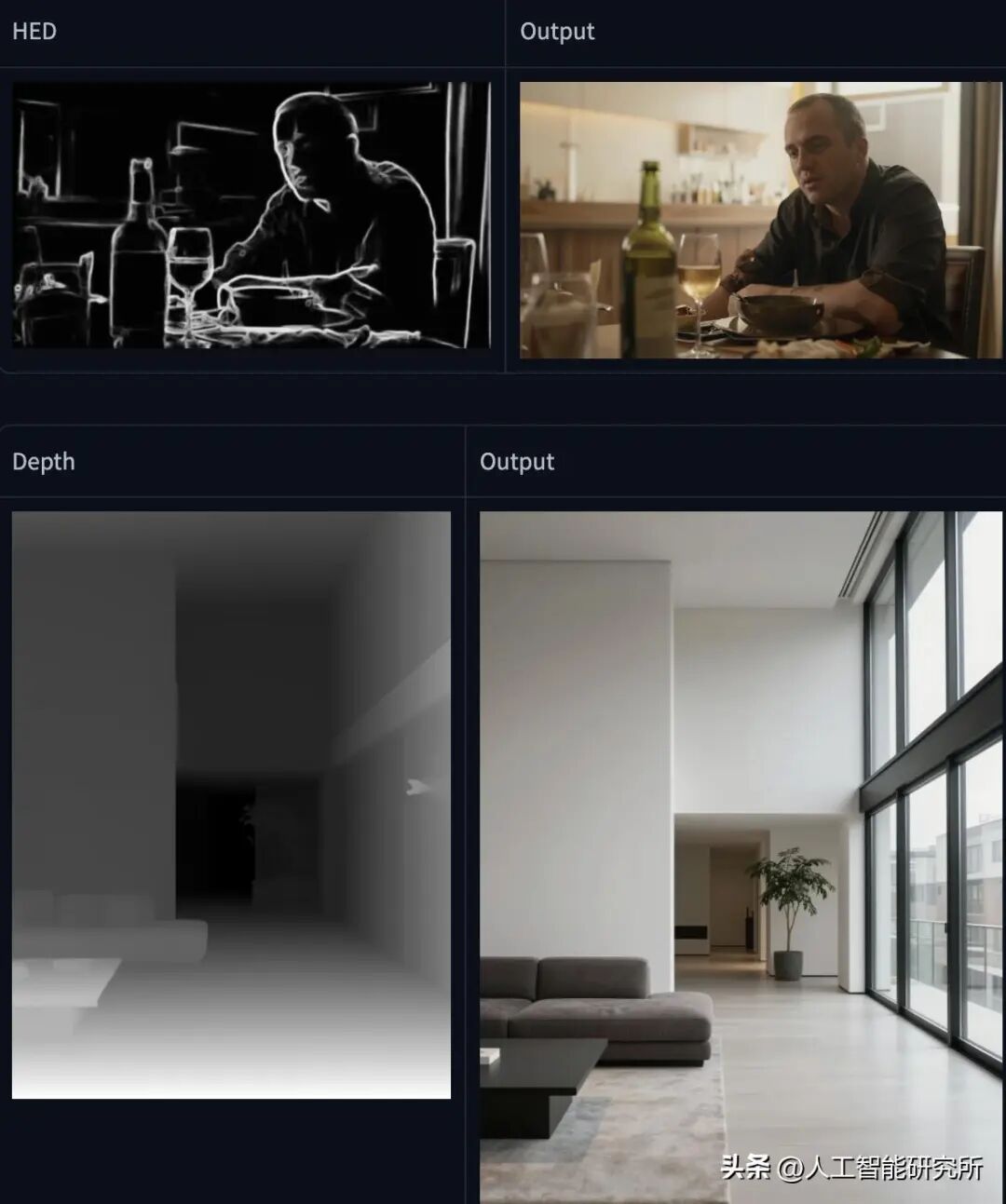

传统的 ControlNet 往往只能单线操作:要么只看边缘(Canny),要么只看姿势(Pose)。如果你既想控制人物姿势,又想控制背景建筑的线条,往往需要复杂的设置,甚至导致画质崩坏。

Z-Image-Turbo-Fun-Controlnet-Union 做到了“多合一”!

它把 ControlNet 的结构直接像乐高积木一样,插进了模型的六个核心模块里。这意味着什么? 姿态(Pose): 哪怕是瑜伽里最反人类的动作,它也能精准还原。 边缘(Canny/HED): 你随手画个火柴人草图,它能瞬间变成精美的海报。 深度(Depth): 画面的远近关系、立体感,拿捏得死死的。 它支持这些条件的联合输入。这就是所谓的“Union”。就像你请了一个全能装修队,水电、木工、油漆同时开工,而且配合默契,最终实现“零失真”的图像处理。

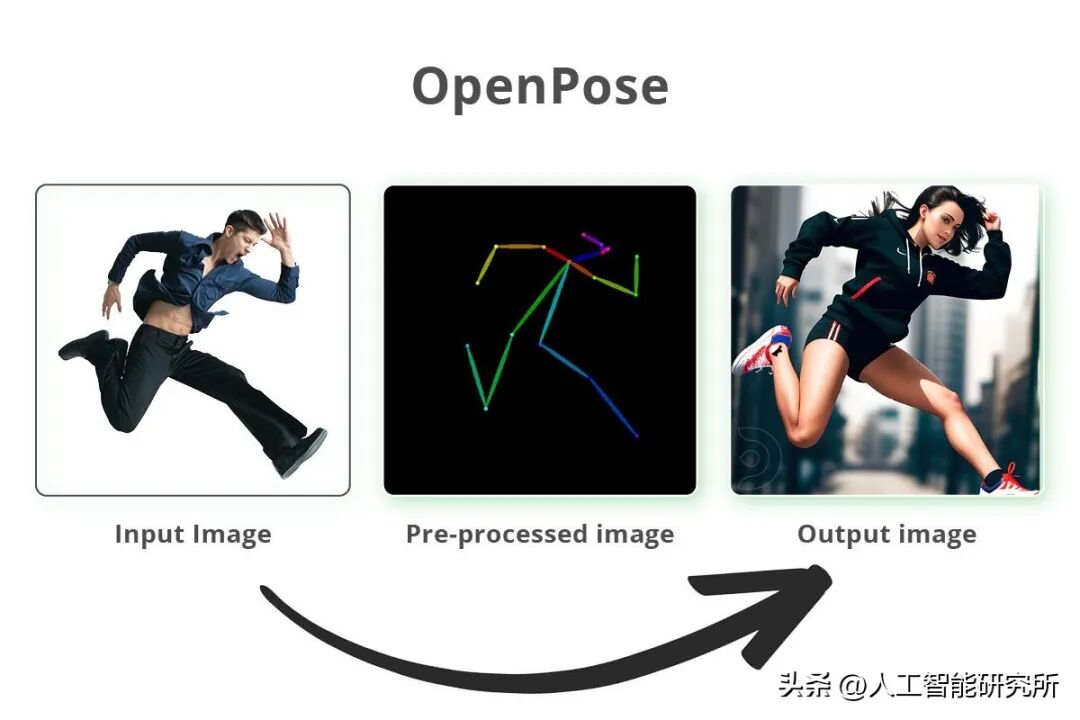

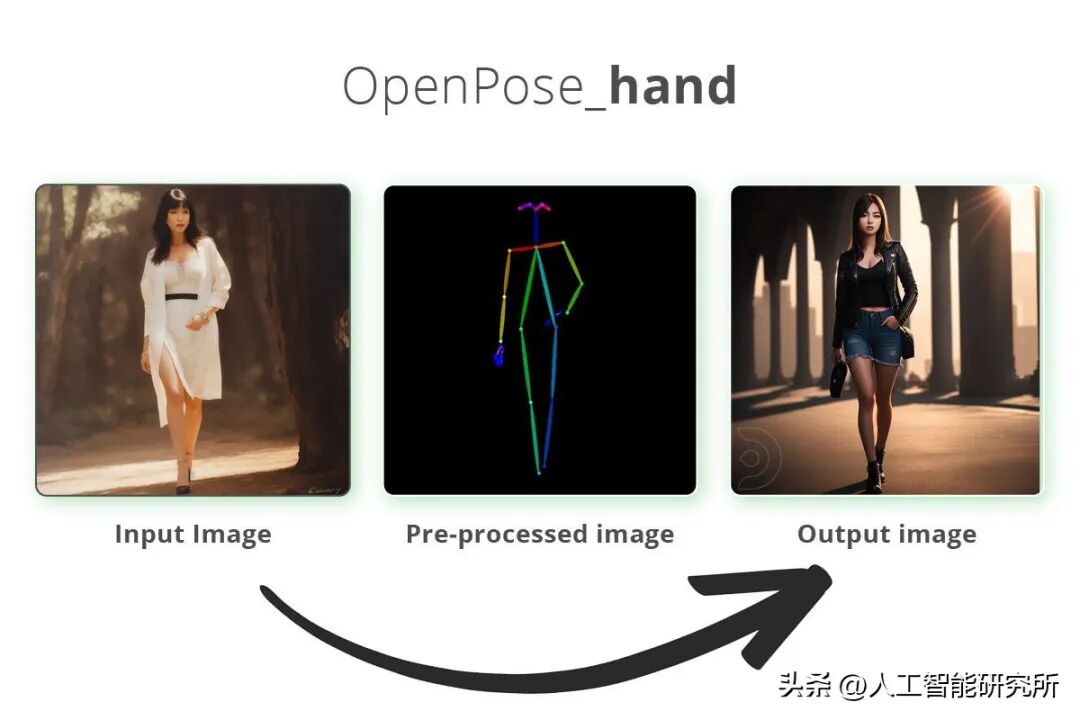

姿势控制(OpenPose):你画个简易火柴人,或者从照片提取骨骼,AI就能让生成的人物一模一样地摆出那个动作。想让人物跳舞、打篮球、优雅地喝咖啡?随便来!

边缘控制(Canny/HED):你随手画个草图,AI就能严格按照轮廓填充细节。建筑设计师画个线稿,瞬间变身逼真渲染图;时尚设计师画个衣服轮廓,马上看到上身效果。

深度控制:告诉AI哪里近哪里远,前景清晰、背景虚化,自然过渡,像专业相机拍出来的一样。

最牛的是,它支持这些控制条件“联合输入”——你可以同时扔给它姿势+边缘+深度,AI完美融合,生成“零失真”的图像。以前的ControlNet模型一用多个条件就容易崩,这家伙稳得一批。

硬件门槛低到离谱:只需要6GB显存!很多老显卡都能跑,还有4位量化版本,连Mac都能轻松部署。测试显示,即使在低端GPU上,几步就能出图,速度和质量完美平衡。

Reddit和X上到处是测试图:有人用它生成K-pop偶像,脸部识别度高到吓人;有人快速出广告素材,保真度完胜很多竞品;还有人用低参数设置(CFG 2-3)就得到超级稳定的输出,不再像以前那样抽风。

为什么说它是“显卡救星”?

接下来的内容,可能会让只有 6G、8G 显存笔记本的朋友感动落泪。 大家都知道,ControlNet 是个显存大户。通常给大模型加上 ControlNet,显存占用会瞬间飙升,那是“富人”的游戏。 但阿里的工程师们这次仿佛开了挂。他们继承了 Turbo 版本的轻量级架构,把这个超级加强版的模型,硬生生塞进了 6GB 显存 的空间里! 这意味着什么? 你不需要买 4090,你手里那台用来打 LOL 的老游戏本(RTX 3060 甚至更低),现在也能跑专业级的 AI 绘图了。

如果你是 Mac 用户(M 系列芯片),它提供了 4 位量化版本,部署起来简直不要太丝滑。 在低端 GPU 上测试,虽然速度没 4080 那么夸张,但也绝对在可接受范围内。而且,它不需要像以前那样把 CFG Scale(提示词相关性)调得很高,只需要 2-3 的低数值,画面就非常稳定。这就像一辆省油又跑得快的跑车,谁不爱?

想想看,这意味着什么?

电商卖家:几分钟出数百张产品图,再也不用请模特拍样照。

游戏开发者:快速生成角色原型和场景概念图,省下大把美术成本。

影视特效师:从草图直接到高保真预览,创意迭代快十倍。

甚至你我这样的普通人:想给自己画张梦幻头像、设计个专属壁纸,轻轻松松专业级输出。

这不只是一个模型,这是一扇大门——把专业级图像创作的门槛砸得粉碎。以前只有大公司和专业人士玩得起的工具,现在人人都能上手。

更激动人心的是,这只是开始。阿里云说,未来它会和Z-Image的其他变体(如编辑版)完美协同,形成一个完整的“生成-编辑-控制”闭环。想象一下:你先生成一张图,不满意的地方直接说“把天空换成星空,把人物衣服改成蓝色”,AI精准执行,一致性拉满。

Z-Image-Turbo-Fun-Controlnet-Union 的出现,不仅仅是多了一个模型那么简单。它在告诉我们:AI 绘画不再是拼硬件的军备竞赛,而是正在走向“高效、可控、平民化”的新时代。 目前,Python 代码版本已经出了,据说对 ComfyUI(最硬核的 AI 绘图工作流)的支持也马上就要推出。一旦接入 ComfyUI,配合它那恐怖的生成速度和控制力,这一套“组合拳”可能会彻底改变很多设计师的工作流。

我想问问大家: 如果你的电脑也能 9 秒钟生成一张大师级作品,你最想画出的画面是什么? 是小时候梦里的场景?还是这辈子都不敢想的创意设计? 别光想了,链接就在 Hugging Face 上,去试试看,也许你的显卡正在期待这场狂欢!

更多transformer,VIT,swin tranformer

参考头条号:人工智能研究所

v号:人工智能研究Suo, 启示AI科技动画详解transformer 在线视频教程

更多推荐

已为社区贡献54条内容

已为社区贡献54条内容

所有评论(0)