MCP基础上的AI智能体应用新架构设计:新范式深度剖析!

AI大模型开发新范式:MCP协议引领智能体架构变革 当前AI智能体开发面临效率瓶颈,传统模式下每个智能体需独立处理接口适配、数据解析等工作,导致重复劳动严重。MCP(模型上下文协议)应运而生,通过标准化架构解决这一痛点。该协议包含三大核心组件:MCP Server(能力提供方)、MCP Tool(具体功能)和MCP Client(调用方),形成六步标准化调用流程。相比厂商私有接口,MCP实现了跨模

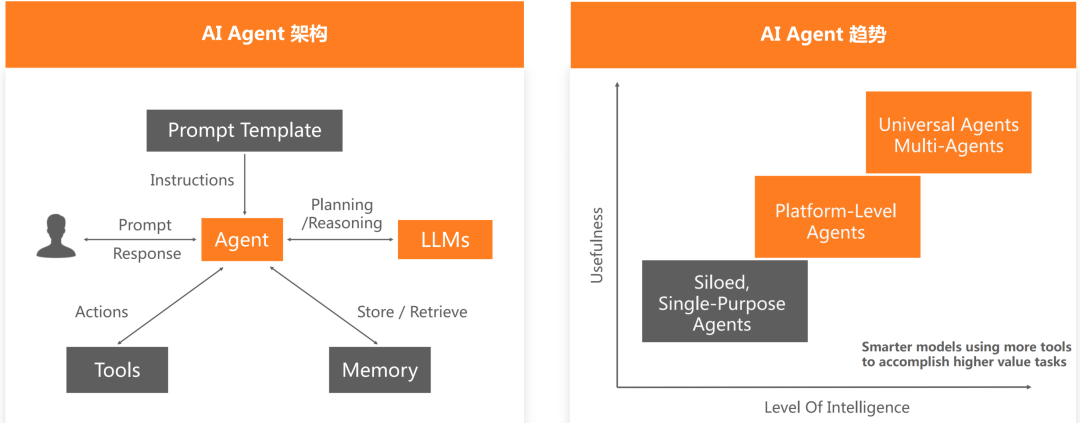

在当今数字化时代,AI 大模型正以前所未有的速度改变着我们的生活和工作方式。AI 智能体作为智能应用的核心,承载着企业创新和效率提升的重任。然而,随着业务需求的复杂化,AI 智能体的开发和部署面临着诸多挑战。传统开发模式下,每个 AI 智能体都需要独立寻找接口、解析数据、编写适配代码,导致开发效率低下、重复工作量大,严重限制了 AI 智能体应用的规模化发展。

为了解决这些问题,基于 MCP(Model Context Protocol,模型上下文协议)的 AI 智能体架构设计新范式应运而生,它通过标准化的协议和高效的协同机制,为 AI 应用的开发和部署带来了全新的架构设计思路和落地方法。

下文我们详细剖析之。

—1—

基于 MCP AI 智能体架构设计新范式

1、现状:AI 智能体还在“手工作坊”阶段

- 现状:每个 AI 智能体都要自己找接口、写适配、做编排 → 重复劳动。

- 结果:AI 智能体数量少,业务浅,无法平台化。

2、破局:MCP = AI 世界的 USB-C

从宏观上看,有以下几个组件:

第一、一句话定义

MCP(Model Context Protocol)把“找接口 + 解析数据”这两件脏活累活,全部交给 LLM 干。

第二、三个角色

- MCP Server:暴露工具的后端服务(谁提供能力)。

- MCP Tool:Server 里的具体函数(提供什么能力)。

- MCP Client:调用工具的 AI 智能体(怎么使用能力)。

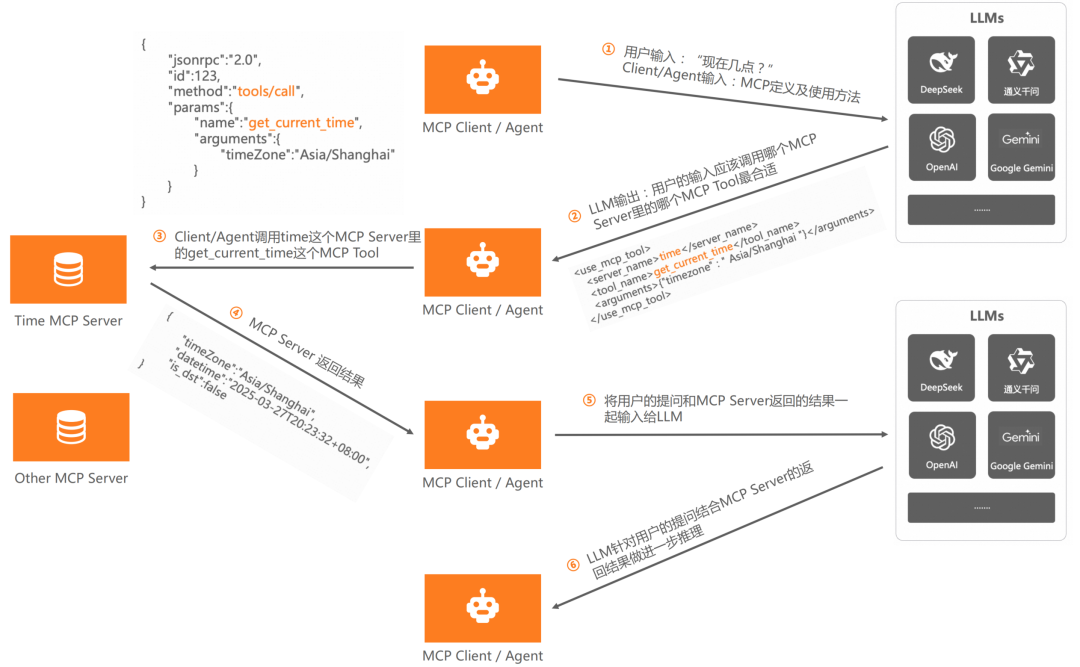

第三、运行 6 步曲

用户提问 → LLM 挑 Tool → Client 调 Server → Server 回包 → LLM 规整答案 → 返回用户。

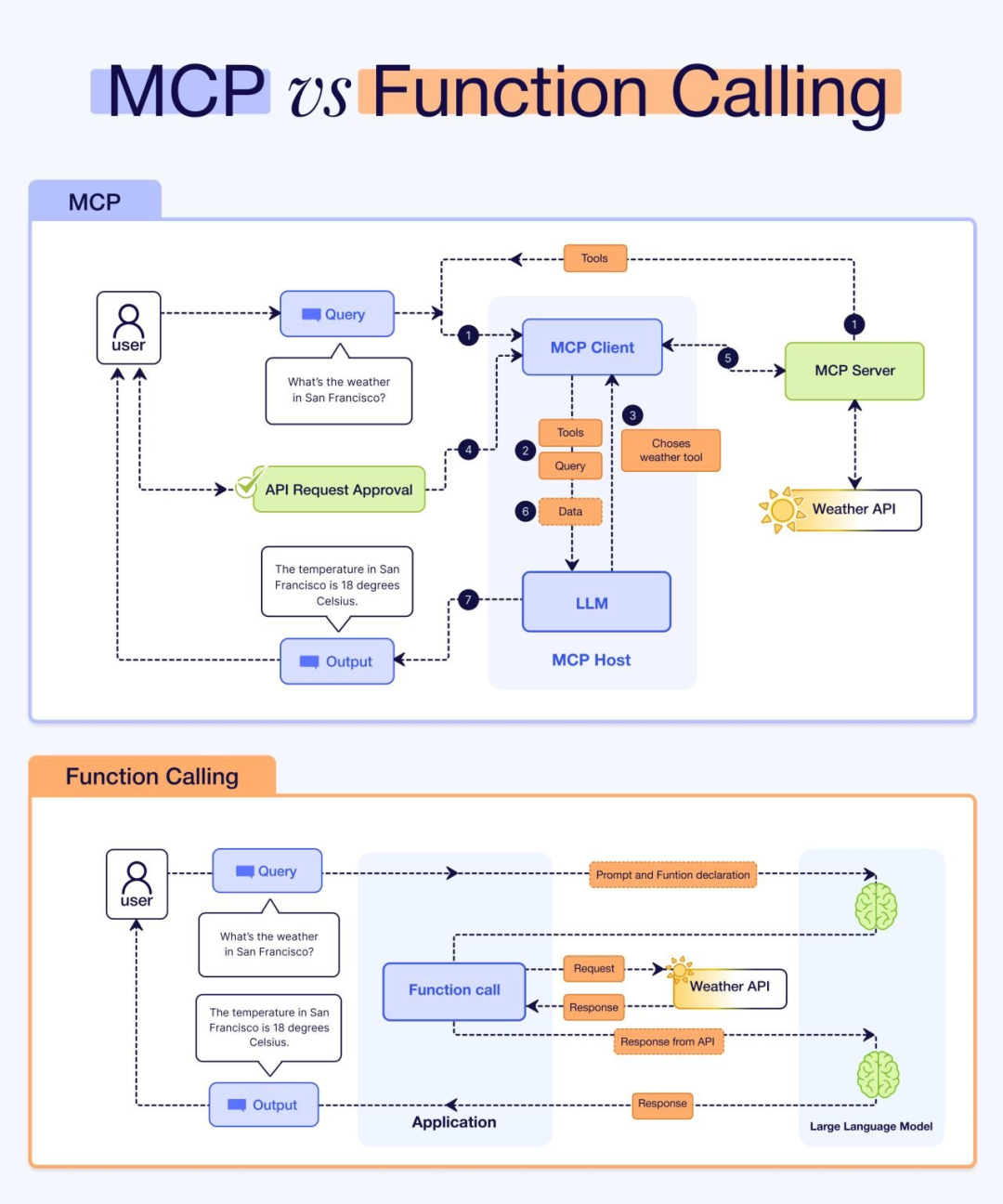

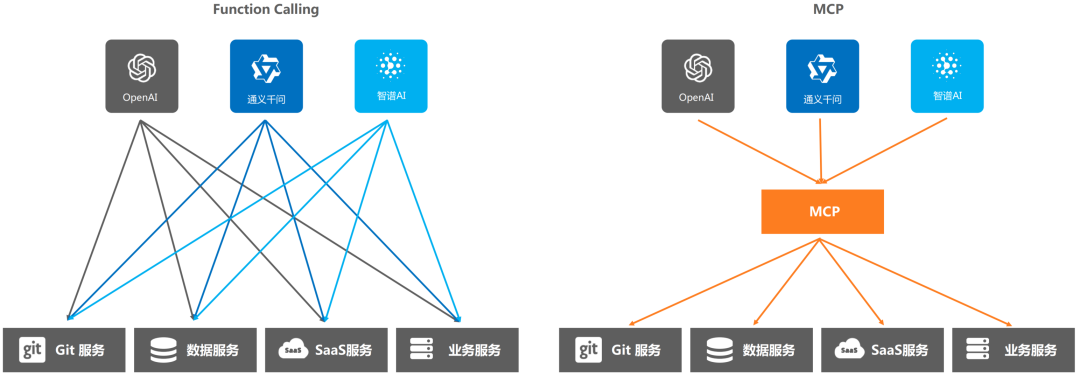

第四、MCP 与 Function Calling 的区别

Function Calling:模型厂商私有的“苹果 Lightning”接口。

MCP:跨模型通用的“USB-C”接口,零绑定,全球可复用,MCP 建立在 Function Calling 的能力基础之上。

3、基于 MCP 的 AI 智能体三大落地挑战

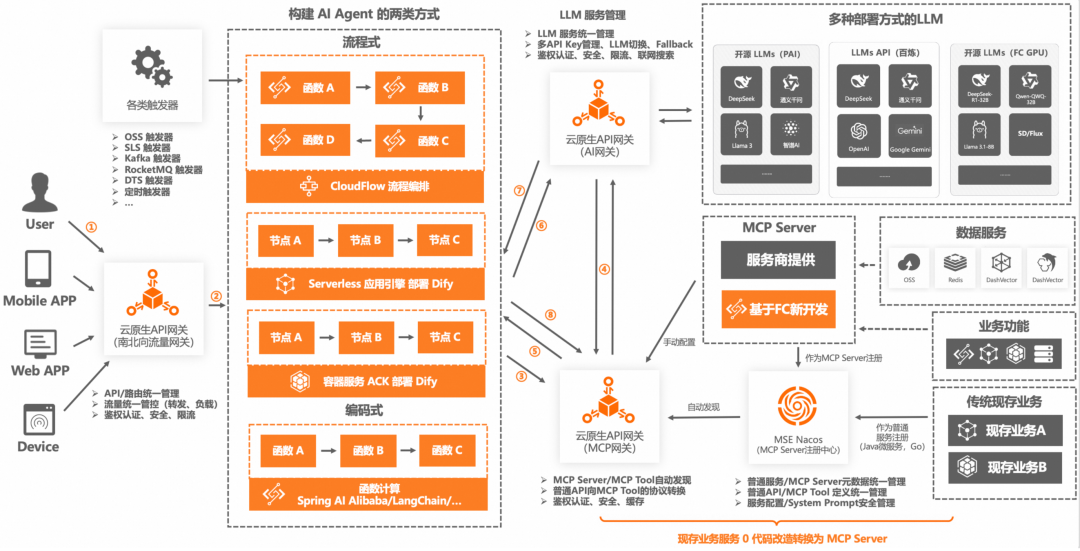

4、基于 MCP 的 AI 智能体新架构设计模式:一张图 + 三步走

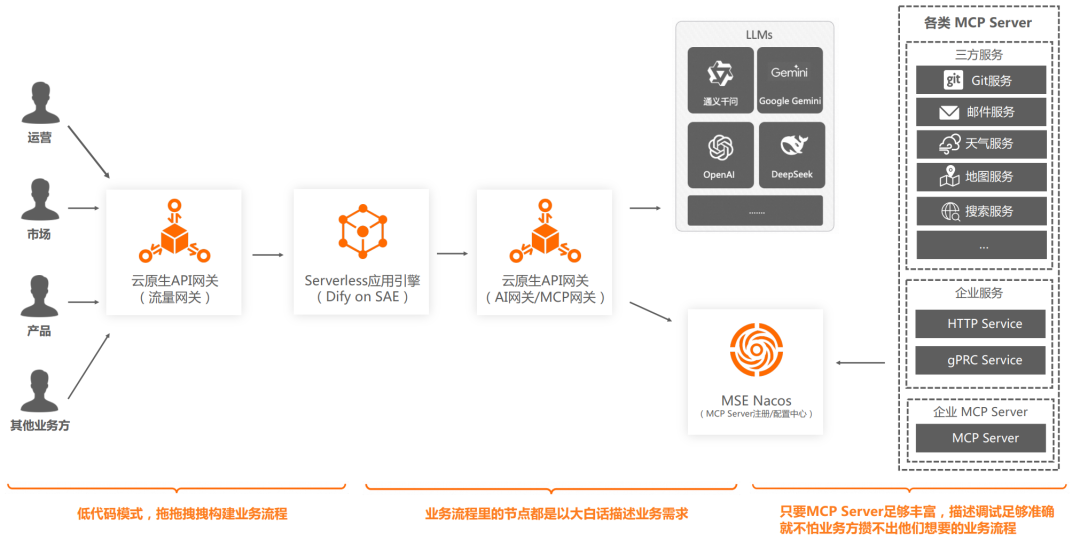

第一、一张图

用户 → 云原生 API 网关(流量网关+ API 网关 + AI 网关 + MCP 网关四重角色) → AI 事件驱动层 → AI 智能体业务逻辑层 → 大模型层 → 数据/知识层 → Nacos(新注册中心 + 新配置中心) → 新可观测中心 → 新评估体系 → 新安全防护体系 → 函数计算FC(跑 Server)。

第二、三步走

Step1 Nacos = MCP 注册&配置中心

- 服务注册:SpringCloud/Dubbo/Go 服务一键变成 MCP Server。

- 配置管理:Prompt 版本、灰度、加密、秒级生效。

- 效果验证:内置成功率仪表盘,Prompt 调优像调接口一样简单。

Step2 云原生 API 网关 = 三通一平

- 流量/API 网关:南北向统一入口,限流鉴权。

- AI 网关:代理 LLM,解决模型切换、Token 限流、幻觉兜底。

- MCP 网关:

- 动态发现 Nacos 里的 MCP Server;

- SSE ↔ Streamable HTTP 双向转换;

- 统一 OAuth2/JWT 权限,细到表级数据权限。

Step3 函数计算 FC = Serverless MCP 工厂

- 官方 MCP Runtime:写业务逻辑即可,SDK 已内置。

- 0.05C 起步,按次计费,30 s 内弹千实例,稀疏调用最省钱。

- 自带指标、链路、日志三板斧,排障像查函数日志一样简单。

5、组织升级:三种新角色

- 运维:管网关、Nacos、FC、可观测,跟云厂商打交道。

- 研发:拆业务原子能力 → 批量生产 MCP Server。

- 运营/产品:低代码拖拉拽,用自然语言拼装业务流程,PRD 即产品。

6、三步上车指南(今天就能动手)

- 把现有 Spring/Dubbo/Go 服务注册到 Nacos(无需改代码)。

- 在 Nacos 里加一条

xxx-mcp-tools.json描述文件(复制粘贴改 URL)。 - 云原生 API 网关自动生成 MCP 地址,直接用 HTTP POST 调用。

7、一句话总结

MCP 把 AI 应用从“手工打磨”带进“乐高时代”,也带入了基于 MCP 的 AI 智能体应用新架构设计范式,从此:

- 后端研发专注做 MCP Server “积木”新架构设计;

- 产品/运营像拼乐高一样搭 AI 智能体;

- 运维只操心网关与资源成本。

未来企业的 AI 竞争力,取决于在新的架构设计新范式下 MCP Server 的丰富度和拼装速度。

在大模型时代,我们如何有效的去学习大模型?

现如今大模型岗位需求越来越大,但是相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

一直在更新,更多的大模型学习和面试资料已经上传带到CSDN的官方了,有需要的朋友可以扫描下方二维码免费领取【保证100%免费】👇👇

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,下面是我整理好的一套完整的学习路线,希望能够帮助到你们学习AI大模型。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF书籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型各大场景实战案例

结语

【一一AGI大模型学习 所有资源获取处(无偿领取)一一】

所有资料 ⚡️ ,朋友们如果有需要全套 《LLM大模型入门+进阶学习资源包》,扫码获取~

更多推荐

已为社区贡献192条内容

已为社区贡献192条内容

所有评论(0)