DeepSeek 新年炸场!梁文锋领衔发布 mHC 架构,彻底解决大模型训练“炸机”难题

DeepSeek发布mHC架构解决大模型训练不稳定难题 2026年1月1日,DeepSeek创始人梁文锋领衔发布《流形约束超连接》(mHC)论文,针对大模型训练中的梯度爆炸等不稳定问题提出创新解决方案。mHC通过数学方法将超连接空间投影到特定流形,在保持高性能的同时恢复恒等映射特性,仅带来6.7%的额外计算开销。该技术被形象比喻为"智能导航系统",可有序引导数据流传递,显著提升

DeepSeek 新年炸场!梁文锋领衔发布 mHC 架构,彻底解决大模型训练“炸机”难题

2026年1月1日,DeepSeek 给 AI 圈投下了一颗重磅“炸弹”。创始人梁文锋亲自署名,发布最新论文《流形约束超连接》,直指大模型训练中的核心痛点——训练不稳定性。这一新架构有望成为继 ResNet 之后的又一座里程碑。

文章目录

01 前言:大模型训练的“阿喀琉斯之踵”

在深度学习领域,模型规模的不断扩大伴随着训练难度的指数级上升。自 2015 年 ResNet 提出残差连接以来,这一范式统治了业界十年。然而,随着模型参数迈向万亿级别,传统的连接方式开始显现疲态。

为了追求更高的性能,业内曾尝试 HC(Hyper-connections,超连接),通过拓宽残差流宽度和多样化连接模式来提升性能。但这也带来了严重的副作用:削弱了恒等映射特性,导致梯度爆炸、训练不稳定,以及巨大的内存访问开销。

今天,DeepSeek 发布的这篇论文,正是为了解决这个“卡脖子”的问题。

02 核心技术:mHC(流形约束超连接)

📄 论文概览

- 论文标题:Manifold-Constrained Hyper-connections (mHC)

- 发布时间:2026年1月1日

- 核心作者:Zhenda Xie(解振达)、Yixuan Wei(韦毅轩)、Huanqi Cao

- 重磅署名:梁文锋(DeepSeek 创始人)

💡 技术原理:什么是 mHC?

DeepSeek 提出的 mHC(Manifold-Constrained Hyper-connections) 是一个通用框架。简单来说,它通过数学方法,将超连接的残差连接空间 投影 到一个特定的流形上。

这一操作的核心目的有两个:

- 恢复恒等映射特性:保证信号在深层网络中无损传递。

- 基础设施级优化:确保在实际工程落地时的运行效率。

🆚 架构对比:ResNet vs HC vs mHC

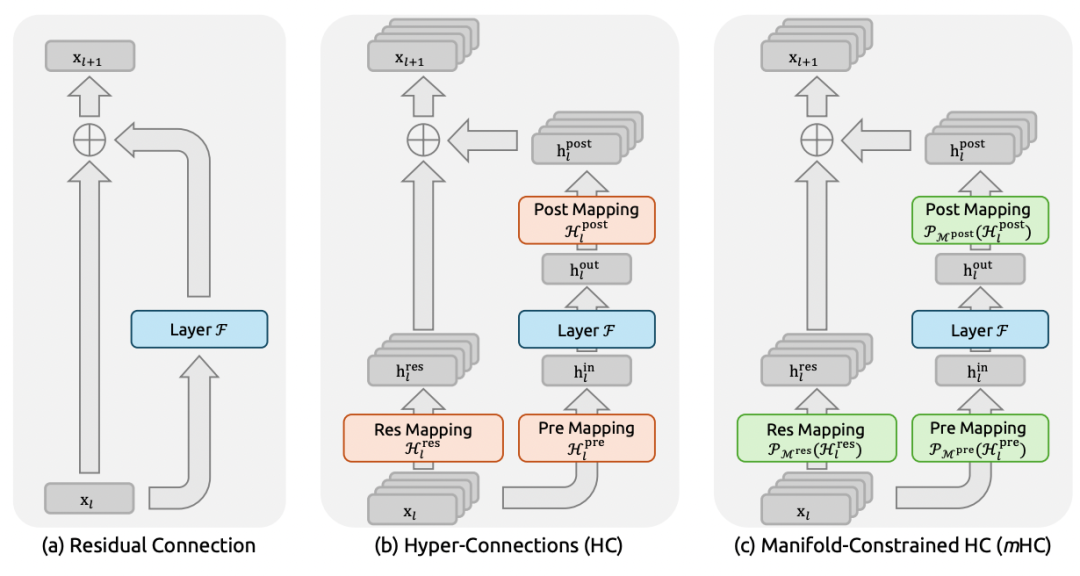

下图清晰地展示了三种架构的演进逻辑。我们可以看到,mHC 并非简单地增加连接,而是通过“约束流形”来优化连接空间,从而在保证高性能的同时,维持了训练的稳定性。

(图注:残差连接范式演进。从 标准残差连接 到 超连接,再到 DeepSeek 提出的 流形约束超连接。)

03 性能实测:仅 6.7% 的额外开销

对于开发者来说,再好的理论如果跑不动也是徒劳。DeepSeek 在论文中给出了令人振奋的实测数据:

在内部大规模训练中,当扩展率 n = 4 n=4 n=4 时,mHC 仅带来了 6.7% 的额外时间开销。

这意味着,开发者几乎不需要付出额外的计算成本,就能获得:

- ✅ 显著的性能提升

- ✅ 优异的可扩展性

- ✅ 稳定的大规模训练支持

04 通俗解读:给大模型装上“智能导航”

很多同学可能对上面的数学概念感到头大。我们可以用一个非常形象的例子来理解这项技术的突破。

背景:

- ResNet 时代:训练模型就像几百人排队玩传话游戏。为了让后面的人听清,允许后面的人直接听最前面的人喊(残差连接)。但这导致最后一层收到的信号量太大,全是噪音,容易直接“崩溃”(梯度爆炸)。

- HC 时代:DeepSeek 24年9月提出的 HC 相当于把单车道变成了四车道,路宽了,但车流无序,经常追尾,依然不稳定。

mHC 的突破:

2026年1月1号,DeepSeek 发布的 mHC 架构,相当于给每个人都发了一个 “智能导航系统”。

它实时引导数据流从不同的“高速公路”走,保证 进来多少车、出去也是多少车。车速依旧快,但不再撞车。mHC(流形约束) 就像是这个系统的底层规则,从数学上保证了信号传递和梯度的双向畅通。

这也就是为什么论文中说,mHC 将“避免训练半天梯度爆炸无法收敛”。

05 DeepSeek 近期“大动作”回顾

DeepSeek 最近的发布节奏非常密集,从学术到工程,全面发力:

- 2025年12月1日:发布 DeepSeek-V3.2 和 DeepSeek-V3.2-Speciale。

- V3.2 在推理 Benchmarks 上达到 GPT-5 水平;

- Speciale 版本则强化了数学证明和逻辑验证,媲美 Gemini-3.0-Pro。

- 2025年9月29日:发布 DeepSeek-V3.2-Exp,引入稀疏注意力机制,API 价格腰斩(降价 50%+),开发者狂喜。

- 2025年9月17日:登顶 Nature 封面。

- DeepSeek-R1 论文成为中国大模型研究首个 Nature 封面。

- 《自然》评价:“几乎所有主流的大模型都还没有经过独立同行评审,这一空白终于被 DeepSeek 打破。”

06 总结与展望

DeepSeek 的这一新论文,不仅仅是一次学术上的“炫技”,更是对深度学习基石的一次加固。

- 理论层面:mHC 为拓扑架构设计提供了新思路,未来可能会催生更多关于“几何约束”与“可塑性-稳定性”平衡的研究。

- 工程层面:它让超大规模模型的训练变得更加“驯服”,降低了模型炸机的风险。

对于正在深耕大模型训练的开发者和研究员来说,mHC 架构无疑值得关注和尝试。期待 DeepSeek 后续开源相关的实现代码!

👍 觉得文章有用?点个赞吧!

💬 欢迎在评论区讨论:你认为 mHC 会取代 ResNet 成为新的标配吗?

标签:#DeepSeek #大模型 #深度学习 #梁文锋 #人工智能 #mHC

更多推荐

已为社区贡献63条内容

已为社区贡献63条内容

所有评论(0)