AI Agent 在汽车上的应用

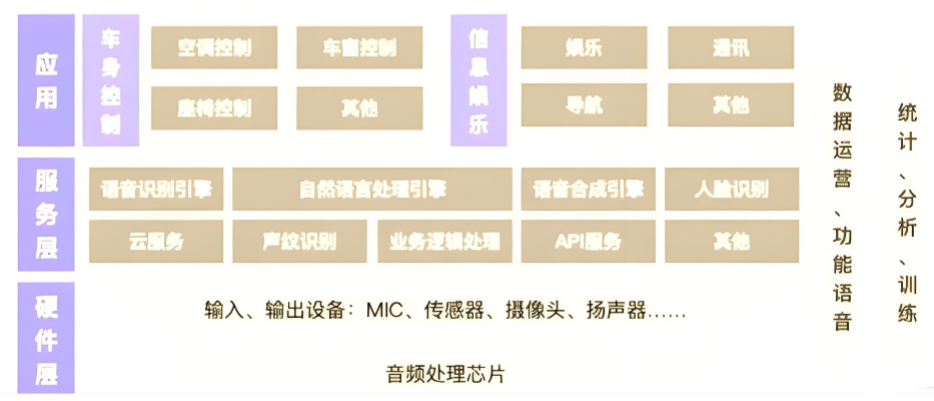

智能座舱多模态交互AI Agent的核心优势在于突破单一交互模态的局限性,实现语音、视觉、触觉、生物识别等多模态的深度融合与协同交互,构建更贴近人类本能、更符合直觉的超自然交互(Natural UI)模式,大幅提升驾驶场景下的交互安全性与便捷性。语音交互是当前最核心的交互模态,依托端侧ASR(自动语音识别)、TTS(语音合成)与多轮对话技术,实现免唤醒指令响应、方言识别与情感化回复等高级功能。端侧

1 AI Agent是什么

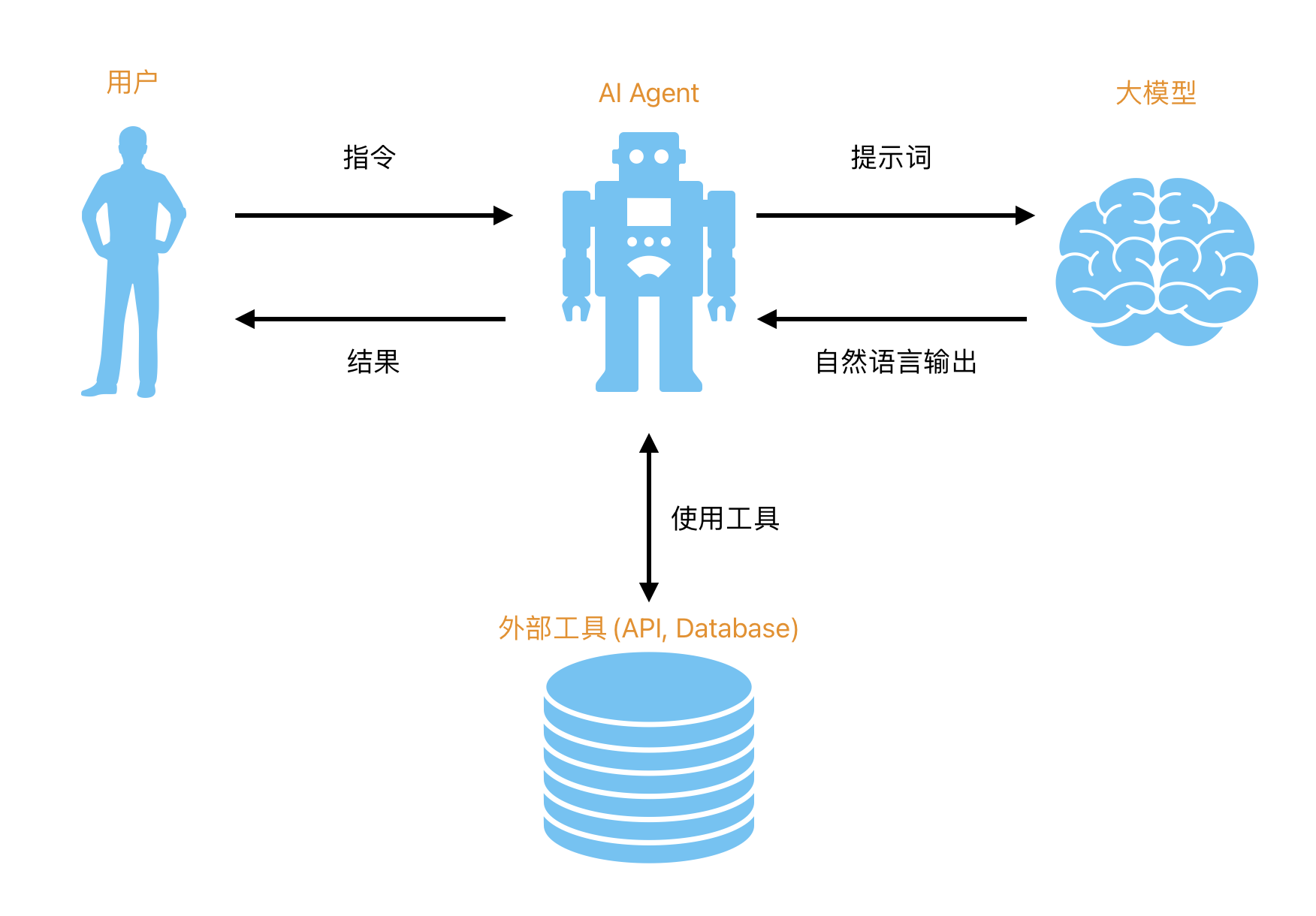

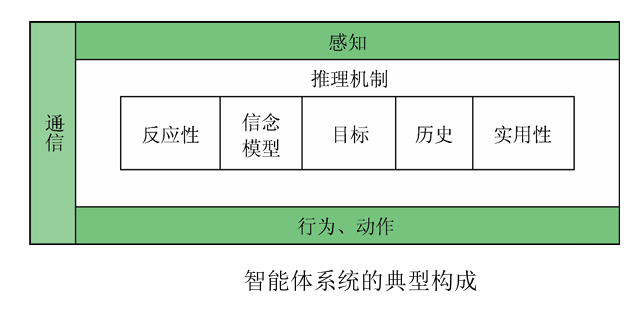

AI Agent 全称 Artificial Intelligence Agent,即人工智能智能体,是一种能够自主感知环境、做出决策、执行动作,并持续与环境和其他主体交互的智能系统。

简单来说,AI Agent 不是一个单一的算法模型,而是一套具备 “感知 - 决策 - 执行 - 反馈” 闭环能力的智能体,核心特点是自主性、交互性、适应性。

汽车领域,AI Agent 通常以 “多智能体协同” 的形式存在。从近两年开始,AI Agent 在汽车上正从单点功能升级为全链路场景化智能中枢。覆盖智能座舱、自动驾驶、车联网服务与车辆运维四大领域,通过多模态感知、意图理解与跨系统协同,显著提升驾驶安全、交互效率与用车体验。

2 汽车上的核心应用领域

2.1 智能座舱

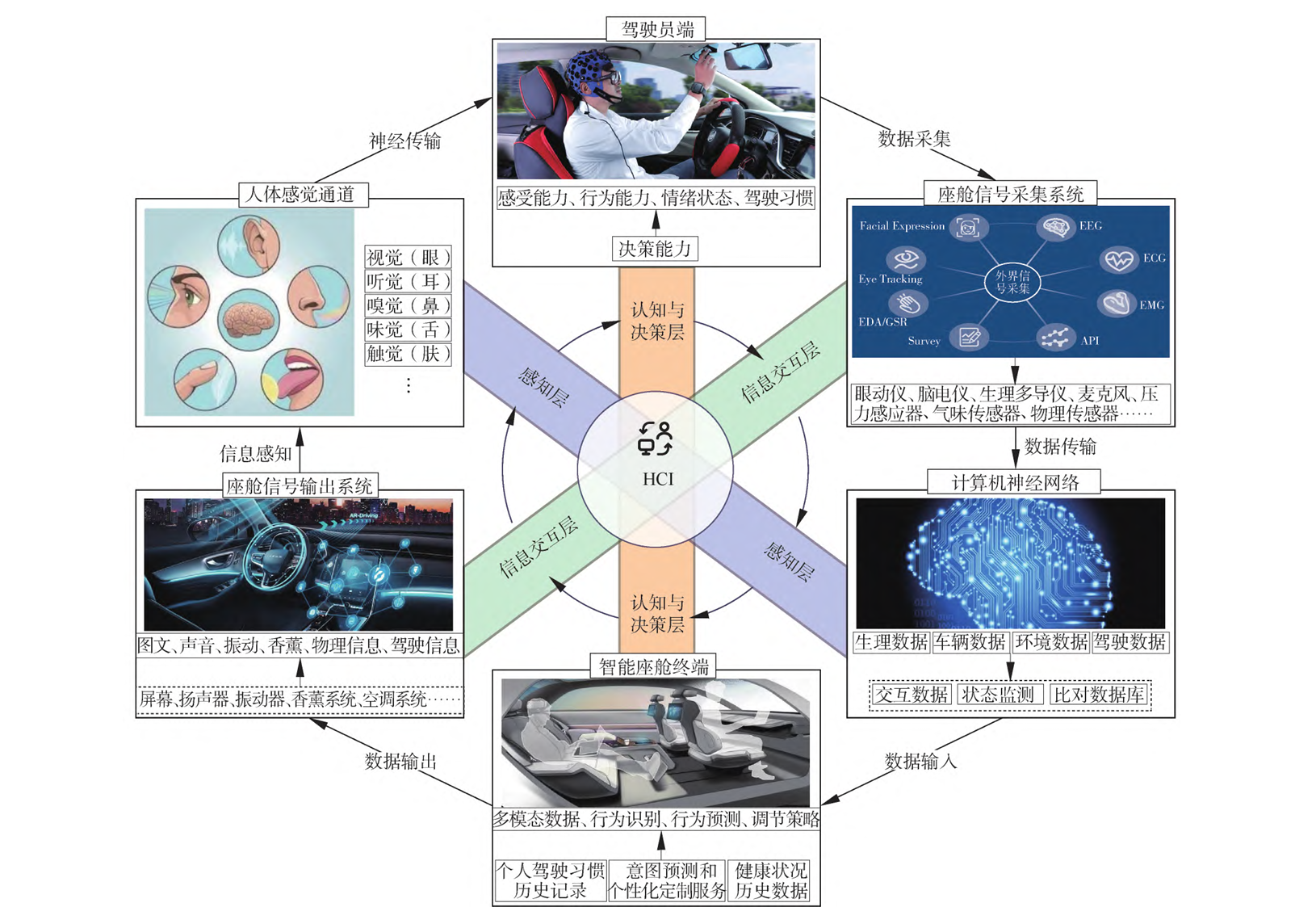

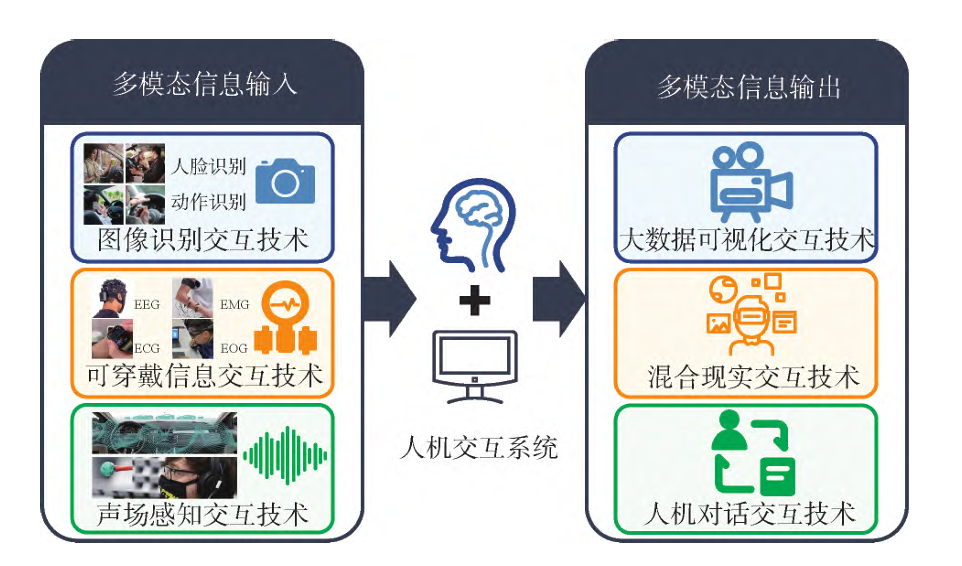

智能座舱多模态交互 AI Agent 是以端侧大模型为核心,融合语音、视觉、触觉、生物识别等多通道数据,具备 “感知 - 理解 - 决策 - 执行 - 反馈” 闭环能力的智能体,能主动理解用户模糊意图并跨模态协同提供场景化服务,是座舱从被动响应迈向主动智能的核心载体。

2.1.1 核心模块

|

层级 |

核心组件 |

功能说明 |

技术要点 |

|

感知层 |

麦克风阵列、DMS/OMS摄像头、力反馈传感器、生物识别模块 |

采集语音指令、人脸/手势/情绪、触控压力等多源数据 |

端侧实时处理,延迟<200ms,抗干扰算法 |

|

理解层 |

多模态大模型(如文心、通义千问)、意图推理引擎、记忆模块 |

融合解析语义、视觉信息,理解上下文与用户习惯 |

模型蒸馏压缩、联邦学习保障隐私 |

|

决策层 |

多Agent协同调度器、场景规则引擎 |

拆解复杂需求,分配任务至各功能Agent(导航/支付/娱乐) |

A2A协议标准化接口,动态优先级调度 |

|

执行层 |

车载ECU、生态API(支付宝/高德)、硬件控制接口 |

执行空调/座椅调节、服务下单、导航规划等操作 |

硬件抽象层,跨域服务原子化调用 |

2.1.2 交互种类介绍

智能座舱多模态交互AI Agent的核心优势在于突破单一交互模态的局限性,实现语音、视觉、触觉、生物识别等多模态的深度融合与协同交互,构建更贴近人类本能、更符合直觉的超自然交互(Natural UI)模式,大幅提升驾驶场景下的交互安全性与便捷性。

语音交互是当前最核心的交互模态,依托端侧ASR(自动语音识别)、TTS(语音合成)与多轮对话技术,实现免唤醒指令响应、方言识别与情感化回复等高级功能。端侧ASR技术的识别准确率已提升至98%以上,能够有效应对高速行驶、空调开启等嘈杂环境下的语音识别需求;TTS技术则支持情感化语音合成,可根据场景氛围与用户情绪调整语音的“喜怒哀乐”,增强交互的拟人化体验。

多轮对话能力则允许用户在不重复唤醒的情况下完成连续指令输入,例如用户先说出“去公司”,后续补充“走最快的路线”,系统可自动关联上下文完成路线调整,无需重新触发唤醒指令。

视觉交互作为语音交互的重要补充,通过3D手势识别、眼动追踪、DMS等技术拓展交互边界,实现“无接触”的精准控制。3D手势识别技术可识别抬手、挥手、握拳等常见手势,支持切歌、静音、调节音量等功能的手势触发;眼动追踪技术则通过捕捉用户视线焦点,实现“视线选屏”的交互模式,减少驾驶过程中的触控操作;

DMS系统则实时监测驾驶员的眨眼频率、头部姿态等特征,当检测到驾驶员频繁眨眼或打哈欠等疲劳信号时,自动触发提神机制——推送轻柔音乐、调低空调温度或开启香氛,保障驾驶安全。部分高阶方案还具备场景化视觉感知能力,例如感知到孩子入睡后主动调低音量,发现交警贴条时及时提醒车主,体现出场景化的主动关怀。

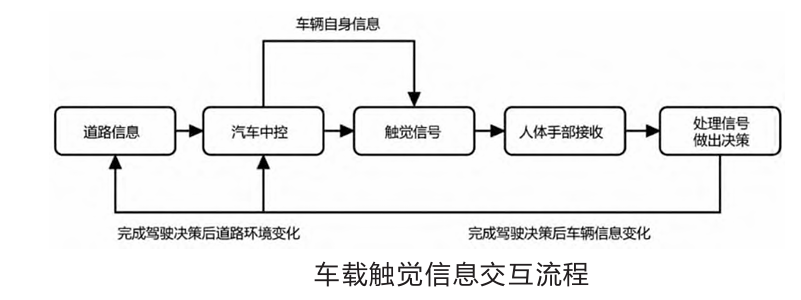

触觉交互聚焦于“盲操作反馈”与“安全预警”两大核心需求,通过力反馈方向盘、座椅震动、压感屏等硬件载体传递交互信息。在导航场景中,当车辆即将转弯时,力反馈方向盘会通过单侧震动向驾驶员传递转向提醒,配合语音播报实现“听觉+触觉”的双重预警,提升导航指令的感知效率;压感屏则通过不同强度的触觉反馈区分不同操作的触发状态,帮助用户在不注视屏幕的情况下完成盲操作,减少驾驶分心。

座椅震动功能则可与ADAS(高级驾驶辅助系统)联动,当检测到车道偏离或前方碰撞风险时,通过座椅特定区域的震动向驾驶员发出预警,提升安全提醒的有效性。

生物识别交互则聚焦于身份认证与个性化服务触发,核心技术包括面部识别、掌静脉识别与心率监测等。

面部识别技术可实现驾驶员身份的自动认证,认证通过后自动调整座椅位置、后视镜角度、空调温度等个性化设置,并推送常用路线;掌静脉识别则凭借更高的安全性,用于支付验证、车辆解锁等敏感操作;心率监测技术则通过采集驾驶员心率数据,评估其身体状态,在长途驾驶中若检测到心率异常,主动推荐休息区并规划停靠路线。

多模态融合交互是该Agent的高阶能力,通过跨模态对齐算法与场景化决策引擎,实现多通道数据的协同分析与联合响应,破解单一模态交互的局限性。

例如用户说“打开天窗”的同时做出抬手动作,系统通过“语音+视觉”的双模态验证快速响应,避免误触发;当用户说出“我冷”时,系统通过“语音指令+环境温度数据”的融合分析,同步执行空调升温、座椅加热操作,并通过语音完成结果反馈;在“下班买咖啡”的场景中,系统则整合语音下单、导航规划、免密支付等多环节能力,实现从指令输入到服务完成的全链路闭环,无需用户多轮操作。

2.1.3 与传统交互系统的差异

2.2 智能驾驶

随着人工智能技术的迭代升级,AI Agent(智能体)凭借其自主性、适应性、交互性与学习性的核心特征,已成为智能驾驶系统从“规则驱动”向“数据驱动”转型的核心支撑。

作为连接车辆硬件与驾驶任务的“大脑”,AI Agent贯穿智能驾驶“感知-决策-执行”全链路,推动驾驶自动化水平从L2级辅助驾驶向L4级高阶自动驾驶加速演进,同时在提升行车安全、优化交通效率、降低商业化落地成本等方面展现出关键价值。

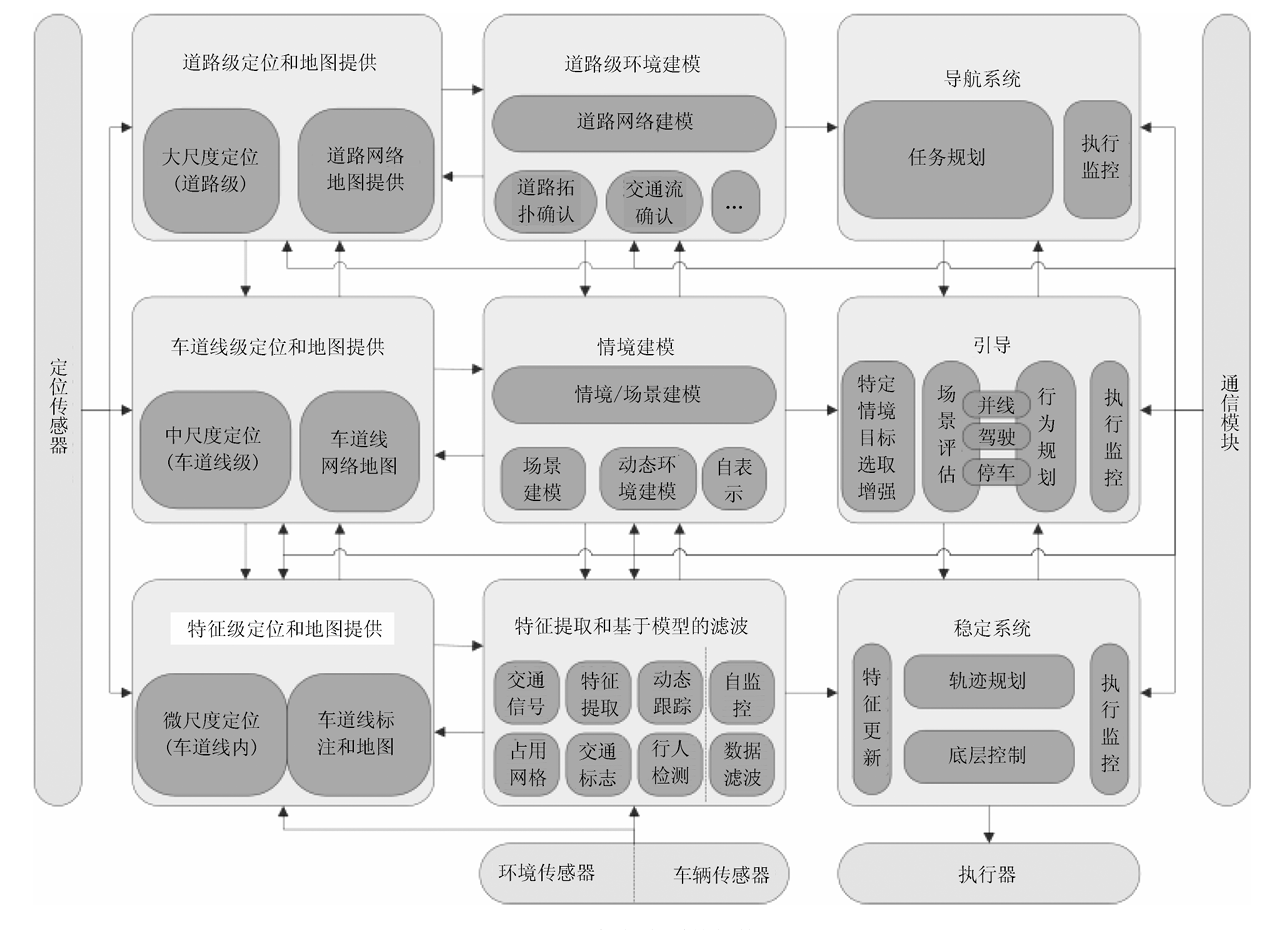

2.2.1 技术架构

智能驾驶系统由感知层、决策层、执行层构成,AI Agent的核心价值在于主导决策层与感知层的协同运作,并赋能执行层实现精准控制,同时承担多车、车路协同的交互决策任务。

与传统规则驱动的驾驶系统相比,AI Agent通过海量数据学习与实时环境交互,可动态适配复杂动态场景(如极端天气、突发障碍物、无保护左转等),大幅提升系统的场景泛化能力。其核心定位可概括为三大角色:

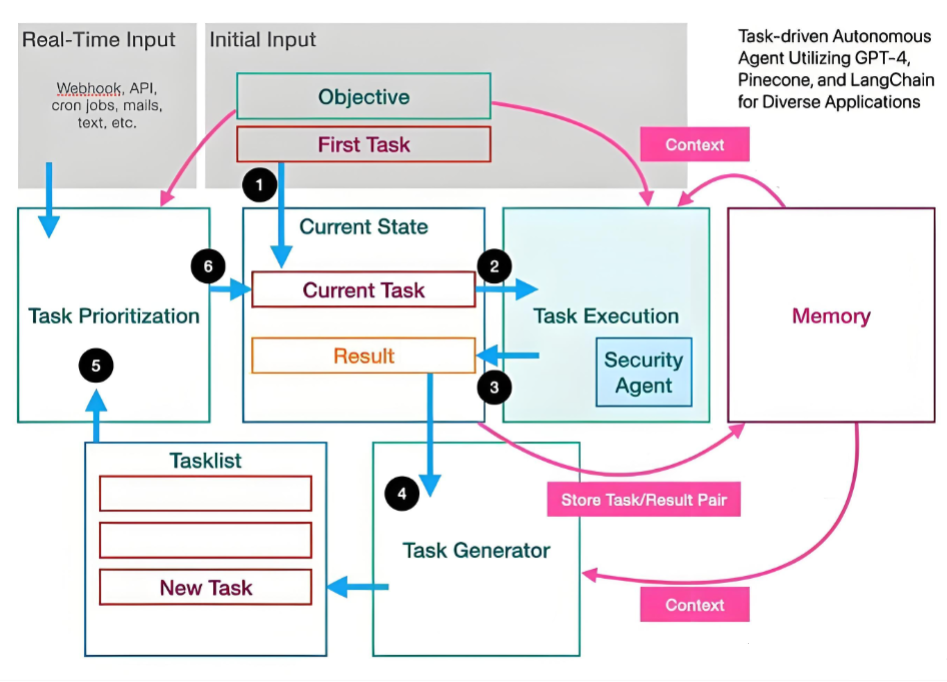

传统智能驾驶系统采用"感知-定位-预测-决策-规划-控制"的串行模块化架构,存在数据流转损耗、场景泛化能力受限等固有缺陷。AI Agent通过构建"环境感知-智能决策-执行反馈-持续学习"的闭环智能体架构,实现了从"规则驱动"向"数据驱动+模型驱动"融合范式的转型。其核心架构可拆解为四大功能模块,各模块通过车云一体算力架构实现高效协同:

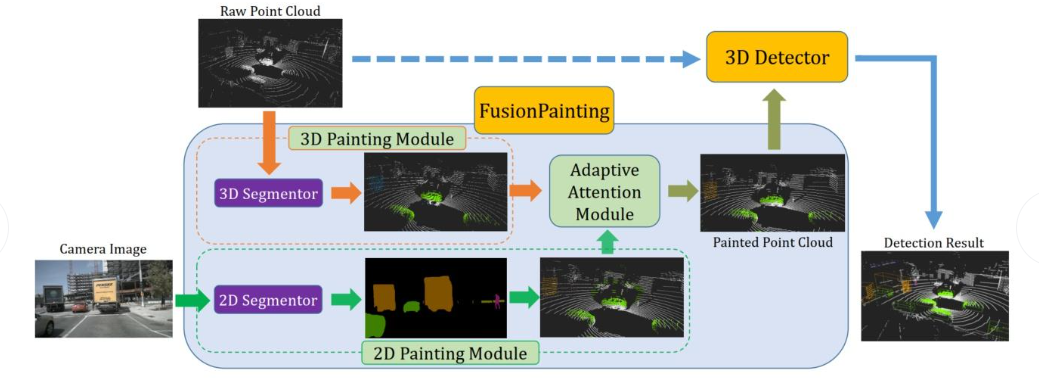

多模态感知融合模块

作为AI Agent的"感知器官",该模块通过摄像头、激光雷达、毫米波雷达等多源传感器数据的时空同步与特征融合,构建高精度环境认知模型。

区别于传统融合方案,AI Agent引入Transformer-based多模态融合架构,实现对动态目标(车辆、行人、非机动车)状态估计、静态障碍物(护栏、施工区域)语义分割及极端天气(暴雨、浓雾)下的鲁棒感知。依托Waymo发布的WOD-E2E长尾场景数据集,该模块可针对发生率低于0.003%的罕见场景(如马拉松赛事期间的施工区域通行、 scooter骑行者摔倒避让)进行专项训练,显著提升感知系统的长尾场景覆盖能力。

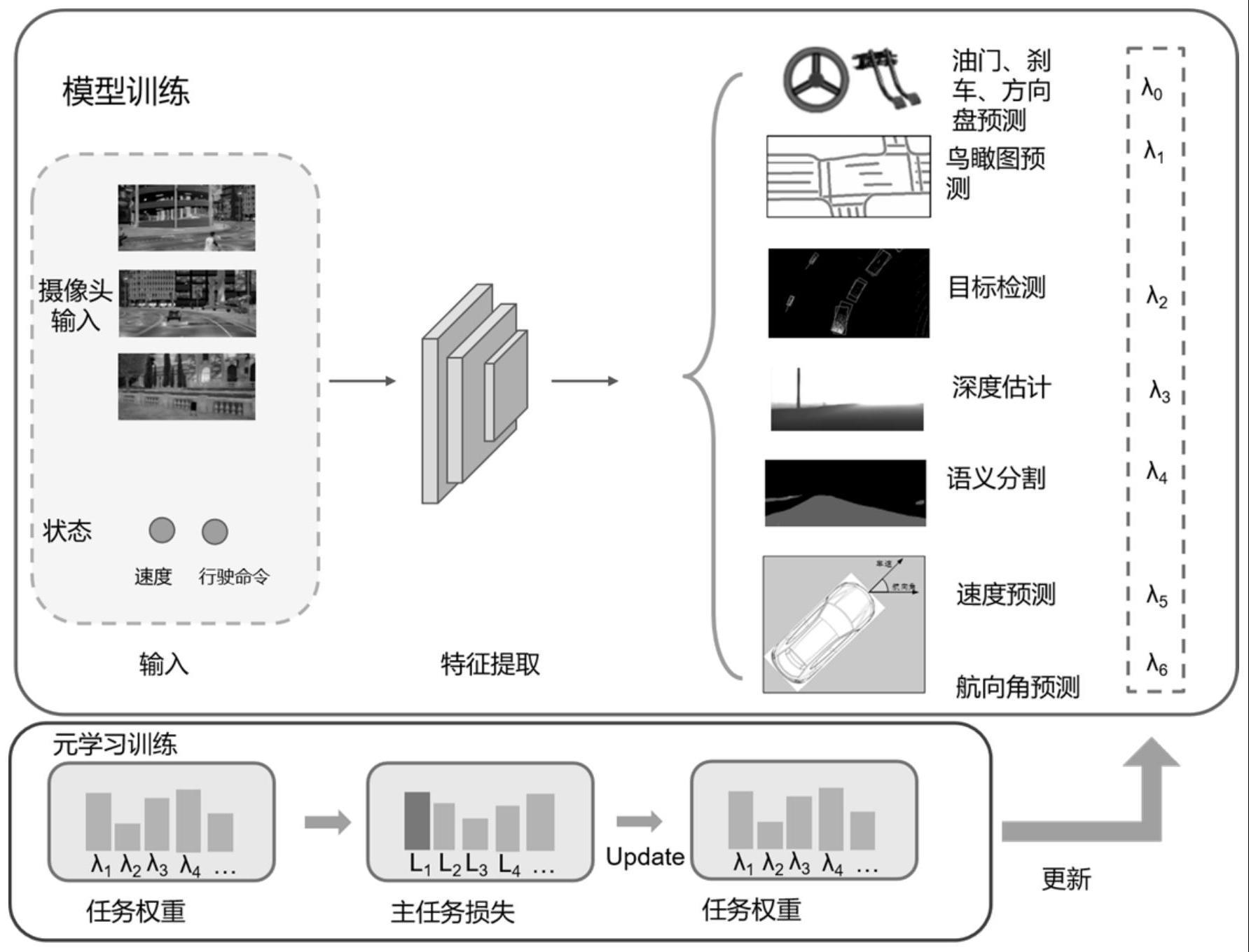

端到端决策规划模块

此为AI Agent的核心"决策中枢",通过强化学习(RL)、生成式人工智能(AIGC)与世界模型(World Model)的协同,实现从传感器输入到驾驶动作输出的端到端映射。

核心优势在于规避传统模块化架构中的误差累积,通过多阶段强化学习策略(模仿学习冷启动→世界模型交互训练→车端模型蒸馏)降低高质量数据依赖门槛。例如商汤绝影R-UniAD技术路线,通过该策略使端到端自动驾驶的数据需求降低一个数量级,同时实现超越人类驾驶的决策性能上限。

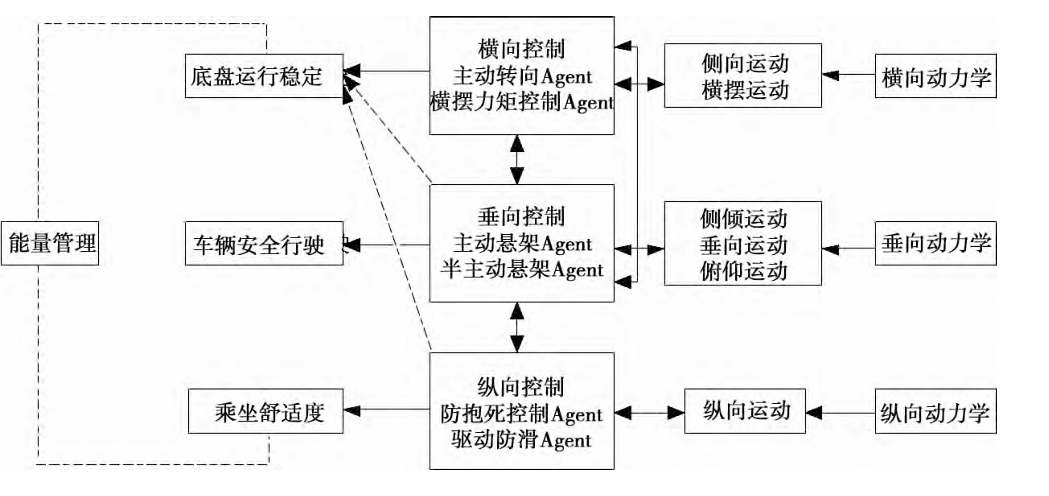

协同执行控制模块

承担AI Agent决策指令的精准转化功能,通过模型预测控制(MPC)与线控底盘的深度耦合,实现转向、制动、驱动系统的毫秒级响应。该模块引入数字孪生技术,将车端执行机构状态实时反馈至决策层,形成"决策-执行-反馈"的闭环优化;同时通过OTA技术实现控制策略的持续迭代,保障不同工况下的控制精度与乘坐舒适性。

2.2.2 案例分析

|

维度 |

Waymo |

商汤绝影 |

特斯拉 |

|---|---|---|---|

|

核心技术方案 |

基于WOD-E2E数据集的端到端驾驶挑战,通过Rater Feedback Metric与ADE评估模型性能 |

R-UniAD端到端路线(模仿学习冷启动-世界模型强化训练-车端蒸馏部署),世界模型协同交互 |

FSD V12纯视觉端到端架构,多模态感知与决策端到端融合 |

|

关键数据/进展 |

长尾场景接管率较传统方案降低40% |

2025年底完成量产交付,4月上海车展展示实车部署效果;依托商汤大装置实现算力支撑 |

七百万辆量产车真实路测数据、超10万P算力支撑,误判率降至0.01%以下 |

|

应用场景/落地情况 |

Robotaxi车队在亚利桑那州落地,聚焦复杂长尾场景的技术验证 |

量产车型落地,实现云端大模型高效训练与车端小模型轻量化部署 |

规模化应用于量产车型,可处理复杂城市道路、极端天气等多元场景 |

2.2.3 发展趋势

基于5G-A与车路云一体化架构,实现多AI Agent的实时交互与全局交通优化,2030年全球车路协同市场规模预计突破1万亿元,大幅提升高密度交通场景的通行效率;

算力与模型的协同优化:专用芯片算力密度持续提升,结合稀疏计算、混合精度训练等技术,实现AI Agent模型的轻量化与高效化,降低车端部署成本

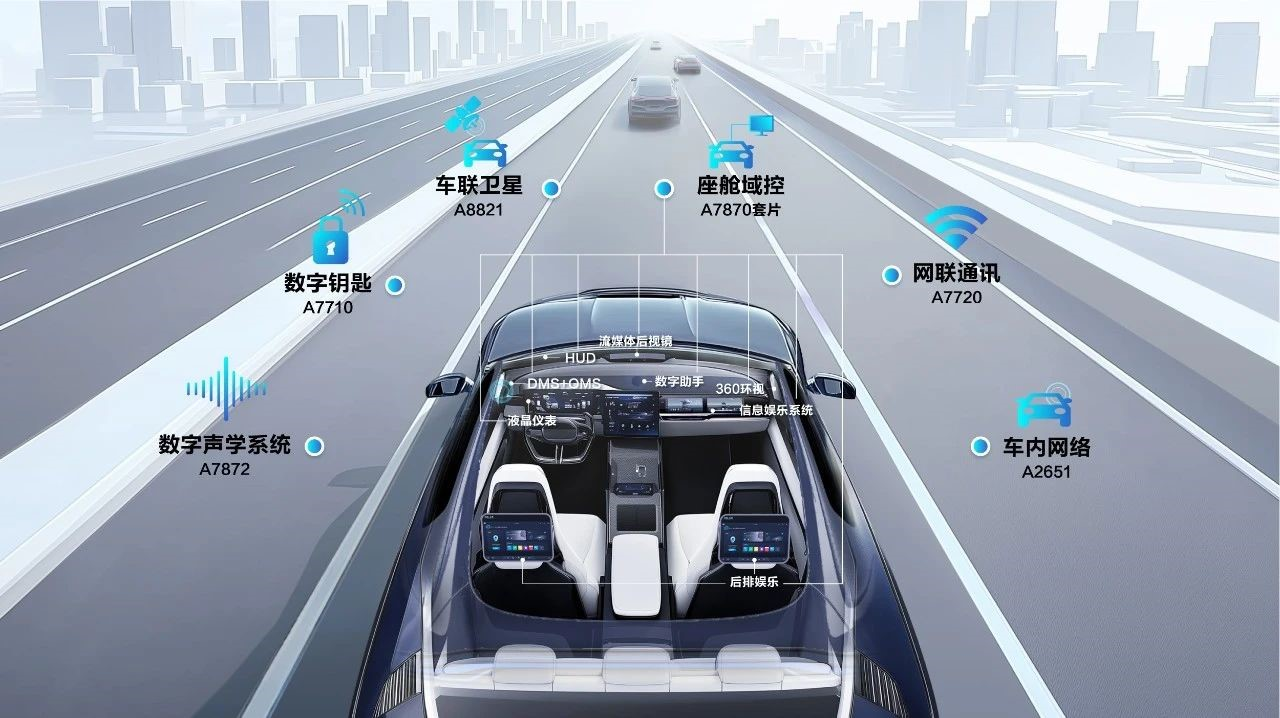

2.3车联网

2.3.1 核心架构及概念介绍

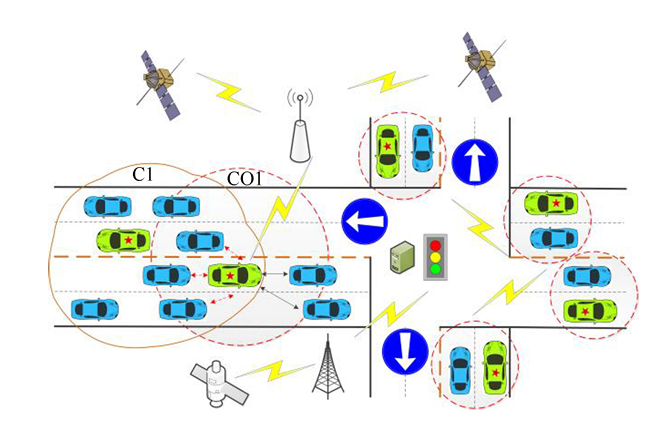

当前的智能车研究主要集中于单车系统在感知、规划和决策等模块的研究,车辆各自执行自己的 检测、避障、识别标志等任务,每台车采集到的数据 相互之间也是不共享的,这就要求单车本身各功能 模块非常可靠.而智能网联汽车的诞生将极大提高 单车效率.智能网联汽车是指搭载先进的车载传感 器、控制器、执行器等装置,并融合现代通信与网络 技术,实现人–车–路–云端等信息交换、共享,具备 复杂环境感知、智能决策、协同控制等功能的新一 代汽车,典型架构如图所示.

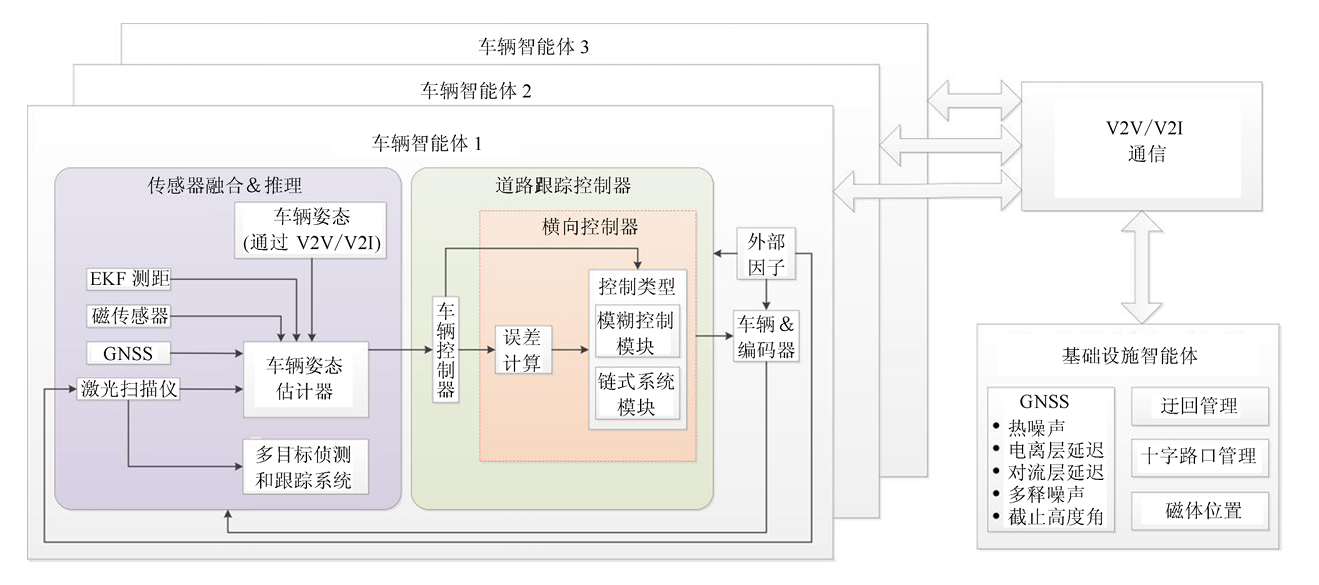

在一般的网联智能汽车研究中,智能汽车Agent 主要利用自身的感知模块对环境信息进行感知,V2X 模块则用于与周围可通信设备交互,获取额外的信 息.这种模式对于智能汽车Agent的要求较高.DE 等提出一种基于Agent的学习框架,以路边的基础设 施为主体,对道路环境进行监控,基于交通环境为进 入该区域的智能汽车Agent做最合理的规划. 网联 智能车被建模成理性智能体,基于(VehicletoInfras tructure, V2I) 的通信架构利用深度模仿学习实现道 路基础设施主导的策略学习.可动态决策的Agent的 运动被仿真为在有恒定速度障碍物环境下的走迷宫, 配合车间多传感器信息融合,如图所示,利用强化学习为智能汽车Agent的具体行为作决策

2.3.2 汽车换道时的Agent应用示例

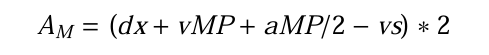

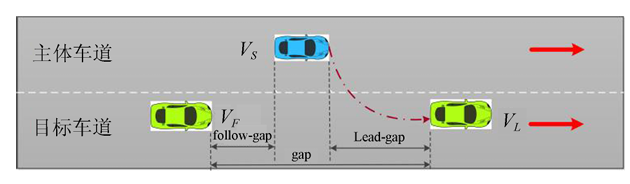

智能汽车在复杂环境下尤其是非结构化道路条 件下的决策能力是衡量其智能化的标准. 在任何交通模型和仿真系统中,换道场景都是 非常重要的研究点,在换道问题的研究中,必须要考虑车辆间信息的交互,智能汽车如何基于对周围车 辆行驶意图的预测,以及环境的变化并结合自身动 态信息及时、有效、安全地作出决策是换道场景问 题研究的重点.换道场景可以分为自由换道、强制 换道和协作式换道3个场景,如图5所示.自由换道 场景下,待换道车辆Agent不需要与周围车辆Agent 进行交互,可根据与周围车辆Agent之间的安全距离 选择换道时机;强制换道为待换道车辆Agent以强制 周围车辆Agent减速形成安全距离的方式进行换道, 而协作式换道则基于待换道车辆Agent与周围车辆 Agent进行信息交互,周围车辆Agent主动调整自身 驾驶策略保证待换道车辆Agent安全换道.模型对 待换道车辆Agent的换道条件作了限制.换道并线的 点称为MP(MergePoint),到达并线点MP的加速度 为AM(MergeAcceleration).

其中,dx为当前位置到达MP点的距离,vMP和aMP 分别为车辆在MP点处的速度与加速度,vs为待换 道车辆Agent的速度.当车辆到达换道点,基于车辆 间距离(gap)、车辆间相对速度以及限定AM决定是 否适合换道

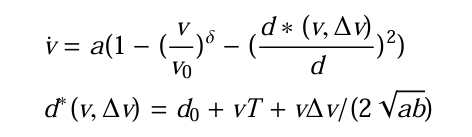

两种常用的控制速度和决定何时换道的模型是 建模汽车纵向动态特性的智能驾驶员模型(Intelli gentDrivingModel,IDM)和基于换道最小化刹车 次数MOBIL决定何时换道的模型

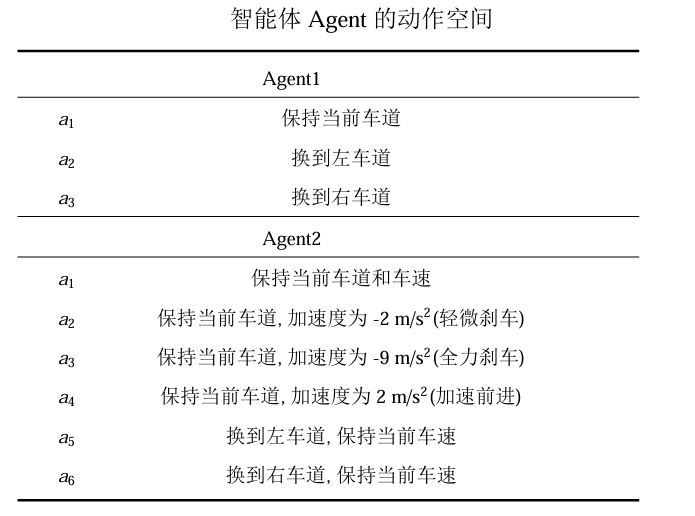

控制车速和换道可看成是强化学习问题,在 IDM 和MOBIL模型基础上提出一种深度学习与Q 学习相结合的深度Q-网络DQN智能体来学习Q 函数, 根据已知的周围车辆的状态和可用的道路信 息, 智能体在其动作空间选择最佳的换道、加速和减 速的动作,智能体的动作空间定义如表

Agent1仅仅控制着换道决策,其速 度则由IDM模型自动地控制着

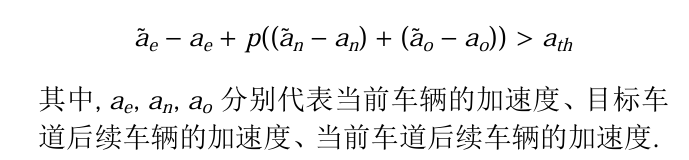

Agent2 则在使用 IDM 模型控制速度并估计周 围车辆Agent速度的基础上,使用MOBIL模型进行 换道决策,决策条件为

WANG 等利用长短时记忆(Long Short-Term Memory, LSTM) 网络建模交互环境, 将包含历史驾 驶信息的内部状态传到深度Q网络DQN中,在深度 强化学习架构下,交互环境长期影响的累计收益可 以用来决定最好的控制策略,这可用于智能车在复 杂的交叉路口的驾驶和执行换道.

人类驾驶汽车经常可以依靠对周围交通状况的 观察和感觉轻松地在高速公路完成换道超车,但很 多时候突然出现的加塞和变道会增加行车过程中发 生事故的几率,影响其他驾驶员的正常驾驶.而对于 智能汽车来说,换道这些动作都需要决策系统完成, 因此,智能车需要作出安全、和谐的决策.

当出现需要超车时,智能车首先在行驶过程中 需要不断对周围车辆的行为进行预测,然后在与他 车协作换道或者保持自己行车状态之间博弈,BMW 公司将预测算法加入到决策过程中去,先使用多项 式回归分类器进行实时预测,然后在动作空间选择 对应的避让或不避让策略,最终实现基于他车不确 定因素的协作行为的博弈

2.3.3 发展趋势

-

从 "单车 - 单路口" 协同升级为 "全城 - 全路网" 智能体网络,实现城市级交通优化

-

上海、北京等 20 + 城市正建设 "车路云一体化" 示范区,预计 2026 年覆盖主要城市

-

与低空无人机、智能轨道交通等融合,构建 "空地一体化" 智能交通网络

2.4 车辆运维管理

车辆运维管理是保障车辆安全运行、控制运营成本、提升服务质量的核心环节,传统模式依赖人工经验进行故障诊断、保养规划和维修调度,存在响应滞后、判断偏差大、资源配置低效等痛点。AI Agent通过模拟人类专家的决策逻辑,构建“感知-分析-决策-执行-反馈”的闭环智能系统,深度整合车载传感器数据、运维历史记录、环境工况等多源信息,实现运维管理从“事后抢修”向“事前预警”、“经验驱动”向“数据智能驱动”的转型。典型应用场景如下:

2.4.1 预测性维护

车载诊断Agent通过“感知-分析-决策-推送-执行”的闭环流程,实现对电池、电机等关键部件的实时监测、故障预警与维保方案推送,依托多源数据采集、边缘-云协同分析、智能决策与精准触达四个环节。

|

环节 |

功能 |

关键技术/组件 |

响应时效 |

|

感知层 |

实时采集电池、电机等多维参数 |

车载传感器网络、T-Box、BMS/MCU接口 |

毫秒级 |

|

边缘分析层 |

本地异常检测与初步诊断 |

轻量AI模型(LSTM/孤立森林)、车载AI芯片 |

秒级 |

|

云端决策层 |

深度预测与维保方案生成 |

数字孪生、故障模式库、历史数据挖掘 |

分钟级 |

|

推送层 |

多渠道触达用户/服务商 |

车机APP、短信、4S店系统 |

即时 |

|

执行层 |

预约与远程干预 |

自动维保预约、充电策略调整 |

按需触发 |

2.4.2 OTA 智能调度

传统OTA升级常因触发时机不当(如通勤途中、紧急用车时)打断用户行程,引发体验诟病。AI Agent通过学习用户驾驶行为数据,精准识别“高概率空闲时段”(如夜间23:00-次日6:00、周末长期静置时段),自动在该窗口完成下载与安装,实现“无感升级”。同时,系统会主动避开用户高频用车时段(如早7:00-9:00、晚17:00-19:00通勤高峰),从根源上消除升级对用车的干扰。

AI Agent实现OTA智能调度的核心是“感知-规划-决策-执行-反馈”的闭环架构,依托多模块协同完成全流程调度优化,具体架构分为五层:

|

架构层级 |

核心功能 |

关键组件/技术 |

核心价值 |

|---|---|---|---|

|

感知层 |

全维度数据采集,为调度决策提供基础支撑 |

车载传感器、T-Box、车机系统;LSTM网络(用户行为学习) |

精准获取用户、车辆、网络多维数据,奠定调度基础 |

|

边缘计算层 |

本地实时分析,快速响应调度需求 |

车载AI芯片、轻量级分析模型、数据脱敏技术 |

降低网络延迟,保障数据安全,提升调度实时性 |

|

云端决策层 |

全局协同优化,生成个性化调度方案 |

大数据平台、深度学习模型、负载均衡算法 |

实现空闲时段精准预测、任务分级排序,保障全局调度高效 |

|

执行层 |

落地调度方案,完成升级全流程自动化执行 |

车机系统、手机APP、异常回滚机制 |

保障升级顺畅,实现无感体验,应对突发异常 |

|

反馈层 |

数据闭环迭代,优化调度模型 |

反馈收集系统、模型训练库 |

持续提升调度方案适配性,优化整体性能 |

2.4.3 数据安全与隐私保护

采用联邦学习与端侧加密,确保用户数据在本地处理,仅上传脱敏后的必要信息。

3 总结

AI Agent 正将汽车从单纯的交通工具转变为 "有感知、会思考、能协作" 的智能伙伴:

-

交互革命:从触控操作到自然对话,实现 "所说即所得"

-

服务升级:从被动执行到主动预判,提供全场景个性化体验

-

智能进化:从辅助工具到决策伙伴,构建更安全、高效的出行生态

随着端侧大模型、多模态融合技术的成熟,AI Agent 将进一步模糊数字与物理世界界限,使汽车成为人们生活中最自然、最贴心的智能伙伴。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)