Ollama在Windows11部署大模型

Ollama 是一个开源平台,让开发者能够在个人电脑上轻松运行、管理和部署大型语言模型。它将复杂的AI模型部署简化为几个简单的命令,实现了"AI民主化"——让每个人都能在本地享受大语言模型的能力。

Ollama 是一个开源平台,让开发者能够在个人电脑上轻松运行、管理和部署大型语言模型。它将复杂的AI模型部署简化为几个简单的命令,实现了"AI民主化"——让每个人都能在本地享受大语言模型的能力。

目录

1.安装Ollama

在官网上下载ollama:

Download Ollama on Windows![]() https://ollama.com/download/windows获取到安装包之后,ollama的默认安装路径是在c盘的而且正常手段无法修改:

https://ollama.com/download/windows获取到安装包之后,ollama的默认安装路径是在c盘的而且正常手段无法修改:

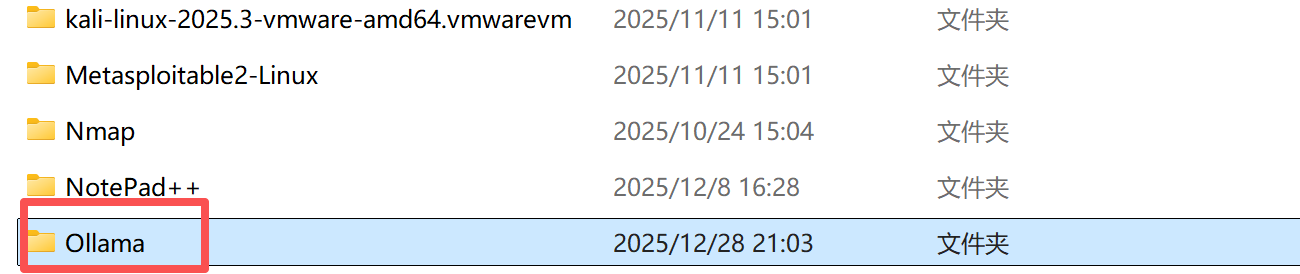

首先先把ollama的安装程序放到你想要安装的盘里面,我想装在E盘就放在E盘根目录下面,然后在E盘底下创建了一个ollama的文件夹,我要把ollama安装到这个路径里面,"E://Ollama"

随后打开命令行:

输入:我的是E://Ollama,按照自己的来就行

ollamasetup.exe /DIR=+文件夹路径2.运行Ollama

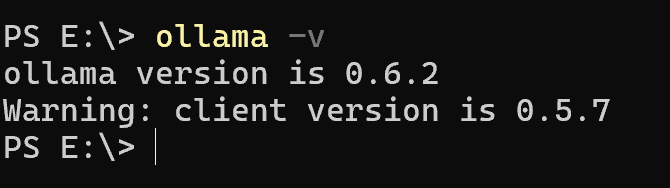

安装好之后打开命令行,输入ollama -v

出现版本信息就是安装成功了

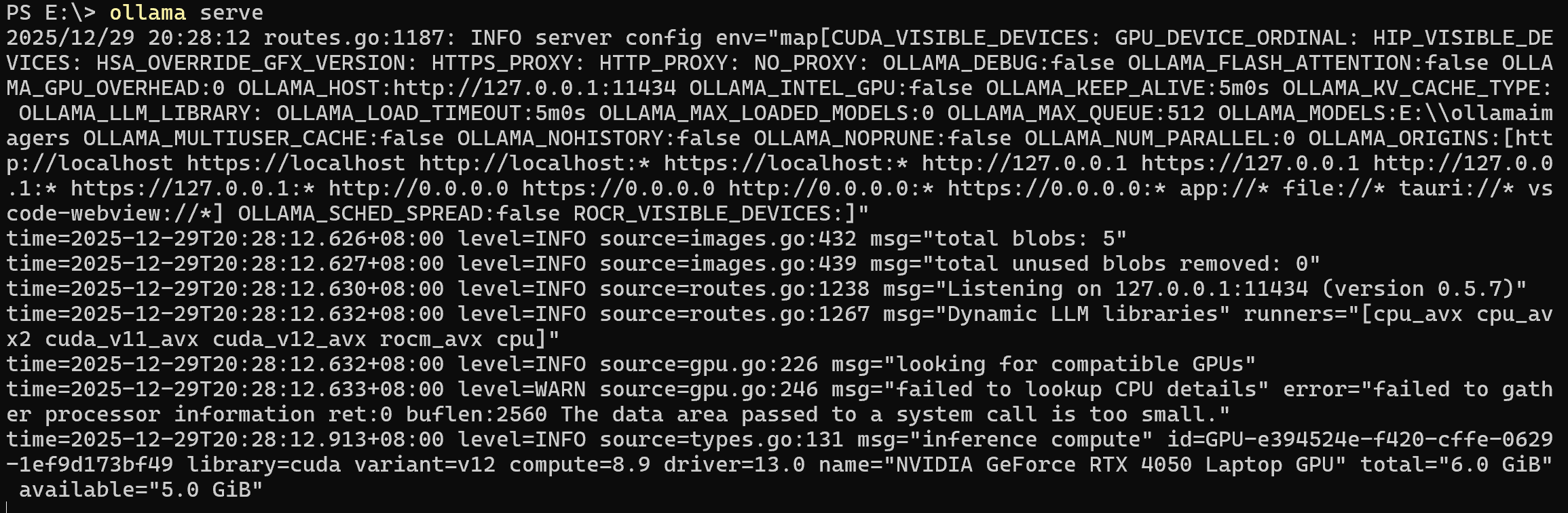

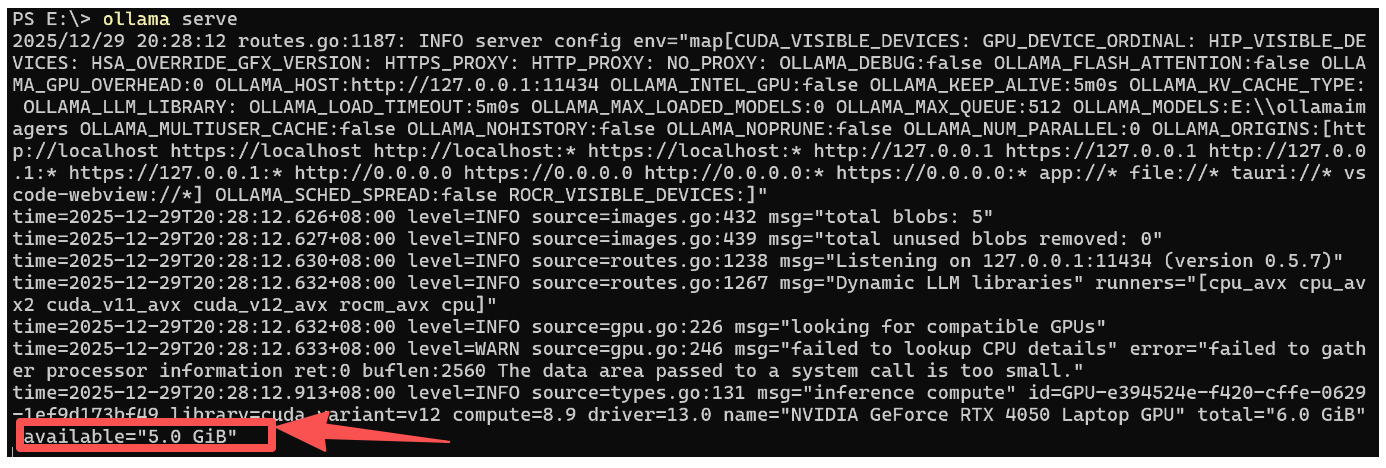

直接运行ollama:ollama serve 可以让它在后台运行

ollama serve

3.部署大模型

在部署大模型之前,要更改大模型的安装路径:

默认路径还是在c盘里面。

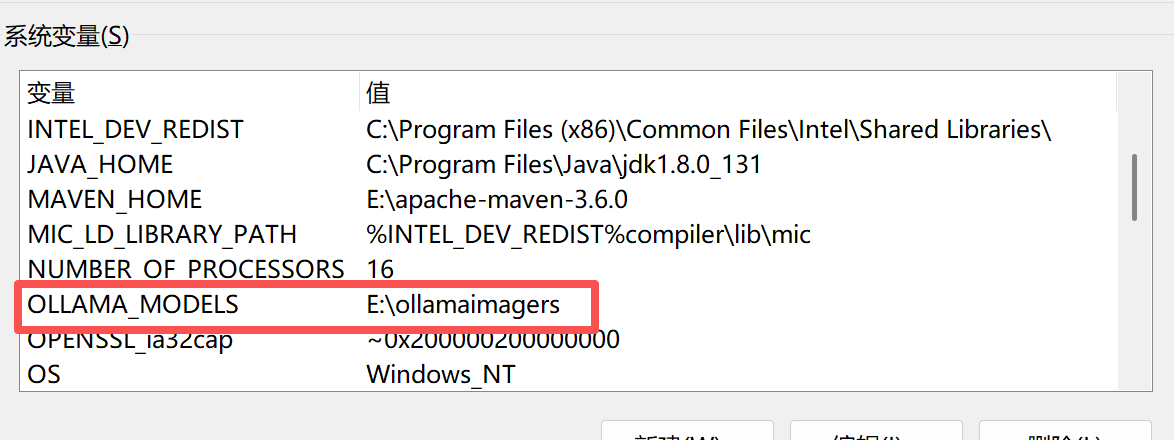

我们在需要的盘当中创建一个用于存放大模型的文件夹,然后更改环境变量:

例如我在E盘创建了一个

进入环境变量编辑:

在系统变量当中添加:

值就是上面创建好的文件夹的路径。

完成更改之后重启电脑。

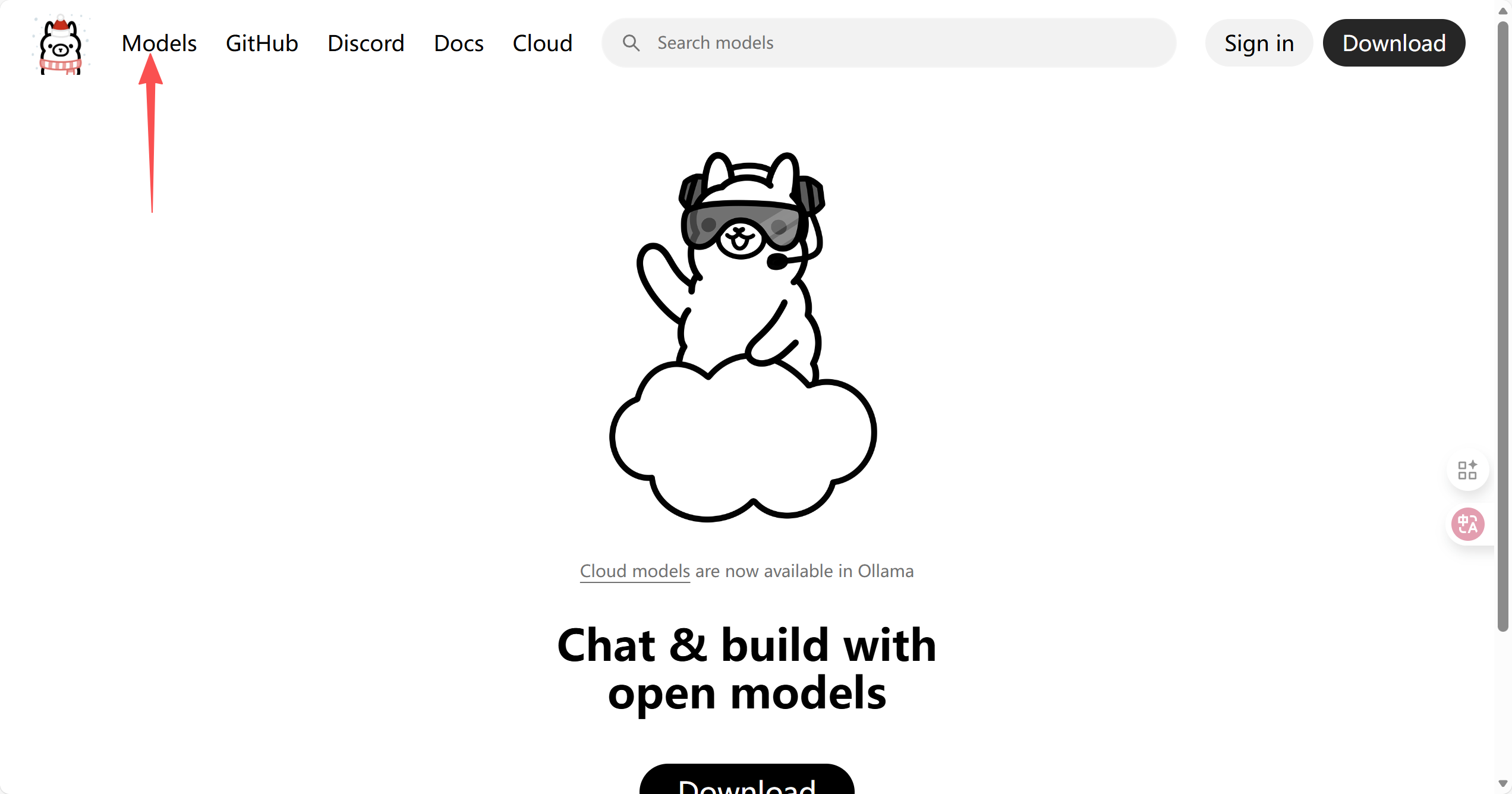

随后访问ollama官网:Ollama

找到models

以deepseek为例:

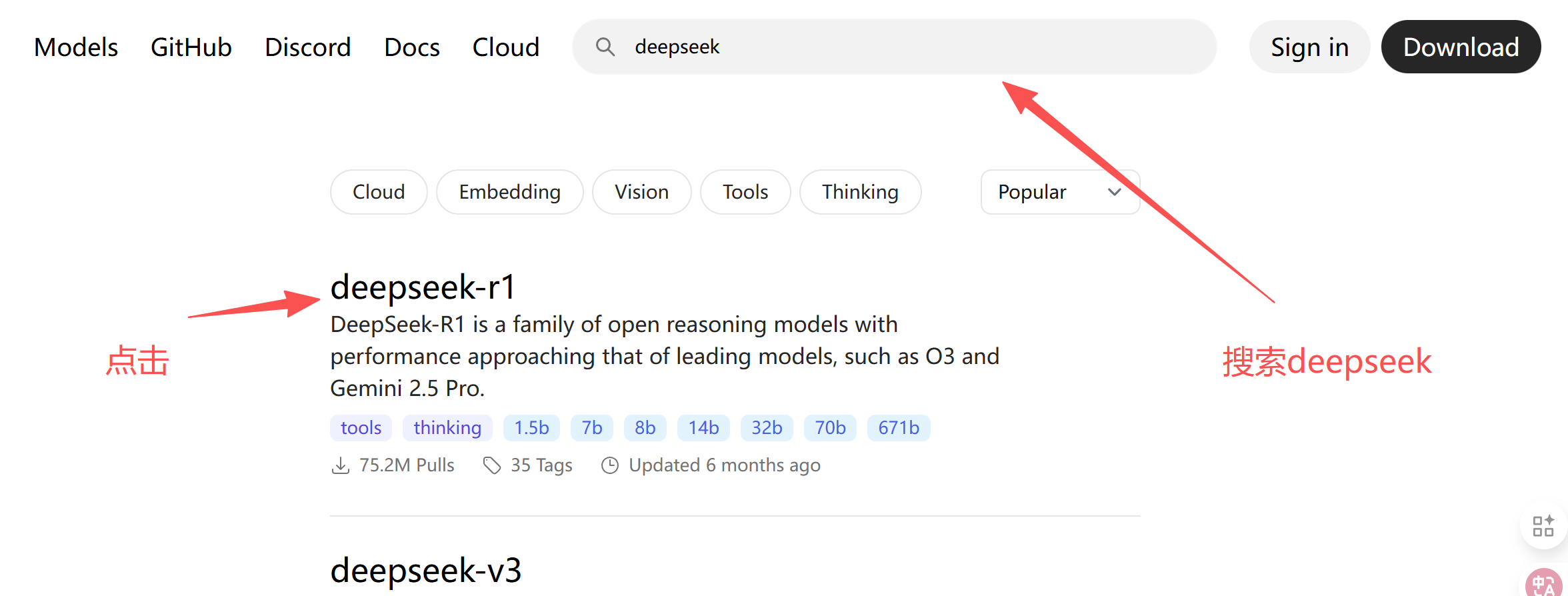

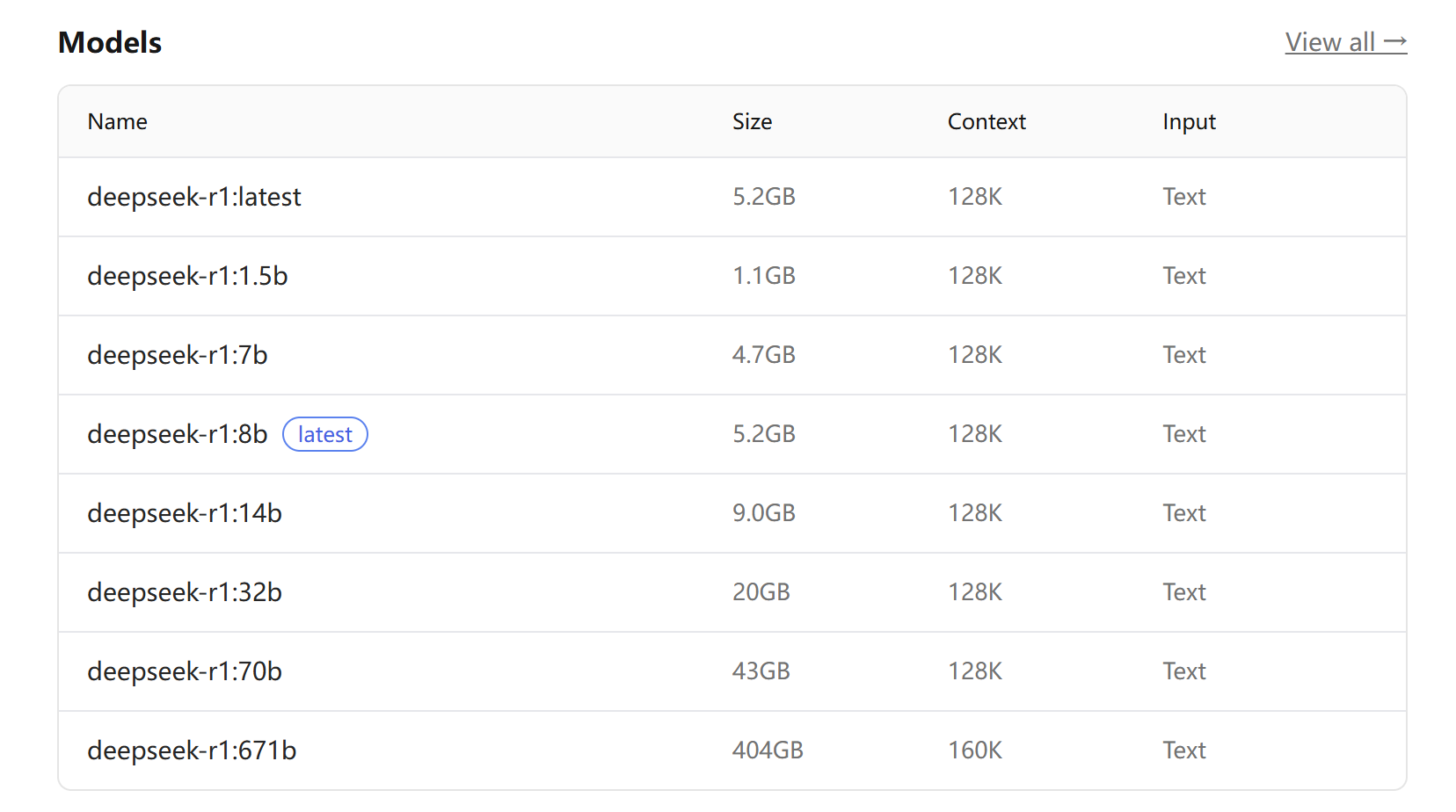

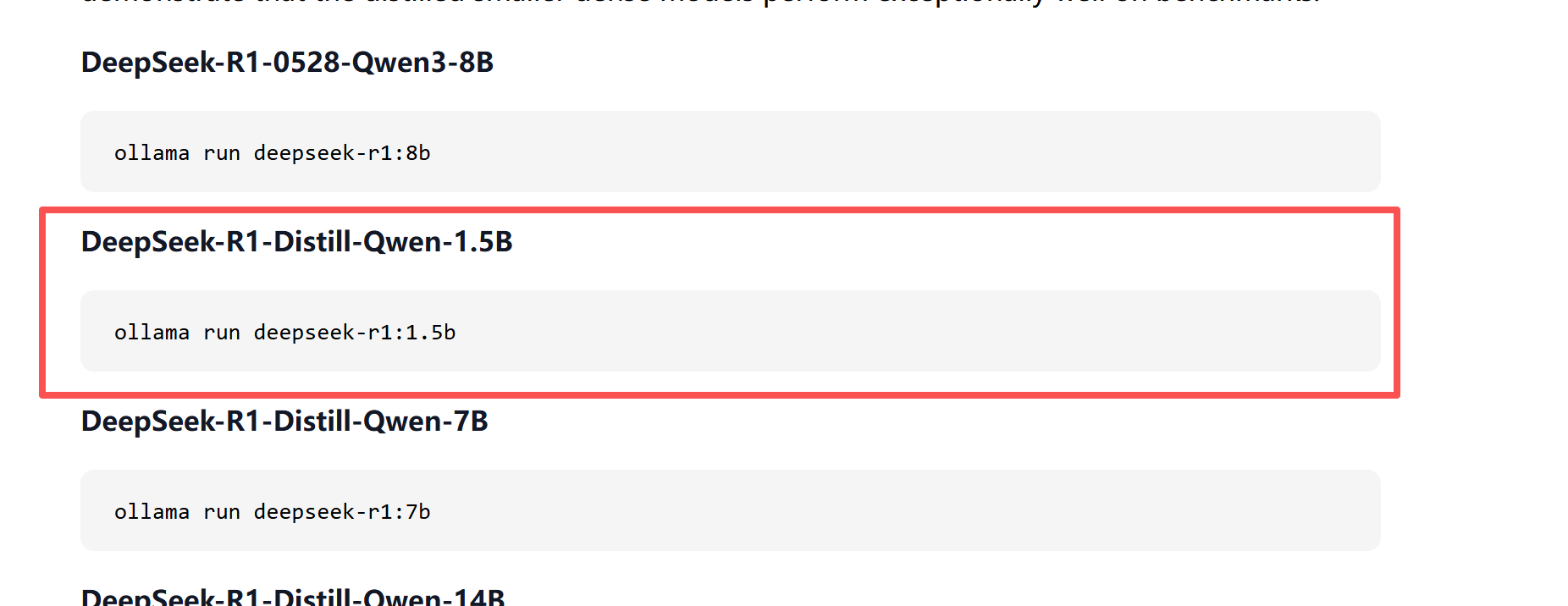

我们可以看到deepseek-r1的模型以及蒸馏模型:

知识蒸馏是一种模型压缩技术,其核心思想是让一个轻量级的"学生模型"通过学习一个庞大而精准的"教师模型"的输出(特别是其输出的"软化"概率分布,而不仅仅是最终标签),来继承教师模型的泛化能力和知识深度。这个过程就像一个博士生导师(教师模型)将自己深厚的学识和经验,提炼成精要的讲义和思考范式,传授给本科生(学生模型),使学生能以小得多的参数量和计算成本,达到接近教师模型的性能。它不只是简单地模仿结果,更是学习教师模型的决策边界、内部特征表示和数据间的关联,从而实现大模型能力向轻量化应用场景的高效迁移,是让AI模型在资源受限的设备上得以部署的关键技术。

Size是其大小,根据自己的显卡显存来选择,我的显存较小,我选择最小的1.5b模型,模型内存越大,模型当中的数据越多,能力就越强,但是对运行时对设备要求也会更高

点击进入1.5b

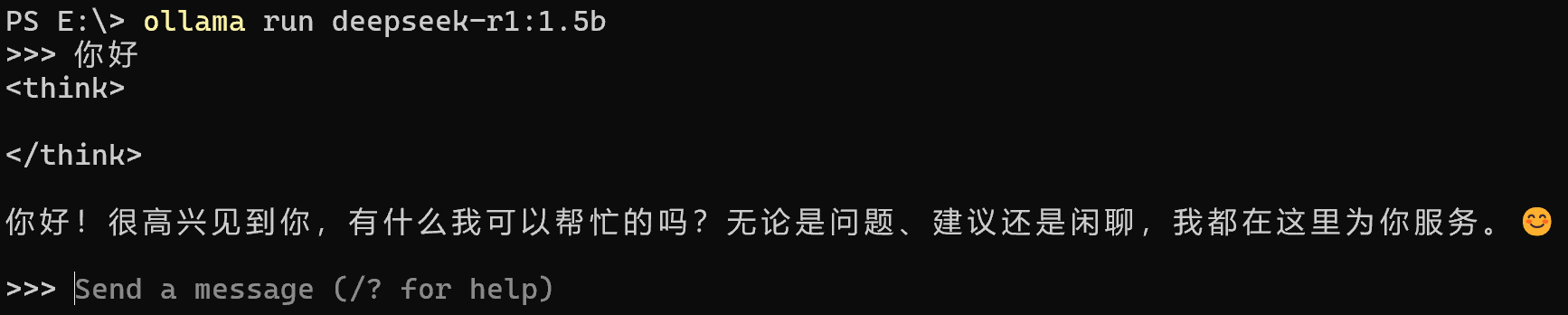

在命令行运行这段命令,ollama会在本地找本机是否有该模型,没有的话会先拉取:

我的已经拉取过了,便可以直接进行对话:

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)