零基础玩转 Ollama:2026 年本地 AI 大模型部署指南,普通人轻松上手

Ollama:本地化AI部署的简易解决方案 Ollama是一款开源工具,能够帮助用户在个人电脑上轻松部署AI大模型,有效解决了云端AI工具的数据隐私、联网依赖和长期成本问题。其主要优势包括:数据本地处理确保隐私安全、完全免费使用、操作界面简单友好、硬件要求低(最低8GB内存即可运行),并支持1700多种模型选择。安装过程仅需3个简单步骤,同时提供图形界面和命令行两种操作方式。通过两个实战案例(文档

在 AI 越来越普及的今天,ChatGPT、Claude 等云端 AI 工具虽然好用,但总面临数据隐私泄露、需要联网才能使用、长期使用成本高的问题。有没有办法让强大的 AI 模型直接跑在自己的电脑上,既安全又免费?答案就是 Ollama—— 一个能让普通人轻松部署本地大模型的开源工具。

就像用 Docker 管理容器化应用一样,Ollama 把 AI 模型的权重、配置和运行环境打包成了 "一站式解决方案",不用复杂配置,跟着步骤点几下,就能让 AI 在自己的电脑上 "安家落户"。今天就带大家从零开始,一步步搭建本地 AI 环境,还会分享两个超实用的实战案例,解决工作学习中的实际问题。

一、选 Ollama,普通人也能轻松驾驭的核心优势

- 隐私绝对安全:所有对话和数据都在本地电脑处理,不用上传到云端,处理敏感信息(比如工作文档、个人隐私)也完全放心,而且能离线运行,没网也能用。

- 零成本使用:完全免费,没有 API 调用费,也没有使用次数限制,一次部署终身能用,学生党、职场人都无压力。

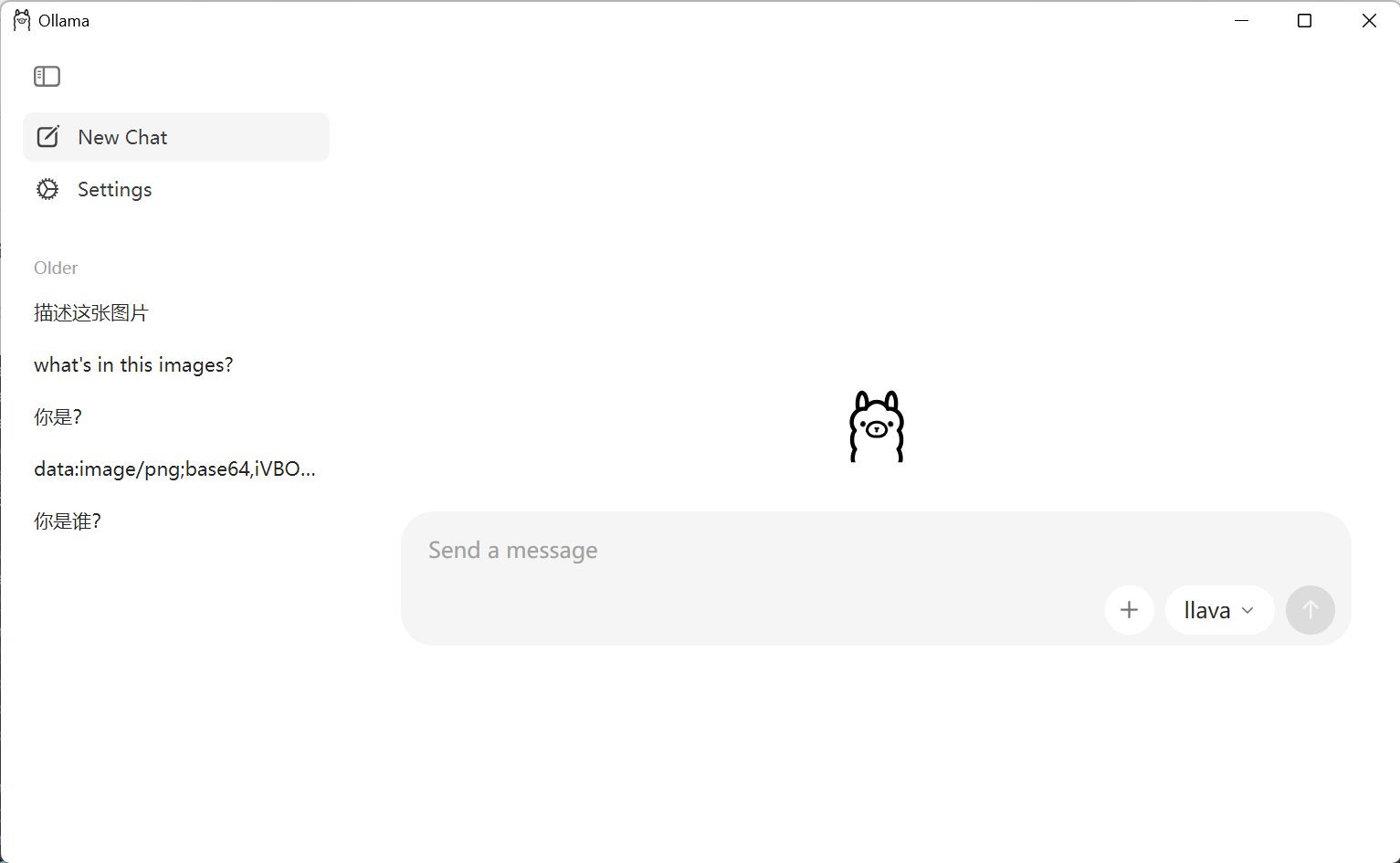

- 操作超级简单:2025 年更新后有了图形界面(GUI),不用记复杂命令,像用普通聊天软件一样操作,文件拖放就能分析。

- 硬件要求不高:最低 8GB 内存就能运行轻量模型,有独立显卡更好,没有也能用 CPU 流畅运行中小型模型。

- 模型选择丰富:支持 1700 多个模型,不管是中文对话、代码生成、文档分析,都能找到合适的模型。

二、快速上手:3 步完成 Ollama 安装与配置

1. 先确认你的电脑是否达标(门槛很低)

- 最低配置(能跑起来):Windows 10/11、macOS 12 + 或 Linux 系统,8GB 内存,10GB 可用存储。

- 推荐配置(用得流畅):16GB 以上内存,有 NVIDIA GPU(4GB 以上显存)或苹果 M 系列芯片,50GB 以上 SSD 存储。

2. 安装步骤(超简单,复制粘贴就行)

普通人安装

方法 :直接通过文章顶部提示进行下载安装包(最推荐)找到 Windows版本(OllamaSetup.exe) 和 Mac 版本(Ollama.dmg),点击下载后双击安装,一路下一步就行。

Linux 系统

打开终端,复制粘贴以下命令,一键安装并启动服务:

curl -fsSL https://ollama.com/install.sh | sh

ollama serve

3. 验证安装是否成功

安装完成后,打开命令行(Windows 用 CMD,Mac/Linux 用终端),输入以下命令:

ollama --version

如果显示版本号,再输入:

curl http://localhost:11434

出现 "Ollama is running",就说明安装成功了,也可以直接打开 ollama 出来界面进行界面操作。

三、模型管理:下载与运行 AI 模型(图形界面 + 命令行都能操作)

1. 图形界面操作(推荐新手)

安装完成后,在开始菜单(Windows)或启动台(Mac)找到 Ollama 应用,打开后会看到聊天界面。首次使用时,直接在输入框输入想要用的模型,比如 "llama3.2",系统会自动下载模型,等待几分钟(根据网络速度)就能开始对话了。

2. 命令行操作(更灵活)

下载热门模型

打开命令行,输入以下命令就能下载常用模型(推荐新手先试这些):

- 轻量快速(4GB 内存就能跑):

ollama pull llama3.2:3b - 中文优化(适合中文对话、文档处理):

ollama pull qwen2.5:7b - 代码生成(写代码、改 bug):

ollama pull codellama:7b

下载进度会实时显示,比如这样:

pulling manifest

pulling 8934d96d3f08... 100% ▕████████████▏ 4.7 GB

verifying sha256 digest

success

运行模型

- 启动对话:输入

ollama run qwen2.5:7b,等待模型加载完成后,就能直接输入问题聊天了。 - 单次问答:不想进入对话模式?直接输入

ollama run qwen2.5:7b "请总结一下人工智能的发展历程",模型会直接返回结果。 - 处理文件:比如分析 PDF,输入

ollama run qwen2.5:7b "总结这份PDF的核心内容" /path/to/你的文件.pdf(把路径换成自己的文件路径)。

常用模型管理命令(记不住也没关系,用图形界面就行)

- 查看已下载模型:

ollama list - 删除不需要的模型:

ollama rm 模型名称(比如ollama rm llama3.2:3b) - 查看模型详情:

ollama show qwen2.5:7b

四、实战案例:用 Ollama 解决两个常见问题

案例 1:本地文档总结助手(处理 PDF/Word/TXT,不用上传云端)

工作中经常收到几十页的 PDF 报告,逐字看太费时间?用 Ollama 搭建本地文档总结助手,直接拖拽文件就能生成核心摘要,还能提问细节。

操作步骤:

- 下载中文优化模型:打开命令行输入

ollama pull qwen2.5:7b(已下载可跳过)。 - 打开 Ollama 图形界面,点击左上角 "文件" 按钮,选择 "上传文件",选中要处理的 PDF/Word 文档(支持多种格式)。

- 在输入框输入提示词:"请总结这份文档的核心观点,分点列出,重点标注关键数据和结论",点击发送。

- 等待几秒,模型就会生成简洁的总结,还能继续提问,比如 "文档中提到的 2025 年行业增长率是多少?"

命令行操作(可选):

如果习惯用命令行,进入文档所在文件夹,输入:

ollama run qwen2.5:7b "总结这份文档的核心内容: $(cat 报告.txt)"

(如果是 PDF,先转成 TXT 或直接用图形界面上传更方便)

案例 2:编程小助手(写代码、查 bug、改语法,新手也能搞定)

学习编程时遇到语法错误?想快速实现一个功能却不知道怎么写?用 CodeLlama 模型搭建编程助手,本地就能获得专业指导,不用联网查资料。

操作步骤:

- 下载代码模型:命令行输入

ollama pull codellama:7b。 - 启动模型:输入

ollama run codellama:7b。 - 输入需求,比如:"用 Python 写一个批量重命名文件的函数,要求把文件夹里的所有.jpg 文件按顺序命名为 ' 照片 1.jpg'、' 照片 2.jpg'..."

- 模型会返回完整代码,还会附带注释,直接复制到 Python 编辑器就能用。如果运行出错,把错误信息粘贴回去,模型会帮忙修改。

示例代码(模型生成):

import os

def batch_rename_jpg(folder_path):

# 检查文件夹是否存在

if not os.path.exists(folder_path):

print(f"文件夹 {folder_path} 不存在")

return

# 获取文件夹中所有.jpg文件

jpg_files = [f for f in os.listdir(folder_path) if f.endswith('.jpg')]

jpg_files.sort() # 按默认顺序排序

# 批量重命名

for idx, old_name in enumerate(jpg_files, start=1):

old_path = os.path.join(folder_path, old_name)

new_name = f"照片{idx}.jpg"

new_path = os.path.join(folder_path, new_name)

# 避免文件名冲突

if os.path.exists(new_path):

print(f"文件 {new_name} 已存在,跳过")

continue

os.rename(old_path, new_path)

print(f"已重命名:{old_name} -> {new_name}")

# 使用示例:替换为你的文件夹路径

batch_rename_jpg("D:/我的照片")

五、性能优化小技巧(让 AI 跑得更快更稳)

- 根据硬件选模型:8GB 内存选 3B/7B 参数的模型(比如 llama3.2:3b、qwen2.5:7b),16GB 以上内存可以选 13B/14B 参数的模型。

- 启用 GPU 加速:如果有 NVIDIA 显卡,系统会自动启用 CUDA 加速;Mac 用户会自动使用 Metal 加速,不用额外配置。

- 减少内存占用:下载量化版本模型,比如

ollama pull qwen2.5:7b-q4_0,体积更小,内存占用更低,性能基本不受影响。 - 调整上下文窗口:如果处理长文档(比如 10 万字以上),可以在对话中输入

/set parameter num_ctx 8192,扩大模型能处理的文本长度。

六、常见问题排查(遇到问题不用慌)

- 服务启动失败:可能是 11434 端口被占用,Windows 用户打开 CMD 输入

netstat -ano | findstr :11434,找到占用进程关闭;或修改端口:Windows 设置系统环境变量OLLAMA_PORT=8080,Mac/Linux 输入export OLLAMA_PORT=8080。 - 模型运行很慢:关闭其他占用内存的程序,下载量化模型(q4_0 版本),或启用 GPU 加速(检查显卡驱动是否安装)。

- 中文回答不流畅:换用中文优化模型(qwen2.5、通义千问相关模型),在提示词中明确要求用中文回答。

总结

Ollama 把复杂的大模型部署变得简单化、平民化,不用懂高深的 AI 技术,普通人跟着步骤也能搭建属于自己的本地 AI 助手。无论是处理文档、辅助编程,还是学习 AI 技术、保护数据隐私,Ollama 都能满足需求。

现在就动手试试吧:下载 Ollama → 安装 → 下载模型 → 开始使用。从简单的对话开始,慢慢探索更多功能,你会发现 AI 能帮你解决更多工作学习中的问题。如果遇到问题,欢迎在评论区交流,一起解锁 Ollama 的更多用法!

常用命令速查表(收藏备用)

- 下载模型:

ollama pull 模型名称 - 启动对话:

ollama run 模型名称 - 查看已下载模型:

ollama list - 删除模型:

ollama rm 模型名称 - 验证服务:

curl http://localhost:11434

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)