AI编程的“技术债”:Cursor创始人警告,“氛围编程”正为系统崩溃埋下伏笔

【摘要】AI编程正催生一种名为“氛围编程”的危险实践。开发者过度依赖AI,忽视代码内涵,正在快速累积隐形技术债,为未来系统性崩溃埋下伏-笔。

【摘要】AI编程正催生一种名为“氛围编程”的危险实践。开发者过度依赖AI,忽视代码内涵,正在快速累积隐形技术债,为未来系统性崩溃埋下伏-笔。

引言

软件开发领域正被生成式AI的浪潮彻底重塑。代码补全、函数生成乃至整个模块的端到端构建,AI辅助工具以前所未有的效率赋能开发者。然而,在这片生产力狂欢的背后,一股令人不安的暗流正在涌动。近期,AI编程工具头部厂商Cursor的创始人兼CEO Michael Truell公开发出了一份极具分量的行业警示,他指出,一种他称之为**“氛围编程”(Vibe Coding)**的模式正在蔓延,这种过度依赖AI的开发方式,可能正将我们引向一个“看似繁荣,实则地基不稳”的危险未来。这份来自行业核心参与者的反思,为我们审视AI在软件工程中的角色,提供了一个冷静且必要的视角。

一、📈 “氛围编程”的幽灵:当直觉取代理解

1.1 “氛围编程”的核心特征

“氛围编程”并非一个严格的技术术语,而是对一种开发心态和行为模式的精准描绘。它的核心在于,开发者不再追求对代码逻辑的深度理解和掌控,转而依赖一种模糊的“感觉”或“氛围”来驱动开发。开发者向AI下达高级指令,AI返回可运行的代码,只要功能在表面上得以实现,任务便宣告完成。

这种模式下,开发者与代码之间建立了一种疏离的关系。代码不再是思想的精确表达,而是一个由AI组装的黑盒。开发者从软件的“建筑师”和“工程师”,逐渐退化为AI的“指令传递者”或“任务调度员”。他们关心的是“它看起来能跑”,而非“它为什么能这样跑”以及“它在极端情况下会如何表现”。

1.2 开发者为何陷入“氛围编程”

这种模式的吸引力是显而易见的,它迎合了人性中对即时满足和认知捷径的追求。

-

极高的效率与即时反馈。AI可以在数秒内生成数百行代码,快速将一个想法转化为可交互的原型。这种即时反馈循环极具诱惑力,尤其是在敏捷开发和快速迭代的压力下。

-

认知负荷的显著降低。理解复杂的业务逻辑、处理繁琐的边界条件、学习新的API,这些都是高认知负荷的活动。将这些任务外包给AI,让开发者得以从繁重的脑力劳动中解脱出来。

-

掩盖基础能力的不足。对于经验不足的开发者,AI成为了掩盖其基础知识短板的“拐杖”。他们可以绕过学习数据结构、算法或设计模式的艰苦过程,直接获得“能用”的解决方案。

然而,正是这种看似高效的捷径,正在为软件工程的未来铺设一条通往危机的轨道。

1.3 角色的异化:从“副驾驶”到“全自动驾驶”

AI辅助编程的初衷是扮演“副驾驶”(Co-Pilot)的角色,它负责处理重复、模式化的任务,为开发者提供建议,从而让开发者能专注于更具创造性和战略性的工作,例如系统设计、架构决策和复杂问题攻坚。但在“氛围编程”模式下,AI的角色被悄然切换到了“全自动驾驶”。

下表清晰地对比了两种模式下开发者与AI的角色分工差异。

|

评估维度 |

副驾驶模式 (Healthy Collaboration) |

全自动驾驶模式 (Vibe Coding) |

|---|---|---|

|

主导权 |

开发者主导,AI辅助 |

AI主导,开发者验证表面结果 |

|

核心任务 |

开发者负责架构设计、逻辑定义;AI负责代码实现、重构建议 |

开发者负责提出模糊需求;AI负责端到端实现 |

|

代码理解 |

开发者必须完全理解并为AI生成的代码负责 |

开发者选择性忽略代码细节,只关心功能是否实现 |

|

审查与测试 |

代码审查和单元测试是强制性的质量关卡 |

审查流于形式,测试可能由AI生成,缺乏深度覆盖 |

|

最终产物 |

高质量、可维护、开发者拥有完全所有权的软件资产 |

功能可用但内部结构脆弱、开发者无法完全掌控的“黑盒” |

这种角色的异化,是“氛围编程”最危险的信号。它意味着开发者正在主动放弃对软件系统最核心的控制权和理解力。

二、🏗️ 技术债的复利效应:从代码异味到系统性崩溃

Michael Truell用了一个非常形象的比喻来描述“氛围编程”的后果,它就像建造一栋只有墙壁和屋顶,却对地下的管线、承重结构和地基情况一无所知的建筑。短期内,这栋建筑或许能用,但其内部积累的结构性风险,将随着时间的推移,以复利的方式不断增长,最终导致灾难性的坍塌。

2.1 不稳定地基的具体表现

AI在生成代码时,其首要目标通常是“功能正确性”,而非“工程卓越性”。这导致其产出物天然地携带了多种技术债的基因。

2.1.1 架构原则的侵蚀

大型软件系统的稳定性和可扩展性,依赖于统一且清晰的架构原则,例如分层、模块化、依赖倒置等。AI在缺乏全局上下文的情况下,可能会在系统的不同部分生成风格迥异、模式冲突的代码。

-

破坏分层。一个被设计为表现层的组件,可能被AI植入了直接访问数据库的代码,破坏了应用的分层结构。

-

引入循环依赖。在生成新功能时,AI可能为了快速实现而随意引用其他模块,无意中造成模块间的循环依赖,使得系统变得僵化和难以维护。

-

设计模式的滥用或误用。AI可能会在不合适的场景下生搬硬套某个设计模式,或者用极其复杂的方式实现一个简单的功能,增加了不必要的复杂性。

2.1.2 依赖管理的黑洞

AI为了解决特定问题,可能会在其生成的代码中引入一些冷门、未经充分验证甚至存在安全漏洞的第三方库。在“氛围编程”模式下,开发者往往不会仔细审查这些新增的依赖。

-

供应链安全风险。这些未知的依赖项成为了软件供应链中的薄弱环节,可能将恶意代码或已知漏洞(CVE)引入到生产环境中。

-

许可证合规问题。AI引入的库可能带有严格的传染性许可证(如GPL),如果开发者不察觉,可能会给公司带来严重的法律风险。

-

依赖膨胀与冲突。无节制地添加依赖,会导致项目体积膨胀,构建时间变长,并极易引发不同库之间的版本冲突。

2.1.3 性能与资源的隐形消耗

AI生成的代码往往是“能跑就行”的朴素实现,很少会针对性能和资源使用进行优化。

-

低效的算法与数据结构。在需要高性能处理的场景,AI可能选择了一个时间复杂度为O(n²)的算法,而非更优的O(n log n)方案。

-

资源泄漏。AI生成的代码可能忘记关闭文件句柄、数据库连接或网络套接字,导致资源泄漏,长时间运行后会耗尽系统资源。

-

常见的性能陷阱。例如在循环中执行数据库查询(N+1问题)、不合理地使用重量级锁、生成大量临时对象导致频繁的垃圾回收(GC)等。

2.1.4 脆弱的错误处理与韧性设计

健壮的系统必须能够优雅地处理各种预期和意外的错误。AI在这方面的能力通常非常薄弱。

-

空的

catch块。这是最危险的模式之一,AI可能会生成try-catch结构,但在catch块中什么也不做,直接“吞掉”异常。这使得问题发生时,系统悄无声息地失败,极难排查。 -

笼统的异常处理。AI倾向于捕获顶级的

Exception,而不是具体的、可操作的异常类型。这使得精确的错误恢复和重试逻辑难以实现。 -

缺乏熔断、降级与重试机制。在分布式系统中,对下游服务的调用必须有韧性设计。AI生成的代码通常是简单的直接调用,缺乏对网络抖动、服务超时等问题的考虑。

2.2 技术债的累积与爆发过程

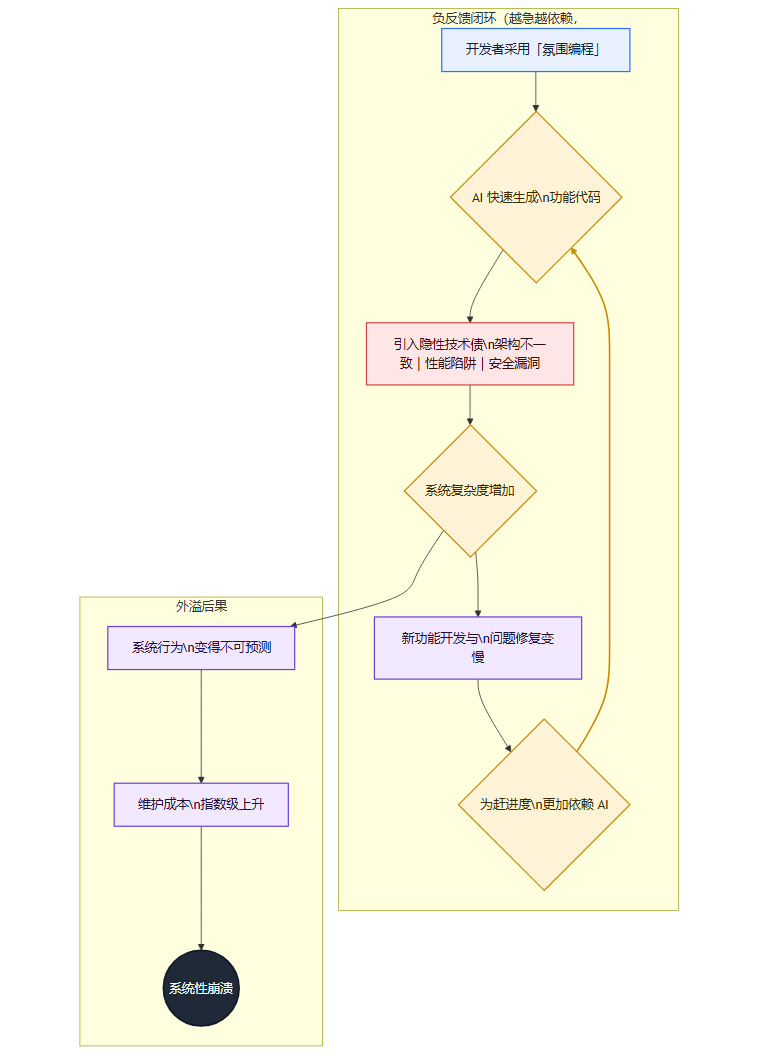

这些由AI埋下的“技术债”并非孤立存在,它们会相互作用,形成一个恶性循环的放大效应。我们可以用一个流程图来描绘这个过程。

这个流程清晰地展示了,短期的效率提升是以透支系统长期的健康为代价的。起初,问题可能只是零星的“代码异味”。但随着功能不断叠加,这些问题会盘根错节,最终形成一张难以解开的“技术债之网”。当这张网的承载力达到极限时,任何一次看似微小的改动,都可能触发多米诺骨牌效应,导致整个系统的崩溃。

三、🧠 开发者技能的“空心化”:从工程师到AI操作员

“氛围编程”对系统的侵蚀是深远的,但其对开发者个人乃至整个行业的伤害可能更为致命。它正在引发一场技能的“空心化”危机,威胁着软件工程师这个职业的核心价值。

3.1 基础能力的系统性削弱

软件工程的根基,建立在一系列扎实的基础能力之上,包括数据结构与算法、计算机网络、操作系统原理、编译原理等。这些知识是理解软件为何如此运行的基石。

-

对于初级开发者。他们是“氛围编程”最大的受害者。AI让他们可以轻易绕过学习这些底层知识的“痛苦曲线”,直接获得成果。这看似是福音,实则是剥夺了他们构建坚实知识体系的机会。一个不理解TCP/IP协议栈的开发者,如何能设计出高可用的网络服务?一个对并发模型一知半解的开发者,又如何能编写出线程安全的代码?

-

对于资深开发者。长期依赖AI,同样会使其技能“生锈”。解决复杂问题的能力,源于持续不断的深度思考、调试和实践。当这些脑力活动被AI代劳后,曾经娴熟的技能会逐渐退化。

3.2 解决复杂问题能力的丧失

AI工具目前最擅长的是解决那些已经被充分定义、有大量现有代码可供学习的“常规问题”。然而,软件工程的真正价值,在于解决那些全新的、模糊的、充满不确定性的“复杂问题”。

-

调试能力的退化。调试是工程师的核心技能之一,它要求缜密的逻辑推理、大胆的假设和细致的验证。当一个由AI生成的复杂系统出现诡异的Bug时,一个只会“氛围编程”的开发者将束手无策,因为他根本不理解系统的内部工作机制。他无法像经验丰富的工程师那样,通过日志、指标和调试工具,层层剥茧,直达问题的根源。

-

系统设计与创新的停滞。伟大的软件架构,诞生于对业务需求的深刻洞察、对技术边界的精准把握和对未来演进的战略远见。这些都不是AI目前能够胜任的。如果开发者将自己局限于向AI提需求的“产品经理”角色,那么整个行业创造突破性技术和架构的能力将被严重抑制。

3.3 职业价值的重新定义

长期来看,“氛围编程”将导致开发者群体的分化。一部分人将彻底沦为“AI操作员”,他们的工作是重复性的,价值是低廉的,并且极易被更智能的AI或更低成本的人力所替代。他们的核心竞争力不再是工程技术本身,而是“如何更好地向AI提问”(Prompt Engineering)。

另一部分人,则会警惕这种趋势,主动将AI作为提升自身能力的杠杆,而非替代品。他们会利用AI处理琐碎事务,将节省下来的时间投入到更具价值的活动中。下表对比了这两种截然不同的职业发展路径。

|

维度 |

AI操作员 (Prompt Engineer) |

AI赋能的软件工程师 (AI-Empowered Engineer) |

|---|---|---|

|

核心技能 |

编写高效的Prompt、任务拆解 |

系统设计、架构决策、复杂问题诊断、代码审查、技术领导力 |

|

与AI的关系 |

依赖、服从 |

协作、驾驭 |

|

价值来源 |

提升AI任务的完成效率 |

确保软件系统的长期健康、可靠性和创新性 |

|

职业天花板 |

较低,受限于AI本身的能力 |

极高,可成长为架构师、技术专家、CTO |

|

可替代性 |

高 |

低 |

Cursor创始人的警告,实际上是在提醒每一位开发者,必须主动选择成为后者。否则,在不远的将来,我们可能会发现自己被亲手喂养大的AI工具所淘汰。

四、🛡️ 构建防御工事:人机协作的工程纪律

面对“氛围编程”带来的系统性风险,我们并非束手无策。解决方案不在于抵制AI,而在于建立一套更加严格、更加以人类智慧为核心的工程纪律。我们必须将AI视为一个能力极强但心智尚不成熟的“实习生”,而不是一个可以完全信赖的“资深专家”。这意味着我们需要构建一套有效的“防御工事”,确保AI的效率优势得以发挥,同时其潜在的破坏性被严格约束。

4.1 “信任但核实”:AI产出物的正确心智模型

我们必须从根本上转变对AI生成代码的心智模型。AI的任何输出,都应被视为一份“草稿”或“提议”,而非可以直接合并的“最终交付物”。采纳这份草稿的前提是,开发者必须对其进行彻底的理解、审查和重构,直到它完全符合团队的质量标准和架构原则。

这个过程可以类比于数学家使用计算机辅助证明。计算机可以执行海量的计算和符号推演,但最终的逻辑链条、公理应用和证明的完备性,必须由数学家本人来审视和确认。在软件工程中,开发者就是那位最终负责的“数学家”。

4.2 强化传统质量关卡

在AI时代,传统的软件质量保障手段,如代码审查、自动化测试和静态分析,不仅没有过时,反而变得比以往任何时候都更加重要。它们构成了抵御“氛围编程”侵蚀的第一道,也是最重要的一道防线。

4.2.1 代码审查的“升维”

传统的代码审查(Code Review)可能更多关注于编码规范、命名和简单的逻辑错误。但在审查AI生成的代码时,其职责必须“升维”,审查者需要带上“架构师”和“安全专家”的帽子。

-

审查的焦点转移。审查的重点应从“代码写得怎么样”转向“这段代码为什么要存在”以及“它对系统的长期影响是什么”。

-

深挖隐藏的假设。AI代码常常包含一些隐性的上下文假设。例如,它可能假设某个输入永远不为null,或者某个API调用永远不会超时。审查者必须像侦探一样,找出并挑战这些未经声明的假设。

-

安全审计成为标配。必须对AI生成的代码进行严格的安全审计,检查是否存在常见的安全漏洞,如SQL注入、跨站脚本(XSS)、不安全的依赖项引用等。

-

“可解释性”审查。如果一段AI生成的代码逻辑过于复杂,以至于审查者无法在短时间内理解,那么这段代码就应该被拒绝。不可解释的代码,就是不可维护的代码。开发者应要求提交者(无论是人还是AI)用更简单、更清晰的方式重构它。

4.2.2 测试策略的再思考

AI同样可以生成测试用例,这在提升测试覆盖率方面很有帮助。但测试的价值核心在于“测试策略的设计”,而非“测试代码的编写”。

-

强化契约测试与集成测试。由于AI可能在不同模块间引入微妙的不一致性,因此验证模块间交互契约的集成测试变得至关重要。

-

引入属性测试(Property-Based Testing)。相比于传统的基于示例的测试(Example-Based Testing),属性测试不关心单个具体输入的输出,而是定义和验证代码必须遵守的通用“属性”或“不变量”。这种方法对于发现AI代码中隐藏的边缘情况(Edge Cases)非常有效。

-

混沌工程的常态化。对于复杂的分布式系统,应定期引入混沌工程实践,主动在系统中注入故障(如网络延迟、节点宕机),以检验由AI构建或修改的部分是否具备足够的韧性。

4.2.3 静态与动态分析工具的“强制执行”

自动化工具是捕获低级错误和安全问题的有效手段。

-

静态应用安全测试(SAST)。在代码提交和构建流水线中,强制执行SAST扫描,可以自动发现AI代码中许多常见的安全漏洞。

-

软件成分分析(SCA)。SCA工具可以扫描项目依赖,识别出其中包含已知漏洞的库,有效防范AI引入的供应链风险。

-

代码质量度量。使用SonarQube等工具持续监控代码的圈复杂度、重复率、技术债预估等指标。当AI的引入导致这些指标恶化时,必须及时告警并进行干预。

4.3 人类“签字”的最终所有权

无论一段代码由谁生成,最终将其合并到主干分支的那个开发者,就必须承担起100%的所有权和责任。在工程文化中,必须杜绝“这是AI写的,我不太清楚”这类推卸责任的言辞。

-

明确的责任归属。每一次代码提交,都必须有明确的人类负责人。这个负责人不仅要对代码的功能负责,更要对其可读性、可维护性、性能和安全性负责。

-

鼓励重构而非直接接受。当AI提供了一个可行的方案时,更佳的实践往往不是直接复制粘贴,而是理解其思路后,用自己的方式,结合更深厚的上下文知识,亲手重写一遍。这个过程本身就是一次宝贵的学习和内化。

通过上述工程纪律的建设,我们可以为AI这匹“快马”套上可靠的“缰绳”,确保它在正确的赛道上,朝着提升软件工程质量的终极目标前进。

五、🌐 行业范式的演进:从效率崇拜到价值回归

Cursor创始人的警告,更深层次上是对当前行业过度崇拜“开发速度”和“交付效率”这一范式的反思。AI的出现,将这种崇拜推向了极致,但也同时暴露了其内在的脆弱性。未来,一个成熟的、能够与AI共存的软件行业,必须完成一次从“效率崇拜”到“长期价值回归”的范式转换。

5.1 重新定义“生产力”

长期以来,软件开发的生产力常常被简单地量化为“功能点数量”、“代码行数”或“交付的故事点”。这些指标在AI时代将变得极具误导性。一个团队可以在一天内使用AI“生产”数千行代码和十几个功能,但如果这些产出是以累积巨额技术债为代价,那么这种“生产力”就是负面的。

未来的生产力衡量,必须转向更关注长期价值的指标。

|

旧有指标 (效率导向) |

未来指标 (价值导向) |

衡量目的 |

|---|---|---|

|

代码行数 (Lines of Code) |

平均故障恢复时间 (MTTR) |

衡量系统的韧性和团队的应急响应能力 |

|

功能交付速度 (Velocity) |

变更失败率 (Change Fail Rate) |

衡量交付过程的稳定性和质量 |

|

开发人员数量 (Headcount) |

系统可维护性指数 |

评估维持和扩展系统所需的长期成本 |

|

CPU利用率 |

客户满意度与业务成果 |

将技术活动与最终的商业价值直接挂钩 |

这种转变意味着,管理者的关注点必须从“我们多快”转向“我们多稳,以及我们创造了多少可持续的价值”。

5.2 资深工程师角色的演变

在新的范式下,资深工程师和技术负责人的角色将发生深刻的演变。他们的价值将不再仅仅体现在编写最核心、最复杂的代码上,而更多地体现在以下几个方面。

-

技术方向的“把关人”。他们负责制定和维护团队的技术标准、架构原则和质量红线,确保AI的应用不会偏离正确的工程轨道。

-

代码质量的“首席策展人”。他们是代码审查流程的核心,负责审查最关键、最复杂的AI生成代码,并对代码库的整体健康状况负责。

-

团队能力的“赋能者”。他们最重要的职责之一,是指导和培养初级开发者如何批判性地、有效地使用AI工具。他们需要教会新人如何审查、重构和测试AI代码,帮助他们建立扎实的基础能力,避免陷入“氛围编程”的陷阱。

5.3 AI与创新的辩证关系

过度依赖AI会扼杀创新,但这并不意味着AI是创新的敌人。恰恰相反,当被正确使用时,AI是加速深度创新的强大催化剂。

-

加速原型验证。AI可以帮助团队在极短的时间内,将一个创新的想法构建成可交互的原型,从而快速验证其市场和技术可行性,大大降低了创新的试错成本。

-

解放人力于创造性任务。通过将繁琐的、重复性的编码工作(如编写样板代码、数据转换、API客户端等)自动化,AI可以将开发者从“技术劳作”中解放出来,让他们有更多的时间和精力投入到真正需要人类智慧的创新活动中。

-

提供多样的解决方案。面对一个复杂问题,开发者可以要求AI提供多种不同的实现思路或架构方案。这可以拓宽开发者的视野,激发新的灵感,避免陷入单一的思维定式。

关键在于,我们必须将AI定位在创新的“辅助者”,而非创新的“主导者”。创新的火花,永远源于人类对问题的深刻洞察、跨领域的知识连接和不拘一格的想象力。

结论

AI编程工具的崛起,是软件开发史上一次深刻的技术变革。它带来了前所未有的效率提升,但也伴随着“氛围编程”这一危险的副作用。Cursor创始人的警告,如同一声警钟,提醒我们必须正视过度依赖AI所带来的技术债累积、开发者技能空心化和行业创新能力受损的风险。

我们不应因噎废食,拒绝AI带来的进步。正确的道路是,在拥抱AI的同时,以加倍的努力坚守和强化软件工程的核心原则。通过建立“信任但核实”的心智模型,升级代码审查、测试等质量关卡,并明确人类开发者的最终所有权,我们可以构建起一套与AI高效、安全协作的工程体系。

最终,AI是放大器,它既可以放大我们的效率,也可以放大我们的错误。决定其最终效果的,不是工具本身,而是使用工具的人。只有那些保持清醒、坚守纪律、并始终将创造长期价值作为最终目标的开发者和团队,才能在这场由AI驱动的行业变革中,行稳致远。

📢💻 【省心锐评】

AI是速度的引擎,但工程纪律才是方向盘。没有方向盘的狂飙,终点只会是悬崖。开发者必须手握方向盘,让AI成为通往卓越工程的助推器,而非失控的加速器。

更多推荐

已为社区贡献552条内容

已为社区贡献552条内容

所有评论(0)