【值得收藏】企业AI架构指南:从“搭框架“到“用对路“的系统化方法

总结一下,企业AI的架构不是“五层的堆砌”,而是**“业务→应用→插件→模型→数据→硬件”的 逆向推导**——先想“要解决什么业务问题”,再想“用什么应用”,再想“需要什么插件连接模 型和应用”,再想“选什么模型”,再想“需要什么数据”,最后想“买什么硬件”。比如一家零售企业要做“智能客服”,架构应该是这样的:•业务问题:减少客服重复咨询(比如“退换货政策”每天被问100次);•应用场景:智能客服

很多企业聊AI落地时,常陷入两个误区:要么把AI当成“插件”,随便找个大模型接上去就用;要么把AI当成“基建”,买了一堆GPU却不知道怎么连数据、跑应用。其实企业AI不是“ 堆组件”,而是一套“分层协同的系统”——就像盖房子,地基(硬件)、钢筋水泥(数据)、框架(模型)、水电管线(插件)、装修(应用),每一层都要衔接好,否则要么塌掉,要么用起来别扭。

今天我就把企业AI的架构拆透,从“五层结构”讲到“部署选择”,最后说清楚“怎么用对场 景”——毕竟,架构的本质是“解决问题的工具”,不是“摆给别人看的图纸”。

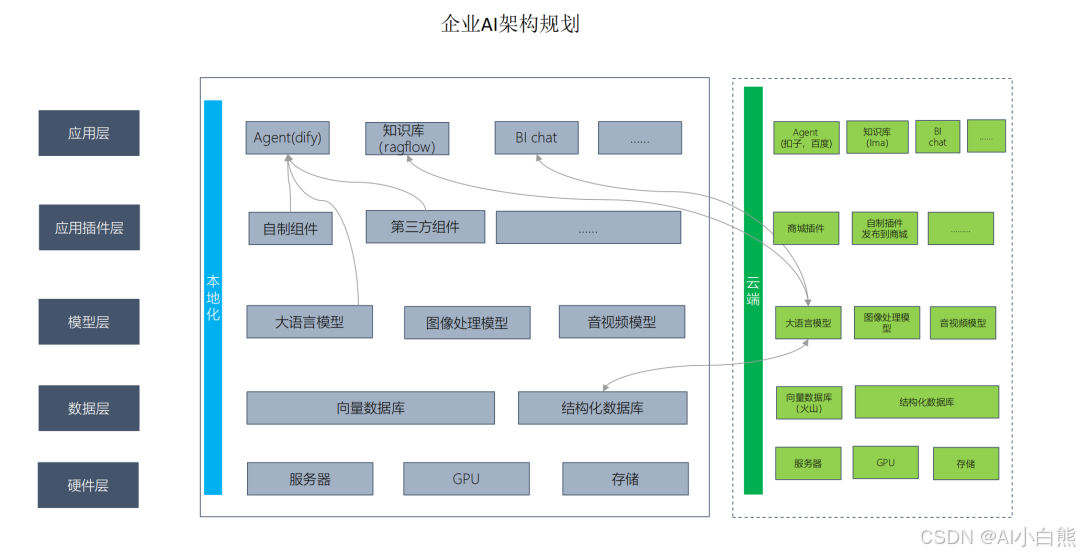

一、企业AI的“五层金字塔”:每一层都有不可替代的作用

企业AI的架构可以拆解为硬件层-数据层-模型层-AI应用插件层-应用层,五层从上到下是“支撑关系”,从下到上是“价值传递关系”——底层越扎实,上层的应用越能跑通;上层越贴近业务,底层的投入越有意义。

1. 硬件层:AI的“物理地基”,不是“买GPU就行”

很多人对硬件层的认知停留在“GPU数量”,但实际上,硬件层是“计算、存储、网络”的协同系统,三个部分缺一不可:

•计算层:以GPU(如NVIDIA A100/H100)或AI芯片(如昇腾910)为核心,负责模型训 练和推理——比如训练一个大语言模型需要 thousands of GPU-hours,推理一个复杂的图像生成任务需要GPU的张量核心加速;•存储层:分“热存储”(SSD,用于高频访问的向量数据库)和“冷存储”(NAS/对象存储,用于归档非结构化数据),还要解决“数据流动”问题——比如从业务系统导过来的订单数据,要能快速同步到向量数据库;•网络层:低延迟的RDMA网络(比如InfiniBand)是关键,否则模型推理时调用数据会 “卡脖子”——比如一个Agent要同时调用大模型和本地知识库,网络延迟超过100ms,用户体验就会崩。

一句话总结:硬件层不是“买最贵的GPU”,而是“匹配业务需求的计算存储网络组合”—— 比如做客服知识库的企业,不需要顶级GPU,但需要大容量的向量数据库存储;做工业图像检测的企业,需要高算力GPU处理实时图像,但存储可以用便宜的对象存储。

2. 数据层:AI的“燃料库”,不是“存数据就行”

AI的核心是“用数据喂模型”,但数据层的关键不是“量”,而是“结构化+向量化的双底座 ”——就像做饭,既要把食材洗干净(结构化),也要切成适合下锅的大小(向量化):

•结构化数据:来自ERP、CRM等业务系统的表格数据(如订单、客户信息),特点是“ 规整、易查询”,适合用来做“精准计算”(比如ChatBI分析月度销量);•非结构化数据:PDF、Word、音频、视频等“散装数据”,需要先做“切片-向量化”处理——比如把一份产品手册切成1000个片段,用Embedding模型(如 text-embedding-3-small)转换成768维的向量,存到向量数据库(如 Pinecone、Chroma)里,这样AI才能“理解”内容,回答用户的问题(比如“我们的产品质 保期是多久”)。

这里有个误区:很多企业以为“把数据扔到向量库就行”,但其实向量化的质量决定了 AI的回答质量——比如切片太粗(把10页的手册切成1片),AI会找不到关键信息;切片太细(把一句话切成3片),AI会断章取义。所以数据层一定要做“预处理 pipeline”:自动分词、去重、标注,确保向量库的“纯度”。

3. 模型层:AI的“引擎”,不是“越大越好”

模型层是AI的“大脑”,但选模型的关键不是“参数规模”,而是“匹配业务场景”——就像开车,跑高速用跑车,拉货用卡车,不是所有场景都需要“千万参数的大模型”:

•大语言模型(LLM):处理文字类任务(如写文案、答问题、生成报告),国内的 DeepSeek-R1、阿里千问,国外的GPT-4、Claude 3都是典型;•多模态模型:处理图像、音频、视频任务(如生成产品图、转写会议录音、剪辑短视频),比如Stable Diffusion(生图)、Whisper(语音转文字)、Llama 3多模态版(图文理解);•垂直领域模型:针对特定行业的优化模型(如医疗领域的影像诊断模型、金融领域的 fraud detection模型),这类模型参数不一定大,但“行业知识”更精准。

模型选型的三个原则:① 优先用“开箱即用的成熟模型”(比如写文案用GPT-4,生图用 Stable Diffusion),不要从零训练;② 核心业务用“微调后的模型”(比如把企业手册喂给 LLM,让它回答更精准);③ 涉密场景用“开源模型私有化部署”(比如DeepSeek-MoE、Llama 3开源版)。

4. AI应用插件层:AI的“变速箱”,不是“可有可无”

很多人会忽略这一层,但插件层是“连接模型和应用的关键中间件”——就像汽车的变速箱,把引擎的动力转换成车轮的动力,否则模型再强,应用也用不上:

•工作流插件:比如LangChain、AutoGPT的工作流引擎,能把“调用模型-查询数据库- 生成结果”串成一个自动化流程(比如“收到客户投诉邮件→调用Whisper转文字→查询CRM客户历史→用LLM生成回复→自动发送”);•工具调用插件:比如连接Excel、SQL的插件,让AI能“操作本地数据”(比如ChatBI要分析月度销量,需要调用SQL插件查数据库,再用LLM生成图表);•安全管控插件:比如内容审核插件(防止AI生成违规内容)、权限管理插件(限制不同角色调用不同模型)。

插件层的核心价值:让应用“模块化”——比如要做一个“合同审核Agent”,不需要重新写代码,只要组合“PDF解析插件+LLM合同审核模型+邮件发送插件”就行,灵活度比从头开发高10倍。

5. 应用层:AI的“终端”,不是“为了用AI而用AI”

应用层是企业AI的“最后一公里”,评价应用的唯一标准是“解决具体业务问题”——不是“ 能生成文章”,而是“能帮市场部每天省2小时写文案”;不是“能答问题”,而是“能帮客服减少30%重复咨询”:

•Agent(智能代理):比如“销售助理Agent”,能自动处理客户跟进(比如“客户问‘产 品价格’→查询产品库→用LLM生成报价→发送客户”),适合高频、重复性的业务;•知识库问答:比如把企业手册、产品说明喂给向量库,用Chatbot做“智能 FAQ”(比如“我们的产品质保期是多久”→AI查询向量库→生成准确回答),适合客服、培训场景;•ChatBI:用“自然语言提问→AI生成SQL→查询数据库→生成图表”的流程,替代传统BI的 “写SQL-跑数据-做图表”(比如“上个月华南地区的销量同比增长多少”→AI自动生成SQL→返回结果+柱状图),适合数据分析场景。

二、部署方式:不是“选云端还是本地”,而是“选适合业务的组合”

讲完架构,接下来是企业最头疼的问题:AI要部署在云端?本地?还是混合? 答案不是“非此即彼”,而是“根据业务需求选组合”——就像住房子,刚需房选市区(云端,方便), 别墅选郊区(本地,私密),改善房选城乡结合部(混合,平衡)。

1. 云端部署:快速试错的“轻模式”

适合场景:初创企业、快速试错的业务(比如新推出的市场活动文案生成)、非核心数据的应用(比如公众号文章生成)。

优势:① 快(注册账号就能用,不用买硬件);② 省(按调用量付费,不用承担硬件折旧);③ 全(云端服务商有丰富的插件和模型,比如阿里云的通义千问、百度的文心一 言)。

劣势:① 数据隐私风险(核心数据要传到云端,比如客户身份证信息);② 自定义受限 (云端模型不能深度微调,比如要让AI用企业独特的术语回答,可能做不到);③ 调用延迟 (高峰期云端模型响应慢,比如晚上8点用GPT-4写文案,可能要等10秒)。

2. 本地化部署:数据安全的“重模式”

适合场景:金融、医疗、政务等涉密场景(比如医院的病历分析、银行的客户风险评 估)、核心业务系统(比如企业的ERP数据查询)。

优势:① 数据可控(所有数据都在本地服务器,不会泄露);② 自定义强(可以深度微调模型,比如把医院的病历喂给LLM,让它诊断更准确);③ 响应快(本地模型调用延迟低 于1秒,适合实时场景)。

劣势:① 贵(要买GPU、服务器、向量数据库,前期投入至少几十万);② 重(需要专门的IT团队维护,比如模型升级、硬件故障);③ 慢(部署周期长,从买硬件到上线要1-3 个月)。

3. 混合部署:平衡效率和安全的“最优解”

适合场景:中大型企业、有核心数据但需要快速迭代的业务(比如制造企业的生产流程优化)。

具体组合方式:① 核心数据本地化(比如客户身份证信息存在本地向量库),非核心数据云端(比如市场活动文案生成用云端模型);② 实时业务本地化(比如生产线上的图像检测用本地模型),非实时业务云端(比如月度生产报告生成用云端模型);③ 模型训练云端 (用云端的大算力训练模型),模型推理本地化(用本地服务器跑模型,避免数据传到云端)。

优势:兼顾了云端的“快”和本地的“安全”,是目前大部分企业的选择。

三、企业AI架构规划的“三个关键”:避免踩坑的核心逻辑

讲完架构和部署,最后说三个能帮企业少走弯路的规划原则——毕竟,架构不是“画图纸 ”,而是“解决问题”:

1. 顶层设计要“对齐业务”,不要“为技术而技术”

很多企业做AI架构时,先买GPU,再找数据,最后想应用——这是“倒着来”。正确的顺序是:先明确业务问题→再选应用场景→最后设计架构。 比如制造企业的业务问题是“减少生产线上的次品率”,对应的应用场景是“生产线上的图像检测”,那么架构设计应该是:① 硬件层买高算力GPU(用于实时图像检测);② 数据层存生产线上的次品图像(结构化数据是次品率统计,非结构化数据是次品图像);③ 模型层用微调后的YOLOv8(图像检测模型);④ 插件层用本地工作流引擎(连接图像传感器-模型-ERP 系统);⑤ 应用层是生产线上的实时报警系统(检测到次品自动停机)。

2. 数据底座要“打扎实”,不要“凑数”

AI的效果80%取决于数据,所以数据层是架构的“地基”——比如做知识库问答,如果你把企业手册切成1000片,但每片都有重复内容,那么AI回答会混乱;如果切片太粗,AI找不到关键信息。

数据层的三个关键点:① 全(把所有相关数据都整合进来,比如企业手册、客服记录、 产品说明);② 纯(去重、去错、标注,确保数据准确);③ 活(定期更新数据,比如新产品上线后,及时把新手册喂给向量库)。

3. 部署方式要“匹配需求”,不要“跟风”

很多企业会问“到底用云端还是本地?”——没有标准答案,关键看你的“核心诉求”是什么:

•如果核心诉求是“快”(比如新业务要快速上线),选云端;•如果核心诉求是“安全”(比如涉密数据),选本地;•如果核心诉求是“平衡”(既要安全又要快),选混合。

最后:企业AI落地的“全景图”

总结一下,企业AI的架构不是“五层的堆砌”,而是**“业务→应用→插件→模型→数据→硬件”的 逆向推导**——先想“要解决什么业务问题”,再想“用什么应用”,再想“需要什么插件连接模 型和应用”,再想“选什么模型”,再想“需要什么数据”,最后想“买什么硬件”。

比如一家零售企业要做“智能客服”,架构应该是这样的:

•业务问题:减少客服重复咨询(比如“退换货政策”每天被问100次);•应用场景:智能客服Chatbot;•插件层:用本地工作流引擎(连接Whisper语音转文字+向量数据库+LLM);•模型层:用微调后的DeepSeek-R1(喂了企业的退换货政策);•数据层:结构化数据是客户订单(来自CRM),非结构化数据是退换货政策手册(切片后存本地向量库);•硬件层:买2台NVIDIA A100 GPU(用于模型推理)+ 1台向量数据库服务器(存退换货手册);•部署方式:混合部署(核心数据本地,非核心数据云端)。

写在最后:企业AI不是“未来时”,而是“现在时”——但要落地好,关键不是“用最先进的 技术”,而是“用对的架构解决对的问题”。希望这篇文章能给你一张“AI落地的全景图”,帮你从顶层设计开始,把AI从“概念”变成“能用、好用、有用”的工具。

毕竟,技术的价值,永远是解决业务的问题。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

更多推荐

已为社区贡献492条内容

已为社区贡献492条内容

所有评论(0)