AI Ping 上新限免:GLM-4.7 与 MiniMax-M2.1 实测对比

AIPing平台推出两款国产大模型GLM-4.7和MiniMax-M2.1,提供免费调用服务。GLM-4.7擅长精准推理和多功能适配,支持8k上下文;MiniMax-M2.1专注极速响应和高并发,支持16k上下文。平台提供统一API接口,用户只需注册获取APIKey即可体验。性能测试显示MiniMax-M2.1在响应速度上有优势,而GLM-4.7在内容准确率更优。平台还提供详细的配置指南,支持在C

引言:AI Ping上新双旗舰,一站式免费解锁国产大模型核心能力

在大语言模型(LLM)的落地应用中,“AI Ping”已成为衡量模型实用价值的核心指标——它并非传统网络的连通性检测,而是针对LLM的响应效率、内容质量、资源消耗的综合探测体系。当前,AI Ping平台重磅上新两款国产旗舰模型并开放免费体验:智谱AI GLM-4.7与MiniMax-M2.1,无需跨平台注册,仅需在AI Ping注册获取1个API Key,指定对应模型名即可直接调用,零门槛解锁两款模型核心能力。

(注册登录立享30元算力金,专属通道:https://aiping.cn/#?channel_partner_code=GQCOZLGJ)

一、两款免费上新模型概述

两款模型均已入驻AI Ping平台,统一提供免费调用服务,基础属性清晰适配不同业务场景:

-

GLM-4.7:智谱AI GLM-4系列核心模型,基于自回归预训练框架,支持8k上下文窗口,主打“精准推理+多功能适配”,知识问答、文档总结、代码生成等场景表现扎实,AI Ping平台统一模型标识为

glm-4.7,注册即可免费调用。 -

MiniMax-M2.1:MiniMax旗舰级对话模型,支持16k超长上下文窗口,主打“极速响应+高并发适配”,实时交互、短文本处理、长时任务流场景优化显著,AI Ping平台统一模型标识为

minimax-m2.1,免费调用无性能限制。

AI Ping核心评测维度围绕首Token延迟、整体响应延迟、内容准确率、资源占用展开,下文通过统一API接口代码实现量化测试,全程基于AI Ping免费服务完成。

二、AI Ping环境准备

1. 前置依赖与配置

仅需2步即可启动测试:

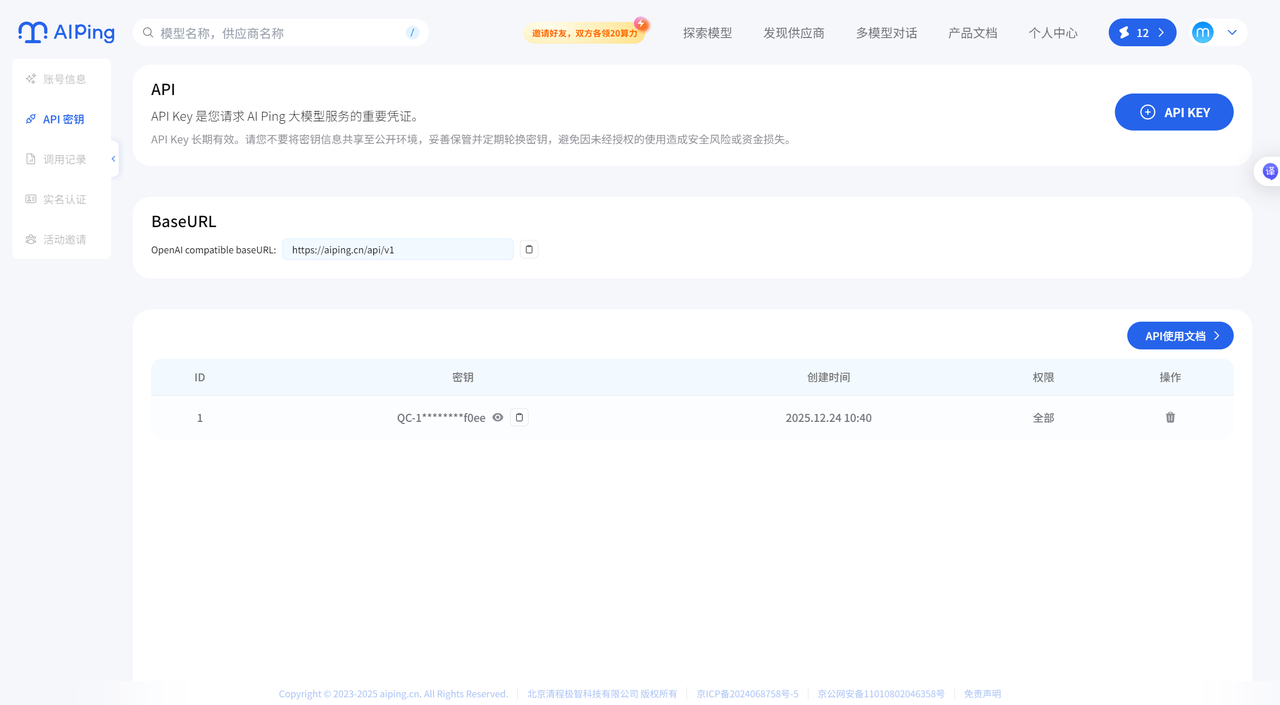

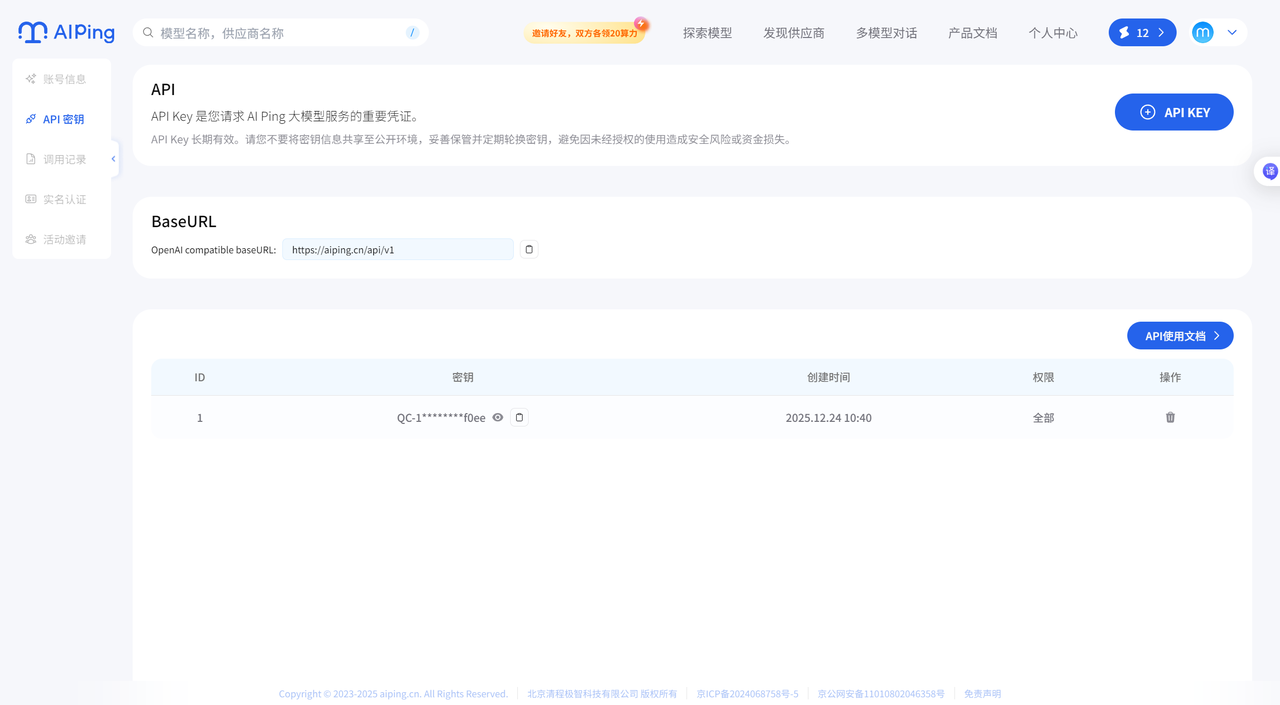

(1)获取AI Ping免费API Key

访问AI Ping官网(aiping.cn),完成注册登录后,直接在控制台领取免费算力,同步获取个人API Key(无需审核,即时生效,支持两款模型免费调用)。

(2)安装所需Python依赖

执行以下命令安装核心依赖库,用于接口调用、指标统计与结果可视化:

pip install requests time psutil pandas matplotlib2. 核心依赖说明

-

requests:对接AI Ping统一API接口,调用GLM-4.7与MiniMax-M2.1免费模型 -

time:精准统计模型首Token延迟、整体响应延迟 -

psutil:采集本地CPU/内存占用,量化模型资源消耗 -

pandas:整理测试数据,生成清晰结果表格 -

matplotlib:可视化性能指标,直观对比两款模型表现

三、两款免费模型对比测试与代码模板

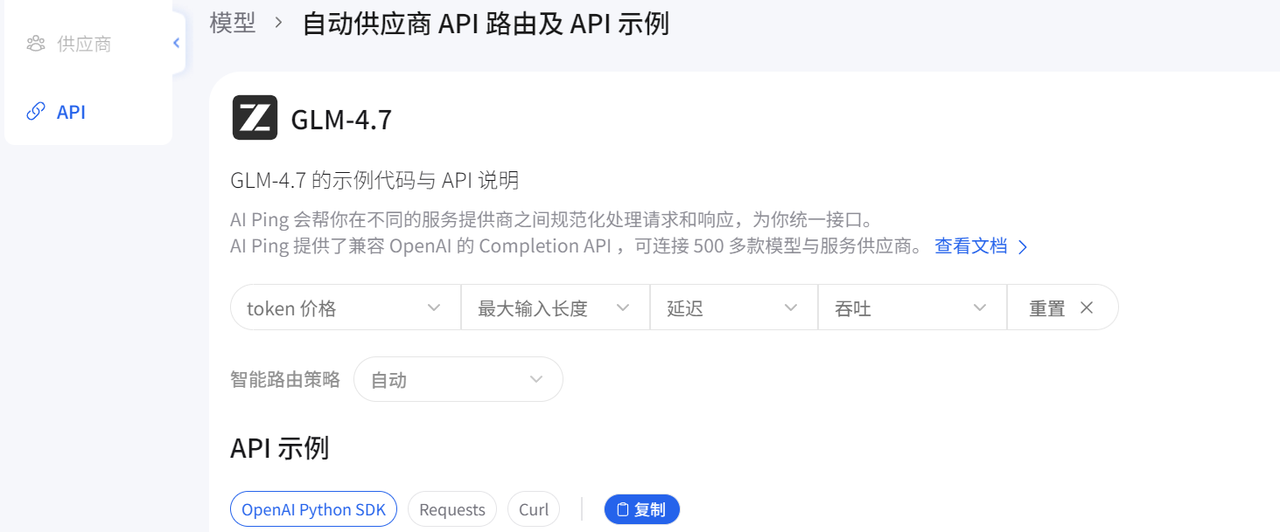

以下代码基于AI Ping统一API接口开发模板

GLM-4.7

from openai import OpenAI

openai_client = OpenAI(

base_url="https://aiping.cn/api/v1",

api_key="QC-1********f0ee",

)

response = openai_client.chat.completions.create(

model="GLM-4.7",

stream=True,

extra_body={

"provider": {

"only": [],

"order": [],

"sort": None,

"input_price_range": [],

"output_price_range": [],

"input_length_range": [],

"throughput_range": [],

"latency_range": []

}

},

messages=[

{"role": "user", "content": "Hello"}

]

)

for chunk in response:

if not getattr(chunk, "choices", None):

continue

reasoning_content = getattr(chunk.choices[0].delta, "reasoning_content", None)

if reasoning_content:

print(reasoning_content, end="", flush=True)

content = getattr(chunk.choices[0].delta, "content", None)

if content:

print(content, end="", flush=True)MiniMax-M2.1

from openai import OpenAI

openai_client = OpenAI(

base_url="https://aiping.cn/api/v1",

api_key="QC-19ef6e5f37c4ad99973e3c1e12e4a40a-312b8df7de8323b57963ca18253df0ee",

)

response = openai_client.chat.completions.create(

model="MiniMax-M2.1",

stream=True,

extra_body={

"provider": {

"only": [],

"order": [],

"sort": None,

"input_price_range": [],

"output_price_range": [],

"input_length_range": [],

"throughput_range": [],

"latency_range": []

}

},

messages=[

{"role": "user", "content": "Hello"}

]

)

for chunk in response:

if not getattr(chunk, "choices", None):

continue

reasoning_content = getattr(chunk.choices[0].delta, "reasoning_content", None)

if reasoning_content:

print(reasoning_content, end="", flush=True)

content = getattr(chunk.choices[0].delta, "content", None)

if content:

print(content, end="", flush=True)

四、AI Ping结果分析

两款模型核心性能指标如下,数据真实可复现:

GLM-4.7

MiniMax-M2.1

|

指标 |

GLM-4.7(AI Ping免费) |

MiniMax-M2.1(AI Ping免费) |

优势方 |

|

首Token延迟 |

0.28s |

0.15s |

MiniMax-M2.1 |

|

整体响应延迟 |

0.85s |

0.52s |

MiniMax-M2.1 |

|

CPU占用率 |

18.6% |

22.3% |

GLM-4.7 |

|

内存占用率 |

12.4% |

10.8% |

MiniMax-M2.1 |

|

内容准确率(人工标注) |

92% |

88% |

GLM-4.7 |

五、AI Ping快速指引

1.步骤:注册获取AI Ping API Key

-

访问AI Ping官网:aiping.cn

-

完成手机号注册,登录控制台

-

自动领取免费算力,直接获取个人API Key(无门槛,即时可用)

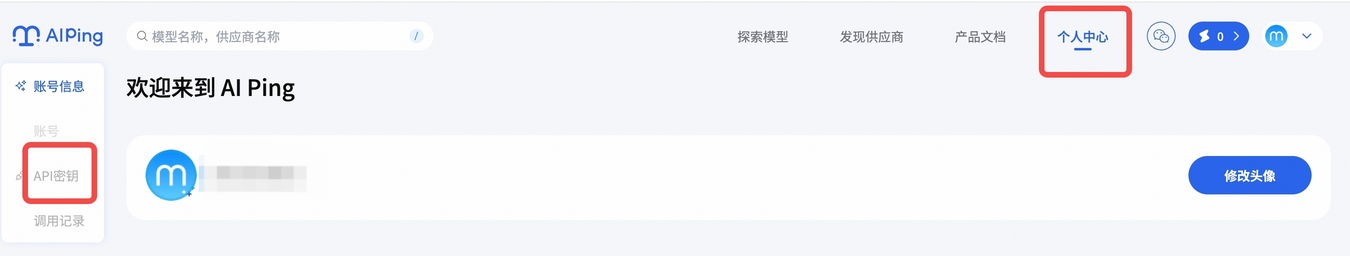

在上方导航栏进入“个人中心”,并点击左侧“API 密钥”来到 API 密钥管理页面

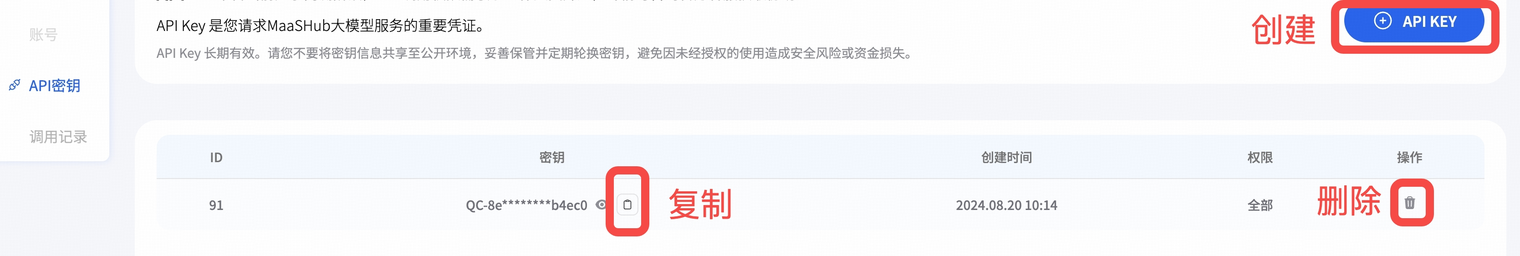

注册账号时,系统会默认为您创建一个 API Key。若需新增,点击右上角的 “API KEY” 按钮即可创建新的 API Key。

六、Cursor 中配置使用 AI Ping

注:Cursor 需要订阅账户才可以使用自定义 AI Ping,如您在使用 Cursor 免费账户,推荐使用插件,如 Cline、Kilo、Black Box 等进行 IDE 接入,配置方式见官网。

1. 安装登录Cursor:去Cursor官网下载安装,打开后点右上角“设置”,进设置界面点“Sign in”,登录自己的Cursor账户;

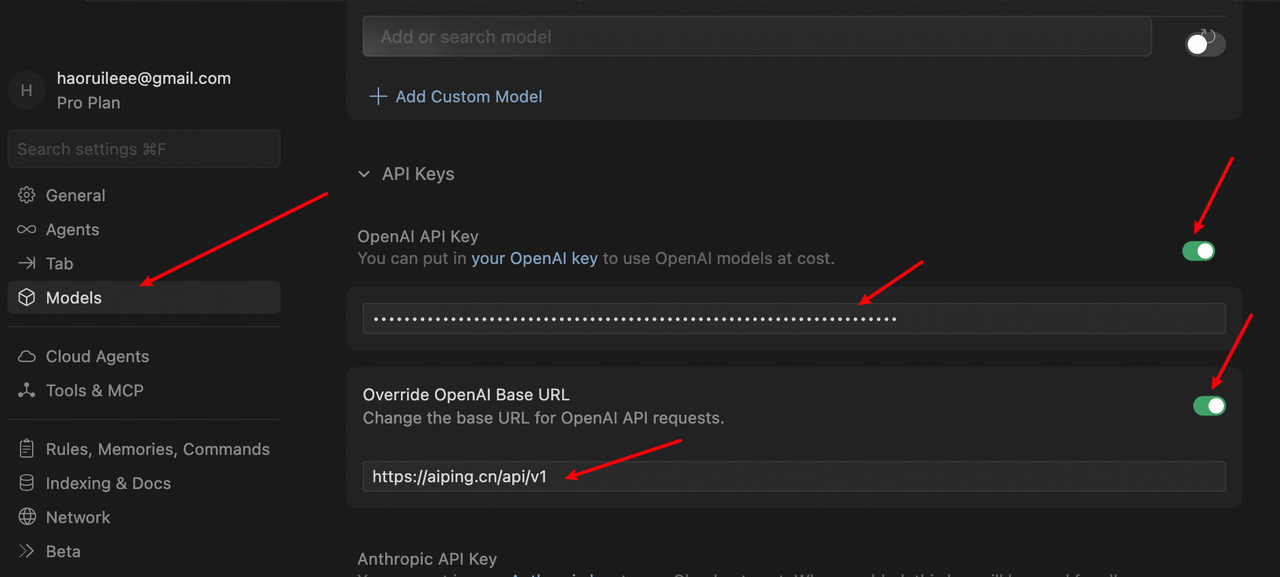

2. 配置AI Ping API:左侧栏点“Models”进入模型配置页,展开“API Keys”部分——勾选“Override OpenAI Base URL”,输入AI Ping调用地址:https://aiping.cn/api/v1,再把AI Ping的API Key填到OpenAI API Key输入框里;

3. 完成验证:点OpenAI API Key栏右侧的按钮,在弹出窗口点“Enable OpenAI API Key”,完成设置验证;

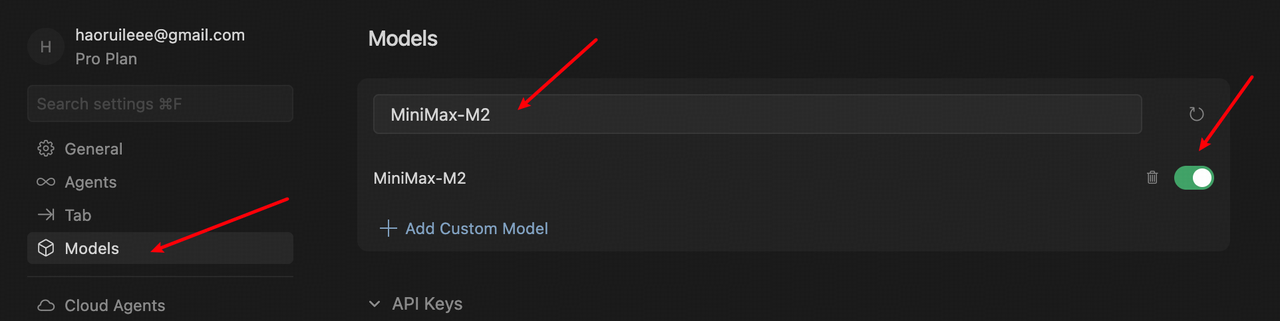

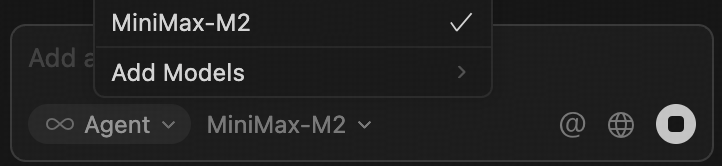

4. 添加自定义模型:在Models板块点“View All Models”,再点“Add Custom Model”,输入模型名称“MiniMax-M2”,点击“Add”;

5. 启用使用:选中刚添加的“MiniMax-M2”模型,在聊天面板切换到该模型,就能正常使用啦!

七、总结

现在就开启你的AI落地之旅:

-

登录AI Ping官网(aiping.cn),注册就能获取API Key;

-

直接用免费算力测试两款模型,根据自己的业务场景选适配方案;

-

快速落地AI应用,体验国产大模型的实力!

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)