2025 年 AI 行业年度总结

自2023年起,我坚持每年撰写一篇个人视角的AI领域年度观察总结。2025年的技术变化更加剧烈,本次总结涵盖Agent架构演进、企业AI转型及AI产品趋势等多个维度。从DeepSeek-R1的开源冲击到Claude 3.7 Sonnet引爆编程赛道,从上下文工程取代提示词工程到Claude Code与Manus的路径分化,从AI视频产品的蓬勃发展到传统SaaS市场被重塑,这一年见证了AI技术从理论到应用的全面爆发。本文首发自个人博客我的 2025 年 AI 行业观察:Agent 架构演进、企业 AI 转型现状与 AI 产品趋势

ChatGPT 发布一周年记: 大模型时代,个人如何实现自我成长

ChatGPT 发布两周年记: 大模型基础设施与中间件工具生态演进

目录

2025 年我心中的「ChatGPT 时刻」

2025 年我认为值得特别记录的一些模型发布,它们深刻改变了行业格局。

2025 年 1 月 20 日 DeepSeek-R1 发布:DeepSeek 发布了在数学、代码编写和逻辑推理方面表现卓越的 DeepSeek-R1 模型。其性能直追 OpenAI o1,并能够展示详尽的思维链。该模型通过 MIT 协议开源了相关权重和代码,不仅产生了深远的技术影响,更直接重塑了全球开源与商业大模型,乃至中美大模型的技术竞争格局。

2025 年 2 月 24 日 Anthropic 推出 Claude 3.7 Sonnet:Anthropic 推出了自家首款混合推理模型 Claude 3.7 Sonnet,显著提升了模型的编程(特别是前端能力)和推理能力,带动 AI 应用层产品 Cursor、Manus 以及 Claude Code 的相继走红,各大模型厂商的迭代重点集体转向编程领域,在「Vibe Coding」理念持续火热的背景下,编程能力提升成为为大模型竞争重点。

2025 年 4 月 16 日 OpenAI 正式发布 o3 系列模型:OpenAI 发布了 o3 系列模型,支持在思维链中原生调用工具,并将图像理解能力融入推理过程,能够结合缩放、旋转等图像处理工具解决复杂的视觉推理问题。此外,o3 引入了「交错思考」(Interleaved Thinking)能力,即在推理过程中交替执行思考与行动(ReAct 模式)。该能力通过 Responses API 首次上线,支持推理摘要以及在函数调用过程中保留推理 Token,并预告将内置网页搜索、文件检索和代码解释器等工具。随后,各大厂商纷纷跟进「交错思考」技术:

- Anthropic 正式将此模式命名为「Interleaved Thinking」,并通过特定的 Beta Header 提供 API 支持。「To enable interleaved thinking, add the beta header interleaved-thinking-2025-05-14 to your API request.」

- MiniMax M2 原生支持交错思考,模型在每轮工具交互间进行反思,根据环境反馈决定下一步行动。「「M2 natively supports Interleaved Thinking, enabling it to reason between each round of tool interactions. Before every Tool Use, the model reflects on the current environment and the tool outputs to decide its next action.」」

- Kimi K2 引入了类似的 Thinking 模式。

- Google 为 Gemini 3 Pro 带来了思维签名(Thought Signatures)功能。

- DeepSeek-V3.2 实现了将思考直接集成到工具调用中,并支持在思考与非思考模式下灵活切换。「DeepSeek-V3.2 is our first model to integrate thinking directly into tool-use, and also supports tool-use in both thinking and non-thinking modes.」

2025 年 11 月 18 日 Google Gemini 3 系列:Gemini 3 Pro 将大模型的综合智力与知识储备推向了新高度,它几乎承载了整个「前互联网时代」的知识库,不仅知识性幻觉极低且推理速度飞快,代表了当前大模型技术的最高综合水平。

多模态领域的其他突破

- Google Veo 3(2025 年 5 月): 实现了音画同步的视频生成,是首个能在生成视频画面的同时,精准匹配环境音效(如鸟鸣、交通声)乃至人物对话的视频生成模型。

- OpenAI GPT Image 1(2025 年 3 月): 具备原生图像生成能力,实现了极高精度的文字渲染与跨模态推理(例如在生成图片中精确嵌入特定的长文本)。

Agent 架构演进

Agent 的架构演进本质上是在模拟现代组织的管理模式,若将项目管理(PMP)视为教导 Agent 「如何正确做事」的方法论,那么工作分解结构(WBS)则对应 Agent 的任务规划能力,ReAct 范式的灵感源于戴明环(PDCA),而 Anthropic 推出的 Claude Skills 则是对组织过程资产(OPA)的高度抽象。

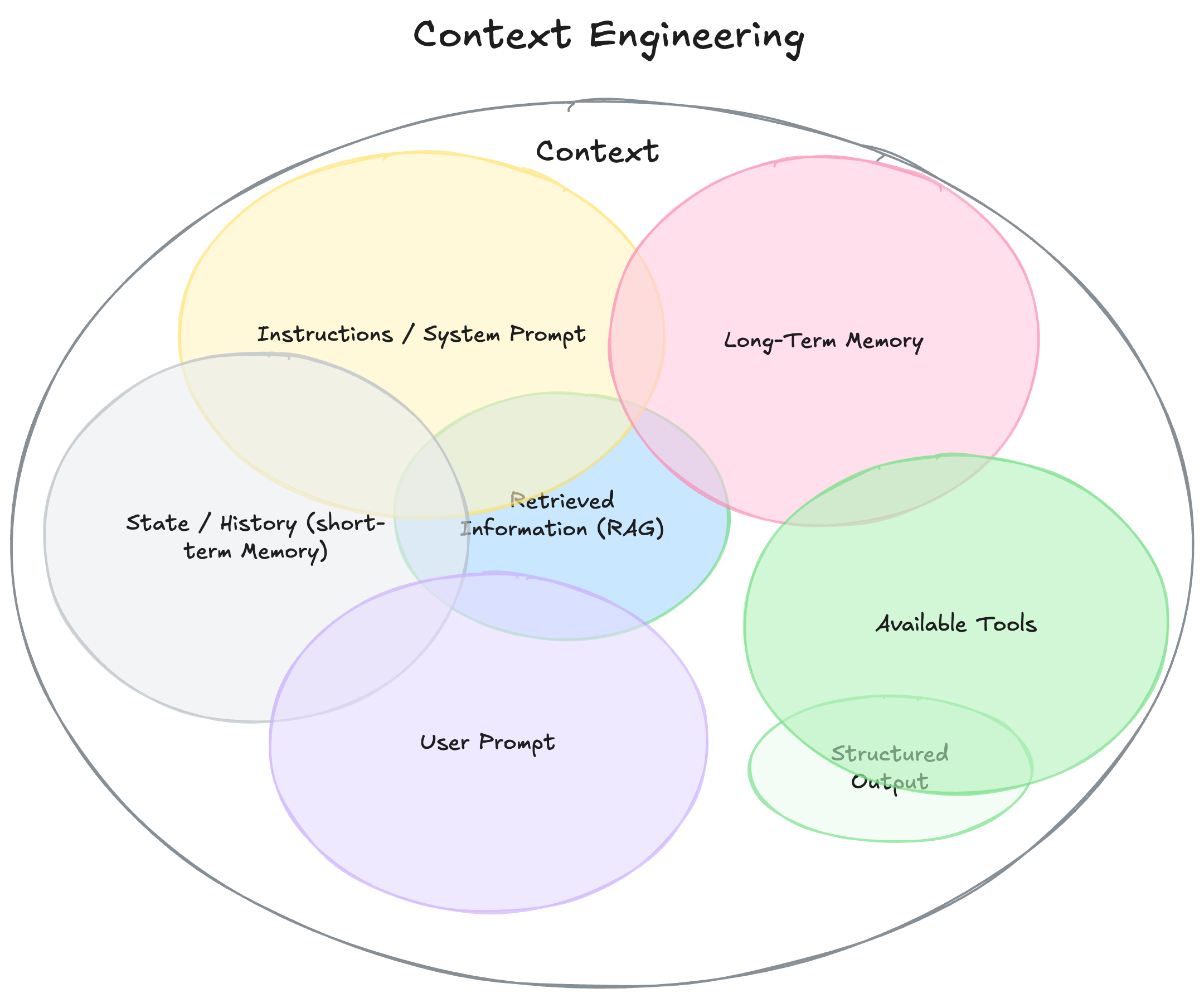

从提示词工程向上下文工程的范式转移

此前,开发者过度关注提示词工程,试图通过复杂的修辞、角色扮演(如「你是一位拥有 10 年经验的前端工程师」)或思维链技巧来优化模型输出,不过随着模型基础能力的显著增强,单纯依赖指令的方法已趋于瓶颈。

当前,上下文工程已走入舞台中央。其核心不再是打磨具体的指令措辞,而是优化模型在特定时刻的信息状态,与其编写冗长的指令指导模型逐步思考,不如为其提供清晰的背景资料、相关文档和精准的数据结构,模型本身的推理能力已足够强大,性能瓶颈往往源于解决问题所需的上下文信息匮乏。

上下文工程是一门设计系统的学科,旨在以正确的格式提供精准的信息与工具,使大语言模型获取完成任务所需的完备要素。这包括上下文卸载(信息外部化)、上下文缩减(历史记录压缩)、上下文检索(动态信息注入)以及上下文隔离(环境解耦)。在 Agent 开发中,系统架构、工具定义及数据检索逻辑本质上都是提示词的组成部分。

设计优秀的工具接口是上下文工程的核心

完善的工具定义(Tool Definition)必须包含清晰的名称与描述、详尽的参数说明(明确每个参数的类型、取值范围及必填项)、应用示例(在描述中直接给出调用示例,例如:「若需查询 X,应按此格式调用工具……」)。

此外,工具设计应具备「防御性编程」思维:若模型输入的参数格式略有偏差(如多余空格),工具应尝试自动修正或返回明确的错误提示,而非直接崩溃。工具返回的结果应采用结构化、易于解析的文本,避免返回模型难以理解的二进制数据。

系统化评估是 Agent 走向生产环境的关键

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)