一文讲清:RAG检索增强生成原理,看完就悟了!

摘要:RAG(检索增强生成)技术通过结合信息检索和自然语言生成,为AI模型提供实时外部数据支持,解决传统模型知识过时和虚构问题。其核心流程包括检索相关信息、增强知识库、生成准确回答三个步骤。相比普通AI依赖训练数据,RAG能获取最新资料并生成可靠回答。该技术广泛应用于聊天机器人等需要实时信息的场景,通过分块处理、语义编码、向量检索等流程,使AI成为"带参考资料答题的考生"。随着

RAG(Retrieval-Augmented Generation)是⼀种结合了信息检索和⾃然语⾔⽣成的技术,旨在提⾼⽣成模型的性能和准确性。

用大白话解释一下,RAG 就是给 AI 生成模型(比如 GPT、文心一言)装了个 “实时查资料的外挂”:

1、先从外部数据库 / 网页里精准搜到相关信息

2、再用这些靠谱信息转换为可读的 “参考资料”

2、最后生成答案

既解决了 AI“记不住新东西、容易瞎编” 的问题,又让输出更准、更有依据

拆成 3 个核心步骤:

1、检索(Retrieval):AI 先当 “搜索引擎”—— 你问它 “2025 年 AI 产品经理岗位需求变化”,它不会直接瞎答,而是先去爬行业报告、招聘网站、权威文章,把和 “岗位需求” 相关的信息都捞出来;

2、增强(Augmented):这些捞出来的信息,就成了 AI 的 “临时知识库”—— 相当于考试前给它划了重点,让它不用靠自己 “过时的记忆” 答题;

3、生成(Generation):AI 再当 “文案整理师”—— 把搜到的重点信息整合、润色,用自然语言讲给你听,最后输出 “2025 年 AI 产品经理更看重 RAG 应用能力、数据分析能力,新增了跨部门协同要求” 这类具体答案。

最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,其中算法、工程应用类人才需求最为紧迫!

学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。【点击蓝字获取】

【2025最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!

对比普通 AI(没装 RAG)的区别:

普通 AI:靠训练时的 “老记忆” 答题,可能告诉你 “2023 年的需求”,甚至编不存在的要求;

RAG 增强 AI:靠 “实时检索 + 参考资料” 答题,答案又新又准,还能溯源(比如告诉你答案来自某平台的某报告)。

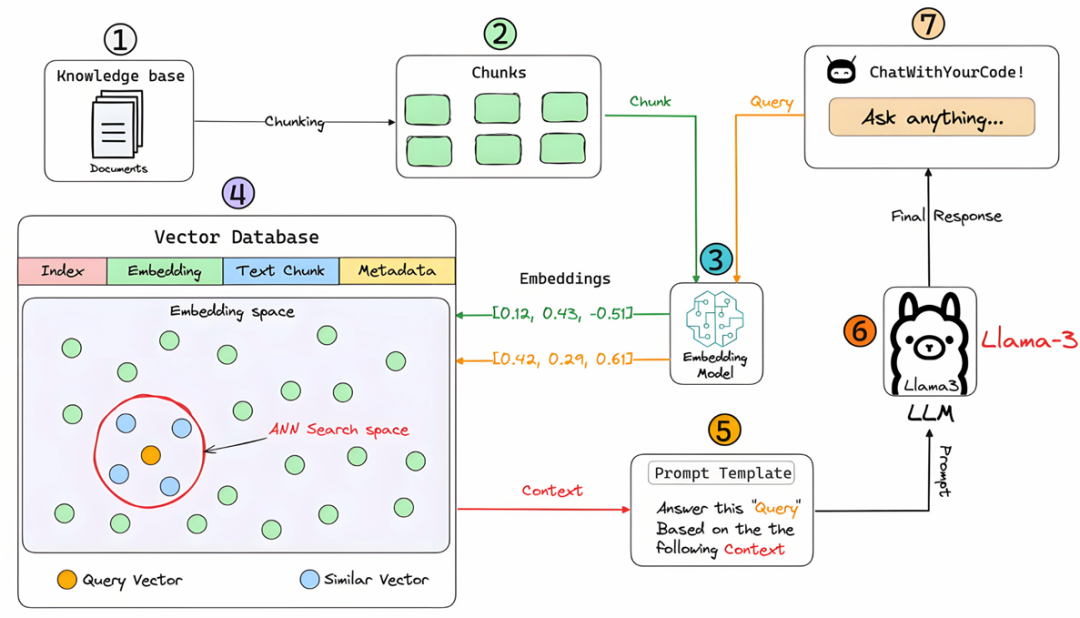

RAG 模型⼴泛应⽤于聊天机器⼈、智能助理、问答系统和其他需要实时信息的⾃然语⾔处理任务。底层原理如图:

这个图就是 RAG 工作的 “完整流水线”,跟着以下步骤就能看懂:

第一、 图左上角的Knowledge base(知识库)是 RAG 的 “素材仓库”—— 比如你做 “Chat With Your Code”,仓库里存的就是所有代码文档(Documents)。

但整份文档太长,大模型读不下、也找不到细节,所以要做Chunking(分块):把长文档切成一小段一小段的Chunks(文本块)(对应图里步骤 2 的绿色方块)

这一步的核心是:把 “大资料” 拆成 “小信息便利贴”,为后续精准找资料打基础。

第二、 步骤 3 的Embedding Model(嵌入模型)是 RAG 的 “语义翻译机”:它会把每一个「Chunks」,以及你后续输入的「Query(用户提问)」,都转换成一串数字 —— 这串数字叫「Embeddings(嵌入向量)」(图里的「[0.12, 0.43, -0.51]」就是例子)。

为啥转数字?

计算机看不懂 “文字的意思”,但能通过 “向量的距离” 判断语义是否相近:

比如 “代码怎么运行” 和 “运行代码的步骤”,转成向量后距离很近;

而 “代码怎么运行” 和 “今天吃什么”,向量距离会很远。

第三、 步骤 4 的Vector Database(向量数据库),是 RAG 的 “语义保险柜”:它存的不是文字,是Embeddings(嵌入向量)+ 对应的Text Chunk(文本块原文)+Metadata(元数据,比如这个 Chunk 来自哪份文档),还会建Index(索引)方便快速搜。

图里的Embedding space(嵌入空间)是这些向量的 “数字地图”:每个点代表一个 Chunk 的向量。

当你的Query转成Query Vector(查询向量,图里橙色点)后,会在ANN Search space(近似最近邻搜索空间)里圈出红圈 —— 找到和它距离最近的Similar Vector(相似向量,蓝色点),对应的 Chunk 就是 “和问题最相关的资料”。

**第四、**找到相关资料后,步骤 5 的Prompt Template(提示词模板)就登场了:模板里写着Answer this ‘Query’ Based on the the Following Context—— 翻译过来就是 “必须照着下面的参考资料(Context)回答我的问题”。

这里的Context,就是步骤 4 里找到的相似 Chunk。把 “你的 Query + 对应的 Context” 拼在一起,就成了给大模型的 “带资料的问题”。

第五、 最后一步步骤 6 的LLM(大语言模型,图里是 Llama-3),是 RAG 的 “最终答题者”:它拿到 “带资料的问题” 后,不会瞎编

因为提示词要求它基于 Context 回答,所以它会把 Context 里的信息整理成自然语言,生成准确的Final Response(最终回复)。

回复会传回步骤 7 的「ChatWithYourCode!」交互界面,你就能在「Ask anything…」框下看到精准回答了。

最后,用一句话总结 RAG 流程图逻辑:

通过“分块→语义编码→向量检索→带资料提问”流程,让大模型从 “靠记忆瞎编的选手”,变成 “拿着参考资料答题的靠谱考生”

——这就是 RAG 能让 AI 输出更准的核心。

最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,其中算法、工程应用类人才需求最为紧迫!

学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。【点击蓝字获取】

【2025最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!

更多推荐

已为社区贡献122条内容

已为社区贡献122条内容

所有评论(0)