Matlab 实现 Attention - GRU 多变量时间序列预测:打开时间序列预测新大门

Matlab实现Attention-GRU多变量时间序列预测1.Matlab实现Attention-GRU多变量时间序列预测(注意力机制融合门控循环单元,也可称呼TPA-GRU,时间注意力机制结合门控循环单元)2.运行环境为Matlab2020b:3.data为数据集,MainAttGRUNM.m为主程序,运行即可;其余m文件为子函数,无需运行,所有文件放在一个文件夹,赠送俩个Attention-

Matlab实现Attention-GRU多变量时间序列预测 1.Matlab实现Attention-GRU多变量时间序列预测(注意力机制融合门控循环单元,也可称呼TPA-GRU,时间注意力机制结合门控循环单元) 2.运行环境为Matlab2020b: 3.data为数据集,MainAttGRUNM.m为主程序,运行即可;其余m文件为子函数,无需运行,所有文件放在一个文件夹,赠送俩个Attention-GRU学习的文献: 4.运行需要GPU支持运算

在时间序列预测领域,Attention - GRU(也可亲切地称呼为 TPA - GRU,即时间注意力机制结合门控循环单元)正逐渐崭露头角。今天咱就聊聊如何用 Matlab 实现这一强大的预测模型。

一、运行环境

本次实现基于 Matlab2020b 版本。为啥强调版本呢?不同版本在函数支持、性能优化等方面可能存在差异,所以保持一致能少走不少弯路。

二、代码结构及运行方式

咱整个项目的代码结构清晰明了。data 就是数据集,这个好理解,所有预测的基础数据都在这。而 MainAttGRUNM.m 是主程序,堪称整个项目的“指挥官”,只要运行它,整个预测流程就启动啦。其余的 m 文件都是子函数,它们默默地配合主程序完成各项具体任务,不过这些子函数无需单独运行。为了方便管理和运行,记得把所有文件都放在同一个文件夹里哦。

这里咱简单看看 MainAttGRUNM.m 主程序里可能涉及的关键代码部分(以下代码为示意,非完整可运行代码):

% 加载数据集

load('data.mat');

% 数据预处理部分,例如归一化

scaledData = normalize(data);

% 创建 Attention - GRU 模型结构

numFeatures = size(scaledData, 2);

numHiddenUnits = 100;

layers = [...

sequenceInputLayer(numFeatures)

gruLayer(numHiddenUnits)

attentionLayer

fullyConnectedLayer(1)

regressionLayer];

% 设置训练选项

options = trainingOptions('adam',...

'MaxEpochs', 100,...

'MiniBatchSize', 32,...

'Plots', 'training-progress');

% 划分训练集和测试集

numTimeSteps = size(scaledData, 1);

trainData = scaledData(1:round(0.8 * numTimeSteps), :);

testData = scaledData(round(0.8 * numTimeSteps)+1:end, :);

% 训练模型

net = trainNetwork(trainData, targetTrain, layers, options);

% 进行预测

predictions = predict(net, testData); 代码分析

- 数据加载与预处理:

load('data.mat');这行代码就是把咱准备好的数据集加载到 Matlab 工作区。而normalize函数是对数据进行归一化处理,让数据处于一个合适的范围,有助于模型更快更好地收敛。 - 模型构建:

sequenceInputLayer(numFeatures)这是定义输入层,告诉模型输入数据有多少个特征。gruLayer(numHiddenUnits)创建了 GRU 层,这里设置了隐藏单元的数量为 100,这个数量会影响模型的学习能力。attentionLayer就是添加注意力机制啦,它能让模型更聚焦于重要的时间步信息。fullyConnectedLayer(1)是全连接层,最终regressionLayer定义了回归层,因为我们做的是时间序列预测,属于回归问题。 - 训练选项设置:

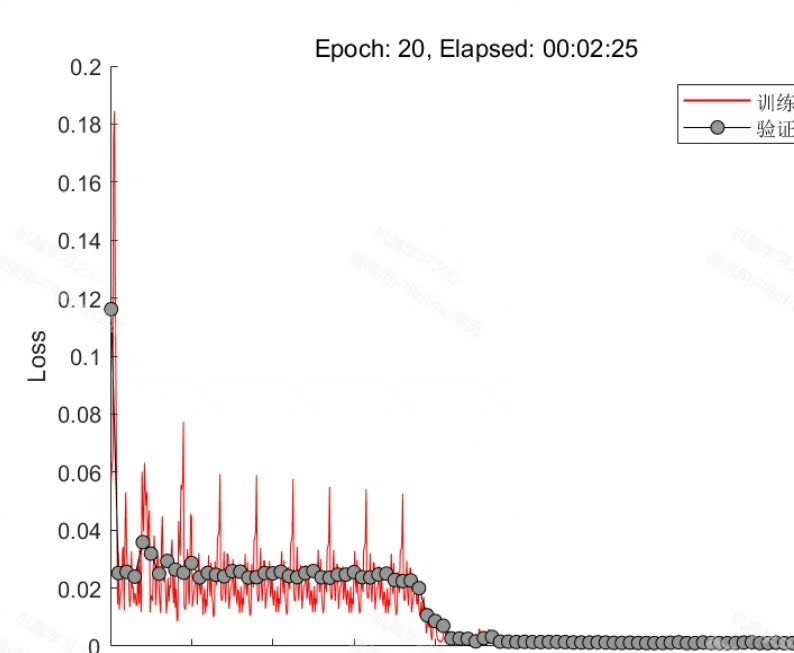

trainingOptions('adam',...)这里使用了 Adam 优化器,它在很多深度学习任务中表现出色。MaxEpochs设置了最大训练轮数为 100,MiniBatchSize定义了每个小批量数据的大小为 32,这些参数都需要根据实际情况调整。Plots选项能让我们在训练过程中看到训练进度图,方便观察模型训练情况。 - 数据划分与训练预测:把数据集划分成训练集和测试集,用训练集来训练模型

trainNetwork(trainData, targetTrain, layers, options);,然后用测试集进行预测predictions = predict(net, testData);。

三、硬件支持

这里得重点提一下,运行这个模型是需要 GPU 支持运算的。为啥呢?因为深度学习模型的计算量巨大,GPU 强大的并行计算能力能大幅提升训练和预测速度。要是没有 GPU,训练过程可能会变得极其漫长,让人等得心急如焚。

最后,再给大家赠送两份 Attention - GRU 学习的文献,希望大家能更深入地了解这个模型背后的原理和更多应用场景,在时间序列预测的探索之路上越走越远。

这样,通过 Matlab 实现 Attention - GRU 多变量时间序列预测的主要内容就介绍完啦,大家赶紧动手实践起来吧!

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)