【视频异常检测】PANDA: Towards Generalist Video Anomaly Detection via Agentic AI Engineer

PANDA是一种基于多模态大语言模型的通用视频异常检测系统,通过四大核心能力实现无需训练数据或人工干预的开放场景异常检测:(1)自适应场景感知策略规划,利用检索增强生成机制动态制定检测策略;(2)目标驱动的启发式推理,结合视觉增强工具进行结构化分析;(3)工具增强型自我反思,在不确定时调用专用工具收集额外证据;(4)自我改进的记忆链机制,通过历史经验持续优化性能。实验表明,PANDA在开放场景下展

原文链接:https://arxiv.org/abs/2509.26386

源码:https://github.com/showlab/PANDA

Abstract

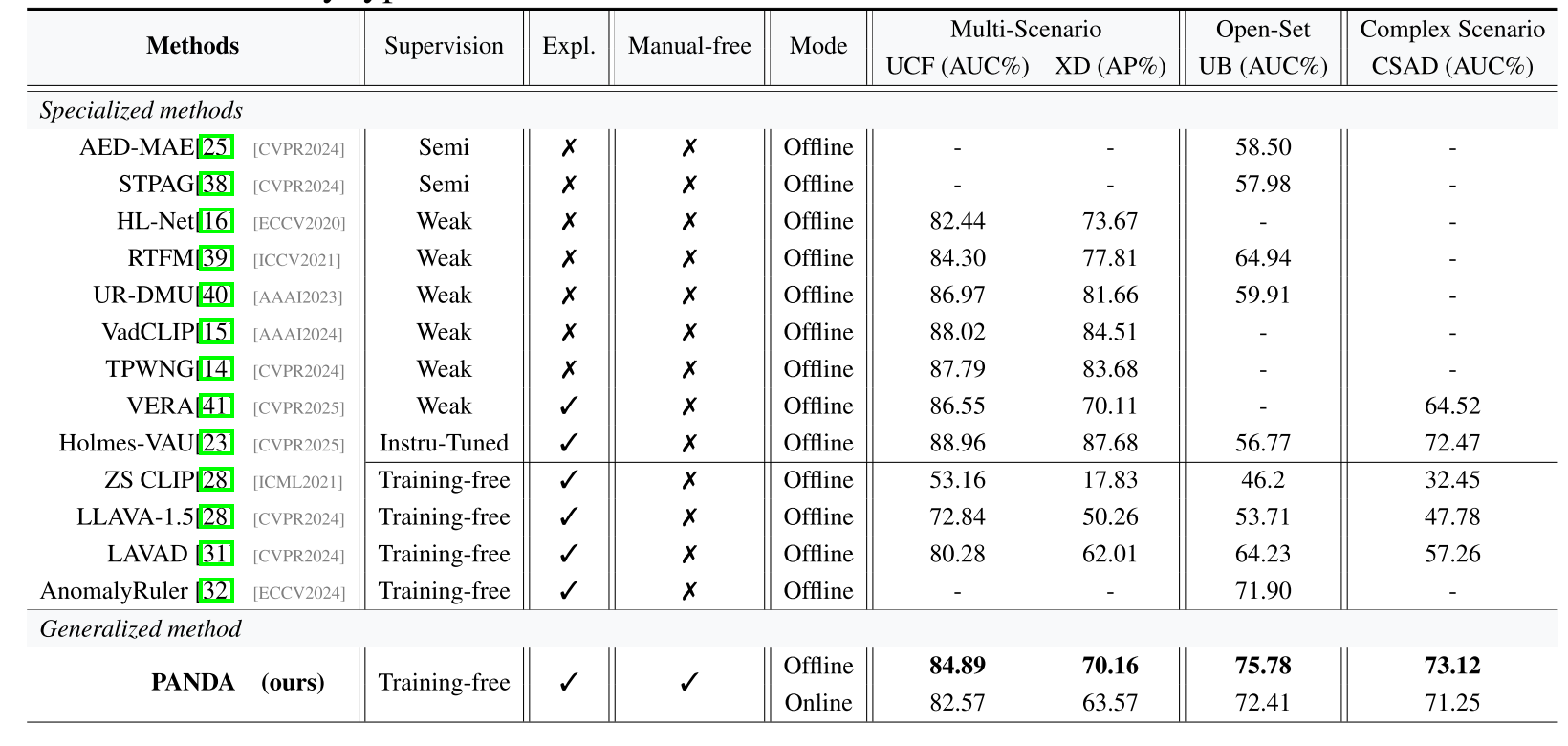

视频异常检测(VAD)是一项关键且具有挑战性的任务,这源于现实场景的复杂性与多样性。以往的方法在应用于新场景和未见过的异常类型时,通常依赖特定领域的训练数据和人工调整,存在人力成本高、泛化能力有限等问题。因此,我们旨在实现通用型视频异常检测(generalist VAD),即无需训练数据或人工干预,自动处理任意场景和任意类型的异常。本研究中,我们提出了PANDA——一种基于多模态大型语言模型(MLLMs)的智能体AI工程师。具体而言,我们通过全面设计四大核心能力构建了PANDA:(1)自适应场景感知策略规划、(2)目标驱动的启发式推理、(3)工具增强型自我反思、(4)自我改进的记忆链机制。具体来说,我们开发了自适应场景感知的检索增强生成(RAG)机制,使PANDA能够检索异常相关知识以制定异常检测策略;其次,引入潜在异常引导的启发式提示策略,提升推理精度;此外,PANDA采用渐进式反思机制,并结合一系列上下文感知工具,在复杂场景中迭代优化决策;最后,记忆链机制使PANDA能够利用历史经验持续提升性能。大量实验表明,在无训练和无人工干预的情况下,PANDA在多场景、开放集和复杂场景设置中均取得了最先进的性能,验证了其强大的泛化能力和稳健的异常检测能力。相关代码已开源至https://github.com/showlab/PANDA。

1 Introduction

本节将介绍PANDA的核心架构与推理流程,这是一款面向通用视频异常检测的智能体AI工程师。PANDA旨在动态感知多样化环境,执行渐进式、工具增强的推理与自我优化(如图2所示)。其核心功能通过四大协同模块实现:(1)自适应场景感知策略规划、(2)目标驱动的启发式推理、(3)工具增强型自我反思、(4)自我改进的记忆链机制。

3.1 Self-adaptive Scene-aware Strategy Planning

要在通用且无约束的环境中实现视频异常检测,关键在于动态感知当前视频上下文并构建针对性检测策略。考虑到现实世界中许多异常具有场景依赖性,且视觉条件存在差异,PANDA首先对输入视频进行自适应感知,以提取高层级的环境上下文信息。

Environmental Perception.

给定用户定义的检测查询 U s e r q u e r y User_{query} Userquery和包含N帧的输入视频序列 V = { f 1 , f 2 , . . . , f N } V=\{f_1, f_2, ..., f_N\} V={f1,f2,...,fN},PANDA会均匀采样M个关键帧 F = { f 1 , f 2 , . . . , f M } F=\{f_1, f_2, ..., f_M\} F={f1,f2,...,fM},并结合用户查询构建感知提示词 P r o m p t p e r c e p t i o n Prompt_{perception} Promptperception。该提示词被输入至视觉语言模型(VLM),模型返回结构化的环境信息:

其中,场景概述(Scene Overview)提供场景的高层级总结,包括地点类型(如街道、商店、停车场)和观察到的活动;潜在异常(Potential Anomalies)指当前场景下可能发生的可疑行为类型;天气条件(Weather Condition)涵盖时段(白天/夜晚)和天气状况(如晴天、雨天)等属性;视频质量(Video Quality)总结分辨率和清晰度(如低分辨率、模糊、含噪)。

RAG-Based Strategy Planning.

获取结构化环境上下文后,PANDA开始规划检测策略。为避免模型幻觉并提升可靠性,该规划过程通过检索增强生成(RAG)机制实现,由多模态大型语言模型(MLLM)驱动。首先,基于用户查询 U s e r q u e r y User_{query} Userquery,PANDA构建知识库提示词 P r o m p t k n o w Prompt_{know} Promptknow,并利用MLLM生成结构化的通用异常知识库:

其中,事件类型(Event Type)指用户指定的异常类别;异常规则(Anomaly Rules)是与每种异常类型对应的检测规则;应用场景(Application Scenes)是异常可能发生的上下文环境。

针对每种异常类型,我们预定义H个“规则-场景”对以构建知识库。PANDA将感知到的环境信息 E n v I n f o EnvInfo EnvInfo作为查询,检索相关性最高的k条异常规则:

最后,PANDA整合用户查询 U s e r q u e r y User_{query} Userquery、环境信息 E n v I n f o EnvInfo EnvInfo和检索到的规则 R u l e s a Rules_a Rulesa,构建规划提示词 P r o m p t p l a n Prompt_{plan} Promptplan并输入MLLM,生成检测策略方案:

其中,预处理(Preprocessing)指定可选的视觉增强步骤(如亮度调整、去噪、超分辨率);潜在异常(Potential Anomalies)基于规则相关性和场景理解优化异常列表;启发式提示词(Heuristic Prompt)包含针对每种潜在异常的分步推理指令,支持下游推理模块进行结构化的思维链分析。

通过整合自适应环境感知与RAG增强的策略规划,PANDA确保后续异常推理具备目标导向性和上下文感知能力,显著提升开放世界场景下的鲁棒性。

3.2 Goal-Driven Heuristic Reasoning

推理模块是PANDA分析视频异常事件的核心组件,支持离线和在线两种推理模式。本节重点介绍离线模式,在线模式的实现细节将在后续说明。

在3.1节构建的检测策略方案指导下,PANDA利用VLM执行目标驱动的启发式推理。给定用户查询 U s e r q u e r y User_{query} Userquery、片段级视频序列 V c l i p = { c 1 , c 2 , . . . , c T } V_{clip}=\{c_1, c_2, ..., c_T\} Vclip={c1,c2,...,cT}(每个视频片段 c t c_t ct包含s帧)和策略方案 P l a n s t r a t e g y Plan_{strategy} Planstrategy,PANDA首先应用方案中指定的预处理工具,得到增强后的视频片段:

其中,潜在异常、异常规则和启发式提示词直接继承自规划阶段;增强与反思信息(Enhancement and Reflection Info)包含自我反思阶段产生的内容(将在3.3节详细说明),包括工具优化结果、更新后的异常规则和启发式提示词。为增强时间感知能力,PANDA配备短期记忆组件 M e m o r y t e x t l − s t e p s Memory_{text}^{l-steps} Memorytextl−steps,记录过去l步推理过程作为文本记忆;同时维护对应的视觉记忆流 M e m o r y v i s u a l l − s t e p s Memory_{visual}^{l-steps} Memoryvisuall−steps,存储与最近l步推理对齐的视觉帧,支持模型在推理过程中获取细粒度视觉线索。

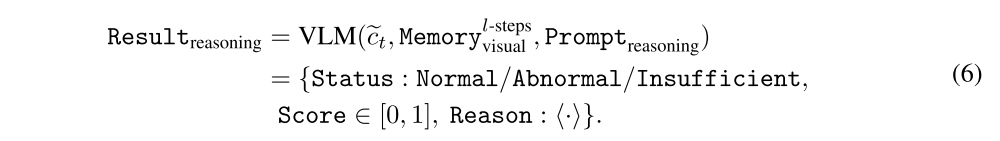

最终,在潜在异常目标和丰富上下文知识的驱动下,PANDA执行启发式推理:

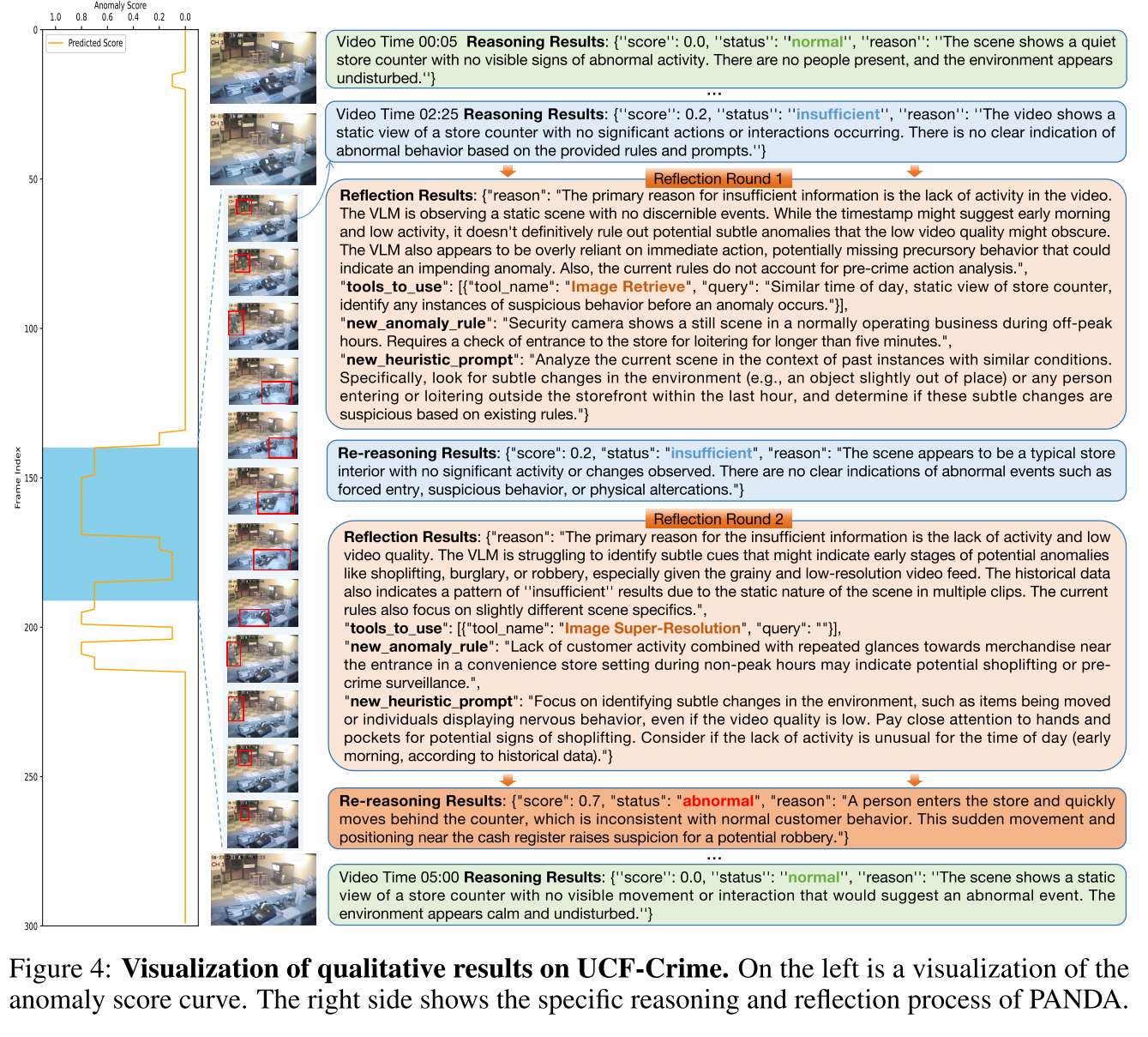

其中,状态(Status)表示VLM的判断结果:正常(Normal)表示片段被明确分类为非异常,异常(Abnormal)表示存在强异常证据,信息不足(Insufficient)表示当前信息不足以做出明确判断;分数(Score)对应每种状态下片段存在异常事件的概率;原因(Reason)是VLM给出的状态判断依据。若结果为“信息不足”,PANDA将触发反思机制以收集更多上下文或观察结果,之后重新进入推理循环。

3.3 Tool-Augmented Self-Reflection

在复杂场景中,PANDA可能无法明确判断视频片段是否存在异常。此时模型返回“信息不足”状态,触发反思模块。PANDA采用工具增强型自我反思机制,配备一系列用于视觉内容增强和辅助分析的专用工具 τ = { t o o l 1 , t o o l 2 , . . . , t o o l n } \tau=\{tool_1, tool_2, ..., tool_n\} τ={tool1,tool2,...,tooln},包括图像去模糊、去噪、亮度增强、图像检索、目标检测和网络搜索等,助力收集额外证据以支持决策过程。

Experience-Driven Reflection.

针对当前推理步骤返回的“信息不足”原因(Insufficient Reason),PANDA首先查询其长期记忆链(Long CoM,将在3.4节介绍),检索最相似的历史反思案例:

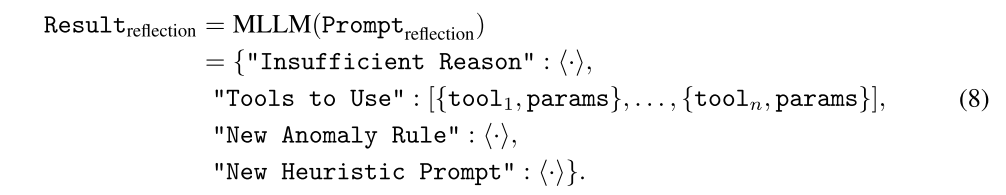

随后,PANDA结合视频上下文信息(包括用户查询、环境信息、策略方案、异常规则、短期记忆链、信息不足原因和历史反思经验)构建反思提示词 P r o m p t r e f l e c t i o n Prompt_{reflection} Promptreflection,并输入MLLM分析不确定性原因并推荐合适的反思方案:

其中,信息不足原因(Insufficient Reason)是MLLM结合VLM输出、环境线索和异常规则等上下文推断出的决策不确定性根源;待使用工具(Tools to Use)指定用于信息增强的工具名称及其对应参数;新异常规则(New Anomaly Rule)和新启发式提示词(New Heuristic Prompt)分别表示更新后的异常规则和重新设计的启发式提示词。

Tool Invocation.

PANDA执行反思结果中建议的工具功能,以增强视觉和语义信息。工具调用过程可表示为:

其中,文本增强信息(Text Enhancement Info)包括工具输出的总结(如检测到的目标、网络搜索结果);视觉增强信息(Visual Enhancement Info)包括处理后的视频片段 c ^ t \hat{c}_t c^t和检索到的历史关键帧集 c s = { f 1 , f 2 , . . . , f s } c_s=\{f_1, f_2, ..., f_s\} cs={f1,f2,...,fs}。

Refined Reasoning.

PANDA利用新获取的文本线索更新推理提示词:

并对增强后的视频片段输入重新执行推理:

若返回状态为“正常”或“异常”,PANDA在下一步骤继续推理;若仍为“信息不足”,则重新触发反思。为避免无限循环,反思轮次被限制为r。若经过r轮反思后结果仍为“信息不足”,PANDA将为该状态分配默认异常分数,跳过当前片段并继续处理下一个步骤。

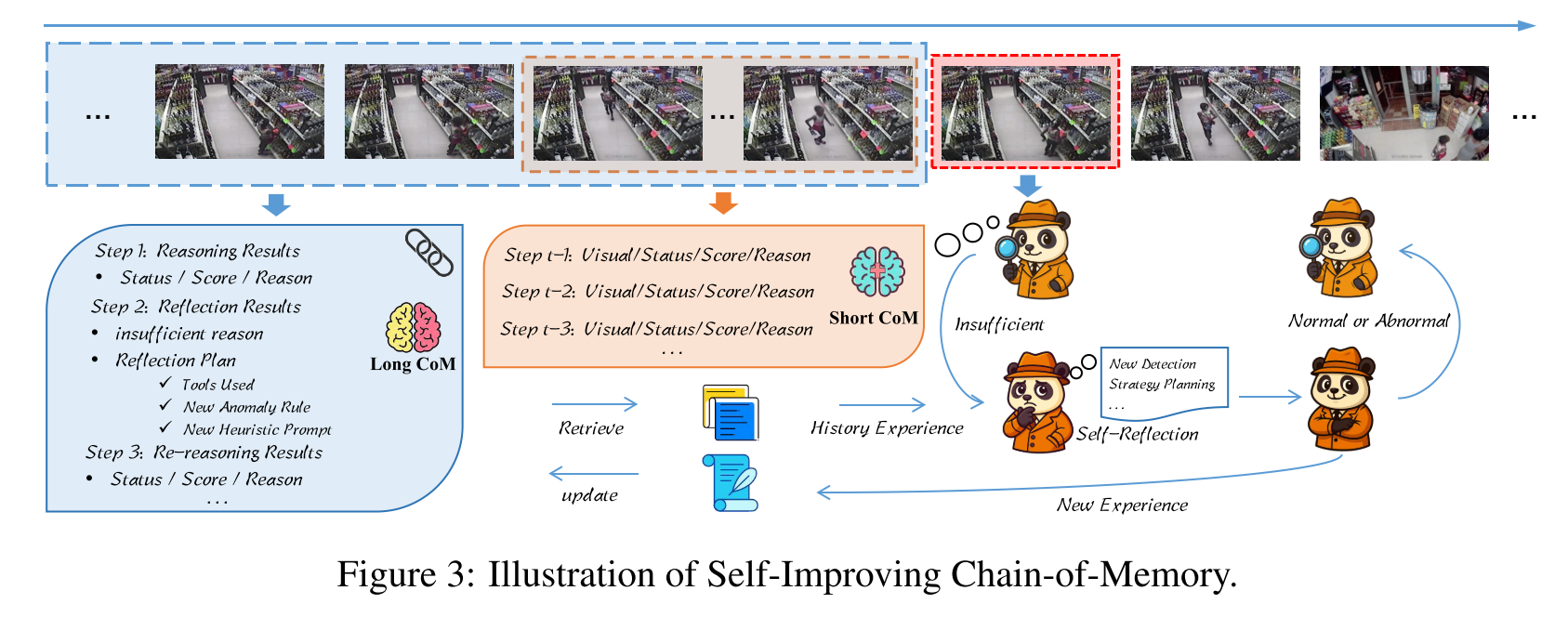

3.4 Self-Improving Chain-of-Memory

为使PANDA通过推理、反思和优化推理的迭代循环积累经验,逐步提升性能,本文设计了自我改进的记忆链(CoM)机制(如图3所示)。该机制增强了长期上下文感知能力和视频序列决策的一致性,包含短期记忆链(short CoM)和长期记忆链(long CoM)两个组件。

Short CoM.

在推理阶段,短期记忆链包括文本推理轨迹 M e m o r y t e x t l − s t e p s Memory_{text}^{l-steps} Memorytextl−steps和对应的视觉记忆流 M e m o r y v i s u a l l − s t e p s Memory_{visual}^{l-steps} Memoryvisuall−steps(如3.2节所述)。在反思阶段,短期记忆链表现为过去的反思输出集合: R e s u l t r e f l e c t i o n h i s t o r y = { R e s u l t r e f l e c t i o n 1 , R e s u l t r e f l e c t i o n 2 , . . . , R e s u l t r e f l e c t i o n l } Result_{reflection}^{history} = \{Result_{reflection}^1, Result_{reflection}^2, ..., Result_{reflection}^l\} Resultreflectionhistory={Resultreflection1,Resultreflection2,...,Resultreflectionl}。

Long CoM.

PANDA还维护一个随时间演化的长期记忆链: L o n g − C o M = { M 1 , M 2 , . . . , M T } Long-CoM = \{M_1, M_2, ..., M_T\} Long−CoM={M1,M2,...,MT},其中每个时间步t的记忆单元 M t M_t Mt包含三个关键输出: M t = { R e s u l t r e a s o n i n g , R e s u l t r e f l e c t i o n , R e s u l t r e a s o n i n g r e f i n e d } M_t = \{Result_{reasoning}, Result_{reflection}, Result_{reasoning}^{refined}\} Mt={Resultreasoning,Resultreflection,Resultreasoningrefined}。该结构确保PANDA保留所有决策阶段的完整轨迹——初始推理、反思分析和反思后决策。

视频处理初期,长期记忆链为空,PANDA依赖短期记忆链的局部窗口记忆进行初始推理和反思。随着更多片段被处理,长期记忆链逐渐积累轨迹,支持记忆一致性推理和反思规划。通过这种自我改进的记忆链机制,PANDA能够利用积累的历史经验指导推理和反思过程,使异常检测的稳定性和准确性随时间逐步提升。

4 Experiments

5 Conclusion

在这项工作中,我们介绍了Panda,这是一个面向通用VAD的代理人工智能工程师,当面对各种真实世界场景时,它不需要训练数据或手动制作管道。熊猫集成了四个核心能力:自适应场景感知战略规划、目标驱动的启发式推理、工具增强的自我反思和自我完善的记忆链。这些功能协同工作,使熊猫能够自适应地检测各种、动态和以前未曾见过的环境中的异常。我们在多个基准上的广泛实验,包括多场景、开放场景和复杂场景,验证了Panda强大的泛化能力和稳健的性能,无需任何训练。这些发现突显了熊猫作为现实世界场景中通用VAD解决方案的潜力。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)