文生中英双语 AI 视频工具推荐:作为自媒体人,我为什么首推这个

这几年AI视频工具飞速发展,从中文字幕,到中文自动生成英文字幕都已经不新鲜了,但是文生中英双语 AI 视频工具,你用过吗?

这几年AI视频工具飞速发展,从中文字幕,到中文自动生成英文字幕都已经不新鲜了,但是文生中英双语 AI 视频工具,你用过吗?

作为一名长期做内容输出的自媒体人,最近一直在尝试文生视频、中英双语表达的产品。

真实情况是: 👉 能生成画面的工具很多,但真正适合“长期做内容”的并不多。

在讲即梦之前,先说说我用过、也踩过坑的几款工具。

一、我实际用过的几款 AI 视频工具,对比感受很明显

1️⃣ 可灵 AI(Kling)

可灵的视频画面质量确实很强,运动合理、物理感真实,适合做偏写实的展示类视频。

但问题也很明显:

-

更偏“画面生成”

-

声音基本需要后期再处理

-

中英双语讲解视频制作流程偏长

适合追求画面效果,但不太适合高频输出教学或讲解类内容。

2️⃣ Pixverse

Pixverse 的优势在于风格多,动画、3D、数字风格都能玩。

不足之处在于:

-

偏视觉表达

-

音频、对白仍需额外补充

-

更适合创意展示,而不是完整教学视频

3️⃣ 讯飞智作

讯飞智作在配音、模板化内容上很成熟,做讲解视频比较省事。

但实际使用下来:

-

自由度有限

-

更像“视频生成平台”,而不是“创作型工具”

-

对画面创意的支持相对有限

4️⃣ 海螺 AI / HaiperAI

这类工具在图生视频、图片动画上表现不错,适合把静态素材“动起来”。

但整体体验是:

-

仍需要多个工具配合

-

很难一步生成完整可用的视频成片

二、真正的分水岭:即梦 3.5 Pro 做到了什么不一样?

也正是在反复对比后,我开始意识到一个问题:AI 视频的瓶颈,不在画面,而在工作流。

12 月 16 日,即梦 A1 正式上线「视频 3.5 Pro 模型」(Seedance 1.5 Pro),这次更新,恰好击中了这个核心痛点:

即梦 3.5 Pro 不只是“生成视频”,而是—— 👉 直接生成「音画一体」的完整视频,而且是文生中英双语 AI 视频。

三、即梦 3.5 Pro 必须讲清楚的三大更新

1、画面 + 声音一次生成,音画一体

在输入中文或英文提示词后,即梦可以同步生成:

-

视频画面

-

环境音效

-

人声对白(支持中英双语)

-

背景音乐

不需要再找配音、不需要剪 BGM,生成结果就是可以直接用的成片。

从实际效果来看,即梦的生视频能力,已经稳稳进入国内第一梯队。

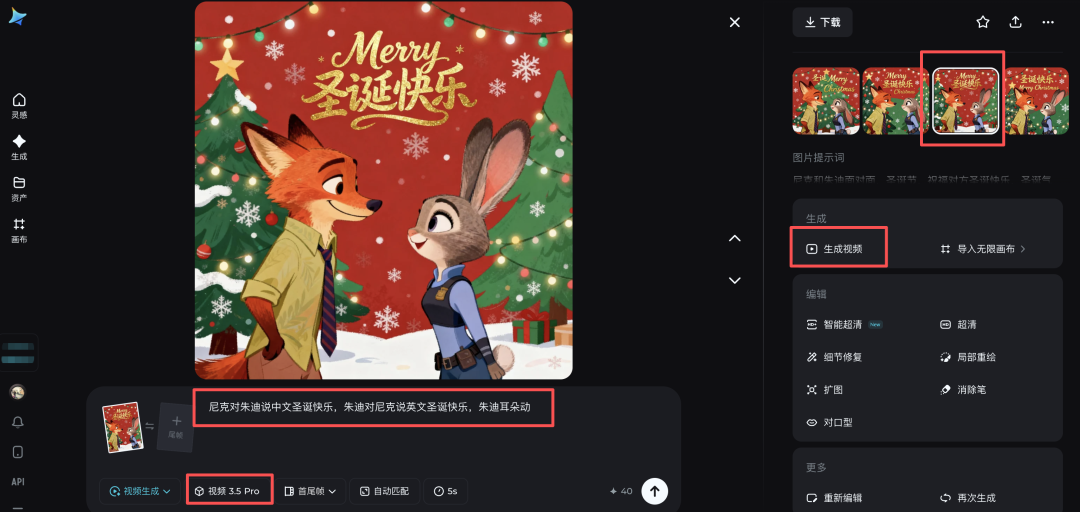

2、“生图 + 生视频”双王牌,一站式完成创作

即梦本身就拥有成熟的 AI 生图模型。 在 3.5 Pro 上线后,已经形成了完整的:

👉 生图 + 生视频“双王牌配置”

你可以:

-

先文生图,再生成视频

-

直接文生完整视频

-

图生视频并自动补齐声音

真正做到覆盖 从创意到成片的全链路 AI 创作需求。

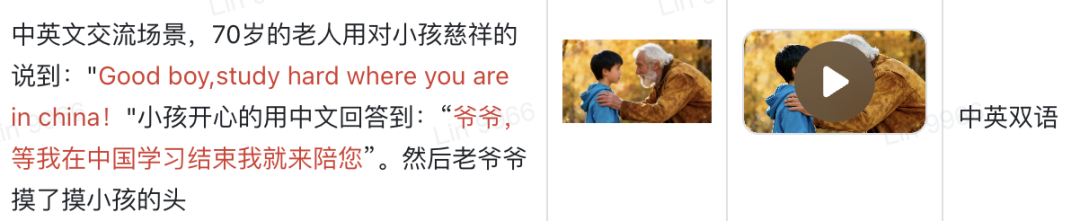

比如我先用即梦生成圣诞氛围感的朱迪和尼克,只是用简单的语意就能让他们两个用中英文互相祝福啦。

3、版权清晰,商用与个人都放心

即梦所有生图与视频模型生成的内容,均有完整、清晰的版权授权。 不论是自媒体发布、教学使用,还是商业内容,都不用额外担心版权风险。

四、模型功能拆解:即梦 3.5 Pro 到底强在哪?

从模型能力来看,3.5 Pro 的优势集中在三点:

1️⃣ 环境音效智能生成模型可以理解画面内容,自动匹配环境音,让视频更有沉浸感。

2️⃣ 中英双语人声对白支持中文、英文等多语言输出,语音自然、节奏稳定,适合教学与讲解场景。

3️⃣ 音乐配乐自动匹配根据视频情绪自动生成 BGM,整体观感更完整。

五、实操案例:用即梦做一个中英双语教学视频

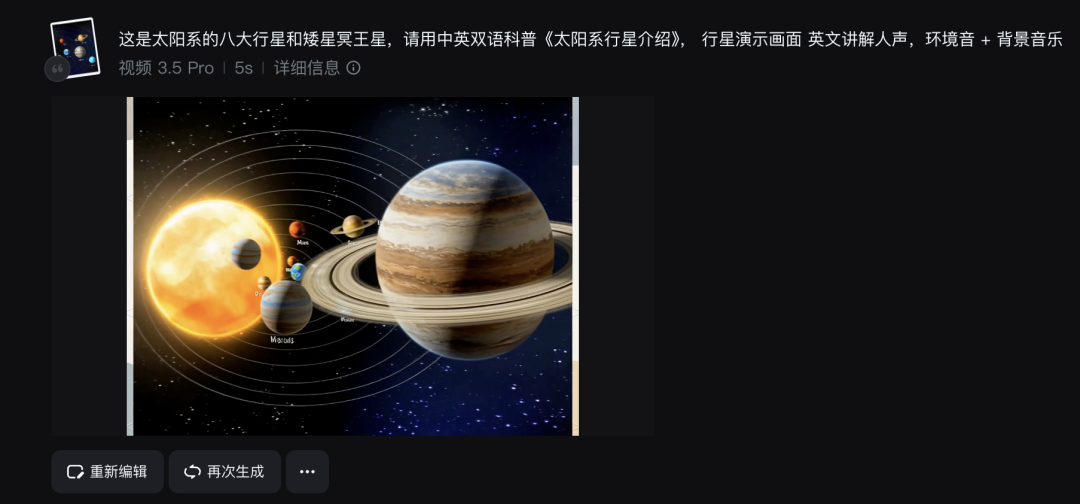

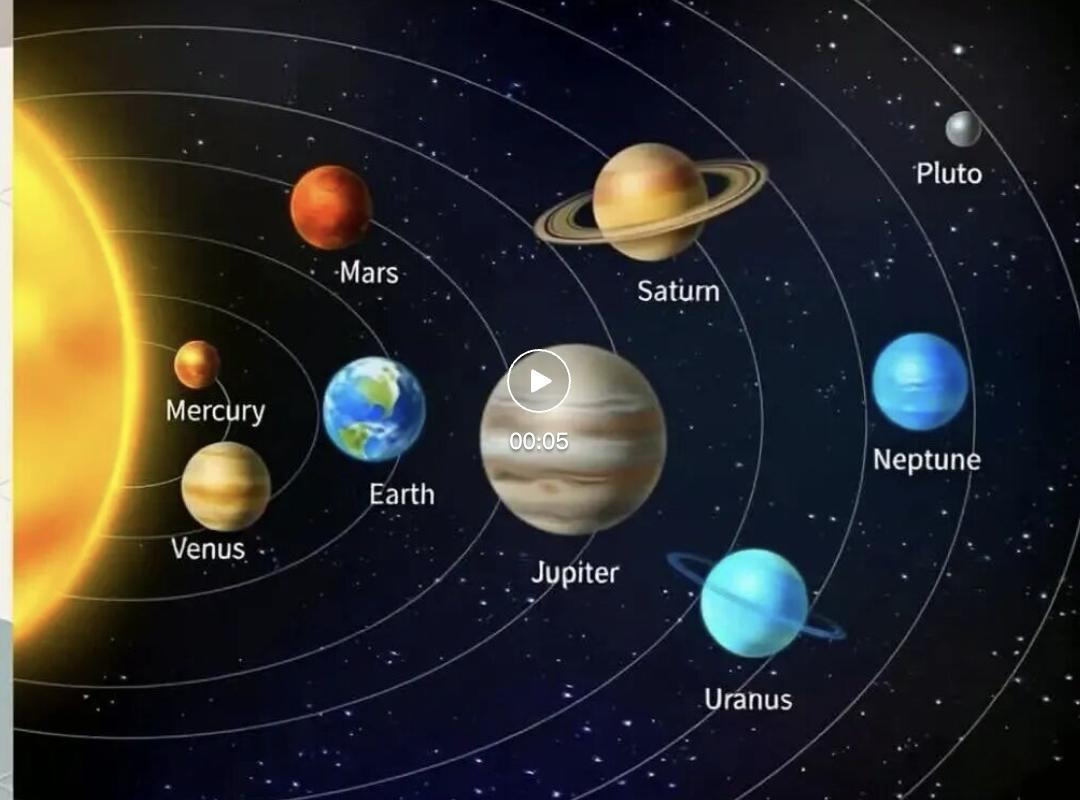

案例:中英双语科普《太阳系行星介绍》

操作流程非常简单:

-

输入中英文混合提示词

-

选择视频节奏与风格

-

即梦直接生成:

-

行星演示画面

-

英文讲解人声

-

环境音 + 背景音乐

-

最终视频几乎无需二次剪辑,就能直接用于教学或内容发布。

六、结语

回到最初的问题:为什么在用过这么多工具后,我更愿意用即梦?

答案其实很简单: 👉 它第一次把 AI 视频,从“工具拼接”,变成了“完整工作流”。

再加上目前 即梦 3.5 Pro 新模式仍处于首发期,每天还有积分送,相当于免费哦,无论你是做教学、自媒体,还是内容创作,都非常值得亲自体验一次。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)