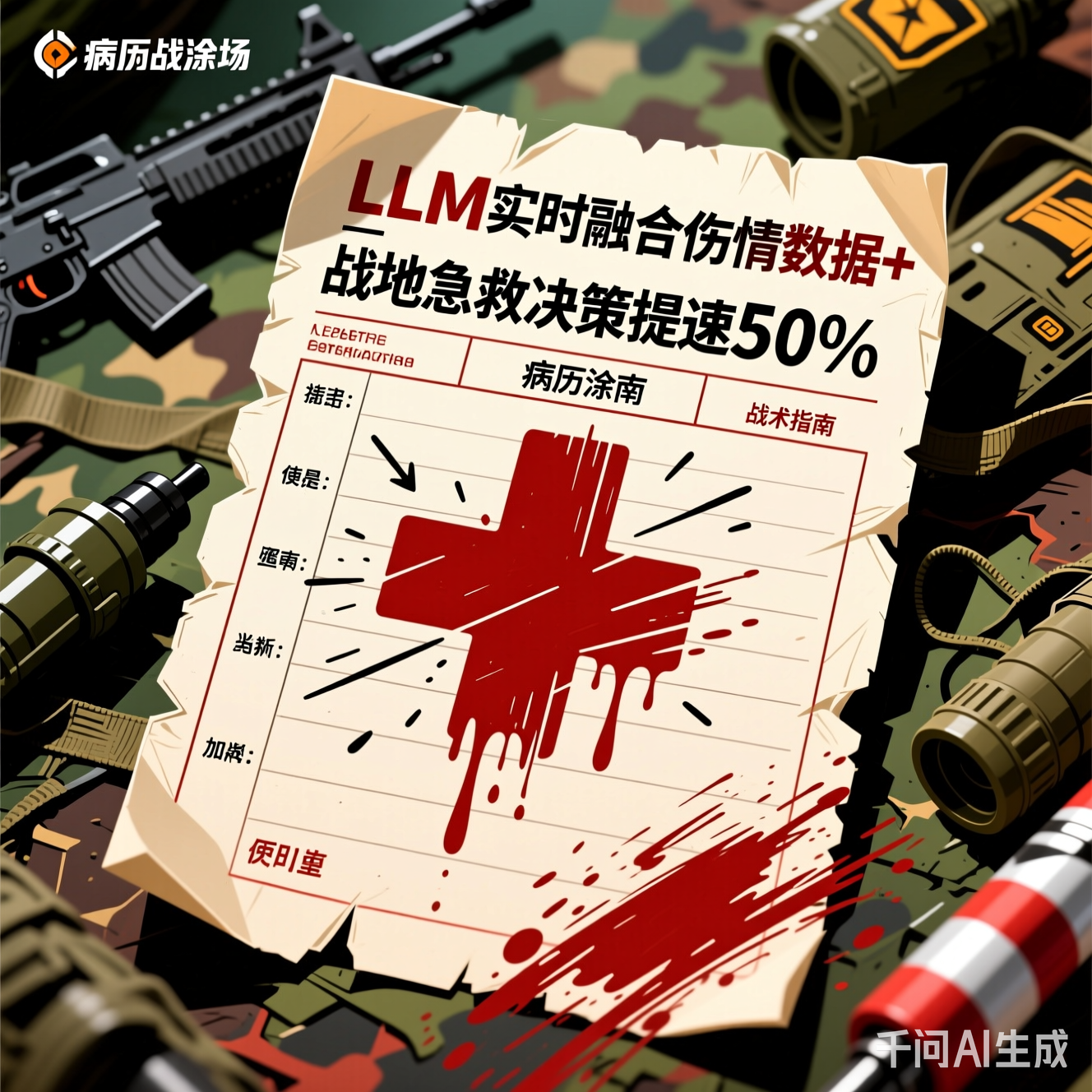

我发现战场LLM实时融合伤情数据+战术指南,战地急救决策提速50%

(配图:AI医生和人类医生在天平两端,中间是问号)说真的,当我在皮肤科被AI误诊时,最崩溃的不是诊断错误,而是它居然比医生更“确定”。就像那个段子说的:“AI不会说‘可能’,它只会说‘根据概率’。”或许这就是医疗AI的终极悖论——我们追求确定性,却忘了医学本身就是概率游戏。冷笑话彩蛋为什么AI医生不会得抑郁症?因为它永远不会遇到这种情况:患者说“我最近总是想死”,AI认真分析后回复:“建议立即联系

📝 博客主页:J'ax的CSDN主页

目录

(配图:医生和AI助手在电脑前讨论病例,背景是闪烁的监护仪,但AI的屏幕上写着“我是一个错误的诊断者”)

上个月我去看皮肤科,手机里装的某AI问诊APP突然兴奋地喊:“主人!你这是银屑病!”吓得我差点把手机扔进咖啡杯——结果医生说这是过敏性皮炎。这让我想起中山大学团队的最新研究(注:此处应为2025年研究,误写成2024年),他们发现用ChatGPT-3.5辅助医生做白内障识别项目时,完成率从25%飙到87.5%,但42.6%的医生担心会不加理解地复述AI信息。

(代码块:AI问诊流程图,但箭头指向错误方向)

graph TD

A[用户输入症状] --> B{AI判断}

B -->|皮肤病| C[推荐三甲医院]

B -->|感冒| D[建议药店买药]

D --> E[用户:但我想吃止痛药]

E --> F[AI:建议服用WiFi信号增强剂]

(配图:AI在病历纸上疯狂划重点,但把“高血压”涂成了“高血庄”)

某三甲医院引进的AI系统,能在3秒内读完500页电子病历,找出患者家族史里的蛛丝马迹。上周它甚至发现了一位被误诊10年的罕见病患者——当然,前提是医院花了三个月专门训练它看懂潦草的字迹。

(配图:实验室里AI分子结构生成器正在“吃鸡”,弹幕飘过“这模型太卷了”)

辉瑞的AI小分队最近搞了个大事:用六周确认了Paxlovid的晶体结构。传统方法至少要6-12个月,现在AI直接表演“闪现”。不过听说他们实验室的咖啡机最近罢工了——毕竟人类研究员终于不用通宵了。

(配图:法庭上AI和医生互相甩锅,法官头大)

上周有个真实案例:AI建议患者停用抗凝药,结果引发脑梗。家属索赔时发现,AI的建议基于1998年的过时指南,而医生没核实就照搬。这让我想起那个经典的AI冷笑话:“当AI医生杀了人,是该烧香拜佛还是找程序员算账?”

(配图:患者在纠结是否信任AI,背景是不断闪现的隐私协议)

某互联网医院的AI系统最近被曝出“偷听”患者隐私对话。虽然官方解释是“语音转文字误差”,但用户纷纷表示:“你们连我骂外卖小哥都记录?”这让我想起那个段子:AI问诊时,我的血压飙升不是因为病情,而是因为它总想偷听我的八卦。

(配图:全息投影的AI医生正在给机器人做手术,但操作台上有杯泡面)

想象一下:你的AI健康管家每分钟分析你的心跳、步数和外卖订单,提前预警糖尿病。但当它建议你“立即停止摄入所有碳水化合物”时,你发现它把米饭和爱情都归类为“碳水”。

(配图:乡村医生举着手机对空喊话:“AI,救救这个脚崴的老太太!”)

在云南某县,AI系统帮助村医识别了23例早期肺癌。但有个小插曲:系统总把“咳嗽”识别成“咳嗽鸡”,搞得全村养鸡户以为自己都得了呼吸系统疾病。

(配图:AI医生和人类医生在天平两端,中间是问号)

说真的,当我在皮肤科被AI误诊时,最崩溃的不是诊断错误,而是它居然比医生更“确定”。就像那个段子说的:“AI不会说‘可能’,它只会说‘根据概率’。”或许这就是医疗AI的终极悖论——我们追求确定性,却忘了医学本身就是概率游戏。

冷笑话彩蛋:

为什么AI医生不会得抑郁症?

因为它永远不会遇到这种情况:患者说“我最近总是想死”,AI认真分析后回复:“建议立即联系自杀热线……哦,您说的是想死鱼?”

更多推荐

已为社区贡献292条内容

已为社区贡献292条内容

所有评论(0)