API测试自动化工具选型:策略、对比与落地实践

摘要: API测试工具选型直接影响自动化测试成效。2025年,团队需从协议支持、断言机制、CI/CD适配等维度评估工具,对比Postman、Rest-Assured等代码驱动型工具与Katalon等低代码平台的优劣。建议采用四阶评估法,结合业务需求和技术趋势(如AI增强测试、云原生适配),选择最适合的方案,并建立持续优化机制,构建高效的API质量保障体系。(149字)

为何工具选型决定自动化成败

随着微服务架构和云原生技术的普及,API测试已成为软件质量保障的核心环节。2025年现阶段,测试团队面临的不再是“是否需要自动化”,而是“如何选择最适合的自动化工具”。一次成功的工具选型能够提升300%的测试效率,而错误选择则可能导致自动化项目流产。本文将从实际应用场景出发,为测试从业者提供系统化的选型方法论。

一、工具选型评估模型

1.1 核心能力维度

协议支持完备性:是否覆盖REST、GraphQL、gRPC、WebSocket等主流协议

断言机制灵活性:支持JSONPath/XPath提取、Schema验证、状态码校验等

数据驱动能力:参数化测试、外部数据源集成、动态数据生成

性能测试集成:能否实现从功能测试到负载测试的无缝转换

1.2 技术整合指标

CI/CD流水线适配度:Jenkins、GitLab CI、GitHub Actions等平台对接

监控与报告体系:实时测试看板、自定义报告、告警机制

协作功能完整性:版本控制、权限管理、团队协作支持

扩展开发支持:插件体系、API客户端集成、自定义函数库

二、主流工具全景对比

2.1 代码驱动型工具

Postman+Newman:

优势:生态成熟、社区活跃、协作功能强大

局限:大规模测试时性能瓶颈明显

适用场景:中小团队、快速迭代项目

Rest-Assured:

优势:Java生态深度融合、BDD风格可读性强

局限:技术栈绑定度高、学习曲线陡峭

适用场景:Java技术栈企业、测试开发团队

2.2 低代码/无代码平台

Katalon Platform:

优势:全栈测试支持、AI辅助生成、企业级功能

局限:商业化成本较高、定制灵活性有限

适用场景:跨平台测试需求、混合技能团队

Apifox:

优势:接口设计-测试- Mock一体化、国产化适配

局限:国际生态整合待加强、复杂场景支持度不足

适用场景:国内互联网企业、全生命周期管理需求

三、选型决策框架

3.1 四阶评估法

阶段一:需求精准画像

梳理API数量与协议分布

明确自动化覆盖率目标

评估团队技术能力矩阵

确定集成环境要求

阶段二:工具初筛匹配

建立加权评分卡(功能40%、技术30%、成本20%、生态10%)

进行7天概念验证(POC)测试

核心场景深度验证

团队接受度调研

阶段三:试点项目实施

选择典型业务模块

制定过渡迁移方案

建立效能衡量基线

收集用户体验反馈

阶段四:规模化推广

制定标准化规范

建立知识管理体系

设计效能监控指标

规划持续优化路径

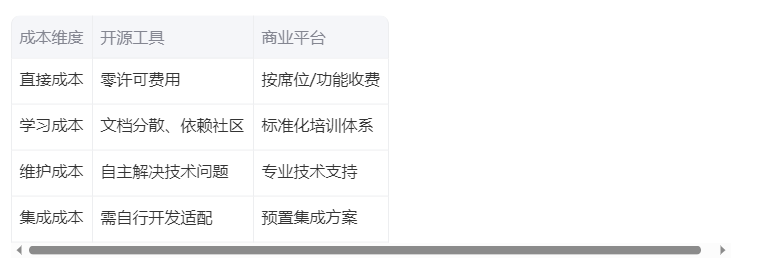

3.2 成本效益分析模型

四、2026年技术趋势前瞻

AI增强测试:智能用例生成、自愈性测试脚本、异常模式预测

云原生适配:Kubernetes原生调度、Service Mesh集成、Serverless测试支持

可观测性融合:将测试数据接入APM体系,实现质量可观测

合规性测试自动化:GDPR、等保2.0等合规要求的自动化验证

结语

工具选型本质上是对团队技术战略、业务需求和组织能力的综合决策。在API测试领域,没有“唯一最优解”,只有“最适合方案”。建议测试团队建立定期的工具评估机制,保持技术敏感度,在稳定性和先进性之间找到最佳平衡点,最终构建高效、可靠的API质量保障体系。

精选文章

Python+Playwright+Pytest+BDD:利用FSM构建高效测试框架

更多推荐

已为社区贡献382条内容

已为社区贡献382条内容

所有评论(0)