【炸裂】170万下载!LightX2V让普通显卡实现视频实时生成,小白程序员也能秒变AI视频大神!

LightX2V是开源视频生成项目,通过Phased DMD步数蒸馏和LightVAE轻量级VAE两大核心技术,将视频生成从40-50步压缩到4步,实现1:1实时生成。全栈性能工程优化包括低比特算子、稀疏注意力算子等,支持8GB以上显存消费级显卡,集成ComfyUI并支持多种主流模型和国产芯片,让个人和企业低成本实现高质量视频生成。

今年以来,开源项目LightX2V 及其 4 步视频生成蒸馏模型在 ComfyUI 社区迅速走红,单月下载量超过 170 万次。越来越多创作者用它在消费级显卡上完成高质量视频生成,把“等几分钟出一段视频”变成“边看边出片”。

LightX2V 背后并不是单一模型的优化,而是一整套面向低成本、强实时视频生成的推理技术栈:从步数蒸馏与轻量VAE,到低比特算子、稀疏算子、多卡并行与分级Offloading,目标只有一个——在主流硬件上,把视频生成推到 1:1 实时。

- GitHub:https://github.com/ModelTC/LightX2V

- Hugging Face:https://huggingface.co/lightx2v

- 项目主页:https://light-ai.top

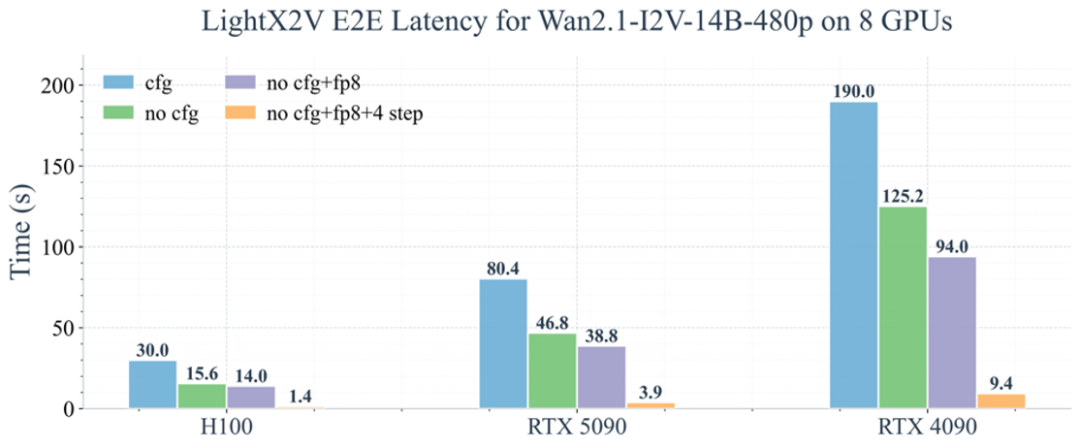

1:1 实时,远超现有框架

在很多视频生成框架中,生成 5–10 秒视频依然需要几分钟时间。LightX2V 在相同分辨率和硬件条件下,通过极少步数的推理和系统级优化,将生成时间压缩到与视频时长接近的水平 (如上图端到端耗时所示),实现接近 1:1 的实时体验。

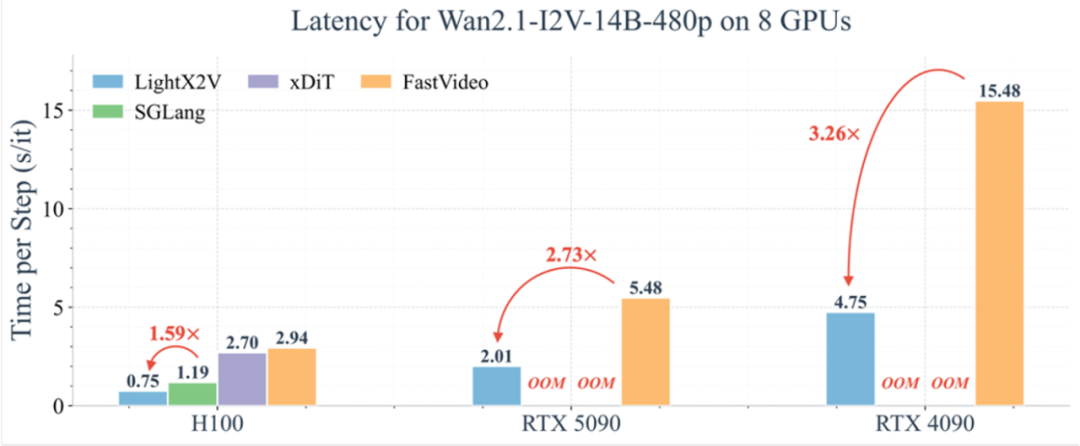

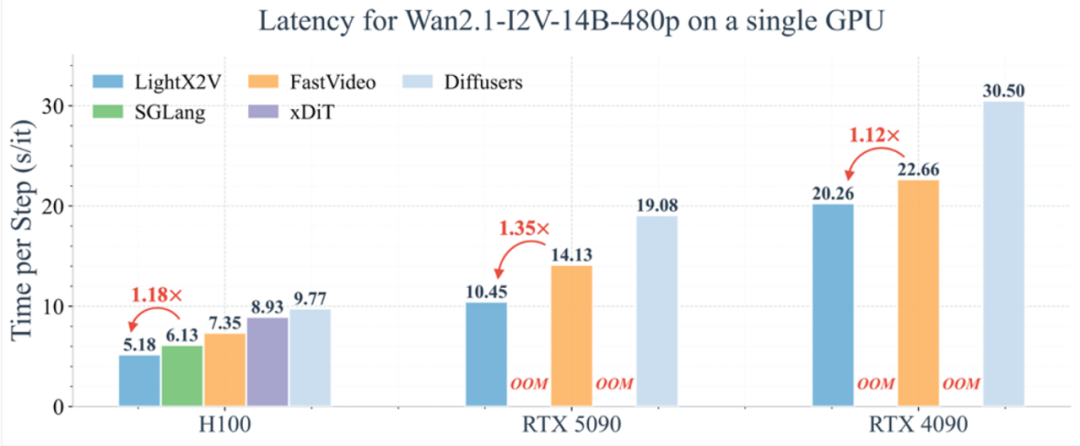

在同类开源方案中,LightX2V 相比 SGLang Diffusion, FastVideo 等优秀的开源框架在延迟和吞吐上都具有明显优势 (如下图单步耗时对比所示),尤其是在 8GB–24GB 消费级显卡区间,更容易跑满硬件能力。

双核心算法:Phased DMD 步数蒸馏 + LightVAE

LightX2V 的速度并不是简单 “少采样几步” 得到的,而是通过两项关键算法协同设计:

Phased DMD 步数蒸馏

LightX2V 自研的 Phased DMD 步数蒸馏,把原本 40–50 步的视频扩散过程压缩到 4 步,同时保持时间一致性和运动细节。基于这一技术产出的少步模型(如 Wan2.1 / Qwen-Image 等)已经在 Hugging Face 趋势榜中长期靠前,累积下载量达到百万级。

LightVAE 轻量级 VAE

针对视频生成场景对吞吐和分辨率的双重需求,LightX2V 设计了极致轻量的 LightVAE。与常规 VAE 相比,在保持高清画质和时间一致性的前提下,有效降低了编解码开销,为 4 步推理释放出更多预算。

这两部分相当于在 “算法上先把路打通”,再让后续工程优化尽可能榨干硬件性能。

全栈性能工程:从 8GB 显存到多卡强实时

在算法压缩完成后,LightX2V 通过一套全栈推理框架,把 “能跑” 变成 “跑得快、跑得省”:

- 显存门槛:通过步数蒸馏、低比特量化和分级 Offloading,将完整视频生成工作流的显存需求压到 8GB 以下,入门级消费卡即可运行。

- 吞吐与延迟:综合使用低比特算子、稀疏注意力与特征缓存,在常见 5 秒视频场景下达到接近 1:1 的实时生成速度。

关键技术模块包括:

- 低比特算子(MXFP8 / MXFP6 / NVFP4):在不明显损伤画质的前提下压缩计算与带宽,释放硬件算力。

- 稀疏注意力算子:利用视频时空特征的稀疏性,减少冗余计算,提升大分辨率下的吞吐。

- 特征缓存:对中间特征进行缓存与复用,降低重复计算,进一步缩短延迟。

- 三层延迟隐藏 Offloading:通过精细化的显存–内存调度,在 8GB 显存上完成 28B 级别 MoE 模型推理,兼顾成本与能力。

- FP8 通信多卡并行:结合 FP8 通信和流水线 / 序列并行,在多卡环境下进一步提升吞吐,面向 5090 等消费级新卡实现更高帧率的强实时目标。

这些技术叠加,使 LightX2V 不仅在单机单卡上易于部署,也可以顺畅扩展到多卡集群。

模型与硬件生态:从 Wan 到国产芯片

为了方便创作者直接受益于上述优化,LightX2V 面向主流模型和硬件做了系统支持:

- 模型生态:当前已支持 Wan2.1 / Wan2.2、CogVideo1.5、HunyuanVideo1.5 等主流视频生成模型,以及 Matrix Game、MagicDrive 等世界模型,并在这些模型上提供 4 步或少步数配置与加速方案。

- 应用生态:LightX2V 深度集成 ComfyUI,LightVAE 等核心组件已进入社区主干工作流,用户可以在熟悉的图形界面中直接调用加速推理。

- 硬件生态:除 NVIDIA 3060 / 4090 / 5090 及 A100 / A800 / H100 / H800 / H200 等显卡外,LightX2V 还原生支持寒武纪 MLU590、沐曦 C500 等国产 AI 芯片,为本地化、大规模部署提供了基础。

使用与落地:从个人创作到企业集群

在实际使用上,LightX2V 覆盖了从个人到企业的不同需求:

- 个人开发者:只需要一台带独显的笔记本或台式机,就可以本地启动带前端界面的视频生成工具,在 ComfyUI 中完成素材调试、风格迭代和项目输出。

- 企业用户:通过 LightX2V 的服务化部署方案,可以一键搭建面向外部的 API 服务和 Web 应用,并按需扩展到多机多卡集群,支持批量视频生产和内部工具集成。

- 普通用户:可直接访问网页版入口 x2v.light-ai.top,在浏览器中体验少步视频生成和实时预览。

从图像转视频、文本转视频,到世界模型和自动驾驶仿真,LightX2V 试图用开源的方式,把 “高质量、低成本、强实时” 的视频生成能力交到更多人手里。

那么,如何系统的去学习大模型LLM?

作为一名深耕行业的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

更多推荐

已为社区贡献376条内容

已为社区贡献376条内容

所有评论(0)