CPU、NPU、GPU、TPU的区别

本文对比分析了四种处理器核心的特性与应用场景:CPU作为通用计算核心,擅长复杂逻辑和串行任务;GPU采用众核架构,适合图形渲染和大规模并行计算;NPU专为神经网络优化,在边缘AI推理中具有高能效优势;TPU则是Google专为云端AI设计的张量加速器。四者在架构设计、核心数量、适用任务和能效比方面存在显著差异:CPU是系统"大脑",GPU主攻并行计算,NPU专注边缘推理,TPU

目录

1.CPU

CPU(Central Processing Unit)是计算机的通用计算核心,承担系统指令的读取、解码、执行和控制任务,追求通用性、低延迟、复杂逻辑处理能力,适用于串行任务和复杂分支逻辑。

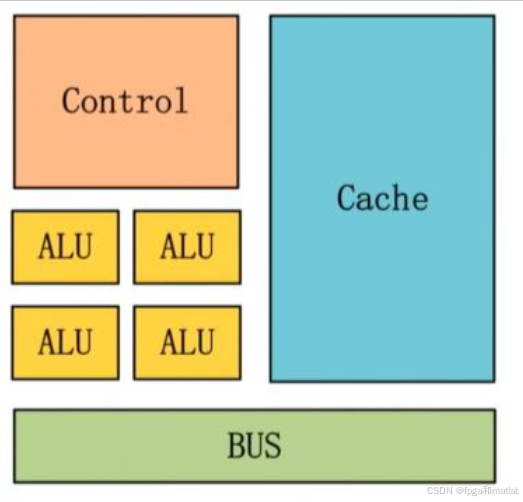

CPU采用冯诺依曼架构,包含控制单元(CU)、算术逻辑单元(ALU)、寄存器、缓存(L1/L2/L3)等模块。其核心数量少(消费级CPU通常4-32核),但单核心性能极强,缓存容量大且延迟低,支持复杂的指令集(如 x86、ARM)。

注重分支预测、乱序执行等技术,优化串行任务的执行效率。

CPU擅长复杂串行计算,支持整数运算、浮点运算、逻辑运算和分支判断,可处理非结构化数据和多变的计算流程,例如:

if (a>b) then c=a+b else c=a−b

应用:

操作系统内核调度、文件管理、人机交互。

复杂逻辑程序(如编译器、数据库事务处理)。

通用计算任务(如办公软件、轻量级编程)。

2.GPU

GPU(Graphics Processing Unit)最初为图形渲染设计,后发展为并行计算核心,追求高吞吐量、大规模并行处理能力,适用于数据并行的同质化任务。

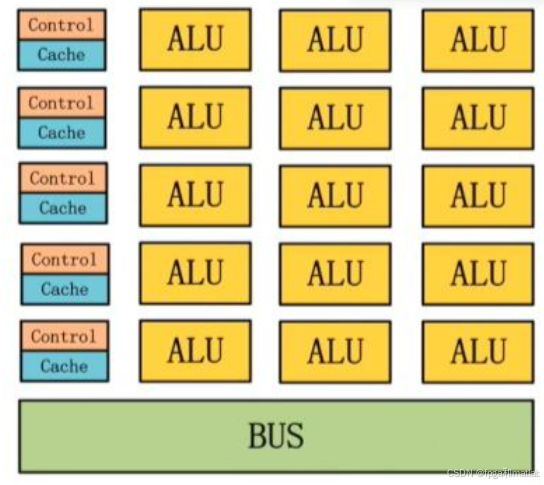

GPU采用众核架构,包含数千个流处理器(SP),按流式多处理器(SM)分组。核心数量极多(消费级 GPU可达数千SP),但单核心性能较弱,缓存容量小,指令集相对简单。注重数据并行,通过SIMT(单指令多线程) 架构,让大量线程同时执行相同指令。

GPU擅长大规模并行浮点运算,适用于数据密集型、无分支或少分支的计算任务,例如矩阵乘法、向量运算:

![]()

应用:

图形渲染(3D游戏、影视特效、CAD建模)。通用并行计算(GPGPU):深度学习训练(如CNN前向/ 反向传播)、科学计算(流体力学模拟)、密码学运算。

3.NPU

NPU(Neural Processing Unit)是专为神经网络计算设计的专用处理器,又称AI芯片,追求神经网络运算的极致能效比,适用于深度学习推理(部分支持训练)。

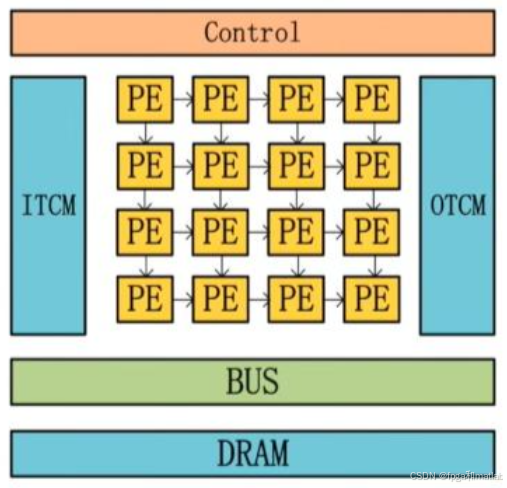

NPU采用脉动阵列(Systolic Array)、乘加器阵列(MAC Array)等专用架构,硬件级支持神经网络的核心运算 ——乘累加(MAC)。

NPU集成激活函数硬件单元、池化单元,减少数据搬运延迟,支持低精度计算(如INT8、FP16)。功耗远低于CPU/GPU,适合嵌入式设备和边缘计算场景。

NPU专为神经网络运算优化,核心是乘累加操作,对应神经网络的卷积、全连接层计算:

其中,wi为权重,xi为输入,b为偏置,y为输出。

应用:

边缘端AI推理:手机拍照美颜、语音助手(如Siri、小爱同学)、自动驾驶感知。

嵌入式设备:智能家居(摄像头人脸识别)、无人机避障。

部分高性能NPU支持轻量级深度学习训练。

4.TPU

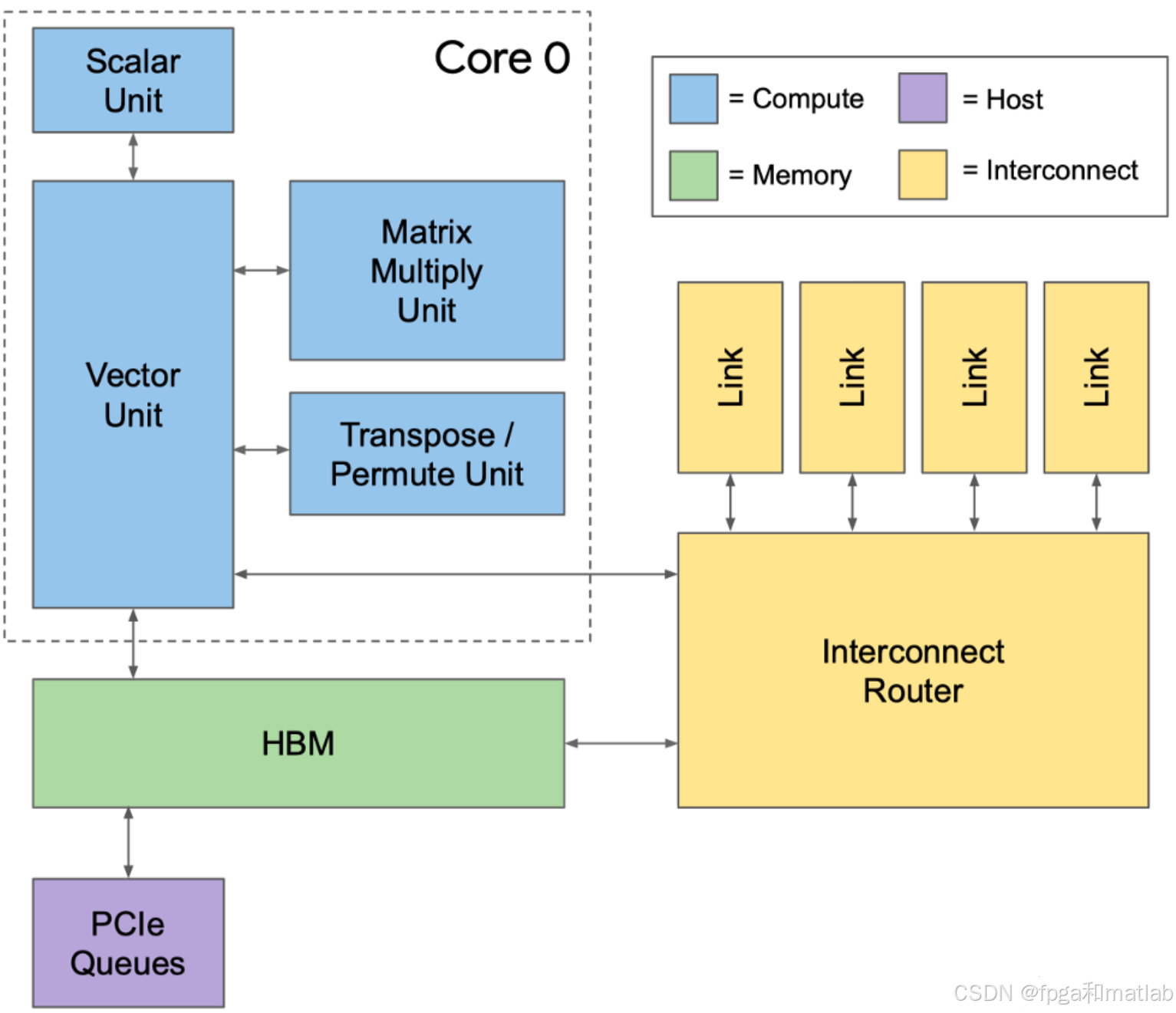

TPU(Tensor Processing Unit)是Google专为TensorFlow框架设计的专用AI加速器,本质是高性能 NPU的一种,追求云端深度学习训练/推理的极致吞吐量。

TPU采用大规模脉动阵列架构,集成数万级MAC单元,硬件级支持张量运算(多维矩阵运算)。高带宽内存(HBM)设计,减少数据访问延迟,支持FP32/FP16/BF16/INT8等多种精度。与CPU/GPU协同工作,由CPU负责逻辑控制,TPU专注张量计算。

TPU专为张量运算优化,完美适配深度学习框架中的张量操作,例如卷积层的多维矩阵运算:

![]()

其中,X为输入特征图,W为卷积核。

应用:

云端深度学习训练:Google搜索排序、AlphaGo模型训练、大语言模型(LLM)训练。

大规模AI推理:Google翻译、图像识别API、智能推荐系统。

5.CPU、NPU、GPU、TPU核心区别对比

| 特性 | CPU | GPU | NPU | TPU |

|---|---|---|---|---|

| 设计目标 | 通用计算、低延迟 | 并行计算、高吞吐量 | 神经网络推理、高能效 | 张量计算、云端 AI |

| 核心架构 | 冯・诺依曼架构,少核 | 众核架构,SIMT | 脉动阵列 / MAC 阵列 | 大规模脉动阵列 |

| 核心数量 | 少(4-32 核) | 极多(数千 SP) | 中(数千 MAC) | 多(数万 MAC) |

| 适用任务 | 串行、复杂逻辑 | 数据并行、浮点运算 | 深度学习推理 | 深度学习训练 / 推理 |

| 能效比 | 低 | 中 | 高 | 极高(云端) |

| 典型场景 | 系统调度、办公软件 | 游戏渲染、GPGPU | 手机 AI、边缘计算 | Google 云端 AI 服务 |

CPU是通用全能选手,适合复杂逻辑和串行任务,是计算机的“大脑中枢”。

GPU是并行计算猛将,适合大规模同质化数据处理,是深度学习训练的主力。

NPU是边缘AI专家,能效比高,适合嵌入式设备的实时推理。

TPU是云端AI王者,专为张量运算优化,是Google大规模AI服务的核心算力。

更多推荐

已为社区贡献191条内容

已为社区贡献191条内容

所有评论(0)