LangChain 升级革命:从 0.3 到 1.1.0,面向对象到函数式编程的范式转变!为生产级 AI 应用奠定坚实基础!

LangChain从0.3到1.1.0实现了从面向对象到函数式编程的范式转变。通过LCEL和LangGraph,解决了旧版本的状态缺失、定制困难和调试黑洞等问题,引入了显式数据流和状态外置等设计理念,使开发者能够更好地控制LLM应用,为构建生产级AI应用提供了坚实基础。

简介

LangChain从0.3到1.1.0实现了从面向对象到函数式编程的范式转变。通过LCEL和LangGraph,解决了旧版本的状态缺失、定制困难和调试黑洞等问题,引入了显式数据流和状态外置等设计理念,使开发者能够更好地控制LLM应用,为构建生产级AI应用提供了坚实基础。

LangChain 从 0.3 到 1.1.0 的演进,不是一次简单的版本升级,而是一场从“面向对象封装”到“函数式组合”的范式革命。本文不谈简单的 API 替换,而是从架构师视角,深度剖析如何通过 LCEL 和 LangGraph 夺回对 LLM应用的控制权,解决生产环境中的“黑盒焦虑”。

一、破局:告别“魔法”时代

在 2023 年,LangChain 0.x 是当之无愧的“Demo 之王”。

只需 RetrievalQA.from_chain_type() 一行代码,一个能够检索知识库的机器人就诞生了。这被称为“Magic(魔法)”。

但在 2024 年的生产环境中,这种“魔法”变成了诅咒:

-

状态缺失:AgentExecutor 把对话历史、中间思考、工具结果全部混在内存里,服务一重启,用户上下文全丢。

-

定制高墙:想在检索后加一个简单的 Rerank?对不起,你需要继承类、重写方法、甚至 Copy 源码。

-

调试黑洞:当 ConversationalRetrievalChain 在内部死循环时,你无法打断点,因为逻辑被封装在三层父类的 _call 方法里。

LangChain 1.x 的核心使命只有一件事:De-magic(去魔法化)。它把控制权从框架手中夺回,交还给开发者。

二、架构代差:从 OOP 到 FRP 的范式转移

要理解这次升级,必须看透底层的编程范式变化。

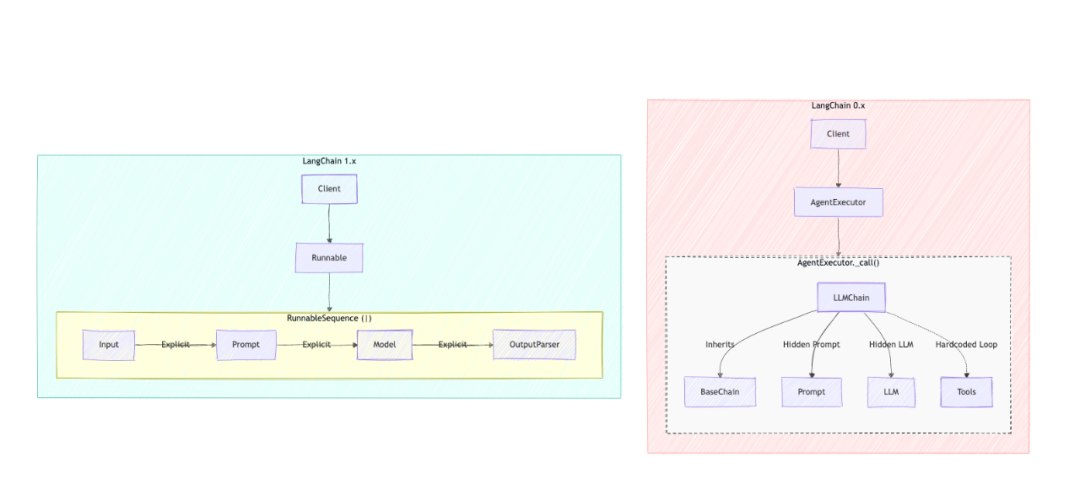

2.1 0.x 时代:臃肿的继承体系 (OOP)

LangChain 0.x 是典型的面向对象设计。核心逻辑依赖复杂的继承链:

BaseChain -> LLMChain -> RetrievalQA -> ConversationalRetrievalChain。

这种设计的致命伤在于逻辑隐藏。开发者调用的是最上层的封装,底层的 Prompt 拼接、History 截断、Output 解析全部不可见。

2.2 1.x 时代:函数式响应编程 (FRP + Graph)

LangChain 1.x 引入了 LCEL (LangChain Expression Language),本质上是借鉴了 Linux 管道的函数式组合思想。

- Atomic(原子化):不再有大而全的 Chain,只有 Prompt、Model、Parser 这样的原子组件。

- Composable(可组合):通过统一的 Runnable 协议,组件像乐高一样拼接。

- Visible(可见性):数据流向在代码中一览无余,不再有“幕后操作”。

| 维度 | LangChain0.x | LangChain 1.x | 架构本质 |

|---|---|---|---|

| 构建方式 | 继承大类 (Inheritance) | 管道组合 (Composition) | OOP vs FP |

| 控制流 | 隐式 (封装在 _call) | 显式 (图的边 / Edges) | 黑盒 vs 白盒 |

| 状态管理 | 内存变量 (Memory Class) | 结构化数据 (State Schema) | 有状态 vs 无状态 |

| 运行机制 | 线性 DAG | 循环图 (Cyclic Graph) | 流水线 vs 状态机 |

三、升级的核心设计思想:控制权回归

3.1 协议至上:Runnable Protocol

1.x 实际上只做了一件事:定义了标准。所有的组件(无论是 OpenAI 模型,还是自定义的 Python 函数),只要实现了 invoke、stream、batch,就是 Runnable。

这意味着架构师可以混编:

- 第一步用 LangChain 的 Prompt 模板;

- 第二步插入一段自己写的复杂 Python 业务逻辑(通过 RunnableLambda);

- 第三步调用本地大模型。

这种互操作性是企业级架构的刚需。

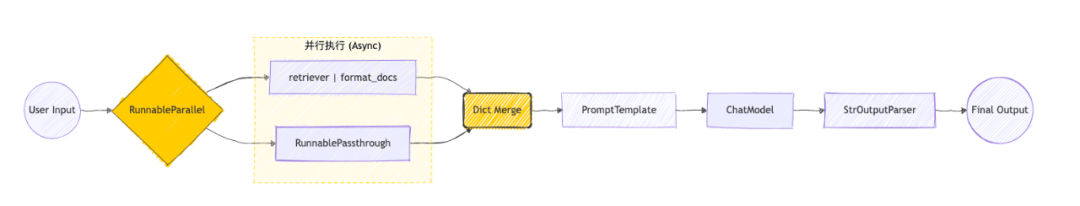

3.2 显式优于隐式:LCEL 的数据流哲学

看一段代码对比,感受“控制权”的差异,0.x (你不知道它在做什么):

# 这一行代码背后发生了什么?你完全不知道。

qa = RetrievalQA.from_chain_type(llm, chain_type="stuff", retriever=retriever)

1.x (每一行逻辑都是你定义的):

# 数据流清晰可见:检索 -> 格式化 -> 组装 Prompt -> 调用模型 -> 解析字符串

chain = (

{"context": retriever | format_docs, "question": RunnablePassthrough()}

| prompt

| model

| StrOutputParser()

)

在 1.x 中,如果你想加日志、加监控、加异常处理,你可以精确地插入到管道的任何缝隙中。

3.3 状态外置:Agent 即状态机

这是 LangGraph 解决的最痛点。在 0.x 中,Agent 是一个在那儿“空转”的 while 循环。

在 1.x (LangGraph) 中,Agent 被建模为有限状态机 (FSM)。

State as Data (状态即数据):状态不再是内存里的黑魔法,而是一个定义好的 TypedDict(Schema)。这使得持久化(Checkpointing)、断点续传、时间旅行调试成为可能。

四、重构:从 AgentExecutor 到 LangGraph

这是升级中最硬的骨头,也是收益最大的部分。我们以一个“带有审批流的订单查询 Agent”为例。

4.1 0.x 的困境

在旧版本实现“如果涉及敏感操作,需人工审批”这一逻辑几乎是不可能的,因为 AgentExecutor 的执行循环是写死的,你无法在中间插入“暂停”逻辑。

4.2 1.x 的破局 (LangGraph 实现)

Step 1: 定义状态 (The Brain)

from typing import TypedDict, Annotated

from langgraph.graph.message import add_messages

class AgentState(TypedDict):

# 使用 reducer 自动处理消息追加,而不是简单的覆盖

messages: Annotated[list, add_messages]

# 显式追踪需要审批的操作

pending_actions: list

Step 2: 定义节点 (The Muscles)

# 仅仅是普通的 Python 函数,不再依赖复杂的 Agent 类

def call_model(state: AgentState):

response = model.invoke(state["messages"])

return {"messages": [response]}

def execute_tools(state: AgentState):

# 执行具体的工具逻辑

...

return {"messages": [tool_output]}

Step 3: 定义控制流 (The Nervous System) —— 核心差异点

from langgraph.graph import StateGraph, END

workflow = StateGraph(AgentState)

# 定义条件边:决定下一步去哪

def router(state):

last_msg = state["messages"][-1]

if not last_msg.tool_calls:

return END

# 核心:在这里插入业务规则!

if is_sensitive_operation(last_msg.tool_calls):

return "human_review" # 路由到人工审批节点

return "tools"

workflow.add_conditional_edges("model", router)

Step 4: 编译与运行 (The Runtime)

# 编译时挂载持久化存储

app = workflow.compile(checkpointer=PostgresSaver(conn))

# 运行

config = {"configurable": {"thread_id": "conan-orderXXX"}}

app.invoke(input_data, config)

重构收益显著:

- 确定性:不再担心 Agent 陷入死循环,每一步跳转都在图定义中。

- 人机协同:原生支持 Human-in-the-loop,遇到 human_review 节点自动暂停,等待 API 触发继续。

- 持久化:服务重启后,根据 thread_id 可以无缝恢复之前的对话上下文。

五、生产级优化与最佳实践

5.1 彻底的流式改造 (Streaming First)

生产环境对 TTFT (Time to First Token) 极其敏感。0.x 的流式通常是“伪流式”(通过 Callback 实现,很难传回前端)。

1.x 的 LCEL 原生支持 astream_events:

# v2 版本的事件流,细粒度控制

async for event in chain.astream_events(input, version="v2"):

if event["event"] == "on_chat_model_stream":

# 实时推送 token

yield event["data"]["chunk"].content

elif event["event"] == "on_retriever_end":

# 实时告诉用户:文档检索完毕

yield json.dumps({"status": "retrieved", "docs": ...})

实践经验:利用 astream_events 可以在前端精确展示“正在思考”、“正在检索”、“正在计算”的细粒度状态,用户体验提升巨大。

5.2 并发与异步 (Asyncio)

在 API Gateway 层,必须全链路异步。LCEL 的 RunnableParallel 能够自动并行化无依赖的步骤(例如同时检索 Wiki 和 内部数据库)。

# 自动并发:检索和问题分析同时进行

inputs = RunnableParallel({

"context": retriever,

"analysis": analysis_chain

})

# 整个链路必须使用 ainvoke

await chain.ainvoke(...)

六、总结与展望

LangChain 1.1.0 的升级,本质上是一场工程化的胜利。

- 对开发者:它从一个“帮你写代码”的魔法框架,变成了一个“让你写出好代码”的基础设施。

- 对架构师:它提供了构建复杂、高可用、可观测 AI 应用所需的确定性。

如果你的应用还停留在 PoC 阶段,0.3 也许还能凑合。但如果要构建一个从容应对万级请求、需要与现有业务系统深度集成、且经得起审计的生产级 AI 应用,拥抱 LangChain 1.x 是正确的选择。

这不仅是代码的重构,更是思维方式的重构—从期待 AI 的魔法,转变为掌控系统的逻辑!

七、在大模型时代,我们如何有效的去学习大模型?

现如今大模型岗位需求越来越大,但是相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也_想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把都打包整理好,希望能够真正帮助到大家_。

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,下面是我整理好的一套完整的学习路线,希望能够帮助到你们学习AI大模型。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF书籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型各大场景实战案例

结语

【一一AGI大模型学习 所有资源获取处(无偿领取)一一】

所有资料 ⚡️ ,朋友们如果有需要全套 《LLM大模型入门+进阶学习资源包》,扫码获取~

更多推荐

已为社区贡献179条内容

已为社区贡献179条内容

所有评论(0)