2025最新RAG框架教程(超详细)从零基础到企业级应用,收藏这篇就够了!

随着多模态大模型技术发展,支持文本、图片、音频、视频等全模态检索的 RAG 系统已成为企业级知识管理的关键需求。核心推荐(清华团队 MCP 架构创新)、RAGFlow(企业级稳定性)、Morphik(多模态专注型)技术验证型(学术 benchmark 领先)、(研究导向全模态)这些项目在架构设计、检索精度、工程化成熟度等方面各有优势,均可实现从文件解析、多模态索引到生成式问答的完整闭环。

该文章调研了2025年最新开源的5个全模态RAG知识库框架,包括UltraRAG 2.1、RAGFlow、Morphik、Taichu-mRAG和ScienceSage,从架构设计、检索精度、工程化成熟度等方面进行了详细评估。文章提供了选型决策树、部署实践建议和风险趋势分析,帮助开发者根据不同场景选择合适的RAG框架。其中UltraRAG 2.1代表技术前沿,RAGFlow是生产级首选,Morphik在知识密集型场景性价比突出。

特别声明:该文章出于传递知识而非盈利之目的,同时并不代表赞成其观点或证实其描述,内容仅供参考。

执行摘要

随着多模态大模型技术发展,支持文本、图片、音频、视频等全模态检索的 RAG 系统已成为企业级知识管理的关键需求。本报告基于 2025 年最新开源项目调研,筛选出 5 个具备全模态处理能力、功能强大且架构先进的 RAG 知识库框架:

核心推荐:UltraRAG 2.1(清华团队 MCP 架构创新)、RAGFlow(企业级稳定性)、Morphik(多模态专注型)技术验证型:Taichu-mRAG(学术 benchmark 领先)、ScienceSage(研究导向全模态)

这些项目在架构设计、检索精度、工程化成熟度等方面各有优势,均可实现从文件解析、多模态索引到生成式问答的完整闭环。

一、项目详细评估

1. UltraRAG 2.1(首推:下一代架构标杆)

-

开发团队

:清华大学 THUNLP 实验室、东北大学 NEUIR、OpenBMB、AI9Stars

-

GitHub

:https://github.com/OpenBMB/UltraRAG

-

核心定位

:全球首个基于 Model Context Protocol (MCP) 架构的原生多模态 RAG 框架

全模态能力

- VisRAG Pipeline:端到端支持视觉文档(图片、PDF、扫描件)处理,避免传统 OCR 信息损失,多模态任务性能提升 25-39%

- 统一索引机制:文本、图像、表格、公式统一向量化,支持跨模态混合检索

- 原生多模态生成:集成视觉语言模型(VLM),实现图文混合问答

架构优势

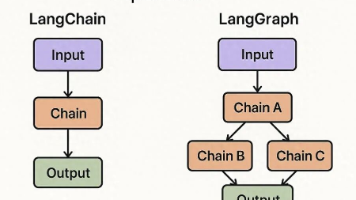

- MCP 解耦架构:检索、生成、评估模块独立服务,通过 YAML 声明式配置即可串行 / 循环 / 条件分支编排,50 行配置替代传统 900 + 行代码

- 标准化评估体系:内置 UltraRAG-Eval,支持相关性、忠实度、流畅性多维度自动化评测

- 模块化热插拔:可无缝替换 Embedding 模型(自研 UltraRAG-Embedding 性能超 bge-m3 约 10%)、LLM 后端

稳定性与生态

- 学术背书:在 M3DocVQA 等权威基准上验证,端到端问答准确率提升 33%

- 社区活跃:GitHub 星标 12k+,持续迭代,支持 Llama、Qwen、Kimi 等主流模型

- 企业就绪:提供完备训练脚本(SFT/DPO)、动态知识增强与规则链,适配生产环境

2. RAGFlow(首推:企业级工程化首选)

-

核心定位

:基于深度文档理解的多模态 RAG 智能工作流平台

全模态能力

- 多源数据融合:明确支持文本、图像、音视频全模态数据摄入

- DeepDoc 解析引擎:高精度识别文档结构,智能分离文本、图像、表格、公式并保留语义关联

- 统一检索接口:兼容 Elasticsearch、FAISS 等 12 种检索后端,支持跨模态混合检索

功能强大性

- 低代码编排:可视化工作流设计,支持 “客户咨询→知识库检索→生成回复” 等业务流程快速落地

- 动态知识增强:实时关联最新业务数据,内置规则链引擎(如财务合规校验),有效抑制模型幻觉

- 全链路监控:从数据摄入到答案生成的完整可追溯性,适合审计要求高的场景

稳定性表现

- 成熟度高:多个 CSDN/51CTO 部署教程表明社区验证充分,部署方案完善

- 性能基准:某律所处理 20 万页合同,条款定位速度达 0.8 秒 / 条,错误率仅 3.2%

- 资源需求:建议配置 16GB 内存 + 50GB 磁盘,适合中等规模企业私有化部署

3. Morphik(特色:知识图谱驱动)

-

核心定位

:开源多模态 RAG 数据库,专注非结构化数据治理

全模态能力

- 万物接入:支持 PDF、视频、文本、图片等任意格式,智能分块 + 嵌入生成

- ColPali 多模态嵌入:结合文本和图像内容生成统一向量,检索精准度高

- 视频处理:明确支持视频文件解析,通过帧提取 + 字幕识别构建时序索引

核心特色

- 自动知识图谱:自动提取实体与关系,文档连接更清晰,问答上下文关联性提升显著

- 自然语言规则引擎:用自然语言定义提取规则,非结构化→结构化转换门槛低

- 持久化缓存:预处理文档 “冻结” 状态,二次检索响应速度提升 60% 以上

稳定性与扩展性

- 存储灵活:支持本地、MongoDB、S3、PostgreSQL/pgvector 多种后端

- 生态接口:提供 AIGC 客户端应用,快速管理多源数据

- 适用场景:AI 开发者构建智能问答、企业私有数据治理、学术文献语义搜索

4. Taichu-mRAG(学术:多模态精度领先)

-

开发团队

:武汉人工智能研究院(紫东太初团队)

-

核心定位

:面向多模态富文档理解的专业 RAG 框架

技术突破

- 端到端优化:在 M3DocVQA 数据集上问答准确率比开源 SOTA 提升 33%,多模态检索召回率提升 12%

- 细粒度混合索引:文本嵌入 + 图像区域特征 + 表格结构的多模态混合索引召回

- 跨模态关联检索:支持图文混合查询,自动关联图表与说明文字

架构特点

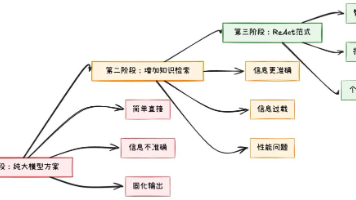

- 四大核心模块:Query 理解→多模态混合索引召回→多模态精排→多模态增强答案生成

- 视觉语义保留:特别优化对版面结构、图表关系、公式特征的向量化,避免信息表征缺失

局限性

- 部署复杂度:学术项目,生产化工具链与文档相对薄弱

- 社区规模:主要面向研究,企业级支持有限

- 推荐用途:技术验证、高难度多模态文档理解场景

5. ScienceSage(研究:多模态探索型)

-

项目性质

:学术论文配套系统(arXiv:2502.18479)

全模态支持

- 会话级多模态索引:支持文本、图像、音频、视频上传与检索

- 转录索引策略:音频 / 视频数据自动转录为文本索引,原始媒体不存储,降低存储成本

- 多模态嵌入:文本用 Hugging Face all-distilroberta-v1,图像用 CLIP 模型

技术优势

- 知识双库存储:Weaviate(向量)+ Nebula Graph(图)混合存储,兼顾语义与关系检索

- LangChain/LlamaIndex 集成:提供灵活 RAG 实现,支持知识图谱索引与向量索引混合

- 私有 LLM 部署:支持 Mixtral.8X7B 等开源模型本地 GPU 部署

成熟度评估

- 实验性质:正在测试 LanceDB 存储多模态索引,未达生产级稳定

- 适用场景:科研实验、DIY 个性化知识库、对数据隐私极端敏感的场景

二、全面对比矩阵

| 评估维度 | UltraRAG 2.1 | RAGFlow | Morphik | Taichu-mRAG | ScienceSage |

|---|---|---|---|---|---|

| 文本支持 | ✅ 原生优化 | ✅ 深度解析 | ✅ 智能分块 | ✅ 混合索引 | ✅ 标准支持 |

| 图片支持 | ✅ VisRAG 端到端 | ✅ DeepDoc | ✅ ColPali 嵌入 | ✅ 细粒度区域特征 | ✅ CLIP 模型 |

| 视频支持 | ✅ 索引与帧检索 | ✅ 明确支持 | ✅ 明确支持 | ✅ 时序索引 | ✅ 转录索引 |

| 音频支持 | ❌ 未明确 | ✅ 明确支持 | ❌ 未明确 | ❌ 未明确 | ✅ 转录索引 |

| 知识图谱 | ⚠️ 评估中 | ⚠️ 计划集成 | ✅ 自动构建 | ✅ 动态构建 | ✅ Nebula Graph |

| 架构先进性 | ⭐⭐⭐⭐⭐ MCP | ⭐⭐⭐⭐ 工作流 | ⭐⭐⭐ 可扩展 | ⭐⭐⭐ 模块化 | ⭐⭐ 传统集成 |

| 工程化成熟度 | ⭐⭐⭐⭐ 上升期 | ⭐⭐⭐⭐⭐ 高 | ⭐⭐⭐ 中等 | ⭐⭐ 研究型 | ⭐⭐ 实验型 |

| 社区活跃度 | ⭐⭐⭐⭐ 12k 星 | ⭐⭐⭐⭐ 成熟 | ⭐⭐⭐ 新兴 | ⭐⭐ 学术主导 | ⭐ 论文项目 |

| 部署复杂度 | 中等 | 中低 | 中等 | 较高 | 高 |

| 性能基准 | 提升 25-39% | 0.8 秒 / 条款 (20 万页) | 未公开 | SOTA+33% | 未公开 |

三、选型决策树

场景化建议

| 应用场景 | 首选方案 | 备选方案 | 关键理由 |

|---|---|---|---|

| 企业智能客服 | RAGFlow | UltraRAG | 工作流成熟、合规性强、响应快 |

| 科研文献管理 | Morphik | UltraRAG | 知识图谱自动构建、语义搜索精准 |

| 法律 / 金融文档审查 | RAGFlow | Taichu-mRAG | DeepDoc 解析精度高、规则链灵活 |

| 多媒体知识库 | UltraRAG | Morphik | 原生多模态、架构可扩展 |

| 数据敏感 | UltraRAG | ScienceSage | 支持全开源模型、MCP 解耦安全 |

| 快速原型验证 | Morphik | UltraRAG | 低代码、部署快、功能全面 |

四、部署实践建议

1. 环境准备(通用)

# 推荐配置

CPU: 16核心以上

内存: 32GB(生产环境64GB+)

GPU: RTX 4090 24GB(支持多模态推理)

存储: NVMe SSD 500GB+

系统: Ubuntu 22.04 LTS

2. UltraRAG 2.1 快速部署

# 步骤精简版

git clone https://github.com/OpenBMB/UltraRAG

cd UltraRAG && conda create -n ultrarag python=3.10

conda activate ultrarag && pip install -r requirements.txt

# 配置MCP服务(YAML示例见官方文档)

python -m ultrarag.server --config config.yaml

3. RAGFlow 生产部署

- Docker 部署:官方提供 docker-compose,一键启动完整服务栈

- 向量数据库:推荐 Elasticsearch 8.x(支持稠密 + 稀疏向量混合检索)

- 解析引擎:DeepDoc 需独立部署,建议分配 8GB 内存

- 监控:集成 Prometheus+Grafana,监控检索延迟与生成质量

4. Morphik 扩展配置

# 配置示例:视频处理pipeline

parsers:

video:

extract_fps: 1 # 每秒提取1帧

subtitle_languages: ['zh', 'en']

embedding_model: 'colpali-rerank'

storage:

backend: 'postgresql'

vector_extension: 'pgvector'

五、风险与趋势

当前风险

- 视频处理成本:全量视频帧提取与向量化计算开销大,建议采用关键帧采样策略

- 音视频转录精度:Speech-to-Text 对领域术语识别率约 85-92%,需配套人工校验流程

- 多模态幻觉:跨模态检索可能引入语义漂移,建议增加重排序(rerank)与置信度过滤

技术趋势(2025)

- MCP 协议

- 普及:UltraRAG 引领的模块化架构将成为企业 RAG 标准

- 端到端优化:VisRAG 类方案减少信

- 息损失,性能差距将进一步拉大

- 存储一体化:LanceDB 等多模态向量数据库成熟,将简化技术栈

- 边缘部署:模型小型化(如 Qwen2-VL-2B)推动 RAG 向边缘设备迁移

六、结论与行动建议

综合评估结论

-

UltraRAG 2.1

代表技术前沿,适合有研发团队、追求长期演进的企业

-

RAGFlow

是当前最稳妥的生产级选择,尤其适合法律、金融等强合规场景

-

Morphik

在知识密集型场景(科研、教育)性价比突出

即刻行动清单

- POC 验证:使用 Morphik 或 UltraRAG,用 100 份文档 + 10 个视频搭建测试环境,2 周内验证效果

- 性能基准:在相同数据集(如 MMarco)上对比 RAGFlow 与 UltraRAG 的检索召回率与生成准确率

- 成本测算:视频处理按 1 元 / 分钟(转录 + 向量化)估算 TB 级数据总成本

- 安全审计:评估 MCP 架构下各模块数据流转路径,确保符合等保 2.0 要求

最终建议

对于 90% 企业场景,推荐采用 RAGFlow 快速落地,同时启动 UltraRAG 2.1 技术预研,构建双轨演进能力。对于科研或 AI 原生企业,可直接切入 UltraRAG 生态,抢占技术红利。

我们主要做AI警务、AI政务、AI医疗、AI教育大模型应用开发和AI大模型本地私有化部署,RAG知识库,AI Agent智能体, MCP服务,LLM微调,硬件设备方案推荐等服务,包含企业级应用开发和其他场景的定制化开发,欢迎交流。

如何学习AI大模型 ?

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。【保证100%免费】🆓

CSDN粉丝独家福利

这份完整版的 AI 大模型学习资料已经上传CSDN,朋友们如果需要可以扫描下方二维码&点击下方CSDN官方认证链接免费领取 【保证100%免费】

读者福利: 👉👉CSDN大礼包:《最新AI大模型学习资源包》免费分享 👈👈

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

👉1.大模型入门学习思维导图👈

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

对于从来没有接触过AI大模型的同学,我们帮你准备了详细的学习成长路线图&学习规划。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。(全套教程文末领取哈)

👉2.AGI大模型配套视频👈

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,每个章节都是当前板块的精华浓缩。

👉3.大模型实际应用报告合集👈

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(全套教程文末领取哈)

👉4.大模型实战项目&项目源码👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战项目来学习。(全套教程文末领取哈)

👉5.大模型经典学习电子书👈

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。(全套教程文末领取哈)

👉6.大模型面试题&答案👈

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。(全套教程文末领取哈)

为什么分享这些资料?

只要你是真心想学AI大模型,我这份资料就可以无偿分享给你学习,我国在这方面的相关人才比较紧缺,大模型行业确实也需要更多的有志之士加入进来,我也真心希望帮助大家学好这门技术,如果日后有什么学习上的问题,欢迎找我交流,有技术上面的问题,我是很愿意去帮助大家的!

这些资料真的有用吗?

这份资料由我和鲁为民博士共同整理,鲁为民博士先后获得了北京清华大学学士和美国加州理工学院博士学位,在包括IEEE Transactions等学术期刊和诸多国际会议上发表了超过50篇学术论文、取得了多项美国和中国发明专利,同时还斩获了吴文俊人工智能科学技术奖。目前我正在和鲁博士共同进行人工智能的研究。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

CSDN粉丝独家福利

这份完整版的 AI 大模型学习资料已经上传CSDN,朋友们如果需要可以扫描下方二维码&点击下方CSDN官方认证链接免费领取 【保证100%免费】

读者福利: 👉👉CSDN大礼包:《最新AI大模型学习资源包》免费分享 👈👈

更多推荐

已为社区贡献201条内容

已为社区贡献201条内容

所有评论(0)