【AI大模型对话】06.实现项目 代码接收本地AI大模型的返回数据

系列文章目录

提示:帮帮志会陆续更新非常多的IT技术知识,希望分享的内容对您有用。本章分享的是springboot的使用。前后每一小节的内容是存在的有:学习and理解的关联性。【帮帮志系列文章】:每个知识点,都是写出代码和运行结果且前后关联上的去分析和说明(能大量节约您的时间)。

所有文章都*不会*直接把代码放那里,让您自己去看去理解。我希望我的内容对您有用而努力~

系列文章总目录,除了当前的AI大模型系列外,还包括java前后分离,Python,AI,大数据,游戏,面试等等,系列文章归纳在此:

系列文章—总目录

前言

前提:本系列实现AI大模型,使用的是Python语言,用户界面使用的是html,通过vue框架来实现的。所以:需要掌握和具备这些前提知识(前端用vue.js来交互数据,是为了更加贴合于公司上班和市场运用)

当前为系列文章:已经安装好了Anaconda开发软件,安装好了pytorch,确定的电脑的软件(版本)和硬件设备(GPU英伟达),已经创建好了pycharm项目 并 关联到了Anaconda的环境包

当前为第6篇,需查看前面的内容,请查看前面序号

在公司经常写商业化项目,我们公司基本的要求,随意选一些,是这样的:

提供开源、闭源等多种模型即开即用服务,集成模型选型、微调训练及安全套件等功能,构建网络安全防护、数据隔离加密、内容风险过滤三重安全保障机制本系列文章尽量趋近于 公司的商业要求

一、查看区别

当前我们采用非流式输出处理

下一小节采用流式输出处理

具体的区别,我额外文章为:

【AI大模型对话】流式输出和非流式输出的定义和区别大致为:一个大模型全部数据生成完毕,返回数据另一个大模型生成多少数据,返回多少数据,源源不断产生我把文章拆开了,全部放一起,篇幅太大,反而不好看清楚

二、启动模型

前面章节已经 安装好了ollama,且配置了ollama拉取模型的位置,也拉取了一个deepseek模型

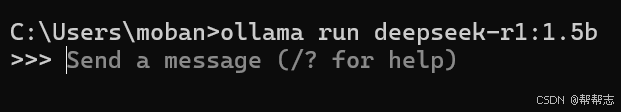

启动模型

ollama run 模型的名字

根据自己拉取的名字来修改命令,我们按照前面的小节,命令为:

ollama run deepseek-r1:1.5b

启动成功

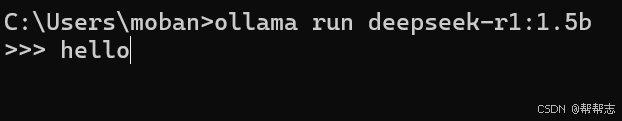

灰色的那句 send a message 不是我写的,自动装填的,现在就可以直接写你想问的问题,我们测试:

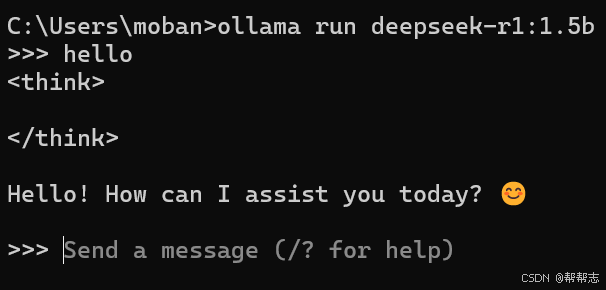

回车,运行:

think里面正常来说:就是它思考的输出,目前还没有

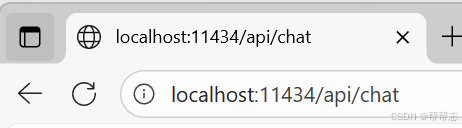

访问web

测试:端口这些都是没有被占用,ollama的deepseek在用,能正常访问等等等 端口是固定的11434

终端不能关闭,终端现在相当于是一个能在本机访问的:web网页服务器

会看到网页里面有个404 xxx xxx看不到网页其他内容,是正常的,它这个需要post提交方式,而不是直接浏览器输入的get方式404 xxx xxx 就已经成功了,因为这个404是ollama的html标签,而不是浏览器显示的该网页xxxxx啥的

三、编写代码

非流式输出

1.安装requests包

别说已经安装过了啥的,现在我们用Anaconda管理环境,目前pycharm创建的项目是关联好了Anaconda里面的某一个环境,需要在Anaconda里面的某一个环境安装requests包

命令:

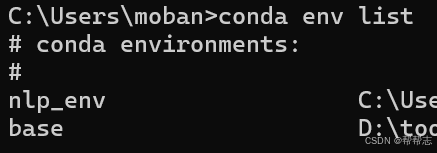

conda env list查看当前Anaconda已经有的环境

conda activate nlp_env激活nlp_env环境 / 使用nlp_env环境

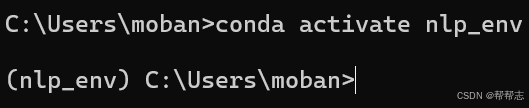

pip install requests==2.32.5 -i https://repo.huaweicloud.com/repository/pypi/simple/安装包

2.编写代码

#导入包

import requests

#后面这个 就是从vue前端来接收的,当前是控制台获取

input=input("请输入一个问题:\n")

prompt = {

#本地拉取的是什么模型,这里就填那个模型的名字,万一电脑有几个呢

"model":"deepseek-r1:1.5b",

"messages": [

{"role":"system", "content":"你是一个专业的助手,请回答相关问题"},

{"role":"user", "content":input} #控制台数据的变量

],

"stream":False

}

#post提交

#接收web的数据,指定json格式

result = requests.post(url="http://localhost:11434/api/chat", json=prompt)

#print(result) #可以把result输出看一看

#状态码

print(result.status_code)

#result.json()是python字典{}格式的

#里面有很多信息,有分析的一堆话 有结果

# 我们最终给前端vue的是某一些数据

print(result.json())

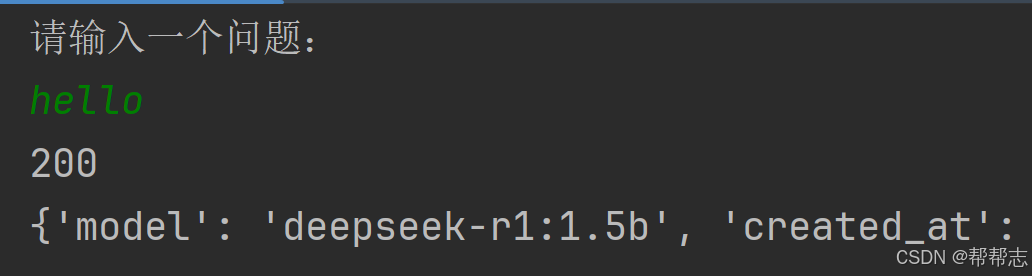

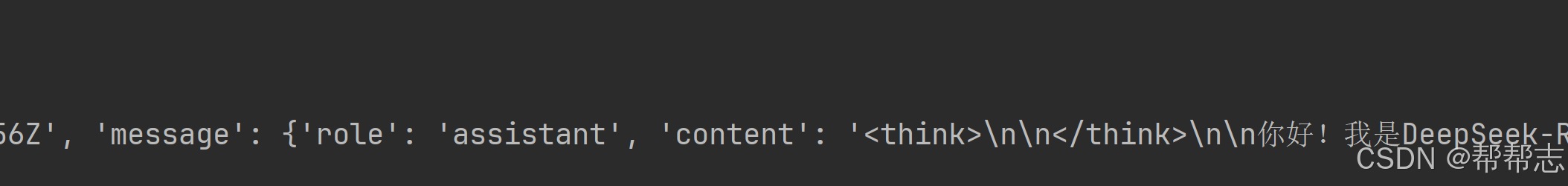

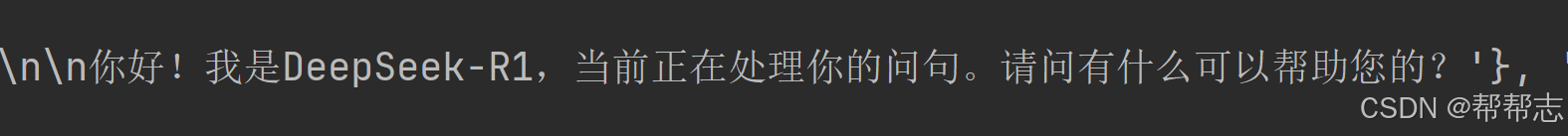

3.运行

目前终端不能关闭

运行Python代码

结果:

我把控制台往后面拉一下,截屏,很长的一个字典

这里就已经成功了

可以通过Python的字典语法,填入key,取出里面的内容

一般交给前端vue的就是两个 :思考的 和 输出的结果

商业化项目:不断的训练 + 精准的内部提示词[代码里面写了一部分,拼接] 和 给公司甲方自己的数据,让模型输出的更加准确和精准

所以:上面那段代码还得加(系列后面会传 +代码还会用上pytorch机器学习和深度学习,第4小节安装的)

下一小节:流式输出,正在上传ing

总结

说明一下:整个这个系列实现AI大模型对话项目。序号文章一共也就10几篇,只有核心图文重点操作步骤来实现这个目标,仅仅有安装步骤+代码步骤。。没有理论或者介绍行业技术啥的叭叭叭的话~

(包括这个AI大模型的环境搭建,深度学习,数据处理,流输出,流推理等等)

(基本上您边看边写:一个小时或者一上午就能跟着一起手搓一个,然后您可以自行添加功能和内容在您项目里面)

其他扩展细节知识点,本系列省略了(或者有链接)如:

Python语法的

vue语法的

(会陆续更新非常多的IT技术知识及泛IT的电商知识,可以点个关注,共同交流。ღ( ´・ᴗ・` )比心)

(也欢迎评论,提问。 我会依次回答~)

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)