[特殊字符] AI Agents 入门 · Hugging Face 系列 Lesson 1

AI智能体入门:从概念到实践 摘要:本文介绍了AI智能体(Agent)的核心概念与技术架构。智能体代表AI从"能聊天"到"能做事"的进化,由大语言模型(大脑)和工具集(身体)组成,具备理解、推理和执行能力。文章解析了智能体的5级自主能力图谱(从简单处理到多智能体协作),列举了典型应用场景(虚拟助手、客服系统等),并提供了工程落地建议:从单工具调用开始,逐步扩

🤖 AI Agents 入门 · Hugging Face 系列 Lesson 1

什么是 Agent?为什么它是 AI 的下一站?

随着大语言模型(LLM)愈发强大,AI 正从 “能聊天” 走向 “能做事”。

而推动这一步跨越的核心技术,正是 Agent(智能体)。

Agent = 不是只会回答,而是能理解、推理、规划、调用工具执行任务的 AI。

本教程基于 Hugging Face 官方 Agents Course 学习总结,面向想系统掌握 AI 智能体的开发者,提供 概念 + 结构 + 实践方向 的全景认知。

适用读者与阅读收获(面向 CSDN)

- 想从“能聊天”走向“能做事”的开发者与从业者

- 需要梳理 Agent 概念、结构与常见场景的读者

- 关注“工具在 Agent 中如何落地”的工程实践者

- 读完可迅速把握:核心概念、结构组成、场景与实践建议

📌 本课重点(读完后你能掌握)

| 知识点 | 是否覆盖 |

|---|---|

| Agent 的直观理解 | ✔ |

| Agent 的正式定义 | ✔ |

| Agent 的组成结构 | ✔ |

| AI 自主能力的层级(Agency Spectrum) | ✔ |

| Agent 用到的模型类型 | ✔ |

| 工具(Tool)在 Agent 中的角色 | ✔ |

| Agent 的典型应用场景 | ✔ |

🧠 1. 直观理解:用“Alfred 管家”解释什么是 Agent

想象你有一个 AI 管家 Alfred——你说:

Alfred,帮我做一杯咖啡。

Alfred会:

- 理解指令:“用户想喝咖啡”

- 推理规划:走到厨房 → 打开咖啡机 → 制作 → 端回咖啡

- 执行动作:使用“咖啡机”这个工具

- 交付结果:把咖啡给你

➡ Alfred 不是“回一句话”,而是“执行任务”

➡ 这就是 Agent 的核心本质:能行动,而不仅是聊天

📌 2. Agent 的正式定义(技术视角)

Agent 是一个利用 AI 模型与环境交互以达成目标的系统,它结合自然语言理解、推理规划与动作执行(通常通过工具)来完成任务。

其中最关键三个关键词:

| 能力 | 说明 |

|---|---|

| 理解 | 接收自然语言指令 |

| 推理 | 分析目标并制定任务步骤 |

| 执行 | 借助工具与环境交互 |

LLM = Agent 的“大脑”

工具(Tools) = Agent 的“身体”

🧩 3. Agent 的组成结构:大脑 + 身体

| 部件 | 功能 | 示例 |

|---|---|---|

| 大脑(AI Model / LLM) | 思考:理解语言、推理规划、决定下一步动作 | GPT、LLaMA、Gemini 等 |

| 身体(Tools / Capabilities) | 行动:执行任务,与环境交互 | 发送邮件、数据库查询、图像生成、Web 搜索等 |

重点:LLM 决定“做什么”,Tools 决定“能做什么”。

🌈 4. Agent 的自主能力等级(Agency Spectrum)

智能体并不是“要么有,要么没有”,而是逐级增强的。

| 等级 | 自主能力 | 类型 | 示例 |

|---|---|---|---|

| ☆ | 不影响程序流程 | Simple Processor | 纯文本回复 |

| ★☆ | 控制基本流程 | Router | if/else 决策跳转 |

| ★★☆ | 选择函数 | Tool Caller | LLM 选择调用哪个工具 |

| ★★★ | 多步骤执行 | Multi-step Agent | 规划连续动作“搜索→提取→总结→回复” |

| ★★★★ | 智能体触发智能体 | Multi-Agent System | A 调用 B 完成协同任务 |

本教程后续章节会从 Tool Caller → Multi-step Agent → Multi-Agent 逐级进阶。

⚙ 5. Agent 使用的模型(LLM 是核心)

| 类型 | 输入 | 输出 | 在 Agent 中的角色 |

|---|---|---|---|

| LLM | 文本 | 文本 | 默认核心引擎(生成推理与计划) |

| VLM | 图像 + 文本 | 文本 | “读图 + 推理” |

| 多模态模型 | 文本 + 图像 + 音频/视频 | 文本 | 未来主流方向 |

第 1 课中我们只使用 LLM 作为 Agent 的大脑。

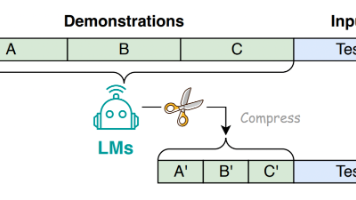

🔌 6. 工具(Tools):Agent 与环境交互的关键

大模型只能输出文本

➡ 无法直接执行任务

➡ 所以需要工具

工具让 LLM 有现实行动能力。

示例:发送邮件工具

def send_message_to(recipient, message):

"""Useful to send an e-mail message to a recipient"""

...

当 Agent 决定执行“给经理发邮件”动作时,将由工具完成真实发送。

工具设计质量 = Agent 能力上限。

这也是为什么企业 Agent 通常需要定制私有工具集。

7. Agent 的典型应用场景

| 场景 | 描述 | 设计工具例子 |

|---|---|---|

| 个人虚拟助手 | 代表用户执行数字指令 | 提醒、发送消息、日历、搜索 |

| 客服智能助手 | 解决问题 + 调用系统 + 创建工单 | FAQ、订单查询、退款、服务状态 |

| 游戏 NPC | 动态对话 & 自适应行为 | 世界状态查询、剧情推进 |

| 数据工作流执行 | 自动流程编排 + 信息采集 | Web 搜索、数据库、文件读写 |

| AI 软件工程师 | 代码生成 + 运行 + 调试 + 测试 | Shell、编译器、Git、测试框架 |

Agent 的能力 = LLM 推理能力 × 工具生态 × 任务场景设计

🛠 实践建议(给工程团队的落地路线)

- 从 Tool Caller 开始:先让 LLM 能“选择并调用”你已有的 2–3 个高频工具(如 Web 搜索、数据库查询、发消息)。

- 明确评估指标:任务完成率、步骤数、出错率、响应时延是通用指标;按场景扩展(如客服的工单关闭率)。

- 渐进演化:从单步 → 多步 → 多智能体协作,每一步都用日志与指标做闭环。

📚 下一课预告

- Lesson 2:从 Tool Caller 到 Multi-step Agent 的工程实践

- Lesson 3:多智能体协作(Multi-Agent)与任务分工策略

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)