推理速度的“新王”!Tokencake框架实测:KV缓存延迟暴降47%,vLLM已不是对手!

大型语言模型(LLM)正越来越多地应用于需要外部函数调用的复杂多智能体场景中。这类工作负载给KV Cache带来了严峻的性能挑战:空间竞争会导致关键智能体的缓存被驱逐,而时间利用率低下使得运行工具调用等待期间,停滞的智能体缓存长时间闲置于GPU内存中。

大型语言模型(LLM)正越来越多地应用于需要外部函数调用的复杂多智能体场景中。这类工作负载给KV Cache带来了严峻的性能挑战:空间竞争会导致关键智能体的缓存被驱逐,而时间利用率低下使得运行工具调用等待期间,停滞的智能体缓存长时间闲置于GPU内存中。

针对上述挑战,北京航空航天大学联合北京大学、阿里的研究者提出了一种以KV Cache为中心的多智能体应用服务框架Tokencake,通过智能体感知设计协同优化调度与内存管理。其中,空间调度器采用动态内存分区机制保护关键智能体免受资源争用影响,时间调度器则通过主动卸载与预测性加载策略,在函数调用阻塞期间重新配置GPU内存。在典型多智能体基准测试中,Tokencake相较于vLLM可将端到端延迟降低47.06%以上,并使GPU内存有效利用率提升16.9%。

-

论文标题:

Tokencake: A KV-Cache-centric Serving Frameworkfor LLM-based Multi-Agent Applications

-

论文链接:

https://arxiv.org/pdf/2510.18586

01 方法

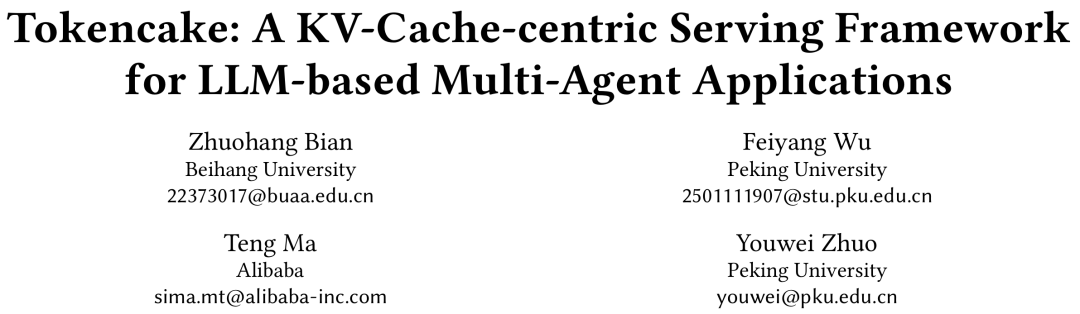

Tokencake 旨在通过从时间和空间两个维度管理KV Cache资源,以优化多智能体应用的性能。图4展示了Tokencake的架构,包含三个核心组件:前端API、空间调度器和时间调度器。这些组件协同工作,共同管理GPU内存中KV Cache块的整个生命周期。

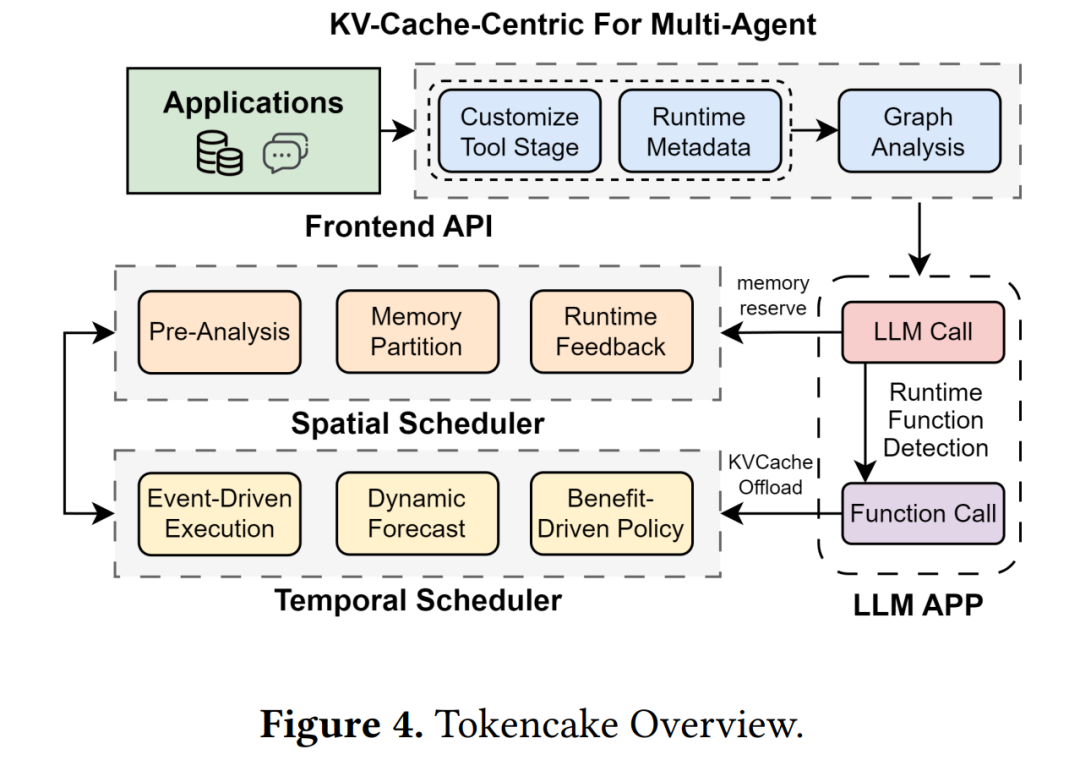

前端 API 将用户定义的应用逻辑转换为一个可优化的图结构。图5展示了如何使用该API构建一个简单的RAG应用。该图结构随后被两个专用调度器所使用。

图6展示了空间调度器与时间调度器之间的紧密协作。空间调度器负责管理不同智能体之间全局内存的分配,时间调度器则处理单个智能体请求随时间变化的内存生命周期。它们协调工作最为关键的地方在于两者策略的交汇点。

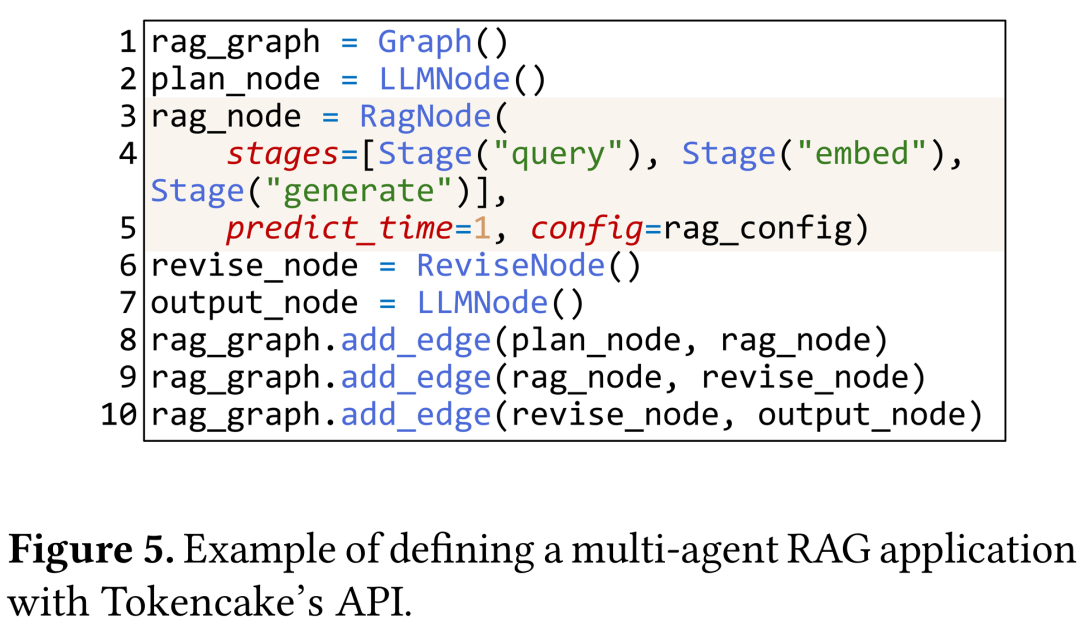

时间调度器致力于最大化 KV Cache 利用率,在智能体执行长时间的外部操作(例如函数调用)期间,将其 KV Cache 卸载到 CPU 内存中,并根据对外部调用执行时间的预估,在下次使用前将其预测性传回GPU。

只有当释放GPU资源带来的预期收益超过数据传输成本时才会启动卸载操作,需要实时分析预测函数调用时长、KV Cache大小、等待请求队列状态等多个动态因素。时间调度器的决策逻辑如算法1所示。

尽管 Tokencake 的主动卸载与上传机制是其性能的核心,但CPU同时分配或释放大量内存块操作可能引入显著的延迟,从而影响主调度循环。为减轻这种延迟,研究团队引入了两项针对性的优化:

研究团队实现了一个专用的CPU块缓冲区。Tokencake 不再将内存块释放回操作系统,而是将其返回到一个轻量级的内部空闲列表。后续的卸载操作会优先从此缓冲区中满足其分配请求,从而规避关键路径上的高成本系统调用。这一设计使得大型卸载操作的内存管理延迟从最坏情况下的近秒级降至稳定的亚毫秒级。

Tokencake 利用预测模型执行渐进式内存块预留,基于函数调用预计完成时间,调度器会在上传操作启动前的多个调度周期内开始逐步预留所需的 GPU 内存块。这种方法通过将一次大的分配请求分解为一系列小请求,确保预测上传触发时目标内存块已就绪,从而避免分配阻塞并大幅提升操作可靠性。

空间调度器旨在通过感知各智能体重要性来解决内存管理问题。如图8所示,该调度器采用基于混合优先级指标的动态内存分区策略,将GPU的KV Cache划分为两个区域:面向所有智能体的全局共享池,以及仅限****最关键智能体访问的预留池。该策略确保即使共享池使用率较高时,关键智能体仍能获得有保障的内存资源,避免被低优先级任务阻塞。

**空间调度器会周期性计算各智能体类型的混合优先级综合得分,得分排名靠前的指定为关键智能体。**这种动态选择机制确保受保护的智能体集合能随应用需求变化而自适应调整。

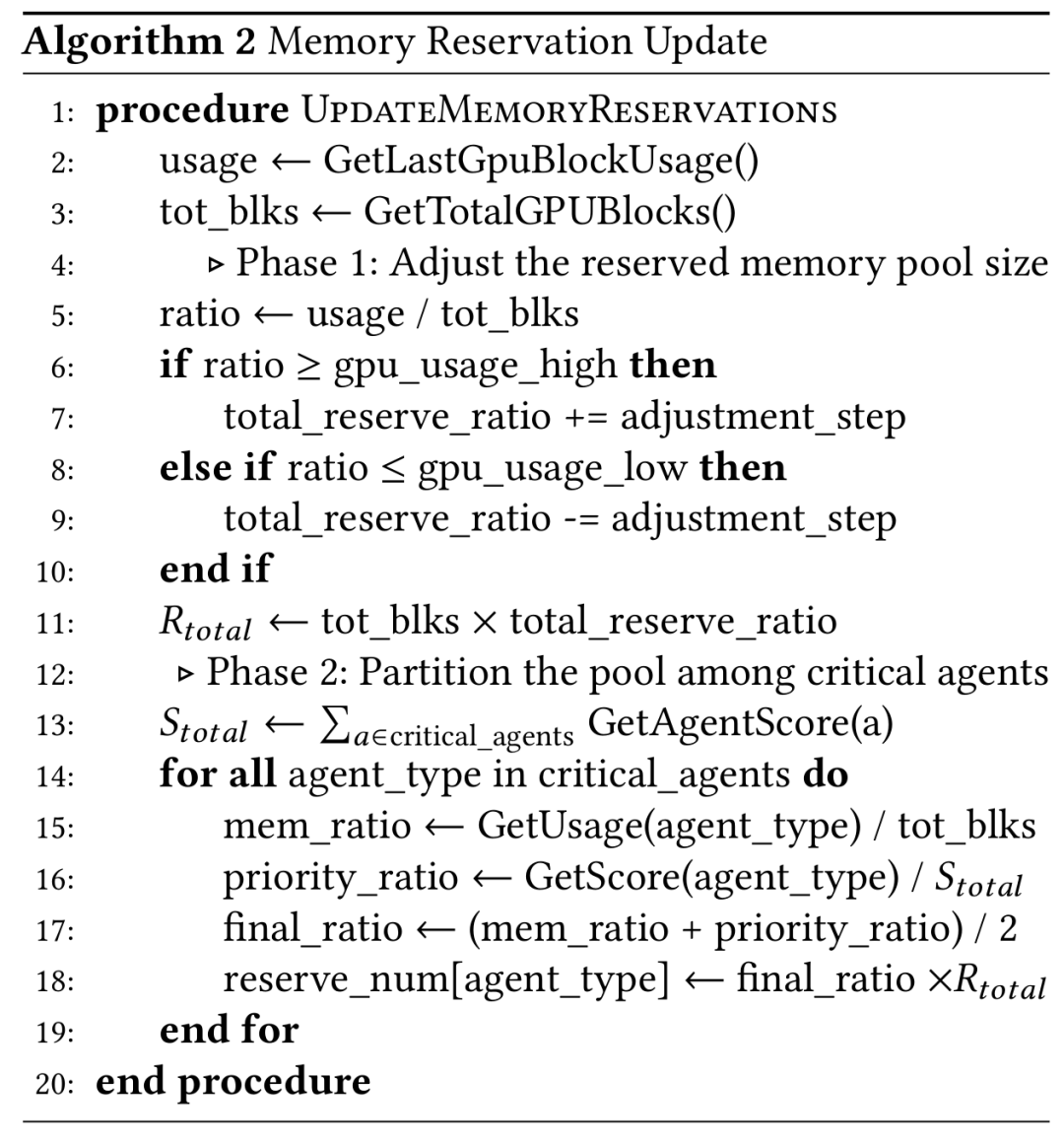

一旦确定了关键智能体,空间调度器就会根据算法2中的两阶段过程更新内存预留:

- 阶段1(第5-11行):基****于当前GPU块使用率计算系统内存压力,动态调整预留内存池总容量。当内存使用率较高时,系统会提升total_reserve_ratio以增强对关键任务的保护;当使用率较低时则降低该比率,避免共享池可用内存的浪费。

- 阶段2(第13-19行):给每个关键智能体分配预留池(R_total)容量。每个智能体的配额由两大因素的加权平均值决定:该智能体的历史内存使用量(第15行)及其相对优先级得分(第16行)。这种均衡分配方式确保那些兼具高优先级与高内存需求特征的智能体获得更大的预留空间。

02 评估

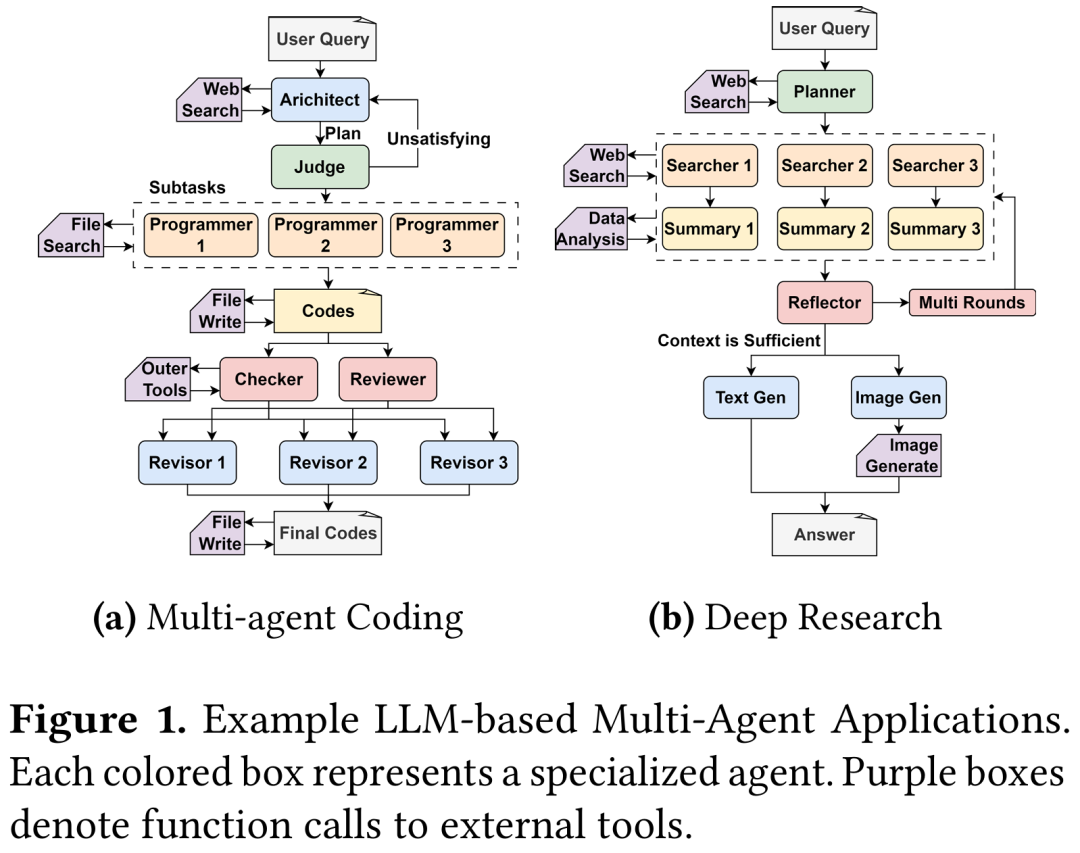

为了确保能够反映真实的场景的评估,研究团队实现了两个具有代表性的多智能体应用:代码编写者(Code-Writer)和深度研究(Deep Research),如图1所示。

基准测试的用户请求基于ShareGPT和AgentCode数据集生成,这些数据集包含真实世界中的对话数据。为了模拟动态的用户环境,使用泊松分布生成请求到达时间,通过调整每秒应用请求数量来评估系统在不同负载条件下的性能表现。

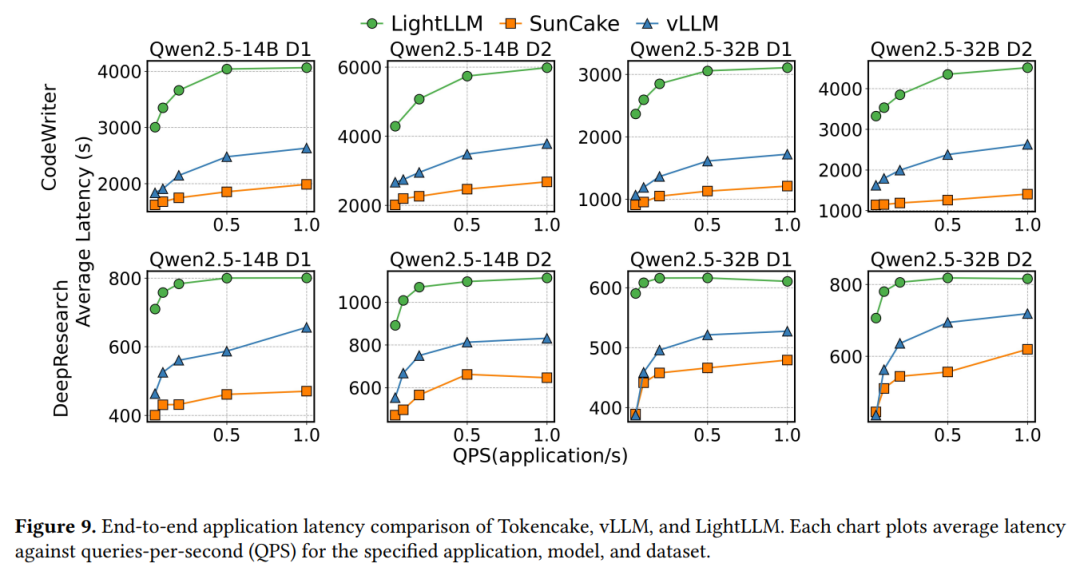

注:Tokencake在图例中是SunCake

如图9所示,Tokencake 的延迟随负载增加呈现出更平缓的上升趋势。通过智能地卸载停滞智能体的 KV Cache,Tokencake释放了宝贵的GPU内存,使其能为活跃请求维持更大、更高效的批处理大小。

在 1.0 QPS 的高负载下,Tokencake相较vLLM基线可降低47.06%以上的平均端到端延迟。这一结果充分证明,Tokencake在多智能体工作负载的严苛条件下能持续保持高性能与稳定性,而LightLLM等专用系统在此场景中表现不佳。

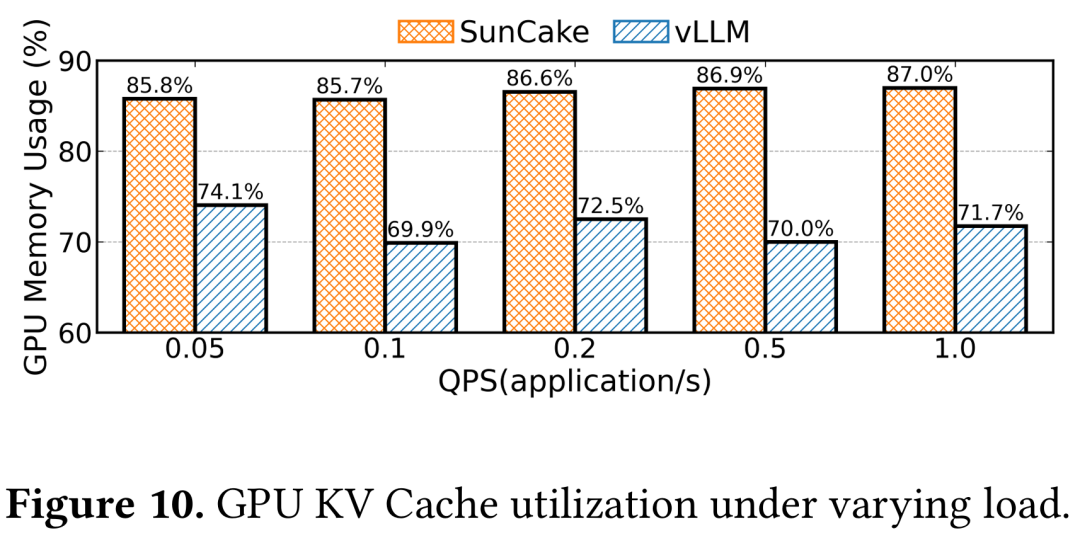

图10显示Tokencake在所有负载下,始终维持更高的平均 GPU KV Cache 使用率,相比vLLM最高提升16.9%。

注:Tokencake在图例中是SunCake

那么,如何系统的去学习大模型LLM?

作为一名深耕行业的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

更多推荐

已为社区贡献282条内容

已为社区贡献282条内容

所有评论(0)