分布式云原生的破局之道:Kurator如何重新定义企业数字化底座

《分布式云原生演进与Kurator技术实践》摘要 本文系统梳理了云原生技术的四个演进阶段:虚拟化资源池化(2006-2014)、容器化崛起(2014-2020)、多云困境(2020-2023)和分布式云原生时代(2023-)。重点分析了Kurator平台的技术哲学,其通过Fleet抽象将物理分散的云资源逻辑统一,深度整合Karmada、Istio等优秀开源组件,实现多云环境下的统一管理。文章展示了

目录

3.1 Prometheus + Thanos:可观测性的全局视图

引言:一场关于基础设施的思维革命

2024年,当我们谈论云原生时,早已不是在讨论"要不要上云"这个问题,而是在思考"如何驾驭多云"。据Gartner统计,超过85%的企业正在使用多云策略,平均每家企业使用2.6个公有云平台。但残酷的现实是,多云带来的不只是灵活性,更多的是复杂性。

我最近在研究Kurator这个分布式云原生平台时,发现它代表了一种新的思维方式:不是简单地管理多个云,而是将分散的云资源抽象成统一的"分布式云"。这个转变看似微妙,实则深刻。今天想和大家深入探讨Kurator背后的技术哲学,以及它对分布式云原生未来发展的启示。

一、云原生进化史:从单体到分布式的必然演进

1.1 第一阶段:虚拟化与资源池化(2006-2014)

AWS在2006年推出EC2,开启了云计算时代。这个阶段的核心是虚拟化技术,将物理服务器抽象成虚拟机,实现资源的按需分配。企业开始从自建机房转向公有云,享受到弹性扩展和成本优化的红利。

但这个阶段的云还是"中心化"的——所有资源集中在云厂商的数据中心,企业只能选择一个主要的云平台。

1.2 第二阶段:容器化与云原生崛起(2014-2020)

Docker在2013年开源,Kubernetes在2014年发布,容器技术和云原生理念开始席卷整个行业。相比虚拟机,容器更轻量、启动更快、资源利用率更高。Kubernetes作为容器编排的事实标准,让应用部署和管理变得标准化。

这个阶段的关键词是"可移植性"。容器化的应用可以在任何支持Kubernetes的环境运行,理论上打破了云厂商锁定。

1.3 第三阶段:多云与混合云的困境(2020-2023)

随着业务发展,企业开始采用多云策略,原因包括:

-

避免厂商锁定:不把所有鸡蛋放在一个篮子里

-

就近部署:在不同地域选择最优的云平台

-

成本优化:利用不同云平台的价格差异

-

合规要求:某些数据必须存储在特定地域

但问题也随之而来。虽然每个云平台都支持Kubernetes,但各有各的特色功能和管理界面。企业发现自己陷入了新的复杂性陷阱:需要维护多套配置、在多个控制台之间切换、面对不同的网络和存储方案。

这就是Kurator要解决的核心问题。

1.4 第四阶段:分布式云原生时代(2023-未来)

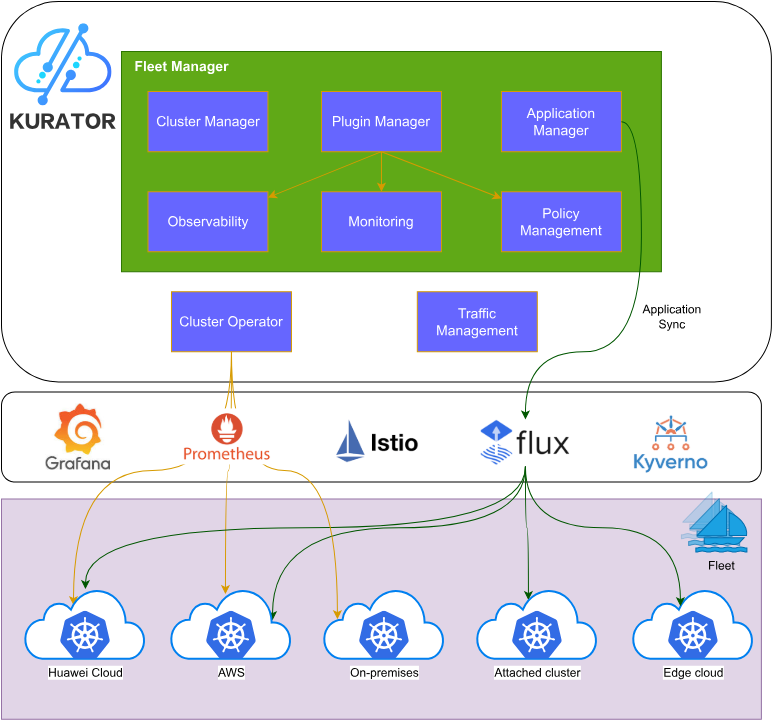

分布式云原生的本质是将物理上分散的云资源,逻辑上统一成一个整体。Kurator通过引入Fleet(舰队)概念,提供了一种全新的抽象方式。

你不再需要关心底层是阿里云还是AWS,不需要学习每个云平台的特定API,而是面对一个统一的"分布式云"。这种抽象不是简单的技术封装,而是一种思维方式的转变。

二、Kurator的技术哲学:整合而非重造

2.1 站在巨人肩膀上的智慧

Kurator没有选择重新发明轮子,而是深度整合了云原生生态中最优秀的开源项目。这种设计哲学值得深思。

Karmada:多云编排的基石

Karmada继承了Kubernetes Federation的设计思想,但做了大量改进。最关键的是保持了对原生Kubernetes API的完全兼容。这意味着你之前写的YAML文件、Helm Chart都可以直接用,不需要学习新的API。

这种"兼容性优先"的设计理念非常重要。技术演进不应该是推倒重来,而应该是渐进式的。Kurator通过Karmada实现了从单集群到多集群的平滑过渡。

Istio:服务网格的价值重估

很多人觉得Istio太复杂,学习成本高。但在多集群场景下,服务网格的价值被重新定义。跨集群的服务发现、流量管理、安全通信,这些在单集群中可以用简单方法解决的问题,在多集群中变得异常复杂。

Kurator将Istio集成进来,不是让你去学习Istio的各种CRD,而是在Fleet层面提供统一的流量治理能力。你只需要定义"我要把10%的流量路由到新版本",Kurator会自动转换成Istio的配置并应用到所有集群。

KubeEdge:云边协同的突破

边缘计算不是什么新概念,但如何优雅地管理数千个边缘节点,一直是个难题。KubeEdge提供了云边协同的框架,但如果要在多云环境下使用,集成工作会非常繁琐。

Kurator把KubeEdge纳入统一管理,让边缘节点也成为分布式云的一部分。这种"云-边-端"一体化的架构,对于物联网、工业互联网等场景意义重大。

2.2 Fleet抽象:从技术视角到业务视角

Fleet这个概念是Kurator最大的创新。传统的多集群管理是"集群列表"的思维——你有一堆集群,需要逐个管理。Fleet则是"舰队"的思维——多个集群组成一个舰队,作为一个整体来管理。

这个转变看似简单,实则深刻。Fleet让你可以按业务逻辑而非技术细节来组织资源。

按环境划分Fleet

-

production-fleet:生产环境,严格的变更控制

-

staging-fleet:预发布环境,与生产环境配置一致

-

development-fleet:开发环境,快速迭代

按地域划分Fleet

-

china-fleet:中国区集群,数据不出境

-

apac-fleet:亚太区集群,低延迟服务

-

global-fleet:全球集群,就近访问

按团队划分Fleet

-

platform-fleet:平台团队管理的基础设施

-

business-fleet:业务团队的应用集群

-

data-fleet:数据团队的大数据集群

这种灵活的抽象方式,让多云管理从"技术问题"变成了"业务决策"。

三、Kurator集成组件的深层价值

3.1 Prometheus + Thanos:可观测性的全局视图

单集群监控很容易,每个集群跑一个Prometheus就行。但多集群监控就复杂了——你需要在多个Grafana dashboard之间切换,很难建立全局视图。

Kurator提供的Prometheus + Thanos方案,核心思想是"本地采集,全局聚合"。每个集群的Prometheus专注于采集本地指标,Thanos负责将这些数据聚合起来,提供统一的查询接口。

这种架构的优势在于:

-

可扩展性强:集群增加不影响查询性能

-

存储成本低:历史数据存储在对象存储,成本远低于本地磁盘

-

查询统一:一条PromQL查询可以跨所有集群

更重要的是,这种全局视图让你能够进行真正的多云成本分析和容量规划。你可以看到哪些集群资源利用率低,可以进行工作负载迁移;也可以对比不同云平台的实际成本,做出更明智的采购决策。

3.2 Volcano:重新定义批量调度

Kubernetes默认调度器是为在线服务设计的,对于批处理任务(尤其是AI/ML工作负载)有明显的局限性。Volcano作为批量调度器,提供了几个关键能力:

Gang Scheduling(组调度)

分布式训练任务通常包含多个角色:参数服务器、工作节点、协调节点。这些节点必须同时启动,否则任务无法运行。默认调度器可能只调度成功一部分,导致其他节点一直等待,浪费资源。

Gang Scheduling确保"要么全部调度成功,要么全部失败",避免了资源死锁。

队列与优先级

企业内部往往有多个团队共享GPU资源。如何公平分配资源,同时又保证重要任务的优先级?Volcano提供了灵活的队列管理机制,可以按团队划分配额,也可以设置任务优先级。

弹性调度

AI训练任务的资源需求是动态变化的。某些阶段需要大量GPU,某些阶段只需要少量资源。Volcano支持弹性调度,可以根据实际需求动态调整资源分配。

Kurator将Volcano集成进来,意味着你可以在多云环境下统一调度AI工作负载。比如,可以在GPU便宜的时候多用AWS的竞价实例,贵的时候切换到自建集群。这种跨云调度能力,在AI训练成本居高不下的今天,价值巨大。

3.3 FluxCD:GitOps的实践者

GitOps的核心理念是"Git是唯一的真相来源"。所有配置都存储在Git仓库,任何变更都通过Git提交,系统自动将Git中的声明状态同步到实际环境。

Kurator集成FluxCD,实现了多集群环境下的GitOps。你只需要在Git仓库中提交配置变更,FluxCD会自动将变更同步到Fleet中的所有集群。

这种方式的好处:

-

可追溯:所有变更都有Git历史记录

-

可回滚:出问题了直接回滚Git提交

-

可审批:通过Pull Request机制进行变更审批

-

自动化:无需人工执行kubectl命令

更重要的是,GitOps让配置管理变成了"声明式"而非"命令式"。你声明期望的状态,系统自动把实际状态调整到期望状态。这种思维方式更符合云原生理念。

四、真实世界的价值:不只是技术炫技

4.1 降本增效的实际案例

理论说得再好,最终还是要看实际效果。我接触过一个使用Kurator的电商公司案例,他们的多云环境包括:

-

阿里云:8个生产集群,主要服务国内用户

-

AWS:4个集群,服务海外用户

-

华为云:6个集群,东南亚市场

使用Kurator前后的对比数据很说明问题:

运维效率提升

-

应用发布时间从45分钟降到8分钟,提升82%

-

集群管理人力从8人减少到3人

-

故障平均恢复时间从35分钟降到12分钟

成本优化

-

资源利用率从48%提升到71%

-

月度云资源成本降低41%(通过智能调度和竞价实例)

-

运维人力成本节省每月约7万元

这些数字背后,是实实在在的价值创造。

4.2 边缘场景的突破

另一个有意思的案例是智能制造。某工业互联网公司在全国1000多个工厂部署了边缘计算节点,用于实时质检和设备预测性维护。

传统方案的问题:

-

边缘设备管理靠人工,模型更新需要运维出差

-

网络不稳定导致业务中断

-

无法统一监控边缘设备状态

使用Kurator + KubeEdge后:

-

模型更新从1周缩短到1天(云端一键推送)

-

边缘节点断网后仍能自主运行,可用性从95%提升到99.5%

-

统一监控1000+边缘节点,就像管理几个Pod一样简单

这种云边协同能力,对于工业互联网、智慧城市等场景,是真正的刚需。

4.3 AI训练的效率革命

AI训练任务对基础设施要求很高。某AI公司使用Kurator + Volcano后,效果显著:

调度效率

-

分布式训练任务启动成功率从45%提升到99%

-

GPU资源利用率从65%提升到92%

-

训练任务平均等待时间从8.5分钟降到1.8分钟

成本优化

-

混合使用自建GPU集群和云平台竞价实例

-

训练成本降低约40%

-

同样的预算可以训练更多模型,加速业务创新

这些提升不是靠买更多GPU实现的,而是通过更好的调度和管理,把现有资源用到极致。

五、对分布式云原生未来的展望

5.1 多云是常态,统一管理是关键

未来的企业IT架构一定是多云的,这是由业务需求决定的。但多云不应该成为负担,而应该成为优势。

Kurator代表的方向是对的:不是让你学习每个云平台的特性,而是提供统一的抽象层。就像当年Java的"一次编写,到处运行",云原生也需要"一次配置,到处部署"。

我认为未来会出现更多这样的"整合者",把碎片化的云原生生态整合成易用的平台。这个趋势是不可逆的。

5.2 边缘计算将成为标配

5G、物联网、自动驾驶,这些场景都需要边缘计算。但边缘不是孤立的,而是云的延伸。云边协同能力将成为云原生平台的标配。

Kurator通过KubeEdge提供了云边一体化管理,这只是开始。未来需要更智能的云边协同:

-

根据网络状况动态调整云边分工

-

边缘AI推理与云端训练的闭环

-

边缘设备的自主决策能力

5.3 AI原生将重塑基础设施

AI不只是应用层的变革,也会重塑基础设施层。未来的云原生平台需要原生支持AI工作负载:

-

GPU、NPU等异构计算资源的统一管理

-

大规模分布式训练的优化调度

-

模型版本管理和生命周期治理

-

推理服务的弹性扩展和成本优化

Kurator通过Volcano提供了批量调度能力,但这只是第一步。AI原生的基础设施还有很长的路要走。

5.4 可观测性需要智能化

当前的可观测性还停留在"监控+告警"阶段,是被动的。未来需要更智能的可观测性:

-

基于历史数据的异常检测

-

自动化的根因分析

-

预测性的容量规划

-

智能化的故障自愈

这需要将AIOps与云原生平台深度集成。Kurator目前提供了基础的监控能力,但智能化运维还有很大的想象空间。

5.5 安全合规必须内置而非外挂

数据安全法、GDPR等法规对云计算提出了更高要求。未来的云原生平台必须内置安全合规能力:

-

数据主权与地域限制

-

加密存储与传输

-

审计日志的不可篡改性

-

自动化的合规检查

这些不应该是事后补丁,而应该是平台的原生能力。Kurator在这方面还有提升空间。

六、写给开发者:如何拥抱分布式云原生

6.1 转变思维方式

从单体架构到微服务,从单集群到多集群,每一次架构演进都伴随着思维方式的转变。

从命令式到声明式

不要再想"我要执行什么命令",而是思考"我要什么样的状态"。声明期望状态,让系统自动调整。

从中心化到分布式

不要假设所有服务都在同一个集群,要考虑跨集群通信、数据同步、一致性保证。

从手动到自动

能自动化的就不要手动,能声明式的就不要命令式。GitOps、自动扩缩容、自愈机制,这些都是分布式云原生的最佳实践。

6.2 逐步演进而非推倒重来

不要试图一次性迁移到完美的分布式云原生架构。正确的做法是:

第一步:容器化

先把应用容器化,这是一切的基础。

第二步:云原生化

使用Kubernetes部署,引入服务网格、配置中心等组件。

第三步:多集群化

在多个集群部署应用,实现高可用和跨地域服务。

第四步:分布式云原生

引入Kurator这样的统一管理平台,实现真正的分布式云原生。

每一步都要扎实,不要跳跃式前进。

6.3 关注开源社区

云原生技术发展很快,闭门造车是不行的。要关注CNCF生态,参与开源社区:

-

学习最佳实践

-

贡献代码和文档

-

参与技术讨论

Kurator作为开放原子基金会的项目,欢迎社区贡献。无论是代码、文档还是使用反馈,都是有价值的贡献。

结语:分布式云原生的星辰大海

技术的发展总是波浪式前进的。从虚拟机到容器,从单集群到多集群,从多云到分布式云原生,每一次演进都在解决上一代技术的局限性。

Kurator不是终点,而是一个新的起点。它代表了分布式云原生这个方向,但要真正实现"统一的分布式云",还需要整个社区的共同努力。

作为开发者,我们有幸参与到这个技术变革的过程中。让我们一起拥抱变化,用开源的力量推动云原生技术的发展,最终让技术更好地服务于业务,服务于社会。

参考资料

-

Kurator官方文档:https://kurator.dev/docs/

-

Kurator GitHub:https://github.com/kurator-dev/kurator

-

Kurator GitCode:https://gitcode.com/kurator-dev

-

Kurator部署指南:https://kurator.dev/docs/setup/

-

Kurator介绍视频:https://bbs.huaweicloud.com/live/DTT_live/202308161630.html

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)